Negli anni '90 era il DNA.

Negli anni 2000, si trattava dei ping dei ripetitori cellulari.

Ma nel 2026 il nuovo standard di prova è l'impronta digitale.

Vedila in questo modo...

Ogni file video ha una firma unica.

Se anche un solo pixel viene alterato dall'intelligenza artificiale, l'impronta digitale cambia istantaneamente.

Se la vostra prova dell'IA non ha un timestamp verificato su blockchain per bloccare l'impronta digitale, potrebbe anche essere un cartone animato agli occhi di un giudice moderno.

Questo significa che l'era del “vedere per credere” è finita.

Siamo entrati nell'era della verifica video AI, dove la prova non si trova in ciò che si vede, ma nel codice digitale nascosto sotto la superficie.

In questo blog analizzeremo perché le prove tradizionali falliscono contro le frodi video, come individuare le clip manipolate, perché la verifica è fondamentale per l'ammissibilità e perché un rilevatore video AI come TruthScan è ora essenziale per i team legali.

Immergiamoci in questa storia.

Punti di forza

- Nel 2026, tutte le prove video dovranno essere sottoposte a verifica video AI per essere considerate affidabili.

- La frode video include piccoli ritocchi come la manipolazione del timestamp, non solo la sostituzione completa dei volti.

- Un rilevatore di deepfake professionale è l'unico modo per individuare gli artefatti GAN che sfuggono agli esseri umani.

- Nuove regole come la Federal Rule 707 stanno standardizzando le modalità di ammissione delle prove di AI in tribunale.

- L'analisi automatizzata delle prove consente agli studi di elaborare in modo rapido e accurato pacchetti massicci di documenti.

- TruthScan previene le frodi durante le audizioni dal vivo rilevando in tempo reale le maschere sintetiche.

Che cos'è la prova video nelle controversie legali?

Le prove video sono fondamentalmente clip registrate utilizzate in tribunale per dimostrare ciò che è accaduto. Dai casi penali ai risarcimenti assicurativi, sono ovunque.

Tuttavia, nel 2026, l'aumento delle frodi video ha reso “vedere per credere” un'ipotesi pericolosa. I professionisti del settore legale hanno ora bisogno di una solida verifica video AI per garantire l'integrità del sistema giudiziario.

Tipi di prove video che i tribunali utilizzano quotidianamente

Non preoccupatevi più delle frodi dell'IA. TruthScan Può aiutarvi:

- Rilevare l'IA generata immagini, testo, voce e video.

- Evitare frodi di grande portata guidate dall'intelligenza artificiale.

- Proteggete i vostri prodotti più sensibile beni dell'impresa.

- Sorveglianza (TVCC): Telecamere di negozi o semafori. È la prova più comune nei casi penali.

- Body Cam: Filmati di agenti di polizia, utilizzati soprattutto in casi di diritti civili o di uso eccessivo della forza.

- Telecamere da cruscotto: La prova di riferimento per gli incidenti d'auto e le controversie assicurative.

- Testimonianze registrate: Le deposizioni video o le testimonianze a distanza sono diventate normali dopo la pandemia. Sono ormai uno standard, ma sono soggetti a problemi di individuazione delle frodi legali.

- Smartphone e social media: Video di astanti o post che dimostrino il comportamento o la posizione di qualcuno.

- Sicurezza aziendale: Filmati utilizzati dalle aziende per casi di frode o di “licenziamento illegittimo”.

L'intelligenza artificiale generativa e la tecnologia deepfake hanno aggiunto un nuovo livello di rischio. Nel 2025:

- 1 verifica di identità su 20 è stata ingannata da AI deepfakes

- Un sondaggio Medius ha riportato che 43% di professionisti sono stati vittime di un tentativo di frode deepfake

Casi reali di frode delle prove video

- Filmati manipolati in aula

I filmati manipolati in aula si riferiscono a qualsiasi prova video o audio presentata in un caso legale che è stata alterata, modificata o completamente fabbricata utilizzando la tecnologia.

Esempi:

- Caso deepfake della contea di Alameda (2025): Una causa civile in California è stata annullata dopo che il tribunale ha scoperto che il video di un testimone presentato come prova era stato completamente creato utilizzando l'intelligenza artificiale.

- La difesa da deepfake di Sz Huang contro Tesla (2023): In una causa per omicidio colposo, gli avvocati di Tesla hanno sostenuto che il filmato chiave dell'incidente potrebbe essere un falso.

Video di sorveglianza alterati

I video di sorveglianza sono uno dei tipi più comuni di prove di IA utilizzate in tribunale. Tuttavia, molte persone pensano erroneamente che la manipolazione riguardi solo i deepfake completi.

In realtà, le frodi video avvengono spesso in modi più piccoli e meno evidenti che possono compromettere un caso.

I tipi più comuni di manipolazione includono:

- Modifiche del timestamp

- Rimozione del telaio

- Modifiche ai metadati o al GPS

- Sostituzione del viso

- Rimozione o inserimento di oggetti

- Filmati in loop

- Degrado della qualità

I video di sorveglianza provengono spesso da luoghi diversi, come negozi privati, campanelli di casa, parcheggi e telecamere cittadine. A differenza dei filmati delle telecamere della polizia, questi sistemi di solito non seguono le regole della catena di custodia.

Ciò significa che:

- Potrebbe non esserci una traccia chiara di chi ha gestito la pratica.

- Il filmato può essere copiato, trasferito o convertito più volte.

- Le procedure di autenticazione possono essere deboli o incoerenti.

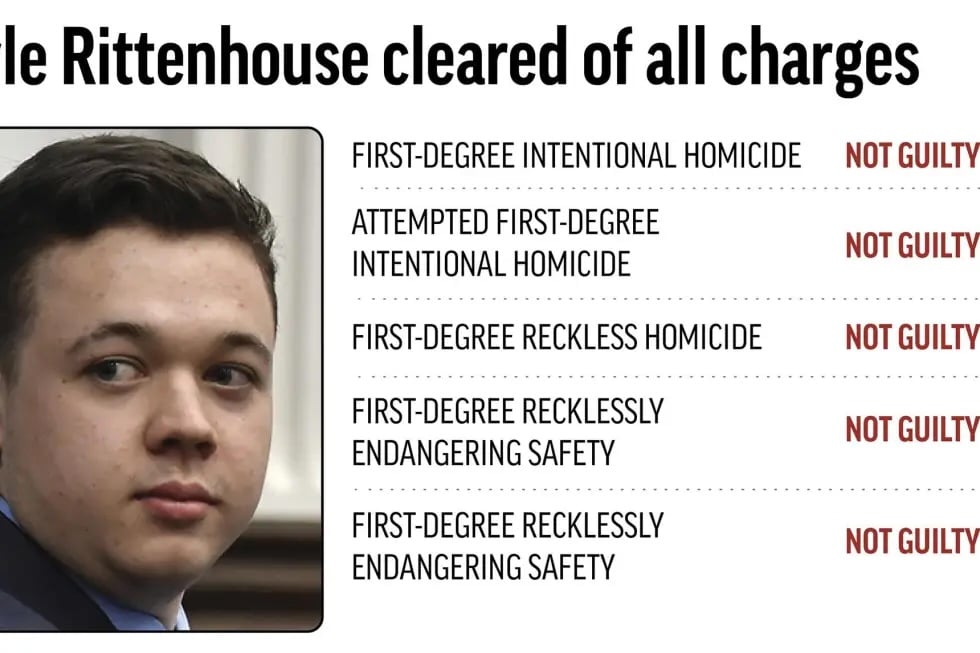

Esempio: La questione del potenziamento dell'AI in Wisconsin v. Rittenhouse

Un esempio famoso è quello del processo Wisconsin contro Rittenhouse. L'accusa ha cercato di utilizzare la funzione pinch-to-zoom di un iPad per mostrare i dettagli di un video di un drone.

La difesa ha sostenuto che lo zoom di Apple utilizza l'interpolazione AI per indovinare ciò che dovrebbe essere presente. Il giudice ha stabilito che senza un rilevatore video AI professionale, il filmato migliorato non può essere ammesso.

Testimonianze video contestate

Una testimonianza video contestata richiede di solito un rilevamento di frode legale per determinare se una registrazione è..:

- Una deposizione o dichiarazione completamente inventata

- Una testimonianza reale contestata come falsa

- Una registrazione reale manipolata

Ogni scenario crea un serio onere di autenticazione per il tribunale.

Esempio: Il caso di affidamento dei figli nel Regno Unito

In una controversia giudiziaria britannica citata dalla University of Baltimore Law Review, una madre ha presentato una registrazione pesantemente alterata per ritrarre il padre come violento durante una battaglia per la custodia.

L'obiettivo era quello di limitare l'accesso ai figli.

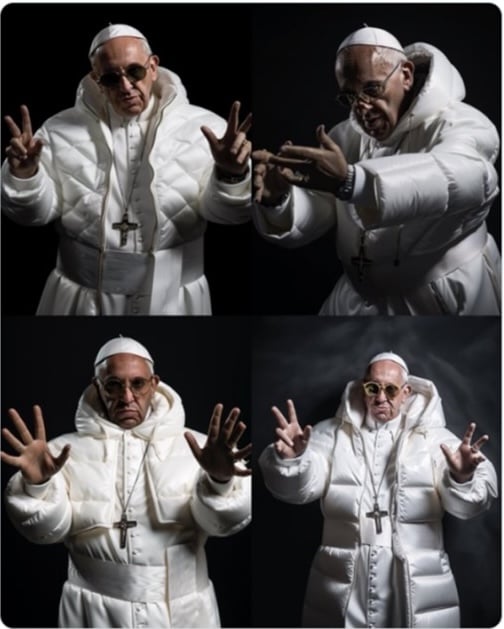

L'ascesa dei video generati dall'intelligenza artificiale nelle questioni legali

Il viaggio verso l'attuale era dei rilevatori di deepfake si è sviluppato in fasi distinte:

- Gli anni dell'allarme (2017-2021)

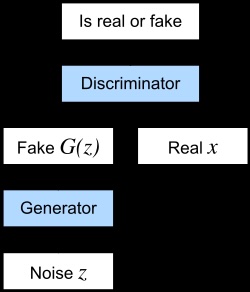

La tecnologia Deepfake (alimentata da reti generative avversarie (GAN)) è entrata nell'occhio del pubblico intorno al 2017.

I primi deepfake erano spesso di bassa qualità: volti con strane distorsioni, dita in più, illuminazione non corrispondente e tratti sfocati che li rendevano facilmente individuabili.

- La fase di escalation (2022-2023)

Nel 2022 la tecnologia è migliorata. Molti erano gratuiti e utilizzabili su smartphone.

Nel 2023, abbiamo iniziato a vedere alcune delle prime sfide significative legate al deepfake in cause giudiziarie, tra cui Sz Huang contro Tesla, Stati Uniti contro Reffitt e Stati Uniti contro Doolin, in cui gli avvocati hanno sollevato dubbi sul fatto che le prove video potessero essere generate dall'intelligenza artificiale.

Nello stesso periodo, il Comitato consultivo per le regole sulle prove dell'American Bar Association ha iniziato a studiare formalmente la questione.

- La soglia critica (2024-2025)

I contenuti generati dall'intelligenza artificiale non sono rimasti accademici a lungo. Nel 2024, un incidente dello studio di ingegneria Arup, che ha coinvolto una videochiamata fittizia generata dall'IA che autorizzava una frode, è stato risolto. bonifici bancari per un totale di $25 milioni di euro.

Il sistema legale ha iniziato a rispondere.

Nel 2025, La Louisiana ha approvato la HB 178, creando il primo quadro di verifica delle prove di AI a livello statale.

A livello federale, il Comitato consultivo statunitense per le regole sulle prove ha proposto di Regola 707, incentrata sulle prove generate dalla macchina.

A che punto è la situazione nel 2026

A partire dall'inizio del 2026, la regolamentazione dei deepfake e dei video AI ha subito un'accelerazione a livello nazionale:

- 46 Stati hanno approvato una qualche forma di legislazione sul deepfake.

- Dal 2022, Solo nel 2025 sono state promulgate 169 leggi e introdotte 146 proposte di legge..

- La regola federale 707 è aperta ai commenti del pubblico fino al 16 febbraio 2026.

Migliorare la verifica video con l'intelligenza artificiale

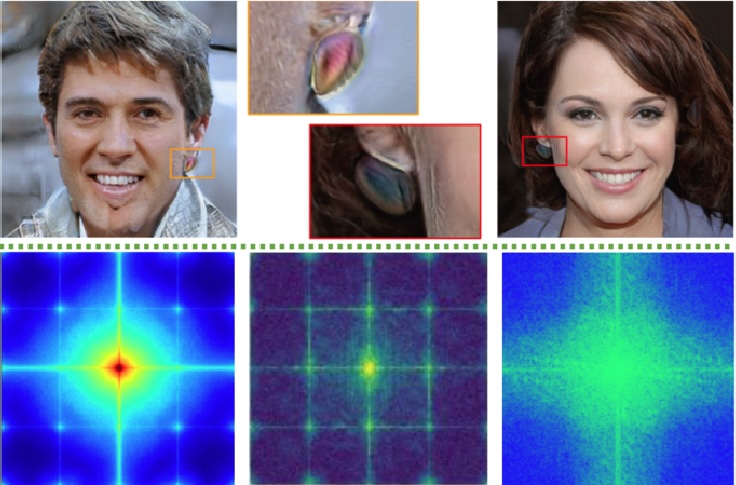

Il modo più efficace per rilevare i video generati dall'IA è utilizzare l'IA stessa.

Questo perché i deepfake sono creati da sistemi di apprendimento automatico che lasciano dietro di sé sottili schemi digitali.

Questi schemi sono troppo piccoli o complessi per essere notati dall'occhio umano. Ma possono essere rilevati da altri algoritmi.

Un sistema affidabile di verifica video AI è in grado di analizzare contemporaneamente più livelli di un video, tra cui:

- Analisi a livello di cornice controlla ogni fotogramma per verificare la presenza di errori visivi, come texture strane, disadattamento dell'illuminazione o problemi di fusione intorno ai volti.

- Analisi della coerenza temporale esamina il movimento tra i fotogrammi per individuare salti innaturali o movimenti incoerenti.

- Tracciamento dei punti di riferimento facciali monitora il movimento degli occhi, l'ammiccamento e la forma del viso per rilevare cambiamenti innaturali.

- Test di sincronizzazione audiovisiva controlla se i movimenti delle labbra corrispondono esattamente alle parole pronunciate.

- Audio forense analizza la voce alla ricerca di segni di clonazione, come modelli di suono insoliti o toni robotici.

- Analisi dei metadati e della compressione L'esame dei dati dei file nascosti è fondamentale per il rilevamento delle frodi legali, per verificare se corrispondono ai dettagli della registrazione originale.

Formazione dei team legali sulle frodi video

Poiché l'IA è in grado di imitare il comportamento umano con un'accuratezza spaventosa, gli studi legali stanno utilizzando l'analisi automatizzata delle prove e un mix di tattiche tradizionali per essere all'avanguardia.

| Categoria | Metodo | Descrizione |

| Modi ufficiali | Crediti CLE (Educazione Legale Continua) | Corsi obbligatori o elettivi che insegnino agli avvocati come autenticare le prove digitali, comprendere i deepfakes e soddisfare gli standard probatori. |

| Esperti di intelligenza artificiale nominati dal tribunale | Istituire specialisti forensi certificati di IA, simili agli esperti di DNA, per valutare le prove video contestate in tribunale. | |

| Modi non ufficiali | Red-Teaming interno | Assumere professionisti della cybersicurezza per verificare se prove false o manipolate possono passare attraverso i sistemi di assunzione dell'azienda. |

| “Protocollo ”Vibe Check | Addestrare il personale a individuare i segnali d'allarme più comuni del deepfake, come battito di ciglia innaturale, distorsione dei lineamenti o problemi di sincronizzazione delle labbra, prima di passare alla revisione forense. |

Strumenti e tecnologie per la validazione delle prove

Nel 2026, abbiamo superato il semplice controllo visivo.

Poiché l'intelligenza artificiale è ormai in grado di ingannare anche gli investigatori più esperti, i team legali utilizzano una serie di strumenti specifici per verificare che ciò che vedono sia la verità assoluta.

La tecnologia alla base della convalida delle prove

- Rilevatori di deepfake: Si tratta di programmi software specializzati che analizzano gli artefatti GAN. Si tratta di microscopici schemi matematici o rumori lasciati dai modelli AI che generano i volti sintetici. Mentre un essere umano vede un volto, il rilevatore vede una firma digitale che non gli appartiene.

- TruthScan è un rilevatore di fake che analizza i video fotogramma per fotogramma alla ricerca di segni di AI, come lampeggiamenti insoliti, forme strane del viso o errori di pixel in cui viene aggiunto un volto falso.

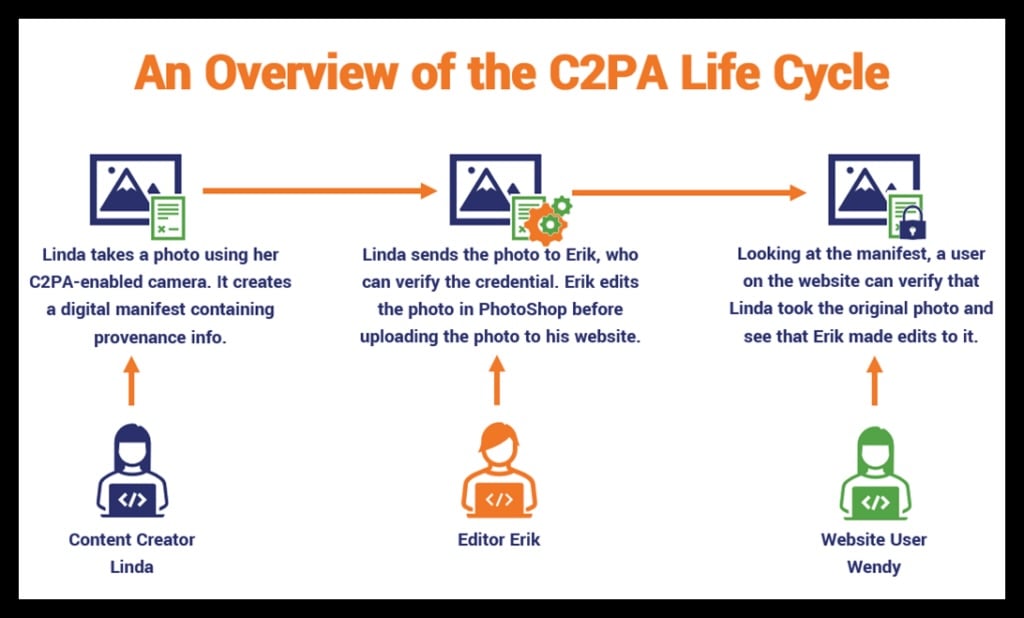

- Timestamp della Blockchain: Per dimostrare che un video non è stato toccato dal momento della registrazione, molte agenzie utilizzano lo standard C2PA. Quando un video viene registrato su un dispositivo conforme, viene creata un'impronta digitale unica (hash) che viene memorizzata su una blockchain.

- TruthScan può verificare se questa impronta corrisponde al video, mostrando se il file è stato modificato o se la catena di custodia è stata interrotta.

- Strumenti forensi per i metadati: Ogni file digitale ha un certificato di nascita noto come dati Exif. Questi strumenti verificano se un file è stato salvato in un software di editing AI o se i dati di localizzazione (GPS) sono stati falsificati. Se un video dichiara di provenire da una fotocamera di un negozio, ma i metadati mostrano che è stato esportato da un editor video, il problema è stato risolto.

- Amped Software e TruthScan esaminano i dati nascosti dei file (Exif, intestazioni) per vedere se il video è stato modificato o elaborato dall'AI.

Tendenze nelle prove video dell'intelligenza artificiale

Ecco le tre tendenze del 2026.

- Forensi generativi avversari: IA contro IA

Il modo più avanzato per catturare un deepfake nel 2026 è utilizzare la stessa tecnologia che lo ha creato. Si tratta della cosiddetta Generative Adversarial Forensics.

- Un'IA (il generatore) cerca di creare un falso, mentre un'altra IA (il discriminatore) cerca di catturarlo. In tribunale, strumenti come TruthScan possono essere il discriminatore definitivo.

- Esempio: Un querelante presenta un video di un amministratore delegato che stipula un contratto verbale. TruthScan analizza il video utilizzando i propri modelli avversariali per rilevare gli artefatti GAN. Se il software rileva una probabilità sintetica di 98%, è probabile che la prova sia un falso per ingannare gli occhi umani.

- Analisi della sincronizzazione audio-video (la regola degli 0,01 ms)

Di solito gli esseri umani sono in grado di individuare un ritardo se l'audio di un video è spento di circa 40-80 millisecondi. Tuttavia, i deepfake del 2026 sono spesso quasi perfetti.

- I moderni strumenti forensi di intelligenza artificiale cercano oggi un ritardo di 0,01 millisecondi tra il suono fonetico di una parola e il movimento meccanico delle labbra.

- Esempio: In un caso di molestie del 2026, un imputato ha sostenuto che un video era stato falsificato. L'analisi forense automatizzata delle prove ha dimostrato che le forme delle labbra “M” e “B” erano sfasate di 0,02 ms rispetto all'audio. Questo errore microscopico dimostra che la voce è stata clonata e sovrapposta a un video diverso, portando al licenziamento.

- Cheapfakes vs. Deepfakes

Mentre i deepfake utilizzano un'intelligenza artificiale di alto livello, i cheapfake sono la forma più comune di frode video.

- Un Deepfake crea una realtà che non è mai accaduta (come un face-swap). Un Cheapfake prende un filmato reale e ne cambia il contesto o l'intento utilizzando semplici strumenti.

- Esempio (Il rallentatore): Un video di un politico che appare ubriaco o alterato può essere creato semplicemente rallentando il filmato di 20% e regolando il tono dell'audio.

- Esempio (Il ri-contesto): Un filmato di una protesta del 2022 in un altro Paese viene pubblicato nel 2026 come prova in diretta di una sommossa locale. I legali utilizzano ora l'analisi dei metadati di TruthScan per dimostrare la data di nascita effettiva del video.

Come TruthScan protegge le prove video legali

TruthScan garantisce che ogni fotogramma presentato in tribunale sia autentico, verificato e legalmente difendibile.

La piattaforma semplifica la verifica video AI grazie ai seguenti vantaggi:

Registri di audit automatizzati e documentazione della catena di custodia

- Affidabilità in tribunale: Genera report in formato PDF e JSON che documentano ogni fase di verifica con punteggi di confidenza e timestamp precisi.

- Conformità di alto livello: Potete stare tranquilli sapendo che i vostri dati sono al sicuro e rispondono a rigorosi standard globali come SOC 2, ISO 27001 e GDPR.

- Controllo dati flessibile: Conservate le prove sensibili all'interno della giurisdizione richiesta con le opzioni di implementazione on-premise o VPC progettate per i settori altamente regolamentati.

Elaborazione batch e integrazione API per i flussi di lavoro legali

- Un enorme risparmio di tempo: Elaborazione simultanea di migliaia di file da pacchetti di scoperta o set di sorveglianza utilizzando le importazioni in massa (S3/GCS).

- E-Discovery senza soluzione di continuità: Semplificate le vostre operazioni integrando la verifica direttamente nel vostro software esistente tramite webhook e API.

- Eliminare gli errori manuali: Automatizzate il primo passaggio di screening delle prove, in modo che il vostro team possa concentrarsi sulla strategia invece che sulla noiosa verifica file per file.

Verifica in tempo reale per deposizioni e udienze a distanza

- Stop all'impersonificazione: Utilizzare gli endpoint di streaming live per rilevare se un testimone sta utilizzando filtri deepfake o cloni vocali durante un'udienza a distanza.

- Mantenere l'integrità del tribunale: Segnalazione di anomalie visive o audio in tempo reale, per evitare che testimonianze fraudolente vengano registrate.

- La pace della mente: Fornite ai vostri clienti e al tribunale un ulteriore livello di sicurezza che garantisce che la persona sullo schermo sia esattamente quella che dichiara di essere.

Per saperne di più sulla protezione delle prove video dell'intelligenza artificiale

Proteggete la vostra azienda dai rischi dei media manipolati. La tecnologia deepfake detector e AI video detector di TruthScan offre la soluzione definitiva per l'e-discovery e la verifica legale.

Siete pronti a vedere TruthScan in azione?

- Visita truthscan.com per ottenere 20.000 crediti gratuiti.

- Per richieste aziendali, integrazione API o opzioni di implementazione personalizzate, contattate il loro team all'indirizzo Truthscan.com/contatto.