Pendahuluan

Kecerdasan buatan mengubah lanskap penipuan keuangan dengan cara yang belum pernah terjadi sebelumnya. Pada awal tahun 2024, penipu menggunakan deepfakes yang dihasilkan AI untuk menyamar sebagai eksekutif dalam panggilan video-menipu karyawan Hong Kong untuk mentransfer $25 juta kepada para penipu[1][2]. Insiden seperti ini menunjukkan bagaimana AI generatif memberdayakan penjahat untuk membuat penipuan yang sangat meyakinkan yang menargetkan bank dan pelanggan mereka. Regulator membunyikan alarm: FinCEN Departemen Keuangan AS mengeluarkan peringatan pada akhir tahun 2024 yang memperingatkan tentang meningkatnya penipuan menggunakan media "deepfake" yang dihasilkan oleh AI, termasuk dokumen identitas palsu untuk mem-bypass verifikasi bank[3][4]. Whitepaper ini membahas tentang Tren penipuan AI dalam layanan keuangan dan membahas bagaimana institusi dapat meningkatkan pertahanan mereka. Kami mengeksplorasi bagaimana penipu menggunakan AI generatif-mulai dari peniruan deepfake hingga identitas sintetis-dan menguraikan teknologi dan strategi (termasuk alat pendeteksi canggih seperti TruthScan) yang dapat digunakan oleh tim fraud dan eksekutif untuk melawan ancaman yang terus berkembang ini.

Tren Penipuan AI Utama dalam Layanan Keuangan

AI dan pembelajaran mesin dimanfaatkan oleh pelaku kejahatan untuk melakukan penipuan dengan skala dan kecanggihan yang lebih besar. Penting Taktik penipuan yang digerakkan oleh AI yang berdampak pada bank, tekfin, dan perusahaan asuransi termasuk:

- Penipuan Peniruan Deepfake: Penjahat menggunakan Video dan audio yang dihasilkan AI untuk menyamar sebagai orang yang dipercaya (CEO, pelanggan, dll.) secara real-time. Sebagai contoh, suara tiruan yang mirip dengan aslinya telah digunakan dalam serangan vishing (phishing suara) untuk mengesahkan transfer uang palsu, dan video yang dibuat oleh AI telah menipu karyawan untuk menyetujui transaksi palsu[1][5]. Media sintetis ini menyulitkan untuk mengetahui apakah Anda benar-benar berbicara dengan orang yang Anda kira, sehingga memungkinkan pencurian bernilai tinggi seperti kasus deepfake $25M di atas. Deepfakes menjadi terjangkau dan mudah diproduksihanya membutuhkan sedikitnya 20-30 detik audio untuk mengkloning suara, atau kurang dari satu jam untuk menghasilkan video yang tampaknya otentik[6].

- Phishing & BEC yang Ditingkatkan dengan AI: AI generatif meningkatkan skema rekayasa sosial seperti email phishing dan kompromi email bisnis (BEC). Chatbot AI dapat menyusun email penipuan yang sangat dipersonalisasi dalam bahasa bisnis yang sempurna, meniru gaya penulisan CEO atau membuat faktur vendor palsu yang meyakinkan dalam skala besar. Bahkan, alat bawah tanah seperti PenipuanGPT dan WormGPT (versi ChatGPT yang tidak difilter) telah muncul untuk membantu penjahat siber mengotomatiskan pembuatan phishing dan malware[7][8]. Ini berarti calon penipu dengan keterampilan minimal dapat membuat kampanye phishing atau kode berbahaya dengan mudah. Dengan AI, seorang penjahat dapat mengirimkan ribuan email atau pesan teks penipuan yang disesuaikan, sehingga meningkatkan jangkauan upaya penipuan tradisional. Pusat Kejahatan Internet FBI telah mengamati lebih dari $2,7 miliar hilang akibat penipuan BEC pada tahun 2022, dan AI generatif mengancam untuk mendorong kerugian tersebut lebih tinggi lagi di tahun-tahun mendatang[9][10].

- Identitas Sintetis & Penipuan Dokumen: AI generatif memicu ledakan penipuan identitas sintetissalah satu jenis kejahatan keuangan yang paling cepat berkembang[11][12]. Penipu menggabungkan data pribadi asli dan palsu untuk membuat identitas "Frankenstein", lalu menggunakan AI untuk menghasilkan dokumen pendukung yang realistis - dari paspor palsu dan rekening koran untuk membayar uang muka[7]. Generator gambar AI dan alat pengeditan dapat memalsukan ID dan foto yang tampak asli yang lolos dari pemeriksaan biasa. Bahkan pemeriksaan langsung atau verifikasi swafoto berpotensi dikalahkan oleh gambar atau video yang dimanipulasi oleh AI. Dengan mengotomatiskan pembuatan ribuan persona palsu (masing-masing dengan foto profil yang dibuat oleh AI, media sosial, dll.), penjahat dapat membuka rekening bank atau mengajukan pinjaman secara massal dan melakukan pencucian uang atau gagal bayar. Kerugian dari penipuan identitas sintetis diperkirakan sekitar $35 miliar pada tahun 2023[13]dan AI generatif hanya mempercepat tren ini dengan membuat identitas palsu menjadi lebih murah dan lebih sulit dideteksi.

- Penipuan dan Penghindaran Otomatis: Selain membuat konten palsu, AI juga membantu para penipu memaksimalkan keberhasilan skema mereka. Bot tingkat lanjut dapat dengan cepat menguji detail kartu kredit yang dicuri di situs e-commerce, menggunakan ML untuk menghindari pemicu deteksi. AI dapat membantu para penjahat mengidentifikasi tautan terlemah dalam keamanan organisasi atau bahkan mensintesis respons suara untuk mengalahkan verifikasi identitas berbasis telepon. Sebuah industri rumahan di web gelap sekarang menjual alat AI "penipuan sebagai layanan" dengan harga hanya $20[14]. Demokratisasi kemampuan AI ini berarti bahkan penjahat tingkat rendah pun dapat melancarkan serangan penipuan yang sangat canggih. Perlombaan senjata meluas hingga menghindari deteksi-penipu menggunakan AI untuk menyelidiki sistem anti-penipuan bank dan menyempurnakan pendekatan mereka hingga menemukan metode yang lolos dari filter[15]. Singkatnya, AI memungkinkan penipuan dilakukan pada skala dan efisiensi yang belum pernah terlihat sebelumnyamenantang pertahanan konvensional.

Taktik yang diaktifkan oleh AI ini sudah berkembang biak dengan kecepatan yang mengkhawatirkan. Skema penipuan tradisional seperti pemalsuan cek atau phishing sudah ada selama bertahun-tahun, tetapi AI meningkatkan volume dan realismenya. Data menceritakan kisah yang jelas: Penipuan AI adalah melonjak.

Jangan Pernah Khawatir Tentang Penipuan AI Lagi. TruthScan Dapat Membantu Anda:

- Mendeteksi AI yang dihasilkan gambar, teks, suara, dan video.

- Hindari penipuan besar yang digerakkan oleh AI.

- Lindungi sebagian besar sensitif aset perusahaan.

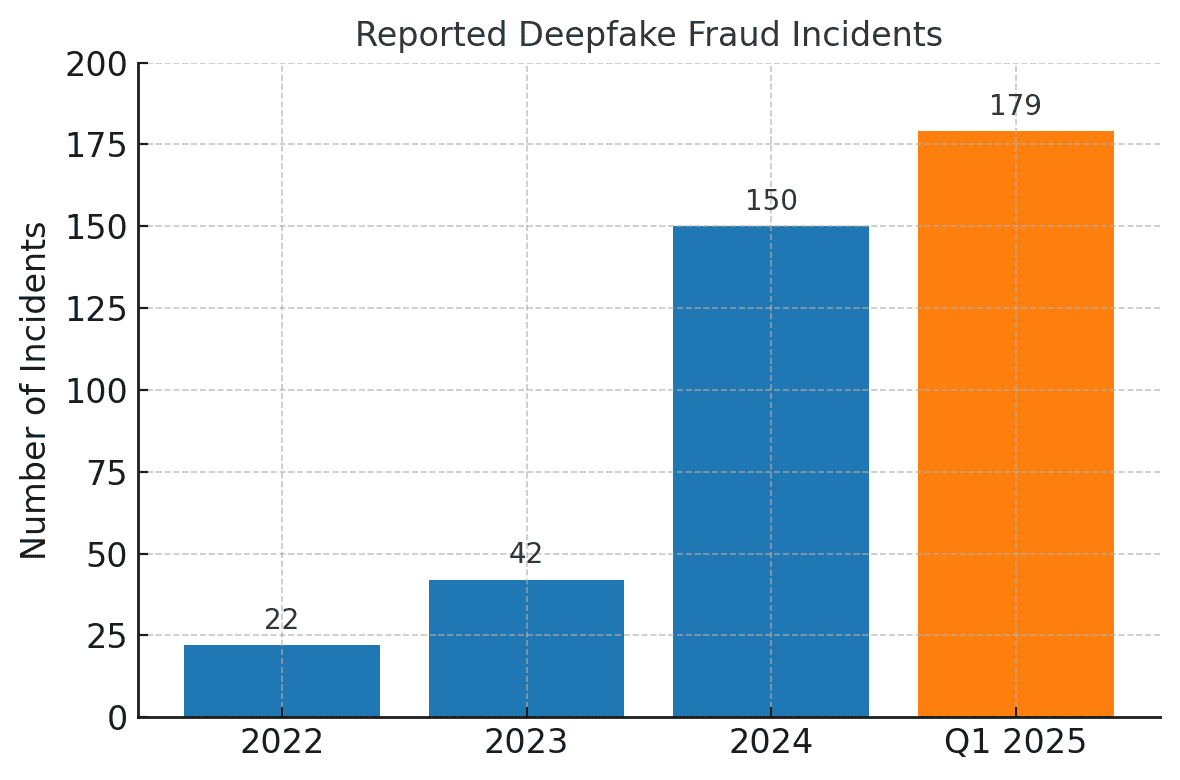

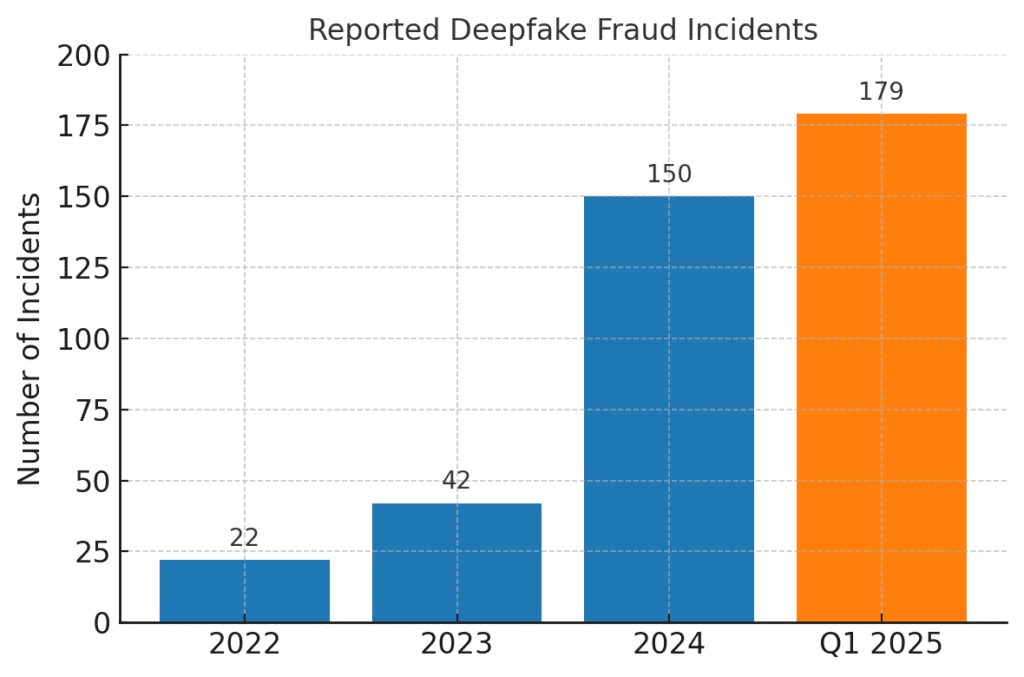

Insiden penipuan terkait deepfake telah meroket. Pada tahun 2022, hanya ada 22 kasus penipuan deepfake yang tercatat, tetapi pada tahun 2023 ada 42 kasus, dan pada tahun 2024 insiden meledak menjadi 150 kasus. Hanya dalam kuartal pertama tahun 2025, 179 insiden penipuan deepfake dilaporkan - melebihi total untuk seluruh tahun 2024[16][17].

Analisis industri terbaru menggemakan tren ini. Satu laporan mencatat adanya 700% peningkatan insiden deepfake menargetkan perusahaan tekfin pada tahun 2023[18]. Yang lebih mengejutkan lagi, Amerika Utara mengalami 1.740% lonjakan kasus penipuan deepfake antara tahun 2022 dan 2023[19]. Penjahat keuangan dengan cepat mengadopsi alat ini karena alat ini berhasil - banyak bank dan korban yang belum siap untuk mendeteksi penipuan yang disebabkan oleh AI.

Dampak dan Tantangan bagi Lembaga Keuangan

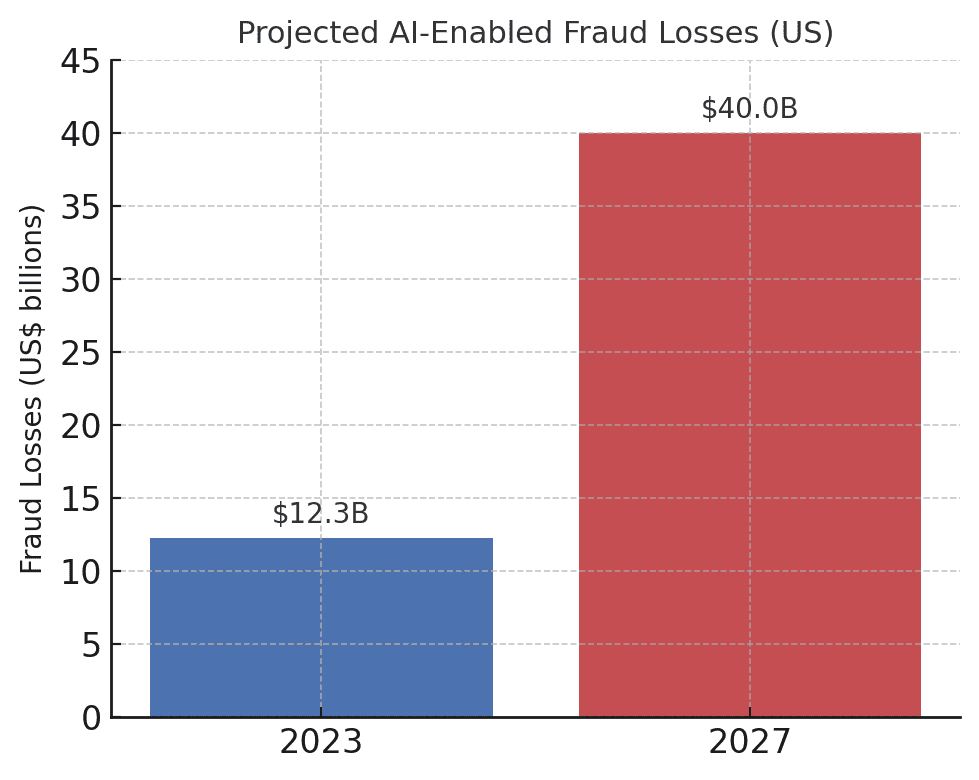

Meningkatnya penipuan yang digerakkan oleh AI dampak yang signifikan pada lembaga keuangan, nasabah, dan sistem keuangan yang lebih luas. Dampak yang paling langsung adalah kerugian moneter. Perkiraan industri memperkirakan hal itu pada tahun 2027, Kerugian penipuan yang dimungkinkan oleh AI generatif dapat mencapai $40 miliar di ASnaik dari $12,3 miliar pada tahun 2023[20]. Peningkatan lebih dari tiga kali lipat ini (a CAGR 32%) mencerminkan seberapa cepat risiko penipuan tumbuh dalam nilai dolar.

Proyeksi kerugian akibat penipuan yang didukung oleh AI meningkat secara dramatis. Deloitte memperkirakan kerugian penipuan keuangan AS yang terkait dengan AI generatif akan meningkat dari $12,3 miliar pada tahun 2023 hingga $40 miliar pada tahun 2027[20].

Selain kerugian materi, ada juga kerugian reputasi dan biaya kepercayaan. Konsumen mengharapkan bank mereka untuk melindungi mereka - tetapi penipuan yang menggunakan AI merusak kepercayaan pada saluran digital. Misalnya, jika nasabah menjadi korban penipuan deepfake yang meyakinkan (seperti panggilan video bankir palsu), mereka mungkin akan menyalahkan bank karena keamanan yang tidak memadai. Kepercayaan publik dalam verifikasi suara, email, dan bahkan konferensi video dapat terkikis jika "apa yang Anda lihat/dengar" tidak lagi dianggap nyata[21]. Menurut survei, 85% profesional keuangan di AS/Inggris memandang penipuan deepfake sebagai ancaman "eksistensial" terhadap keamanan organisasi mereka[22]. Lebih dari separuh perusahaan di pasar tersebut melaporkan menjadi target penipuan yang didukung oleh deepfake, dan yang mengkhawatirkan 43% dari mereka yang menjadi target mengakui bahwa serangan itu berhasil dalam membodohi mereka[23]. Setiap insiden yang terjadi tidak hanya menyebabkan kerugian finansial, tetapi juga mengikis kepercayaan pelanggan terhadap institusi.

Perusahaan-perusahaan keuangan juga bergulat dengan tantangan operasional dan kepatuhan dari penipuan AI. Tim anti-penipuan menghadapi lonjakan peringatan dan insiden, yang membebani sumber daya investigasi. Model pendeteksian penipuan yang ada (banyak di antaranya mengandalkan aturan atau teknik pembelajaran mesin yang lebih tua) mungkin kesulitan mengenali konten yang disintesis oleh AI yang terlihat sah. Faktanya, sistem pendeteksi deepfake canggih yang dikembangkan di laboratorium mengalami penurunan akurasi hingga hampir 50% saat dihadapkan dengan pemalsuan dunia nyata di alam liar[24]. Staf manusia tidak jauh lebih baik - penelitian menemukan bahwa orang hanya dapat menemukan video deepfake berkualitas tinggi di sekitar 55%-60% dari waktu ke waktu, hampir tidak lebih baik dari kebetulan[25]. Hal ini mengindikasikan bahwa tanpa alat bantu baru, bank akan kehilangan sebagian besar upaya penipuan yang digerakkan oleh AI.

Ada juga dimensi peraturan. Regulator dan penegak hukum sangat menyadari risiko ini (sebagaimana dibuktikan oleh peringatan FinCEN), dan mereka mengharapkan lembaga keuangan untuk beradaptasi. Bank mungkin akan menghadapi pedoman yang lebih ketat tentang verifikasi pelanggan dan pelaporan penipuan di era AI. Sebagai contoh, jika karyawan bank ditipu oleh deepfake untuk menyetujui transfer sebesar $10 juta, regulator mungkin akan memeriksa kontrol bank dan proses uji tuntas. The Undang-Undang Kerahasiaan Bank sekarang secara eksplisit mencakup pelaporan dugaan kejahatan siber dan aktivitas terkait deepfake[26][4]yang berarti bank harus melatih staf untuk mengenali dan melaporkan indikator penipuan yang dihasilkan oleh AI dalam Laporan Aktivitas Mencurigakan (Suspicious Activity Report/SAR). Kegagalan dalam mengikuti teknik penipuan yang disempurnakan dengan AI dapat menyebabkan pelanggaran kepatuhan atau pertanggungjawaban hukum jika nasabah atau rekanan menyatakan bahwa bank tidak melakukan cukup banyak hal untuk mencegah penipuan yang dapat diprediksi dengan AI.

Mungkin tantangan terbesarnya adalah sifat asimetris dari ancaman baru ini. AI generatif sangat menurunkan biaya dan hambatan keterampilan bagi penyerang, sementara secara eksponensial meningkatkan volume dan realisme serangan. Satu rumor deepfake yang viral atau panggilan tiruan suara yang meyakinkan dapat mengalahkan investasi autentikasi senilai jutaan dolar. Sementara itu, para pembela HAM harus memverifikasi keaslian setiap transaksi dan interaksi, sebuah tugas yang jauh lebih sulit. Ini benar-benar perlombaan senjata: AI memberikan penipu perangkat yang dapat diperbarui sendiri untuk menerobos keamanan, mengharuskan bank untuk terus memperbarui pertahanan mereka juga[15][27]. Banyak lembaga keuangan mengakui bahwa mereka tidak cukup siap - lebih dari 80% perusahaan tidak memiliki rencana respons formal untuk serangan deepfakedan lebih dari setengahnya tidak memberikan pelatihan kepada karyawan tentang risiko deepfake[28][29]. Kesenjangan kesiapsiagaan ini menunjukkan bahwa organisasi saat ini rentan, tetapi juga menyoroti di mana tindakan yang diperlukan.

Sebuah metrik yang patut dicatat dan serius datang dari laporan industri baru-baru ini: 42,5% upaya penipuan di sektor keuangan sekarang melibatkan beberapa bentuk AI[30]. Dengan kata lain, hampir setengah dari serangan penipuan yang dihadapi bank memiliki komponen AI - baik itu dokumen yang dibuat oleh AI, suara yang disintesis, atau pesan phishing yang dibuat oleh mesin. Statistik ini menggarisbawahi bahwa AI bukanlah ancaman masa depan yang bersifat hipotetis; AI sudah ada di sini, memaksa lembaga keuangan untuk beradaptasi atau menghadapi kerugian yang semakin besar.

Melawan Penipuan yang Didukung AI: Strategi dan Solusi

Menghadapi penipuan yang digerakkan oleh AI membutuhkan evolusi dalam strategi pencegahan penipuan. Pendekatan tradisional (seperti verifikasi manual atau mesin aturan statis) tidak cocok untuk penipuan AI yang berubah bentuk. Sebaliknya, bank harus merangkul teknologi (seperti memastikan mereka memiliki Sertifikat SSL yang aman), pelatihan, dan kerja sama tim untuk membalikkan keadaan. Di bawah ini, kami menguraikan strategi utama dan solusi yang muncul:

- Memanfaatkan AI untuk Melawan AI (Alat Deteksi Tingkat Lanjut): Lembaga keuangan semakin beralih ke Solusi pendeteksian bertenaga AI untuk mengidentifikasi konten dan anomali yang dihasilkan oleh AI. Intinya, Anda perlu melawan api dengan api. Alat-alat perusahaan baru seperti TruthScan menawarkan deteksi AI multi-modal di seluruh teks, gambar, suara, dan video untuk membantu mengotentikasi konten secara real time[31]. Sebagai contoh, bank dapat menggunakan pendeteksi teks AI untuk memindai komunikasi yang masuk (email, pesan obrolan) untuk mencari tanda-tanda bahasa yang dihasilkan AI yang mungkin mengindikasikan email phishing atau pertanyaan pelanggan palsu. Sistem pendeteksi teks AI dari TruthScan dapat mengidentifikasi konten yang ditulis oleh AI dari model seperti GPT-4 dengan Akurasi 99%+bahkan menunjukkan dengan tepat kalimat mana yang kemungkinan besar dihasilkan oleh AI[32][33]. Demikian pula, alat forensik gambar AI dapat memverifikasi dokumen dan gambar Detektor Gambar AI dapat menandai apakah SIM atau tagihan utilitas yang dikirimkan telah dibuat atau dimanipulasi secara digital dengan membandingkannya dengan pola yang diketahui dari citra yang dihasilkan AI[34]. Untuk ancaman audio, bank mulai menggunakan detektor pemalsuan suara - solusi yang menganalisis audio panggilan untuk mencari sidik jari akustik dari ucapan sintetis. Detektor Suara AI dari TruthScan, misalnya, mendengarkan tanda-tanda kloning suara dan dapat memverifikasi keaslian pembicara untuk mencegah panggilan penipu[35]. Dengan mengintegrasikan detektor ini melalui API ke dalam alur kerja mereka, lembaga keuangan dapat secara otomatis menyaring konten AI di latar belakang transaksi dan interaksi. Hal ini memberikan lapisan pertahanan tambahan yang beroperasi dengan kecepatan mesin, menangkap apa yang mungkin terlewatkan oleh mata/telinga manusia.

- Menerapkan Verifikasi Multi-Faktor dan Verifikasi di Luar Band: Karena AI membuat lebih sulit untuk mempercayai suara atau gambar, bank harus lebih mengandalkan metode verifikasi yang tidak dapat dipalsukan oleh AI. Ini termasuk otentikasi multi-faktor (MFA) menggunakan saluran yang aman. Misalnya, jika permintaan transfer kawat datang melalui email atau panggilan video, memerlukan faktor kedua seperti kode sandi sekali pakai yang dikirim ke perangkat seluler pemohon yang diketahui, atau panggilan balik ke nomor telepon tepercaya yang ada di file. Beberapa bank menambahkan pemeriksaan "keaktifan" untuk transaksi berisiko tinggi - misalnya, meminta pelanggan untuk melakukan swafoto langsung dengan gerakan atau kata tertentu, yang lebih sulit ditiru oleh video palsu. Autentikator biometrik dapat ditingkatkan dengan langkah-langkah anti-spoofing (misalnya pemindaian kedalaman wajah 3D, atau pemantauan gerakan mata yang halus yang sering kali gagal ditiru oleh deepfake[27]). Kuncinya adalah untuk menghindari satu titik kegagalan. Bahkan jika deepfake AI dapat menipu satu saluran (misalnya verifikasi suara), pemeriksaan di luar pita atau tes biometrik yang terkoordinasi dapat memberikan tantangan yang diperlukan untuk mengungkap penipuan. Prinsip-prinsip tanpa kepercayaan harus diterapkan: perlakukan setiap instruksi yang tidak diminta atau tidak terduga (bahkan dari eksekutif atau klien yang "dikenal") sebagai sesuatu yang mencurigakan hingga diverifikasi melalui saluran independen.

- Pelatihan Karyawan dan Kesadaran akan Penipuan: Teknologi saja bukanlah peluru perak - terutama karena penipu akan menargetkan mata rantai terlemah, yang sering kali adalah kepercayaan manusia. Lembaga keuangan harus berinvestasi dalam pelatihan rutin untuk tim pencegahan penipuan dan staf lini depan tentang penipuan berbasis AI. Karyawan harus belajar mengenali tanda bahaya deepfakes dan rekayasa sosial. Hal ini dapat mencakup pelatihan mengenai anomali yang tidak kentara (misalnya masalah sinkronisasi bibir dalam panggilan video, atau audio yang mengandung intonasi yang tidak wajar atau suara latar belakang yang terlalu sedikit - tanda-tanda potensial dari suara sintetis). Mendorong budaya verifikasikaryawan harus merasa diberdayakan untuk menghentikan sementara transaksi atau permintaan yang mencurigakan dan memverifikasinya secara independen, meskipun permintaan tersebut tampaknya berasal dari CEO. Kasus Upaya pemalsuan suara CEO Ferrari instruktif - seorang eksekutif hanya mengungkap tipu muslihat tersebut dengan mengajukan pertanyaan pribadi yang tidak dapat dijawab oleh si penipu[36]. Simulasi latihan phishing/deepfake juga bisa berguna. Seperti halnya perusahaan menjalankan simulasi phishing untuk melatih staf, mereka bisa mensimulasikan pesan suara palsu atau video rapat palsu dan melihat apakah karyawan mendeteksinya. Hal ini akan membangun memori otot untuk melawan serangan yang sebenarnya. Mengingat bahwa lebih dari 50% perusahaan tidak memiliki protokol respons deepfake dan hanya sedikit pelatihan[29]melembagakan program-program semacam itu adalah buah yang tidak terlalu mahal untuk meningkatkan ketahanan.

- Analisis Penipuan dan Deteksi Anomali: Bank harus terus menggunakan AI di sisi defensif dengan meningkatkan analisis penipuan mereka. Sistem deteksi penipuan modern menggunakan model pembelajaran mesin yang menganalisis transaksi secara real time dan menandai anomali atau pola berisiko tinggi. Model-model ini perlu diperbarui untuk menyertakan sinyal yang mengindikasikan penipuan yang digerakkan oleh AI. Sebagai contoh, model ML dapat dilatih untuk mendeteksi metadata atau pola perilaku yang terkait dengan pengambilalihan akun yang digerakkan oleh bot (misalnya waktu pengisian formulir yang sangat cepat, atau pola pengetikan yang sangat konsisten yang menunjukkan adanya skrip otomatis). Model bahasa dapat digunakan untuk menganalisis konten pesan dan menandai jika email dari pemasok suara yang dihasilkan AI atau terlalu formulaik (dipasangkan dengan deteksi teks AI yang disebutkan sebelumnya). Bank-bank seperti JPMorgan telah mulai menggunakan model bahasa yang besar pada komunikasi internal mereka untuk menemukan frasa atau konteks yang mungkin mengindikasikan upaya rekayasa sosial[37]. Jaringan pembayaran seperti Mastercard memindai kumpulan data yang sangat besar (miliaran transaksi) dengan AI untuk mengidentifikasi transaksi penipuan yang tidak dapat diidentifikasi oleh aturan tradisional[38]. Kesimpulannya adalah bahwa AI defensif harus sama inovatifnya dengan AI ofensif. Perusahaan harus mempertimbangkan untuk mengembangkan atau membeli model AI yang secara khusus dapat mendeteksi konten deepfake, identitas sintetis, dan pola serangan generatif. Yang terpenting, model-model ini harus terus dilatih ulang dengan contoh-contoh penipuan AI terbaru (praktik yang disebut pembelajaran online atau pembelajaran terpadu) agar dapat mengimbangi taktik penjahat yang berkembang pesat[39][40].

- Kolaborasi dan Berbagi Informasi: Memerangi penipuan yang didukung oleh AI akan membutuhkan kolaborasi baik di dalam maupun di luar institusi. Upaya yang terpisah-pisah kurang efektif untuk melawan ancaman yang melampaui batas-batas organisasi. Tim pencegahan penipuan, tim keamanan siber, dan TI perlu bekerja sama - misalnya, tim keamanan dapat menggunakan deteksi deepfake dalam alat konferensi video, sementara tim penipuan mengintegrasikan pemindaian konten ke dalam pemantauan transaksi. Pada tingkat yang lebih luas, bank harus berpartisipasi dalam kelompok industri seperti Financial Services Information Sharing and Analysis Center (FS-ISAC) untuk bertukar informasi intelijen tentang skema penipuan AI baru[41]. Jika satu bank menemukan vektor serangan deepfake baru, berbagi wawasan tersebut dapat membantu bank lain untuk menutup celah sebelum mereka terkena. Latihan bersama atau simulasi "tim merah" dengan skenario yang melibatkan AI (misalnya penipuan eksekutif deepfake atau bypass verifikasi ID yang dibuat oleh AI) dapat dilakukan melalui konsorsium industri atau dengan dukungan regulator. Regulator sendiri berfokus pada risiko AI, jadi melibatkan mereka secara proaktif adalah hal yang bijaksana. Dengan berkontribusi pada standar dan pedoman penggunaan AI, bank dapat membantu membentuk ekosistem yang lebih aman. Pada akhirnya, karena ancaman terhadap satu bank adalah ancaman bagi semua bank di ruang ini[42]pendekatan pertahanan kolektif akan memperkuat kemampuan setiap orang untuk mendeteksi dan mencegah penipuan yang disempurnakan dengan AI.

- Pendidikan Pelanggan dan Tindakan Kepercayaan: Terakhir, lembaga keuangan tidak boleh mengabaikan peran kesadaran pelanggan. Dengan adanya deepfakes dan penipuan AI yang menargetkan masyarakat umum (misalnya, suara palsu dalam penipuan kakek-kakek atau obrolan "dukungan teknis" palsu yang dihasilkan oleh AI), bank dapat membantu mengedukasi nasabah tentang bahaya ini. Banyak bank sudah mengirimkan peringatan tentang phishing; mereka dapat mengembangkannya dengan menyebutkan kloning suara AI dan video deepfake, serta memberikan tips tentang cara memverifikasi permintaan. Beberapa organisasi progresif mengirimkan pemberitahuan push atau peringatan di aplikasi mereka jika ada penipuan yang diketahui sedang beredar (misalnya, "Waspadalah: penipu mungkin menggunakan tiruan suara anggota keluarga yang meminta uang")[43]. Meskipun tidak secara langsung mencegah serangan, edukasi dapat mengurangi tingkat keberhasilan dan memperkuat bahwa bank adalah mitra dalam hal keamanan. Selain itu, bank yang berinvestasi dalam pencegahan penipuan yang mutakhir harus menyoroti hal ini kepada nasabah sebagai pembeda - Misalnya, memberi tahu nasabah bahwa semua panggilan video atau dokumen yang dikirimkan dipindai oleh AI untuk mengetahui keasliannya (tanpa membocorkan metode yang sensitif) dapat meyakinkan nasabah bahwa bank menggunakan semua alat yang tersedia untuk melindungi mereka. Menjaga kepercayaan digital akan sangat penting bagi bank untuk sepenuhnya memanfaatkan manfaat AI dalam layanan, sehingga transparansi dan perlindungan yang berfokus pada nasabah merupakan bagian dari pertahanan yang menyeluruh.

Peran Layanan Deteksi Konten AI

Landasan dari perangkat anti-penipuan di era AI adalah penggunaan Layanan deteksi konten AI. Layanan ini mengkhususkan diri dalam menemukan "sidik jari" dari konten yang dihasilkan oleh AI yang mungkin lolos dari peninjau manusia. TruthScan adalah salah satu penyedia yang menawarkan layanan Rangkaian Deteksi AI mencakup berbagai jenis konten. Lembaga keuangan dapat mengintegrasikan alat ini untuk menyaring indikator pemalsuan dan penipuan secara otomatis:

- Verifikasi Dokumen dan Gambar: Platform TruthScan memungkinkan bank untuk menguji dokumen keuangan untuk mengetahui adanya kecurangan yang dihasilkan oleh AI secara real time[44]. Ini berarti ketika rekening baru dibuka atau aplikasi pinjaman datang dengan ID foto dan potongan gaji, sistem dapat langsung menganalisis gambar-gambar tersebut untuk mencari tanda-tanda pembuatan atau gangguan sintetis. Dengan akurasi target lebih dari 99%[45]AI Image Detector dapat menangkap gambar ID palsu atau PDF yang telah direkayasa yang mungkin akan disetujui oleh manusia. Jenis verifikasi keaslian dokumen sangat penting untuk menghentikan penipuan identitas sintetis bahkan sebelum akun dibuka.

- Pemantauan Transaksi Waktu Nyata: Dengan menerapkan integrasi API, TruthScan dapat terhubung ke pemrosesan transaksi bank dan menandai anomali di waktu nyata. Jika sebuah instruksi datang melalui email yang tampak mencurigakan, Detektor Penipuan Email dapat menganalisis isi pesan dan mendeteksi apakah pesan tersebut kemungkinan besar ditulis oleh model AI yang mencoba menipu vendor atau eksekutif[46]. Demikian pula, fitur Detektor AI Waktu Nyata dapat memantau komunikasi langsung (seperti obrolan atau platform kolaborasi) untuk memberikan peringatan instan jika, misalnya, umpan video deepfake penipu terdeteksi selama rapat berisiko tinggi[47][48]. Pemantauan berkelanjutan dengan peringatan instan dan respons otomatis membantu memperkecil celah di mana kecurangan dapat terjadi tanpa terdeteksi.

- Pertahanan Deepfake Suara dan Video: Untuk pusat panggilan dan manajer hubungan, dengan menggabungkan TruthScan Detektor Suara AI menambahkan lapisan keamanan ekstra. Jika penipu menelepon dengan menyamar sebagai klien menggunakan tiruan suara, sistem dapat menganalisis audio panggilan dan menandai jika mengandung elemen yang disintesis oleh AI (seperti jeda mikro yang hilang, atau artefak dalam gelombang suara)[35]. Di bagian depan video, fitur Detektor Deepfake menerapkan algoritme visi komputer ke bingkai video untuk menangkap ketidakkonsistenan-seperti gerakan wajah yang tidak wajar, pencahayaan yang aneh, atau sinkronisasi bibir yang tidak sesuai-yang mengungkapkan kepalsuan[49][50]. Dengan memverifikasi integritas suara dan wajah dalam interaksi penting, bank dapat menggagalkan penipu yang mencoba menipu karyawan mereka. Alat-alat ini berfungsi seperti pendeteksi kebohongan berteknologi tinggi untuk konten digital, yang beroperasi tanpa terlihat di latar belakang.

Perlu dicatat bahwa penerapan teknologi pendeteksian semacam itu bukanlah solusi yang bisa langsung digunakan; teknologi ini harus dikalibrasi dan disesuaikan dengan alur kerja institusi. Positif palsu harus dikelola (misalnya, detektor teks AI dapat menandai komunikasi yang sah berbasis template sebagai mencurigakan sampai ia mempelajari perbedaannya). Namun, jika diintegrasikan dengan baik, alat ini secara nyata meningkatkan kemampuan organisasi untuk menemukan konten yang curang sebelum menyebabkan kerusakan. Mereka juga menghasilkan jejak audit dan laporan analitis yang berguna untuk kepatuhan dan untuk terus meningkatkan model penipuan.

Yang terpenting, efektivitas alat pendeteksi AI bergantung pada pembaruan konstan. Sama seperti perangkat lunak antivirus yang membutuhkan tanda tangan baru untuk virus baru, pendeteksi AI memerlukan pelatihan ulang tentang teknik deepfake dan model AI terbaru. Vendor seperti TruthScan memperbarui algoritme mereka untuk menangani model generatif dan taktik penghindaran yang baru, mempertahankan akurasi tinggi bahkan ketika AI berevolusi[51]. Hal ini meringankan beban tim internal dan memastikan bank tidak lagi berperang dengan perang kemarin, sementara para penjahat beralih ke trik-trik AI yang baru.

Kesimpulan

Industri jasa keuangan berada di persimpangan jalan dalam memerangi penipuan. Di satu sisi, para penjahat dengan cepat menggunakan AI generatif untuk meluncurkan penipuan yang lebih meyakinkan dan meluas dari sebelumnya. Di sisi lain, bank dan para pejuang penipuan memiliki persenjataan pertahanan berbasis AI yang semakin berkembang. Institusi yang akan berkembang adalah institusi yang mengenali lanskap ancaman baru dan merespons dengan kecerdikan yang sama. Hal ini berarti berinvestasi pada kemampuan deteksi yang canggih, mengintegrasikan proses verifikasi berlapis-lapis, mengedukasi staf dan pelanggan, serta menumbuhkan budaya kewaspadaan dan adaptasi.

Penipuan yang didukung oleh AI adalah target yang bergerak cepat - penipuan deepfake yang menipu perusahaan hari ini mungkin akan dilawan dengan teknik deteksi baru besok, hanya untuk kemudian penipu mengubah metodenya minggu depan. Oleh karena itu, strategi pencegahan penipuan "standar industri" di tahun 2025 adalah strategi yang menekankan pada ketangkasan dan peningkatan berkelanjutan. Organisasi keuangan harus memperlakukan sistem pertahanan penipuan mereka sebagai entitas yang hidup dan belajar yang berkembang seiring dengan taktik kriminal. Memanfaatkan kemitraan dengan penyedia teknologi merupakan jalan pintas yang cerdas untuk membangun kemampuan ini. Misalnya, berkolaborasi dengan perusahaan khusus seperti TruthScan (yang menawarkan solusi yang disesuaikan untuk perbankan dan keuangan) dapat mempercepat kemampuan institusi untuk mencegah penipuan yang didukung oleh AI sekaligus menjaga kepatuhan terhadap peraturan dan kepercayaan pelanggan[52].

Pada akhirnya, melindungi dari penipuan yang digerakkan oleh AI bukan hanya tentang teknologi - tetapi juga tentang menjaga hal-hal mendasar kepercayaan yang menopang keuangan. Nasabah membutuhkan keyakinan bahwa bank mereka dapat membedakan transaksi yang asli dengan yang palsu, nasabah asli dengan penipu AI. Dengan menggunakan alat deteksi AI yang canggih, memperkuat protokol verifikasi, dan tetap berada di depan dalam menghadapi ancaman yang muncul, perusahaan jasa keuangan dapat menjunjung tinggi kepercayaan tersebut. Jalan ke depan tidak diragukan lagi akan menampilkan lebih banyak inovasi penipuan yang dicoba oleh pihak lawan, tetapi dengan kesiapan dan investasi yang tepat, bank dapat memastikan bahwa AI menjadi lebih sebagai aset daripada ancaman dalam bidang pencegahan penipuan. Ini adalah tujuan yang dapat dicapai: teknologi AI yang sama yang mengancam gangguan dapat dimanfaatkan untuk menjaga integritas sistem keuangan kita. Sekaranglah saatnya bagi tim pencegahan penipuan dan eksekutif tingkat C untuk bertindak tegas, merangkul solusi dan strategi canggih untuk mengakali para penipu dan mengamankan masa depan keuangan digital.

Sumber: Laporan industri terbaru, peringatan peraturan, dan whitepaper teknologi telah direferensikan di seluruh (Deloitte[20][18]Forum Ekonomi Dunia (World Economic Forum)[19][24]Departemen Keuangan AS FinCEN[3][4], Federal Reserve[13], Keepnet Labs[16][30]antara lain) untuk memberikan data dan contoh. Semua data dan contoh dikutip secara in-line agar pembaca dapat mengeksplorasi lebih jauh.

[1] [9] [10] [14] [15] [18] [20] [37] [38] [42] [43] Perbankan deepfake dan risiko penipuan AI | Deloitte Insights

[2] [5] [6] [19] [21] [24] [25] [27] [36] [39] [40] [41] Mendeteksi AI yang berbahaya sangat penting di era deepfake | World Economic Forum

[3] [4] [26] FinCEN Mengeluarkan Peringatan tentang Skema Penipuan yang Melibatkan Media Deepfake yang Menargetkan Institusi Keuangan | FinCEN.gov

[7] [8] FraudGPT dan GenAI: Bagaimana penipu akan menggunakan AI selanjutnya? | Paduan

[11] Penipuan identitas sintetis: Bagaimana AI mengubah permainan - Federal Reserve Bank of Boston

[12] [13] Kecerdasan Buatan Generatif Meningkatkan Ancaman Penipuan Identitas Sintetis

[16] [17] [22] [23] [28] [29] [30] Statistik & Tren Deepfake 2025 | Data & Wawasan Utama - Keepnet

[31] [34] [35] [46] [47] [48] TruthScan - Deteksi AI Perusahaan & Keamanan Konten

[32] [33] [51] Detektor AI: Deteksi Teks AI Tingkat Perusahaan - TruthScan

[44] [45] [52] Deteksi Penipuan AI Perbankan | Solusi CRO | TruthScan

[49] [50] Detektor Deepfake - Identifikasi Video Palsu & AI - TruthScan