Pendahuluan: Era Baru Serangan Berbasis AI

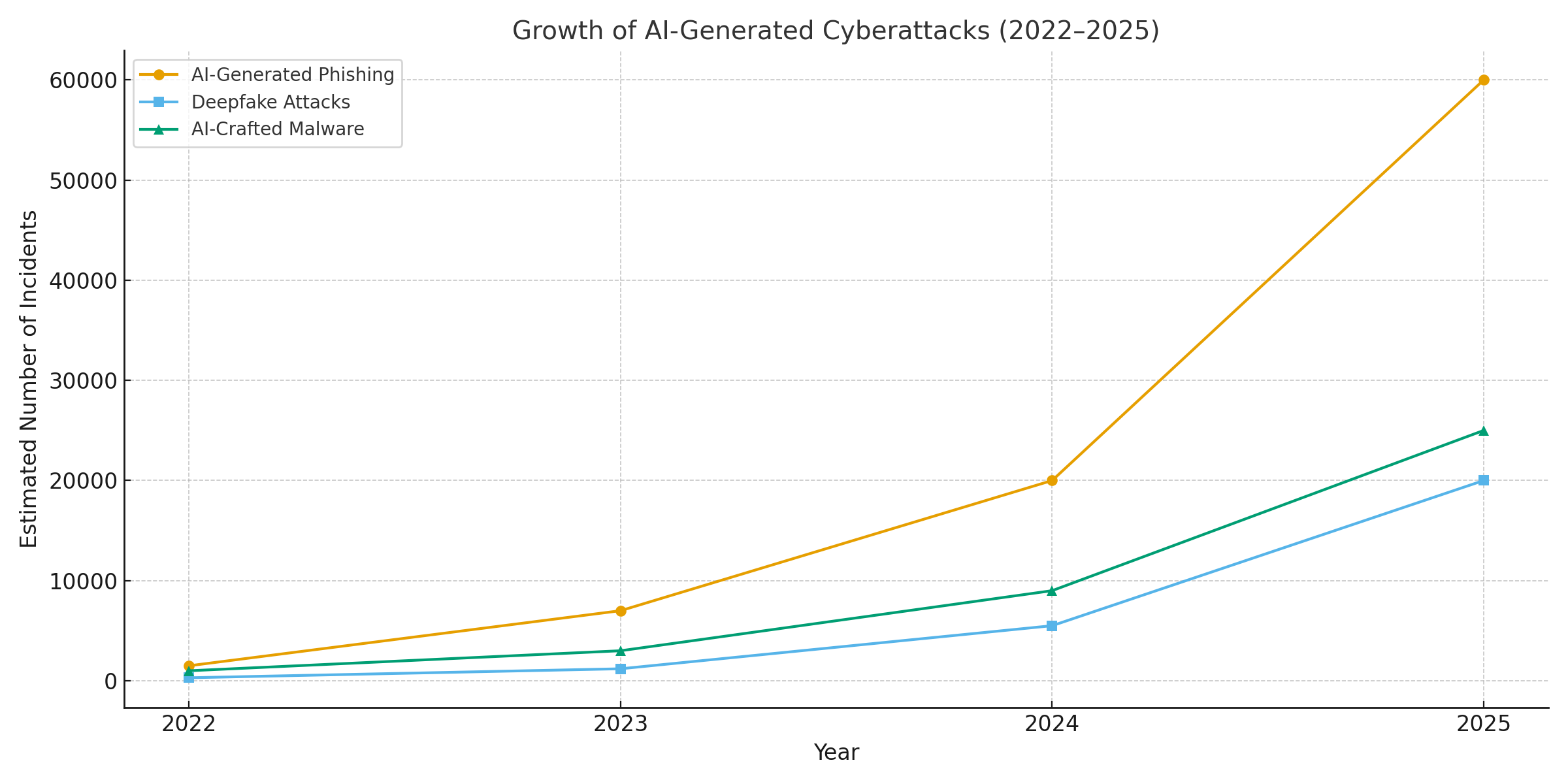

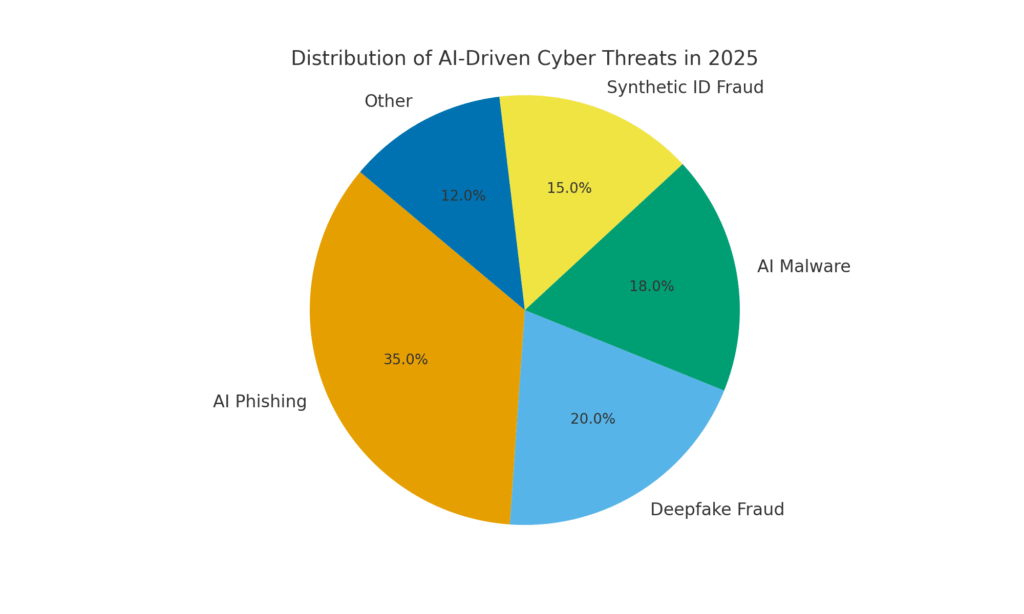

Tahun 2025 telah menandai titik kritis dalam keamanan siber. AI Generatif telah meningkatkan serangan siber, memungkinkan pelaku ancaman untuk meluncurkan lebih banyak sering, realistis, dan terukur kampanye daripada sebelumnya. Faktanya, selama setahun terakhir diperkirakan 16% insiden siber yang dilaporkan melibatkan penyerang yang memanfaatkan alat bantu AI (misalnya model pembuatan gambar dan bahasa) untuk meningkatkan rekayasa sosial[1]. Dari email phishing yang sangat meyakinkan hingga penipuan audio/video yang memalsukan, para pelaku kejahatan menggunakan AI di semua sektor. Mayoritas profesional keamanan sekarang mengaitkan lonjakan serangan siber ke AI generatifyang memberikan cara yang lebih cepat dan lebih cerdas bagi pelaku kejahatan untuk mengeksploitasi korban[2]. AI generatif secara efektif menurunkan standar keterampilan untuk kejahatan siber sekaligus meningkatkan potensinya.

Mengapa hal ini sangat memprihatinkan? AI dapat secara instan menghasilkan konten yang dipoles dan sadar akan konteks yang dapat menipu pengguna yang sudah terlatih sekalipun. AI dapat meniru suara dan wajah dengan akurasi yang menakutkan, dan bahkan menghasilkan kode berbahaya yang berubah untuk menghindari deteksi. Akibatnya, serangan siber menjadi lebih sulit dideteksi dan lebih mudah dieksekusi. The Forum Ekonomi Dunia memperingatkan bahwa 72% organisasi telah mengalami peningkatan risiko siber - terutama rekayasa sosial dan penipuan - karena kemampuan AI yang terus berkembang[3]. Insiden di dunia nyata membuktikan hal ini: Pada awal tahun 2024, para penjahat menggunakan AI yang dihasilkan panggilan video palsu untuk menyamar sebagai CFO perusahaan dan mengelabui karyawan agar mau dipindahkan $25,6 juta kepada para penipu[4]. Dan dalam kasus lain, peretas Korea Utara menggunakan Dokumen identitas palsu yang dibuat oleh AI untuk melewati pemeriksaan keamanan dalam kampanye phishing pertahanan[5]. Contoh-contoh ini menyoroti risiko yang ada - AI generatif memberdayakan penipuan yang melewati kontrol manusia dan teknis.

Namun, AI juga merupakan bagian dari solusi. Alat deteksi tingkat lanjut (seperti yang ada di TruthScan) menggunakan AI terhadap AI - menganalisis konten untuk mengetahui tanda tangan halus dari pembuatan mesin. Dalam laporan resmi ini, kami akan membahas ancaman siber yang digerakkan oleh AI pada tahun 2025 dan bagaimana organisasi dapat memitigasinya. Dari Phishing yang dihasilkan oleh AI untuk penipuan CEO palsu, Malware yang dibuat oleh AI, identitas sintetisdan banyak lagi, kita akan mengeksplorasi bagaimana AI generatif membentuk ulang serangan. Kami juga akan membahas langkah-langkah pertahanan yang konkret, termasuk Deteksi konten AIforensik deepfake, dan teknologi verifikasi identitas yang dapat membantu tim keamanan mendapatkan kembali keunggulannya. Tujuannya adalah untuk menjelaskan bagaimana perusahaan, MSSP, CISO, dan penyelidik penipuan dapat mengintegrasikan alat deteksi AI di seluruh tumpukan keamanan siber mereka untuk melawan gelombang ancaman bertenaga AI ini.

Jangan Pernah Khawatir Tentang Penipuan AI Lagi. TruthScan Dapat Membantu Anda:

- Mendeteksi AI yang dihasilkan gambar, teks, suara, dan video.

- Hindari penipuan besar yang digerakkan oleh AI.

- Lindungi sebagian besar sensitif aset perusahaan.

Phishing & BEC yang Dihasilkan oleh AI: Penipuan dengan Skala yang Belum Pernah Terjadi Sebelumnya

Salah satu dampak paling jelas dari AI generatif adalah pada phishing dan kompromi email bisnis (BEC) skema. Model bahasa AI dapat menyusun email yang lancar dan disesuaikan secara kontekstual dalam hitungan detik - menghilangkan kesalahan tata bahasa yang mencolok dan frasa yang canggung yang pernah menjadi ciri khas phishing. Hasilnya adalah membanjirnya email dan teks penipuan yang sangat meyakinkan. Pada April 2025, lebih dari separuh email spam (51%) ditulis oleh AInaik dari hampir nol dua tahun sebelumnya[6]. Yang lebih mengkhawatirkan lagi, para peneliti menemukan bahwa sekitar 14% email serangan BEC dihasilkan oleh AI pada tahun 2025[7] - angka yang diperkirakan akan terus meningkat karena para penjahat mengadopsi alat seperti ChatGPT. Beberapa penelitian memperkirakan lebih dari 80% email phishing sekarang mungkin memiliki bantuan AI dalam pembuatannya[8].

Volume umpan yang dihasilkan oleh AI ini telah meledak. Analisis keamanan menunjukkan bahwa serangan phishing yang terkait dengan AI generatif melonjak sebesar 1,265% dalam waktu singkat[9]. Dalam satu periode, laporan insiden phishing melonjak 466% dalam satu kuartalsebagian besar disebabkan oleh kit phishing otomatis dan bot yang memompa umpan khusus[9][10]. Mengapa terjadi lonjakan seperti itu? Karena AI memungkinkan penyerang skala operasi mereka secara dramatis. Seorang penjahat tunggal dapat menggunakan chatbot AI untuk menghasilkan ribuan email penipuan yang dipersonalisasi yang menargetkan karyawan atau pelanggan yang berbeda, semuanya dalam waktu yang biasanya dibutuhkan untuk membuat satu email. Otomatisasi massal ini membuat FBI memperingatkan bahwa kerugian BEC (yang telah mencapai $2,7 miliar pada tahun 2022) akan semakin meningkat karena AI "mengancam untuk mendorong kerugian tersebut lebih tinggi lagi"[11][12].

Tidak hanya ada lebih banyak email phishing, mereka juga lebih efektif. Para korban tertipu pada tingkat yang lebih tinggi oleh bahasa yang dipoles dan detail kontekstual yang dapat dimasukkan oleh AI. Dalam pengujian laboratorium, email phishing yang ditulis oleh AI mencapai Rasio klik-tayang 54% - jauh di atas ~12% untuk upaya phishing tradisional[13]. Pesan-pesan ini terbaca seperti gaya CEO asli atau merujuk pada acara perusahaan yang sebenarnya, sehingga menurunkan kewaspadaan penerima. Penyerang bahkan menggunakan AI untuk menguji frasa yang berbeda dan mengulang-ulang pengait yang paling berhasil[14]. Dan tidak seperti manusia, AI tidak membuat kesalahan ketik atau lelah - AI dapat memuntahkan varian yang tak ada habisnya hingga seseorang lolos dari filter dan menipu seseorang.

Contoh Kasus: Pada pertengahan tahun 2025, sebuah Reuters Investigasi mengungkap bagaimana para penipu di Asia Tenggara memanfaatkan ChatGPT untuk mengotomatiskan komunikasi penipuan[15]. Mereka membuat email bank yang meyakinkan dan teks layanan pelanggan secara massal, sehingga meningkatkan jangkauan skema mereka secara luas. Polisi Eropa juga melaporkan perangkat phishing berbasis AI yang dijual di web gelap dengan harga di bawah $20, yang memungkinkan para pelaku berketerampilan rendah untuk meluncurkan kampanye yang canggih[16][17]. Penghalang untuk masuk ke BEC dan phishing pada dasarnya telah menguap.

Tindakan Pertahanan - Menghentikan AI Phish: Dengan adanya serangan gencar ini, organisasi harus membentengi email dan saluran pesan mereka. Di sinilah Deteksi konten AI dapat membantu. Alat-alat seperti Detektor Teks AI dari TruthScan dan khusus pemindai email dapat menganalisis pesan yang masuk untuk mengetahui penanda statistik dari teks yang dihasilkan AI. Sebagai contoh, fitur Detektor Penipuan Email TruthScan menggunakan analisis bahasa alami untuk menandai email yang kemungkinan besar berasal dari AI, meskipun email tersebut terlihat sah[18]. Detektor ini memeriksa hal-hal seperti tata bahasa yang dipoles dengan sempurna, kerumitan kalimat, dan pola gaya bahasa yang tidak biasa dilakukan oleh penulis manusia. Dengan pemindaian waktu nyataemail yang mencurigakan dapat dikarantina atau ditandai untuk ditinjau sebelum sampai ke tangan pengguna. Tim keamanan perusahaan mulai menerapkan filter berbasis AI seperti itu di gateway email dan platform perpesanan. Dalam praktiknya, hal ini menambahkan lapisan pertahanan baru di atas filter spam tradisional - yang secara eksplisit disetel untuk menangkap konten yang ditulis oleh AI. Pada tahun 2025, perusahaan-perusahaan terkemuka mengintegrasikan solusi seperti TruthScan melalui API ke dalam gateway email yang aman dan rangkaian kolaborasi cloud mereka, menciptakan pos pemeriksaan otomatis untuk Phishing yang dihasilkan oleh AI konten.

Peniruan Suara & Video Deepfake: Penipuan "Melihat itu Menipu"

Mungkin ancaman yang didorong oleh AI yang paling mendalam pada tahun 2025 adalah munculnya serangan suara dan video palsu. Dengan menggunakan model AI, para penjahat dapat meniru suara seseorang hanya dari beberapa detik audio, atau membuat video realistis wajah seseorang dari beberapa foto. Deepfakes ini digunakan untuk penipuan peniruan dengan risiko tinggi - mulai dari penipuan CEO (panggilan "CEO palsu") hingga konferensi video palsu dan lainnya. Sebuah laporan industri baru-baru ini mengungkapkan 47% organisasi telah mengalami serangan deepfake dari beberapa jenis[19]. Dan ini bukan hanya teori: beberapa pencurian pada tahun 2023-2025 telah membuktikan bahwa deepfake dapat mengalahkan otentikasi utama - mata dan telinga kita sendiri.

Salah satu kasus yang terkenal melibatkan transfer bank internasional sebesar $25 juta setelah seorang karyawan tertipu oleh konferensi video palsu. Para penyerang menggunakan AI untuk mensintesis kemiripan dengan CFO perusahaan dalam panggilan Zoom, lengkap dengan suara dan tingkah lakunya, menginstruksikan karyawan tersebut untuk mentransfer dana[4][20]. Dalam insiden lain di Australia, pemerintah setempat kehilangan $2.3 juta ketika para penipu memalsukan suara dan video pejabat kota untuk menyetujui pembayaran palsu[21]. Dan yang mengkhawatirkan, para penjahat menggunakan suara tiruan AI dalam "penipuan kakek-nenek" - menelepon para manula dan menyamar sebagai kerabat mereka yang sedang dalam kesulitan. The FBI dan FinCEN mengeluarkan peringatan pada akhir tahun 2024 tentang lonjakan penipuan menggunakan Media "deepfake" yang dihasilkan oleh AItermasuk agen layanan pelanggan palsu dan identitas sintetis untuk mem-bypass verifikasi KYC[22].

Frekuensi kejahatan berbasis deepfake meningkat dengan cepat. Pada akhir tahun 2024, sebuah analisis menunjukkan penipuan deepfake baru terjadi setiap lima menit rata-rata[23]. Pada Q1 2025 saja, insiden deepfake yang dilaporkan melonjak 19% dibandingkan dengan semua tahun 2024[24][25]. Deepfakes sekarang menyumbang sekitar 6,5% dari semua serangan penipuan, a Peningkatan 2.137% sejak tahun 2022[26][27]. Teknologi yang dibutuhkan telah menjadi mudah diakses - sering kali hanya membutuhkan sedikit Audio 30 detik untuk mengkloning suara, atau di bawah satu jam cuplikan sampel untuk memodelkan wajah seseorang secara meyakinkan[20]. Singkatnya, tidak pernah semudah ini untuk "memalsukan" identitas orang yang dipercaya dan mengelabui korban untuk menyerahkan uang atau informasi.

Langkah-langkah Pertahanan - Mengotentikasi Realitas: Untuk melawan ancaman deepfake, organisasi beralih ke teknologi canggih deteksi media sintetis alat. Sebagai contoh, Detektor Suara AI dari TruthScan dan Detektor Deepfake TruthScan menggunakan AI untuk menganalisis audio dan video untuk mencari tanda-tanda manipulasi. Sistem ini melakukan analisis frame-by-frame dan bentuk gelombang untuk menemukan artefak seperti gerakan wajah yang tidak wajar, masalah sinkronisasi bibir, atau ketidakteraturan spektral audio yang mengkhianati klip yang dibuat oleh AI. Dalam pengujian, algoritme TruthScan mencapai Akurasi 99%+ dalam mengidentifikasi suara yang dihasilkan AI dan mendeteksi bingkai video yang dimanipulasi secara real time[28][29]. Faktanya, para peneliti di Genians Security Center baru-baru ini menggunakan forensik gambar TruthScan untuk menganalisis kartu identitas palsu yang digunakan oleh para peretas Korea Utara - detektor gambar deepfake dari TruthScan menandai dokumen tersebut sebagai dokumen yang tidak otentik dengan Keyakinan 98%menggagalkan upaya spear-phishing[5][30].

Untuk pertahanan praktis, perusahaan menerapkan kemampuan deteksi ini pada titik-titik kunci. Verifikasi suara ditambahkan ke alur kerja pusat panggilan - misalnya ketika "klien" meminta transfer dalam jumlah besar melalui telepon, audio dapat dijalankan melalui detektor pemalsuan suara untuk memastikan bahwa itu benar-benar suara mereka (dan bukan tiruan AI). Demikian juga, platform konferensi video dapat mengintegrasikan pemindaian deepfake langsung dari streaming video peserta, untuk menangkap wajah sintetis. Rangkaian deteksi deepfake dari TruthScan, misalnya, menawarkan analisis panggilan video waktu nyata dan autentikasi wajah yang dapat dihubungkan ke Zoom atau WebEx melalui API[31][29]. Ini berarti jika seseorang mencoba bergabung dalam rapat menggunakan video CEO Anda yang dibuat dengan AI, sistem dapat menandai "kemungkinan pemalsuan" sebelum kerusakan terjadi. Selain itu, transaksi penting sekarang sering kali menyertakan langkah verifikasi (di luar jaringan atau multi-faktor) yang dapat meningkatkan autentikasi konten - misalnya, memerlukan konfirmasi lisan singkat yang kemudian diperiksa oleh detektor suara AI untuk keasliannya. Dengan melapisi alat-alat ini, perusahaan menciptakan jaring pengaman: bahkan jika karyawan lihat atau mendengar sesuatu yang masuk akal, forensik AI di belakang layar akan mempertanyakan realitasnya. Dalam lanskap ancaman yang dirasuki AI, "Jangan percaya - verifikasi" menjadi mantra untuk setiap komunikasi suara atau video yang melibatkan uang atau akses sensitif.

Malware Buatan AI & Kode yang Dikaburkan: Ancaman yang Berkembang dalam Kode

Pengaruh AI tidak terbatas pada rekayasa sosial - AI juga mengubah permainan dalam pengembangan malware dan kode serangan yang mengelak. Pada tahun 2025, Grup Intelijen Ancaman Google menemukan jenis malware pertama yang menggunakan AI selama eksekusi untuk mengubah perilaku mereka[32][33]. Salah satu contohnya, dijuluki PROMPTFLUXadalah skrip berbahaya yang sebenarnya memanggil API AI (model Gemini Google) untuk menulis ulang kodenya sendiri dengan cepatmenghasilkan varian baru yang dikaburkan untuk menghindari deteksi antivirus[34][35]. Evolusi AI "tepat pada waktunya" ini menandai lompatan menuju malware polimorfik yang otonom. Contoh lainnya, PROMPTSTEALmenggunakan asisten pengkodean AI untuk menghasilkan perintah Windows satu baris untuk pencurian data, yang pada dasarnya mengalihdayakan sebagian logikanya ke mesin AI secara real time[36][37]. Inovasi-inovasi ini menunjukkan masa depan di mana malware dapat terus mengubah dirinya sendiri - seperti halnya pena manusia - untuk mengalahkan pertahanan.

Bahkan tanpa AI on-the-fly, penyerang menggunakan AI selama pengembangan untuk membuat kode berbahaya yang lebih kuat. AI generatif dapat menghasilkan malware yang sangat kaburyang mengandung lapisan logika membingungkan yang menghambat rekayasa balik. Menurut laporan intelijen ancaman, lebih dari 70% pelanggaran besar pada tahun 2025 melibatkan beberapa bentuk malware polimorfik yang mengubah tanda tangan atau perilakunya untuk menghindari deteksi[38]. Selain itu, 76% kampanye phishing sekarang menggunakan taktik polimorfik seperti URL dinamis atau muatan yang ditulis ulang oleh AI[38]. Alat-alat seperti persembahan dark-web WormGPT dan PenipuanGPT (klon ChatGPT yang tidak dibatasi) memungkinkan bahkan orang yang bukan ahli untuk menghasilkan malware dropper, keylogger, atau kode ransomware hanya dengan menjelaskan apa yang mereka inginkan[39]. Hasilnya adalah banyaknya varian malware baru. Misalnya, pada tahun 2024, sebuah pencuri informasi bernama BlackMamba muncul yaitu sepenuhnya dihasilkan oleh AImenggunakan ChatGPT untuk menulis kodenya dalam beberapa segmen - setiap eksekusi menghasilkan biner yang sedikit berbeda, sehingga membingungkan antivirus berbasis tanda tangan tradisional[38]. Peneliti keamanan juga mendemonstrasikan bukti-konsep polimorfik yang dihasilkan oleh AI yang dapat menghindari banyak perlindungan titik akhir[40].

Selain itu, para penyerang memanfaatkan AI untuk menyempurnakan pengiriman malware. AI dapat dengan cerdas membuat skrip email phishing (seperti yang telah dibahas) yang membawa tautan malware. AI juga dapat membantu pengembangan eksploitasi - misalnya menggunakan AI untuk menemukan kerentanan baru atau mengoptimalkan shellcode. Aktor negara-bangsa dilaporkan telah menggunakan model AI canggih untuk membantu menemukan eksploitasi zero-day dan mengembangkan malware yang disesuaikan untuk target[41]. Semua tren ini berarti bahwa malware di tahun 2025 akan lebih tersembunyi dan lebih adaptif. Sering kali "diciptakan bersama" dengan AIsehingga lebih sulit untuk dideteksi dengan menggunakan aturan konvensional.

Tindakan Pertahanan - AI vs AI dalam Pertahanan Malware: Mempertahankan diri dari malware yang dibuat oleh AI membutuhkan kombinasi deteksi canggih dan analisis bertenaga AI di sisi pertahanan. Banyak organisasi yang meningkatkan perlindungan titik akhir dan EDR (Deteksi & Respons Titik Akhir) dengan model AI/ML yang mencari pola perilaku kode yang dihasilkan AI. Misalnya, transformasi kode on-host yang tiba-tiba atau pola panggilan API yang tidak biasa dapat mengindikasikan sesuatu seperti PROMPTFLUX yang meregenerasi dirinya sendiri. Demikian pula, pemantauan jaringan dapat menangkap anomali seperti malware yang menjangkau layanan AI (yang tidak "normal" untuk aplikasi pengguna). Vendor sedang melatih detektor berbasis ML pada keluarga malware berbantuan AI yang diidentifikasi sejauh ini, meningkatkan pengenalan terhadap ancaman baru ini.

Salah satu solusi yang muncul adalah pemindaian konten AI terintegrasi dalam pengembang dan membangun pipeline. Ini berarti menggunakan detektor yang digerakkan oleh AI untuk menganalisis skrip, pembuatan perangkat lunak, atau bahkan perubahan konfigurasi untuk konten berbahaya atau konten yang dibuat oleh AI. Sebagai contoh, Detektor Waktu Nyata dari TruthScan dapat digunakan lebih dari sekadar teks - analisis multimodalnya berpotensi menandai kode atau file konfigurasi yang mencurigakan dengan mengenali apakah file tersebut dibuat oleh mesin dengan pola pengaburan[42][43]. Tim pengembangan dan MSSP mulai memindai skrip infrastruktur-sebagai-kode, log PowerShell, dan artefak lainnya untuk mencari tanda-tanda segmen yang ditulis oleh AI yang dapat mengindikasikan tangan penyerang. Meskipun ini adalah area yang baru, namun menunjukkan harapan: dalam satu kasus, tim keamanan menggunakan detektor AI untuk menangkap file kit phishing yang dikaburkan yang "terasa" dibuat oleh AI dan memang merupakan bagian dari serangan[44]. Kode file tersebut terlalu rumit dan bertele-tele (ciri khas generasi AI), dan pemindaian konten AI mengonfirmasi kemungkinan besar file tersebut tidak ditulis oleh manusia[40].

Terakhir, berbagi intelijen ancaman yang berfokus pada ancaman AI sangatlah penting. Ketika Google GTIG mempublikasikan detail malware berbasis Prompt atau ketika para peneliti melaporkan teknik penghindaran AI yang baru, organisasi harus memasukkannya ke dalam teknik pendeteksian mereka. Analisis perilaku - mencari tindakan seperti proses yang memunculkan skrip yang menulis ulang kode proses yang sama - dapat menangkap anomali yang ditunjukkan oleh malware yang dibantu oleh AI. Singkatnya, para pembela HAM harus melawan api dengan api: menyebarkan Alat keamanan berbasis AI yang dapat beradaptasi secepat malware yang digerakkan oleh AI. Ini mencakup segala sesuatu mulai dari antivirus yang ditingkatkan dengan AI hingga analitik perilaku pengguna yang dapat mengidentifikasi ketika sebuah akun atau sistem mulai bertindak "tidak seperti manusia." Dengan menggunakan AI untuk pertahanan, tim keamanan dapat melawan keunggulan kecepatan dan skala yang diberikan oleh AI kepada para penyerang.

Identitas Sintetis dan Skema Penipuan yang Dipicu oleh AI

Beranjak dari malware ke dunia penipuan: penipuan identitas sintetis telah meledak dengan bantuan AI generatif. Penipuan identitas sintetis melibatkan pembuatan persona fiktif dengan menggabungkan data asli dan palsu (mis. SSN asli + nama dan dokumen palsu). Identitas "Frankenstein" ini kemudian digunakan untuk membuka rekening bank, mengajukan kredit, atau lolos dari pemeriksaan KYC - yang pada akhirnya menghasilkan pinjaman yang tidak terbayar atau pencucian uang. Ini sudah menjadi salah satu jenis penipuan yang tumbuh paling cepat, dan AI sekarang telah menyiramkan bahan bakar ke dalam api. Kerugian dari penipuan ID sintetis melewati $35 miliar pada tahun 2023[45]dan pada awal tahun 2025, beberapa perkiraan menunjukkan hampir 25% dari semua kerugian penipuan bank disebabkan oleh identitas sintetis[46]. Analis Experian menemukan bahwa lebih dari 80% penipuan akun baru di pasar tertentu sekarang ditautkan ke ID sintetis[19] - sebuah statistik mengejutkan yang menggarisbawahi betapa meluasnya penipuan ini.

AI generatif memperkuat penipuan sintetis dalam beberapa cara. Pertama, AI membuatnya sepele untuk menghasilkan "dokumen penangkar" dan jejak digital yang diperlukan untuk menjual identitas palsu. Di masa lalu, penipu mungkin mengedit foto identitas atau secara manual membuat tagihan listrik palsu. Sekarang, ada alat untuk menghasilkan foto profil yang tampak asli, kartu identitas, paspor, rekening koran, bahkan profil media sosial menggunakan generator gambar AI dan model bahasa[47][48]. Sebagai contoh, seseorang dapat menggunakan AI untuk membuat foto kepala realistis dari seseorang yang tidak ada (mencegah pencarian gambar terbalik dengan mudah), dan menghasilkan SIM palsu yang cocok dengan foto tersebut. AI juga dapat mensimulasikan "tanda-tanda kehidupan" dari sebuah identitas - misalnya membuat catatan orang tua, alamat, atau unggahan media sosial yang bersifat sintetis untuk menyempurnakan cerita latar[49]. The Boston Fed mencatat bahwa Gen AI bahkan dapat menghasilkan memalsukan audio dan video dari orang palsu - misalnya, pengguna sintetis dapat "muncul" dalam video verifikasi selfie, lengkap dengan wajah dan suara yang unik, semuanya dihasilkan oleh AI[50].

Kedua, AI membantu penipu tingkatkan operasi mereka. Alih-alih memalsukan satu atau dua identitas pada satu waktu, mereka dapat secara terprogram menghasilkan ratusan atau ribuan paket identitas lengkap dan secara otomatis mengisi aplikasi akun baru secara massal[51][52]. Beberapa layanan web gelap secara efektif menawarkan "Identitas Sintetis sebagai Layanan"menggunakan otomatisasi untuk menghasilkan akun terverifikasi untuk dijual. Selama program bantuan pandemi COVID-19, misalnya, penjahat menggunakan bot dengan identitas yang dibuat oleh AI untuk mengajukan pinjaman dan tunjangan secara massal, membuat sistem kewalahan dengan pelamar palsu. Seperti yang diproyeksikan oleh Juniper Research, kerugian global akibat penipuan identitas digital (yang dipicu oleh taktik ini) akan naik 153% pada tahun 2030 dibandingkan dengan tahun 2025[53].

Tindakan Pertahanan - Memverifikasi Identitas di Dunia AI: Metode pemeriksaan identitas tradisional sedang berjuang melawan pemalsuan yang dibuat oleh AI. Untuk beradaptasi, organisasi mengadopsi verifikasi identitas dan perilaku berlapis-lapis didukung oleh AI. Lapisan kunci sudah maju forensik dokumen dan gambar. Sebagai contoh, Detektor Gambar AI dari TruthScan dan Detektor Dokumen Palsu memberikan kemampuan untuk menganalisis ID, swafoto, atau dokumen yang diunggah untuk mencari tanda-tanda sintesis atau gangguan. Alat-alat ini memeriksa artefak tingkat piksel, ketidakkonsistenan pencahayaan, dan metadata untuk menentukan apakah sebuah gambar dibuat oleh AI atau dimanipulasi. Alat-alat ini dapat menangkap isyarat halus - seperti pola latar belakang yang identik dari foto yang dibuat oleh GAN, atau jenis huruf dan spasi pada ID yang tidak sesuai dengan templat pemerintah yang diketahui. Dengan menggunakan detektor semacam itu pada saat penerimaan, bank dapat secara otomatis menandai SIM atau swafoto pemohon jika kemungkinan besar dibuat oleh AI (misalnya, sistem TruthScan akan menandai ID militer palsu yang digunakan dalam kasus phishing Kimsuky APT).[5]). Menurut siaran pers TruthScan, platform mereka telah digunakan oleh lembaga keuangan untuk memvalidasi keaslian dokumen dalam skala besar, mengidentifikasi pemalsuan dengan akurasi yang sangat tinggi[54].

Lapisan lainnya adalah analisis perilaku dan pemeriksaan referensi silang. Identitas asli memiliki kedalaman - sejarah bertahun-tahun, catatan publik, aktivitas media sosial, dll. Identitas yang dihasilkan oleh AI, tidak peduli seberapa bagusnya, sering kali tidak memiliki akar yang dalam. Bank dan pemberi pinjaman sekarang menggunakan AI untuk mengkorelasikan data aplikasi dengan data publik dan data kepemilikan: Apakah nomor telepon dan email orang ini menunjukkan riwayat penggunaan? Apakah geolokasi perangkat atau IP-nya masuk akal? Apakah mereka mengetik data dalam formulir dengan cara manusia, atau menyalin-tempel (seperti yang dilakukan bot)? Model AI dapat dilatih untuk membedakan perilaku pelanggan yang asli dengan pola sintetis. Federal Reserve mencatat bahwa "Identitas sintetis bersifat dangkal, dan AI dapat melihatnya" - Verifikasi berbasis AI dapat dengan cepat mencari jejak digital dari sebuah identitas dan memberikan peringatan jika hanya sedikit atau bahkan tidak ada sama sekali.[55]. Dalam praktiknya, layanan verifikasi identitas sekarang menggunakan AI yang memeriksa apakah selfie pengguna cocok dengan foto-foto sebelumnya (untuk mendeteksi pertukaran wajah) dan bahkan meminta pengguna dengan tindakan acak (seperti pose atau frasa tertentu) selama pemeriksaan keaktifan, sehingga menyulitkan deepfakes untuk merespons dengan benar[56][57].

Akhirnya, pemantauan berkelanjutan perilaku akun setelah onboarding membantu menangkap akun-akun sintetis yang lolos. Karena akun-akun ini tidak terkait dengan persona yang sebenarnya, pola penggunaannya sering kali terlihat jelas (misalnya, melakukan transaksi yang tepat waktu untuk mendapatkan kredit, lalu menggunakannya secara berlebihan). Pemantauan penipuan berbasis AI (seperti platform Sift atau Feedzai) dapat mengidentifikasi anomali dalam penggunaan akun, menandai potensi sintetis untuk ditinjau. Singkatnya, memerangi penipuan identitas yang didukung oleh AI membutuhkan Pembuktian identitas dengan AI - menggabungkan forensik dokumen, pemeriksaan biometrik, korelasi data, dan analisis perilaku. Kabar baiknya, kemajuan AI yang sama yang memungkinkan terjadinya penipuan juga digunakan untuk mendeteksinya. TruthScan, misalnya, menawarkan solusi rangkaian verifikasi identitas yang mengintegrasikan analisis teks, gambar, dan suara untuk memeriksa pengguna baru. Dengan memanfaatkan alat ini, salah satu bank besar mencatat penurunan yang signifikan dalam pembukaan akun sintetis yang berhasil, bahkan ketika rata-rata industri meningkat. Perlombaan senjata terus berlanjut, tetapi para pembela HAM belajar untuk menemukan "petunjuk digital" yang samar-samar dari akun sintetis, tidak peduli seberapa baik AI mencoba menutupi jejaknya.

Mengintegrasikan Deteksi AI di Seluruh Tumpukan Keamanan

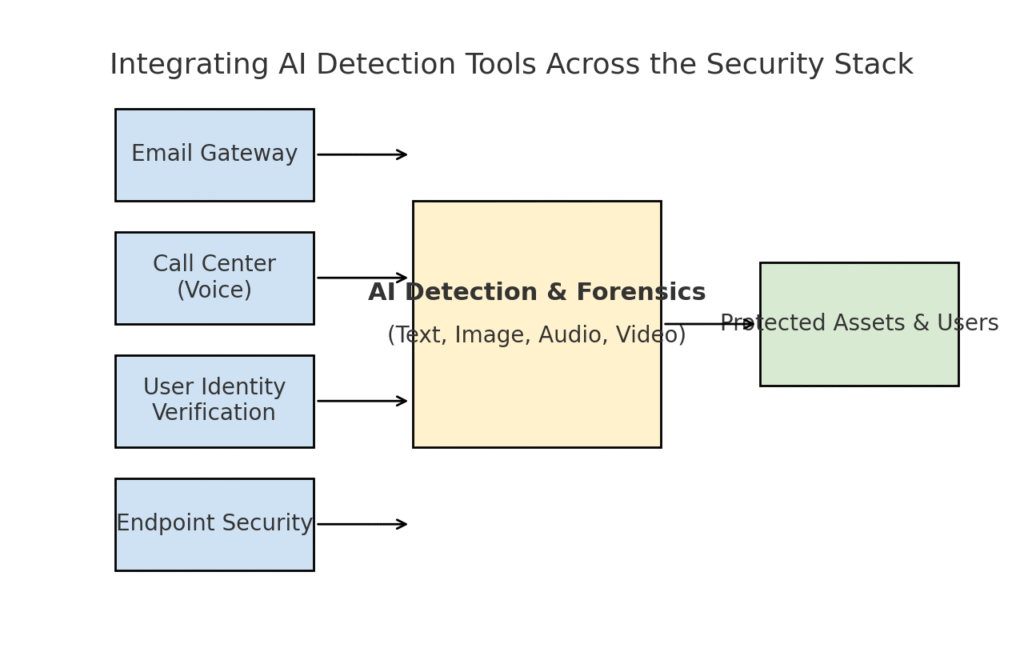

Kami telah menjelajahi beberapa area ancaman yang berbeda - phishing, deepfakes, malware, penipuan sintetis - semuanya didukung oleh AI. Sudah jelas bahwa tidak ada alat tunggal atau perbaikan satu kali akan menyelesaikan tantangan tersebut. Sebaliknya, perusahaan membutuhkan strategi yang komprehensif untuk menyematkan deteksi dan verifikasi bertenaga AI di setiap lapisan dari tumpukan keamanan siber mereka. Pendekatan ini harus mencerminkan permukaan serangan, yang meliputi email, web, suara, dokumen, identitas, dan lainnya. Diagram di bawah ini mengilustrasikan bagaimana organisasi dapat mengintegrasikan alat deteksi AI TruthScan (dan solusi serupa) di seluruh lapisan keamanan perusahaan yang umum:

Mengintegrasikan alat pendeteksi AI di berbagai lapisan tumpukan keamanan - mulai dari gateway email dan pusat panggilan hingga verifikasi pengguna dan perlindungan titik akhir. Deteksi konten AI (tengah) menganalisis teks, gambar, audio, dan video secara real time, yang kemudian dimasukkan ke dalam titik-titik penegakan yang melindungi aset dan pengguna.

Dalam model ini, detektor AI multi-modal bertindak sebagai otak pusat yang berinteraksi dengan berbagai kontrol keamanan:

- Gerbang Email: Email masuk akan melewati detektor teks/penipuan AI sebelum mencapai kotak masuk. Hal ini berkaitan dengan pertahanan phishing yang telah kita bahas - misalnya dengan menggunakan Detektor Penipuan Email dari TruthScan melalui API di penyedia email Anda untuk secara otomatis mengkarantina email yang dibuat oleh AI yang mencurigakan[18]. Ini juga dapat diterapkan pada platform perpesanan (aplikasi chatting, gateway SMS) untuk memindai konten dari pola phishing atau penipuan.

- Pusat Panggilan dan Sistem Suara: Saluran telepon dan VOIP diamankan dengan mengintegrasikan deteksi pemalsuan suara. Sebagai contoh, saluran dukungan pelanggan bank dapat menggunakan Detektor Suara AI dari TruthScan untuk menganalisis audio penelepon yang masuk secara real time dan memperingatkan jika jejak suara penelepon adalah sintetis atau tidak sesuai dengan profil mereka yang diketahui[58][59]. Hal ini membantu mencegah serangan vishing dan peniruan suara (seperti panggilan CEO palsu) agar tidak berhasil.

- Proses Verifikasi Identitas Pengguna: Selama pembuatan akun atau tindakan pengguna yang berisiko tinggi (pengaturan ulang kata sandi, transfer kawat), verifikasi identitas yang digerakkan oleh AI mulai bekerja. ID foto yang diunggah diperiksa oleh alat forensik gambar (misalnya, memeriksa apakah foto tersebut dibuat oleh AI atau foto dari foto), dan panggilan selfie atau video disaring oleh detektor pemalsuan. TruthScan Detektor Deepfake dapat digunakan di sini untuk melakukan otentikasi wajah - memastikan orang yang ada di kamera adalah orang yang nyata dan cocok dengan ID[60][61]. Sinyal perilaku (irama pengetikan, konsistensi perangkat) juga dapat dimasukkan ke dalam model AI untuk mendeteksi bot atau identitas sintetis.

- Titik Akhir dan Jaringan: Agen keamanan titik akhir dan server proxy dapat menggabungkan analisis konten AI untuk file dan skrip. Misalnya, jika EDR titik akhir melihat skrip atau EXE baru yang sedang dieksekusi, EDR dapat mengirimkan konten teks file ke detektor AI untuk memeriksa apakah file tersebut menyerupai malware buatan AI yang dikenal atau menunjukkan ciri-ciri kode AI yang dikaburkan. Demikian pula, sistem DLP (pencegahan kehilangan data) dapat menggunakan deteksi teks AI untuk menandai teks sensitif yang dibuat oleh AI (yang dapat mengindikasikan orang dalam yang menggunakan AI untuk membuat pesan eksfiltrasi data atau memalsukan laporan). TruthScan Detektor Waktu Nyata dirancang untuk terhubung ke alur kerja tersebut, menawarkan analisis konten secara langsung di seluruh platform dengan opsi respons otomatis[42][62] (misalnya, memblokir file atau pesan secara otomatis jika teridentifikasi sebagai malware atau disinformasi yang dihasilkan oleh AI).

The manfaat utama dari pendekatan terpadu ini adalah kecepatan dan konsistensi. Serangan AI bergerak dengan cepat - email phishing, suara palsu, dan data sintetis dapat menyerang banyak saluran sekaligus. Dengan menginstruksikan semua saluran tersebut dengan deteksi AI, sebuah organisasi mendapatkan visibilitas waktu nyata dan pertahanan yang mendalam. Satu tim menggambarkannya sebagai menciptakan "sistem kekebalan AI" untuk perusahaan mereka: setiap kali ada sesuatu yang dikomunikasikan (baik itu email, unggahan dokumen, panggilan suara, dll.), sistem kekebalan AI "mengendusnya" untuk mencari tanda tangan asing (yang dibuat oleh AI) dan menetralisirnya jika ditemukan berbahaya.

Paket perusahaan TruthScan mencontohkan hal ini, karena menawarkan platform terpadu mencakup deteksi AI teks, gambar, audio, dan video yang dapat digunakan secara modular atau secara keseluruhan[63][64]. Banyak perusahaan memulai dengan menerapkan satu atau dua kemampuan (misalnya, deteksi teks dalam email dan deteksi gambar dalam proses orientasi) dan kemudian mengembangkannya ke kemampuan lain setelah mereka melihat nilainya. Yang penting, integrasi dibuat ramah pengembang - TruthScan dan layanan serupa menyediakan API dan SDK sehingga tim keamanan dapat mengaitkan deteksi ke dalam sistem yang ada tanpa melakukan rekayasa ulang secara besar-besaran. Baik itu SIEM, gateway email, aplikasi perbankan khusus, atau sistem CRM, pendeteksian dapat berjalan di belakang layar dan memberikan peringatan atau tindakan otomatis. Sebagai contoh, sebuah platform media sosial besar mengintegrasikan API moderasi konten untuk secara otomatis menghapus video deepfake dalam beberapa menit setelah diunggah[65][66]mencegah penyebaran informasi yang salah yang dihasilkan oleh AI.

Kesimpulan: Tetap Terdepan di Depan Kurva

Perkembangan pesat ancaman yang digerakkan oleh AI pada tahun 2025 telah menantang organisasi dengan cara baru. Para penyerang telah menemukan cara untuk mengeksploitasi kepercayaan manusia dalam skala besar - meniru suara dan identitas, mengotomatiskan rekayasa sosial, menghindari pertahanan melalui kode adaptif, dan mengarang seluruh realitas palsu. Ini adalah prospek yang menakutkan bagi para pembela HAM, tetapi bukan berarti tidak ada harapan. Sama seperti para penjahat yang memanfaatkan AI, kita juga dapat menggunakan AI di sisi keamanan. Munculnya Deteksi konten AI, forensik deepfake, dan pemindai identitas sintetis memberi kita kekuatan untuk melawan ancaman-ancaman baru ini. Dengan menggunakan alat-alat ini dan mengintegrasikannya di semua lapisan pertahanan, perusahaan dapat secara dramatis mengurangi risiko serangan bertenaga AI yang lolos. Para pengguna awal telah menggagalkan upaya penipuan bernilai jutaan dolar dengan menangkap pelaku deepfake.[26]atau mencegah bencana phishing dengan menyaring email yang dibuat oleh AI.

Di luar teknologi, organisasi harus mengembangkan budaya "percaya tapi verifikasi". Karyawan harus menyadari bahwa di era AI, melihat (atau mendengar) tidak selalu berarti percaya - skeptisisme yang sehat yang dipasangkan dengan alur kerja verifikasi dapat menghentikan banyak taktik rekayasa sosial. Pelatihan dan kesadaran, dikombinasikan dengan alat verifikasi otomatis seperti TruthScanmembentuk pertahanan yang tangguh. Dalam artian, kita harus meningkatkan standar untuk otentikasi dan validasi informasi. Komunikasi dan dokumen digital tidak bisa lagi diterima begitu saja; asal-usulnya perlu diperiksa, baik dengan mesin atau proses.

Seiring berjalannya waktu, kami berharap para penyerang akan semakin menyempurnakan taktik AI mereka - tetapi juga mengharapkan inovasi yang berkelanjutan dalam AI pertahanan. Dinamika kucing dan tikus akan terus berlanjut. Keberhasilan para pemain bertahan akan bergantung pada kelincahan dan berbagi intelijen. Mereka yang dengan cepat menggabungkan intelijen ancaman baru (misalnya teknik deteksi deepfake baru atau tanda tangan model AI yang diperbarui) akan tetap berada di depan para penyerang yang memanfaatkan alat AI terbaru. Kolaborasi antara industri, akademisi, dan pemerintah juga akan sangat penting dalam pertarungan ini, seperti yang terlihat dari peringatan dan kerangka kerja yang muncul dari lembaga-lembaga seperti Kerangka Kerja Manajemen Risiko AI NIST dan kolaborasi antar bank dalam deteksi AI penipuan.

Sebagai penutup, industri keamanan siber berada di tengah-tengah pergeseran paradigma yang digerakkan oleh AI. Ancaman yang dihadapi tidak seperti satu dekade yang lalu, tetapi kami menghadapinya dengan pertahanan yang belum pernah terjadi sebelumnya. Dengan kombinasi teknologi pendeteksian canggih dan strategi keamanan yang kuat, kami bisa mengurangi risiko AI generatif dan bahkan mengubahnya menjadi keuntungan bagi kami. Alat-alat seperti rangkaian deteksi AI dari TruthScan memungkinkan kami untuk mengembalikan kepercayaan di dunia tanpa kepercayaan - untuk memastikan bahwa orang di ujung telepon adalah orang yang nyata, bahwa dokumen di kotak masuk kita adalah asli, dan bahwa kode yang berjalan di jaringan kita belum dirusak oleh AI yang berbahaya. Dengan berinvestasi pada kemampuan ini sekarang, organisasi tidak hanya akan melindungi diri mereka sendiri dari serangan yang diaktifkan oleh AI saat ini, tetapi juga membangun ketahanan terhadap ancaman yang terus berkembang di masa depan. Kesimpulannya jelas: AI mungkin meningkatkan serangan siber, tetapi dengan pendekatan yang tepat, AI juga dapat meningkatkan pertahanan kita.

Sumber: Data dan contoh yang relevan diambil dari laporan intelijen ancaman tahun 2025 dan para ahli, termasuk Tren Insiden Siber Mayer Brown[1][67], rangkuman ancaman Fortinet tahun 2025[2][19], penelitian Barracuda tentang serangan email AI[6][7]Laporan ancaman AI dari Google GTIG[34], wawasan Federal Reserve Boston tentang penipuan sintetis[45][50]dan studi kasus dan siaran pers yang dipublikasikan oleh TruthScan[30][26]antara lain. Hal ini menggambarkan cakupan ancaman yang digerakkan oleh AI dan keampuhan penanggulangan yang berfokus pada AI dalam skenario dunia nyata. Dengan belajar dari kecerdasan semacam itu dan menggunakan alat bantu mutakhir, kita dapat menavigasi era risiko siber yang ditingkatkan dengan AI dengan percaya diri.

[1] [67] Tren Insiden Siber 2025 yang Perlu Diketahui Bisnis Anda | Wawasan | Mayer Brown

[2] [3] [19] Statistik Keamanan Siber Teratas: Fakta, Statistik, dan Pelanggaran untuk tahun 2025

https://www.fortinet.com/resources/cyberglossary/cybersecurity-statistics

[4] [11] [12] [16] [17] [20] [22] [47] [48] [52] Penipuan Berbasis AI dalam Layanan Keuangan: Tren dan Solusi Terkini | TruthScan

https://truthscan.com/blog/ai-driven-fraud-in-financial-services-recent-trends-and-solutions

[5] [26] [30] [54] TruthScan Mendeteksi Serangan Deepfake Korea Utara terhadap Pejabat Pertahanan - Majalah Bryan County

[6] [7] [14] Setengah dari spam di kotak masuk Anda dihasilkan oleh AI - penggunaannya dalam serangan tingkat lanjut berada pada tahap yang lebih awal | Blog Barracuda Networks

https://blog.barracuda.com/2025/06/18/half-spam-inbox-ai-generated

[8] [10] Indeks Kepercayaan Digital Q2 2025: Data dan Wawasan Penipuan AI | Sift

https://sift.com/index-reports-ai-fraud-q2-2025

[9] [13] [24] [25] [38] [39] Ancaman Keamanan Siber AI 2025: Deepfake $25.6M

https://deepstrike.io/blog/ai-cybersecurity-threats-2025

[15] [21] Intelijen Ancaman Terbaru | TruthScan

[18] [63] [64] TruthScan - Deteksi AI Perusahaan & Keamanan Konten

[23] [46] [56] [57] Deepfakes dan Deposit: Cara Melawan Penipuan AI Generatif

https://www.amount.com/blog/deepfakes-and-deposits-how-to-fight-generative-ai-fraud

[27] Serangan Deepfake & Phishing yang Dihasilkan AI: Statistik 2025

https://zerothreat.ai/blog/deepfake-and-ai-phishing-statistics

[28] [58] [59] Detektor Suara AI untuk Pemalsuan & Kloning Suara | TruthScan

https://truthscan.com/ai-voice-detector

[29] [31] [60] [61] [65] [66] Detektor Deepfake - Identifikasi Video Palsu & AI - TruthScan

https://truthscan.com/deepfake-detector

[32] [33] [34] [35] [36] [37] [41] Pelacak Ancaman AI GTIG: Kemajuan dalam Penggunaan Alat AI oleh Pelaku Ancaman | Blog Google Cloud

https://cloud.google.com/blog/topics/threat-intelligence/threat-actor-usage-of-ai-tools

[40] Peretas Mengaburkan Malware Dengan Kode AI Verbose

https://www.bankinfosecurity.com/hackers-obfuscated-malware-verbose-ai-code-a-29541

[42] [43] [62] Deteksi AI waktu nyata - TruthScan

https://truthscan.com/real-time-ai-detector

[44] Operator EvilAI Menggunakan Kode yang Dihasilkan AI dan Aplikasi Palsu untuk ...

https://www.trendmicro.com/en_us/research/25/i/evilai.html

[45] [49] [50] [51] [55] Gen AI meningkatkan ancaman penipuan identitas sintetis - Federal Reserve Bank of Boston

[53] Penipuan Identitas Sintetis 2025: Strategi Deteksi & Pencegahan AI