Panduan komprehensif untuk memahami, mendeteksi, dan mencegah penipuan suara AI di perusahaan

Panggilan Suara $25 Juta yang Tidak Pernah Terjadi

Pada bulan Februari 2024, seorang pekerja keuangan di sebuah perusahaan multinasional di Hong Kong menerima panggilan video dari CFO-nya.

Suara di ujung sana tidak salah lagi; setiap infleksi, setiap jeda, dan bahkan aksen yang sedikit pun, langsung dapat dikenali.

Dia segera memintanya untuk memproses 15 transfer kawat, dengan total $25 juta, untuk menyelesaikan akuisisi rahasia.

Jangan Pernah Khawatir Tentang Penipuan AI Lagi. TruthScan Dapat Membantu Anda:

- Mendeteksi AI yang dihasilkan gambar, teks, suara, dan video.

- Hindari penipuan besar yang digerakkan oleh AI.

- Lindungi sebagian besar sensitif aset perusahaan.

CFO tidak pernah melakukan panggilan itu. Itu sepenuhnya dihasilkan oleh AI.

Ini bukan kasus yang terisolasi. Lembaga keuangan mengalami peningkatan tajam dalam penipuan deepfake.

Selama tiga tahun terakhir, kasus-kasus telah melonjak sebanyak 2.137%, dan AI sekarang mendorong 42,5% dari semua upaya penipuan di sektor ini.

Bahkan dengan lonjakan penipuan suara AI, lebih dari separuh pemimpin bisnis mengakui bahwa karyawan mereka belum dilatih untuk mengenali atau merespons serangan deepfake; hampir 80% perusahaan tidak memiliki protokol formal untuk menangani insiden ini.

Cara Kerja Kloning Suara AI dan Mengapa Ini Menjadi Ancaman

Sintesis suara AI modern hanya membutuhkan sedikit data. Hanya dengan beberapa detik audio, Anda dapat mengkloning suara dengan akurasi hingga 85%.

Prosesnya terdiri dari tiga langkah utama:

- Pengumpulan Data: Penipu mengumpulkan sampel suara dari sumber-sumber publik seperti panggilan konferensi, wawancara podcast, klip media sosial, atau bahkan postingan video LinkedIn.

- Pelatihan Model: AI menganalisis ciri-ciri vokal seperti pitch, nada, aksen, kecepatan, dan pola pernapasan.

- Generasi: Sistem ini menciptakan ucapan sintetis yang cukup meyakinkan, bahkan untuk menipu rekan kerja yang dekat sekalipun.

Masalah Aksesibilitas

Yang membuat ancaman ini semakin berbahaya adalah demokratisasinya. Para penipu tidak lagi membutuhkan sumber daya setingkat Hollywood.

Yang diperlukan hanyalah perangkat lunak yang dapat diakses untuk mengkloning suara dari klip media sosial yang pendek. Banyak alat yang tersedia untuk umum, termasuk alat kelas konsumen Teks ke ucapan AI dapat disalahgunakan untuk menghasilkan audio sintetis yang meyakinkan.

Mengapa Eksekutif Menjadi Target Utama Penipuan

Para eksekutif menghadapi berbagai faktor risiko yang berbahaya.

Paparan publik mereka melalui media sosial membuat sampel suara mudah ditemukan, dan otoritas mereka sering kali mendorong karyawan untuk bertindak cepat dalam memenuhi permintaan yang mendesak.

Rata-rata, satu dari empat eksekutif memiliki pemahaman yang terbatas tentang teknologi deepfake.

Statistik Saat Ini Melukiskan Gambaran yang Memprihatinkan

Dalam Survei Deloitte 2024Sebanyak 25,91 persen eksekutif mengatakan bahwa organisasi mereka telah menghadapi setidaknya satu insiden deepfake yang menargetkan data keuangan atau akuntansi dalam satu tahun terakhir, dan separuh dari seluruh responden percaya bahwa serangan semacam itu akan terus bertambah dalam 12 bulan ke depan.

Yang paling memprihatinkan: hanya 52% organisasi yang merasa yakin bahwa mereka dapat mengenali pemalsuan CEO mereka.

Cara Mengenali Penipuan Suara AI

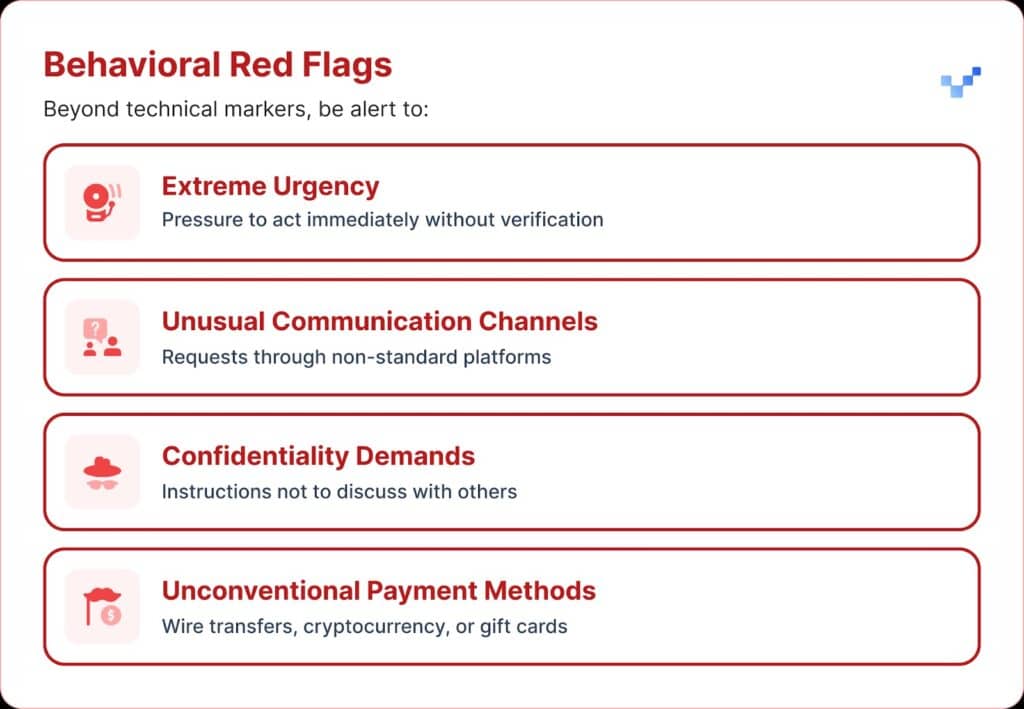

Ketika Anda menerima komunikasi suara yang mencurigakan, ada beberapa tanda peringatan yang harus diperhatikan.

Penipuan suara AI sering kali terdengar monoton atau datar. Anda mungkin juga akan melihat mondar-mandir yang tidak biasa, dengan jeda yang aneh atau ritme yang tidak wajar.

Audio juga dapat membawa dengungan atau gema elektronik yang samar-samar, terutama selama panggilan yang lebih lama.

Dan dalam banyak kasus, suara mengulang frasa terbatas yang terdengar seperti ditulis atau dilatih.

Dampak Finansial dan Biaya yang Harus Dikeluarkan

Sebagian besar organisasi mengalami kerugian rata-rata sekitar $450.000, tetapi di sektor jasa keuangan kerugian naik di atas $603.000.

Dan dalam kasus yang paling parah, 1 dari 10 organisasi melaporkan kerugian lebih dari $1 juta.

Tren ini telah berkembang dengan cepat. Penelitian sebelumnya dari tahun 2022 menunjukkan bahwa beban keuangan rata-rata dari penipuan identitas adalah sekitar $230.000, hampir setengah dari angka saat ini.

Proyeksi Kerugian di Masa Depan

Menurut Deloitte's Center for Financial Services, uang yang hilang akibat penipuan AI di AS dapat meningkat dari 1 triliun dolar AS pada tahun 2023 menjadi 1 triliun dolar AS pada tahun 2027. Itu berarti sekitar 321 triliun dolar AS setiap tahunnya.

Kerentanan Regional

Amerika Utara mengalami peningkatan 1740% dalam penipuan deepfake.

Peningkatan regional yang signifikan ini menunjukkan bahwa Amerika Utara mungkin menjadi target utama para penipu deepfake, kemungkinan karena ekonomi digitalnya yang besar dan penggunaan layanan online yang meluas.

Pendekatan Strategis untuk Perlindungan Eksekutif

1. Menerapkan Protokol Verifikasi

Salah satu cara untuk memperkuat pertahanan adalah dengan menggunakan sistem "kata aman", frasa otentikasi yang telah disepakati sebelumnya dan dibagikan kepada personel kunci.

Penipu yang menggunakan kloning suara AI tidak akan tahu jawaban yang tepat untuk pertanyaan verifikasi pribadi.

Pengamanan lainnya adalah verifikasi multi-saluran.

Setiap permintaan keuangan yang tidak biasa harus dikonfirmasi melalui saluran komunikasi terpisah, jangan pernah hanya mengandalkan metode kontak asli.

Perusahaan juga harus membuat aturan yang jelas untuk eskalasi, dengan waktu tunggu dan langkah-langkah persetujuan untuk transaksi keuangan besar, siapa pun yang memintanya.

2. Berhati-hatilah dengan Paparan Digital

Lapisan perlindungan lain datang dari membatasi seberapa banyak audio dan video eksekutif yang tersedia secara online. Semakin banyak sampel yang dapat dikumpulkan oleh penipu, semakin meyakinkan kloningan mereka.

Hal ini juga membantu menetapkan panduan media sosial yang jelas bagi para eksekutif, terutama seputar memposting video dengan audio yang bersih.

Dan ketika berbicara tentang konferensi, organisasi harus memperhatikan rekaman pembicaraan atau wawancara yang memberikan sampel suara yang panjang.

3. Menerapkan Solusi Teknis

Di sinilah teknologi pendeteksian AI yang canggih menjadi sangat penting.

Organisasi membutuhkan otentikasi suara tingkat perusahaan dan deteksi pemalsuan mendalam kemampuan yang disediakan:

- Analisis Waktu Nyata: Mendeteksi suara sintetis selama komunikasi langsung

- Verifikasi Historis: Menganalisis panggilan dan pesan yang direkam untuk mengetahui keasliannya

- Kemampuan Integrasi: Bekerja dengan lancar dengan platform komunikasi yang ada

- Tingkat Akurasi Tinggi: Meminimalkan positif palsu sekaligus menangkap pemalsuan yang canggih

4. Program Pelatihan Komprehensif

Tim kepemimpinan membutuhkan pelatihan yang ditargetkan tentang ancaman suara AI dan prosedur verifikasi.

Yang tidak kalah pentingnya adalah meningkatkan kesadaran karyawan.

Setiap orang, dalam peran apa pun, harus diperlengkapi untuk mengenali potensi deepfake dan mencegah ancaman siber memasuki organisasi.

Latihan simulasi rutin dapat memperkuat kesiapan ini dengan menggunakan percobaan penipuan suara tiruan untuk menguji dan menyempurnakan prosedur respons.

Solusi Deteksi Suara AI Tingkat Lanjut

Pertahanan tradisional dibangun untuk ancaman berbasis jaringan, bukan untuk peniruan manusia yang didukung oleh AI.

Alasan utama mengapa perangkat keamanan siber standar tidak dapat mengatasi rekayasa sosial berbasis suara:

- Tidak ada Tanda Tangan Malware: Panggilan suara tidak memicu sistem keamanan tradisional

- Faktor Kepercayaan Manusia: Orang secara alami mempercayai apa yang mereka dengar, terutama suara yang mereka kenal

- Kesenjangan Teknologi Deteksi: Meskipun ada peningkatan upaya penipuan yang digerakkan oleh AI, termasuk deepfakes, hanya 22% lembaga keuangan yang telah menerapkan alat pencegahan penipuan berbasis AI

Kebutuhan akan Deteksi Suara Khusus

Penipuan suara modern membutuhkan kemampuan deteksi modern.

Kelas perusahaan Sistem deteksi suara AI bisa:

- Menganalisis Biomarker Vokal: Mendeteksi ketidakkonsistenan halus dalam ucapan sintetis

- Pemrosesan waktu nyata: Memberikan peringatan segera selama panggilan yang mencurigakan

- Pembelajaran Berkelanjutan: Beradaptasi dengan teknik sintesis suara baru

- Siap Integrasi: Bekerja dengan infrastruktur komunikasi yang ada

Organisasi yang serius dalam melindungi dari penipuan suara perlu berinvestasi dalam teknologi pendeteksi AI yang dibuat khusus yang dapat menandingi kecanggihan ancaman yang mereka hadapi.

Penipuan Suara Ada di Sini Sekarang, dan Semakin Meningkat

Pada kuartal pertama tahun 2025, penipuan dan pencurian identitas palsu menyebabkan kerugian lebih dari 1 triliun dolar AS.

Phishing suara dengan kloningan AI melonjak 442%, dan lebih dari 400 bisnis per hari terkena penipuan CEO atau CFO palsu.

Meskipun 56% bisnis mengatakan bahwa mereka merasa sangat yakin dapat mendeteksi deepfakes, hanya 6% yang benar-benar terhindar dari kerugian finansial yang diakibatkan oleh deepfakes.

Yang penting bukanlah apakah organisasi Anda akan menjadi sasaran, tetapi apakah Anda siap untuk itu.

Penipuan suara mengubah wajah keamanan siber. Pertahanan tradisional tidak dapat mengimbangi peniruan yang didukung oleh AI.

Agar tetap terlindungi, organisasi membutuhkan alat deteksi yang lebih baik, program pelatihan yang kuat, dan prosedur verifikasi yang jelas.

Teknologi untuk melawan sudah ada di sini. Pertanyaan yang sebenarnya adalah apakah Anda akan menggunakannya sebelum insiden penipuan suara pertama Anda atau setelahnya.