Penipuan asuransi memasuki era baru yang didukung oleh kecerdasan buatan. Kelompok penipu yang canggih dan penipu tunggal sama-sama mengeksploitasi alat bantu AI generatif untuk menghasilkan klaim palsu, identitas sintetis, bukti yang dipalsukan, dan penipuan peniruan yang sangat meyakinkan. Whitepaper ini mengkaji tren 2025 terbaru dalam penipuan asuransi yang digerakkan oleh AI - mulai dari klaim dan dokumen yang dibuat oleh AI hingga penipuan suara yang dipalsukan - dan menguraikan bagaimana perusahaan asuransi dapat meresponsnya. Kami menyajikan data terbaru, kasus-kasus di dunia nyata, dan wawasan strategis bagi para penjamin emisi, penyelidik penipuan, tim keamanan siber, manajer klaim, dan pemimpin C-suite yang perlu memahami lanskap ancaman yang berkembang pesat ini.

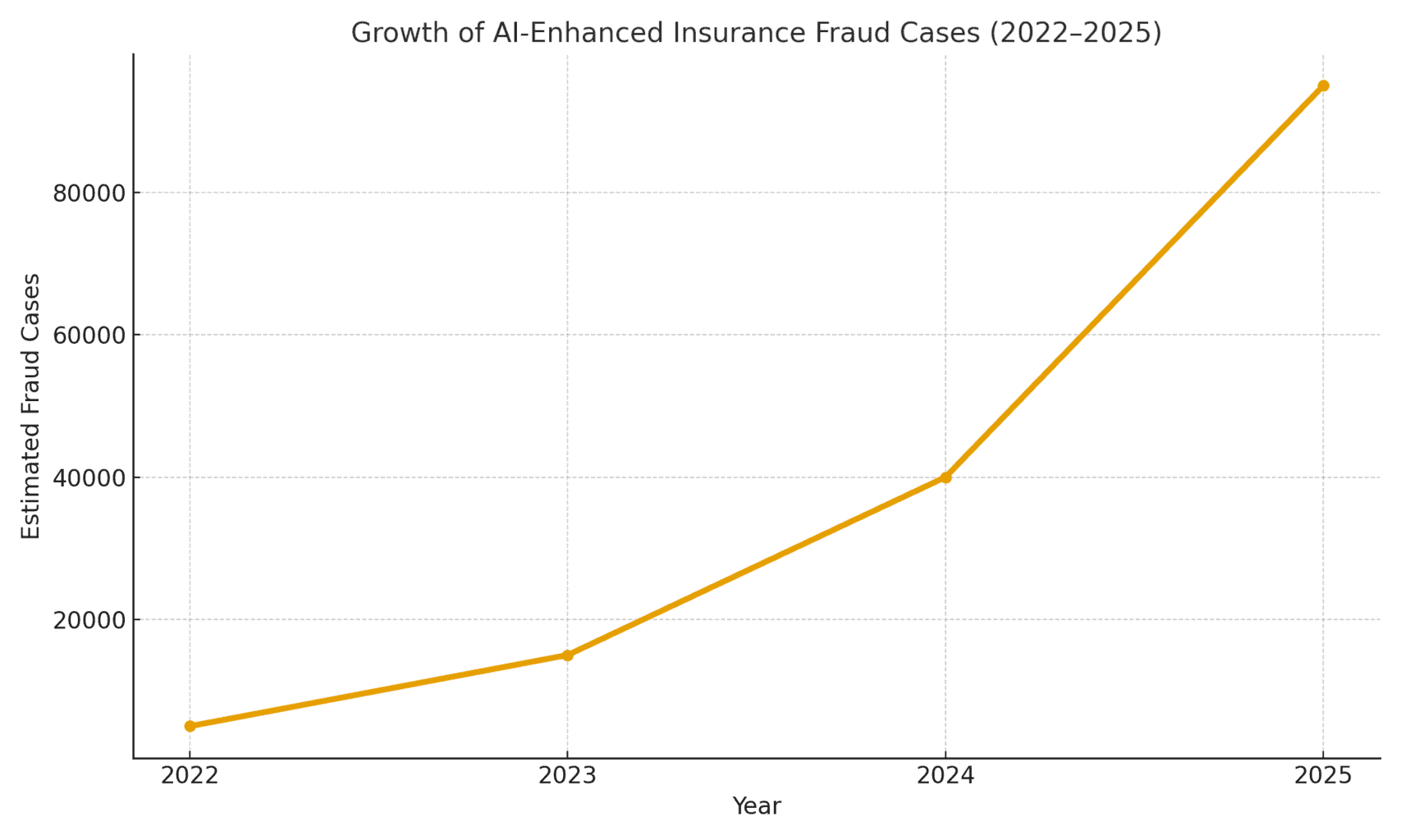

Skala Ancaman: Penipuan yang dimungkinkan oleh AI semakin meningkat. Laporan akuntansi forensik tahun 2025 menemukan bahwa Penipuan berbasis AI kini mencapai lebih dari setengah dari seluruh penipuan keuangan digital[1]. Khususnya di bidang asuransi, perusahaan keamanan suara Pindrop mengamati sebuah 475% peningkatan serangan penipuan suara sintetis di perusahaan asuransi pada tahun 2024yang berkontribusi terhadap peningkatan 19% dari tahun ke tahun dalam upaya penipuan asuransi secara keseluruhan[2]. Wajah perusahaan asuransi secara kasar Eksposur penipuan 20 kali lebih tinggi daripada banksebagian karena ketergantungan yang tinggi pada dokumen, gambar, dan verifikasi suara dalam klaim[3]. Gambar 1 di bawah ini mengilustrasikan pertumbuhan eksplosif insiden penipuan asuransi yang didukung oleh AI dari tahun 2022 hingga 2025, karena beberapa laporan industri telah mengindikasikan peningkatan persentase tiga atau empat digit dari tahun ke tahun dalam keterlibatan AI yang terdeteksi dalam penipuan.

Gambar 1: Peningkatan pesat kasus penipuan asuransi yang disempurnakan dengan AI (pertumbuhan terindeks 2022-2025). Data industri menunjukkan peningkatan eksponensial dalam konten yang dihasilkan oleh AI yang ditemukan dalam klaim penipuan, terutama sejak tahun 2023.[4][2]

Klaim yang Dihasilkan oleh AI dan Bukti Palsu

Salah satu tren yang paling umum adalah penggunaan AI generatif untuk membuat Klaim asuransi yang sepenuhnya dibuat-buat. Dengan generator teks AI yang canggih, penipu dapat menulis deskripsi kejadian yang realistis, laporan medis, atau pernyataan polisi hanya dengan mengklik sebuah tombol. Narasi yang ditulis oleh AI ini sering kali terbaca sebagai tulisan yang dipoles dan masuk akal, sehingga lebih sulit bagi penilai untuk menemukan ketidakkonsistenan. Sebagai contoh, para penipu telah menggunakan ChatGPT untuk membuat deskripsi kecelakaan yang terperinci atau laporan cedera yang terdengar profesional dan meyakinkan - sebuah tugas yang dulunya membutuhkan upaya dan keterampilan menulis yang signifikan.

Yang lebih memprihatinkan adalah bahwa para penjahat sekarang memasangkan narasi palsu ini dengan Bukti pendukung yang dihasilkan AI. Model pembuatan gambar (seperti Midjourney atau DALL-E) dan alat pengeditan dapat menghasilkan foto kerusakan dan cedera yang bersifat fotorealistik. Menurut laporan industri, beberapa pengemudi telah mulai mengirimkan gambar yang dihasilkan AI untuk membesar-besarkan kerusakan kendaraan dalam klaim mobil[5]. AI Generatif dapat membuat foto mobil yang rusak atau rumah yang kebanjiran yang sebenarnya tidak pernah ada. Gambar-gambar ini adalah sering kali lebih realistis daripada yang dapat dicapai oleh teknik Photoshop yang lebih lama[6]sehingga sulit dideteksi dengan mata telanjang. Pada bulan April 2025, Zurich Insurance mencatat peningkatan klaim dengan faktur yang dipalsukan, perkiraan perbaikan yang dibuat-buat, dan foto yang diubah secara digital, termasuk kasus-kasus di mana nomor registrasi kendaraan disisipkan dengan AI pada gambar mobil yang diselamatkan[7][8]. Bukti palsu seperti itu, jika digabungkan dengan formulir klaim yang ditulis oleh AI yang dibuat dengan baik, dapat lolos dari tinjauan manual.

Sebuah kasus yang mencolok di Inggris melibatkan penipu yang mengambil foto media sosial dari sebuah van pedagang dan menggunakan AI untuk menambahkan bumper yang retakkemudian mengirimkannya bersama dengan faktur perbaikan palsu seharga £1.000 sebagai bagian dari klaim kecelakaan palsu[9]. Penipuan ini baru terbongkar ketika para penyelidik menyadari bahwa sama foto van (sebelum kerusakan) di halaman Facebook pemiliknya[10]. Hal ini menggambarkan fenomena yang lebih luas: perusahaan asuransi melaporkan 300% melompat dalam pengeditan gambar "shallowfake" (manipulasi digital sederhana untuk menambah kerusakan atau mengubah detail) hanya dalam satu tahun (2021-2022 vs 2022-2023)[4]. Allianz Inggris memperingatkan pada tahun 2024 bahwa distorsi foto digital dan dokumen palsu memiliki "semua tanda-tanda menjadi penipuan besar terbaru yang menghantam industri ini"[4]. Kepala penipuan klaim Zurich juga mengamati bahwa apa yang dulunya membutuhkan pementasan tabrakan mobil secara fisik sekarang dapat dilakukan sepenuhnya di belakang komputer - penipu dapat "membuat klaim palsu dari balik keyboard mereka dan mengambil sejumlah besar uang" dengan foto dan laporan total kerugian palsu[11][12]. Pergeseran ini tidak hanya meningkatkan volume klaim palsu, tetapi juga menurunkan penghalang untuk masuk bagi calon penipu.

Jangan Pernah Khawatir Tentang Penipuan AI Lagi. TruthScan Dapat Membantu Anda:

- Mendeteksi AI yang dihasilkan gambar, teks, suara, dan video.

- Hindari penipuan besar yang digerakkan oleh AI.

- Lindungi sebagian besar sensitif aset perusahaan.

Lebih dari sekadar mobil, klaim properti dan korban jiwa melihat penggelembungan kerugian yang dibantu oleh AI. Ada laporan mengenai foto palsu untuk asuransi perjalanan (misalnya "kerusakan" koper atau adegan pencurian yang dipentaskan) dan tanda terima yang dibuat oleh AI untuk barang-barang mahal yang tidak pernah dibeli. Klaim jiwa dan kesehatan juga tidak kebal - penipu telah menghasilkan palsu tagihan medis dan sertifikat kematian menggunakan pemalsu dokumen AI. Bahkan, Zurich mencatat teknologi deepfake digunakan untuk membuat penilaian insinyur dan laporan medis yang sepenuhnya fiktif dalam paket klaim[11]. Dokumen yang dihasilkan AI ini, sering kali lengkap dengan logo dan tanda tangan yang realistis, tidak dapat dibedakan dari dokumen asli. Kekhawatiran yang muncul bagi perusahaan asuransi jiwa adalah penipuan berita kematian dan sertifikat kematianpenjahat dapat menggunakan AI untuk membuat berita kematian palsu atau surat dokter untuk mendukung klaim kematian seseorang yang sebenarnya masih hidup (atau yang tidak pernah ada sama sekali, seperti yang akan dibahas selanjutnya).

Pemegang Polis dan Identitas Sintetis

Mungkin perkembangan yang paling berbahaya adalah penipuan identitas sintetis dalam asuransi. Penipuan identitas sintetis melibatkan pembuatan orang atau entitas fiktif dengan menggabungkan data asli (nomor Jaminan Sosial, alamat, dll.) dengan rincian palsu (nama palsu, dokumen ID palsu). Kemajuan dalam AI telah membuatnya sangat mudah untuk menghasilkan profil pribadi yang realistis - termasuk foto dan identitas - untuk orang yang tidak ada[13][14]. Penipu sekarang dapat secara algoritmik membuat nasabah yang benar-benar palsu, membeli polis atas nama mereka, dan kemudian mengajukan klaim atau manfaat polis untuk identitas palsu tersebut.

Di sektor asuransi jiwa, skema identitas sintetis memiliki meroket. Penelitian industri pada tahun 2025 memperkirakan biaya penipuan identitas sintetis lebih dari $30 miliar per tahundengan jumlah sebanyak 80-85% dari semua kasus penipuan identitas di seluruh layanan keuangan[15][16]. Perusahaan asuransi jiwa telah terpukul dengan sangat keras: penjahat telah diketahui mengamankan polis asuransi jiwa untuk orang fiktif dan kemudian "membunuh" orang tersebut di atas kertas untuk mendapatkan manfaat kematian[17]. Sebagai contoh, seorang penipu dapat membuat klien sintetis "John Doe", membayar premi selama setahun, kemudian mengajukan klaim dengan sertifikat kematian palsu dan berita kematian John Doe yang terlalu cepat. Karena identitasnya dibuat dengan hati-hati (riwayat kredit, catatan publik, dll.), klaim kematian tersebut dapat terlihat sah - sampai tidak ada jasad asli atau kerabat asli yang dapat ditemukan. Pada saat penipuan ditemukan, para pelaku sudah lama pergi dengan pembayaran.

Skema identitas sintetis juga mewabah asuransi kesehatan dan asuransi mobil. Lingkaran kriminal menciptakan identitas "Frankenstein" dengan menggunakan nomor Jaminan Sosial anak-anak atau orang lanjut usia (yang tidak memiliki riwayat kredit) yang digabungkan dengan nama dan SIM yang dibuat oleh AI[15]. Mereka kemudian membeli polis kesehatan atau polis mobil untuk orang-orang palsu ini, dan tak lama kemudian mengajukan klaim dalam jumlah besar. Salah satu variannya adalah pengaturan sindikat bisnis palsu (perusahaan cangkang) - misalnya, perusahaan truk palsu - dan membeli asuransi komersial untuk itu, hanya untuk kemudian mengklaim kecelakaan yang dipentaskan atau cedera karyawan hantu[18][19]. Karena bisnis hanya ada di atas kertas (dengan pendaftaran bisnis dan NPWP yang dibuat oleh AI), maka penipuan sintetis "berbasis entitas" sering kali tidak ditemukan sampai setelah klaim dibayarkan[18][20].

Mengapa identitas sintetis begitu efektif? Pertama, mereka sering kali lolos dari pemeriksaan verifikasi identitas otomatis. Biro kredit dan sistem KYC dapat menemukan tidak ada tanda bahaya karena identitas tersebut menyertakan beberapa data yang nyata dan valid (mis. SSN asli dengan catatan yang bersih)[21]. Sementara itu, foto profil dan pemindaian ID yang dihasilkan AI dapat terlihat benar-benar otentik - AI saat ini dapat menghasilkan wajah manusia yang bahkan dapat diterima oleh pengenalan wajah yang canggih sekalipun. Hasilnya: sebagian besar sistem otomatis mengenali profil ini sebagai profil yang sah dan penipuan baru diketahui (jika ada) setelah terjadi kerugian besar[22].

Dampak di dunia nyata: RGA melaporkan bahwa Penipuan identitas sintetis dalam asuransi jiwa sekarang merugikan industri sekitar $30B per tahun dan telah berkembang hampir 400% sejak tahun 2020[15][16]. Komisi Perdagangan Federal AS memperkirakan ID sintetis terdiri dari sebagian besar insiden penipuan identitas[16]. Kerugian ini pada akhirnya menghantam dompet pemegang polis yang jujur - setiap keluarga membayar sekitar $ $700 ekstra dalam bentuk premi setiap tahun karena beban penipuan yang lebih luas pada perusahaan asuransi[15]. Perusahaan asuransi merespons dengan meningkatkan verifikasi pada saat penerimaan dan klaim: menerapkan pemeriksaan basis data untuk hubungan identitas, memantau beberapa polis di alamat yang sama, dan bahkan menjalankan tes "liveness" (pemeriksaan video selfie untuk memastikan bahwa pengaju klaim adalah orang yang nyata, bukan hanya gambar AI)[23][24]. Namun, seperti yang akan kita lihat, para penipu membalas dengan AI di arena berikutnya: suara dan video yang dipalsukan.

Klaim Suara dan Video Deepfake

Dihasilkan oleh AI pemalsuan audio dan video menambahkan dimensi baru yang mengkhawatirkan pada penipuan asuransi. Pada tahun 2023 dan 2024, ada beberapa insiden penjahat yang menggunakan kloning suara untuk menyamar sebagai orang lain melalui telepon - taktik yang awalnya terlihat pada pencurian bank (seperti panggilan telepon CEO deepfake yang terkenal yang mencuri $35 juta pada tahun 2020) tetapi sekarang menyebar ke asuransi. Para penipu mengkloning suara pemegang polis, dokter, atau penilai klaim dan menggunakannya dalam penipuan rekayasa sosial. Analisis Pindrop pada tahun 2024 memperingatkan bahwa "deepfakes, teknologi suara sintetis, dan penipuan berbasis AI mengubah lanskap penipuan", dengan penipuan suara penskalaan pada tingkat yang belum pernah terjadi sebelumnya[25]. Mereka menemukan bahwa pusat panggilan asuransi dibombardir oleh pelaku kejahatan dari luar negeri menggunakan pemalsuan suara: misalnya, panggilan akan masuk dengan memberikan SSN dan data pribadi pemegang polis yang dicuri, dan jika agen menjawab, agen tersebut Suara tiruan AI penelepon dapat mengelabui agen melalui otentikasi berbasis pengetahuan dan meminta pencairan yang tidak benar[26]. Dalam satu kasus perusahaan asuransi West Coast, penyerang berulang kali menggunakan metode ini untuk mencoba mengambil alih akun dan mengalihkan pembayaran, mengeksploitasi fakta bahwa verifikasi ID pusat panggilan mengandalkan suara dan info pribadi yang dapat dipalsukan[26].

Peniruan suara juga telah digunakan di sisi konsumen: Para penipu menelepon korban kecelakaan atau penerima manfaat sementara berpura-pura menjadi perwakilan asuransimenggunakan suara AI yang terdengar resmi, untuk melakukan phishing terhadap informasi sensitif atau bahkan pembayaran. Sebaliknya, penipu dapat menyamar sebagai pelanggan di hotline klaim untuk mengajukan klaim melalui telepon dengan menggunakan suara palsu yang sesuai dengan jenis kelamin/usia pelanggansehingga melewati pemeriksaan biometrik suara. Statistik penipuan baru-baru ini sangat mengkhawatirkan: para ahli industri memproyeksikan 162% pertumbuhan serangan penipuan deepfake terhadap perusahaan asuransi di tahun mendatang[27], dan Pindrop mencatatkan rekor Lonjakan 475% dalam serangan suara sintetis pada tahun 2024 seperti yang disebutkan sebelumnya[2]. Serangan-serangan ini dengan cepat melampaui vektor penipuan siber yang lebih tradisional.

Lebih dari sekadar panggilan telepon, pemalsuan berbasis video muncul dalam proses klaim. Banyak perusahaan asuransi mengadopsi inspeksi klaim virtual dan konferensi video (yang dipercepat oleh pandemi), untuk memverifikasi kerugian atau mewawancarai pengaju klaim dari jarak jauh. Sekarang, penipu adalah memanfaatkan avatar AI dan video deepfake untuk mengelabui verifikasi ini. Ada laporan tentang penggugat yang menggunakan Avatar yang dihasilkan AI pada panggilan video langsung dengan pengatur, untuk menyamar sebagai orang lain atau untuk menyembunyikan tanda-tanda ketidakkonsistenan[28]. Misalnya, sebuah jaringan penipuan mungkin menggunakan deepfake video "langsung" dari penggugat yang seharusnya menunjukkan kerusakan mereka melalui ponsel cerdasPadahal, orang yang ada di depan kamera adalah komposit yang disintesis oleh AI atau aktor sewaan yang memakai filter pengubah wajah. Salah satu skenario yang spekulatif namun masuk akal adalah menggunakan deepfake dari almarhum orang: Dalam penipuan anuitas atau asuransi jiwa, anggota keluarga dapat menggunakan video palsu dari orang yang baru saja meninggal selama panggilan bukti kehidupan rutin untuk terus menerima pembayaran[29]. Meskipun belum ada kasus terkenal seperti ini yang dipublikasikan, perusahaan asuransi bersiap-siap menghadapinya. Regulator juga memperhatikan - diskusi sedang berlangsung di AS dan Eropa tentang klasifikasi deepfake di bawah pencurian identitas dan memperbarui pedoman untuk verifikasi bukti dalam asuransi[30].

Mendeteksi video dan audio deepfake sangat menantang tanpa alat bantu teknis. Penyesuai manusia tidak terlatih untuk membedakan masalah sinkronisasi bibir yang halus atau keanehan akustik. Namun, ada beberapa kasus yang menunjukkan tanda bahaya: misalnya, kedipan yang tidak wajar atau gangguan wajah pada video, atau artefak audio latar belakang pada panggilan telepon yang membuat para penyelidik curiga. Namun secara keseluruhan, Penipuan asuransi deepfake masih dalam tahap awaldan penuntutan masih jarang terjadi - pada tahun 2023, definisi hukum masih belum jelas dan membuktikan bahwa sebuah video dibuat dengan menggunakan kecerdasan buatan (artificial intelligence) sulit dilakukan tanpa analisis dari para ahli[31]. Hal ini memberikan rasa kebal hukum bagi para penipu. Perlombaan senjata sedang berlangsung: perusahaan asuransi sekarang beralih ke AI forensik untuk melawan AImenerapkan algoritme pendeteksi deepfake untuk meneliti video yang mencurigakan frame demi frame untuk mencari tanda-tanda manipulasi[24]. Vendor biometrik suara meluncurkan pendeteksi suara palsu yang menganalisis pola spektral dan irama vokal untuk mengetahui keasliannya[32]. Kami akan membahas teknologi pertahanan ini di bagian selanjutnya.

Penipuan Phishing dan Peniruan yang Disempurnakan dengan AI

Tidak semua penipuan yang diaktifkan oleh AI datang melalui departemen klaim; beberapa targetnya adalah pelanggan dan karyawan melalui rekayasa sosial. Email dan teks phishing yang dibuat oleh AI telah menjadi ancaman utama dalam domain asuransi. Dalam skema ini, penipu menggunakan chatbot AI dan alat penerjemah untuk menghasilkan komunikasi penipuan yang sangat meyakinkan. Misalnya, penjahat dapat meniru branding dan gaya penulisan perusahaan asuransi untuk mengirimkan email phishing massal kepada pemegang polis, memberi tahu mereka bahwa "tindakan mendesak diperlukan untuk mencegah pembatalan polis" dan mengarahkan mereka ke situs web palsu. Tidak seperti email penipuan di masa lalu, AI memastikan tata bahasa yang sempurna dan bahkan personalisasimembuat mereka jauh lebih dapat dipercaya. Kami telah melihat AI digunakan untuk mengikis media sosial untuk mencari detail yang dapat dimasukkan ke dalam pesan spear-phishing, seperti merujuk pada pembelian mobil baru-baru ini dalam pemberitahuan asuransi mobil palsu.

Vektor lainnya adalah Peniruan agen atau eksekutif dengan bantuan AI. Ada beberapa kasus di mana penipu mengkloning suara pemilik agen asuransi dan meninggalkan pesan voicemail untuk pelanggan yang meminta pembaruan informasi bank - secara efektif merupakan serangan phishing suara. Demikian pula, penipuan internal dapat berasal dari peniruan AI: departemen keuangan sebuah perusahaan asuransi hampir menjadi korban ketika penipu mengirim pesan audio palsu konon dari CEO mengesahkan transfer dana (varian dari "penipuan CEO" yang sekarang tercakup dalam beberapa polis asuransi kejahatan elektronik[33]). Penipuan peniruan yang digerakkan oleh AI ini meningkat 17% pada tahun 2023 menurut Liberty Specialty Markets[33]dan diperkirakan akan terus meningkat.

Konsumen juga menjadi sasaran penipuan media sintetis terkait dengan asuransi. Koalisi Melawan Penipuan Asuransi mencatat beberapa kasus penipu yang menyamar sebagai penilai asuransi, menghubungi korban kecelakaan dan mengklaim bahwa mereka menangani klaim mereka dan kemudian menuntut pembayaran segera atau data sensitif[23]. Nasabah yang tidak menaruh curiga, karena merasa lega mendengar dari perwakilan yang seharusnya, mungkin akan menuruti permintaan tersebut, terutama jika si penelepon mengetahui detail kecelakaan mereka (yang dapat diperoleh AI dari peretasan atau sumber-sumber publik). Kesadaran masyarakat akan taktik ini masih rendah; oleh karena itu, para ahli pencegahan penipuan mendesak perusahaan asuransi untuk mengedukasi pemegang polis tentang cara memverifikasi identitas penelepon dan email[23][34]. Sama seperti bank yang memperingatkan nasabahnya tentang phishing, perusahaan asuransi pada tahun 2025 mulai menyertakan peringatan penipuan deepfake dalam komunikasi mereka.

Satu benang merah dalam skema yang disempurnakan dengan AI ini adalah penggunaan perangkat "fraud-as-a-service" yang sudah tersedia[35]. Di web gelap, penjahat bisa membeli atau berlangganan alat yang menyediakan suara deepfake yang sudah jadi, templat dokumen palsu, generator email phishing, dan banyak lagi. Demokratisasi alat bantu AI ini berarti bahkan penipu berketerampilan rendah pun dapat melancarkan serangan penipuan yang canggih[35]. Bagi perusahaan asuransi, hal ini berarti semakin banyaknya upaya penipuan yang lebih meyakinkan yang datang dari segala arah - klaim, layanan pelanggan, email, bahkan media sosial. Hal ini menggarisbawahi perlunya strategi pertahanan yang bercabang banyak, yang menggabungkan teknologi, kewaspadaan manusia, dan kolaborasi lintas industri.

Deteksi dan Pertahanan: Respons yang Didukung AI

Memerangi penipuan yang digerakkan oleh AI membutuhkan Pertahanan yang digerakkan oleh AI. Perusahaan asuransi semakin beralih ke teknologi pendeteksian canggih dan proses yang telah diubah untuk melawan serangan gencar tersebut. Intinya, perusahaan asuransi harus menanamkan pos pemeriksaan otentikasi konten di seluruh siklus asuransi - mulai dari penjaminan emisi hingga klaim hingga interaksi dengan nasabah - untuk mengendus pemalsuan AI. Gambar 2 memberikan perincian jenis-jenis penipuan utama yang dimungkinkan oleh AI dan prevalensinya, dan bagian berikut ini merinci cara mendeteksi dan mencegahnya.

Gambar 2: Jenis-jenis penipuan asuransi yang disempurnakan dengan AI pada tahun 2025 (perkiraan pangsa berdasarkan skema). Citra palsu (foto kerusakan yang direkayasa) dan identitas sintetis termasuk dalam kategori terbesar, diikuti oleh dokumen yang dipalsukan oleh AI (misalnya tanda terima, sertifikat) dan penipuan audio/video yang dipalsukan.

1. Alat Pendeteksi Konten AI: Layanan deteksi AI baru dapat menganalisis teks, gambar, audio, dan video untuk menentukan apakah itu dibuat oleh mesin atau dimanipulasi. Sebagai contoh, perusahaan asuransi dapat memanfaatkan solusi seperti Detektor Teks & Gambar AI dari TruthScan yang menggunakan 99%+ AI yang akurat untuk menandai dokumen yang ditulis dengan AI atau foto yang telah diedit[36]. Perusahaan asuransi dapat mengintegrasikan pendeteksi ini ke dalam sistem klaim mereka: ketika klaim dan buktinya diajukan, deskripsi teks dapat secara otomatis dipindai untuk mencari pola bahasa yang dihasilkan oleh AI, dan gambar apa pun yang diunggah dapat dipindai untuk mencari tanda-tanda CGI atau pengeditan. Alat tingkat perusahaan dapat mengidentifikasi teks yang dihasilkan AI dalam dokumen, email, dan komunikasi dengan akurasi 99%[36]dan juga mendeteksi gambar yang dihasilkan atau dimanipulasi oleh AI untuk memastikan keaslian konten visual[36]. Ini berarti narasi kecelakaan palsu yang diproduksi oleh ChatGPT atau foto kerusakan yang dipalsukan di tengah perjalanan akan ditandai untuk ditinjau secara manual sebelum klaim diproses. Perusahaan asuransi pada tahun 2025 akan semakin banyak mengadopsi otentikasi konten AI semacam itu - pada kenyataannya, 83% profesional anti-penipuan berencana untuk mengintegrasikan deteksi AI generatif pada tahun 2025menurut survei ACFE, naik dari hanya 18% yang menggunakannya saat ini[37][38].

2. Verifikasi Identitas & Pemeriksaan Biometrik: Untuk mengatasi identitas sintetis, perusahaan asuransi juga meningkatkan protokol KYC dengan AI. Layanan validasi identitas dapat memverifikasi silang data pemohon dengan berbagai basis data dan menggunakan pengenalan wajah dengan tes keaktifan. Misalnya, dengan meminta video selfie singkat saat proses penerimaan (dan menggunakan pencocokan wajah dengan ID yang diberikan) dapat menggagalkan banyak ID sintetis. Bahkan dengan teknologi yang lebih tinggi, perusahaan seperti TruthScan menawarkan forensik gambar yang dapat melihat foto profil, avatar, dan gambar persona sintetis yang dibuat oleh AI - detektor gambar AI mereka adalah dilatih untuk mengidentifikasi wajah yang dibuat oleh generator seperti StyleGAN atau ThisPersonDoesNotExist[39]. Dengan menggunakan alat tersebut, perusahaan asuransi dapat mendeteksi jika selfie pemohon asuransi jiwa bukanlah manusia sungguhan. Dari sisi suara, otentikasi biometrik suara untuk panggilan layanan pelanggan dapat membantu; detektor AI suara modern dapat mengidentifikasi suara sintetis dan upaya kloning suara secara real time[40]. Sebagai contoh, TruthScan's Deteksi Suara AI sistem menggunakan analisis akustik untuk mengenali suara yang dihasilkan AI dan pemalsuan audio sebelum menipu staf pusat panggilan[40]. Solusi-solusi ini bertindak seperti firewall - jika seseorang menelepon dengan berpura-pura sebagai John Doe dan jejak suara mereka tidak cocok dengan suara asli John Doe (atau cocok dengan ciri-ciri pemalsuan yang sudah diketahui), maka panggilan tersebut bisa ditandai atau bukti identitas lebih lanjut diperlukan. Autentikasi multi-faktor (konfirmasi email/SMS, kode sandi sekali pakai, dll.) menambah rintangan tambahan bagi peniru untuk mengatasinya.

3. Forensik Video & Gambar Deepfake: Dalam hal bukti video, perusahaan asuransi mulai menerapkan analisis forensik khusus. Perangkat lunak canggih dapat menganalisis metadata video, konsistensi bingkai, dan tingkat kesalahan untuk mendeteksi pemalsuan. Beberapa alat memeriksa pantulan, bayangan, dan isyarat fisiologis (seperti denyut nadi di tenggorokan seseorang dalam video) untuk memastikan keaslian video. Forensik metadata juga berharga: memeriksa metadata file dan jejak pembuatan dalam gambar atau PDF dapat mengungkapkan apakah sesuatu kemungkinan dihasilkan oleh alat AI[41]. Perusahaan asuransi harus meminta file foto asli (yang berisi metadata) daripada hanya tangkapan layar atau salinan cetak, misalnya. Tim penipuan Zurich mencatat keberhasilan dalam menangkap gambar mobil palsu dengan memperhatikan anomali dalam metadata gambar dan analisis tingkat kesalahan[41]. Detektor penipuan email juga dapat memindai komunikasi masuk untuk mencari tanda-tanda konten phishing yang ditulis oleh AI atau tanda tangan berbahaya yang diketahui[42]. Banyak perusahaan asuransi sekarang menjalankan simulasi phishing dan contoh penipuan yang dirancang oleh AI dalam pelatihan karyawan untuk meningkatkan kesadaran.

4. Perubahan Proses dan Pelatihan Manusia: Teknologi saja bukanlah peluru perak. Peningkatan proses dilakukan, seperti pemeriksaan langsung secara acak yang lebih sering dilakukan untuk klaim bernilai tinggi, atau membutuhkan dokumentasi fisik dalam kasus tertentu. Beberapa perusahaan asuransi telah menunda pemrosesan klaim secara otomatis sepenuhnya, dan memasukkan kembali tinjauan manusia untuk klaim yang memiliki skor tinggi pada model risiko penipuan AI. Di sisi manusia, pelatihan sangat penting. Penyelidik dan adjuster penipuan dilatih untuk mengenali tanda bahaya AI: misalnya, beberapa klaim yang menggunakan kata-kata yang sama ("gaya" ChatGPT), gambar yang tidak memiliki keacakan yang sebenarnya (misalnya, pola yang berulang pada apa yang seharusnya merupakan kerusakan organik), atau suara yang terdengar hampir yang benar tetapi memiliki irama robot. Perusahaan asuransi juga mengedukasi nasabah dengan mengirimkan peringatan penipuan tentang skema pemalsuan dan menyarankan cara memverifikasi identitas perwakilan asuransi (misalnya, dengan memberikan nomor telepon yang dikenal).

5. Upaya Kolaboratif: Kolaborasi di seluruh industri semakin meningkat. Di Inggris, Biro Penipuan Asuransi dan Asosiasi Perusahaan Asuransi Inggris telah membentuk kelompok kerja tentang penipuan AI, dan pemerintah Piagam Penipuan Asuransi (2024) mendorong berbagi data dan inisiatif bersama[43]. Secara global, perusahaan asuransi bermitra dengan perusahaan keamanan siber dan perusahaan rintisan AI. Khususnya, produk-produk asuransi baru bermunculan: Liberty Mutual meluncurkan produk asuransi kejahatan elektronik untuk UKM yang secara khusus mencakup penipuan deepfake dan penipuan CEO[44][33]menyoroti bahwa risiko ini sangat nyata. Hal ini juga berarti perusahaan asuransi dapat menjadi korban sekaligus pelaku penipuan AI - membayar penipuan deepfake jika tidak terdeteksi, tetapi juga menawarkan pertanggungan untuk orang lain yang mengalami serangan semacam itu.

Integrasi teknologi pendeteksian ke dalam alur kerja dapat divisualisasikan sebagai pertahanan multi-titik dalam siklus klaim. Seperti yang ditunjukkan dalam Gambar 3perusahaan asuransi dapat memasukkan langkah-langkah verifikasi AI di aplikasi kebijakan (untuk menyaring identitas sintetis melalui pemeriksaan dokumen identitas dan swafoto), di pengajuan klaim (untuk menganalisis dokumen, foto, atau audio yang diunggah secara otomatis untuk menghasilkan AI), selama tinjauan/investigasi klaim (untuk melakukan analisis forensik deepfake pada bukti yang mencurigakan dan memverifikasi setiap interaksi suara), dan tepat sebelum pembayaran (otentikasi identitas akhir untuk memastikan penerima pembayaran adalah sah). Dengan menangkap penipuan lebih awal - idealnya pada saat orientasi atau pemberitahuan pertama kali tentang kerugian - perusahaan asuransi menghemat biaya investigasi dan menghindari pembayaran yang salah.

Gambar 3: Integrasi titik deteksi AI dalam siklus asuransi. Pada saat penerimaan polis, validasi identitas berbasis AI memeriksa identitas sintetis atau palsu. Ketika klaim diajukan, detektor otomatis memindai teks klaim, dokumen, dan gambar untuk mencari konten yang dihasilkan oleh AI. Selama peninjauan klaim, alat analisis pemalsuan dan suara khusus memverifikasi bukti audio/video. Sebelum pembayaran, verifikasi identitas biometrik mengonfirmasi identitas penerima manfaat. Pendekatan berlapis ini membantu mencegat penipuan di berbagai tahap.

Perusahaan asuransi tidak harus membangun semua kemampuan ini secara internal - banyak yang beralih ke solusi perusahaan seperti Rangkaian Deteksi AI dari TruthScanyang menawarkan berbagai alat yang dapat diintegrasikan dengan API ke dalam sistem perusahaan asuransi. Sebagai contoh, Layanan Deteksi Gambar & Pemalsuan Gambar AI dari TruthScan dapat digunakan untuk memverifikasi keaslian gambar dan video dengan akurasi lebih dari 99%[45]. Mereka Detektor Teks AI menandai teks yang ditulis oleh AI dalam klaim atau email[36]sedangkan Detektor Suara AI menyediakan deteksi kloning suara dan verifikasi speaker untuk menghentikan penipu telepon[40]. Bahkan ada alat khusus seperti Detektor Tanda Terima Palsu untuk menganalisis faktur/kwitansi secara instan untuk mengetahui adanya tanda-tanda gangguan atau font/tata letak yang dibuat oleh AI[46] - sangat berguna mengingat prevalensi tagihan perbaikan palsu dalam klaim. Dengan menggunakan kombinasi alat ini, perusahaan asuransi dapat secara drastis meningkatkan tingkat deteksi penipuan mereka. Salah satu perusahaan asuransi Fortune 500 melaporkan telah menangkap 97% percobaan deepfake pada tahun 2024 dengan menggunakan pendekatan penyaringan AI berlapis (teks, gambar, suara) dan dengan demikian menghindari kerugian yang diperkirakan sebesar \$20M[47][48].

Kesimpulan

AI mengubah medan perang penipuan asuransi dalam skala global. Para penipu berinovasi dengan AI generatif untuk menciptakan kepalsuan yang lebih meyakinkan dari sebelumnya - dari orang yang sepenuhnya dibuat-buat dan kecelakaan hingga peniruan yang dapat menipu bahkan para profesional yang sudah berpengalaman. Data dari tahun 2024-2025 menunjukkan pertumbuhan yang mengkhawatirkan dalam skema yang dipicu oleh AI ini, tetapi juga menyoroti bahwa perusahaan asuransi yang berinvestasi dalam deteksi dan pencegahan dapat tetap selangkah lebih maju. Dengan menggabungkan teknologi deteksi AI yang mutakhir - seperti forensik gambar, autentikasi suara, dan analisis teks - dengan alur kerja dan edukasi yang diperbarui, industri ini dapat memitigasi risiko tanpa mengorbankan efisiensi yang dihasilkan oleh proses digital.

Pada intinya, ini adalah perlombaan senjata teknologi[49]. Seperti yang dikatakan oleh seorang pakar pencegahan penipuan, "Dalam realitas baru ini, kewaspadaan adalah harga yang harus dibayar"[50]. Perusahaan asuransi harus menumbuhkan budaya kewaspadaan dan memanfaatkan perangkat terbaik yang tersedia untuk menjaga kepercayaan dalam proses klaim. Hal ini berarti memverifikasi kebenaran dokumen, suara, dan gambar dengan ketelitian yang sama seperti yang digunakan penjamin emisi untuk menilai risiko. Hal ini juga berarti berkolaborasi di seluruh industri untuk berbagi informasi intelijen tentang taktik penipuan AI yang sedang berkembang dan bersama-sama mengembangkan standar (misalnya, persyaratan metadata standar untuk media yang dikirimkan, atau daftar hitam industri yang berisi identitas palsu yang diketahui).

Tahun 2025 adalah titik kritis: perusahaan asuransi yang secara proaktif beradaptasi dengan penipuan yang digerakkan oleh AI akan melindungi nasabah dan neraca keuangan mereka, sementara mereka yang lambat merespons dapat menjadi target penipuan yang menarik perhatian. Berita yang menggembirakan adalah bahwa teknologi untuk melawan sudah ada dan berkembang pesat - AI yang sama yang memberdayakan penipu dapat memberdayakan perusahaan asuransi. Dengan menerapkan solusi seperti rangkaian deteksi AI multi-modal TruthScan untuk klaim dan verifikasi identitas, perusahaan asuransi dapat secara dramatis mengurangi tingkat keberhasilan upaya penipuan yang dihasilkan oleh AI[51][52]. Dengan demikian, mereka tidak hanya mencegah kerugian tetapi juga mengirimkan pesan yang jelas kepada calon penipu: tidak peduli seberapa pintar alatnya, penipuan akan terungkap.

Singkatnya, penipuan asuransi yang digerakkan oleh AI merupakan tantangan yang berat, tetapi dapat dihadapi dengan pertahanan yang sama cerdasnya. Dengan kewaspadaan, strategi lintas fungsi, dan mitra teknologi yang tepat, industri asuransi dapat terus menjunjung tinggi janji fundamental yang menjadi inti bisnisnya - untuk membayar hanya klaim yang sah, dan melakukannya dengan cepat dan aman di dunia yang semakin digital.

Referensi:

- Asosiasi Perusahaan Asuransi Inggris - Statistik penipuan 2023[53][54]

- Allianz & Zurich mengenai lonjakan klaim "pemalsuan dangkal" AI - The Guardian, 2024[4][11]

- Facia.ai - "Penipuan Asuransi Deepfake: Bagaimana AI Menulis Ulang Aturan," Oktober 2025[55][56]

- Koalisi Melawan Penipuan Asuransi - Penipuan Sintetis dalam Asuransi (Quantexa), Desember 2024[21][17]

- RGA - "Perbatasan Baru Perlawanan terhadap Penipuan: Identitas Sintetis," Juni 2025[15][16]

- Pindrop - Laporan Penipuan Suara, via FierceHealthcare, Juni 2025[2][3]

- Memutar Angka - "Skema Penipuan Keuangan Teratas 2025," Oktober 2025[1][57]

- TruthScan - Platform Deteksi AI (gambaran umum layanan), 2025[51][52]

- TruthScan - Halaman produk Pendeteksi Gambar AI, 2025[45][39]

- TruthScan - Halaman produk Pendeteksi Suara AI, 2025[40]

- TruthScan - Halaman produk Pendeteksi Tanda Terima Palsu, 2025[46]

- Pasar Khusus Liberty - Siaran Pers Asuransi Deepfake/Penipuan Siber, Maret 2025[33]

- Facia.ai - Blog Perlombaan Pencegahan Penipuan Asuransi, 2025[24][32]

- Bisnis Asuransi Inggris - "Gambar yang dihasilkan AI yang digunakan untuk penipuan bermotor," April 2025[7][58]

- The Guardian - "Foto kerusakan mobil palsu alarm perusahaan asuransi," Mei 2024[9][12]

[1] [35] [57] Skema Penipuan Keuangan 2025: Ancaman AI dan Tanda Bahaya

https://www.turningnumbers.com/blog/top-financial-fraud-schemes-of-2025

[2] [3] [25] [26] Penipuan asuransi meningkat sebesar 19% dari serangan suara pada tahun 2024

https://www.fiercehealthcare.com/payers/insurance-fraud-increased-19-synthetic-voice-attacks-2024

[4] [9] [10] [11] [12] Penipu mengedit foto kendaraan untuk menambahkan kerusakan palsu dalam penipuan asuransi di Inggris | Industri asuransi | The Guardian

[5] [6] [7] [8] [43] [53] [54] [58] Gambar yang dihasilkan oleh AI sekarang digunakan untuk penipuan asuransi kendaraan bermotor - laporan | Insurance Business UK

[13] [14] [15] [16] Perbatasan Baru Perlawanan Penipuan: Identitas sintetis dan perlombaan senjata AI | RGA

[17] [18] [19] [20] [21] [22] JIFA: Penipuan Sintetis: Dengan Penipuan Sintetis yang Sudah Ada di Ekosistem Mereka, Perusahaan Asuransi Perlu Berpikir Lebih Seperti Bank - InsuranceFraud.org

https://insurancefraud.org/publications/jifa-synthetic-fraud/

[23] [24] [28] [29] [30] [31] [32] [34] [41] [49] [50] [55] [56] Penipuan Asuransi Deepfake: Bagaimana AI Menulis Ulang Aturan Klaim Asuransi

https://facia.ai/blog/deepfake-insurance-fraud-how-ai-is-rewriting-the-rules-of-insurance-claims/

[27] [48] Ancaman Senyap: Mengapa Penipuan Asuransi Beralih ke Saluran Telepon

https://www.modulate.ai/blog/the-silent-threat-why-insurance-fraud-is-moving-to-the-phone-line

[33] [44] Asuransi kejahatan elektronik untuk UKM menargetkan penipuan CEO dan deepfakes - LSM | Bisnis Asuransi Inggris

[36] [42] [51] TruthScan - Deteksi AI Perusahaan & Keamanan Konten

[37] Studi: 8 dari 10 Pelaku Penipuan Berharap untuk Menerapkan AI Generatif pada Tahun 2025

[38] Wawasan dari Laporan Pembandingan Teknologi Anti-Penipuan 2024

[39] [45] Detektor Gambar AI | Temukan Foto Palsu & Manipulasi - TruthScan

https://truthscan.com/ai-image-detector

[40] [52] Detektor Suara AI untuk Pemalsuan & Kloning Suara | TruthScan

https://truthscan.com/ai-voice-detector

[46] Detektor Tanda Terima Palsu TruthScan | Verifikasi Keaslian Tanda Terima

https://truthscan.com/fake-receipt-detector

[47] Perusahaan Asuransi Fortune 500 Mendeteksi 97% Deepfakes dan Menghentikan Sintetis ...