Pendahuluan

AI generatif merevolusi perawatan kesehatan - dan tidak selalu menjadi lebih baik. Pada tahun 2025, skema penipuan perawatan kesehatan telah berkembang lebih digital dan canggih, didorong oleh pelanggaran data, otomatisasi, dan AI generatif[1]. Penjahat mengeksploitasi alat bantu AI untuk menciptakan identitas pasien palsu, klaim asuransi sintetis, dokumen medis yang dibuat oleh AI, resep yang dipalsukan, dan bahkan interaksi dokter-pasien yang dipalsukan. Penipuan berteknologi tinggi ini meningkatkan penipuan ke tingkat yang lebih tinggi, mengancam keuangan perusahaan asuransi dan keselamatan pasien di seluruh dunia. Tantangannya sangat besar: penipuan layanan kesehatan telah menelan biaya puluhan miliar per tahun, dan kemunculan AI adalah mengintensifkan skala dan kompleksitas penipuan[2][3]. Whitepaper ini memberikan gambaran terperinci tentang tren penipuan terbaru yang digerakkan oleh AI di bidang perawatan kesehatan, kasus-kasus nyata dari tahun 2025, dan strategi - mulai dari pendeteksi konten AI hingga verifikasi identitas - untuk memerangi ancaman yang terus berkembang ini.

Munculnya Skema Penipuan yang Didukung AI dalam Layanan Kesehatan

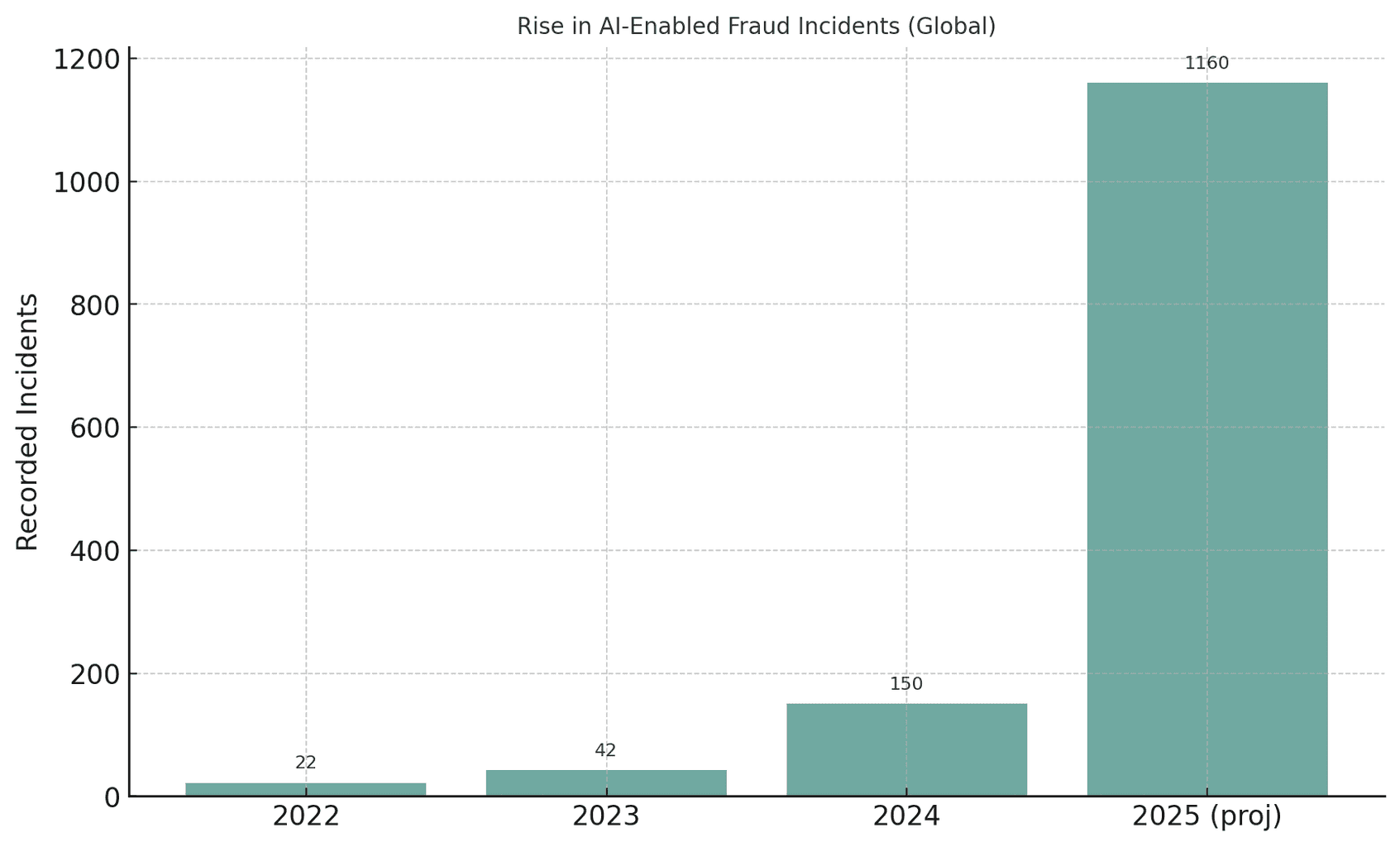

Sektor perawatan kesehatan global sedang mengalami lonjakan yang belum pernah terjadi sebelumnya dalam upaya penipuan yang didukung oleh AI. Ketika AI generatif dapat diakses, penipu dapat mengotomatiskan apa yang dulunya merupakan penipuan manual, menghasilkan identitas, dokumen, dan bahkan suara atau video palsu yang meyakinkan dalam skala besar. Misalnya, pihak berwenang mencatat bahwa upaya penipuan yang melibatkan media deepfake melonjak sebesar 3.000% pada tahun 2023 sendiri[4][5]. Insiden terkait deepfake hampir dua kali lipat dari 22 insiden pada tahun 2022 menjadi 42 insiden pada tahun 2023, kemudian meledak menjadi 150 insiden pada tahun 2024; yang mencengangkan, kuartal pertama tahun 2025 terdapat 179 kasus penipuan deepfake - sudah melebihi total kasus pada tahun 2024[6][7]. Tren ini menunjukkan adanya pertumbuhan yang luar biasa dalam penipuan yang digerakkan oleh AIdengan analis yang memprediksi bahwa AI generatif dapat mendorong kerugian penipuan dari $12,3 miliar pada tahun 2023 hingga $40 miliar pada tahun 2027 (CAGR 32%)[8].

Gambar: Pertumbuhan eksplosif insiden penipuan yang didukung AI dalam beberapa tahun terakhir. Kasus-kasus terdeteksi deepfake atau penipuan berbantuan AI telah meningkat secara dramatis dari tahun 2022 hingga 2025, yang menggambarkan bagaimana alat bantu AI generatif telah meningkatkan upaya penipuan[4][7].

Jangan Pernah Khawatir Tentang Penipuan AI Lagi. TruthScan Dapat Membantu Anda:

- Mendeteksi AI yang dihasilkan gambar, teks, suara, dan video.

- Hindari penipuan besar yang digerakkan oleh AI.

- Lindungi sebagian besar sensitif aset perusahaan.

Layanan kesehatan sangat rentan terhadap gelombang kejahatan yang dipicu oleh AI ini. Ekosistem sektor ini yang luas dan terfragmentasi - mencakup rumah sakit, klinik, asuransi, apotek, dan platform kesehatan jarak jauh - menawarkan ribuan titik serangan[9][10]. Penipuan tradisional (misalnya kartu asuransi palsu atau identitas pasien yang dicuri) memiliki berkembang menjadi eksploitasi sistemik menggunakan AI[10][11]. Dalam sebuah penghapusan di AS pada tahun 2025, Departemen Kehakiman mendakwa 324 terdakwa dalam skema yang berjumlah total $14,6 miliar dalam klaim palsu - kasus penipuan layanan kesehatan terbesar yang pernah ada[12][13]. Banyak penipuan yang melibatkan konsultasi telemedicine dan penipuan pengujian genetik, dan DOJ baru Pusat Fusi Data Penipuan Perawatan Kesehatan menggunakan analitik AI untuk mendeteksi pola secara proaktif[14][15]. Jelas, AI adalah pedang bermata dua: AI membantu para penyelidik untuk menangkap penipuan, tetapi juga memungkinkan penjahat melakukan penipuan dengan skala dan kecanggihan yang belum pernah terjadi sebelumnya[11][2].

Teknik Penipuan Umum Berbasis AI dalam Layanan Kesehatan (2025)

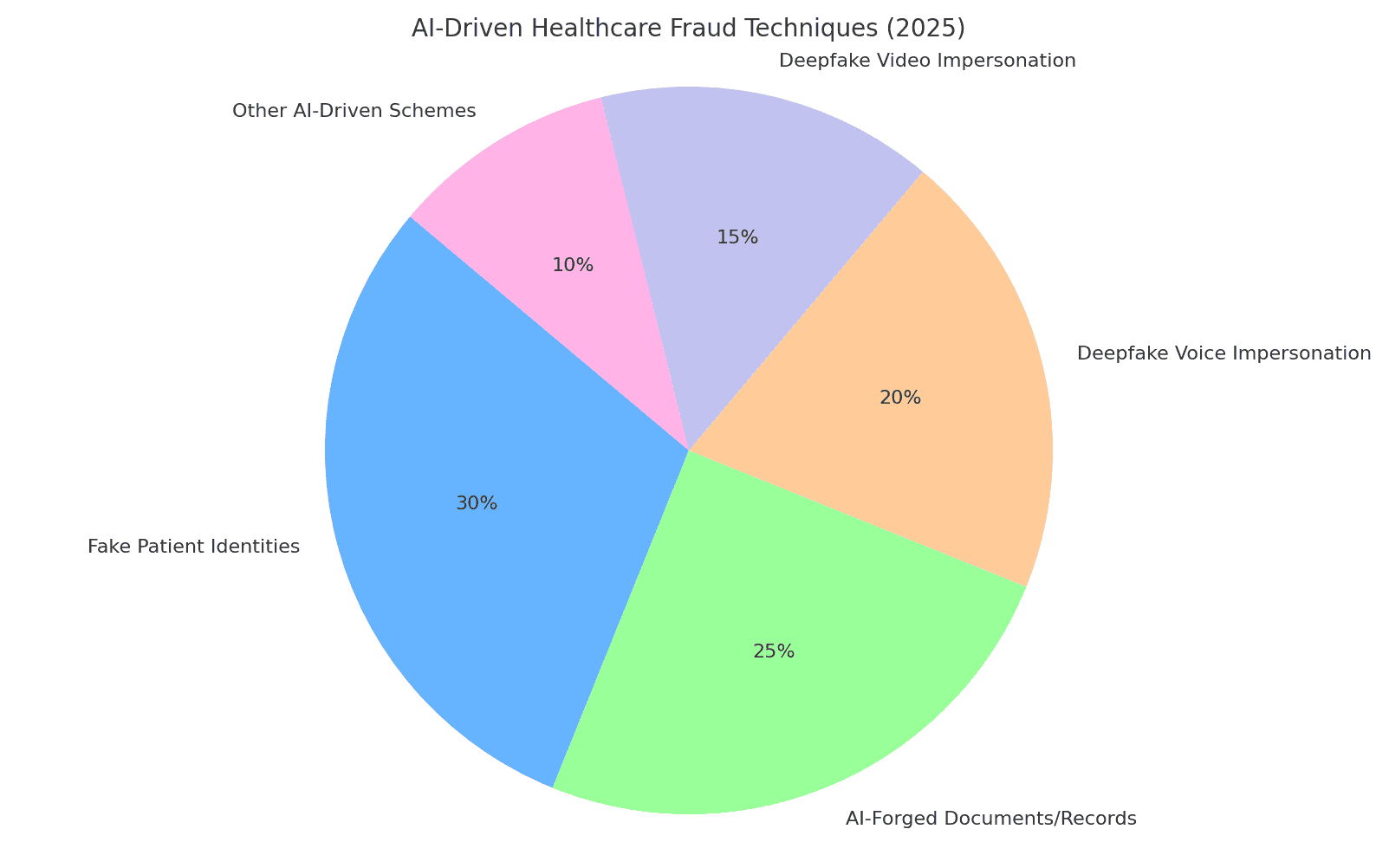

Penipu pada tahun 2025 memiliki perangkat taktik yang diaktifkan oleh AI untuk menipu sistem kesehatan dan perusahaan asuransi. Skema utama termasuk memalsukan identitas dan dokumen, membuat data medis palsu, dan menyamar sebagai orang yang tepercaya melalui pemalsuan. Di bawah ini kami menguraikan teknik penipuan berbasis AI yang paling umum dan bagaimana teknik tersebut digunakan untuk melawan organisasi perawatan kesehatan:

Gambar: Perincian teknik penipuan perawatan kesehatan utama yang digerakkan oleh AI pada tahun 2025. Identitas pasien palsu dan Dokumen yang dipalsukan oleh AI (misalnya rekam medis, klaim) terdiri dari sebagian besar skema, sementara deepfake suara dan peniruan video adalah ancaman yang berkembang pesat. "Skema yang digerakkan oleh AI lainnya" termasuk email phishing yang dibuat oleh AI, bot yang menyerang portal pasien, dan eksploitasi serupa (perkiraan persentase berdasarkan laporan industri[8][16]).

Identitas Pasien Sintetis

Identitas pasien palsu - yang sering kali dibuat dengan bantuan AI - adalah taktik penipuan yang mendasar. Alih-alih mencuri identitas satu orang, para penjahat menggabungkan data nyata dari banyak orang dengan detail yang dibuat-buat untuk membuat identitas sintetis yang lolos sebagai pasien baru[17][18]. AI generatif mempercepat hal ini dengan menghasilkan catatan pribadi yang realistis. Sebagai contoh, AI dapat menghasilkan data yang masuk akal Identitas, profil, bahkan riwayat keluarga ("orang tua sintetis") untuk pasien palsu[19][20]. Pasien hantu ini kemudian digunakan untuk membuka rekening, mendapatkan polis asuransi, atau menagih layanan yang tidak pernah terjadi. Selama pandemi COVID-19, para penipu menggunakan ID sintetis untuk memanfaatkan manfaat kesehatan darurat; sekarang mereka menggunakannya untuk mengajukan klaim asuransi palsu atau mendapatkan resepmengetahui identitas yang dibuat dengan baik dapat menghindari deteksi[21][22]. Menurut Federal Reserve AS, kerugian akibat penipuan identitas sintetis mencapai puncaknya $35 miliar pada tahun 2023 dan terus meningkat[23]. Dampak perawatan kesehatan sangat parah: penipu dapat menggunakan nomor Jaminan Sosial anak yang dicuri untuk membuat pasien palsu dengan kredit yang sempurna, atau mencampurkan data pasien yang dicuri untuk mem-bypass verifikasi perusahaan asuransi[17][24]. Setiap pasien sintetis yang dimasukkan ke dalam sistem merusak integritas data dan dapat menyebabkan pembayaran yang salah atau bahkan kesalahan klinis jika identitas palsu tersebut tercampur dengan rekam medis asli.

Dokumen Medis yang Dihasilkan AI & Klaim Asuransi

AI generatif sekarang digunakan untuk memalsukan dokumen medis, catatan, dan seluruh klaim asuransi. Model bahasa dapat menghasilkan catatan dokter yang terlihat otentik, ringkasan ringkasan, hasil laboratorium, atau laporan penagihan yang dipenuhi dengan jargon medis - semuanya disesuaikan untuk mendukung klaim penipuan. Faktanya, pengamat industri melaporkan adanya Peningkatan 89% dalam dokumen medis yang dihasilkan AI yang diajukan, dibandingkan dengan tahun-tahun sebelumnya[25][26]. Para penipu memanfaatkan catatan palsu ini untuk membenarkan prosedur atau pengobatan mahal yang tidak pernah diberikan, atau untuk menggelembungkan kode penggantian biaya. Misalnya, AI dapat menghasilkan catatan palsu laporan pencitraan diagnostik atau hasil laboratorium untuk mendukung klaim biaya tinggi untuk obat onkologi. Perusahaan asuransi dan sistem kesehatan menghadapi banjir klaim semacam itu. dokumen sintetissehingga lebih sulit untuk membedakan klaim yang sah dan yang palsu. Di Inggris, perusahaan asuransi mencatat penggunaan deepfakes dan dokumen yang dipalsukan dalam penipuan klaim yang meningkat pesatsering kali dalam klaim yang tampaknya rutin dan bernilai rendah untuk menghindari pengawasan[27]. Bahkan pencitraan klinis pun tidak kebal - ada bukti bahwa penipu menggunakan AI generatif untuk meniru gambar medis seperti sinar-X atau pemindaian[3]. Konsekuensinya lebih dari sekadar kerugian finansial: jika rekam medis yang dipalsukan masuk ke dalam berkas pasien, hal ini dapat menyebabkan kesalahan diagnosis atau perawatan yang tidak tepat. Dengan demikian, Dokumen kesehatan yang ditulis dengan AI menimbulkan risiko integritas dan keamanan yang serius.

Resep Palsu dan Penipuan Apotek

Penipuan resep telah memasuki era digital dengan adanya AI. Resep yang dipalsukan - yang secara tradisional dilakukan dengan kertas resep curian atau pengeditan yang belum sempurna - sekarang dapat dibuat secara otomatis dengan detail yang realistis dan tanda tangan dokter. Generator atau templat gambar AI membuatnya mudah untuk dibuat hasil cetak resep elektronik yang tampak asli atau formulir pemesanan apotek. Lebih berbahaya lagi, penjahat menggunakan kloning suara untuk menyamar sebagai dokter dalam panggilan telepon dengan apoteker. Dalam satu tren yang dilaporkan, penipu meretas catatan medis untuk mencuri nomor registrasi DEA dokter dan kemudian menggunakan kredensial tersebut untuk mengirim resep elektronik untuk zat-zat yang dikendalikan[28]. Ada beberapa kasus Pemalsuan suara AI yang digunakan untuk mengotorisasi isi ulang - seorang apoteker menerima panggilan yang terdengar persis seperti dokter yang dikenalnya yang mengonfirmasi resep, tetapi sebenarnya itu adalah suara yang dihasilkan oleh AI. Akibatnya, obat-obatan yang dikontrol (seperti opioid atau stimulan) dapat diperoleh dan dialihkan secara ilegal. Pemalsuan resep tidak hanya menyebabkan kerugian finansial bagi perusahaan asuransi dan apotek, tetapi juga membahayakan pasien, yang mungkin menerima obat yang tidak sesuai dengan catatan mereka. Misalnya, jika penipu menyamar sebagai pasien untuk mendapatkan resep opioid, maka berkas medis pasien yang sebenarnya mungkin diperbarui dengan obat-obatan yang tidak pernah mereka konsumsi, yang mengarah pada interaksi berbahaya atau menandai mereka sebagai pencari narkoba[29]. Perpaduan antara kejahatan siber dan eksploitasi AI ini telah memicu peringatan dari para regulator. Organisasi layanan kesehatan sekarang harus memverifikasi bahwa setiap resep - terutama obat berisiko tinggi - adalah sah dan benar-benar berasal dari penyedia resmibukan deepfake atau pembobolan data.

Peniruan Dokter-Pasien Deepfake

Mungkin perkembangan yang paling menarik perhatian adalah penggunaan pemalsuan mendalam untuk menyamar sebagai petugas kesehatan atau pasien. Dalam pengaturan telemedicine dan layanan pelanggan, para penipu menggunakan video dan audio yang dihasilkan oleh AI untuk menipu orang-orang di ujung sana. Sebagai contoh, para penjahat telah menciptakan memalsukan video pasien untuk konsultasi telehealth, mengelabui dokter untuk memberikan "perawatan" atau rujukan yang kemudian ditagihkan ke asuransi[30][31]. Sebaliknya, penipu mungkin memalsukan kemiripan dengan dokter - menggunakan wajah dan suara dokter yang memiliki reputasi baik - dalam panggilan video ke meyakinkan pasien untuk membayar layanan penipuan atau membocorkan informasi pribadi. Pakar TI perawatan kesehatan memperingatkan bahwa telehealth telah menjadi target yang matangseseorang dapat menjadwalkan janji temu virtual menggunakan identitas pasien palsu, kemudian meminta avatar AI berdiri di video untuk mendapatkan resep atau saran medis dengan kepura-puraan palsu[31][32]. Selain telemedicine, deepfakes memenuhi media sosial dalam bentuk Video "dokter" yang mempromosikan obat ajaib. Pada tahun 2024, para ahli mengamati bahwa video yang dipalsukan dari dokter-dokter terkenal "benar-benar lepas landas," yang menargetkan audiens yang lebih tua dengan tips kesehatan palsu dan produk penipuan[33][34]. Dokter TV tepercaya di Inggris dan Prancis dikloning kemiripannya untuk mendukung obat diabetes palsu dan suplemen tekanan darah[35][36]. Hingga separuh penonton tidak dapat membedakan video medis palsu ini palsu[37]. Erosi kebenaran ini memiliki dampak yang nyata: pasien dapat mengikuti saran berbahaya dari video dokter palsu, atau penipu dapat menagih asuransi untuk konsultasi yang tidak pernah terjadi kecuali sebagai rekaman palsu. Secara keseluruhan, Peniruan yang digerakkan oleh AI merusak kepercayaan mendasar dalam interaksi perawatan kesehatan - jika Anda tidak dapat mempercayai bahwa orang yang ada di layar atau telepon adalah orang yang mereka klaim, maka seluruh sistem berisiko.

Dampak dan Skala: Penipuan Tahun 2025 Berdasarkan Angka

Penipuan yang digerakkan oleh AI tidak lagi menjadi masalah marjinal - sekarang ini menjadi ancaman keuangan dan keamanan yang besar di seluruh sistem kesehatan global. Pertimbangkan statistik dan kasus terbaru berikut ini yang menggambarkan skala masalah:

- Kerugian Tahunan: Penipuan layanan kesehatan diperkirakan merugikan AS sebesar $68 miliar atau lebih setiap tahun[25], kira-kira 3-10% dari semua pengeluaran kesehatan[38]. Secara global, penipuan dapat menghabiskan sekitar 6% dari pengeluaran perawatan kesehatan[39] - angka yang mengejutkan mengingat pengeluaran kesehatan di seluruh dunia mencapai triliunan dolar. Kerugian ini pada akhirnya berujung pada premi yang lebih tinggi, biaya rumah sakit yang meningkat, dan berkurangnya sumber daya untuk perawatan pasien.

- Lonjakan Penipuan pada tahun 2023-2025: Munculnya AI generatif telah menyebabkan ledakan upaya penipuan. Insiden penipuan terkait deepfake meningkat sepuluh kali lipat dari tahun 2022 hingga 2023[4]. Pada tahun 2024, insiden deepfake yang dilaporkan melonjak menjadi 150 (kenaikan 257%)[40]dan tahun 2025 berada di jalur yang tepat untuk melampaui angka tersebut (580 insiden hanya dalam paruh pertama tahun 2025, hampir 4 kali lipat dari total insiden tahun 2024)[7]. Pakar penipuan mencatat bahwa 46% telah mengalami penipuan ID sintetis, 37% pemalsuan suara, dan 29% pemalsuan video dalam penyelidikan mereka[8] - menyoroti betapa umum teknik AI ini telah menjadi.

- Penghapusan Rekor Pencatatan: Lembaga penegak hukum merespons dengan tindakan keras yang lebih besar. Pada Juni 2025, DOJ A.S. mengumumkan penghapusan penipuan perawatan kesehatan terbesar dalam sejarah, menuduh 324 orang dan mengungkap $14,6 miliar dalam klaim penipuan[1][13]. Skema yang digunakan termasuk kontra konsultasi kesehatan jarak jauh, penipuan pengujian genetik, dan penipuan peralatan medis yang tahan lama dalam skala besar[13]. Sebagai bagian dari upaya ini, Medicare menangguhkan $4 miliar dalam pembayaran yang tertunda dianggap mencurigakan[41]mencegah kerugian tersebut. Salah satu kasus utama ("Operasi Gold Rush") mengungkapkan sebuah jaringan internasional yang menggunakan identitas curian untuk mengajukan $10,6 miliar dalam bentuk klaim palsu untuk persediaan medis[42] - bukti seberapa jauh para penjahat akan melangkah ketika dipersenjatai dengan data dan otomatisasi yang dibobol.

- Dampak Penanggung: Perusahaan asuransi di seluruh dunia melihat adanya lonjakan penipuan terkait AI. Di Inggris, perusahaan asuransi melaporkan bahwa deepfakes semakin sering digunakan dalam klaim (sering kali klaim "sentuhan rendah" untuk menghindari deteksi)[27]. Perusahaan reasuransi terkemuka memperingatkan bahwa rekam medis yang dipalsukan dan kondisi kesehatan yang dipalsukan dapat merusak underwriting dan dapat meningkatkan kerugian asuransi jiwa dan kesehatan[43]. Analisis Deloitte tahun 2024 memproyeksikan bahwa pada tahun 2027, Penipuan yang didukung AI generatif dapat menyebabkan kerugian tahunan sebesar 1 triliun dolar AS di AS. (naik dari $12,3 miliar pada tahun 2023)[8]. Lintasan ini menyiratkan dampak yang signifikan terhadap keuntungan perusahaan asuransi jika tindakan penanggulangan yang kuat tidak dilakukan.

- Korban Pasien: Pasien dan masyarakat juga kehilangan uang akibat penipuan ini. Orang dewasa yang lebih tua, khususnya, telah menjadi sasaran penipuan suara AI (panggilan telepon "cucu dalam bahaya") dan penipuan kesehatan palsu. Pada tahun 2023, para lansia AS melaporkan $3,4 miliar dalam kerugian akibat penipuan, meningkat 11% dari tahun sebelumnya[44][45] - beberapa di antaranya didorong oleh skema yang disempurnakan dengan AI. Dan di luar biaya moneter, ada biaya manusiasaran medis palsu dan perawatan palsu yang diiklankan melalui AI dapat menyebabkan kerusakan fisik atau hilangnya kepercayaan pada panduan perawatan kesehatan yang sah.

Secara keseluruhan, tahun 2025 telah menjelaskan bahwa AI meningkatkan penipuan perawatan kesehatan tradisional. Apa yang dulunya merupakan skema oportunistik yang lebih kecil telah berkembang menjadi operasi industri yang menjangkau berbagai benua. Kombinasi data besar (sering kali dari pelanggaran) dan generasi AI berarti penipuan dapat dilakukan dengan kecepatan dan masuk akal yang menakutkan. Kerugian global mencapai puluhan miliar dan terus meningkatdan setiap pemangku kepentingan - mulai dari rumah sakit dan perusahaan asuransi hingga pasien - menghadapi risiko. Bagian selanjutnya membahas bagaimana industri ini dapat melawan dengan menggunakan teknologi dan strategi yang sama canggihnya.

Melindungi dari Penipuan yang Didorong oleh AI: Strategi dan Solusi

Menghadapi penipuan layanan kesehatan yang diaktifkan oleh AI membutuhkan persenjataan pertahanan yang sama canggihnya. Eksekutif perawatan kesehatan, tim keamanan siber, petugas kepatuhan, dan perusahaan asuransi harus berkoordinasi untuk menanamkan langkah-langkah anti-penipuan di setiap titik rawan - mulai dari proses penerimaan pasien hingga pembayaran klaim. Di bawah ini adalah strategi utama dan solusi teknis untuk melawan penipuan yang digerakkan oleh AI:

- Alat Pendeteksi Konten AI: Sama seperti penjahat yang menggunakan AI untuk memalsukan konten, organisasi dapat menggunakan AI untuk mendeteksinya. Tingkat Lanjut Detektor konten yang ditulis dengan AI (seperti rangkaian perangkat TruthScan) menganalisis teks, gambar, audio, dan video untuk mengidentifikasi tanda-tanda pembuatan AI. Sebagai contoh, platform TruthScan menerapkan pembelajaran mesin untuk menemukan pola statistik dan kebiasaan linguistik yang mengindikasikan teks yang dibuat oleh AI dengan lebih dari Akurasi 99%[46][47]. Alat-alat ini dapat diintegrasikan ke dalam sistem manajemen klaim atau catatan kesehatan elektronik untuk secara otomatis menandai dokumen yang mencurigakan - misalnya, laporan medis yang kemungkinan ditulis oleh ChatGPT - untuk ditinjau secara manual. Demikian juga, forensik gambar AI dapat mendeteksi pemindaian medis yang dimanipulasi atau ID palsu, dan algoritme pendeteksi pemalsuan dapat menganalisis video untuk mencari tanda-tanda sintesis (artefak dalam piksel, waktu yang tidak wajar dari gerakan wajah, dll.)[48][49]. Dengan menggunakan detektor AI multi-modal, organisasi kesehatan dapat menyaring sebagian besar konten yang dipalsukan oleh AI dalam waktu nyata sebelum menyebabkan kerusakan.

- Verifikasi Rekam Medis & Dokumen: Penyedia layanan kesehatan beralih ke solusi khusus untuk memverifikasi keaslian catatan dan dokumen klaim. Ini termasuk melakukan hashing dan menandatangani secara digital catatan yang sah, serta menggunakan basis data templat dokumen yang sudah dikenal baik untuk dibandingkan dengan dokumen yang dikirimkan. Layanan verifikasi berbasis kecerdasan buatan (misalnya, layanan TruthScan Otentikasi Dokumen Medis solusi) dapat langsung menganalisis konten dan metadata dokumen untuk menentukan apakah dokumen tersebut dibuat oleh mesin atau diubah[50][51]. Mereka melihat ketidakkonsistenan yang mungkin terlewatkan oleh manusia - seperti anomali pemformatan yang tidak kentara atau metadata yang mengindikasikan bahwa sebuah gambar diproduksi oleh AI. Pemantauan catatan pasien dan klaim asuransi secara real-time untuk anomali juga penting[52]. Dengan terus memindai entri baru (hasil lab, catatan dokter, lampiran klaim), sistem ini dapat menangkap catatan palsu sebelum mereka mengarah pada pembayaran yang curang atau kesalahan klinis. Beberapa perusahaan asuransi telah menerapkan aturan di mana setiap dokumentasi klaim yang diidentifikasi sebagai hasil dari AI akan secara otomatis ditarik untuk investigasi penipuan. Tujuannya adalah untuk memastikan bahwa setiap rekam medis atau klaim yang masuk ke dalam alur kerja dapat dipercaya dan tidak diubah.

- Pemeriksaan dan Validasi Identitas: Memperkuat verifikasi identitas sangat penting dalam era ID sintetis. Entitas layanan kesehatan harus memberlakukan pemeriksaan identitas yang ketat untuk pasien baru, penyedia layanan, dan vendor. Hal ini dapat melibatkan otentikasi multi-faktor, pemeriksaan biometrik (seperti pengenalan wajah atau sidik jari pada saat pendaftaran), dan menggunakan layanan verifikasi identitas yang memanfaatkan AI untuk mendeteksi ID palsu atau data pribadi yang tidak cocok. Sebagai contoh, pengenalan wajah dapat dikombinasikan dengan tes keaktifan untuk mencegah wajah yang dihasilkan oleh AI agar tidak disalahartikan sebagai pasien sungguhan melalui foto. Di bagian belakang, algoritme dapat memverifikasi silang detail pasien (alamat, telepon, email, keberadaan media sosial) untuk menemukan identitas "tipis" yang tidak memiliki riwayat normal - yang diketahui sebagai ciri khas ID sintetis[53]. Lembaga keuangan telah menggunakan pemeriksaan konsistensi latar belakang berbasis AI dengan sangat baik[54]dan layanan kesehatan dapat melakukan hal yang sama: misalnya, menandai pemohon Medicare baru jika mereka tidak memiliki jejak digital sebelum tahun ini. Memvalidasi identitas penyedia sama pentingnya - memastikan bahwa dokter dalam video telehealth memiliki lisensi dan benar-benar sesuai dengan yang mereka klaim, mungkin dengan mengeluarkan sertifikat digital atau umpan video bertanda air yang sulit ditiru oleh pemalsu. Di apotek, staf harus memeriksa ulang permintaan resep yang tidak biasa melalui panggilan balik langsung ke penyedia layanan dan menggunakan frasa kode atau pertanyaan verifikasi untuk mengalahkan calon peniru suara AI.

- Deteksi Penipuan Terintegrasi dalam Alur Kerja: Untuk benar-benar melindungi sistem, deteksi penipuan tidak bisa menjadi langkah yang berdiri sendiri - perlu dijalin ke dalam setiap alur kerja dalam organisasi kesehatan.

Dalam praktiknya, ini berarti rumah sakit dan perusahaan asuransi menggunakan integrasi API untuk memanggil layanan pendeteksi kecurangan pada saat-saat kritis. Misalnya, ketika penyedia layanan mengajukan klaim dengan dokumen yang dilampirkan, layanan AI dapat secara otomatis mengevaluasi keaslian dokumen tersebut dalam hitungan detik. Jika janji temu telehealth dimulai, platform dapat menjalankan analisis suara pasif di latar belakang untuk memastikan penelepon tidak menggunakan suara yang disintesis. Pemantauan berkelanjutan juga merupakan kuncinya: platform kecurangan modern menawarkan dasbor yang melacak sinyal kecurangan di seluruh organisasi (validasi yang gagal, seringnya penandaan klaim klinik tertentu, dll.) untuk mengidentifikasi pola, seperti lingkaran kecurangan terorganisir yang beroperasi di berbagai klaim. Dengan memperlakukan kecurangan layanan kesehatan lebih seperti ancaman siber - dengan Pemantauan 24/7, deteksi anomali, dan respons insiden yang cepat - organisasi dapat menangkap masalah sebelum masalah tersebut berkembang[55].

- AI untuk Analisis Penipuan dan Pengenalan Pola: Volume data perawatan kesehatan sangat besar sehingga AI sangat diperlukan dalam menemukan pola kecurangan yang terlewatkan oleh manusia. Model pembelajaran mesin dapat dilatih pada kasus-kasus penipuan historis untuk mendeteksi kasus-kasus baru (misalnya, mengelompokkan klaim yang memiliki kode ICD yang tidak biasa, atau mengidentifikasi ketika penagihan seorang dokter sangat menyimpang dari rekan-rekannya). Perusahaan asuransi sudah menggunakan analisis prediktif untuk menilai klaim untuk risiko penipuan secara real time. Teknik-teknik yang muncul seperti jaringan syaraf tiruan dapat memetakan hubungan antara pasien, penyedia layanan kesehatan, diagnosis, dan klaim untuk menemukan hubungan yang tidak mungkin (seperti nomor seri perangkat yang sama yang digunakan dalam klaim dari negara bagian yang berbeda). Rangkaian penipuan asuransi TruthScan, misalnya, meliputi pengenalan pola klaim dan pemodelan prediktif untuk menangkap lingkaran penipuan yang terorganisir dan pola yang tidak lazim sebelum kerugian terakumulasi[56][57]. Pusat Fusi DOJ tahun 2025 mencontohkan pendekatan ini - menggabungkan data di seluruh Medicare dan asuransi swasta untuk secara proaktif menemukan klaster aktivitas yang mencurigakan[58]. Organisasi perawatan kesehatan juga harus berbagi data dan model AI dalam konsorsium untuk memperluas sinyal penipuan yang dapat dideteksi oleh masing-masing. Semakin banyak data (dalam batas-batas privasi) yang memberi makan model-model ini, semakin baik model-model ini dalam membedakan perilaku normal vs. perilaku curang.

- Pelatihan Staf dan Pengendalian Proses: Teknologi sangat penting, tetapi kesadaran manusia tetap merupakan pertahanan yang kuat. Staf dan administrator layanan kesehatan harus dilatih tentang taktik penipuan yang didukung AI - misalnya, mengetahui bahwa email yang ditulis dengan sempurna dari seorang CEO mungkin merupakan phishing yang ditulis oleh AI, atau bahwa mereka harus memverifikasi identitas penelepon video jika ada sesuatu yang tampak "aneh" (gerakan mata yang aneh atau jeda audio dapat mengisyaratkan adanya deepfake). Latihan dan tips rutin (mirip dengan pelatihan kesadaran phishing) dapat diterapkan untuk ancaman baru seperti penipuan telepon deepfake. Kontrol proses yang sederhana dapat menambah lapisan keamanan: mewajibkan panggilan balik atau verifikasi sekunder untuk permintaan pembayaran dalam jumlah besar atau tidak biasa, menggunakan saluran komunikasi yang diketahui aman untuk informasi sensitif, dan mempertahankan rencana respons insiden khusus untuk dugaan penipuan yang dimediasi oleh AI. Yang terpenting, organisasi harus mengembangkan budaya di mana karyawan merasa diberdayakan untuk mempertanyakan anomalibahkan jika itu adalah "dokter" dalam video yang meminta permintaan yang aneh. Banyak penipuan deepfake yang berhasil dengan mengeksploitasi kepercayaan dan otoritas; tenaga kerja yang waspada dan mengetahui tentang trik ini dapat menghentikan insiden lebih awal. Seperti yang dikatakan oleh seorang ahli, menghadapi deepfake bisa menjadi rutinitas seperti menemukan email phishing - bagian standar dari kebersihan keamanan siber[32][59].

- Memanfaatkan Layanan Khusus: Mengingat evolusi ancaman AI yang cepat, banyak organisasi perawatan kesehatan bermitra dengan penyedia pencegahan penipuan khusus. Layanan seperti TruthScan untuk Perawatan Kesehatan menawarkan solusi menyeluruh yang disesuaikan dengan kasus penggunaan medis, termasuk: pemantauan integritas rekam medis elektronik (EMR) secara real-time, verifikasi dokumen pasien terhadap manipulasi AI, deteksi deepfake untuk telehealth, dan pelaporan kepatuhan (mis. jejak audit yang membuktikan uji tuntas dalam deteksi penipuan untuk regulator)[60][51]. Platform semacam itu sering kali menyediakan Integrasi API agar sesuai dengan sistem yang ada dan dibuat untuk memenuhi peraturan perawatan kesehatan (HIPAA, GDPR)[61][62]. Dengan menggunakan alat tingkat perusahaan, bahkan klinik yang lebih kecil atau perusahaan asuransi regional dapat memperoleh akses ke kemampuan deteksi AI tingkat lanjut tanpa mengembangkannya sendiri. Selain itu, perusahaan asuransi dan penyedia layanan harus memperhatikan pembaruan dalam peraturan dan standar industri - misalnya, undang-undang baru yang melarang penipuan deepfake (beberapa yurisdiksi sekarang secara eksplisit melarang pemalsuan medis, dan A.S. memperluas undang-undang pencurian identitas untuk mencakup peniruan AI).[63]). Menyelaraskan diri dengan standar tersebut dan menggunakan alat bantu yang canggih tidak hanya akan mengurangi kerugian akibat kecurangan, tetapi juga menunjukkan postur keamanan yang kuat kepada para mitra, auditor, dan pasien.

Kesimpulan dan Prospek

Tahun 2025 telah menunjukkan bahwa jin sudah keluar dari botol - AI generatif dan otomatisasi sekarang saling terkait dengan penipuan layanan kesehatan. Ke depannya, para penipu kemungkinan akan terus berinovasi: kita mungkin akan melihat model AI yang belajar meniru gaya penulisan dokter tertentu atau deepfakes yang bereaksi secara real-time untuk menjawab pertanyaan yang menantang. Pertarungan ini akan menjadi perlombaan senjata yang berkelanjutan. Namun, industri perawatan kesehatan merespons dengan semangat yang sama, berinvestasi dalam pertahanan bertenaga AI dan alur kerja keamanan yang lebih ketat. Dengan menggabungkan teknologi deteksi mutakhir, proses verifikasi yang ketat, berbagi data lintas industri, dan kewaspadaan karyawanorganisasi perawatan kesehatan dapat secara substansial mengurangi ancaman penipuan yang difasilitasi oleh AI.

Yang terpenting, ini bukan hanya masalah TI - ini adalah masalah tata kelola dan kepercayaan. Dewan dan eksekutif di bidang perawatan kesehatan harus menyadari penipuan AI sebagai risiko strategis terhadap keuangan dan kepercayaan pasien, yang memerlukan perhatian dan sumber daya secara teratur. Tim kepatuhan harus memperbarui penilaian risiko penipuan untuk memasukkan aspek AI, dan perusahaan asuransi mungkin memikirkan kembali asumsi penjaminan karena mengetahui bahwa persentase tertentu dari klaim dapat berupa penipuan yang dibantu oleh AI. Di sisi lain, memanfaatkan AI secara etis dalam perawatan kesehatan (untuk dukungan keputusan klinis, efisiensi penagihan, dll.) akan terus memberikan manfaat yang besar - selama ada perlindungan yang kuat untuk mencegah penyalahgunaan.

Singkatnya, AI generatif telah mengubah permainan penipuan dalam perawatan kesehatan, tetapi dengan kesadaran dan tindakan pencegahan yang canggih, hal itu tidak harus membebani sistem. Organisasi yang berhasil adalah mereka yang selalu mendapat informasi tentang ancaman yang muncul, beradaptasi dengan cepat dengan pertahanan yang digerakkan oleh AI, dan menumbuhkan budaya "verifikasi dan kepercayaan" daripada "percaya begitu saja." Dengan demikian, layanan kesehatan dapat dengan aman memanfaatkan sisi positif AI sekaligus menetralkan penyalahgunaannya, melindungi keuntungan dan kesejahteraan pasien di era digital.

Sumber: Laporan dan kasus industri terbaru seperti yang dikutip di atas, termasuk Pymnts (Juli 2025)[2][3], Swiss Re Institute (Juni 2025)[27]Federal Reserve Bank of Boston (Apr 2025)[19], BMJ (2024)[37]dan ringkasan solusi TruthScan (2025)[51][64]antara lain. Semua data dan kutipan mencerminkan data terbaru yang tersedia pada tahun 2024-2025, yang menggambarkan kondisi terkini dari penipuan berbasis AI di bidang perawatan kesehatan dan tanggapan untuk memeranginya.

[1] [2] [3] [9] [10] [11] [12] [13] [14] [15] [41] [42] [55] [58] DOJ Memuji Perangkat AI dalam Penindakan Penipuan Layanan Kesehatan Bersejarah

[4] [5] [6] [7] [16] [40] [44] [45] Statistik & Tren Deepfake 2025 | Data & Wawasan Utama - Keepnet

https://keepnetlabs.com/blog/deepfake-statistics-and-trends

[8] Deepfakes dan krisis pengetahuan | UNESCO

https://www.unesco.org/en/articles/deepfakes-and-crisis-knowing

[17] [18] [19] [20] [21] [22] [23] [24] [53] [54] Gen AI meningkatkan ancaman penipuan identitas sintetis - Federal Reserve Bank of Boston

[25] [26] [56] [57] [62] [64] Deteksi Penipuan AI Asuransi Kesehatan & Jiwa | TruthScan

https://truthscan.com/solutions/health-life-commercial-insurance-fraud-detection-solution

[27] [43] Bagaimana deepfakes, disinformasi, dan AI memperkuat penipuan asuransi | Swiss Re

[28] DEA Memperingatkan Penipuan Resep Elektronik - Berita Praktik Farmasi

[29] [39] Keamanan dan Penipuan Siber Layanan Kesehatan: Penyelaman Mendalam ke dalam Risiko dan Pertahanan Terbesar Saat Ini | CrossClassify

https://www.crossclassify.com/resources/articles/healthcare-cybersecurity-and-fraud/

[30] [31] [32] [59] Ancaman yang Berkembang dari Penipuan Telemedicine Deepfake, Mike Ruggio

https://insights.taylorduma.com/post/102jkzn/the-evolving-threat-of-deepfake-telemedicine-scams

[33] [34] Para Ahli Memperingatkan Penipu Menggunakan 'Deepfakes' Dokter Terkenal di Media Sosial

[35] [36] [37] Dokter TV tepercaya "dipalsukan" untuk mempromosikan penipuan kesehatan di media sosial - BMJ Group

https://bmjgroup.com/trusted-tv-doctors-deepfaked-to-promote-health-scams-on-social-media/

[38] [PDF] kondisi penelitian saat ini Ajit Appari dan M. Eric Johnson

http://mba.tuck.dartmouth.edu/digital/Research/ResearchProjects/AJIJIEM.pdf

[46] [47] [48] [49] TruthScan - Deteksi AI Perusahaan & Keamanan Konten

[50] [51] [52] [60] [61] Deteksi Kecurangan Rekam Medis AI | Solusi CRO Perawatan Kesehatan | TruthScan

https://truthscan.com/solutions/healthcare-cro-fraud-detection

[63] Seberapa Berbahayakah Deepfakes dan Penipuan Bertenaga AI Lainnya?