Néhány évvel ezelőtt még professzionális stúdióra és nagy technikai tudásra volt szükség ahhoz, hogy valaki hangját utánozhassuk.

Mostantól bárki, akinek van internetkapcsolata és némi szabadideje, kevesebb mint egy perc alatt létrehozhatja bárki hangjának digitális klónját.

Az ilyen támadásokhoz szükséges eszközök egyre olcsóbbak és mindenki számára elérhetőbbek lesznek napról napra. És mivel oly sok ember osztja meg az életét a közösségi médiában, egy csaló számára nagyon könnyű megtalálni a szükséges hanganyagot.

Ebben a cikkben végigvezetjük Önt az audiocsalás néhány hírhedt valós példáján. Bemutatunk egy olyan megoldást is, amellyel időben véget vethet ezeknek a fenyegetéseknek.

A legfontosabb tudnivalók

- A hanghamisítási kísérletek száma az elmúlt években több mint 2137%-tel nőtt, amit az a tény táplál, hogy a modern mesterséges intelligencia képes 85% pontos hangklónt létrehozni mindössze három másodpercnyi forráshang felhasználásával.

- A hírhedt valós támadások közé tartozik a 2024-es Arup mérnöki céges rablás, ahol a csalók egy pénzügyi igazgatóról készült deepfake videót és hangfelvételt használtak arra, hogy egy alkalmazottat $25,6 millió átutalásra bírjanak.

- A vállalati lopásokon túl a hanghamisítások súlyos érzelmi kockázatot jelentenek a családok számára az emberrablási csalásokon keresztül, és képesek megkerülni a bankok és más, magas biztonságú alkalmazások által használt hagyományos biometrikus biztonsági rendszereket.

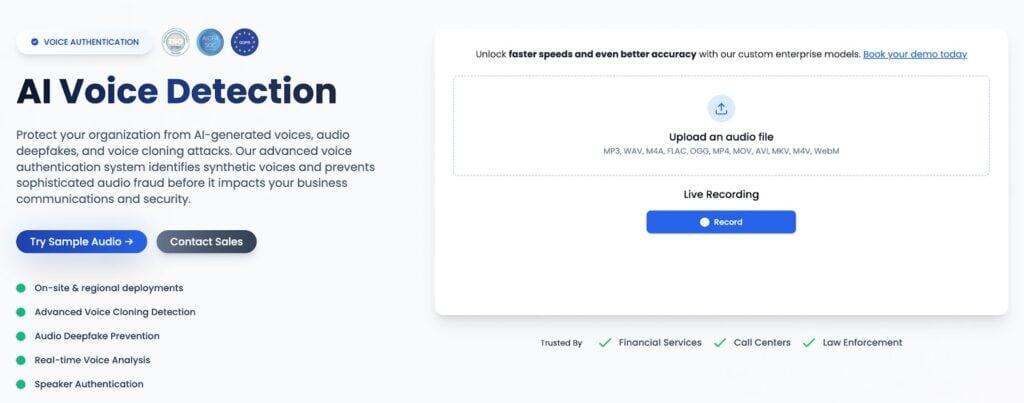

- A szervezetek kénytelenek túllépni a pusztán emberi ellenőrzésen azáltal, hogy többszemélyes jóváhagyási protokollokat vezetnek be a nagy átutalásokhoz, és olyan AI hangdetektorokat alkalmaznak, mint a TruthScan, hogy valós időben elemezzék az akusztikus ujjlenyomatokat.

- A TruthScan biztosítja a vállalati interakciókat azáltal, hogy az olyan platformokról származó szintetikus beszédhibákat, mint az ElevenLabs és a Murf, több mint 99% pontossággal azonosítja az összes főbb hang- és videóformátumban.

Mik azok a Voice Deepfake támadások?

A hanghamisítás valakinek a hangjának digitális hamisítása. A támadó olyan szoftvert használ, amely a hangfelvételekből minden apró részletet képes elemezni arról, ahogyan valaki beszél.

A hang klónozásához a szoftver megpróbál mintákat észrevenni a hangban. Elsősorban olyan dolgokat vesz figyelembe a szoftver, mint a hangmagasság, a hangszín, az, ahogyan valaki a mondatok között lélegzik stb.

Ha egyszer megtanulja ezeket a mintákat, a támadó ráveheti, hogy bármit mondjon ezen a hangon.

Soha többé ne aggódjon az AI-csalások miatt. TruthScan Segíthet:

- AI generált érzékelése képek, szöveg, hang és videó.

- Kerülje a jelentős mesterséges intelligencia által vezérelt csalás.

- Védje a leg érzékeny vállalati eszközök.

Ami veszélyes, az az, hogy a voice deepfake készítő eszközök könnyen hozzáférhetőek. És a legtöbbjük nem igényel telepítést. Ezek online elérhetőek weboldalak formájában.

Csak néhány dollárt kell rájuk dobni, és elkezdhetik klónozni a hangokat. Ha egy kicsit jobban utánanézel, talán még olyan eszközöket is találsz, amelyekkel ingyen klónozhatod a hangokat.

Ez az új és könnyen elérhető technológia a hangcsalások számának meredek emelkedéséhez vezetett.

A csalóknak csak egy aprócska hanganyagra van szükségük valakiről, amelyet a közösségi médiából vagy más nyilvános csatornáról szerezhetnek be, hogy klónozhassák.

Ezután a klónozott hangot arra használhatják, hogy megszemélyesítsenek egy személyt olyan helyzetekben, mint például élő telefonhívások, videóbeszélgetések, hangjegyzetek, bejelentések stb.

Ezek nem csak hipotetikus felhasználási esetei a hangmásolat-támadásoknak. Ezek a dolgok már megtörténtek. A későbbiekben kitérünk néhány hírhedt hangmélyhamisító támadásra.

A Voice Deepfake támadások lehetséges kockázatai

A voice deepfake-ről hallva talán egy olyan vicces videó képét idézte fel, amelyen egy híresség olyan dolgokat mond, amelyeket soha nem mondott.

A klónozott hang látszólag ártalmatlan használata azonban komoly károkat okozhat az érintett feleknek. Beszéljünk a kockázatokról.

Pénzügyi pusztítás a vállalkozások számára

Egy hangmély hamisítás örökre tönkreteheti egy vállalat hírnevét. Az is megvan a hatalma, hogy percek alatt nagy összegektől fossza meg.

Hogyan lehetséges, kérdezheted? A csalók képesek klónozni egy vállalat főnökének hangját, és azt arra használják, hogy felhívják az alkalmazottakat, és olyan dolgokra vegyék rá őket, amelyeket nem kellene megtenniük, például pénzt utalnak át egy számlára.

Ez csak egy példa. A lehetőségek száma végtelen.

Biztonsági rendszerek megkerülése

Az Ön hangja olyan biometrikus adat, amelyet senki másnak nem szabadna birtokolnia. Ez azért van, mert jelszóként használja sok alkalmazásba való bejelentkezéshez, különösen a banki alkalmazásokba.

Bár ezek az alkalmazások rendelkeznek beépített automatikus hangellenőrző rendszerrel, amely megakadályozza az illetéktelen hozzáférést, egy jó hangklónnak még mindig van esélye arra, hogy becsapja őket.

A családok érzelmi megterhelése

Az audiocsalók számára talán a legkönnyebb célpontok az idős családtagok. Például a szülők és a nagyszülők.

A csalók felhívhatnak mondjuk egy anyát, és lejátszhatják a lánya segítségért kiáltó hangját, mondván, hogy elrabolták.

A munkahelyi bizalom csökkenése

A Voice deepfake támadások az egészséges munkahelyi bizalomnak is ártanak.

Az alkalmazottaknak kétszer is ellenőrizniük kell majd a menedzserük telefonhívásait, hogy megbizonyosodjanak arról, hogy nem egy csaló utasítja őket kockázatos dolgokra klónozott hangon.

Akkor milyen lehetőségeid vannak, ha nem kétszeresen kézzel ellenőrzöd? Az imént tárgyalt összes kockázat arra utal, hogy szükség van egy automatizált deepfake támadásmegelőzésre.

Szerencsére most már vannak deepfake AI hangdetektáló eszközeink, a TruthScan az egyik ilyen.

A csalás és a megszemélyesítés megakadályozása a TruthScan AI hangdetektor.

Valós példák a Voice Deepfake támadásokra

A mesterséges intelligenciának köszönhetően mára eljutottunk arra a pontra, hogy nem bízhatunk meg abban, amit a szemünk lát vagy a fülünk hall. A mesterséges intelligencia ma már képes valósághű képeket és videókat készíteni. Ugyanez vonatkozik a hangra is.

Talán már hallottál olyan történeteket, amelyekben emberek bedőlnek a deepfake audio csalásnak. Időről időre felbukkan a hírekben és a közösségi médiában is. Ezek közül néhányat nehéz felfogni.

Meséljünk néhányat a leghírhedtebb voice deepfake támadásokról, hogy képet kaphass arról, milyen ügyesen hajtják végre ezeket.

Az $25 milliós virtuális találkozó, amely valójában soha nem történt meg

Ez a deepfake támadás valószínűleg a legtöbbet jelentett támadás.

A az Arup nevű brit mérnöki cég volt az áldozat., de a csalás a hongkongi irodából indult.

2024 eleje volt, amikor a vállalat pénzügyi osztályának egyik dolgozója e-mailt kapott a vállalat pénzügyi igazgatójától az Egyesült Királyságból. Az e-mailben a pénzügyi igazgató utasította a dolgozót, hogy titkos pénzátutalásokat végezzen néhány bankszámlára.

Az alkalmazott először eléggé gyanakvó volt, mert a kérést kissé furcsának érezte, és azt gondolta, hogy ez egy adathalász átverés lehet.

De aztán az alkalmazottat meghívták egy videokonferencia-hívásra. Amikor a munkavállaló csatlakozott a híváshoz, pontosan a pénzügyi igazgatónak és több más vezető beosztású kollégának tűnő személyt látott.

Mindenki pontosan úgy nézett ki és úgy hangzott, ahogyan kellett. Beszéltek is egymáshoz, hogy még valóságosabbnak tűnjön.

Ez teljesen eloszlatta a pénzügyi osztály dolgozójának minden kétségét, aki ezután 15 tranzakción keresztül több mint $25,6 millió (~HK$200 millió) dollárt küldött több különböző hongkongi bankszámlára.

Később kiderült, hogy ez az egész felállás egy deepfake volt. A hívásban szereplő személyek egyike sem volt az, akinek látszott, kivéve az Arup alkalmazottját. A csalók tökéletesen összehangolták a támadást a vállalat pénzügyi igazgatójának és vezető munkatársainak kiváló minőségű hang- és videoklónjainak felhasználásával.

Az olasz miniszter és a divatikonok

Ez is 2024-ben történt. A Guido Crosetto hamis olasz védelmi miniszter felhívott több olasz elitet, és azonnali pénzügyi segítséget kért tőlük az elrabolt újságírók megmentéséhez.

A hívásban a hamis Guido Crosetto azt állította, hogy ez egy szigorúan titkos kormányzati művelet. A hívónak még olyan legendás divatcikkekkel is sikerült telefonon beszélnie, mint Giorgio Armani.

Sajnos egy személy végül körülbelül egymillió dollárt utalt át. Ők valószínűleg másoknál erősebb hazafias kötelességtudattal segítettek, amit a csalóknak sikerült kihasználniuk.

Az $243,000 brit energiaipari rablás

Ez a történt 2019-ben és valószínűleg ez volt az első ilyen méretű deepfake.

Egy brit energetikai cég vezérigazgatója azt hitte, hogy a németországi anyavállalat főnökével beszél telefonon.

A vezérigazgatót arra kötelezték, hogy mintegy 220 000 eurót ($243 000) utaljon át egy magyarországi beszállítónak. Azt mondták neki, hogy egy kritikus üzletről van szó, amely azonnali átutalást igényel. A vezérigazgató bedőlt a csalásnak, és átutalta a pénzt.

Rémisztő hívás egy arizonai anyának

Emlékszel, beszéltünk arról, hogy az audio deepfakes veszélyt jelent a családokra? Az általunk említett átverési példa valóban megtörtént.

A csalók egy 15 éves lány hangját klónozták a közösségi médiában közzétett videójáról. Ezután felhívták az édesanyját, és azt állították a lány hangján, hogy elrabolták, és az emberrablók azonnal váltságdíjat követelnek érte.

Szerencsére az apa fel tudta hívni a tényleges lányukat, aki az egész megpróbáltatás alatt biztonságban volt egy síedzésen. Elkerülték az átverést.

Hogyan befolyásolják a Voice Deepfakes a vállalkozásokat

A voice deepfake támadás fő célja többnyire a pénzlopás.

De ha a célpont a vállalkozás, a kár többdimenziós.

A deepfakes például megmérgezhetik a légkört egy vállalat alkalmazottai között. Olyan kultúrát teremthet, amelyben az alkalmazottak mindig rettegnek attól, hogy hibát követnek el.

Vegyük például a call centereket. Jelentéseket látunk arról, hogy kiberbűnözők hívják őket, és konkrét ügyfeleknek adják ki magukat.

A trükkjük az, hogy a call center ügynökei megváltoztatják az ügyfelek számlaadatait (pl. lakcím, telefonszám), és átveszik a számláikat.

A távfelvétel és a virtuális interjúk egy másik terület, ahol a jelöltek a hamisított hangokat arra használhatják, hogy olyan állásokat szerezzenek, amelyekre nem is alkalmasak.

A vállalkozások védelme a Voice Deepfake támadásoktól

A hagyományos biztonsági szabályok a vállalkozásoknál az AI előtti korszakban íródtak.

Legfőbb ideje, hogy a vállalkozásoknak átgondolják ezeket. Először is azzal kellene kezdeniük, hogy felvilágosítják magukat arról a sok új kiberfenyegetésről, amelyek a mesterséges intelligenciával való visszaélésből erednek.

Például képzéseket szervezhetnek az egész csapatuk számára, és valós példákat mutathatnak nekik az audiocsalásra. Kezdhetik a fentebb tárgyalt példákkal. Ezeknek a képzéseknek a különböző forgatókönyvekre vonatkozó deepfake támadások megelőzésére vonatkozó tippeket is meg kell adniuk nekik.

Ezután folytathatja a belső üzletpolitikák frissítését. Az egyik fontos változtatás lehet, ha nem engedi meg egyetlen személynek, hogy egyedül engedélyezzen hatalmas összegű átutalásokat.

A nagy kifizetésekhez egy teljes testület jóváhagyását kellene megkövetelni, hogy legalább az egyikük időben észrevegye, hogy valami nincs rendben.

Gondoljon arra is, hogy integráljon egy automatizált AI hangdetektor hogy a hívások alatt a háttérben fusson.

Erre készültek a TruthScan AI-eszközök. AI-eszközeinkkel észlelheti, ellenőrizheti és megelőzheti a voice deepfake támadásokat. Elmondjuk, hogyan.

Hogyan biztosítja a TruthScan a hangalapú interakciókat?

Megértjük, hogy az alkalmazottak egy stresszes hívás közepén nem tudják egymagukban megkülönböztetni a mély, hamis hangot a valódi hangtól. Szükségük van egy dedikált asszisztensre, aki a hívás közben is el tudja látni ezt a feladatot, miközben az Ön csapata arra koncentrálhat, amire felvették őket.

A AI hangdetektor egy dedikált megoldás.

Íme, hogyan működik és mire képes:

- Több millió különböző adatpontot elemez élő telefonbeszélgetésekben és videoértekezleteken, és 99% pontosságot biztosít.

- A hamis hang észlelése után azonnal figyelmeztetést ad ki

- Olyan spektrális mintázatokat és akusztikus ujjlenyomatokat ragad meg a hangban, amelyeket csak a szintetikus modellek hagynak maguk után.

- Integrálható a meglévő call centerrel vagy help deskkel egy egyszerű REST API-n keresztül

- Minden főbb audio- és videoformátumot képes beolvasni

Beszéljen a TruthScan-nel a Voice Deepfake támadások megelőzéséről

A TruthScan segítségével valós időben megállíthatja a hangklónozási csalást, de a kérdés az, hogy mikor kezdi el? Előbb-utóbb az alkalmazottai elkövethetnek egy hibát, és átverhetik Önt. Ne várjon erre a szerencsétlen pillanatra.

A mesterséges intelligenciával működő hangdetektorunk az olyan platformok segítségével, mint az ElevenLabs és a Murf, képes azonosítani a hanghamisításokat.

Élő telefonhívások és videóbeszélgetések során a háttérben működik, így a híváskezelő ügynököknek nem kell több feladatot elvégezniük.

Ehhez mindössze egy gyors integrációra van szükség a REST API-nkon keresztül.

Kezdje el a TruthScan most, és védje meg vállalkozását a deepfake csalásoktól.