A 90-es években ez volt a DNS.

A 2000-es években a mobiltornyok jelzései voltak.

De 2026-ban a bizonyítékok új aranyszabálya a digitális ujjlenyomat lesz.

Gondolj erre így...

Minden videofájl egyedi aláírással rendelkezik.

Ha akár egyetlen pixelt is megváltoztat a mesterséges intelligencia, az ujjlenyomat azonnal megváltozik.

Ha a mesterséges intelligencia bizonyítékának nincs egy ellenőrzött blokklánc időbélyege, amely rögzíti az ujjlenyomatot, akkor az egy modern bíró szemében akár egy karikatúra is lehetne.

Ez tehát azt jelenti, hogy a “látni azt jelenti, hogy hiszünk” korszakának vége.

Beléptünk a mesterséges intelligencia-videóellenőrzés korszakába, ahol a bizonyíték nem abban rejlik, amit lát, hanem a felszín alatt rejtőző digitális kódban.

Ebben a blogban azt vizsgáljuk meg, hogy a hagyományos bizonyítékok miért vallanak kudarcot a videócsalások ellen, hogyan lehet kiszűrni a manipulált klipeket, miért kritikus az ellenőrzés az elfogadhatóság szempontjából, és miért elengedhetetlen a jogi csapatok számára egy olyan mesterséges intelligencia-videódetektor, mint a TruthScan.

Merüljünk el benne.

A legfontosabb tudnivalók

- 2026-ban minden videobizonyítékot mesterséges intelligencia-videóellenőrzésnek kell alávetni ahhoz, hogy megbízhatónak lehessen tekinteni.

- A videohamisítás magában foglalja az olyan apró szerkesztéseket, mint az időbélyegző manipulálása, nem csak a teljes arccsere.

- Egy professzionális deepfake detektor az egyetlen módja annak, hogy az emberek által nem észlelt GAN műalkotásokat elkapják.

- Az új szabályok, például a 707. szövetségi szabály egységesítik a mesterséges intelligencia bizonyíték bírósági elismerésének módját.

- Az automatizált bizonyítékelemzés lehetővé teszi a cégek számára, hogy gyorsan és pontosan dolgozzák fel a hatalmas felfedési csomagokat.

- A TruthScan a szintetikus maszkok valós idejű felismerésével megakadályozza a csalást az élő meghallgatások során.

Mi a videobizonyíték a jogvitákban?

A videobizonyíték alapvetően minden olyan rögzített klip, amelyet a bíróságon a történtek bizonyítására használnak fel. A büntetőügyektől kezdve a biztosítási elszámolásokig mindenhol jelen van.

2026-ban azonban a videócsalások elterjedése miatt a “látva hiszünk” veszélyes feltételezéssé vált. A jogi szakembereknek ma már robusztus mesterséges intelligencia-videóellenőrzésre van szükségük az igazságszolgáltatási rendszer integritásának biztosítása érdekében.

A bíróságok által nap mint nap használt videobizonyítékok típusai

Soha többé ne aggódjon az AI-csalások miatt. TruthScan Segíthet:

- AI generált érzékelése képek, szöveg, hang és videó.

- Kerülje a jelentős mesterséges intelligencia által vezérelt csalás.

- Védje a leg érzékeny vállalati eszközök.

- Megfigyelés (CCTV): Boltok vagy közlekedési lámpák kamerái. Ez a leggyakoribb bizonyíték büntetőügyekben.

- Testkamerák: Rendőrök felvételei, amelyeket többnyire polgárjogi vagy túlzott erőszakkal kapcsolatos ügyekben használnak.

- Dashcams: Az autós balesetek és biztosítási viták bizonyítéka.

- Felvett tanúvallomások: Videómeghallgatások vagy távoli tanúvallomások, amelyek a világjárvány óta megszokottá váltak. Ma már szabvány, de hajlamos a jogi csalások felderítésével kapcsolatos kihívásokra.

- Okostelefon és közösségi média: Videók a járókelőktől vagy olyan bejegyzések, amelyek bizonyítják valakinek a viselkedését vagy tartózkodási helyét.

- Vállalat biztonsága: A vállalatok által csalás vagy “jogtalan elbocsátás” esetén használt felvételek.

A generatív mesterséges intelligencia és a deepfake technológia a kockázat új rétegét jelentette. 2025-ben:

- 20-ból 1 személyazonosság-ellenőrzést megtévesztett az AI deepfakes

- A Medius felmérése szerint 43% szakember esett áldozatul egy deepfake csalási kísérletnek

A videóbizonyítékkal kapcsolatos csalások valós esetei

- Manipulált bírósági felvételek

A manipulált tárgyalótermi felvételek olyan jogi ügyben benyújtott video- vagy hangbizonyítékot jelentenek, amelyet megváltoztattak, szerkesztettek vagy teljesen hamisítottak a technológia segítségével.

Példák:

- Alameda megye mélyhamisítási ügye (2025): Egy kaliforniai polgári peres ügyet elutasítottak, miután a bíróság felfedezte, hogy egy bizonyítékként benyújtott tanúvideót teljes egészében mesterséges intelligencia segítségével készítettek.

- Az Sz Huang kontra Tesla deepfake védelem (2023): A Tesla ügyvédei egy jogtalan haláleset miatt indított perben azt állították, hogy a balesetről készült kulcsfontosságú felvételek egy deepfake lehetnek.

Megváltoztatott megfigyelési videók

A megfigyelési videó az egyik leggyakrabban használt mesterséges intelligencia bizonyíték a bíróságon. Sokan azonban tévesen úgy gondolják, hogy a manipuláció csak teljes mélyhamisítás.

A valóságban a videócsalás gyakran kisebb, kevésbé nyilvánvaló módon történik, ami veszélyeztetheti az ügyet.

A manipuláció gyakori típusai a következők:

- Időbélyeg módosítások

- A keret eltávolítása

- Metaadatok vagy GPS változások

- Arc csere

- Tárgy eltávolítása vagy behelyezése

- Looping felvételek

- Minőségromlás

A megfigyelési videók gyakran számos különböző helyről származnak, például magánüzletekből, otthoni csengőkből, parkolókból és városi kamerákból. A rendőrségi testkamerák felvételeitől eltérően ezek a rendszerek általában nem követik a szigorú felügyeleti lánc szabályait.

Ez azt jelenti:

- Előfordulhat, hogy nincs egyértelmű feljegyzés arról, hogy ki kezelte az aktát.

- A felvételek többször is másolhatók, átvihetők vagy konvertálhatók.

- A hitelesítési eljárások gyengék vagy következetlenek lehetnek.

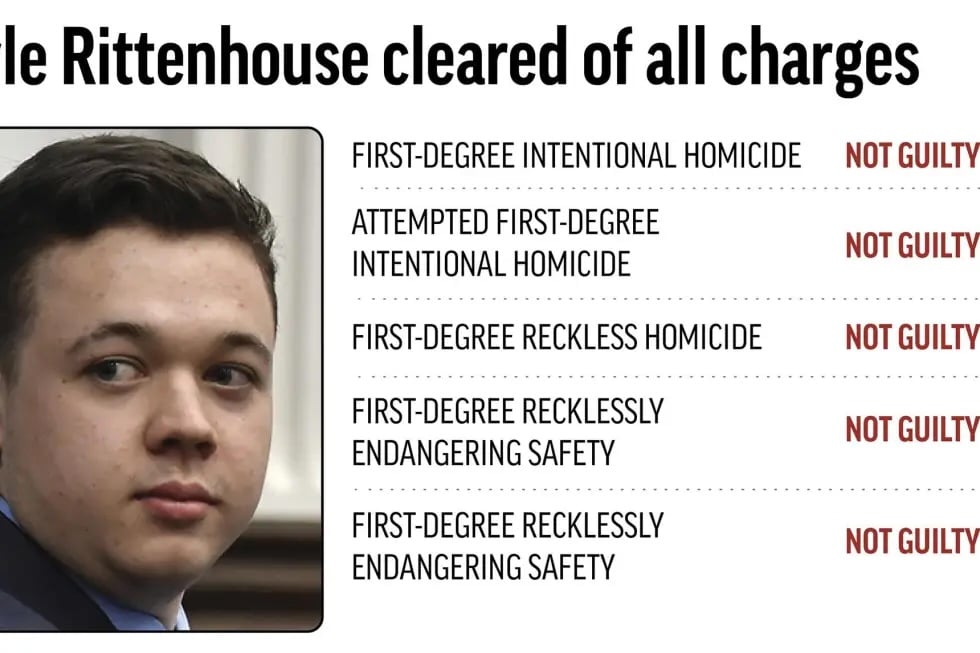

Példa: A Wisconsin kontra Rittenhouse AI-növelési kérdés

Híres példa erre a Wisconsin kontra Rittenhouse per. A vád megpróbálta használni az iPad csippentés-zoom funkcióját, hogy részleteket mutasson egy drónvideón.

A védelem azzal érvelt, hogy az Apple zoomolása mesterséges intelligencia-interpolációt használ, hogy kitalálja, mit kellene ott lennie. A bíró úgy döntött, hogy professzionális AI-videóérzékelő nélkül a feljavított felvételek nem fogadhatók el.

Vitatott video tanúvallomások

Egy vitatott video tanúvallomás általában jogi csalás felderítését igényli annak megállapításához, hogy a felvétel:

- Teljesen hamis tanúvallomás vagy nyilatkozat

- Egy valódi tanúvallomást hamisnak minősítettek

- Egy manipulált valós felvétel

Mindegyik forgatókönyv komoly hitelesítési terhet ró a bíróságra.

Példa: Az Egyesült Királyság gyermekelhelyezési ügye

A University of Baltimore Law Review által idézett egyik brit családi bírósági vitában az anya egy erősen módosított felvételt nyújtott be, hogy az apát erőszakosnak állítsa be a felügyeleti joggal kapcsolatos vita során.

A cél az volt, hogy korlátozzák a gyermekeihez való hozzáférését.

A mesterséges intelligencia által generált videók térhódítása jogi ügyekben

Az út a jelenlegi mélyhamisító detektorok korszakához különböző fázisokban alakult ki:

- A korai figyelmeztető évek (2017-2021)

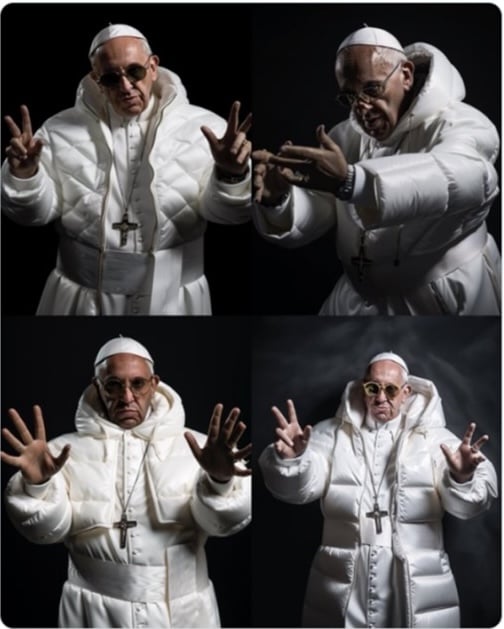

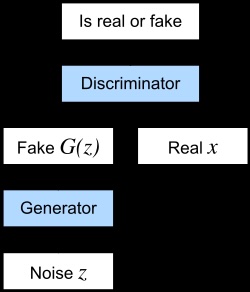

A Deepfake technológia (amelyet a generatív adversariális hálózatok (GAN) hajtanak) 2017 körül került a nyilvánosság elé.

A korai hamisítványok gyakran rossz minőségűek voltak: az arcok furcsa torzulásokkal, extra ujjakkal, nem megfelelő megvilágítással és homályos vonásokkal rendelkeztek, ami miatt könnyű volt kiszúrni őket.

- Az eszkalációs szakasz (2022-2023)

2022-re a technológia javult. Sok volt ingyenes és okostelefonon is használható.

2023-ban kezdtünk találkozni az első jelentős deepfake-hez kapcsolódó kihívásokkal bírósági ügyekben, többek között az Sz Huang v. Tesla, az Egyesült Államok v. Reffitt és az Egyesült Államok v. Doolin ügyekben, ahol az ügyvédek kérdéseket vetettek fel azzal kapcsolatban, hogy a videóbizonyíték lehet-e mesterséges intelligencia által generált.

Ezzel egy időben az Amerikai Ügyvédi Kamara Bizonyítási Szabályokkal Foglalkozó Tanácsadó Bizottsága hivatalosan is elkezdte tanulmányozni a kérdést.

- A kritikus küszöb (2024-2025)

A mesterséges intelligencia által generált tartalom nem sokáig maradt tudományos. 2024-ben az Arup mérnöki cégnél történt egy incidens, amely egy mesterséges intelligencia által generált hamis videohívást érintett, amely csalást engedélyezett. összesen $25 millió EUR összegű átutalások.

A jogrendszer reagálni kezdett.

2025-ben, Louisiana elfogadta a HB 178-at, létrehozva az első állami szintű mesterséges intelligencia bizonyítékokat ellenőrző keretrendszert.

Szövetségi szinten az Egyesült Államok bizonyítási szabályokkal foglalkozó tanácsadó bizottsága a következőket javasolta 707. szabály, a gépi úton előállított bizonyítékokra összpontosítva.

Hol tartanak a dolgok 2026-ban

2026 elejétől országszerte felgyorsult a deepfake és az AI-videók szabályozása:

- 46 állam elfogadták a deepfake jogszabály valamilyen formáját.

- 2022 óta, Csak 2025-ben 169 törvényt fogadtak el, és 146 törvényjavaslatot nyújtottak be..

- A 707. szövetségi szabály nyilvános észrevételek megtételére nyitva áll 2026. február 16-ig.

Videóellenőrzés javítása mesterséges intelligenciával

A mesterséges intelligencia által generált videók felderítésének leghatékonyabb módja maga a mesterséges intelligencia használata.

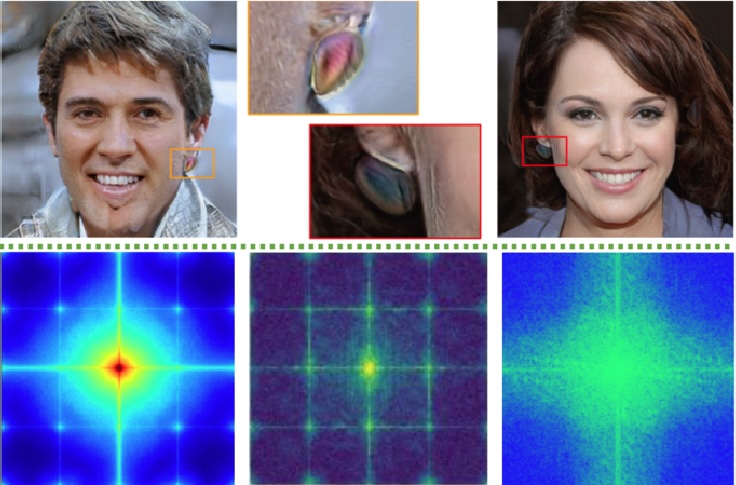

A mélyhamisítványokat ugyanis olyan gépi tanulási rendszerek hozzák létre, amelyek finom digitális mintákat hagynak maguk után.

Ezek a minták túl kicsik vagy túl összetettek ahhoz, hogy az emberi szem észrevegye őket. Más algoritmusok azonban felismerhetik őket.

Egy megbízható mesterséges intelligencia-videóellenőrző rendszer egyszerre képes elemezni a videó több rétegét, többek között:

- Keretszintű elemzés minden egyes képkockát ellenőriz vizuális hibák, például furcsa textúrák, fényviszonyok vagy arcok körüli keverési problémák miatt.

- Időbeli koherenciaelemzés a képkockák közötti mozgást vizsgálja, hogy megtalálja a természetellenes ugrásokat vagy a következetlen mozgást.

- Arc tájékozódási pontok követése figyeli a szemmozgást, a pislogást és az arcformát a természetellenes változások észlelése érdekében.

- Audiovizuális szinkronizációs tesztelés ellenőrzi, hogy az ajakmozgások pontosan megfelelnek-e a beszélt szavaknak.

- Audio kriminalisztika elemzi a hangot a klónozásra utaló jelek, például szokatlan hangminták vagy robotikus hangok után kutatva.

- Metaadatok és tömörítési elemzés a rejtett fájladatok vizsgálata létfontosságú a jogi csalások felderítéséhez, hogy megállapítsa, egyezik-e az eredeti felvétel részleteivel.

Jogi csapatok oktatása a videócsalásokról

Mivel a mesterséges intelligencia ma már ijesztő pontossággal képes utánozni az emberi viselkedést, az ügyvédi irodák automatizált bizonyítékelemzéssel és a hagyományos taktikák keverékével igyekeznek az élen járni.

| Kategória | Módszer | Leírás |

| Hivatalos utak | CLE (jogi továbbképzés) kreditek | Kötelező vagy választható kurzusok, amelyeken az ügyvédek megtanulják, hogyan hitelesítsék a digitális bizonyítékokat, hogyan értsék meg a mély hamisítványokat, és hogyan feleljenek meg a bizonyítási előírásoknak. |

| Bíróság által kirendelt AI szakértők | A DNS-szakértőkhöz hasonló, minősített AI-szakértők létrehozása a vitatott videós bizonyítékok bírósági értékelésére. | |

| Nem hivatalos utak | Belső vörös-csapat | Kiberbiztonsági szakemberek alkalmazása annak vizsgálatára, hogy a hamis vagy manipulált bizonyítékok átcsúszhatnak-e a céges felvételi rendszereken. |

| “Vibe Check” protokoll | A munkatársak képzése a gyakori deepfake figyelmeztető jelek, például a természetellenes pislogás, a torz arcvonások vagy a szájszinkronizációs problémák észlelésére, mielőtt törvényszéki felülvizsgálatra küldenék őket. |

Eszközök és technológia a bizonyítékok validálásához

2026-ban túlléptünk az egyszerű szemrevételezésen.

Mivel a mesterséges intelligencia ma már a legtapasztaltabb nyomozókat is képes megtéveszteni, a jogi csapatok speciális eszközkészletet használnak annak ellenőrzésére, hogy amit látnak, az a teljes igazság.

A bizonyítékok validálása mögött álló technológia

- Deepfake detektorok: Ezek olyan speciális szoftverek, amelyek GAN-leleteket keresnek. Ezek mikroszkopikus, matematikai minták vagy zajok, amelyeket a szintetikus arcokat generáló mesterséges intelligencia modellek hagynak maguk után. Míg az ember egy arcot lát, addig a detektor egy oda nem tartozó digitális aláírást lát.

- TruthScan egy olyan mély hamisítvány-érzékelő, amely képkockáról képkockára vizsgálja a videókat mesterséges intelligencia jelei, például szokatlan pislogás, furcsa arcformák vagy pixelhibák után, ahol egy hamis arcot adnak hozzá.

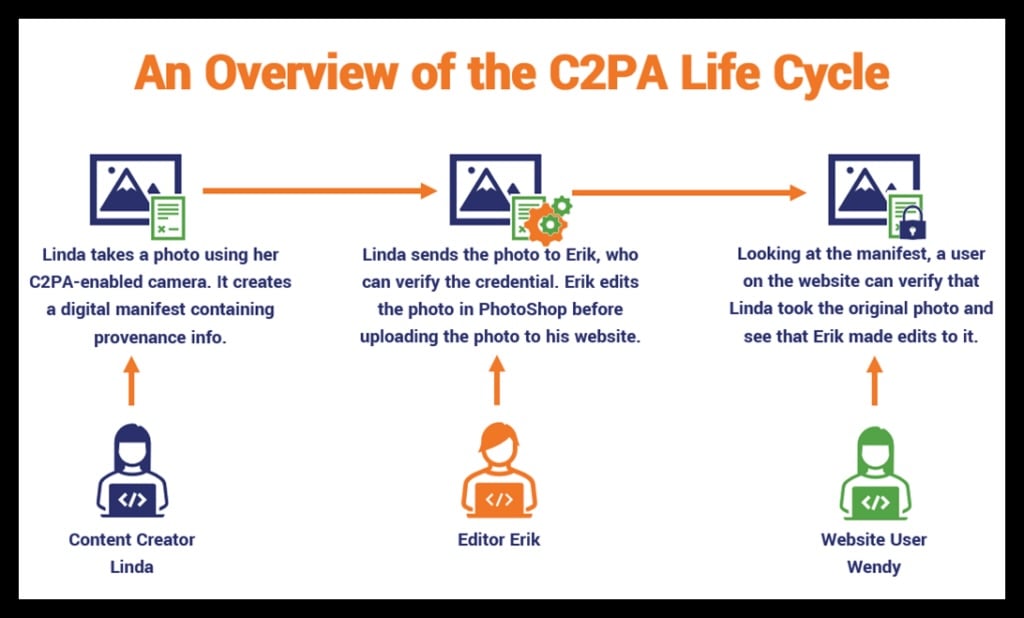

- Blockchain időbélyegek: Annak bizonyítására, hogy egy videóhoz nem nyúltak hozzá a rögzítés óta, sok ügynökség már a C2PA szabványt használja. Amikor egy videót a szabványnak megfelelő eszközzel rögzítenek, egyedi digitális ujjlenyomat (hash) jön létre és tárolódik egy blokkláncban.

- A TruthScan ellenőrizni tudja, hogy ez az ujjlenyomat egyezik-e a videóval, és megmutatja, hogy a fájlt szerkesztették-e, vagy a felügyeleti láncot megszakították-e.

- Metaadat törvényszéki eszközök: Minden digitális fájlnak van egy születési bizonyítványa, az úgynevezett Exif-adatok. Ezek az eszközök ellenőrzik, hogy egy fájlt újra mentettek-e AI szerkesztő szoftverben, vagy hogy a helymeghatározási adatokat (GPS) meghamisították-e. Ha egy videó azt állítja, hogy egy tároló kamerából származik, de a metaadatok azt mutatják, hogy egy videószerkesztő programból exportálták, akkor problémával állunk szemben.

- Az Amped Software és a TruthScan megvizsgálja a rejtett fájladatokat (Exif, fejlécek), hogy kiderüljön, hogy a videót szerkesztették-e vagy mesterséges intelligenciával dolgozták-e fel.

Trendek az AI videó bizonyítékok terén

Íme a 2026-os év három trendje.

- Generatív ellentmondásos törvényszéki vizsgálat: AI vs. AI

A legfejlettebb módja annak, hogy 2026-ban elkapjunk egy deepfake-et, ha ugyanazt a technológiát használjuk, amely létrehozta azt. Ez az úgynevezett Generatív Ellentétes Törvényszéki Törvényszéki Technika.

- Az egyik mesterséges intelligencia (a generátor) megpróbál hamisítványt létrehozni, míg egy másik mesterséges intelligencia (a megkülönböztető) megpróbálja elkapni azt. A tárgyalóteremben az olyan eszközök, mint a TruthScan, lehetnek a végső megkülönböztető eszközök.

- Példa: A felperes benyújt egy videót, amelyen egy vezérigazgató szóbeli szerződést köt. A TruthScan a videót a saját adverzális modelljei segítségével vizsgálja át a GAN-artifaktumok észlelésére. Ha a szoftver 98% szintetikus valószínűséget jelöl meg, a bizonyíték valószínűleg hamisítvány, hogy becsapja az emberi szemet.

- Audio-Video szinkronizálási elemzés (A 0,01ms szabály)

Az emberek általában észreveszik a késleltetést, ha a videó hangja körülbelül 40-80 milliszekundummal eltér. A 2026-os deepfakes azonban gyakran szinte tökéletesek.

- A modern mesterséges intelligencia törvényszéki eszközök ma már 0,01 millimásodperces késleltetést keresnek egy szó fonetikus hangzása és az ajkak mechanikus mozgása között.

- Példa: Egy 2026-os zaklatási ügyben az alperes azt állította, hogy egy videó hamisítvány. A törvényszéki automatizált bizonyítékelemzés kimutatta, hogy az “M” és a “B” ajakformák 0,02 ms eltérést mutattak a hanggal szinkronban. Ez a mikroszkopikus hiba bizonyítja, hogy a hangot klónozták és egy másik videóra helyezték, ami az ügy elutasításához vezetett.

- Cheapfakes vs. Deepfakes

Míg a mély hamisítványok csúcstechnológiás mesterséges intelligenciát használnak, az olcsó hamisítványok a videohamisítás leggyakoribb formája.

- A Deepfake olyan valóságot hoz létre, amely soha nem történt meg (mint egy arccsere). A Cheapfake valódi felvételeket vesz, és egyszerű eszközökkel megváltoztatja a kontextust vagy a szándékot.

- Példa (A lassítás): Egy részegnek vagy befolyásoltnak tűnő politikusról készült videó egyszerűen elkészíthető a felvétel 20%-rel való lelassításával és a hangmagasság beállításával.

- Példa (Az újrakontextus): A 2022-es tüntetésről készült felvételeket 2026-ban egy másik országban élő bizonyítékként közzéteszik egy helyi zavargásról. A jogi csapatok most a TruthScan metaadat-elemzésével bizonyítják a videó tényleges születési dátumát.

Hogyan védi a TruthScan a jogi videóbizonyítékokat?

A TruthScan biztosítja, hogy a bíróságon bemutatott minden képkocka hiteles, ellenőrzött és jogilag védhető legyen.

A platform a következő előnyökkel racionalizálja a mesterséges intelligencia-videóellenőrzést:

Automatizált ellenőrzési naplók és felügyeleti lánc dokumentáció

- Bírósági megbízhatóság: PDF- és JSON-jelentéseket készít, amelyek minden egyes ellenőrzési lépést pontos megbízhatósági pontszámokkal és időbélyegekkel dokumentálnak.

- Top-Tier megfelelés: Nyugodtan tudhatja, hogy adatai biztonságban maradnak, és megfelelnek az olyan szigorú globális szabványoknak, mint a SOC 2, az ISO 27001 és a GDPR.

- Rugalmas adatellenőrzés: A szigorúan szabályozott iparágak számára tervezett helyszíni vagy VPC telepítési opciókkal az érzékeny bizonyítékokat a szükséges joghatóságon belül tarthatja.

Kötegelt feldolgozás és API integráció jogi munkafolyamatokhoz

- Hatalmas időmegtakarítás: Feldolgozhat egyszerre több ezer fájlt a felfedezési csomagokból vagy felügyeleti készletekből tömeges tárolási importálással (S3/GCS).

- Zökkenőmentes elektronikus felderítés: Egyszerűsítse műveleteit azáltal, hogy az ellenőrzést közvetlenül a meglévő szoftverébe integrálja webhookok és API-k segítségével.

- Manuális hibák kiküszöbölése: Automatizálja a bizonyítékok átvizsgálásának első lépését, így csapata a stratégiára összpontosíthat a fárasztó fájlonkénti ellenőrzés helyett.

Valós idejű ellenőrzés a tanúvallomások és távoli meghallgatások esetében

- Állítsa le a megszemélyesítést: Élő közvetítési végpontok használatával észlelheti, hogy egy távoli meghallgatás során a meghallgatott személy használ-e deepfake szűrőket vagy hangklónokat.

- A bírósági integritás fenntartása: Jelölje meg a vizuális vagy audio anomáliákat valós időben, megakadályozva, hogy hamis tanúvallomások kerüljenek a jegyzőkönyvbe.

- Nyugalom: Ügyfeleinek és a bíróságnak egy olyan extra biztonsági szintet nyújt, amely garantálja, hogy a képernyőn megjelenő személy pontosan az, akinek mondja magát.

További információ az AI videobizonyítékok biztosításáról

Védje cégét a manipulált média kockázataitól. A TruthScan deepfake detector és AI video detector technológiája a végső megoldást nyújtja az e-discovery és a jogi ellenőrzés számára.

Készen áll, hogy megnézze a TruthScan-t működés közben?

- Látogasson el a oldalra. truthscan.com hogy ingyen 20,000 kreditet kapjon.

- Vállalati megkeresések, API integráció vagy egyedi telepítési lehetőségek esetén forduljon a csapatukhoz a következő címen Truthscan.com/contact.