Bevezetés

A generatív mesterséges intelligencia forradalmasítja az egészségügyet - és nem mindig a legjobb irányba. 2025-ben az egészségügyi csalások száma nőtt egyre digitálisabb és kifinomultabb, amit az adatvédelmi incidensek, az automatizálás és a generatív mesterséges intelligencia táplálnak.[1]. A bűnözők kihasználják a mesterséges intelligencia eszközeit, hogy létrehozzák hamis betegazonosságok, szintetikus biztosítási igények, mesterséges intelligencia által generált orvosi dokumentumok, hamisított receptek, sőt, még az orvos-beteg interakciókat is hamisították.. Ezek a csúcstechnológiás csalások új magasságokba emelik a csalást, és világszerte veszélyeztetik a biztosítók pénzügyeit és a betegek biztonságát. A kihívás óriási: az egészségügyi csalás már most is évente több tízmilliárd forintba kerül, és a mesterséges intelligencia térhódítása fokozva mind a méretét, mind a komplexitását. a csalások[2][3]. Ez a fehér könyv részletesen bemutatja a legújabb, mesterséges intelligencia által vezérelt csalási trendeket az egészségügyben, a 2025-ös valós eseteket, valamint a fejlődő fenyegetés elleni küzdelem stratégiáit - a mesterséges intelligencia tartalomdetektoroktól a személyazonosság ellenőrzéséig.

A mesterséges intelligencia-alapú csalási rendszerek felemelkedése az egészségügyben

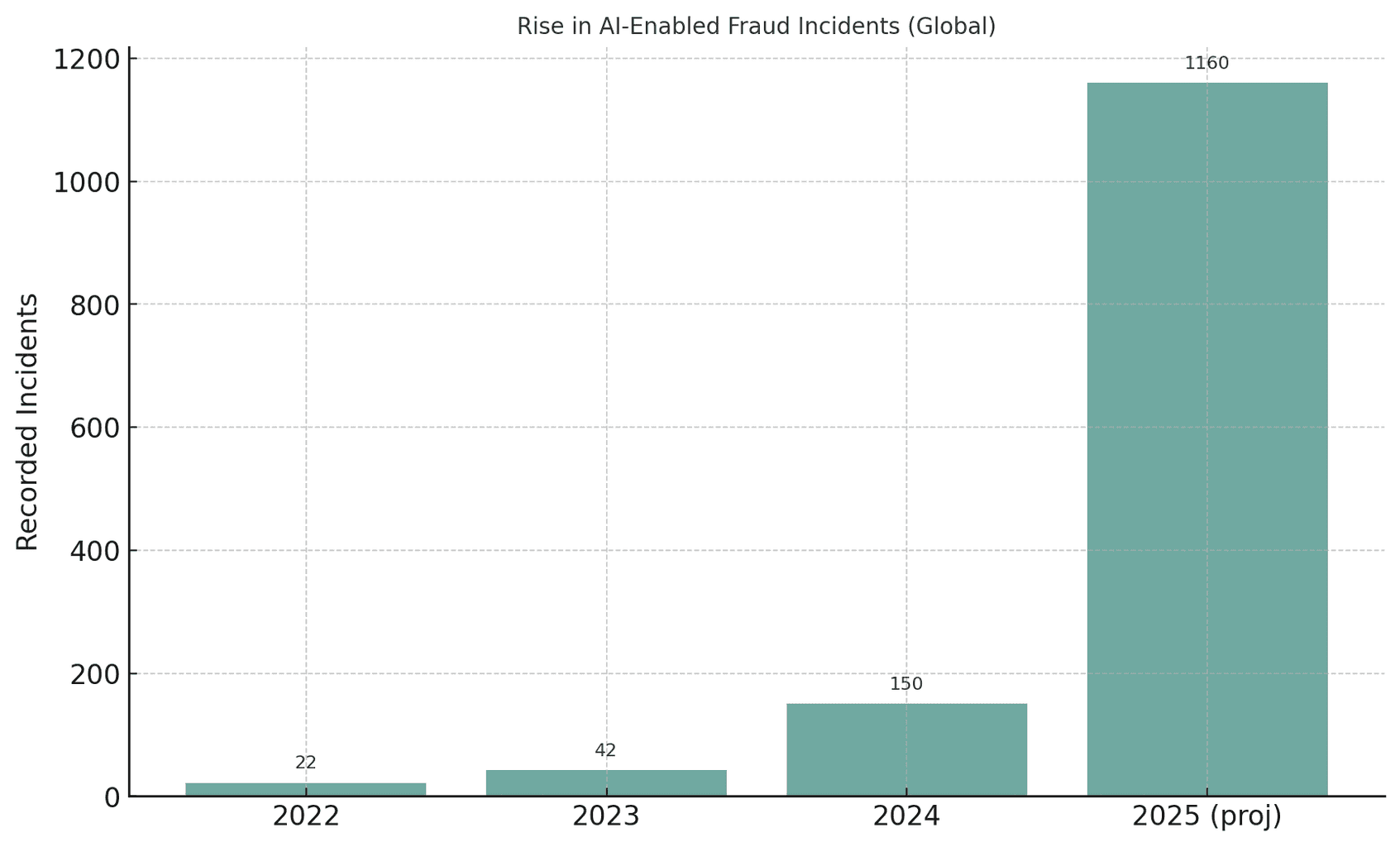

A globális egészségügyi ágazatban példátlanul nagyszámú, mesterséges intelligenciával támogatott csalási kísérlet. Ahogy a generatív mesterséges intelligencia elérhetővé válik, a csalók automatizálhatják a korábban kézzel végrehajtott csalásokat, meggyőző hamis személyazonosságokat, dokumentumokat, sőt hangokat vagy videókat is előállíthatnak. A hatóságok például megjegyezték, hogy a deepfake médiát érintő csalási kísérletek száma 3,000%-vel nőtt 2023-ban egyedül[4][5]. A mélyhamisítással kapcsolatos incidensek száma majdnem megduplázódott a 2022-es 22-ről 2023-ban 42-re, majd 2024-ben 150-re robbant; megdöbbentő módon 2025 első negyedévében 179 mélyhamisítási csalási esetet regisztráltak - ami már meghaladja a 2024-es teljes számot.[6][7]. Ez a tendencia azt sugallja, hogy a mesterséges intelligencia által vezérelt csalások ugrásszerű növekedése, az elemzők szerint a generatív mesterséges intelligencia a csalási veszteségeket a $12,3 milliárd 2023-ban $40 milliárd 2027-ig (32% CAGR)[8].

Ábra: A mesterséges intelligenciával támogatott csalási incidensek robbanásszerű növekedése az elmúlt években. Az észlelt deepfake vagy AI-alapú csalási esetek száma 2022 és 2025 között drámaian megnőtt, ami jól mutatja, hogy a generatív AI-eszközök hogyan turbózták fel a csalási kísérleteket.[4][7].

Soha többé ne aggódjon az AI-csalások miatt. TruthScan Segíthet:

- AI generált érzékelése képek, szöveg, hang és videó.

- Kerülje a jelentős mesterséges intelligencia által vezérelt csalás.

- Védje a leg érzékeny vállalati eszközök.

Az egészségügyet különösen érzékenyen érinti ez a mesterséges intelligencia által táplált bűnözési hullám. Az ágazat hatalmas, széttöredezett ökoszisztémája - amely kórházakat, klinikákat, biztosítókat, gyógyszertárakat és távgyógyászati platformokat foglal magában - több ezer támadási pontot kínál.[9][10]. A hagyományos csalások (pl. hamis biztosítási kártyák vagy lopott betegigazolványok) már rendszerszintű kizsákmányolássá fejlődött az AI használatával[10][11]. Egy 2025-ben lefolytatott amerikai akcióban az Igazságügyi Minisztérium 324 vádlottat vádolt meg összesen $14,6 milliárd hamis állítások - a valaha volt legnagyobb egészségügyi csalási ügy[12][13]. Sok csalás telemedicinális konzultációkat és genetikai tesztelési csalást tartalmazott, és egy új DOJ Egészségügyi csalás adatfúziós központ az AI analitikát a minták proaktív felismerésére használta.[14][15]. A mesterséges intelligencia nyilvánvalóan kétélű kard: segít a nyomozóknak a csalások felderítésében, de ugyanakkor lehetővé teszi a bűnözők számára, hogy soha nem látott mértékű és kifinomultságú csalásokat kövessenek el.[11][2].

Gyakori AI-vezérelt csalási technikák az egészségügyben (2025)

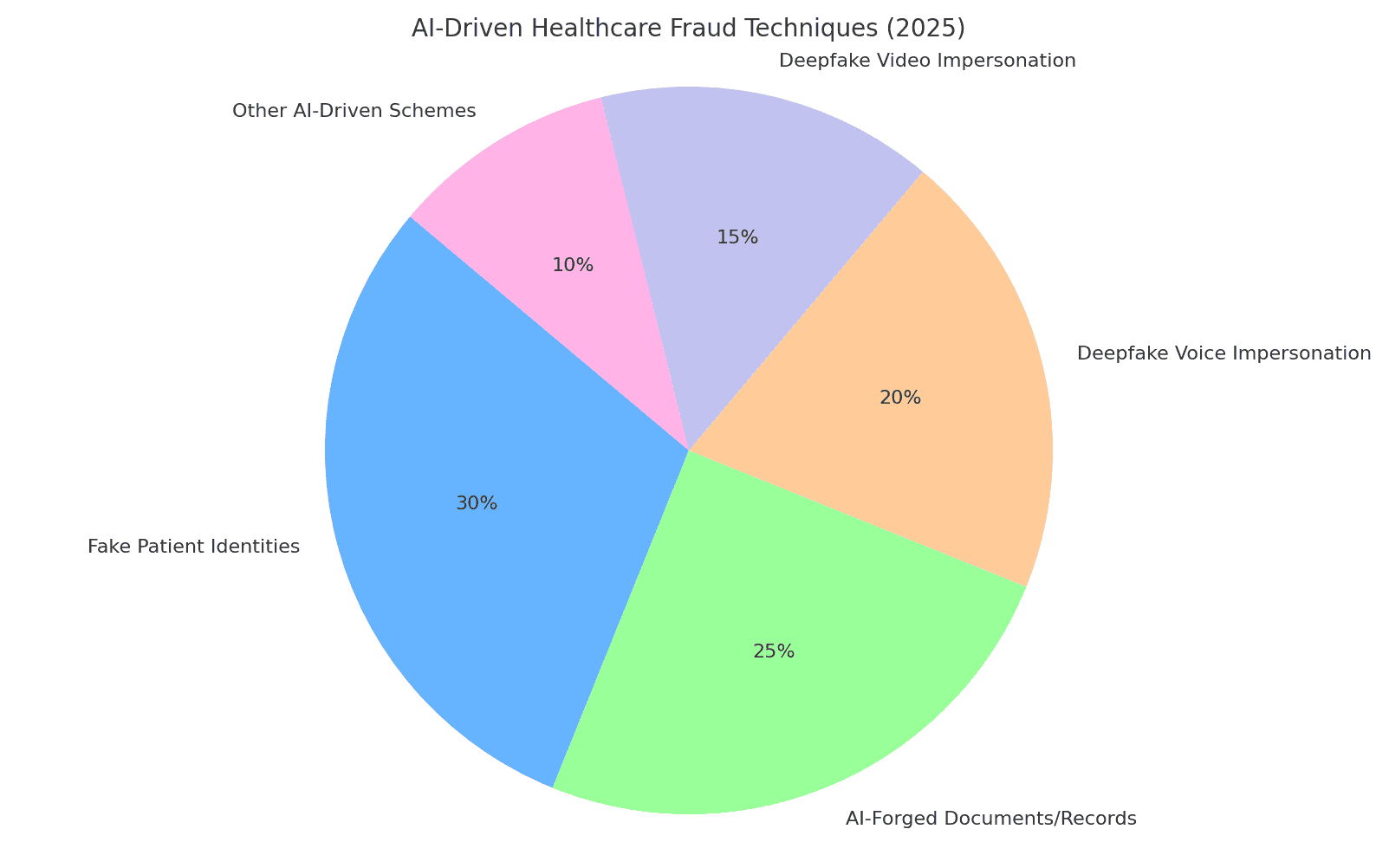

A 2025-ös csalóknak a mesterséges intelligenciával támogatott taktikák eszköztára áll rendelkezésükre az egészségügyi rendszerek és a biztosítók becsapásához. A legfontosabb módszerek közé tartozik a személyazonosságok és dokumentumok hamisítása, hamis orvosi adatok generálása, valamint a megbízható személyzetnek a deepfakes segítségével történő megszemélyesítése. Az alábbiakban lebontjuk a legelterjedtebb AI-alapú csalási technikákat és azt, hogy hogyan használják őket az egészségügyi szervezetek ellen:

Ábra: A főbb AI-alapú egészségügyi csalási technikák lebontása 2025-ben. Hamis betegazonosság és AI-hamisított dokumentumok (pl. orvosi feljegyzések, kárigények) teszik ki a rendszerek nagy részét, míg a deepfake hang és videó megszemélyesítések gyorsan növekvő fenyegetést jelentenek. Az "egyéb mesterséges intelligencia által vezérelt rendszerek" közé tartoznak az AI által készített adathalász e-mailek, a betegportálokat támadó botok és hasonló támadások (becsült százalékos arányok az iparági jelentések alapján).[8][16]).

Szintetikus betegazonosságok

Hamis betegazonosság - gyakran mesterséges intelligencia segítségével jönnek létre - alapvető csalási taktika. Ahelyett, hogy egy személy személyazonosságát lopnák el, a bűnözők több ember valós adatait kombinálják hamisított adatokkal, hogy létrehozzák a szintetikus identitások akik új betegnek adják ki magukat[17][18]. A generatív mesterséges intelligencia felgyorsítja ezt azáltal, hogy valósághű személyes rekordokat hoz létre. Például az AI képes hihető személyazonosító igazolványok, profilok, sőt, akár családtörténetek ("szintetikus szülők") egy hamis beteg számára.[19][20]. Ezeket a fantompácienseket aztán arra használják, hogy számlanyitás, biztosítási kötvények kötése vagy szolgáltatások számlázása ami soha nem történt meg. A COVID-19 világjárvány idején a csalók szintetikus személyazonosító igazolványokat használtak a sürgősségi egészségügyi ellátások lehívására; most pedig arra használják őket, hogy hamis biztosítási igényeket nyújtanak be, vagy recepteket szereznek be, tudva, hogy egy jól kidolgozott identitással elkerülhető a felderítés.[21][22]. Az amerikai jegybank szerint a szintetikus személyazonossággal kapcsolatos csalásból származó veszteségek meghaladták a $35 milliárd 2023-ban és tovább emelkedik[23]. Az egészségügyi hatás súlyos: a csalók egy gyermek lopott társadalombiztosítási számát használhatják arra, hogy egy tökéletes hitelképességű hamis beteget hozzanak létre, vagy a lopott betegadatokat összekeverhetik a biztosító ellenőrzésének megkerülésére.[17][24]. Minden egyes szintetikus beteg, akit a rendszerbe bevezettek aláássa az adatok integritását, és jogtalan kifizetésekhez vezethet. vagy akár klinikai hibák, ha a hamis személyazonosság összekeveredik a valódi orvosi feljegyzésekkel.

AI-generált orvosi dokumentumok és biztosítási igények

A generatív mesterséges intelligenciát mostanában arra használják. orvosi dokumentumok, feljegyzések és teljes biztosítási igények. A nyelvi modellek képesek hitelesnek tűnő orvosi feljegyzéseket, mentesítési összefoglalókat, laboreredményeket vagy orvosi szakzsargonnal teli számlázási kimutatásokat előállítani - mindezt úgy, hogy alátámasszák a csalárd igényt. Valójában az iparági megfigyelők szerint 89% az AI által generált orvosi dokumentumok számának növekedése a korábbi évekhez képest[25][26]. A csalók ezeket a hamis nyilvántartásokat arra használják fel, hogy igazolják a drága eljárásokat vagy gyógyszereket, amelyeket soha nem adtak, vagy hogy felduzzasszák a visszatérítési kódokat. Például egy mesterséges intelligencia létrehozhat egy hamis képalkotó diagnosztikai jelentés vagy laboreredmény az onkológiai gyógyszerekre vonatkozó magas költségigény alátámasztására. A biztosítók és az egészségügyi rendszerek az ilyen esetek áradatával szembesülnek. szintetikus papírmunka, ami megnehezíti a jogos állítások megkülönböztetését a hamisítványoktól. Az Egyesült Királyságban a biztosítók megjegyzik, hogy a a hamisítványok és hamisított dokumentumok gyorsan növekvő használata a kárigényekkel kapcsolatos csalásokban, gyakran látszólag rutinszerű, alacsony értékű követelésekben, hogy elkerüljék az ellenőrzést.[27]. Még a klinikai képalkotás sem immunis - bizonyíték van arra, hogy csalók generatív mesterséges intelligenciát használnak orvosi képek utánzására mint a röntgen vagy a szkennelés[3]. A következmények túlmutatnak a pénzügyi veszteségeken: ha a hamisított orvosi feljegyzések bekerülnek a betegek aktáiba, téves diagnózishoz vagy helytelen kezeléshez vezethetnek. Így, A mesterséges intelligenciával írt egészségügyi dokumentumok komoly integritási és biztonsági kockázatot jelentenek.

Hamisított receptek és gyógyszertári csalás

A vényköteles csalás a mesterséges intelligenciával belépett a digitális korba. Hamisított receptek - hagyományosan lopott vénytáblákkal vagy kezdetleges szerkesztéssel készültek - mostantól automatikusan generálhatók, valósághű részletekkel és orvosi aláírásokkal. Az AI képgenerátorok vagy sablonok segítségével triviális módon létrehozhatók hitelesnek tűnő e-receptnyomtatványok vagy gyógyszertári megrendelőlapok. Még alattomosabban, a bűnözők hangklónozás hogy a gyógyszerészekkel folytatott hívások során orvosnak adják ki magukat. Az egyik jelentett trend szerint a csalók betörtek az orvosi nyilvántartásokba, hogy ellopják az orvosok DEA regisztrációs számait, majd ezeket a hitelesítő adatokat arra használták, hogy elektronikus recepteket küldjenek ellenőrzött anyagokra.[28]. Voltak olyan esetek, amikor AI voice deepfakes használt engedélyezéséhez újratöltések - egy gyógyszerész kap egy hívást, amely pontosan úgy hangzik, mintha egy ismert orvos erősítené meg a receptet, de valójában egy mesterséges intelligencia által generált hangról van szó. Ennek eredményeképpen az ellenőrzött gyógyszerek (például opioidok vagy stimulánsok) illegálisan megszerezhetők és eltéríthetők. A hamisított receptekkel kapcsolatos csalás nemcsak a biztosítóknak és a gyógyszertáraknak okoz anyagi veszteséget; veszélyezteti a betegeket is, akik téves gyógyszereket kaphatnak a nyilvántartásukban. Ha például egy csaló egy betegnek adja ki magát, hogy opioidrecepteket szerezzen, a a valódi beteg orvosi aktáját frissíthetik olyan gyógyszerekkel, amelyeket soha nem szedtek, ami veszélyes kölcsönhatásokhoz vezethet, vagy kábítószer-keresőként jelölheti meg őket.[29]. A kiberbűnözés és a mesterséges intelligencia kihasználásának ez a keveréke a szabályozó hatóságok figyelmeztetéseit váltotta ki. Az egészségügyi szervezeteknek mostantól meg kell győződniük arról, hogy minden recept - különösen a nagy kockázatú gyógyszerek - jogszerű és valóban az engedélyezett szolgáltatótól származik, nem egy deepfake vagy adatszegés.

Deepfake orvos-beteg megszemélyesítések

Talán a leginkább szembetűnő fejlemény a deepfakes az egészségügyi személyzet vagy a betegek megszemélyesítésére. A telemedicinális és ügyfélszolgálati környezetben a csalók mesterséges intelligencia által generált videót és hangot használnak, hogy megtévesszék a másik oldalon lévő embereket. A bűnözők például deepfake videók a betegekről a távgyógyászati konzultációkra, az orvosok becsapása, hogy "kezelést" vagy beutalót adjanak, amelyet aztán a biztosítónak számláznak ki.[30][31]. Ezzel szemben egy csaló egy orvos képmását is meghamisíthatja - egy jó hírű orvos arcát és hangját használva - egy videóhívásban, hogy meggyőzni a beteget, hogy fizessen egy csalárd szolgáltatásért vagy adja ki személyes adatait. Az egészségügyi informatikai szakértők arra figyelmeztetnek, hogy a távegészségügy érett célponttá vált: virtuális találkozót lehet szervezni egy hamis betegazonossággal, majd egy AI avatárral videóra venni, hogy hamis színleléssel recepteket vagy orvosi tanácsokat kapjon.[31][32]. A telemedicinán túl, a mély hamisítványok telítik a közösségi médiát a következő formában "orvos" videók, amelyek csodaszereket reklámoznak. 2024-ben a szakértők megfigyelték, hogy a híres orvosok mélyhamisított videói "tényleg beindult," az idősebb közönséget célozza meg hamis egészségügyi tippekkel és átveréses termékekkel.[33][34]. Az Egyesült Királyságban és Franciaországban megbízható tévés orvosok képmását klónozták, hogy hamis cukorbetegség-gyógymódokat és vérnyomáscsökkentőket támogassanak.[35][36]. A nézők akár fele nem tudta megmondani, hogy ezek a deepfake orvosi videók hamisak voltak[37]. Az igazságnak ez az eróziója kézzelfogható költségekkel jár: a betegek követhetik a hamis orvosvideóból származó káros tanácsokat, vagy a csalók olyan konzultációkat számlázhatnak a biztosítóknak, amelyek soha nem történtek meg, csak egy hamisított felvételen. Mindent egybevetve, A mesterséges intelligencia által vezérelt megszemélyesítés aláássa az egészségügyi interakciókba vetett alapvető bizalmat - ha nem bízhatunk abban, hogy a képernyőn vagy telefonon megjelenő személy az, akinek mondja magát, az egész rendszer veszélyben van.

Hatás és méret: 2025-ös csalás számokkal

A mesterséges intelligencia által vezérelt csalás már nem marginális kérdés - ma már jelentős pénzügyi veszteséget és biztonsági fenyegetést jelent a globális egészségügyi rendszerekben. Tekintsük meg a következő friss statisztikákat és eseteket, amelyek a a probléma nagyságrendje:

- Éves veszteségek: Az egészségügyi csalás az USA-nak becslések szerint $68 milliárd vagy több milliárd évente[25], nagyjából 3-10% az összes egészségügyi kiadásból[38]. Globálisan a csalás körülbelül 6% egészségügyi kiadások[39] - ami megdöbbentő adat, tekintve, hogy az egészségügyi kiadások világszerte több trillió dollárt tesznek ki. Ezek a veszteségek végső soron magasabb biztosítási díjakat, megnövekedett kórházi költségeket és a betegellátásra fordítható források csökkenését jelentik.

- Csalás kiugrása 2023-2025-ben: A generatív mesterséges intelligencia megjelenése a csalási kísérletek robbanásszerű növekedéséhez vezetett. A Deepfake-hez kapcsolódó csalási incidensek száma megnőtt 2022 és 2023 között megtízszereződik[4]. 2024-ben a bejelentett deepfake incidensek száma 150-re ugrott (257% emelkedés).[40], és 2025 jóval meghaladja ezt (580 incidens csak 2025 első felében, ami majdnem 4×ese a 2024-es összesített értéknek).[7]. A csalási szakértők megjegyzik, hogy 46% találkozott szintetikus személyazonossági csalással, 37% hanghamisítással és 29% videohamisítással. vizsgálataik során[8] - kiemelve, hogy ezek a mesterséges intelligencia technikák mennyire elterjedtek.

- Rekordot jelentő leütések: A bűnüldöző szervek egyre nagyobb szigorításokkal reagálnak. 2025 júniusában az amerikai igazságügyi minisztérium bejelentette a a történelem legnagyobb egészségügyi csalási akciója324 személyt vádoltak meg, és feltárták $14,6 milliárd csalárd követelésekben[1][13]. A rendszerek közé tartoztak a távgyógyászati konzultációs csalások, a genetikai teszteléssel kapcsolatos csalások és a tartós orvosi berendezésekkel kapcsolatos tömeges csalások.[13]. Ennek részeként a Medicare felfüggesztett $4 milliárdnyi függőben lévő kifizetést gyanúsnak ítélték[41], megelőzve ezeket a veszteségeket. Az egyik sarkalatos ügy ("Operation Gold Rush") egy nemzetközi hálózatot leplezett le, amely lopott személyazonosságokat használt fel arra, hogy beadjon $10,6 milliárd hamis orvosi ellátmányokra vonatkozó hamis igénylés[42] - ami azt bizonyítja, hogy a bűnözők milyen messzire képesek elmenni, ha feltört adatokkal és automatizálással vannak felfegyverkezve.

- Biztosítói hatások: A biztosítók világszerte látják a a mesterséges intelligenciával kapcsolatos csalások számának növekedése. Az Egyesült Királyságban a biztosítók arról számolnak be, hogy egyre gyakrabban használnak hamisítványokat a kárigényekben (gyakran "alacsony érintettségű" kárigényeket, hogy elkerüljék a felderítést).[27]. Egy vezető viszontbiztosítási cég arra figyelmeztet, hogy a hamisított orvosi feljegyzések és a mélyen hamisított egészségügyi feltételek aláássák a kockázatvállalást, és növelhetik az élet- és egészségbiztosítási veszteségeket.[43]. A Deloitte 2024-es elemzése szerint 2027-re, a generatív AI-alapú csalás $40 milliárd éves veszteséget okozhat az Egyesült Államokban. (a 2023-as $12,3 milliárdról)[8]. Ez a pálya jelentős csapást jelent a biztosítók alsó soraiban, ha nem fogadnak el erőteljes ellenintézkedéseket.

- Beteg áldozatok: A betegek és a lakosság is pénzt veszít ezekkel az átverésekkel. Különösen az idősebb felnőttek kerültek az AI hangalapú csalások ("unoka bajban" telefonhívások) és a deepfake egészségügyi csalások célkeresztjébe. 2023-ban az amerikai idősek arról számoltak be. $3,4 milliárd a csalásból eredő veszteségek, ami 11%-tel több, mint egy évvel korábban.[44][45] - ennek egy részét a mesterséges intelligenciával kiegészített rendszerek hajtják. És a pénzbeli költségeken túlmenően, van egy emberi veszteség: a mesterséges intelligencián keresztül hirdetett hamis orvosi tanácsok és hamis kezelések fizikai károkat okozhatnak, vagy a törvényes egészségügyi tanácsadásba vetett bizalom elvesztéséhez vezethetnek.

Összességében 2025 világossá tette, hogy Az AI felturbózza a hagyományos egészségügyi csalást. A korábban kisebb, opportunista rendszerek mára kontinenseket átfogó, iparosított műveletekké váltak. A nagy mennyiségű (gyakran a jogsértésekből származó) adat és a mesterséges intelligencia kombinációja azt jelenti, hogy az átverések ijesztő gyorsasággal és hihetőséggel valósulhatnak meg. A globális veszteségek több tízmilliárdos nagyságrendűek, és egyre nőnek., és minden érdekelt fél - a kórházaktól a biztosítókon át a betegekig - veszélyben van. A következő fejezet azt tárgyalja, hogy az iparág hogyan tud visszavágni hasonlóan fejlett technológiák és stratégiák segítségével.

Védekezés a mesterséges intelligencia által vezérelt csalás ellen: Stratégiák és megoldások

A mesterséges intelligenciával támogatott egészségügyi csalás elleni küzdelemhez hasonlóan fejlett védelmi eszközök arzenáljára van szükség. Az egészségügyi vezetőknek, a kiberbiztonsági csapatoknak, a megfelelőségi tisztviselőknek és a biztosítóknak össze kell hangolódniuk, hogy csalás elleni intézkedések beágyazása minden sebezhető ponton - a betegfelvételtől a kárkifizetésig. Az alábbiakban bemutatjuk a legfontosabb stratégiákat és technikai megoldásokat a mesterséges intelligencia által vezérelt csalás elleni küzdelemhez:

- AI tartalomérzékelő eszközök: Ahogy a bűnözők a mesterséges intelligenciát használják a tartalom előállítására, úgy a szervezetek is használhatják a mesterséges intelligenciát a tartalom felderítésére. Fejlett Mesterséges intelligencia által írt tartalomdetektorok (például a TruthScan csomagja) elemzi a szöveget, képeket, hangot és videót, hogy azonosítsa a mesterséges intelligencia generálásának árulkodó jeleit. A TruthScan platformja például gépi tanulást alkalmaz a statisztikai minták és nyelvi furcsaságok felismerésére, amelyek az AI által generált szövegre utalnak, több mint 99% pontosság[46][47]. Ezek az eszközök integrálhatók a követeléskezelő rendszerekbe vagy az elektronikus egészségügyi nyilvántartásokba, hogy automatikusan jelezzék a következő adatokat gyanús dokumentumok - pl. egy orvosi jelentés, amelyet valószínűleg a ChatGPT írt - kézi felülvizsgálatra. Hasonlóképpen, a mesterséges intelligencia képelemzés képes felismerni a manipulált orvosi felvételeket vagy hamis személyi igazolványokat, és a deepfake detektáló algoritmusok képesek elemezni a videókat a szintézis jeleiért (pixelekben lévő műalkotások, az arcmozgások furcsa időzítése stb.).[48][49]. A multimodális AI-érzékelők telepítésével az egészségügyi szervezetek a következőket érhetik el az AI által hamisított tartalmak nagy részét valós időben kiszűrni. mielőtt kárt okozna.

- Orvosi feljegyzések és dokumentumok ellenőrzése: Az egészségügyi szolgáltatók speciális megoldásokhoz fordulnak, hogy ellenőrzi a nyilvántartások és kárigénylési dokumentumok hitelességét. Ez magában foglalja a törvényes rekordok tördelését és digitális aláírását, valamint az ismert jó dokumentumsablonok adatbázisainak használatát a beérkezett beadványokkal való összehasonlításhoz. A mesterséges intelligencia által vezérelt hitelesítési szolgáltatások (például a TruthScan Orvosi dokumentumok hitelesítése megoldás) azonnal elemezni tudja egy dokumentum tartalmát és metaadatait, hogy megállapítsa, gépi úton készült-e vagy módosították-e azt.[50][51]. Olyan következetlenségeket keresnek, amelyeket az ember esetleg nem vesz észre - például finom formázási anomáliákat vagy olyan metaadatokat, amelyek arra utalnak, hogy a kép mesterséges intelligenciával készült. A betegnyilvántartások és biztosítási igények valós idejű nyomon követése az anomáliák keresése szintén alapvető fontosságú[52]. Az új bejegyzések (laboreredmények, orvosi feljegyzések, kárigénylések mellékletei) folyamatos szkennelésével ezek a rendszerek képesek elkapni a hamis rekordokat. a előtt csalárd kifizetésekhez vagy klinikai hibákhoz vezetnek. Egyes biztosítók olyan szabályokat vezettek be, amelyek szerint minden olyan igénylési dokumentációt, amelyet mesterséges intelligencia által generáltként azonosítottak, automatikusan csalásvizsgálatra vonnak. A cél annak biztosítása, hogy a munkafolyamatba bekerülő minden egyes orvosi feljegyzés vagy igénylés megbízható és változatlan marad.

- Személyazonosság igazolása és érvényesítés: A személyazonosság ellenőrzésének megerősítése kritikus fontosságú a szintetikus személyazonosító igazolványok korában. Az egészségügyi intézményeknek érvényre kell juttatniuk szigorú személyazonossági igazolás az új betegek, szolgáltatók és beszállítók számára. Ez magában foglalhat többfaktoros hitelesítést, biometrikus ellenőrzéseket (például arcfelismerést vagy ujjlenyomatot a regisztráció során), valamint olyan személyazonosság-ellenőrző szolgáltatások használatát, amelyek a mesterséges intelligenciát használják fel a következők felismerésére. hamis személyi igazolványok vagy nem megfelelő személyes adatok. Az arcfelismerés például kombinálható az életszerűségi tesztekkel, hogy megakadályozzák, hogy egy mesterséges intelligencia által generált arc egy fényképen keresztül valódi betegnek adhassa ki magát. Az algoritmusok a hátsó végén keresztellenőrzik a beteg adatait (cím, telefon, e-mail, közösségi média jelenlét), hogy kiszűrjék a "vékony" személyazonosságokat, amelyeknek nincs normális előzménye - ez a szintetikus azonosítók ismert árulója.[53]. A pénzintézetek nagyszerűen használják az ilyen mesterséges intelligencia által vezérelt háttérellenőrzéseket.[54], és az egészségügy is megteheti ugyanezt: pl. megjelölheti az új Medicare-igénylőt, ha az idei év előtt nem rendelkezik digitális lábnyommal. Szolgáltatói identitások hitelesítése ugyanilyen fontos - annak biztosítása, hogy a távgyógyászati videón szereplő orvos valóban rendelkezik engedéllyel, és valóban az, akinek mondja magát, esetleg digitális tanúsítványok vagy vízjeles videók kibocsátásával, amelyeket a hamisítványok nehezen tudnak utánozni. A gyógyszertárakban a személyzetnek a szokatlan receptkérelmeket a szolgáltatókhoz történő közvetlen visszahívás útján kétszeresen ellenőriznie kell, és kódkifejezéseket vagy ellenőrző kérdéseket kell használnia a potenciális AI hanghamisítók legyőzésére.

- Integrált csalásfelismerés munkafolyamatokban: A rendszer valódi védelme érdekében a csalások felderítése nem lehet önálló lépés, hanem a következőkre kell törekedni minden munkafolyamatba beleszövődik egy egészségügyi szervezetben.

A gyakorlatban ez azt jelenti, hogy a kórházak és a biztosítók API-integrációkat alkalmaznak a csalásfelderítő szolgáltatások kritikus pontokon történő hívására. Ha például egy szolgáltató csatolt dokumentumokat tartalmazó igényt nyújt be, egy mesterséges intelligencia szolgáltatás másodpercek alatt automatikusan kiértékelheti a mellékletek hitelességét. Ha egy távgyógyászati időpontot kezdeményeznek, a platform a háttérben lefuttathatja a passzív hangelemzést, hogy megbizonyosodjon arról, hogy a hívó nem szintetizált hangot használ. Folyamatos ellenőrzés szintén kulcsfontosságú: a modern csalási platformok olyan műszerfalakat kínálnak, amelyek nyomon követik a csalásra utaló jeleket az egész szervezetben (sikertelen érvényesítések, egy bizonyos klinika követeléseinek gyakori megjelölése stb.), hogy azonosítani lehessen a mintákat, például egy szervezett csalási hálózatot, amely több követelésen keresztül működik. Azáltal, hogy az egészségügyi csalást inkább a kiberfenyegetésekhez hasonlóan kezeljük - a 24/7 felügyelet, anomáliák észlelése és gyors reagálás az incidensekre - a szervezetek még azelőtt elkaphatják a problémákat, mielőtt azok elfajulnának[55].

- AI for Fraud Analytics and Pattern Recognition: Az egészségügyi adatok mennyisége olyan nagy, hogy a mesterséges intelligencia nélkülözhetetlen a csalási minták megtalálásában, amelyeket az emberek nem vesznek észre. A gépi tanulási modelleket a korábbi csalási eseteken lehet betanítani az új csalások felderítésére (például a hasonló, szokatlan ICD-kódokat tartalmazó követelések csoportosítása, vagy annak azonosítása, ha egy orvos számlázása nagymértékben eltér a társaitól). A biztosítók már használják a prediktív analitikát a következőkre pontozza a követeléseket csaláskockázat szempontjából valós időben. Az újonnan megjelenő technikák, például a gráf neurális hálózatok képesek feltérképezni a betegek, szolgáltatók, diagnózisok és követelések közötti kapcsolatokat, hogy kiszűrjék a valószínűtlen kapcsolatokat (például ugyanazt a készülék sorozatszámot különböző államokból származó követelésekben használták). A TruthScan biztosítási csalás elleni csomagja például a következőket tartalmazza követelések mintafelismerése és prediktív modellezés a szervezett csalási hálózatok és atipikus minták felderítésére, mielőtt a veszteségek felhalmozódnának.[56][57]. A 2025 DOJ Fusion Center példázta ezt a megközelítést - a Medicare és a magánbiztosítók adatainak összesítése a gyanús tevékenységek klasztereinek proaktív megtalálása érdekében.[58]. Az egészségügyi szervezeteknek hasonlóképpen adatok és AI modellek megosztása konzorciumokban, hogy kiszélesítsék a csalásjelek körét, amelyeket mindegyikük fel tud fedezni. Minél több adat (az adatvédelmi korlátokon belül) táplálja ezeket a modelleket, annál jobban meg tudják különböztetni a normális és a csalárd viselkedést.

- Személyzeti képzés és folyamatellenőrzés: A technológia kulcsfontosságú, de az emberi tudatosság továbbra is erős védelmet jelent. Az egészségügyi személyzetet és a rendszergazdákat ki kell képezni a mesterséges intelligenciával támogatott csalási taktikákról - például tudni kell, hogy egy a tökéletesen megírt e-mail egy vezérigazgatótól lehet, hogy mesterséges intelligencia által létrehozott adathalászat, vagy hogy a videóhívók személyazonosságának ellenőrzése ha valami "nem stimmel" (a furcsa szemmozgások vagy a hangkésés utalhat deepfake-re). Rendszeres gyakorlatok és tippek (hasonlóan az adathalász-tudatossági tréningekhez) alkalmazhatók az új fenyegetések, például a mélyhamisított telefonos csalások esetében. Az egyszerű folyamatellenőrzések további biztonsági rétegeket jelentenek: a nagy vagy szokatlan fizetési kérelmek esetében visszahívás vagy másodlagos ellenőrzés megkövetelése, az érzékeny információkhoz ismert, biztonságos kommunikációs csatornák használata, valamint egy incidensreakcióterv fenntartása kifejezetten a mesterséges intelligencia által közvetített csalás gyanújára. Fontos, hogy a szervezeteknek olyan kultúrát kell kialakítaniuk, amelyben az alkalmazottak felhatalmazást éreznek arra, hogy megkérdőjelezzék az anomáliákat, még akkor is, ha egy "orvos" videón kér egy furcsa kérést. Sok deepfake átverés a bizalom és a tekintély kihasználásával sikeres; egy éber munkaerő, amely ismeri ezeket a trükköket, korán megállíthatja az incidenseket. Ahogy egy szakértő megjegyezte, a mély hamisítványokkal való szembenézés ugyanolyan rutinszerűvé válhat, mint az adathalász e-mailek kiszűrése - a kiberbiztonsági higiénia szokásos részévé.[32][59].

- Szakosított szolgáltatások kihasználása: Tekintettel a mesterséges intelligenciával kapcsolatos fenyegetések gyors fejlődésére, sok egészségügyi szervezet speciális csalásmegelőzési szolgáltatókkal működik együtt. Az olyan szolgáltatások, mint a TruthScan az egészségügyben az orvosi felhasználási esetekre szabott végponttól végpontig terjedő megoldásokat kínálnak, többek között: az elektronikus orvosi nyilvántartás (EMR) integritásának valós idejű nyomon követése, betegdokumentumok ellenőrzése a mesterséges intelligencia manipulációja ellen, a távegészségügyben alkalmazott mélyreható hamisítás-felismerés és a megfelelőségi jelentés (pl. ellenőrzési nyomvonalak, amelyek bizonyítják a szabályozók számára a csalások felderítésében tanúsított kellő gondosságot).[60][51]. Az ilyen platformok gyakran nyújtanak API integráció a meglévő rendszerekbe való zökkenőmentes illeszkedés érdekében, és az egészségügyi előírásoknak (HIPAA, GDPR) megfelelően készültek.[61][62]. A vállalati szintű eszközök használatával még a kisebb klinikák vagy regionális biztosítók is hozzáférhetnek a fejlett AI-felderítési képességekhez anélkül, hogy azokat házon belül fejlesztenék. Emellett a biztosítóknak és a szolgáltatóknak figyelniük kell a szabályozások és az iparági szabványok frissítéseit - például a mélyhamisítással kapcsolatos csalás elleni új törvényeket (egyes joghatóságok már kifejezetten tiltják az orvosi mélyhamisítást, és az USA kiterjeszti a személyazonosság-lopási törvényeket az AI megszemélyesítésére is...).[63]). Az ilyen szabványokhoz való igazodás és a legmodernebb eszközök alkalmazása nemcsak a csalási veszteségeket csökkenti, hanem a partnerek, az ellenőrök és a betegek számára is erős biztonsági pozíciót mutat.

Következtetés és kilátások

A 2025-ös év bebizonyította, hogy a a szellem kiszabadult a palackból - a generatív mesterséges intelligencia és az automatizálás összefonódik az egészségügyi csalással. A jövőben a csalók valószínűleg továbbra is folytatják az innovációt: láthatunk majd olyan AI-modelleket, amelyek megtanulják utánozni az orvosok bizonyos írásmódját, vagy olyan mély hamisítványokat, amelyek valós időben reagálnak a kihívást jelentő kérdésekre. A harc egy folyamatos fegyverkezési verseny lesz. Az egészségügyi ágazat azonban ugyanilyen erőteljesen reagál, és befektet a mesterséges intelligencia alapú védelembe és a szigorúbb biztonsági munkafolyamatokba. Azáltal, hogy kombinálják élvonalbeli felderítési technológia, szigorú ellenőrzési folyamatok, iparágak közötti adatmegosztás és az alkalmazottak ébersége., az egészségügyi szervezetek jelentősen mérsékelhetik a mesterséges intelligencia által elősegített csalás veszélyét.

Fontos, hogy ez nem csak informatikai kérdés - ez egy irányítási és bizalmi kérdés. Az igazgatótanácsoknak és az egészségügyi vezetőknek fel kell ismerniük, hogy az AI-csalás stratégiai kockázatot jelent a pénzügyekre és a betegek bizalmára nézve, és rendszeres figyelmet és erőforrásokat igényel. A megfelelőségi csapatoknak frissíteniük kell a csalási kockázatértékeléseket, hogy azokban az AI szempontok is szerepeljenek, a biztosítók pedig átgondolhatják a biztosítási feltételezéseket, ha tudják, hogy a követelések bizonyos százaléka AI-alapú csalás lehet. A másik oldalról viszont az AI etikus kihasználása az egészségügyben (klinikai döntéstámogatás, számlázás hatékonysága stb. céljából) továbbra is nagy előnyökkel jár majd - mindaddig, amíg erős biztosítékok vannak érvényben a visszaélések megelőzésére.

Összefoglalva, a generatív AI megváltoztatta a csalás elleni játékot az egészségügyben, de tudatossággal és fejlett ellenintézkedésekkel nem kell, hogy túlterhelje a rendszert. Azok a szervezetek lesznek sikeresek, amelyek folyamatosan tájékozódnak az újonnan megjelenő fenyegetésekről, gyorsan alkalmazkodnak a mesterséges intelligencia által vezérelt védekezéssel, és az "alapértelmezett bizalom" helyett az "ellenőrizd és bízz" kultúráját támogatják. Ezáltal az egészségügy biztonságosan kihasználhatja az AI pozitívumait, miközben semlegesítheti a visszaéléseket, és a digitális korban megvédheti mind az eredményt, mind a betegek jólétét.

Források: A fent említett legújabb ipari jelentések és esetek, köztük a Pymnts (2025. július).[2][3], Swiss Re Institute (2025. június)[27], Federal Reserve Bank of Boston (2025. április)[19], BMJ (2024)[37], és a TruthScan megoldási ismertetők (2025)[51][64]többek között. Minden adat és idézet a 2024-2025-ben rendelkezésre álló legfrissebb adatokat tükrözi, szemléltetve az AI által vezérelt csalás jelenlegi helyzetét az egészségügyben és a leküzdésére adott válaszokat.

[1] [2] [3] [9] [10] [11] [12] [13] [14] [15] [41] [42] [55] [58] DOJ hitelezi az AI eszközöket a történelmi egészségügyi csalás elleni küzdelemben

[4] [5] [6] [7] [16] [40] [44] [45] Deepfake statisztikák és trendek 2025 | Key Data & Insights - Keepnet

https://keepnetlabs.com/blog/deepfake-statistics-and-trends

[8] Deepfakes és a megismerés válsága | UNESCO

https://www.unesco.org/en/articles/deepfakes-and-crisis-knowing

[17] [18] [19] [20] [21] [22] [23] [24] [53] [54] A mesterséges intelligencia generációja növeli a szintetikus személyazonossággal kapcsolatos csalás veszélyét - Federal Reserve Bank of Boston

[25] [26] [56] [57] [62] [64] Egészség- és életbiztosítási AI csalásfelismerés | TruthScan

https://truthscan.com/solutions/health-life-commercial-insurance-fraud-detection-solution

[27] [43] Hogyan erősítik a mély hamisítványok, a dezinformáció és az AI a biztosítási csalást | Swiss Re

[28] DEA figyelmeztet az elektronikus vényköteles csalásra - Pharmacy Practice News

[29] [39] Egészségügyi kiberbiztonság és csalás: A Deep Dive Into Today's Greatest Risks and Defenses | CrossClassify

https://www.crossclassify.com/resources/articles/healthcare-cybersecurity-and-fraud/

[30] [31] [32] [59] A Deepfake telemedicinális csalások fejlődő fenyegetése, Mike Ruggio

https://insights.taylorduma.com/post/102jkzn/the-evolving-threat-of-deepfake-telemedicine-scams

[33] [34] Szakértők figyelmeztetnek a csalók segítségével "Deepfakes" Híres orvosok a szociális médiában

[35] [36] [37] Megbízható TV orvosok "deepfaked", hogy támogassák az egészségügyi csalások a szociális médiában - BMJ Group

https://bmjgroup.com/trusted-tv-doctors-deepfaked-to-promote-health-scams-on-social-media/

[38] [PDF] a kutatás jelenlegi állása Ajit Appari és M. Eric Johnson

http://mba.tuck.dartmouth.edu/digital/Research/ResearchProjects/AJIJIEM.pdf

[46] [47] [48] [49] TruthScan - Vállalati AI felderítés és tartalombiztonság

[50] [51] [52] [60] [61] AI Medical Record Fraud Detection | Healthcare CRO megoldások | TruthScan

https://truthscan.com/solutions/healthcare-cro-fraud-detection

[63] Mennyire veszélyesek a Deepfakes és más AI-alapú csalások?