Átfogó útmutató a vállalati AI hangalapú csalás megértéséhez, felderítéséhez és megelőzéséhez

Az $25 millió hanghívás, amely soha nem történt meg

2024 februárjában egy hongkongi multinacionális vállalat pénzügyi munkatársa videóhívást kapott a pénzügyi igazgatójától.

A hang a másik végén összetéveszthetetlen volt; minden hanglejtést, minden szünetet és még az enyhe akcentust is azonnal felismerték.

Sürgősen kérte, hogy dolgozzon fel 15 átutalást, összesen $25 millió forint értékben, egy bizalmas akvizíció véglegesítése érdekében.

Soha többé ne aggódjon az AI-csalások miatt. TruthScan Segíthet:

- AI generált érzékelése képek, szöveg, hang és videó.

- Kerülje a jelentős mesterséges intelligencia által vezérelt csalás.

- Védje a leg érzékeny vállalati eszközök.

A pénzügyi igazgató soha nem tette meg ezt a hívást. Teljesen mesterséges intelligencia generálta.

Ez nem egyedi eset volt. A pénzintézeteknél meredeken emelkedik a deepfake csalások száma.

Az elmúlt három év során az esetek száma 2137%-tel ugrott meg, és az ágazatban az összes csalási kísérlet 42,5%-je a mesterséges intelligencia számlájára írható.

Még az AI hangalapú csalások térnyerése ellenére is az üzleti vezetők több mint fele elismeri, hogy alkalmazottaikat nem képezték ki a deepfake támadások felismerésére vagy az azokra való reagálásra; a vállalatok közel 80%-je nem rendelkezik hivatalos protokollokkal az ilyen incidensek kezelésére.

Hogyan működik a mesterséges intelligencia hangklónozása és miért jelent fenyegetést

A modern AI hangszintézishez meglepően kevés adatra van szükség. Néhány másodpercnyi hanganyagból akár 85% pontossággal klónozható egy hang.

A folyamat három fő lépésből áll:

- Adatgyűjtés: A csalók nyilvános forrásokból, például konferenciahívásokból, podcast-interjúkból, közösségi médiaklipekből vagy akár LinkedIn-videóbejegyzésekből gyűjtenek hangmintákat.

- Modellképzés: A mesterséges intelligencia elemzi az olyan énekjellemzőket, mint a hangmagasság, a hangszín, az akcentus, a tempó és a légzésminták.

- Generáció: A rendszer olyan szintetikus beszédet hoz létre, amely elég meggyőző ahhoz, hogy még a közeli kollégákat is megtévessze.

A hozzáférhetőségi probléma

Ami még veszélyesebbé teszi ezt a fenyegetést, az a demokratizálódás. A csalóknak már nincs szükségük hollywoodi szintű erőforrásokra.

Mindössze egy hozzáférhető szoftverre van szükség ahhoz, hogy egy hangot egy rövid közösségi médiaklipből klónozzunk; a nyílt forráskódú eszközök és a felhőalapú mesterséges intelligencia-szolgáltatások bárki számára elérhetővé tették a hangklónozást, aki alapvető technikai ismeretekkel rendelkezik.

Miért a vezetők a csalás legfőbb célpontjai?

A vezetők a kockázati tényezők veszélyes keverékével szembesülnek.

A közösségi médiában való nyilvános megjelenésük miatt a hangminták könnyen megtalálhatók, és tekintélyük gyakran arra készteti a munkatársakat, hogy gyorsan reagáljanak a sürgős kérésekre.

Átlagosan minden negyedik vezető csak korlátozottan érti a deepfake technológiát.

A jelenlegi statisztikák aggasztó képet festenek

Egy 2024 Deloitte felmérés, a vezetők 25,9%-je mondta, hogy szervezete az elmúlt évben legalább egy pénzügyi vagy számviteli adatokat célzó deepfake incidenssel szembesült, és a válaszadók fele úgy vélte, hogy az ilyen támadások száma a következő 12 hónapban növekedni fog.

A legaggasztóbb: a szervezeteknek csak 52%-je érzi magát biztosnak abban, hogy felismeri a vezérigazgatójáról készült hamisítványt.

Hogyan lehet kiszúrni az AI Voice csalásokat

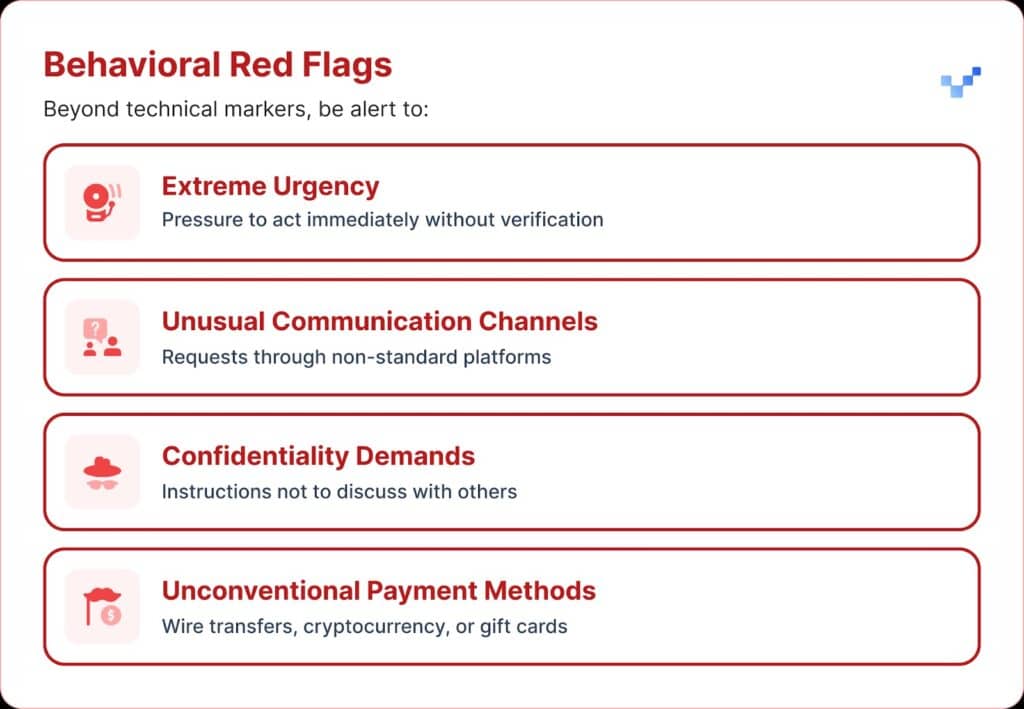

Ha gyanús hangüzenetet kap, van néhány figyelmeztető jel, amire figyelnie kell.

A mesterséges intelligencia hangalapú csalások gyakran monoton vagy lapos hangon szólalnak meg. Szokatlan tempót is észrevehetsz, furcsa szünetekkel vagy természetellenes ritmussal.

A hang szintén hordozhat gyenge elektronikus zümmögést vagy visszhangot, különösen hosszabb hívások során.

És sok esetben a hang korlátozott mondatokat ismételget, amelyek megírtnak vagy begyakoroltnak tűnnek.

Pénzügyi hatás és a tényleges költségek

A legtöbb szervezet átlagosan $450 000 körüli veszteséget szenvedett el, de a pénzügyi szolgáltatások ágazatában a veszteségek $603 000 fölé emelkedtek.

A legsúlyosabb esetekben pedig 10-ből 1 szervezet $1 millió feletti veszteségről számolt be.

Ez a tendencia gyorsan nőtt. Korábbi, 2022-es kutatások szerint a személyazonossággal kapcsolatos csalás átlagos pénzügyi terhe $230 000 körül volt, ami a jelenlegi összeg majdnem fele.

Előrejelzett jövőbeli veszteségek

A Deloitte pénzügyi szolgáltatásokkal foglalkozó központja szerint az Egyesült Államokban a mesterséges intelligencia csalások miatt elveszett pénzösszegek a 2023-as $12,3 milliárdról 2027-re $40 milliárdra emelkedhetnek. Ez évente körülbelül 32% növekedésnek felel meg.

Regionális sebezhetőség

Észak-Amerikában 1740% növekedett a deepfake csalások száma.

Ez a jelentős regionális növekedés arra utal, hogy Észak-Amerika lehet a deepfake csalók elsődleges célpontja, valószínűleg a nagy digitális gazdaság és az online szolgáltatások széles körű használata miatt.

Stratégiai megközelítések a végrehajtók védelmére

1. Ellenőrzési protokollok végrehajtása

A védelem megerősítésének egyik módja a "biztonságos szó" rendszer, azaz a kulcsszemélyzettel megosztott, előre egyeztetett hitelesítési mondatok használata.

A mesterséges intelligencia hangklónozását használó csaló nem fogja tudni a helyes válaszokat a személyes hitelesítési kérdésekre.

Egy másik biztosíték a többcsatornás ellenőrzés.

Minden szokatlan pénzügyi kérést külön kommunikációs csatornán keresztül kell megerősíteni, és soha nem szabad csak az eredeti kapcsolattartási módra hagyatkozni.

A vállalatoknak egyértelmű eszkalációs szabályokat is fel kell állítaniuk, várakozási időkkel és jóváhagyási lépésekkel a nagy pénzügyi tranzakciók esetében, függetlenül attól, hogy ki kéri azokat.

2. Figyeljen a digitális expozícióra

A védelem egy másik szintje a végrehajtó hang- és videóanyagok online elérhetőségének korlátozásával érhető el. Minél több mintát tudnak gyűjteni a csalók, annál meggyőzőbbé válnak a klónjaik.

Az is segít, ha a vezetők számára világos közösségi média irányelveket határoz meg, különösen a tiszta hanggal ellátott videók közzétételére vonatkozóan.

A konferenciák esetében pedig a szervezeteknek ügyelniük kell az olyan rögzített előadásokra vagy interjúkra, amelyek hosszú szakaszokon keresztül hangmintákat adnak ki.

3. Technikai megoldások alkalmazása

Ez az a pont, ahol a fejlett mesterséges intelligencia-érzékelési technológia kritikussá válik.

A szervezeteknek vállalati szintű hanghitelesítésre van szükségük és deepfake felismerés képességek, amelyek biztosítják:

- Valós idejű elemzés: Szintetikus hangok észlelése élő kommunikáció során

- Történelmi ellenőrzés: A rögzített hívások és üzenetek elemzése hitelesség szempontjából

- Integrációs képességek: Zökkenőmentes együttműködés a meglévő kommunikációs platformokkal

- Magas pontossági arányok: A hamis pozitív eredmények minimalizálása a kifinomult hamisítványok elkapása mellett

4. Átfogó képzési programok

A vezetői csapatoknak célzott képzésre van szükségük a mesterséges intelligencia hanggal kapcsolatos fenyegetésekről és az ellenőrzési eljárásokról.

Ugyanilyen fontos a munkavállalók tudatosságának növelése.

Mindenkinek, bármilyen szerepkörben, fel kell készülnie arra, hogy felismerje a potenciális mélyreható hamisítványokat, és megakadályozza a kiberfenyegetések bejutását a szervezetbe.

Rendszeres szimulációs gyakorlatok erősíthetik ezt a felkészültséget a hangalapú csalási kísérletek tesztelésével és a reagálási eljárások finomításával.

Fejlett AI hangfelismerő megoldások

A hagyományos védelmet a hálózati alapú fenyegetésekhez fejlesztették ki, nem pedig a mesterséges intelligencia által vezérelt emberi megszemélyesítéshez.

A fő okok, amiért a szabványos kiberbiztonsági eszközök nem képesek kezelni a hangalapú social engineeringet:

- Nincs malware-jelzés: A hanghívások nem váltják ki a hagyományos biztonsági rendszereket

- Emberi bizalmi tényező: Az emberek természetesen megbíznak abban, amit hallanak, különösen az ismerős hangokban.

- Az észlelési technológia hiányosságai: Az AI-alapú csalási kísérletek, köztük a mélyhamisítások számának növekedése ellenére a pénzintézeteknek csak 22%-a alkalmaz AI-alapú csalásmegelőző eszközöket.

A speciális hangérzékelés szükségessége

A modern hangalapú csalás modern felderítési képességeket igényel.

Vállalati szintű AI hangfelismerő rendszerek lehet:

- A vokális biomarkerek elemzése: A szintetikus beszéd finom ellentmondásainak felismerése

- Valós idejű feldolgozás: Azonnali riasztás a gyanús hívások során

- Folyamatos tanulás: Alkalmazkodás az új hangszintézis technikákhoz

- Integrációra kész: Meglévő kommunikációs infrastruktúrával való együttműködés

A hangalapú csalás elleni védekezést komolyan vevő szervezeteknek célzottan kifejlesztett mesterséges intelligencia-érzékelő technológiába kell befektetniük, amely képes megfelelni az őket fenyegető fenyegetések kifinomultságának.

A hangalapú csalás már itt van, és egyre fokozódik

2025 első negyedévében a deepfake csalások és személyazonossági lopások több mint $200 millió veszteséget okoztak.

Az AI-klónokkal történő hangalapú adathalászat 442% ugrásszerűen megnőtt, és naponta több mint 400 vállalkozást érnek el deepfake vezérigazgatói vagy pénzügyi igazgatói csalások.

Míg a vállalkozások 56%-je szerint nagyon magabiztosak a hamisítványok kiszűrésében, csak 6%-nek sikerült elkerülnie, hogy pénzügyi veszteséget szenvedjen tőlük.

Nem az számít, hogy az Ön szervezetét célba veszik-e, hanem az, hogy Ön készen áll-e erre.

A hangalapú csalás megváltoztatja a kiberbiztonság arculatát. A hagyományos védelem nem tud lépést tartani a mesterséges intelligencia által vezérelt megszemélyesítéssel.

Ahhoz, hogy védve maradjanak, a szervezeteknek jobb észlelési eszközökre, erős képzési programokra és egyértelmű ellenőrzési eljárásokra van szükségük.

A visszavágáshoz szükséges technológia már itt van. Az igazi kérdés az, hogy az első hangalapú csalási incidens előtt vagy után fogja-e használni.