Il y a encore quelques années, il fallait un studio professionnel et beaucoup de compétences techniques pour imiter la voix de quelqu'un.

Désormais, toute personne disposant d'une connexion internet et d'un peu de temps libre peut créer un clone numérique de la voix de n'importe qui en moins d'une minute.

Les outils nécessaires à ces attaques sont de moins en moins chers et de plus en plus accessibles à tous. Et comme de nombreuses personnes partagent leur vie sur les médias sociaux, il est très facile pour un escroc de trouver l'audio dont il a besoin.

Dans cet article, nous allons vous présenter quelques exemples concrets et notoires de fraude audio. Nous vous présenterons également une solution pour mettre un terme à ces menaces.

Principaux enseignements

- Les tentatives de fraude vocale par deepfake ont augmenté de plus de 2 137% ces dernières années, alimentées par le fait que l'IA moderne peut générer un clone de voix précis de 85% en utilisant seulement trois secondes d'audio source.

- Parmi les attaques réelles notoires, citons le vol du bureau d'études Arup en 2024, au cours duquel les escrocs ont utilisé une fausse vidéo et un faux son d'un directeur financier pour inciter un employé à transférer $25,6 millions d'euros.

- Au-delà du vol d'entreprise, les imitations de voix font courir de graves risques émotionnels aux familles par le biais d'escroqueries à l'enlèvement et peuvent contourner les systèmes de sécurité biométriques traditionnels utilisés par les banques et d'autres applications hautement sécurisées.

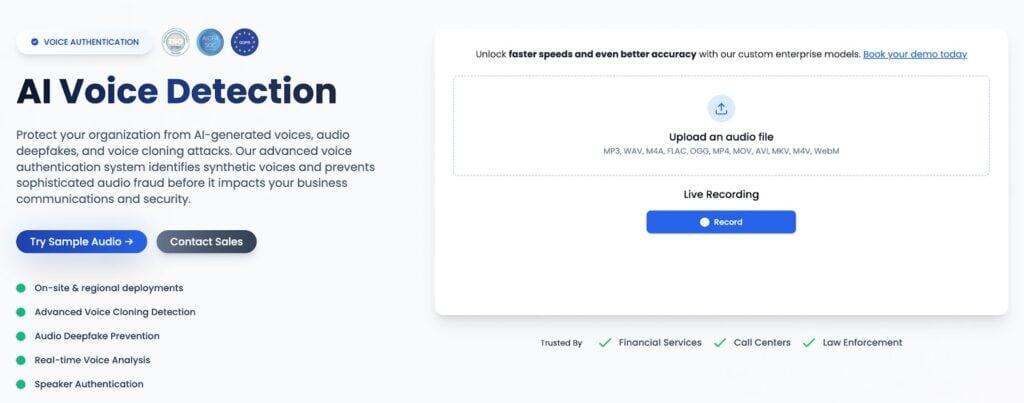

- Les organisations sont obligées de dépasser la seule vérification humaine en mettant en œuvre des protocoles d'approbation à plusieurs personnes pour les transferts importants et en déployant des détecteurs vocaux d'IA comme TruthScan pour analyser les empreintes acoustiques en temps réel.

- TruthScan sécurise les interactions des entreprises en identifiant les artefacts vocaux synthétiques provenant de plateformes telles que ElevenLabs et Murf avec une précision de plus de 99% dans tous les principaux formats audio et vidéo.

Qu'est-ce que les attaques Deepfake par la voix ?

Un deepfake vocal est une contrefaçon numérique de la voix d'une personne. L'attaquant utilise un logiciel capable d'analyser les moindres détails de la façon dont une personne parle à partir d'un enregistrement de sa voix.

Pour cloner la voix, le logiciel tente de repérer les caractéristiques de la voix. Le logiciel prend principalement en compte des éléments tels que la hauteur de la voix, le ton, la façon dont la personne respire entre les phrases, etc.

Une fois qu'il a appris ces schémas, l'attaquant peut lui faire dire n'importe quoi avec cette voix.

Ne vous inquiétez plus jamais de la fraude à l'IA. TruthScan peut vous aider :

- Détecter l'IA générée des images, du texte, de la voix et de la vidéo.

- Éviter la fraude majeure induite par l'IA.

- Protégez vos plus sensible les actifs de l'entreprise.

Ce qui est dangereux, c'est que les outils de création de voice deepfake sont facilement accessibles. Et la plupart d'entre eux ne nécessitent aucune installation. Ils sont disponibles en ligne sous la forme de sites web.

Il vous suffit de leur donner quelques dollars et de commencer à cloner des voix. Si vous creusez un peu plus, vous pourriez même trouver des outils qui vous permettent de cloner des voix gratuitement.

Cette nouvelle technologie, facilement accessible, a entraîné une forte augmentation de la fraude audio.

Les escrocs n'ont besoin que d'une infime partie de l'audio d'une personne, qu'ils peuvent obtenir à partir des médias sociaux ou d'un autre canal public, pour la cloner.

Ils peuvent ensuite utiliser la voix clonée pour se faire passer pour une personne dans des situations telles que des appels téléphoniques en direct, des réunions vidéo, des notes vocales, des annonces, etc.

Il ne s'agit pas d'hypothétiques cas d'utilisation d'attaques vocales de type "deepfake". Ces choses se sont déjà produites. Nous reviendrons plus loin sur certaines des attaques notoires de type "voice deepfake".

Risques potentiels liés aux attaques de type "Deepfake" (voix)

En entendant parler de voice deepfake, vous avez peut-être imaginé une vidéo amusante d'une célébrité disant des choses qu'elle n'a jamais dites.

Mais cette utilisation apparemment anodine de la voix clonée peut causer de graves dommages aux parties concernées. Parlons des risques.

Dévastation financière pour les entreprises

Un deepfake vocal peut ruiner à jamais la réputation d'une entreprise. Il a également le pouvoir de lui dérober d'importantes sommes d'argent en quelques minutes.

Comment cela se fait-il ? Les escrocs peuvent cloner la voix du patron d'une entreprise et l'utiliser pour appeler des employés et leur faire faire des choses qui ne sont pas censées être faites, comme transférer de l'argent sur un compte.

Ce n'est qu'un exemple parmi d'autres. Les possibilités sont infinies.

Contournement des systèmes de sécurité

Votre voix est un élément biométrique que personne d'autre ne devrait posséder. En effet, vous l'utilisez comme mot de passe pour vous connecter à de nombreuses applications, en particulier les applications bancaires.

Bien que ces applications soient dotées d'un système de vérification vocale automatisé intégré pour empêcher tout accès non autorisé, un bon clone vocal peut encore les tromper.

L'impact émotionnel sur les familles

Les cibles les plus faciles pour les fraudeurs audio sont sans doute les personnes âgées de la famille. Les parents et les grands-parents, par exemple.

Les escrocs peuvent appeler, par exemple, une mère et diffuser le son de sa fille appelant à l'aide, en disant qu'elle a été kidnappée.

Érosion de la confiance sur le lieu de travail

Les attaques par Voice Deepfake nuisent également à la confiance dans un lieu de travail sain.

Les employés devront vérifier à deux reprises les appels téléphoniques de leur supérieur pour s'assurer qu'il ne s'agit pas d'un escroc qui leur ordonne de faire des choses risquées avec une voix clonée.

Quelles sont donc vos options, si ce n'est de procéder à une double vérification manuelle ? Tous les risques que nous venons d'évoquer soulignent la nécessité d'une prévention automatisée des attaques par deepfake.

Heureusement, nous disposons aujourd'hui d'outils de détection des fausses voix par l'IA, dont TruthScan.

Prévenir la fraude et l'usurpation d'identité grâce à la solution de TruthScan Détecteur de voix AI.

Exemples réels d'attaques de type "Deepfake" par la voix

Grâce à l'IA, nous avons atteint un stade où nous ne pouvons plus nous fier à ce que nos yeux voient ou à ce que nos oreilles entendent. L'IA est désormais capable de créer des images et des vidéos réalistes. Il en va de même pour le son.

Vous avez peut-être déjà entendu des histoires de personnes tombées dans le piège de la fraude audio deepfake. On en parle régulièrement dans les médias et les réseaux sociaux. Certaines de ces histoires sont difficiles à comprendre.

Nous allons vous présenter quelques-unes des attaques les plus connues de type "voice deepfake", afin que vous puissiez vous faire une idée de l'ingéniosité avec laquelle elles sont exécutées.

La réunion virtuelle de $25 millions qui n'a jamais eu lieu

Cette attaque de type "deepfake" est probablement celle qui a été la plus signalée.

Le La victime était un bureau d'études britannique appelé Arup, mais l'escroquerie provenait de son bureau de Hong Kong.

Au début de l'année 2024, un employé du service financier de l'entreprise a reçu un courriel du directeur financier de l'entreprise au Royaume-Uni. Dans ce courriel, le directeur financier demandait à l'employé d'effectuer des transferts de fonds secrets vers certains comptes bancaires.

Dans un premier temps, l'employé s'est montré assez méfiant car la demande lui semblait un peu étrange et il a pensé qu'il pouvait s'agir d'une escroquerie par hameçonnage.

Mais l'employé a ensuite été invité à participer à une vidéoconférence. Lorsqu'il s'est joint à l'appel, il a vu ce qui semblait être exactement le directeur financier et plusieurs autres collègues de haut rang.

Tout le monde avait l'air et le son qu'il fallait. Ils se parlaient également entre eux pour que cela paraisse plus réel.

Cela a complètement dissipé les doutes de l'employé du département des finances, qui a ensuite envoyé plus de $25,6 millions (~HK$200 millions) sur plusieurs comptes bancaires différents à Hong Kong par le biais de 15 transactions.

Il s'est avéré par la suite que tout ce montage était une supercherie. Aucune personne de l'appel n'était ce qu'elle paraissait être, à l'exception de l'employé d'Arup. Les escrocs avaient parfaitement coordonné l'attaque en utilisant des clones audio et vidéo de haute qualité du directeur financier et des cadres supérieurs de l'entreprise.

Le ministre italien et les icônes de la mode

Celle-ci se déroule également en 2024. A faux ministre italien de la défense Guido Crosetto a appelé plusieurs élites italiennes et leur a demandé une aide financière immédiate pour sauver les journalistes qui avaient été enlevés.

Lors de l'appel, le faux Guido Crosetto a prétendu qu'il s'agissait d'une opération gouvernementale ultrasecrète. L'auteur de l'appel a même réussi à joindre au téléphone des personnalités légendaires de la mode comme Giorgio Armani.

Malheureusement, une personne a fini par transférer environ un million de dollars. Cette personne avait probablement un sentiment de devoir patriotique plus fort que d'autres, ce que les escrocs ont réussi à exploiter.

Le vol de $243 000 euros dans le secteur de l'énergie au Royaume-Uni

Cette a eu lieu en 2019 et a probablement été le premier deepfake de cette ampleur à être signalé.

Le PDG d'une entreprise britannique du secteur de l'énergie pensait qu'il était au téléphone avec son patron de la société mère en Allemagne.

Le PDG a reçu l'ordre de transférer environ 220 000 euros ($243 000) à un fournisseur en Hongrie. On lui a dit qu'il s'agissait d'une transaction critique qui nécessitait un transfert immédiat. Le PDG est tombé dans le panneau et a transféré l'argent.

Un appel terrifiant pour une mère en Arizona

Vous vous souvenez que nous avons parlé des deepfakes audio comme d'une menace pour les familles ? L'exemple d'escroquerie que nous avons donné s'est réellement produit.

Des escrocs avaient cloné la voix d'une jeune fille de 15 ans à partir d'une vidéo de celle-ci diffusée sur les médias sociaux. Ils ont ensuite appelé sa mère et ont prétendu, avec la voix de la fille, qu'elle avait été kidnappée et que ses ravisseurs exigeaient une rançon immédiate.

Heureusement, le père a pu appeler sa fille, qui était en sécurité dans un centre de ski pendant toute l'affaire. Ils ont échappé à l'escroquerie.

Comment les contrefaçons vocales affectent les entreprises

L'objectif principal d'une attaque de type "voice deepfake" est de voler de l'argent.

Mais lorsque la cible est une entreprise, les dommages sont multidimensionnels.

Par exemple, les deepfakes peuvent empoisonner l'atmosphère entre les employés d'une entreprise. Ils peuvent créer une culture dans laquelle les employés sont toujours terrifiés à l'idée de commettre une erreur.

Prenons l'exemple des centres d'appel. Des cybercriminels les appellent en se faisant passer pour des clients spécifiques.

Leur astuce consiste à faire en sorte que les agents du centre d'appel modifient les détails du compte de ces clients (par exemple, l'adresse du domicile, les numéros de téléphone) et prennent le contrôle de leurs comptes.

Les recrutements à distance et les entretiens virtuels sont un autre domaine dans lequel les candidats peuvent utiliser des voix truquées pour décrocher des emplois pour lesquels ils ne sont pas qualifiés.

Protéger les entreprises contre les attaques vocales de type Deepfake

Les règles de sécurité traditionnelles des entreprises ont été rédigées avant l'ère de l'IA.

Il est grand temps que les entreprises les reconsidèrent. Elles devraient commencer par s'informer sur les nombreuses nouvelles cybermenaces qui découlent de l'utilisation abusive de l'IA.

Ils peuvent par exemple organiser des sessions de formation pour l'ensemble de leur équipe et leur montrer des exemples réels de fraude audio. Vous pouvez commencer par les exemples que nous venons d'évoquer. Ces sessions de formation devraient également leur donner des conseils de prévention des attaques par deepfake pour différents scénarios.

Vous pouvez ensuite aller de l'avant et mettre à jour les politiques internes de l'entreprise. Un changement important peut consister à ne plus permettre à une seule personne d'autoriser seule des virements massifs.

Les paiements importants devraient être soumis à l'approbation d'un panel entier, afin qu'au moins l'un d'entre eux puisse s'apercevoir à temps que quelque chose ne va pas.

Vous devriez également envisager d'intégrer un système automatisé de gestion de l'information dans votre système d'information. Détecteur de voix AI pour qu'il s'exécute en arrière-plan pendant les appels.

C'est pour cela que les outils d'IA de TruthScan ont été conçus. Vous pouvez détecter, vérifier et prévenir les attaques de deepfake vocal à l'aide de nos outils d'IA. Voici comment.

Comment TruthScan sécurise les interactions vocales

Nous comprenons que les employés ne peuvent pas, à eux seuls, faire la différence entre une fausse voix et une vraie voix au milieu d'un appel stressant. Ils ont besoin d'un assistant dédié qui puisse s'occuper de cette tâche pendant un appel, tandis que votre équipe peut se concentrer sur ce pour quoi elle a été embauchée.

Notre Détecteur de voix AI est une solution dédiée.

Voici comment il fonctionne et ce dont il est capable :

- Analyse des millions de points de données différents lors d'appels téléphoniques et de réunions vidéo en direct et offre une précision de 99%.

- émet un avertissement immédiatement après avoir détecté une fausse voix

- Capture les modèles spectraux et les empreintes acoustiques de la voix qui ne sont pas pris en compte par les modèles synthétiques.

- S'intègre à votre centre d'appels ou à votre service d'assistance existant par le biais d'une simple API REST.

- Peut numériser tous les principaux formats audio et vidéo

Parlez à TruthScan de la prévention des attaques de Voice Deepfake

Vous pouvez arrêter la fraude par clonage vocal en temps réel avec TruthScan, mais la question est de savoir quand vous allez commencer. Vos employés pourraient tôt ou tard commettre une erreur et vous escroquer. N'attendez pas ce moment malheureux.

Notre détecteur de voix AI peut repérer les deepfakes vocaux à l'aide de plateformes telles que ElevenLabs et Murf.

Il fonctionne en arrière-plan pendant les appels téléphoniques et les réunions vidéo, de sorte que vos agents n'ont pas à effectuer plusieurs tâches à la fois.

Tout ce qu'il faut, c'est une intégration rapide via notre API REST.

Commencez avec TruthScan maintenant et protégez votre entreprise contre les escroqueries de type "deepfake".