Comment la technologie "deepfake" fait perdre des milliards aux entreprises mondiales et pourquoi chaque dirigeant est désormais une cible.

Les chiffres ne mentent pas

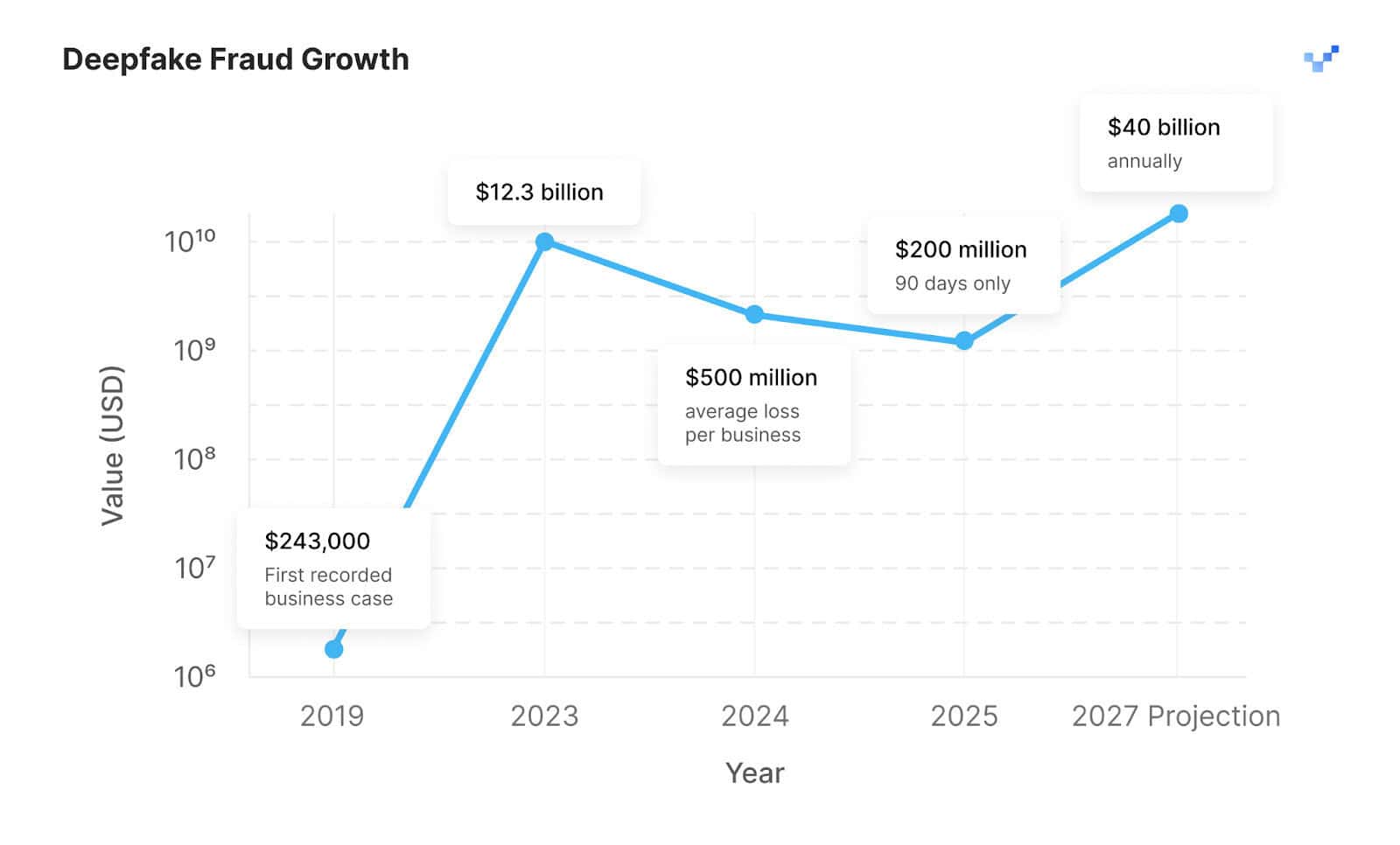

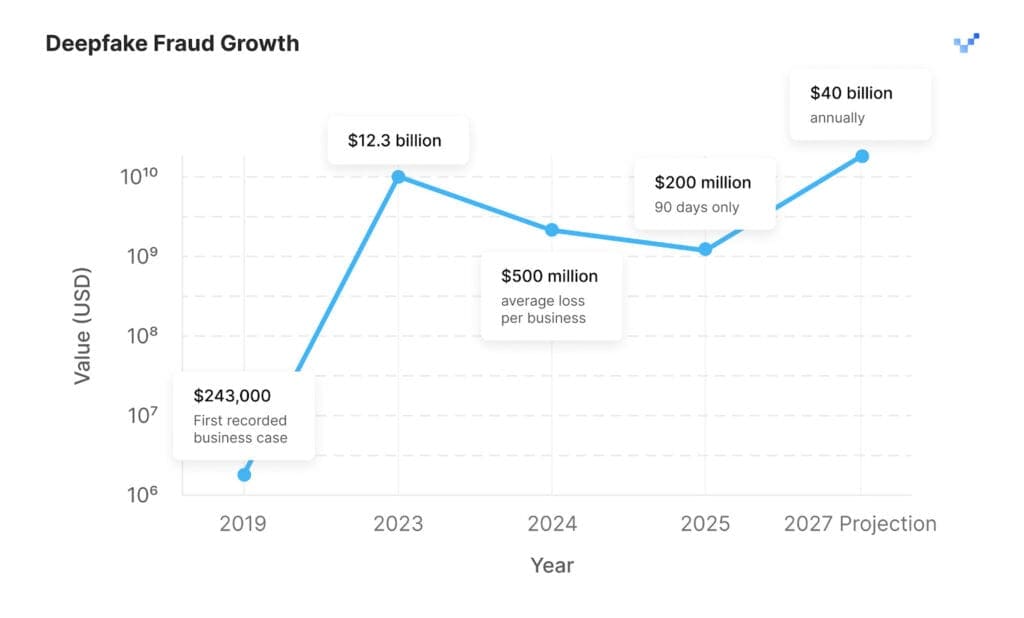

Les fraudes basées sur l'utilisation de Deepfake ont causé plus de $200 millions de pertes au cours du seul premier trimestre 2025.selon le dernier rapport d'incident de Resemble AI. Mais il ne s'agit là que de la partie émergée d'un iceberg ; les experts en sécurité préviennent qu'il pourrait s'étendre jusqu'à $40 milliards d'euros de pertes annuelles aux États-Unis d'ici 2027.

Les mathématiques de la tromperie numérique donnent à réfléchir :

Il s'agit d'une taux de croissance annuel composé de 32%-plus vite que la plupart des courbes d'adoption des technologies, et certainement plus vite que notre capacité à nous défendre contre elles.

Ne vous inquiétez plus jamais de la fraude à l'IA. TruthScan peut vous aider :

- Détecter l'IA générée des images, du texte, de la voix et de la vidéo.

- Éviter la fraude majeure induite par l'IA.

- Protégez vos plus sensible les actifs de l'entreprise.

L'échelle de la vulnérabilité

Une étude récente de Deloitte révèle que 25,9% des dirigeants ont déjà été confrontés à des incidents de type "deepfake" visant leurs données financières au cours des 12 derniers mois. Plus alarmant encore : 50% s'attendent à une augmentation des attaques au cours de l'année prochaine.

L'impact régional est frappant :

- Amérique du Nord: Augmentation de 1,740% des cas de fraude par deepfake en 2023

- Perte moyenne de l'entreprise: $500.000 par incident

- Impact sur les grandes entreprises: Jusqu'à $680 000 par attaque

Pourquoi cette explosion maintenant ?

La création de deepfake était autrefois isolée dans les coins les plus reculés du deep web, où des cybercriminels malhonnêtes échangeaient des crypto-monnaies contre des mots de passe.

Aujourd'hui, les outils d'IA sont couramment disponibles pour tout le monde et les chatbots à usage général peuvent être utilisés pour tricher avec désinvolture avec les systèmes existants.

Leurs capacités dépassent de loin la capacité du grand public à les reconnaître. Comme l'explique David Fairman, expert en cybersécurité chez Netskope : "L'accessibilité publique de ces services a abaissé la barrière à l'entrée pour les cybercriminels, qui n'ont plus besoin d'avoir des compétences technologiques particulières.

L'économie criminelle :

- Coût de la création: A partir de $20 pour le logiciel deepfake de base

- Taux de réussite: Il suffit de travailler une seule fois pour obtenir un retour sur investissement massif

- Taux de détection68% des personnes ne peuvent pas distinguer une vraie d'une fausse vidéo

- Clonage vocal: Nécessite seulement 3 à 5 secondes d'échantillon audio pour la précision du 85%

Attaques récentes de Deepfake

La montée en puissance du Deepfake dans l'assurance automobile au Royaume-Uni (2024) Les assureurs britanniques, dont Allianz et Zurich, ont signalé une augmentation de 300% des demandes d'indemnisation frauduleuses impliquant des photos et des vidéos manipulées par l'IA entre 2021 et 2023, la tendance s'accélérant en 2024. Dans un cas précis, des fraudeurs ont manipulé des images de vidéosurveillance pour modifier la date, l'heure et le numéro d'immatriculation du véhicule à l'appui d'une prétendue demande d'indemnisation pour accident Kennedys Law LLPL'argent de l'amour. Selon l'Association des assureurs britanniques, la valeur moyenne d'une demande d'indemnisation frauduleuse s'élevait à 15 000 livres sterling en 2023, ces délits augmentant d'environ 50 livres sterling par an les primes d'assurance automobile et habitation de l'assuré moyen.

Tentative d'imitation du PDG de Ferrari (2024) En juillet 2024, le constructeur automobile italien Ferrari a été victime d'une attaque au cours de laquelle des escrocs ont tenté de tromper des cadres financiers en usurpant l'identité du PDG Benedetto Vigna. Les fraudeurs ont d'abord contacté les cadres supérieurs sur WhatsApp en leur demandant "la grande acquisition que nous prévoyons", puis ils sont passés à des appels vocaux profonds qui reproduisaient l'accent caractéristique du sud de l'Italie de Benedetto Vigna (article ici).

Fraude aux services du gouvernement fédéral (2024) Selon une étude du GB Group, environ 8,6 millions de personnes au Royaume-Uni ont utilisé des identités fausses ou frauduleuses pour accéder à des services publics. Les fausses identités profondes basées sur l'IA sont de plus en plus utilisées pour diverses escroqueries, notamment pour accéder à des services publics en utilisant de faux justificatifs d'identité. .ID.me a fait état d'une forte augmentation des vecteurs d'attaque entre 2023 et 2024, avec une hausse de 300% des attaques par échange de visage, de 783% des attaques par injection d'images et de vidéos, et de 2 665% des attaques par caméras virtuelles.

L'impôt fiduciaire

Au-delà des pertes financières directes, les "deepfakes" imposent ce que les économistes pourraient appeler un "impôt fiduciaire" sur le commerce mondial. Lorsque les 32% des dirigeants d'entreprise n'ont pas confiance dans la capacité de leurs employés à reconnaître les tentatives de fraude par " deepfake ".Le coût va bien au-delà des incidents individuels.

Les organisations sont désormais obligées d'investir dans :

- Protocoles de vérification améliorés

- Programmes de formation des employés

- Technologies de détection avancées

- Capacités de gestion de crise

- Conformité juridique et réglementaire

Pourtant, malgré cette menace croissante, seulement 29% des entreprises ont pris des mesures pour se protéger, avec 46% sans aucun plan d'atténuation.

L'accélération à venir

Le FinCEN (Financial Crimes Enforcement Network) a observé "une augmentation des signalements d'activités suspectes par les institutions financières décrivant l'utilisation présumée de deepfake media dans des schémas de fraude" à partir de 2023 et jusqu'en 2024.

Ce problème de $25 milliards n'est pas seulement une question d'argent, il s'agit de l'érosion fondamentale de la confiance dans les communications numériques qui alimentent les entreprises modernes. Chaque appel vidéo, chaque message audio, chaque interaction numérique soulève désormais la question suivante : "Comment puis-je savoir que c'est vrai ?"

Les dirigeants qui résoudront cette crise de confiance en premier auront un avantage décisif. Ceux qui ne le feront pas risquent de se retrouver en vedette dans leur propre étude de cas sur les fraudes profondes.

Références :

Resemble AI Q1 2025 Rapport d'incident Deepfake - $200 millions d'euros de pertes au premier trimestre 2025

Centre Deloitte pour les services financiers (mai 2024) - $40 milliards d'euros prévus d'ici 2027, 25,9% des cadres ont connu des incidents, 50% s'attendent à des augmentations

Variety (18 avril 2025) - Les fraudes basées sur l'utilisation de Deepfake ont déjà causé $200 millions de pertes financières en 2025.

Eftsure US (2025) - Statistiques Deepfake (2025) : 25 nouveaux faits pour les directeurs financiers" - $500.000 pertes d'entreprises moyennes, $680.000 pertes de grandes entreprises

CNBC (28 mai 2024) - Citation de David Fairman dans Netskope

Rapport Entrust 2025 sur la fraude à l'identité - 3,000% augmentation des deepfakes à partir de 2022-2023

Alerte FinCEN FIN-2024-Alert004 - Augmentation des rapports d'activités suspectes

Diverses études citées dans Eftsure - 32% des dirigeants n'ont pas confiance dans la reconnaissance des employés, 68% ne peuvent pas distinguer une vraie d'une fausse vidéo, 3 à 5 secondes sont nécessaires pour le clonage de la voix