Dans les années 90, c'était l'ADN.

Dans les années 2000, il s'agissait des signaux émis par les tours de téléphonie mobile.

Mais en 2026, le nouvel étalon-or de la preuve est l'empreinte digitale.

Pensez-y de cette façon...

Chaque fichier vidéo possède une signature unique.

Si un seul pixel est modifié par l'IA, l'empreinte digitale change instantanément.

Si votre preuve d'IA n'a pas d'horodatage vérifié dans la blockchain pour verrouiller cette empreinte digitale, elle pourrait tout aussi bien être un dessin animé aux yeux d'un juge moderne.

Cela signifie donc que l'ère du “voir pour croire” est révolue.

Nous sommes entrés dans l'ère de la vérification vidéo par IA, où la preuve ne se trouve pas dans ce que vous voyez, mais dans le code numérique caché sous la surface.

Dans ce blog, nous explorerons les raisons pour lesquelles les preuves traditionnelles ne sont pas à la hauteur de la fraude vidéo, comment repérer les clips manipulés, pourquoi la vérification est essentielle pour la recevabilité, et pourquoi un détecteur vidéo IA comme TruthScan est désormais essentiel pour les équipes juridiques.

Plongeons dans le vif du sujet.

Principaux enseignements

- En 2026, toutes les preuves vidéo devront faire l'objet d'une vérification vidéo par IA pour être considérées comme fiables.

- La fraude vidéo comprend de petits montages tels que la manipulation de l'horodatage, et pas seulement des échanges de visages.

- Un détecteur de deepfake professionnel est le seul moyen de détecter les artefacts du GAN qui échappent aux humains.

- De nouvelles règles, telles que la règle fédérale 707, normalisent la manière dont les preuves d'IA sont admises par les tribunaux.

- L'analyse automatisée des preuves permet aux entreprises de traiter rapidement et avec précision des dossiers de communication de pièces volumineux.

- TruthScan prévient la fraude lors des audiences en direct en détectant les masques synthétiques en temps réel.

Qu'est-ce que la preuve vidéo dans les litiges juridiques ?

Les preuves vidéo sont essentiellement des enregistrements utilisés au tribunal pour prouver ce qui s'est passé. Qu'il s'agisse d'affaires pénales ou de règlements d'assurance, les preuves vidéo sont omniprésentes.

Cependant, en 2026, l'essor de la fraude vidéo a fait de l'hypothèse “voir, c'est croire” une hypothèse dangereuse. Les professionnels du droit ont désormais besoin d'une vérification vidéo par IA robuste pour garantir l'intégrité du système judiciaire.

Types de preuves vidéo utilisées quotidiennement par les tribunaux

Ne vous inquiétez plus jamais de la fraude à l'IA. TruthScan peut vous aider :

- Détecter l'IA générée des images, du texte, de la voix et de la vidéo.

- Éviter la fraude majeure induite par l'IA.

- Protégez vos plus sensible les actifs de l'entreprise.

- Surveillance (CCTV) : Caméras de magasins ou de feux de signalisation. Il s'agit de la preuve la plus courante dans les affaires pénales.

- Caméras corporelles : Images de policiers, utilisées principalement dans des affaires de droits civils ou de recours excessif à la force.

- Dashcams : La preuve par excellence en cas d'accident de voiture et de litige avec l'assurance.

- Témoignages enregistrés : Les dépositions vidéo ou les déclarations de témoins à distance sont devenues normales depuis la pandémie. Il s'agit désormais d'une norme, mais elle est sujette à des problèmes de détection de la fraude juridique.

- Smartphone et médias sociaux : Vidéos de spectateurs ou messages prouvant le comportement d'une personne ou l'endroit où elle se trouve.

- Sécurité de l'entreprise : Images utilisées par les entreprises dans le cadre de fraudes ou de licenciements abusifs.

L'IA générative et la technologie deepfake ont ajouté une nouvelle couche de risque. En 2025 :

- 1 vérification d'identité sur 20 a été trompée par des "deepfakes" de l'IA

- Une enquête de Medius a révélé que 43% des professionnels ont été victimes d'une tentative de fraude deepfake

Cas réels de fraude aux preuves vidéo

- Clips manipulés dans les salles d'audience

Les clips de salle d'audience manipulés font référence à toute preuve vidéo ou audio soumise dans une affaire judiciaire qui a été modifiée, éditée ou complètement fabriquée à l'aide de la technologie.

Exemples :

- Cas fictif du comté d'Alameda (2025): Une affaire civile californienne a été rejetée après que le tribunal a découvert qu'une vidéo de témoin présentée comme preuve avait été entièrement créée à l'aide de l'IA.

- La défense contre le deepfake de Sz Huang contre Tesla (2023): Dans le cadre d'un procès pour décès injustifié, les avocats de Tesla ont affirmé que les images clés de l'accident pourraient être un faux.

Vidéos de surveillance modifiées

La vidéo de surveillance est l'un des types de preuves d'intelligence artificielle les plus couramment utilisés dans les tribunaux. Cependant, de nombreuses personnes pensent à tort que la manipulation ne concerne que les deepfakes complets.

En réalité, la fraude vidéo se produit souvent de manière moins évidente et plus petite, ce qui peut compromettre une affaire.

Les types de manipulation les plus courants sont les suivants :

- Changements d'horodatage

- Démontage du cadre

- Changements dans les métadonnées ou le GPS

- Remplacement du visage

- Retrait ou insertion d'objets

- Séquences en boucle

- Dégradation de la qualité

Les vidéos de surveillance proviennent souvent d'endroits différents, tels que des magasins privés, des sonnettes de porte d'entrée, des parkings et des caméras municipales. Contrairement aux images des caméras corporelles de la police, ces systèmes ne respectent généralement pas les règles strictes de la chaîne de possession.

En d'autres termes :

- Il se peut qu'il n'y ait pas de trace claire de la personne qui a traité le dossier.

- Le métrage peut être copié, transféré ou converti plusieurs fois.

- Les procédures d'authentification peuvent être faibles ou incohérentes.

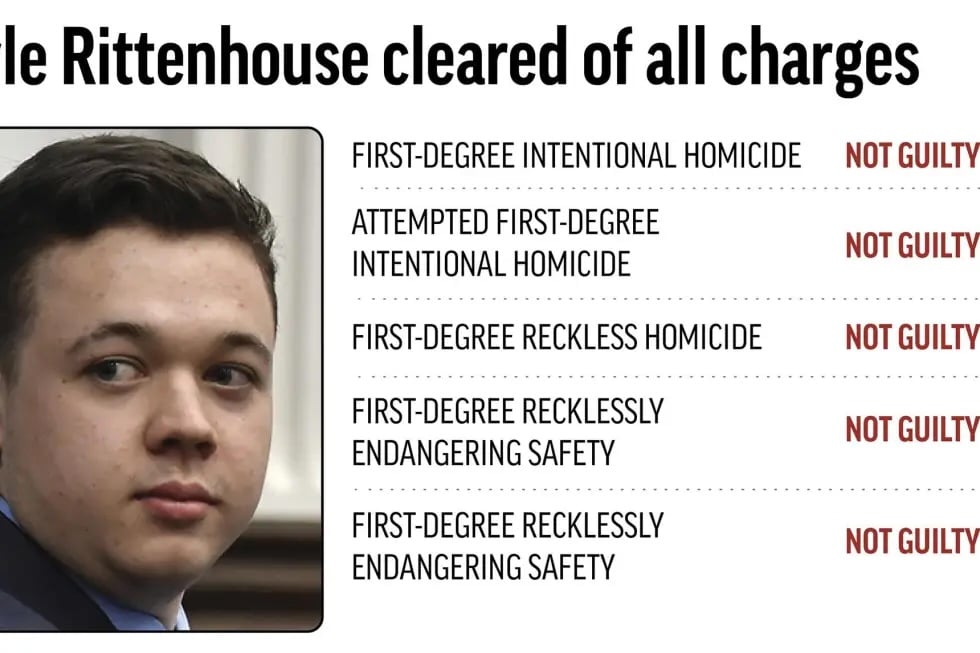

Exemple : La question du renforcement de l'IA dans l'affaire Wisconsin c. Rittenhouse

Un exemple célèbre a été donné lors du procès Wisconsin contre Rittenhouse. L'accusation a tenté d'utiliser la fonction "pincer pour zoomer" d'un iPad pour montrer les détails d'une vidéo de drone.

La défense a fait valoir que le zoom d'Apple utilise l'interpolation de l'IA pour deviner ce qui devrait être là. Le juge a estimé qu'en l'absence d'un détecteur vidéo IA professionnel, les images améliorées ne pouvaient être admises.

Témoignages vidéo contestés

Un témoignage vidéo contesté nécessite généralement une détection légale de la fraude pour déterminer si un enregistrement est correct :

- Une déposition ou une déclaration entièrement fabriquée

- Un vrai témoignage contesté comme faux

- Un enregistrement réel manipulé

Chaque scénario crée une sérieuse charge d'authentification pour le tribunal.

Exemple : Le cas de la garde d'enfants au Royaume-Uni

Dans un litige familial britannique cité par l'University of Baltimore Law Review, une mère a présenté un enregistrement fortement modifié pour dépeindre le père comme violent au cours d'une bataille pour la garde des enfants.

L'objectif était de restreindre son accès à ses enfants.

L'essor de la vidéo générée par l'IA dans les affaires juridiques

L'évolution vers l'ère actuelle des détecteurs de "deepfake" s'est déroulée en plusieurs phases :

- Les années d'alerte précoce (2017-2021)

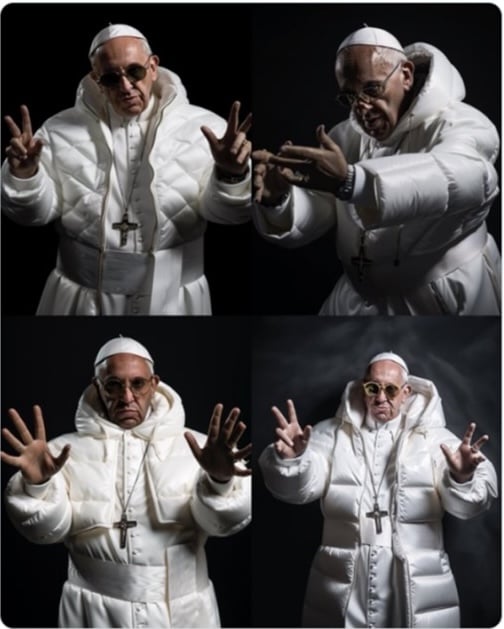

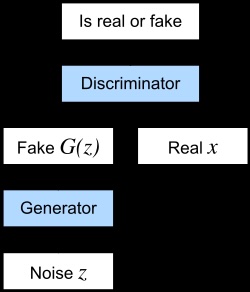

La technologie Deepfake (alimentée par des réseaux adversaires génératifs (GAN)) est apparue aux yeux du public vers 2017.

Les premiers deepfakes étaient souvent de mauvaise qualité : des visages avec des distorsions bizarres, des doigts supplémentaires, des éclairages mal adaptés et des traits flous qui les rendaient faciles à repérer.

- La phase d'escalade (2022-2023)

En 2022, la technologie s'est améliorée. Un grand nombre d'entre eux étaient gratuits et utilisables sur un smartphone.

En 2023, nous avons commencé à voir quelques-uns des premiers défis significatifs liés au deepfake dans des affaires judiciaires, notamment Sz Huang v. Tesla, United States v. Reffitt, et United States v. Doolin, où les avocats ont soulevé des questions sur la possibilité que des preuves vidéo puissent être générées par l'IA.

À peu près à la même époque, le comité consultatif sur les règles de preuve de l'American Bar Association a officiellement commencé à étudier la question.

- Le seuil critique (2024-2025)

Le contenu généré par l'IA n'est pas resté longtemps académique. En 2024, un incident s'est produit au sein de la société d'ingénierie Arup, impliquant un faux appel vidéo généré par l'IA qui autorisait des appels frauduleux à l'aide d'un téléphone portable. des virements électroniques d'un montant total de $25 millions d'euros.

Le système juridique a commencé à réagir.

En 2025, La Louisiane a adopté la loi HB 178, Le Conseil de l'Europe a créé le premier cadre de vérification des preuves en matière d'IA au niveau de l'État.

Au niveau fédéral, l'Advisory Committee on Evidence Rules (comité consultatif sur les règles de preuve) a proposé ce qui suit Règle 707, axée sur les preuves générées par des machines.

Situation en 2026

Au début de l'année 2026, la réglementation sur les deepfakes et les vidéos d'IA s'est accélérée à l'échelle nationale :

- 46 États ont adopté une forme ou une autre de législation sur le deepfake.

- Depuis 2022, 169 lois ont été promulguées et 146 projets de loi ont été déposés pour la seule année 2025.

- La règle fédérale 707 est ouverte aux commentaires du public jusqu'au 16 février 2026.

Améliorer la vérification vidéo grâce à l'IA

Le moyen le plus efficace de détecter les vidéos générées par l'IA est d'utiliser l'IA elle-même.

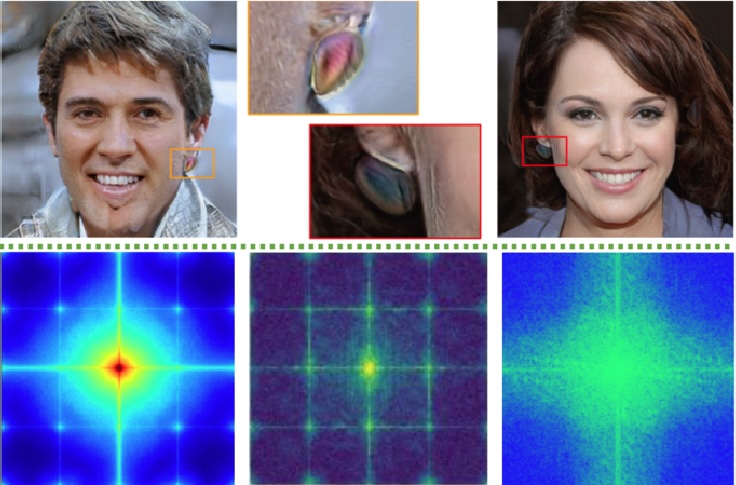

En effet, les deepfakes sont créés par des systèmes d'apprentissage automatique qui laissent des traces numériques subtiles.

Ces motifs sont trop petits ou trop complexes pour que l'œil humain les remarque. Mais ils peuvent être détectés par d'autres algorithmes.

Un système fiable de vérification vidéo par IA peut analyser plusieurs couches d'une vidéo à la fois, notamment :

- Analyse au niveau du cadre vérifie chaque image à la recherche d'erreurs visuelles telles que des textures étranges, des décalages d'éclairage ou des problèmes de fusion autour des visages.

- Analyse de la cohérence temporelle examine les mouvements entre les images pour détecter les sauts non naturels ou les mouvements incohérents.

- Suivi des points de repère faciaux surveille le mouvement des yeux, le clignement des paupières et la forme du visage pour détecter les changements non naturels.

- Test de synchronisation audiovisuelle vérifie que les mouvements des lèvres correspondent exactement aux mots prononcés.

- L'audio-judiciaire analyse la voix pour y déceler des signes de clonage, tels que des motifs sonores inhabituels ou des tonalités robotiques.

- Analyse des métadonnées et de la compression l'examen des données des fichiers cachés est essentiel pour la détection des fraudes légales, afin de vérifier si elles correspondent aux détails de l'enregistrement original.

Sensibiliser les équipes juridiques à la fraude vidéo

L'IA étant désormais capable d'imiter le comportement humain avec une précision terrifiante, les cabinets d'avocats ont recours à l'analyse automatisée des preuves et à un mélange de tactiques traditionnelles pour garder une longueur d'avance.

| Catégorie | Méthode | Description |

| Voies officielles | Crédits CLE (formation juridique continue) | Cours obligatoires ou facultatifs enseignant aux avocats comment authentifier les preuves numériques, comprendre les "deepfakes" et respecter les normes en matière de preuve. |

| Experts en IA nommés par la Cour | Mettre en place des spécialistes certifiés en criminalistique de l'IA, similaires aux experts en ADN, pour évaluer les preuves vidéo contestées devant les tribunaux. | |

| Voies non officielles | Équipe rouge interne | Engager des professionnels de la cybersécurité pour vérifier si des preuves falsifiées ou manipulées peuvent passer à travers les systèmes de réception de l'entreprise. |

| “Protocole ”Vibe Check | Former le personnel à repérer les signes d'alerte courants des deepfakes, tels que les clignements d'yeux non naturels, les traits déformés ou les problèmes de synchronisation des lèvres, avant de demander un examen médico-légal. |

Outils et technologies pour la validation des preuves

En 2026, nous avons dépassé le stade de la simple inspection visuelle.

Parce que l'IA est désormais capable de tromper même les enquêteurs les plus chevronnés, les équipes juridiques utilisent un ensemble d'outils spécifiques pour vérifier que ce qu'elles voient est la vérité absolue.

La technologie derrière la validation des preuves

- Détecteurs de fausses pistes : Il s'agit de logiciels spécialisés qui recherchent les artefacts GAN. Il s'agit de motifs mathématiques microscopiques ou de bruits laissés par les modèles d'IA qui génèrent des visages synthétiques. Alors qu'un humain voit un visage, le détecteur voit une signature numérique qui n'a pas lieu d'être.

- TruthScan est un détecteur de fausses images qui analyse les vidéos image par image à la recherche de signes d'intelligence artificielle, tels que des clignotements inhabituels, des formes de visage bizarres ou des erreurs de pixels où un faux visage a été ajouté.

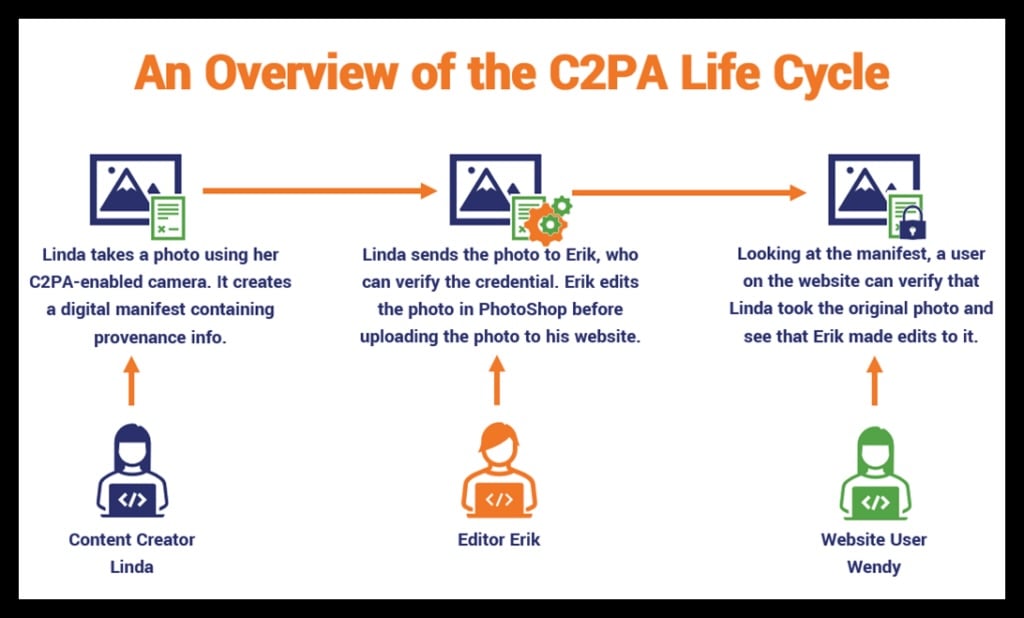

- Horodatage de la blockchain : Pour prouver qu'une vidéo n'a pas été touchée depuis le moment où elle a été enregistrée, de nombreuses agences utilisent désormais la norme C2PA. Lorsqu'une vidéo est enregistrée sur un appareil conforme, une empreinte numérique unique (hash) est créée et stockée sur une blockchain.

- TruthScan peut vérifier si cette empreinte correspond à la vidéo, en indiquant si le fichier a été édité ou si la chaîne de contrôle a été rompue.

- Outils de recherche de métadonnées : Chaque fichier numérique possède un certificat de naissance connu sous le nom de données Exif. Ces outils permettent de vérifier si un fichier a été réenregistré dans un logiciel de montage en IA ou si les données de localisation (GPS) ont été falsifiées. Si une vidéo prétend provenir d'une caméra de magasin mais que les métadonnées indiquent qu'elle a été exportée à partir d'un éditeur vidéo, vous avez un problème.

- Amped Software et TruthScan examinent les données cachées des fichiers (Exif, en-têtes) pour voir si la vidéo a été éditée ou traitée par l'IA.

Tendances en matière de preuves vidéo par l'IA

Voici les trois tendances de 2026.

- La criminalistique adverbiale générative : IA contre IA

Le moyen le plus avancé de détecter un deepfake en 2026 est d'utiliser la même technologie que celle qui l'a créé. Cette méthode est connue sous le nom de Generative Adversarial Forensics.

- Une IA (le générateur) tente de créer un faux, tandis qu'une autre IA (le discriminateur) tente de l'attraper. Dans les salles d'audience, des outils comme TruthScan peuvent être le discriminateur ultime.

- Exemple : Un plaignant soumet une vidéo d'un PDG concluant un contrat verbal. TruthScan analyse la vidéo en utilisant ses propres modèles contradictoires pour détecter les artefacts GAN. Si le logiciel détecte une probabilité synthétique 98%, la preuve est probablement un faux destiné à tromper l'œil humain.

- Analyse de la synchronisation audio-vidéo (règle des 0,01ms)

Les humains peuvent généralement repérer un retard si le son d'une vidéo est décalé d'environ 40 à 80 millisecondes. Cependant, les 2026 deepfakes sont souvent presque parfaits.

- Les outils modernes de police scientifique de l'IA recherchent désormais un délai de 0,01 milliseconde entre le son phonétique d'un mot et le mouvement mécanique des lèvres.

- Exemple : Dans une affaire de harcèlement datant de 2026, un défendeur a prétendu qu'une vidéo avait été falsifiée. L'analyse judiciaire automatisée des preuves a montré que la forme des lèvres “M” et “B” était décalée de 0,02 ms par rapport à l'audio. Cette erreur microscopique prouve que la voix a été clonée et superposée à une autre vidéo, ce qui a conduit à un non-lieu.

- Faux billets et faux billets

Alors que les deepfakes font appel à une intelligence artificielle de pointe, les cheapfakes sont la forme la plus courante de fraude vidéo.

- Un Deepfake crée une réalité qui ne s'est jamais produite (comme un échange de visages). Un Cheapfake prend des images réelles et en modifie le contexte ou l'intention à l'aide d'outils simples.

- Exemple (Le ralentissement): Une vidéo d'un homme politique semblant ivre ou en état d'ébriété peut être créée simplement en ralentissant la séquence de 20% et en ajustant la hauteur du son.

- Exemple (le recontexte) : Des images d'une manifestation organisée en 2022 dans un autre pays sont postées en 2026 comme preuve d'une émeute locale. Les équipes juridiques utilisent désormais l'analyse des métadonnées de TruthScan pour prouver la date de naissance réelle de la vidéo.

Comment TruthScan protège les preuves vidéo légales

TruthScan garantit que chaque image que vous présentez au tribunal est authentique, vérifiée et juridiquement défendable.

La plateforme rationalise la vérification vidéo de l'IA grâce aux avantages suivants :

Journaux d'audit automatisés et documentation de la chaîne de contrôle

- Fiabilité de la préparation au procès : Génère des rapports PDF et JSON qui documentent chaque étape de la vérification avec des scores de confiance précis et des horodatages.

- Conformité de premier niveau : Vous pouvez être tranquille en sachant que vos données restent sécurisées et qu'elles répondent à des normes mondiales strictes telles que SOC 2, ISO 27001 et GDPR.

- Contrôle flexible des données : Conservez les preuves sensibles au sein de votre juridiction grâce à des options de déploiement sur site ou VPC conçues pour les secteurs hautement réglementés.

Traitement par lots et intégration API pour les flux de travail juridiques

- Un gain de temps considérable : Traiter simultanément des milliers de fichiers provenant de dossiers de découverte ou de surveillance à l'aide d'importations de stockage en vrac (S3/GCS).

- L'administration de la preuve électronique (E-Discovery) : Rationalisez vos opérations en intégrant la vérification directement dans votre logiciel existant via des webhooks et des API.

- Éliminer les erreurs manuelles : Automatisez le premier passage de l'examen des preuves afin que votre équipe puisse se concentrer sur la stratégie plutôt que sur la vérification fastidieuse de chaque fichier.

Vérification en temps réel pour les dépositions et les auditions à distance

- Arrêter l'usurpation d'identité : Utiliser des points d'extrémité de diffusion en direct pour détecter si un déposant utilise des filtres deepfake ou des clones vocaux lors d'une audience à distance.

- Maintenir l'intégrité de la Cour : Signaler les anomalies visuelles ou sonores en temps réel, afin d'éviter que des témoignages frauduleux ne soient consignés dans le dossier.

- Tranquillité d'esprit : Offrez à vos clients et au tribunal un niveau de sécurité supplémentaire qui garantit que la personne à l'écran est exactement celle qu'elle prétend être.

En savoir plus sur la sécurisation des preuves vidéo IA

Protégez votre entreprise des risques liés à la manipulation des médias. Les technologies de détection de deepfake et de détection vidéo par IA de TruthScan constituent la solution ultime pour l'e-discovery et la vérification juridique.

Prêt à voir TruthScan en action ?

- Visiter truthscan.com pour obtenir gratuitement 20 000 crédits.

- Pour les demandes des entreprises, l'intégration des API ou les options de déploiement personnalisées, contactez l'équipe à l'adresse suivante Truthscan.com/contact.