90-luvulla se oli DNA.

2000-luvulla se oli matkapuhelinmastojen pingejä.

Mutta vuonna 2026 uusi kultainen todiste on digitaalinen sormenjälki.

Ajattele asiaa näin...

Jokaisella videotiedostolla on yksilöllinen allekirjoitus.

Jos tekoäly muuttaa edes yhtä pikseliä, sormenjälki muuttuu välittömästi.

Jos tekoälytodisteissasi ei ole todennettua lohkoketjun aikaleimaa, joka lukitsee sormenjäljen paikalleen, se voi yhtä hyvin olla sarjakuva nykyaikaisen tuomarin silmissä.

Tämä tarkoittaa siis sitä, että “seeing is believing” -aika on ohi.

Olemme siirtyneet tekoälyvideoiden todentamisen aikakauteen, jossa todiste ei löydy siitä, mitä näet, vaan pinnan alle piilotetusta digitaalisesta koodista.

Tässä blogissa selvitämme, miksi perinteinen todistusaineisto ei riitä videopetoksia vastaan, miten manipuloidut klipit havaitaan, miksi todentaminen on ratkaisevan tärkeää hyväksyttävyyden kannalta ja miksi TruthScanin kaltainen tekoälyvideoilmaisin on nykyään välttämätön oikeustiimille.

Sukelletaanpa sisään.

Keskeiset asiat

- Vuonna 2026 kaikki videotodisteet on tarkistettava tekoälyn avulla, jotta niitä voidaan pitää luotettavina.

- Videopetos sisältää pieniä muokkauksia, kuten aikaleiman manipulointia, ei vain täydellisiä kasvojen vaihtoja.

- Ammattimainen deepfake-ilmaisin on ainoa tapa havaita GAN-artefaktit, jotka ihmiset eivät huomaa.

- Uusilla säännöillä, kuten liittovaltion säännöllä 707, standardoidaan sitä, miten tekoälytodisteet hyväksytään oikeudessa.

- Automaattisen todisteanalyysin avulla yritykset voivat käsitellä massiivisia löytöpaketteja nopeasti ja tarkasti.

- TruthScan ehkäisee petoksia suorien kuulemisten aikana havaitsemalla synteettiset naamiot reaaliaikaisesti.

Mitä videotodisteet ovat oikeudellisissa riita-asioissa?

Videotodisteet ovat periaatteessa mitä tahansa nauhoitettua videoleikettä, jota käytetään oikeudessa todisteena tapahtuneesta. Sitä on kaikkialla, rikostapauksista vakuutusratkaisuihin.

Vuonna 2026 videopetosten yleistyminen on kuitenkin tehnyt “näkemällä uskoo” -periaatteesta vaarallisen olettamuksen. Oikeusalan ammattilaiset tarvitsevat nyt vankkaa tekoälyvideoiden todentamista, jotta oikeusjärjestelmän eheys voidaan varmistaa.

Tuomioistuinten päivittäin käyttämät videotodisteiden tyypit

Älä enää koskaan ole huolissasi tekoälypetoksista. TruthScan Voi auttaa sinua:

- Tunnista AI luotu kuvat, teksti, ääni ja video.

- Vältä merkittävä tekoälyyn perustuva petos.

- Suojaa kaikkein herkkä yrityksen omaisuuserät.

- Valvonta (CCTV): Kauppojen tai liikennevalojen kamerat. Tämä on yleisin todiste rikostapauksissa.

- Vartalokamerat: Poliisivirkailijoiden kuvamateriaalia, jota käytetään lähinnä kansalaisoikeustapauksissa tai liiallista voimankäyttöä koskevissa asioissa.

- Ajokamerat: Todisteet auto-onnettomuuksissa ja vakuutustaisteluissa.

- Tallennetut todistukset: Videotallenteet tai etätodistajanlausunnot, joista on tullut tavanomaisia pandemian jälkeen. Ne ovat nykyään standardi, mutta ne ovat alttiita oikeudellisille petosten havaitsemiseen liittyville haasteille.

- Älypuhelin ja sosiaalinen media: Sivullisilta saadut videot tai viestit, jotka todistavat jonkun käyttäytymisen tai sijainnin.

- Yrityksen turvallisuus: Yritysten käyttämä kuvamateriaali petos- tai “aiheettomia potkuja” koskevissa tapauksissa.

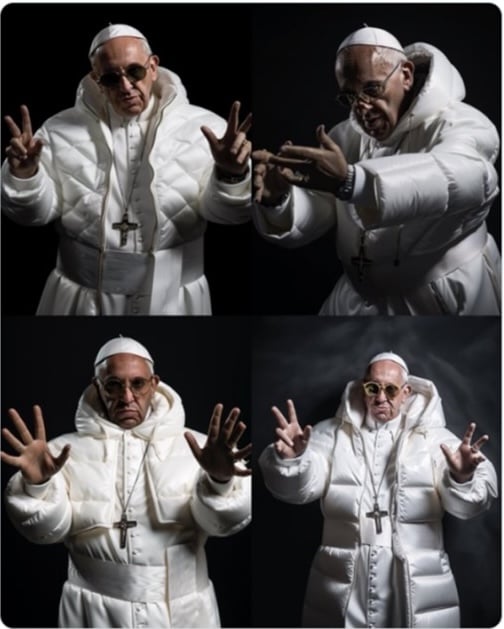

Generatiivinen tekoäly ja deepfake-teknologia ovat lisänneet uuden riskikerroksen. Vuonna 2025:

- Tekoälyn syväväärennökset huijasivat 1:tä 20:stä henkilöllisyystodennuksesta.

- Medius-tutkimuksen mukaan 43% ammattilaisista oli joutunut deepfake-huijausyrityksen uhriksi.

Videotodisteiden väärinkäyttöä koskevat todelliset tapaukset

- Manipuloidut oikeudenkäyntipätkät

Manipuloidut oikeudenkäyntipätkät tarkoittavat kaikkia oikeudenkäynnissä esitettyjä video- tai äänitodisteita, joita on muutettu, muokattu tai täysin väärennetty teknologian avulla.

Esimerkkejä:

- Alamedan piirikunnan deepfake-tapaus (2025): Kalifornialainen siviilioikeudenkäynti hylättiin sen jälkeen, kun tuomioistuin huomasi, että todisteeksi toimitettu todistajan video oli luotu kokonaan tekoälyn avulla.

- Sz Huang vastaan Tesla deepfake-puolustus (2023): Teslan asianajajat väittivät väärästä kuolemasta nostetussa kanteessa, että keskeinen kolarikuvaus saattaa olla väärennös.

Muutetut valvontakameravideot

Valvontakameravideo on yksi yleisimmistä oikeudessa käytetyistä tekoälytodisteista. Monet ihmiset kuitenkin ajattelevat manipuloinnin virheellisesti olevan vain täyttä deepfakea.

Todellisuudessa videopetoksia tapahtuu usein pienemmillä, vähemmän ilmeisillä tavoilla, jotka voivat vaarantaa tapauksen.

Yleisiä manipulaatiotyyppejä ovat:

- Aikaleiman muutokset

- Rungon poistaminen

- Metatietojen tai GPS:n muutokset

- Kasvojen korvaaminen

- Esineen poistaminen tai asettaminen

- Looping-materiaalia

- Laadun heikkeneminen

Valvontakameravideot ovat usein peräisin monista eri paikoista, kuten yksityisistä myymälöistä, kotien ovikelloista, parkkipaikoilta ja kaupungin kameroista. Toisin kuin poliisin valvontakameran kuvamateriaalissa, näissä järjestelmissä ei yleensä noudateta tiukkoja säilytystapasääntöjä.

Se tarkoittaa:

- Ei välttämättä ole selvää tietoa siitä, kuka on käsitellyt asiakirjaa.

- Kuvamateriaalia voidaan kopioida, siirtää tai muuntaa useita kertoja.

- Tunnistusmenettelyt voivat olla heikkoja tai epäjohdonmukaisia.

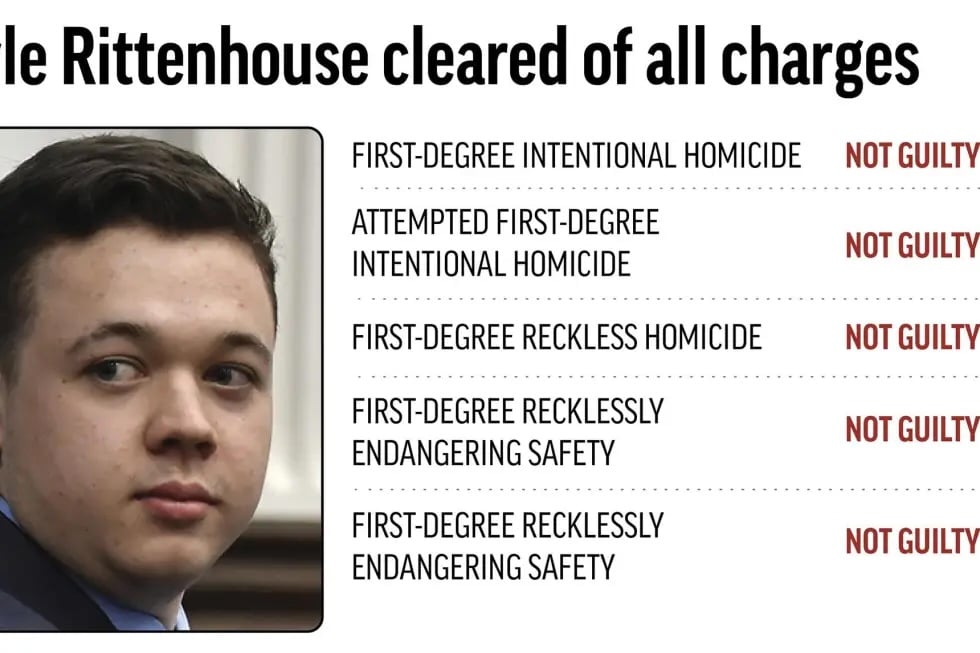

Esimerkki: Wisconsin v. Rittenhouse AI Enhancement -kysymys (Wisconsin v. Rittenhouse)

Kuuluisa esimerkki tuli Wisconsin v. Rittenhouse -oikeudenkäynnistä. Syyttäjä yritti käyttää iPadin nipistämällä zoomaustoimintoa näyttääkseen yksityiskohtia drone-videosta.

Puolustus väitti, että Applen zoomaus käyttää tekoälyn interpolointia arvaamaan, mitä siellä pitäisi olla. Tuomari päätti, että ilman ammattimaista tekoälyvideoilmaisinta parannettua kuvamateriaalia ei voitu hyväksyä.

Kiistanalaiset videotodistukset

Kiistelty videotodistus edellyttää yleensä oikeudellista petoksen havaitsemista, jotta voidaan määrittää, onko tallennus:

- Täysin keksitty lausunto tai lausunto

- Todellinen todistus kyseenalaistettu väärennöksenä

- Manipuloitu todellinen tallennus

Jokainen skenaario aiheuttaa tuomioistuimelle vakavan todentamisrasitteen.

Esimerkki: Yhdistyneen kuningaskunnan lasten huoltajuus

Baltimoren yliopiston oikeustieteellisen aikakauskirjan siteeraamassa brittiläisessä perheoikeudenkäynnissä äiti esitti voimakkaasti muunnellun nauhoituksen, jolla hän kuvasi isän väkivaltaisena huoltajuuskiistan aikana.

Tavoitteena oli rajoittaa hänen mahdollisuuksiaan tavata lapsiaan.

Tekoälyn tuottamien videoiden yleistyminen oikeudellisissa asioissa

Matka kohti nykyistä väärennösilmaisimien aikakautta eteni eri vaiheissa:

- Varhaisvaroitusvuodet (2017-2021)

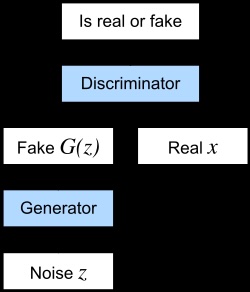

Deepfake-teknologia (joka perustuu generatiivisiin vastakkaisverkkoihin (GAN)) tuli julkisuuteen noin vuonna 2017.

Varhaiset väärennökset olivat usein heikkolaatuisia: kasvoissa oli outoja vääristymiä, ylimääräisiä sormia, vääränlainen valaistus ja epätarkkoja piirteitä, joiden ansiosta ne oli helppo havaita.

- Eskalaatiovaihe (2022-2023)

Vuoteen 2022 mennessä tekniikka parani. Monet niistä olivat ilmaisia ja käyttökelpoisia älypuhelimella.

Vuonna 2023 alettiin nähdä ensimmäisiä merkittäviä deepfake-haasteita oikeustapauksissa, kuten Sz Huang v. Tesla, Yhdysvallat v. Reffitt ja Yhdysvallat v. Doolin, joissa asianajajat esittivät kysymyksiä siitä, voisiko videotodiste olla tekoälyn tuottamaa.

Samoihin aikoihin American Bar Associationin todistelusääntöjä käsittelevä neuvoa-antava komitea alkoi virallisesti tutkia asiaa.

- Kriittinen kynnysarvo (2024-2025)

Tekoälyn luoma sisältö ei pysynyt pitkään akateemisena. Vuonna 2024 Arup-insinööritoimiston tapaus, johon liittyi tekoälyn luoma väärennetty videopuhelu, joka antoi luvan vilpilliseen tilisiirtoja yhteensä $25 miljoonaa euroa..

Oikeusjärjestelmä alkoi reagoida.

Vuonna 2025, Louisiana hyväksyi HB 178, luoden ensimmäisen valtiotason tekoälynäyttöä koskevan todentamisjärjestelmän.

Liittovaltion tasolla Yhdysvaltain todistelusääntöjä käsittelevä neuvoa-antava komitea ehdotti, että Sääntö 707, jossa keskitytään koneellisesti tuotettuihin todisteisiin..

Tilanne vuonna 2026

Vuoden 2026 alusta lähtien deepfake- ja tekoälyvideoiden sääntely on kiihtynyt valtakunnallisesti:

- 46 valtiota ovat hyväksyneet jonkinlaisen deepfake-lainsäädännön.

- Vuodesta 2022 lähtien, 169 lakia on annettu ja 146 lakiehdotusta esiteltiin pelkästään vuonna 2025..

- Federal Rule 707 on avoinna julkisia kommentteja varten 16. helmikuuta 2026 saakka.

Videotarkistuksen tehostaminen tekoälyn avulla

Tehokkain tapa havaita tekoälyn luoma video on käyttää tekoälyä itse.

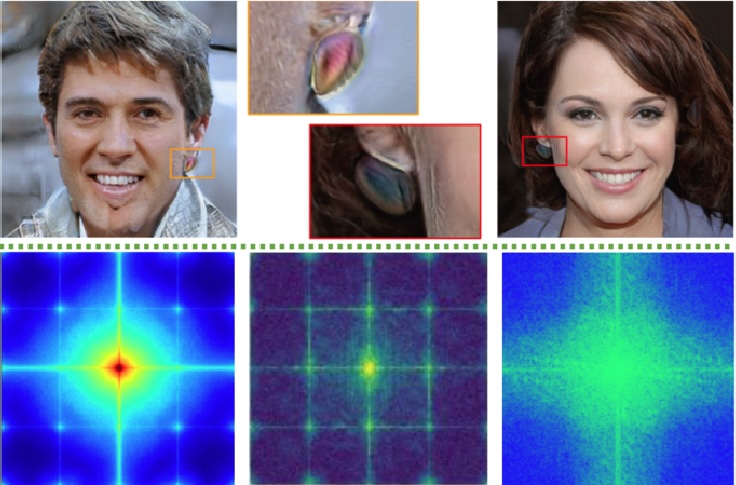

Tämä johtuu siitä, että syväväärennökset luodaan koneoppimisjärjestelmillä, jotka jättävät jälkeensä hienovaraisia digitaalisia kuvioita.

Nämä kuviot ovat liian pieniä tai monimutkaisia ihmissilmän havaittavaksi. Muut algoritmit voivat kuitenkin havaita ne.

Luotettava tekoälyvideoiden todentamisjärjestelmä voi analysoida useita videon kerroksia kerralla, mukaan lukien:

- Kehystason analyysi tarkistaa jokaisen kuvan visuaaliset virheet, kuten oudot tekstuurit, valaistuksen epäsuhta tai kasvojen ympärillä esiintyvät häivytysongelmat.

- Ajallinen koherenssianalyysi tarkastelee liikettä eri ruutujen välillä löytääkseen luonnottomia hyppyjä tai epäjohdonmukaista liikettä.

- Kasvojen maamerkkien seuranta tarkkailee silmien liikkeitä, räpäytyksiä ja kasvojen muotoa havaitakseen luonnottomat muutokset.

- Audiovisuaalisen synkronoinnin testaus tarkistaa, että huulien liikkeet vastaavat täsmälleen puhuttuja sanoja.

- Äänitutkimus analysoi äänen kloonauksen merkkien, kuten epätavallisten äänimuotojen tai robottimaisen sävyn, varalta.

- Metatietojen ja pakkauksen analysointi Piilotetun tiedoston tietojen tutkiminen on elintärkeää oikeudellisten petosten havaitsemiseksi, jotta voidaan nähdä, vastaavatko ne alkuperäisen tallenteen tietoja.

Oikeudellisten tiimien kouluttaminen videopetoksista

Koska tekoäly pystyy nyt jäljittelemään ihmisen käyttäytymistä pelottavalla tarkkuudella, asianajotoimistot käyttävät automaattista todisteiden analysointia ja perinteisten taktiikoiden yhdistelmää pysyäkseen kärjessä.

| Luokka | Menetelmä | Kuvaus |

| Viralliset keinot | CLE (jatkuva oikeudellinen koulutus) opintopisteet | Pakolliset tai valinnaiset kurssit, joilla opetetaan lakimiehille, miten digitaalista todistusaineistoa voidaan todentaa, ymmärtää väärennöksiä ja täyttää todistusvaatimuksia. |

| Tuomioistuimen nimeämät tekoälyasiantuntijat | Perustetaan DNA-asiantuntijoiden kaltaisia sertifioituja tekoälyn rikosteknisiä asiantuntijoita arvioimaan kiistanalaisia videotodisteita oikeudessa. | |

| Epäviralliset tavat | Sisäinen punainen tiimi | Palkataan kyberturvallisuuden ammattilaisia testaamaan, voivatko väärennetyt tai manipuloidut todisteet livahtaa yrityksen vastaanottojärjestelmien läpi. |

| “Vibe Check” -pöytäkirja | Koulutetaan henkilökuntaa havaitsemaan yleiset väärennösten varoitusmerkit, kuten epäluonnollinen räpyttely, vääristyneet piirteet tai huulten synkronointiin liittyvät ongelmat, ennen kuin ne viedään rikostekniseen tarkastukseen. |

Todisteiden validoinnin välineet ja teknologia

Vuonna 2026 olemme päässeet pelkän silmämääräisen tarkastuksen ohi.

Koska tekoäly pystyy nykyään huijaamaan jopa kokeneimpia tutkijoita, oikeudelliset tiimit käyttävät erityisiä työkaluja varmistaakseen, että näkemänsä on absoluuttinen totuus.

Todisteiden validoinnin taustalla oleva teknologia

- Deepfake Detectors: Nämä ovat erikoistuneita ohjelmistoja, jotka etsivät GAN-artefakteja. Ne ovat mikroskooppisia, matemaattisia kuvioita tai kohinaa, joita synteettisiä kasvoja luovat tekoälymallit jättävät jälkeensä. Kun ihminen näkee kasvot, tunnistin näkee digitaalisen allekirjoituksen, joka ei kuulu sinne.

- TruthScan on syvä väärennösilmaisin, joka skannaa videot ruutu ruutulta tekoälyn merkkien, kuten epätavallisen räpäytyksen, outojen kasvojen muotojen tai pikselivirheiden varalta, joihin on lisätty väärennetyt kasvot.

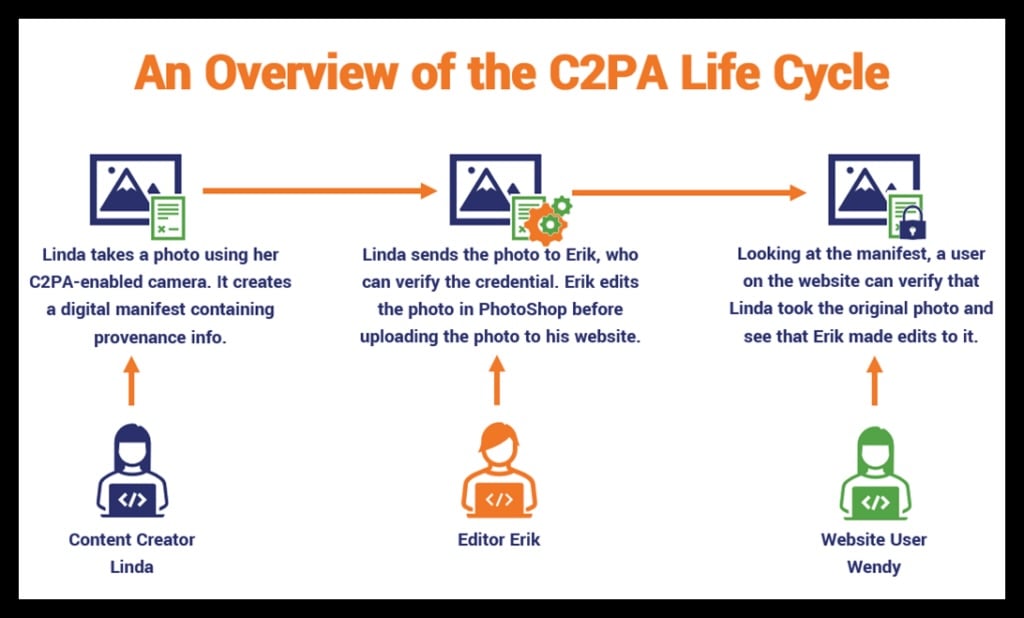

- Lohkoketjun aikaleimat: Monet virastot käyttävät nykyään C2PA-standardia todisteena siitä, ettei videoon ole koskettu sen tallennushetken jälkeen. Kun video tallennetaan vaatimusten mukaisella laitteella, luodaan yksilöllinen digitaalinen sormenjälki (hash), joka tallennetaan lohkoketjuun.

- TruthScan voi tarkistaa, täsmääkö tämä sormenjälki videon kanssa, ja näyttää, onko tiedostoa muokattu tai onko säilytysketju rikottu.

- Metatiedon rikostekniset työkalut: Jokaisella digitaalisella tiedostolla on syntymätodistus, joka tunnetaan nimellä Exif-tiedot. Nämä työkalut tarkistavat, onko tiedosto tallennettu uudelleen AI-editointiohjelmalla tai onko sijaintitiedot (GPS) väärennetty. Jos video väittää olevansa peräisin myymäläkamerasta, mutta metatiedot osoittavat, että se on viety videoeditorilla, sinulla on ongelma.

- Amped Software ja TruthScan tutkivat piilotettuja tiedostotietoja (Exif, otsikot) nähdäkseen, onko videota muokattu tai tekoälyllä käsitelty.

Tekoälyn videotodisteiden suuntaukset

Tässä ovat vuoden 2026 kolme suuntausta.

- Generatiivinen vastakohtainen rikostutkinta: AI vs. AI

Edistyksellisin tapa saada deepfake kiinni vuonna 2026 on käyttää samaa teknologiaa, joka loi sen. Tämä tunnetaan nimellä Generative Adversarial Forensics.

- Yksi tekoäly (generaattori) yrittää luoda väärennöksen, kun taas toinen tekoäly (erottelija) yrittää saada sen kiinni. Oikeussalissa TruthScanin kaltaiset työkalut voivat olla lopullinen erottelija.

- Esimerkki: Kantaja toimittaa videon, jossa toimitusjohtaja tekee suullisen sopimuksen. TruthScan skannaa videon käyttämällä omia vastakkaisasetelmamallejaan GAN-artefaktien havaitsemiseksi. Jos ohjelmisto merkitsee 98%-synteettisen todennäköisyyden, todiste on todennäköisesti väärennös ihmissilmän huijaamiseksi.

- Audio-video-synkronoinnin analysointi (0,01 ms sääntö)

Ihmiset huomaavat yleensä viiveen, jos videon ääni poikkeaa noin 40-80 millisekuntia. Vuoden 2026 väärennökset ovat kuitenkin usein lähes täydellisiä.

- Nykyaikaiset tekoälyn rikostekniset työkalut etsivät nykyään 0,01 millisekunnin viiveen sanan foneettisen äänteen ja huulten mekaanisen liikkeen välillä.

- Esimerkki: Eräässä vuonna 2026 käsitellyssä häirintätapauksessa vastaaja väitti, että video oli väärennetty. Rikostekninen automaattinen todisteanalyysi osoitti, että “M” ja “B” -huulien muodot olivat 0,02 ms epäsynkronissa äänen kanssa. Tämä mikroskooppisen pieni virhe todisti, että ääni oli kloonattu ja kerrostettu eri videon päälle, mikä johti syytteen hylkäämiseen.

- Cheapfakes vs. Deepfakes

Vaikka syväväärennöksissä käytetään huippuluokan tekoälyä, halpaväärennökset ovat yleisin videohuijauksen muoto.

- Deepfake luo todellisuuden, jota ei ole koskaan tapahtunut (kuten kasvojen vaihto). Cheapfake ottaa todellista kuvamateriaalia ja muuttaa sen kontekstia tai tarkoitusta yksinkertaisilla työkaluilla.

- Esimerkki (Hidastaminen): Poliitikon humalassa tai heikossa kunnossa esiintyvä video voidaan luoda yksinkertaisesti hidastamalla videokuvaa 20%:llä ja säätämällä äänen korkeutta.

- Esimerkki (Re-Context): Kuvamateriaalia vuoden 2022 mielenosoituksesta toisessa maassa lähetetään vuonna 2026 suorana todisteena paikallisesta mellakasta. Lakimiehet käyttävät nyt TruthScanin metatietoanalyysiä todistaakseen videon todellisen syntymäajan.

Miten TruthScan suojaa laillisia videotodisteita

TruthScan varmistaa, että jokainen oikeudessa esittämäsi kuva on aito, todennettu ja oikeudellisesti puolustettavissa.

Alusta tehostaa tekoälyvideoiden todentamista seuraavien etujen avulla:

Automatisoidut auditointilokit ja jäljitysketjun dokumentointi

- Tuomioistuinvalmis luotettavuus: Luo PDF- ja JSON-raportteja, jotka dokumentoivat jokaisen varmennusvaiheen tarkkojen luottamuspisteiden ja aikaleimojen avulla.

- Huipputason vaatimustenmukaisuus: Voit olla rauhassa tietäen, että tietosi pysyvät turvassa ja täyttävät tiukat maailmanlaajuiset standardit, kuten SOC 2, ISO 27001 ja GDPR.

- Joustava tiedonhallinta: Pidä arkaluonteiset todisteet vaaditun lainkäyttöalueesi sisällä tiukasti säännellyille toimialoille suunnitelluilla on-premise- tai VPC-käyttöönottovaihtoehdoilla.

Eräkäsittely ja API-integraatio oikeudellisiin työnkulkuihin

- Massiivinen ajansäästö: Käsittele tuhansia tiedostoja löytöpaketeista tai valvontakokonaisuuksista samanaikaisesti käyttämällä irtotallennustiedostojen tuontia (S3/GCS).

- Saumaton sähköinen tiedonhankinta: Tehosta toimintojasi integroimalla todentaminen suoraan olemassa olevaan ohjelmistoosi verkkokoukkujen ja sovellusrajapintojen avulla.

- Manuaalisten virheiden poistaminen: Automatisoi todisteiden seulonnan ensimmäinen läpikäynti, jotta tiimisi voi keskittyä strategiaan tylsän tiedostokohtaisen tarkistamisen sijaan.

Reaaliaikainen todentaminen todistajanlausuntoja ja etäkuulemisia varten

- Lopeta imitointi: Käytä suoratoistopalvelun päätepisteitä havaitaksesi, käyttääkö kuulusteltava deepfake-suodattimia tai ääniklooneja etäkuulustelun aikana.

- Säilytä tuomioistuimen rehellisyys: Merkitse visuaaliset tai äänipoikkeamat reaaliaikaisesti ja estä vilpillisten lausuntojen kirjaaminen pöytäkirjaan.

- Mielenrauha: Tarjoa asiakkaillesi ja tuomioistuimelle ylimääräinen turvakerros, joka takaa, että näytöllä näkyvä henkilö on juuri se, joka hän väittää olevansa.

Lisätietoja AI-videotodisteiden suojaamisesta

Suojaa yrityksesi manipuloidun median riskeiltä. TruthScanin deepfake detector- ja AI-videotunnistinteknologia tarjoavat täydellisen ratkaisun sähköiseen tiedonhankintaan ja oikeudelliseen todentamiseen.

Oletko valmis näkemään TruthScanin toiminnassa?

- Käy osoitteessa truthscan.com saadaksesi ilmaiseksi 20 000 krediittiä.

- Yritystiedustelujen, API-integraation tai mukautettujen käyttöönottovaihtoehtojen osalta ota yhteyttä heidän tiimiinsä osoitteessa Truthscan.com/contact.