Vakuutuspetokset ovat siirtymässä uuteen aikakauteen, jonka voimanlähteenä on tekoäly. Sekä kehittyneet petosringit että yksittäiset huijarit hyödyntävät tekoälyä tuottavia työkaluja väärennettyjen korvausvaatimusten, synteettisten henkilöllisyyksien, väärennettyjen todisteiden ja erittäin vakuuttavien huijausten tuottamiseen. Tässä whitepaperissa tarkastellaan tekoälyyn perustuvien vakuutuspetosten viimeisimpiä 2025 suuntauksia - tekoälyn luomista korvausvaatimuksista ja asiakirjoista syvälle väärennettyihin äänihuijauksiin - ja hahmotellaan, miten vakuutuksenantajat voivat reagoida niihin. Esittelemme tuoreimpia tietoja, todellisia tapauksia ja strategisia näkemyksiä vakuutuksenantajille, petostutkijoille, kyberturvaryhmille, korvauspäälliköille ja johtajille, joiden on ymmärrettävä tätä nopeasti kehittyvää uhkakuvaa.

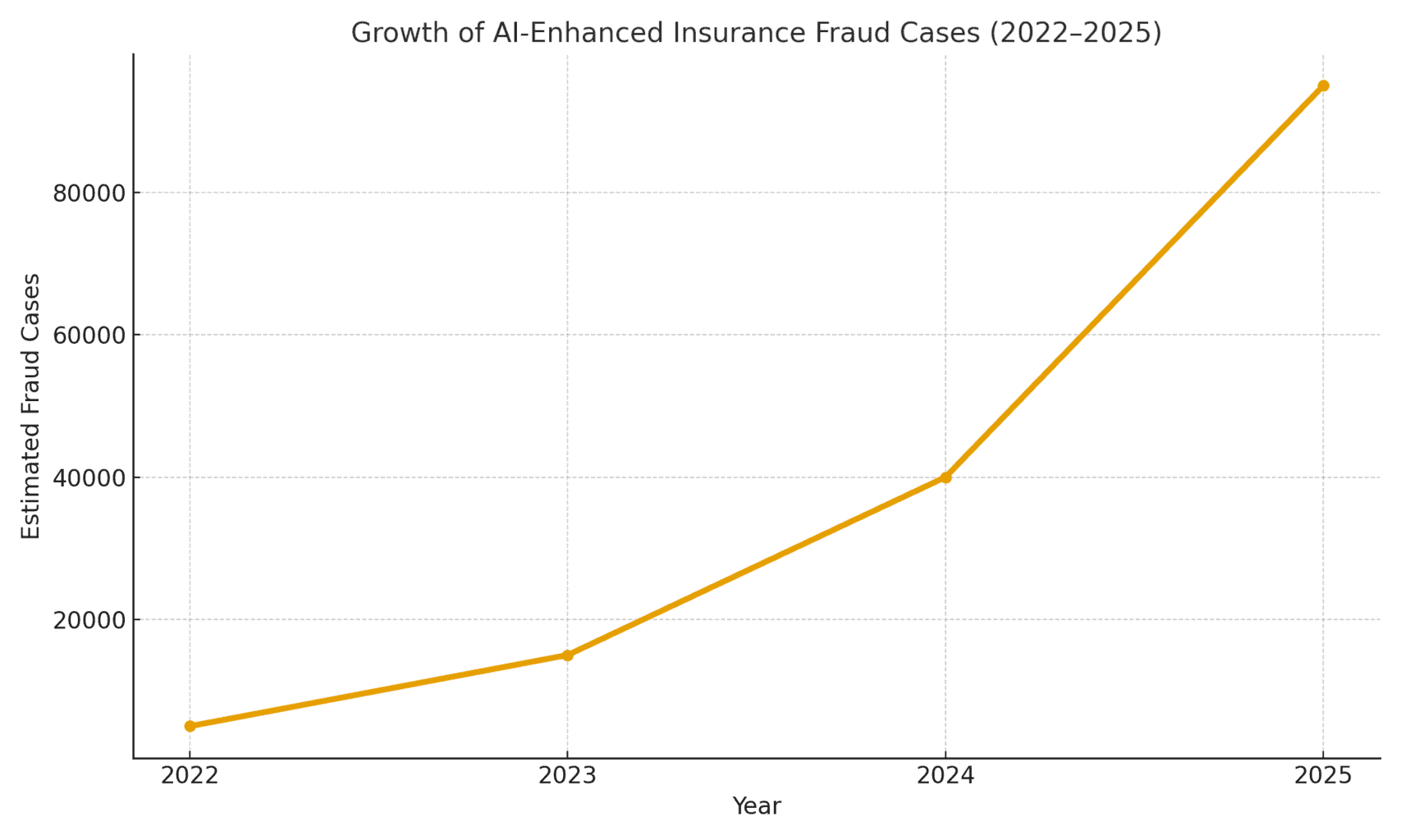

Uhkan laajuus: Tekoälyn mahdollistamat petokset ovat kasvussa. Vuonna 2025 laaditussa rikosteknisessä raportissa todettiin, että Tekoälypohjaiset huijaukset muodostavat nyt yli puolet kaikista digitaalisista talouspetoksista.[1]. Vakuutuksessa erityisesti ääniturvayhtiö Pindrop havaitsi... 475% synteettisten äänipetoshyökkäysten lisääntyminen vakuutusyhtiöissä vuonna 2024., mikä osaltaan vaikutti siihen, että vakuutuspetosyritykset lisääntyivät 19% edellisvuodesta.[2]. Vakuutusyhtiöt kohtaavat noin 20 kertaa suurempi petosalttius kuin pankeilla, mikä johtuu osittain siitä, että korvausvaatimuksissa turvaudutaan paljon asiakirjoihin, kuviin ja äänitarkistuksiin.[3]. Alla olevassa kuvassa 1 havainnollistetaan tekoälyllä tehostettujen vakuutuspetostapausten räjähdysmäistä kasvua vuosina 2022-2025, sillä useat alan raportit ovat osoittaneet, että tekoälyn havaittu osallistuminen petoksiin lisääntyy vuosittain kolme- tai nelinumeroisella prosenttimäärällä.

Kuva 1: Tekoälyllä tehostettujen vakuutuspetostapausten nopea kasvu (indeksoitu kasvu 2022-2025). Alan tiedot osoittavat, että tekoälyllä tuotetun sisällön määrä kasvaa eksponentiaalisesti petollisissa korvaushakemuksissa erityisesti vuodesta 2023 alkaen.[4][2]

Tekoälyn luomat väitteet ja väärennetyt todisteet

Yksi vallitsevimmista suuntauksista on generatiivisen tekoälyn käyttö käsityön tekemiseen. täysin tekaistut vakuutuskorvausvaatimukset. Kehittyneiden tekoälytekstigeneraattoreiden avulla huijarit voivat kirjoittaa realistisia tapahtumakuvauksia, lääkärinlausuntoja tai poliisin lausuntoja napin painalluksella. Nämä tekoälyn kirjoittamat kertomukset vaikuttavat usein hiotuilta ja uskottavilta, mikä vaikeuttaa korvausasiamiesten havaitsemista epäjohdonmukaisuuksista. Huijarit ovat esimerkiksi käyttäneet ChatGPT:tä laatiakseen yksityiskohtaisia onnettomuuskuvauksia tai vammaraportteja, jotka kuulostavat ammattimaisilta ja vakuuttavilta - tehtävä, joka ennen vaati huomattavaa vaivannäköä ja kirjoitustaitoa.

Vielä huolestuttavampaa on se, että rikolliset yhdistävät nämä väärennetyt tarinat nyt Tekoälyn luoma todistusaineisto. Kuvantuotantomalleilla (kuten Midjourney tai DALL-E) ja muokkaustyökaluilla voidaan tuottaa fotorealistisia vaurio- ja vammakuvia. Alan raporttien mukaan jotkut kuljettajat ovat alkaneet tekoälyn tuottamien kuvien esittäminen ajoneuvon vaurioiden liioittelemiseksi autovaateissa.[5]. Generatiivinen tekoäly voi luoda kuvan romuttuneesta autosta tai tulvivasta kodista, jota ei ole koskaan ollut olemassa. Nämä kuvat ovat usein realistisempia kuin mitä vanhemmilla Photoshop-tekniikoilla voitiin saavuttaa.[6], minkä vuoksi niitä on vaikea havaita paljain silmin. Huhtikuussa 2025 Zurich Insurance havaitsi, että korvausvaatimusten määrä kasvoi, kun - väärennetyt laskut, väärennetyt korjausarviot ja digitaalisesti muunnetut valokuvat.mukaan lukien tapaukset, joissa ajoneuvojen rekisterinumerot lisättiin tekoälyn avulla kuviin, joissa oli kuvia romutetuista autoista.[7][8]. Kun tällaiset väärennetyt todisteet yhdistetään hyvin laadittuun tekoälyn laatimaan hakemuslomakkeeseen, ne voivat ohittaa manuaalisen tarkistuksen.

Eräässä Yhdistyneessä kuningaskunnassa sattuneessa silmiinpistävässä tapauksessa huijarit veivät sosiaalisessa mediassa otetun valokuvan kauppiasautosta ja lisätä tekoälyn avulla haljennut puskuri.ja toimitti sen sitten yhdessä väärennetyn 1000 punnan korjauslaskun kanssa osana väärennettyä kolarikorvausvaatimusta.[9]. Huijaus paljastui vasta, kun tutkijat huomasivat... sama pakettiauton kuva (ennen vahinkoa) omistajan Facebook-sivulla.[10]. Tämä kuvaa laajempaa ilmiötä: vakuutuksenantajat raportoivat, että 300% hyppy "shallowfake"-kuvamuokkauksissa. (yksinkertaiset digitaaliset manipulaatiot vaurioiden lisäämiseksi tai yksityiskohtien muuttamiseksi) vain yhden vuoden aikana (2021-2022 vs. 2022-2023).[4]. Allianz UK varoitti vuonna 2024, että digitaalisten valokuvien vääristämisellä ja väärennetyillä asiakirjoilla on "kaikki merkit siitä, että niistä on tulossa viimeisin suuri huijaus, joka iskee alalle".[4]. Zurichin korvauspetoksista vastaava päällikkö totesi myös, että Se, mikä ennen vaati fyysisen kolarin lavastamista, voidaan nyt tehdä kokonaan tietokoneen takana. - huijarit voivat "luoda petollisen korvausvaatimuksen näppäimistönsä takaa ja saada huomattavia summia" väärennettyjen valokuvien ja raporttien avulla.[11][12]. Tämä muutos ei ainoastaan lisää väärennettyjen korvausvaatimusten määrää, vaan se myös alentaa mahdollisten huijareiden kynnystä päästä markkinoille.

Älä enää koskaan ole huolissasi tekoälypetoksista. TruthScan Voi auttaa sinua:

- Tunnista AI luotu kuvat, teksti, ääni ja video.

- Vältä merkittävä tekoälyyn perustuva petos.

- Suojaa kaikkein herkkä yrityksen omaisuuserät.

Autojen lisäksi, omaisuus- ja vahinkovahingot näkevät tekoälyavusteista tappioiden inflaatiota. On raportoitu väärennetyistä valokuvista matkavakuutusta varten (esim. matkatavaroiden "vahingoittuminen" tai lavastetut varkauskohtaukset) ja tekoälyn luomat kuitit kalliista tavaroista, joita ei ole koskaan ostettu. Henki- ja sairausvakuutuskorvaukset eivät myöskään ole immuuneja - huijarit ovat luoneet väärennettyjä sairauskulut ja kuolintodistukset käyttämällä tekoälyn asiakirjaväärennöksiä. Zürich huomasi, että deepfake-teknologiaa käytettiin luomaan täysin kuvitteelliset insinöörien arviot ja lääkärinlausunnot. korvauspaketeissa[11]. Näitä tekoälyn luomia asiakirjoja, joissa on usein realistisia logoja ja allekirjoituksia, ei voi erottaa aidoista papereista. Henkivakuutusyhtiöiden huolenaiheena on kuolinilmoitus- ja kuolintodistuspetokset: rikolliset voivat käyttää tekoälyä tuottamaan väärennettyjä kuolinilmoituksia tai lääkärin kirjeitä tukeakseen kuolemantapausta jonkun sellaisen henkilön osalta, joka on todellisuudessa yhä elossa (tai jota ei ole koskaan ollutkaan, kuten seuraavassa käsitellään).

Synteettiset vakuutuksenottajat ja identiteetit

Ehkä salakavalin kehitys on synteettinen identiteettipetos vakuutuksissa. Synteettisessä identiteettipetoksessa luodaan fiktiivinen henkilö tai yhteisö yhdistämällä todellisia tietoja (varastettuja sosiaaliturvatunnuksia, osoitteita jne.) väärennettyihin tietoihin (väärennetyt nimet, väärennetyt henkilöllisyystodistukset). Tekoälyn kehittyminen on helpottanut huomattavasti seuraavien tekijöiden luomista realistiset henkilöprofiilit - valokuvineen ja tunnuksineen - henkilöille, joita ei ole olemassa.[13][14]. Huijarit voivat nyt algoritmisesti luoda täysin väärän asiakkaan, ostaa vakuutuksen hänen nimissään ja myöhemmin esittää korvausvaatimuksia tai vakuutuskorvauksia tämän väärennetyn henkilöllisyyden perusteella.

Henkivakuutusalalla synteettiset identiteettijärjestelmät ovat olleet nousi pilviin. Vuonna 2025 tehdyssä alan tutkimuksessa arvioidaan, että synteettisen identiteettipetoksen kustannukset - yli $30 miljardia euroa vuodessa, jonka osuus on peräti 80-85% kaikista identiteettipetostapauksista. rahoituspalvelujen alalla[15][16]. Henkivakuutusyhtiöt ovat kärsineet erityisen pahasti: huijarit ovat tunnetusti tehneet - hankkia henkivakuutuksia fiktiiviselle henkilölle ja sitten "tappaa" kyseinen henkilö paperilla saadakseen kuolemantapauskorvauksen.[17]. Huijari voi esimerkiksi luoda synteettisen asiakkaan nimeltä "John Doe", maksaa vakuutusmaksuja vuoden ajan ja esittää sitten korvaushakemuksen väärennetyllä kuolintodistuksella ja kuolinilmoituksella John Doen ennenaikaisesta kuolemasta. Koska henkilöllisyys on rakennettu huolellisesti (luottotiedot, julkiset rekisterit jne.), kuolemantapausta koskeva vaatimus voi vaikuttaa lailliselta - kunnes todellista ruumista tai todellisia sukulaisia ei löydy. Kun huijaus paljastuu, tekijät ovat jo kauan sitten häipyneet maksun kanssa.

Myös synteettiset identiteettijärjestelmät vaivaavat sairausvakuutus ja autovakuutus. Rikollisringit luovat "Frankenstein"-identiteettejä luomalla käyttämällä lasten tai vanhusten sosiaaliturvatunnuksia (joilla ei ole luottohistoriaa) yhdistettynä tekoälyn luomiin nimiin ja ajokortteihin.[15]. Sitten he ostavat sairaus- tai autovakuutuksia näille väärennetyille henkilöille ja esittävät pian sen jälkeen suuria korvausvaatimuksia.. Yksi vaihtoehto on syndikaattien perustaminen valeyritykset (peiteyhtiöt) - esimerkiksi näennäinen kuorma-autoyhtiö - ja ostaa sille kaupallisen vakuutuksen, jotta se voisi myöhemmin esittää korvausvaatimuksia lavastettujen onnettomuuksien tai näennäisten työntekijöiden vammojen perusteella.[18][19]. Koska yritys on olemassa vain paperilla (tekoälyn luomat yritysrekisterit ja verotunnisteet), tämä "synteettiset petokset, jotka perustuvat yksikköihin paljastuu usein vasta korvausten maksamisen jälkeen.[18][20].

Miksi synteettiset identiteetit ovat niin tehokkaita? Ensinnäkin ne läpäisevät usein automaattiset henkilöllisyyden tarkistukset. Luottotietotoimistot ja KYC-järjestelmät saattavat löytää... ei punaisia lippuja koska henkilöllisyys sisältää joitakin todellisia, päteviä tietoja (esim. oikea SSN-tunnus, jolla on puhdas rekisteri).[21]. Samaan aikaan tekoälyn luomat profiilikuvat ja henkilöllisyystodistusten skannaukset voivat näyttää täysin aidoilta - nykypäivän tekoäly voi tuottaa ihmisen kasvot, jotka jopa kehittynyt kasvojentunnistus voisi hyväksyä aidoiksi. Tulos: useimmat automaattiset järjestelmät tunnistavat nämä profiilit laillisiksi ja petos paljastuu (jos paljastuu lainkaan) vasta suurten tappioiden jälkeen.[22].

Vaikutukset todellisessa maailmassa: RGA:n mukaan synteettiset identiteettipetokset henkivakuutusalalla maksavat alalle nyt noin $30B vuodessa. ja se on kasvanut lähes 400% vuodesta 2020 lähtien.[15][16]. Yhdysvaltain liittovaltion kauppakomissio Federal Trade Commission arvioi, että suurin osa identiteettipetoksista on synteettisiä henkilöllisyystodistuksia.[16]. Nämä tappiot kohdistuvat lopulta rehellisten vakuutuksenottajien lompakoihin - jokainen perhe maksaa vuosittain arviolta \$700 ylimääräistä vakuutusmaksua vakuutuksenantajien laajemman petoskuorman vuoksi.[15]. Vakuutusyhtiöt reagoivat tähän tehostamalla tarkistuksia vakuutuksen vastaanottamisen ja korvausvaatimusten yhteydessä: tietokantatarkistukset henkilöllisyyden yhdistämiseksi, useiden samassa osoitteessa olevien vakuutusten seuranta ja jopa "elävyystestien" suorittaminen (selfie-videotarkistukset, joilla varmistetaan, että hakija on todellinen henkilö eikä vain tekoälyn kuva).[23][24]. Mutta kuten näemme, huijarit käyttävät tekoälyä seuraavalla areenalla: väärennetyt äänet ja videot.

Deepfake-äänet ja videoväitteet

Tekoälyn luoma audio- ja videoväärennökset lisäävät vakuutuspetoksiin uuden hälyttävän ulottuvuuden. Vuosina 2023 ja 2024 tapahtui useita tapauksia, joissa rikolliset käyttivät seuraavia keinoja. äänen kloonaus henkilöitymään yksityishenkilöiksi puhelimitse - taktiikka, joka on alun perin nähty pankkiryöstöissä (kuten surullisenkuuluisa deepfake-pääjohtajan puhelinsoitto, jolla varastettiin $35 miljoonaa euroa vuonna 2020), mutta joka on nyt levinnyt vakuutuksiin. Huijarit kloonaavat vakuutuksenottajien, lääkäreiden tai korvauskäsittelijöiden ääniä ja käyttävät niitä sosiaalisessa huijauksessa. Pindropin vuoden 2024 analyysissä varoitettiin, että "Syväväärennökset, synteettinen ääniteknologia ja tekoälypohjaiset huijaukset muokkaavat petosmaisemaa.", äänipetoksella skaalautuminen ennennäkemättömällä vauhdilla[25]. He löysivät vakuutuspalvelukeskuksia pommittivat ulkomaiset pahat toimijat, jotka käyttivät ääniväärennöksiä: esimerkiksi puhelut tulisivat ja antaisivat todellisen vakuutuksenottajan varastetun SSN- ja henkilötiedot, ja jos agentti vastaisi, vakuutuksenottajan soittajan tekoälyllä kloonattu ääni voi huijata agenttia tietoon perustuvan todennuksen avulla. ja pyytää vilpillistä maksua -[26]. Eräässä länsirannikon vakuutusyhtiön tapauksessa hyökkääjät käyttivät tätä menetelmää toistuvasti yrittäessään ottaa tilejä haltuunsa ja ohjata maksuja, hyödyntäen sitä, että puhelinpalvelukeskuksen tunnistustarkastus perustui ääni- ja henkilötietoihin, jotka voidaan väärentää.[26].

Äänen jäljittelyä on käytetty myös kuluttajapuolella: Huijaajat ovat soittaneet onnettomuuden uhreille tai edunsaajille, kun vakuutusedustajiksi tekeytyminen, jotka käyttävät tekoälyn ääniä kuulostamaan virallisilta, jotta he voivat huijata arkaluonteisia tietoja tai jopa maksuja. Kääntäen petollinen voi esiintyä asiakkaana korvaushotlineen puhuessaan. tehdä reklamaatio puhelimitse käyttäen asiakkaan sukupuolta/ikää vastaavaa syvää tekoääntä.ja ohittaa näin äänibiometriset tarkastukset. Viimeaikaiset petostilastot ovat raitistavia: alan asiantuntijat ennustavat, että 162% Vakuutusyhtiöihin kohdistuvien petoshyökkäysten lisääntyminen (deepfake) tulevana vuonna[27], ja Pindrop kirjasi 475% synteettisten äänihyökkäysten piikki vuonna 2024 kuten aiemmin mainittiin[2]. Nämä hyökkäykset ovat nopeasti ohittamassa perinteisemmät verkkopetosvektorit.

Puheluiden lisäksi, videopohjaiset väärennökset syntyy korvausvaatimusprosessissa. Monet vakuutuksenantajat ovat ottaneet käyttöön virtuaaliset vahinkotarkastukset ja videoneuvottelut (joita pandemia vauhditti), jotta vahinkoja voidaan tarkistaa tai haastatella korvauksenhakijoita etänä. Nyt huijarit ovat tekoälyavattarien ja väärennettyjen videoiden hyödyntäminen näiden tarkistusten huijaamiseksi.. On raportoitu, että hakijat ovat käyttäneet Tekoälyn luomat avatarit suorissa videopuheluissa säätelijöiden kanssa, jotta he voisivat esiintyä jonkun toisena tai peittää epäjohdonmukaisuuden merkit.[28]. Petosverkosto voi esimerkiksi käyttää deepfake-tietokonetta "live"-video oletetusta asianomistajasta, joka näyttää vahinkonsa älypuhelimen välityksellä., vaikka kamerassa oleva henkilö on tekoälyn syntetisoima kooste tai palkattu näyttelijä, jolla on kasvoja muuttavat suodattimet. Eräs spekulatiivinen mutta uskottava skenaario on käyttää deepfake-kuvaa kuolleet henkilö: Perheenjäsen voi käyttää hiljattain kuolleen henkilön väärennettyä videokuvaa rutiininomaisen elämäntodistuspuhelun aikana saadakseen edelleen maksuja.[29]. Vaikka yhtään tämänkaltaista korkean profiilin tapausta ei ole vielä julkistettu, vakuutuksenantajat varautuvat siihen. Myös sääntelyviranomaiset ovat ottaneet huomioon - Yhdysvalloissa ja Euroopassa käydään keskusteluja väärennösten luokittelemisesta identiteettivarkauksiin ja vakuutusten todisteiden todentamista koskevien ohjeiden päivittämisestä.[30].

Väärennettyjen videoiden ja äänen havaitseminen on hyvin haastavaa ilman teknisiä työkaluja. Ihmiskorjaajia ei ole koulutettu havaitsemaan hienovaraisia huulisynkronointiongelmia tai akustisia outouksia. Joissain tapauksissa on kuitenkin havaittu punaisia lippuja: esimerkiksi luonnotonta räpyttelyä tai kasvojen häiriöitä videolla tai puhelun taustaäänen artefakteja, jotka ovat antaneet vihjeen tutkijoille. Kaiken kaikkiaan, deepfake-vakuutuspetos on vielä alkuvaiheessa, ja syytteeseenpano on edelleen harvinaista - vuonna 2023 oikeudelliset määritelmät olivat epäselviä, ja videon osoittaminen tekoälyn tuottamaksi oli vaikeaa ilman asiantuntija-analyysiä.[31]. Tämä antaa huijareille rangaistuksettomuuden tunteen. Asevarustelukilpailu on käynnissä: vakuutuksenantajat ovat nyt kääntymässä rikostekninen tekoäly tekoälyn torjumiseksiottaa käyttöön deepfake-tunnistusalgoritmeja, jotka tutkivat epäilyttäviä videoita ruutu kerrallaan manipuloinnin merkkien varalta.[24]. Äänibiometriikkatoimittajat tuovat markkinoille deepfake-äänentunnistimia, jotka analysoivat spektrisiä kuvioita ja äänenkäytön tahtia aitouden varmistamiseksi.[32]. Käsittelemme näitä puolustustekniikoita myöhemmässä jaksossa.

Tekoälyä tehostetut phishing- ja imitaatiohuijaukset

Kaikki tekoälyyn perustuvat petokset eivät tapahdu korvausosaston kautta, vaan osa kohteista on sellaisia. asiakkaat ja työntekijät sosiaalisen manipuloinnin avulla. Tekoälyn laatimat kalastelusähköpostit ja tekstit ovat muodostuneet suureksi uhaksi vakuutusalalla. Näissä järjestelmissä huijarit käyttävät tekoälyä hyödyntäviä chatbotteja ja käännöstyökaluja luodakseen erittäin vakuuttavia huijausviestejä. Rikolliset voivat esimerkiksi jäljitellä vakuutusyhtiön brändiä ja kirjoitustyyliä ja lähettää vakuutuksenottajille massiivisia phishing-sähköpostiviestejä, joissa kerrotaan, että "vakuutuksen peruuttamisen estämiseksi tarvitaan kiireellisiä toimia" ja ohjataan heidät väärennetylle verkkosivustolle. Toisin kuin aiemmat kömpelöt huijaussähköpostit, Tekoäly varmistaa moitteettoman kieliopin ja jopa personoinnin.mikä tekee niistä paljon uskottavampia. Olemme nähneet tekoälyn käyttävän sosiaalisesta mediasta tietoja, joita käytetään spear-phishing-viesteihin, kuten viittaus äskettäiseen auton ostoon väärennetyssä autovakuutusilmoituksessa.

Toinen vektori on Asiamiesten tai johtajien tekoälyavusteinen henkilöityminen. On ollut tapauksia, joissa huijarit kloonasivat vakuutusyhtiön omistajan äänen ja jättivät asiakkaille ääniviestejä, joissa pyydettiin pankkitietojen päivittämistä - käytännössä kyseessä oli ääni phishing-hyökkäys. Myös sisäiset petokset voivat johtua tekoälyn jäljittelystä: erään vakuutusyhtiön rahoitusosasto oli vähällä joutua uhriksi, kun huijarit lähettivät väärennetyn ääniviestin. väitetysti toimitusjohtajalta varainsiirron salliminen (toimitusjohtajapetoksen muunnelma, joka nykyään kuuluu joidenkin sähköisen rikollisuuden vakuutusten piiriin).[33]). Tällaiset tekoälyn ohjaamat huijaukset kasvoivat 17% vuonna 2023 Liberty Specialty Marketsin mukaan.[33]ja niiden odotetaan edelleen nousevan.

Kuluttajat joutuvat myös synteettisten mediahuijausten kohteeksi. sidottu vakuutukseen. Coalition Against Insurance Fraud toteaa, että vakuutuspetoksia vastaan toimivat huijarit ovat esiintyneet vakuutussovittelijoina, ottaneet yhteyttä onnettomuuden uhreihin väittäen hoitavansa heidän korvausvaatimuksensa ja sitten välittömän maksun tai arkaluonteisten tietojen vaatiminen[23]. Pahaa aavistamattomat asiakkaat, jotka ovat helpottuneita kuullessaan oletetusta edustajasta, saattavat suostua, varsinkin jos soittaja tiesi yksityiskohtia heidän onnettomuudestaan (jotka tekoäly voisi saada selville hakkeroinnista tai julkisista lähteistä). Yleinen tietoisuus näistä taktiikoista on vähäistä, joten petosten torjunnan asiantuntijat kehottavat vakuutuksenantajia tekemään seuraavaa vakuutuksenottajien valistaminen soittajien ja sähköpostiviestien henkilöllisyyden tarkistamisesta.[23][34]. Aivan kuten pankit varoittavat asiakkaita tietojenkalastelusta, vakuutusyhtiöt vuonna 2025 alkavat sisällyttää viestintäänsä varoituksia huijaushuijauksista.

Yksi yhteinen tekijä näissä tekoälyllä tehostetuissa järjestelmissä on helposti saatavilla olevien "petos-palvelupakettien" käyttö.[35]. Pimeässä verkossa rikolliset voivat ostaa tai tilata työkaluja, jotka tarjoavat valmiita väärennettyjä ääniä, väärennettyjä asiakirjamalleja, phishing-sähköpostigeneraattoreita ja paljon muuta. Tekoälytyökalujen demokratisoituminen tarkoittaa, että jopa heikosti koulutetut huijarit voivat käynnistää kehittyneitä petoshyökkäyksiä.[35]. Vakuutusyhtiöiden kannalta tämä tarkoittaa entistä vakuuttavampia petosyrityksiä, joita tulee joka puolelta - korvausvaatimuksista, asiakaspalvelusta, sähköpostista ja jopa sosiaalisesta mediasta. Tämä korostaa tarvetta monitahoiseen puolustusstrategiaan, jossa yhdistyvät teknologia, inhimillinen valppaus ja toimialojen välinen yhteistyö.

Havaitseminen ja puolustautuminen: AI-powered Response

Tekoälypohjaisten petosten torjunta edellyttää Tekoälyohjattu puolustus. Vakuutusyhtiöt turvautuvat yhä useammin kehittyneisiin havaintotekniikoihin ja uudistettuihin prosesseihin vastustaakseen hyökkäystä. Vakuutusyhtiöiden on pohjimmiltaan sisällytettävä sisällön todentamisen tarkistuspisteet koko vakuutuksen elinkaaren ajan - vakuutusten myöntämisestä korvausvaatimuksiin ja asiakasvuorovaikutukseen - tekoälyn väärennösten havaitsemiseksi. Kuvassa 2 esitetään tekoälyn mahdollistamat keskeiset petostyypit ja niiden yleisyys, ja seuraavissa jaksoissa kerrotaan yksityiskohtaisesti, miten kukin niistä voidaan havaita ja estää.

Kuva 2: Tekoälyllä tehostettujen vakuutuspetosten tyypit vuonna 2025 (arvioitu osuus järjestelmittäin). Väärennetyt kuvat (väärennetyt valokuvat vahingoista) ja synteettiset henkilöllisyydet kuuluvat suurimpiin luokkiin, ja niitä seuraavat tekoälyllä väärennetyt asiakirjat (esim. kuitit, todistukset) ja väärennetyt ääni-/videohuijaukset.

1. Tekoälyn sisällöntunnistustyökalut: Uudet tekoälyn havaitsemispalvelut voivat analysoida tekstiä, kuvia, ääntä ja videota määrittääkseen, ovatko ne koneellisesti tuotettuja tai manipuloituja. Vakuutusyhtiöt voivat esimerkiksi hyödyntää sellaisia ratkaisuja kuten TruthScanin tekoälytekstin ja kuvien tunnistimet jotka käyttävät 99%+ tarkkaa tekoälyä merkitäkseen tekoälyllä kirjoitetut asiakirjat tai väärennetyt valokuvat.[36]. Vakuutusyhtiö voisi integroida nämä ilmaisimet korvausvaatimusjärjestelmäänsä: kun korvausvaatimus ja siihen liittyvät todisteet toimitetaan, tekstikuvaus voidaan automaattisesti skannata tekoälyn luoman kielen mallien varalta, ja kaikki ladatut kuvat voidaan skannata CGI:n tai muokkauksen merkkien varalta. Yritystason työkalut voivat tunnistaa tekoälyn luoman tekstin asiakirjoista, sähköposteista ja viestinnästä 99%-tarkkuudella.[36]ja vastaavasti tunnistaa tekoälyn luomat tai manipuloidut kuvat visuaalisen sisällön aitouden varmistamiseksi.[36]. Tämä tarkoittaa sitä, että ChatGPT:n tuottama väärennetty onnettomuuskertomus tai kesken matkan väärennetty vahinkokuva merkitään manuaalisesti tarkistettavaksi ennen korvaushakemuksen käsittelyä. Vakuutusyhtiöt vuonna 2025 ottavat yhä useammin käyttöön tällaista tekoälyn sisällön todentamista - itse asiassa, 83% petostentorjunta-alan ammattilaisista aikoo integroida generatiivisen tekoälyn havaitsemisen vuoteen 2025 mennessä.ACFE:n tutkimuksen mukaan vain 18% käyttää sitä nykyään.[37][38].

2. Henkilöllisyyden todentaminen ja biometriset tarkastukset: Synteettisten identiteettien torjumiseksi vakuutusyhtiöt parantavat KYC-protokollia myös tekoälyn avulla. Henkilöllisyyden validointipalvelut voivat vertailla hakijan tietoja useisiin tietokantoihin ja käyttää kasvojentunnistusta ja elävyystestejä. Esimerkiksi vaatimalla lyhyt videokuvaselfie sisäänkirjautumisen yhteydessä (ja käyttämällä kasvojentunnistusta annettuun henkilöllisyystodistukseen) voidaan estää monet synteettiset henkilöllisyystodistukset. TruthScanin kaltaiset yritykset, jotka ovat vieläkin enemmän huipputekniikkaa, tarjoavat kuvien rikosteknistä tutkimusta, jolla voidaan tekoälyn luomat profiilikuvat, avatarit ja synteettiset persoonakuvat paikalla - heidän tekoälykuvantunnistimensa on koulutettu tunnistamaan kasvot, jotka on tehty StyleGANin tai ThisPersonDoesNotExist-generaattoreiden kaltaisilla generaattoreilla.[39]. Tällaisia työkaluja käyttämällä vakuutuksenantaja voi havaita, jos henkivakuutuksen hakijan selfie ei ole oikea ihminen. Äänen puolella, ääni biometrinen tunnistus asiakaspalvelupuheluissa voi auttaa; nykyaikaiset äänitekoälyilmaisimet pystyvät havaitsemaan tunnistaa synteettiset äänet ja äänien kloonausyritykset reaaliajassa[40]. Esimerkiksi TruthScanin Tekoälyn äänentunnistus järjestelmä käyttää akustista analyysia tunnistaa tekoälyn luomat äänet ja ääniväärennökset ennen kuin ne huijaavat puhelinkeskuksen henkilökuntaa.[40]. Nämä ratkaisut toimivat palomuurin tavoin - jos joku soittaa teeskennellen olevansa John Doe ja hänen äänitunnuksensa ei vastaa John Doen aitoa ääntä (tai vastaa tunnettuja väärennettyjä ominaisuuksia), puhelu voidaan merkitä tai vaatia lisätodisteita henkilöllisyydestä. Monitekijätodennus (sähköposti- tai tekstiviestivahvistus, kertakäyttökoodit jne.) lisää esteet, jotka huijareiden on voitettava.

3. Deepfake Video & Image Forensics: Videotodisteiden osalta vakuutusyhtiöt alkavat ottaa käyttöön erikoistunutta rikosteknistä analyysia. Kehittyneillä ohjelmistoilla voidaan analysoida videon metatietoja, kuvien yhdenmukaisuutta ja virhetasoja väärennösten havaitsemiseksi. Jotkin työkalut tutkivat heijastuksia, varjoja ja fysiologisia vihjeitä (kuten pulssi henkilön kurkussa videolla) varmistaakseen, että video on aito. Metatiedon rikostekninen tutkiminen on myös arvokasta: tiedostojen metatietojen ja kuvien tai PDF-tiedostojen sukupolvenjälkien tutkiminen voi paljastaa, onko jokin tiedosto todennäköisesti tuotettu tekoälytyökalulla.[41]. Vakuutusyhtiöiden tulisi vaatia alkuperäisiä valokuvatiedostoja (jotka sisältävät metatietoja) eikä esimerkiksi pelkkiä kuvakaappauksia tai tulostettuja kopioita. Zurichin petosryhmä havaitsi, että väärennettyjen autokuvien jäljittämisessä onnistuttiin havaitsemaan poikkeavuuksia kuvan metatiedoissa ja virhetason analyysissä.[41]. Sähköpostihuijausten havaitsimet voi myös skannata saapuvaa viestintää merkkien tekoälyn kirjoittaman phishing-sisällön tai tunnettujen haitallisten allekirjoitusten varalta.[42]. Monet vakuutusyhtiöt suorittavat nykyään työntekijöiden koulutuksessa phishing-simulaatioita ja tekoälyn laatimia huijausesimerkkejä tietoisuuden lisäämiseksi.

4. Prosessimuutokset ja ihmisten koulutus: Pelkkä teknologia ei ole hopealuoti. Prosessin parannukset on toteutettu, kuten useampia satunnaisia henkilökohtaisia pistokokeita arvokkaiden korvausvaatimusten osalta tai fyysisten asiakirjojen vaatiminen tietyissä tapauksissa. Jotkin vakuutusyhtiöt ovat lykänneet täysin automatisoitua suoraviivaista korvausvaatimusten käsittelyä ja ottaneet uudelleen käyttöön ihmisen suorittaman tarkastuksen sellaisten korvausvaatimusten osalta, jotka ovat saaneet korkean pistemäärän tekoälyn petosriskimallissa. Ihmisten koulutus on ratkaisevan tärkeää. Petostutkijoita ja korvausasiantuntijoita koulutetaan tunnistamaan tekoälyn punaiset liput: esimerkiksi useat korvausvaatimukset, joissa käytetään samanlaista sanamuotoa (ChatGPT-tyyli), kuvat, joista puuttuu todellinen satunnaisuus (esim. toistuvat kuviot kuvissa, joiden pitäisi olla orgaanisia vaurioita), tai äänet, jotka kuulostavat melkein oikealla mutta robottimaisella tahdilla. Vakuutusyhtiöt myös valistavat asiakkaita: ne lähettävät petosvaroituksia väärennösjärjestelmistä ja neuvovat, miten vakuutusedustajan henkilöllisyys voidaan varmistaa (esimerkiksi antamalla tunnettu takaisinsoittonumero).

5. Yhteistyöponnistelut: Teollisuuden laajuinen yhteistyö on lisääntymässä. Yhdistyneessä kuningaskunnassa Insurance Fraud Bureau ja Association of British Insurers ovat perustaneet tekoälypetoksia käsitteleviä työryhmiä, ja hallituksen laatima Vakuutuspetoksia koskeva peruskirja (2024) edistää tietojen jakamista ja yhteisiä aloitteita[43]. Vakuutusyhtiöt tekevät maailmanlaajuisesti yhteistyötä kyberturvallisuusyritysten ja tekoälyä kehittävien startup-yritysten kanssa. Uusia vakuutustuotteita on ilmestymässä: Liberty Mutual lanseerasi pk-yrityksille tarkoitettu sähköisen rikollisuuden vakuutus, joka kattaa erityisesti huijaukset ja toimitusjohtajapetokset.[44][33], mikä korostaa, että tämä riski on hyvin todellinen. Tämä tarkoittaa myös sitä, että vakuutuksenantajat saattavat joutua sekä tekoälypetosten uhreiksi että niiden ratkaisijoiksi - he voivat maksaa korvauksia deepfake-huijauksesta, jos sitä ei havaita, mutta tarjota myös vakuutusturvaa muille, jotka joutuvat tällaisten hyökkäysten kohteeksi.

Tunnistustekniikan integrointi työnkulkuihin voidaan visualisoida monipistepuolustuksena korvausvaatimusten elinkaaressa. Kuten kuvassa Kuva 3vakuutuksenantajat voivat lisätä tekoälyn todentamisvaiheita osoitteessa politiikan soveltaminen (synteettisten henkilöllisyyksien seulominen henkilöllisyystodistusten ja selfie-tarkastusten avulla), osoitteessa korvaushakemuksen jättäminen (ladattujen asiakirjojen, valokuvien tai äänen automaattinen analysointi tekoälyn tuottamista varten). korvausvaatimusten tarkastelu/tutkinta (epäilyttäville todisteille tehdään rikostekninen deepfake-analyysi ja tarkistetaan mahdolliset äänivuorovaikutukset), ja juuri ennen kuin maksu (viimeinen henkilöllisyyden todentaminen, jolla varmistetaan, että maksunsaaja on laillinen). Havaitsemalla petokset varhaisessa vaiheessa - mieluiten jo vakuutuksen kirjaamisen tai ensimmäisen vahinkoilmoituksen yhteydessä - vakuutuksenantajat säästävät tutkintakustannuksia ja välttävät aiheettomia maksuja.

Kuva 3: Tekoälyn havaitsemiskohtien integrointi vakuutuksen elinkaareen. Vakuutuksen ottamisen yhteydessä tekoälypohjainen identiteetin validointi tarkistaa, ettei kyseessä ole synteettinen tai väärennetty henkilöllisyys. Kun korvaushakemus jätetään, automaattiset tunnistimet tarkastavat korvaushakemustekstin, asiakirjat ja kuvat tekoälyn luoman sisällön varalta. Korvausvaatimusten tarkistuksen aikana erikoistuneet deepfake- ja äänianalyysityökalut tarkistavat kaikki audio-/videotodisteet. Ennen maksun suorittamista biometrinen henkilöllisyyden todentaminen vahvistaa edunsaajan henkilöllisyyden. Tämä monikerroksinen lähestymistapa auttaa estämään petokset useissa vaiheissa.

Vakuutusyhtiöiden ei tarvitse rakentaa kaikkia näitä valmiuksia itse, vaan monet käyttävät yritysratkaisuja, kuten TruthScanin AI Detection Suite -ohjelmisto, joka tarjoaa erilaisia työkaluja, jotka voidaan integroida API:n kautta vakuutusyhtiöiden järjestelmiin. Esim, TruthScanin AI Image & Deepfake Detection -palvelu voidaan käyttää kuvien ja videoiden aitouden tarkistamiseen yli 99% tarkkuudella.[45]. Heidän Tekoälytekstin tunnistin merkitsee tekoälyn kirjoittaman tekstin väitteissä tai sähköposteissa.[36], kun taas AI Voice Detector tarjoaa äänen kloonauksen tunnistuksen ja kaiuttimen todentamisen puhelimen huijareiden pysäyttämiseksi.[40]. On jopa kapealla työkaluja, kuten Väärennetty kuitti Detector laskujen/kuittien välitön analysointi väärennösten tai tekoälyn luomien fonttien/asettelujen varalta.[46] - erittäin hyödyllinen, kun otetaan huomioon väärennettyjen korjauslaskujen yleisyys korvausvaatimuksissa. Käyttämällä näiden välineiden yhdistelmää vakuutuksenantaja voi parantaa huomattavasti petosten havaitsemisastettaan. Eräs Fortune 500 -vakuutusyhtiö raportoi, että 97% deepfake-yritykset vuonna 2024 käyttämällä monitasoista tekoälyn seulontamenetelmää (teksti, kuva, ääni) ja välttämällä siten arviolta \$20M tappioita.[47][48].

Päätelmä

Tekoäly muuttaa vakuutuspetosten torjuntaa maailmanlaajuisesti. Petostentekijät innovoivat tekoälyn avulla luodakseen entistäkin vakuuttavampia valheita - täysin keksityistä henkilöistä ja onnettomuuksista aina henkilöitymiseen, joka voi huijata jopa kokeneita ammattilaisia. Vuosien 2024-2025 tiedot osoittavat, että tekoälyllä toimivien järjestelmien määrä kasvaa hälyttävästi, mutta ne myös korostavat, että havaitsemiseen ja ennaltaehkäisyyn investoivat vakuutusyhtiöt voivat pysyä askeleen edellä. Yhdistämällä huippuluokan tekoälyn tunnistustekniikka - kuten kuvien rikostutkinta, äänitodennus ja tekstianalyysi - päivitetyillä työnkuluilla ja koulutuksella ala voi vähentää riskejä uhraamatta digitaalisten prosessien tuomaa tehokkuutta.

Kyse on pohjimmiltaan teknologisesta kilpavarustelusta, -[49]. Kuten eräs petostentorjunnan asiantuntija totesi, "Tässä uudessa todellisuudessa valppaus on palkkio, joka on maksettava"[50]. Vakuutusyhtiöiden on edistettävä valppautta ja hyödynnettävä parhaita käytettävissä olevia välineitä luottamuksen säilyttämiseksi korvausprosessiin. Tämä tarkoittaa, että asiakirjojen, äänien ja kuvien todenperäisyys on tarkistettava samalla tarkkuudella kuin vakuutuksenantajat arvioivat riskejä. Se tarkoittaa myös yhteistyötä koko toimialan kesken, jotta voidaan jakaa tietoa uusista tekoälypetostaktiikoista ja kehittää yhdessä standardeja (esimerkiksi toimitetun median metatietovaatimuksia tai toimialan mustia listoja tunnetuista väärennetyistä henkilöllisyyksistä).

Vuosi 2025 on käännekohta: vakuutuksenantajat, jotka - sopeutua ennakoivasti tekoälyyn perustuviin petoksiin. suojaavat asiakkaitaan ja taseitaan, kun taas hitaasti reagoivat saattavat joutua otsikoihin nousevien huijausten kohteeksi. Rohkaiseva uutinen on se, että teknologia, jonka avulla voidaan torjua huijauksia, on olemassa ja kehittyy nopeasti - sama tekoäly, joka antaa petoksentekijöille voimavaroja, voi antaa myös vakuutusyhtiöille voimavaroja. Ottamalla käyttöön ratkaisuja, kuten TruthScanin monimodaalinen tekoälyn havaitsemispaketti korvausvaatimuksia ja henkilöllisyyden todentamista varten, vakuutuksenantajat voivat vähentää huomattavasti tekoälyn tuottamien petosyritysten onnistumisprosenttia.[51][52]. Näin ne eivät ainoastaan estä tappioita, vaan myös lähettävät selkeän viestin mahdollisille petoksentekijöille: olivatpa työkalut kuinka nokkelia tahansa, petokset paljastuvat.

Yhteenvetona voidaan todeta, että tekoälyyn perustuva vakuutuspetos on valtava haaste, mutta siihen voidaan vastata yhtä älykkäällä puolustuksella. Valppauden, monialaisen strategian ja oikeiden teknologiakumppaneiden avulla vakuutusala voi jatkossakin pitää kiinni liiketoimintansa ytimessä olevasta peruslupauksesta - maksaa vain lailliset korvausvaatimukset nopeasti ja turvallisesti yhä digitaalisemmassa maailmassa.

Viitteet:

- Association of British Insurers - Petostilastot 2023[53][54]

- Allianz ja Zurich tekoälyyn perustuvasta "shallowfake"-vaateiden kasvusta - The Guardian, 2024[4][11]

- Facia.ai - "Vakuutuspetos: Rewriting the Rules," lokakuu 2025[55][56]

- Koalitio vakuutuspetoksia vastaan - Synteettiset petokset vakuutusalalla (Quantexa), joulukuu 2024[21][17]

- RGA - "Petostentorjunnan uusi rajapyykki: synteettiset identiteetit". kesäkuu 2025[15][16]

- Pindrop - Voice Fraud Report, via FierceHealthcare, kesäkuu 2025[2][3]

- Numeroiden kääntäminen - "Rahoitushuijausten kärkiohjelmat 2025", "Top Financial Fraud Schemes 2025". lokakuu 2025[1][57]

- TruthScan - AI Detection Platform (yleiskatsaus palveluihin), 2025[51][52]

- TruthScan - AI Image Detector -tuotesivu, 2025[45][39]

- TruthScan - AI Voice Detector -tuotesivu, 2025[40]

- TruthScan - Fake Receipt Detector -tuotesivu, 2025[46]

- Liberty Specialty Markets - Deepfake/Cyber Fraud -vakuutuksen lehdistötiedote, maaliskuu 2025[33]

- Facia.ai - Blogi: Aseiden kilpajuoksu vakuutuspetosten ehkäisemiseksi, 2025[24][32]

- Insurance Business UK - "Tekoälyn luomia kuvia käytetään moottoripetoksiin" huhtikuu 2025[7][58]

- The Guardian - "Väärennetyt autovahinkokuvat hälyttävät vakuutusyhtiöt". toukokuu 2024[9][12]

[1] [35] [57] 2025 Rahoitushuijaukset: AI-uhat ja punaiset liput

https://www.turningnumbers.com/blog/top-financial-fraud-schemes-of-2025

[2] [3] [25] [26] Vakuutuspetokset lisääntyvät 19% äänihyökkäyksistä vuonna 2024.

https://www.fiercehealthcare.com/payers/insurance-fraud-increased-19-synthetic-voice-attacks-2024

[4] [9] [10] [11] [12] Huijarit muokkaavat ajoneuvon kuvia lisätäkseen väärennettyjä vaurioita Yhdistyneen kuningaskunnan vakuutushuijauksessa | Vakuutusala | The Guardian

[5] [6] [7] [8] [43] [53] [54] [58] Tekoälyn luomia kuvia käytetään nyt liikennevakuutuspetoksiin - raportti | Insurance Business UK

[13] [14] [15] [16] Petostentorjunnan uusi rajapyykki: synteettiset identiteetit ja tekoälyn kilpavarustelu | RGA

[17] [18] [19] [20] [21] [22] JIFA: Synteettinen petos: Vakuutusyhtiöiden on ajateltava enemmän pankkien tavoin - InsuranceFraud.org: Synteettiset petokset jo ekosysteemissä

https://insurancefraud.org/publications/jifa-synthetic-fraud/

[23] [24] [28] [29] [30] [31] [32] [34] [41] [49] [50] [55] [56] Vakuutuspetos: Miten tekoäly kirjoittaa vakuutuskorvausten säännöt uusiksi?

https://facia.ai/blog/deepfake-insurance-fraud-how-ai-is-rewriting-the-rules-of-insurance-claims/

[27] [48] Hiljainen uhka: Miksi vakuutuspetokset siirtyvät puhelinlinjalle?

https://www.modulate.ai/blog/the-silent-threat-why-insurance-fraud-is-moving-to-the-phone-line

[33] [44] Pk-yrityksille suunnattu sähköinen rikosvakuutus kohdistuu toimitusjohtajapetoksiin ja väärennöksiin - LSM | Insurance Business UK

[36] [42] [51] TruthScan - Yritysten tekoälyn havaitseminen ja sisällön suojaus

[37] Tutkimus: 8 kymmenestä petostentorjujasta odottaa käyttävänsä generatiivista tekoälyä vuoteen 2025 mennessä.

[38] Insights from 2024 Anti-Fraud Technology Benchmarking Report -raportti petostentorjuntateknologian vertailuanalyysistä

[39] [45] Tekoälyn kuvantunnistin | Tunnista väärennetyt ja manipuloidut kuvat - TruthScan

https://truthscan.com/ai-image-detector

[40] [52] Tekoälyn äänentunnistin Deepfakes & Voice Cloning | TruthScan

https://truthscan.com/ai-voice-detector

[46] TruthScan Fake Receipt Detector | Tarkista kuitin aitous

https://truthscan.com/fake-receipt-detector

[47] Fortune 500 -vakuutusyhtiö havaitsee 97% syväväärennöksiä ja lopettaa synteettiset ...