Vielä muutama vuosi sitten jonkun äänen matkimiseen tarvittiin ammattimainen studio ja paljon teknistä taitoa.

Nyt kuka tahansa, jolla on internet-yhteys ja hieman vapaa-aikaa, voi luoda digitaalisen kloonin kenen tahansa äänestä alle minuutissa.

Hyökkäysten välineet tulevat joka päivä halvemmiksi ja helpommin kaikkien saataville. Ja koska niin monet ihmiset jakavat elämäänsä sosiaalisessa mediassa, huijarin on hyvin helppo löytää tarvitsemansa ääni.

Tässä artikkelissa käymme läpi joitakin pahamaineisia esimerkkejä äänipetoksista. Esittelemme myös ratkaisun, jolla nämä uhat voidaan lopettaa ajoissa.

Keskeiset asiat

- Voice deepfake -petosyritykset ovat lisääntyneet viime vuosina yli 2 137%:llä, mikä johtuu siitä, että nykyaikainen tekoäly voi luoda 85%:n tarkan äänikloonin käyttämällä vain kolme sekuntia lähdeääntä.

- Tunnettuihin tosielämän hyökkäyksiin kuuluu vuonna 2024 tapahtunut Arup-insinööritoimiston ryöstö, jossa huijarit käyttivät talousjohtajan väärennettyä videota ja ääntä huijatakseen työntekijän siirtämään $25,6 miljoonaa euroa.

- Yritysvarkauksien lisäksi ääniväärennökset aiheuttavat vakavia henkisiä riskejä perheille kidnappaushuijausten kautta, ja ne voivat ohittaa perinteiset biometriset turvajärjestelmät, joita pankit ja muut korkean turvallisuuden sovellukset käyttävät.

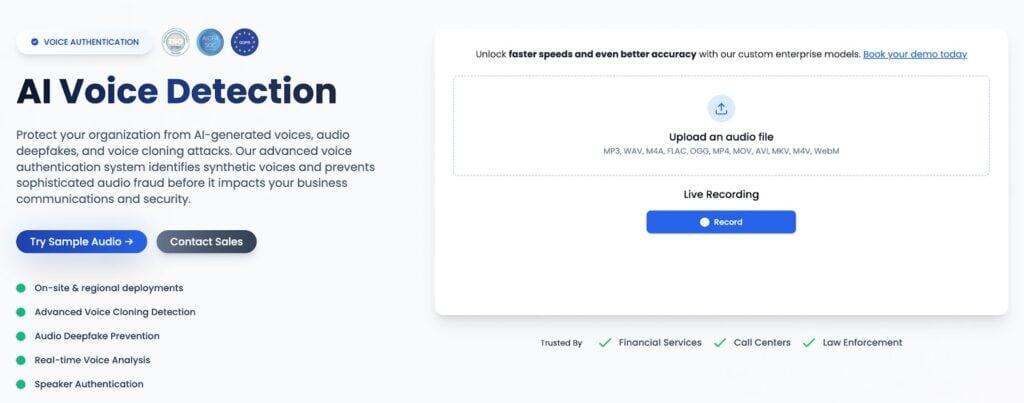

- Organisaatiot joutuvat siirtymään pelkän inhimillisen todentamisen ohi ottamalla käyttöön usean henkilön hyväksymisprotokollia suurille siirroille ja ottamalla käyttöön TruthScanin kaltaisia tekoälyn äänentunnistimia, jotka analysoivat akustisia sormenjälkiä reaaliaikaisesti.

- TruthScan turvaa yritysten vuorovaikutusta tunnistamalla ElevenLabsin ja Murfin kaltaisten alustojen synteettiset puheartefaktat yli 99%-tarkkuudella kaikissa tärkeimmissä ääni- ja videoformaateissa.

Mitä ovat Voice Deepfake -hyökkäykset?

Ääniväärennös on digitaalinen väärennös jonkun henkilön äänestä. Hyökkääjä käyttää ohjelmistoa, joka pystyy analysoimaan äänitallenteesta jokaisen pienen yksityiskohdan siitä, miten joku puhuu.

Äänen kloonaamiseksi ohjelmisto yrittää havaita äänessä olevia kuvioita. Ohjelmisto ottaa huomioon lähinnä äänenkorkeuden, äänensävyn, hengitystavan lauseiden välissä jne.

Kun se oppii nämä kuviot, hyökkääjä voi saada sen sanomaan mitä tahansa kyseisellä äänellä.

Älä enää koskaan ole huolissasi tekoälypetoksista. TruthScan Voi auttaa sinua:

- Tunnista AI luotu kuvat, teksti, ääni ja video.

- Vältä merkittävä tekoälyyn perustuva petos.

- Suojaa kaikkein herkkä yrityksen omaisuuserät.

Vaarallista on se, että voice deepfake -työkalut ovat helposti saatavilla. Ja useimmat niistä eivät vaadi asennusta. Ne ovat saatavilla verkossa verkkosivustojen muodossa.

Sinun tarvitsee vain heittää heille muutama dollari ja alkaa kloonata ääniä. Jos etsit hieman tarkemmin, saatat jopa löytää työkaluja, joiden avulla voit kloonata ääniä ilmaiseksi.

Tämä uusi ja helposti saatavilla oleva tekniikka on johtanut äänipetosten jyrkkään kasvuun.

Huijaajat tarvitsevat vain pienen pätkän äänitiedostoa jostakin henkilöstä, jonka he voivat hankkia sosiaalisesta mediasta tai jostain muusta julkisesta kanavasta kloonatakseen hänet.

Tämän jälkeen he voivat käyttää kloonattua ääntä henkilöitymiseen esimerkiksi suorissa puheluissa, videokokouksissa, äänimuistiinpanoissa, ilmoituksissa jne.

Nämä eivät ole vain hypoteettisia käyttötapauksia voice deepfake -hyökkäyksistä. Näitä asioita on jo tapahtunut. Käsittelemme myöhemmin joitakin pahamaineisia ääniväärennöshyökkäyksiä.

Voice Deepfake-hyökkäysten mahdolliset riskit

Kuullessasi voice deepfake -tekstistä olet ehkä saanut mieleesi hauskan videon, jossa julkkis sanoo asioita, joita hän ei ole koskaan sanonut.

Kloonatun äänen näennäisen harmiton käyttö voi kuitenkin aiheuttaa vakavaa vahinkoa asianosaisille. Puhutaanpa riskeistä.

Taloudellinen tuho yrityksille

Ääniväärennös voi pilata yrityksen maineen lopullisesti. Sillä on myös valta ryöstää siltä suuria rahasummia muutamassa minuutissa.

Miten niin, saatatte kysyä? Huijarit voivat kloonata yrityksen pomon äänen ja käyttää sitä soittaakseen työntekijöille ja saadakseen heidät tekemään asioita, joita ei pitäisi tehdä, kuten siirtämään rahaa tilille.

Tämä on vain yksi esimerkki. Mahdollisuuksia on loputtomasti.

Turvajärjestelmien ohittaminen

Äänesi on biometrinen tieto, jota kenelläkään muulla ei pitäisi olla. Käytät sitä nimittäin salasanana kirjautuessasi moniin sovelluksiisi, erityisesti pankkisovelluksiin.

Vaikka näissä sovelluksissa saattaa olla sisäänrakennettu automaattinen äänitarkastusjärjestelmä, joka estää luvattoman käytön, hyvä ääniklooni voi silti huijata niitä.

Perheiden emotionaalinen rasitus

Äänihuijareiden ehkä helpoimpia kohteita ovat perheen iäkkäät ihmiset. Esimerkiksi vanhemmat ja isovanhemmat.

Huijarit saattavat soittaa vaikkapa äidille ja soittaa hänen tyttärensä huutavan apua ja sanoa, että hänet on kidnapattu.

Luottamuksen heikkeneminen työpaikalla

Voice deepfake -hyökkäykset vahingoittavat myös luottamusta terveeseen työpaikkaan.

Työntekijät joutuvat tarkistamaan esimiehensä puhelut kahdesti varmistaakseen, ettei kyseessä ole huijari, joka käskee heitä tekemään riskialttiita asioita kloonatulla äänellä.

Mitkä ovat sitten vaihtoehtosi, jos et tee tuplatarkastusta manuaalisesti? Kaikki äsken käsittelemämme riskit viittaavat siihen, että tarvitaan automaattista deepfake-hyökkäysten torjuntaa.

Onneksi meillä on nyt syvän tekoälyn äänentunnistustyökaluja, joista TruthScan on yksi.

Estä petokset ja väärennökset TruthScanin avulla. AI Voice Detector.

Reaalimaailman esimerkkejä Voice Deepfake-hyökkäyksistä

Tekoälyn ansiosta olemme saavuttaneet pisteen, jossa emme voi enää luottaa siihen, mitä silmämme näkevät tai korvamme kuulevat. Tekoäly pystyy nyt luomaan realistisia kuvia ja videoita. Sama koskee ääntä.

Olet ehkä jo kuullut tarinoita ihmisistä, jotka ovat langenneet deepfake-äänihuijauksiin. Sitä esiintyy jatkuvasti uutisissa ja sosiaalisessa mediassa aika ajoin. Joitakin niistä on vaikea käsittää.

Kerromme nyt muutamista pahamaineisimmista ääniväärennöshyökkäyksistä, jotta saat hyvän käsityksen siitä, miten taitavasti ne toteutetaan.

$25 miljoonan euron virtuaalikokous, jota ei koskaan oikeasti pidetty

Tämä deepfake-hyökkäys on luultavasti eniten raportoitu.

The uhri oli brittiläinen insinööritoimisto Arup, mutta huijaus oli peräisin sen Hongkongin toimistosta.

Oli alkuvuosi 2024, kun eräs yrityksen talousosaston työntekijä sai sähköpostiviestin yrityksen talousjohtajalta Yhdistyneestä kuningaskunnasta. Sähköpostissa talousjohtaja kehotti työntekijää tekemään salaisia rahansiirtoja joillekin pankkitileille.

Aluksi työntekijä oli itse asiassa melko epäluuloinen, koska pyyntö tuntui hieman oudolta, ja hän ajatteli, että kyseessä saattoi olla phishing-huijaus.

Mutta sitten työntekijä kutsuttiin videoneuvottelupuheluun. Kun työntekijä liittyi puheluun, hän näki talousjohtajan ja useita muita johtavia kollegoita.

Kaikki näyttivät ja kuulostivat juuri sellaisilta kuin pitääkin. He myös puhuivat keskenään, jotta se tuntuisi aidommalta.

Tämä pyyhki täysin pois kaikki talousosaston työntekijän epäilykset, ja hän lähetti sen jälkeen yli $25,6 miljoonaa (~HK$200 miljoonaa) useille eri Hongkongin pankkitileille 15 tapahtuman kautta.

Myöhemmin selvisi, että koko tämä asetelma oli huijaus. Kukaan puhelun henkilöistä ei ollut se, miltä näytti, paitsi Arupin työntekijä. Huijaajat olivat koordinoineet hyökkäyksen täydellisesti käyttämällä yrityksen talousjohtajan ja johtavien työntekijöiden laadukkaita ääni- ja videoklooneja.

Italian ministeri ja muoti-ikonit

Tämäkin tapahtui vuonna 2024. A väärennös Italian puolustusministeri Guido Crosetto soitti useille italialaisille eliitille ja pyysi heiltä välitöntä taloudellista apua siepattujen toimittajien pelastamiseksi.

Puhelussa väärennetty Guido Crosetto väitti, että kyseessä oli hallituksen huippusalainen operaatio. Soittaja onnistui jopa saamaan puhelimeen legendaarisia muotiguruja, kuten Giorgio Armanin.

Valitettavasti yksi henkilö päätyi siirtämään noin miljoona dollaria. Hänellä oli luultavasti muita voimakkaampi isänmaallinen velvollisuus auttaa, ja huijarit onnistuivat käyttämään tätä hyväkseen.

$243,000 Yhdistyneen kuningaskunnan energiaryöstö

Tämä tapahtui vuonna 2019 ja se oli luultavasti ensimmäinen sen mittakaavan deepfake.

Erään brittiläisen energiayhtiön toimitusjohtaja luuli puhuvansa puhelimessa saksalaisen emoyhtiön pomonsa kanssa.

Toimitusjohtaja määrättiin siirtämään noin 220 000 euroa ($243 000) unkarilaiselle toimittajalle. Hänelle kerrottiin, että kyseessä oli kriittinen kauppa, joka piti siirtää välittömästi. Toimitusjohtaja uskoi huijaukseen ja siirsi rahat.

Kauhistuttava puhelu äidille Arizonassa

Muistatko, kun puhuimme siitä, että audio deepfakes on uhka perheille? Antamamme esimerkki huijauksesta tapahtui todella.

Huijarit olivat kloonanneet 15-vuotiaan tytön äänen sosiaalisessa mediassa olleesta videosta. Sen jälkeen he soittivat tytön äidille ja väittivät tyttären äänellä, että hänet oli kidnapattu ja että hänen sieppaajansa vaativat lunnaita välittömästi.

Onneksi isä pystyi soittamaan oikealle tyttärelleen, joka oli turvassa hiihtoharjoituksissa koko tapahtuman ajan. He välttyivät huijaukselta.

Miten Voice Deepfakes vaikuttaa yrityksiin

Voice deepfake -hyökkäyksen päätavoite on useimmiten rahan varastaminen.

Mutta kun kohteena ovat yritykset, vahinko on moniulotteinen.

Esimerkiksi deepfakes voi myrkyttää yrityksen työntekijöiden välisen ilmapiirin. Se voi luoda kulttuurin, jossa työntekijät pelkäävät aina virheiden tekemistä.

Otetaan esimerkiksi puhelinkeskukset. Näemme raportteja, joissa verkkorikolliset soittavat niihin ja esiintyvät tiettyinä asiakkaina.

Heidän temppunsa on saada puhelinpalvelun työntekijät muuttamaan näiden asiakkaiden tilitietoja (esim. kotiosoitteita ja puhelinnumeroita) ja ottamaan heidän tilinsä haltuunsa.

Etähenkilöstön palkkaaminen ja virtuaalihaastattelut ovat toinen ala, jolla hakijat voivat käyttää väärennettyjä ääniä saadakseen työpaikkoja, joihin he eivät ole päteviä.

Yritysten suojaaminen Voice Deepfake -hyökkäyksiltä

Yritysten perinteiset turvallisuussäännöt on laadittu ennen tekoälyä.

On korkea aika, että yritysten on harkittava niitä uudelleen. Niiden olisi ensin aloitettava kouluttamalla itseään monista uusista kyberuhkista, jotka ovat seurausta tekoälyn väärinkäytöstä.

He voivat esimerkiksi järjestää koulutustilaisuuksia koko tiimilleen ja näyttää heille todellisia esimerkkejä äänipetoksista. Voit aloittaa edellä käsitellyistä esimerkeistä. Näissä koulutustilaisuuksissa heille pitäisi myös antaa vinkkejä deepfake-hyökkäysten estämiseen eri skenaarioissa.

Sen jälkeen voit päivittää sisäisiä liiketoimintakäytäntöjä. Yksi tärkeä muutos voi olla se, että yksittäisen henkilön ei enää anneta yksin valtuuttaa massiivisia tilisiirtoja.

Suurten maksujen tulisi edellyttää koko paneelin hyväksyntää, jotta ainakin yksi heistä huomaa ajoissa, että jokin on vialla.

Kannattaa myös harkita automaattisen AI Voice Detector toimimaan taustalla puhelujen aikana.

Sitä varten TruthScanin tekoälytyökalut on tehty. Tekoälytyökaluillamme voit havaita, todentaa ja estää ääniväärennöshyökkäykset. Kerromme, miten.

Miten TruthScan turvaa puheviestinnän

Ymmärrämme, että työntekijät eivät voi yksin erottaa syvää väärennettyä ääntä aidosta äänestä kesken stressaavan puhelun. He tarvitsevat erityisen avustajan, joka voisi hoitaa tämän tehtävän puhelun aikana, kun tiimisi voi keskittyä tekemään sitä, mihin heidät on palkattu.

Meidän AI Voice Detector on erityinen ratkaisu.

Näin se toimii ja mihin se pystyy:

- Analysoi miljoonia eri datapisteitä suorissa puheluissa ja videokokouksissa ja tuottaa 99%-tarkkuuden.

- Antaa varoituksen välittömästi väärennetyn äänen havaitsemisen jälkeen.

- Pystyy havaitsemaan äänessä spektrisiä kuvioita ja akustisia sormenjälkiä, joita synteettiset mallit eivät jätä jäljelle.

- Integroituu olemassa olevaan puhelinkeskukseen tai help deskiin yksinkertaisen REST API:n kautta.

- Voi skannata kaikki tärkeimmät audio- ja videoformaatit

Keskustele TruthScanin kanssa Voice Deepfake -hyökkäysten estämisestä

TruthScanin avulla voit pysäyttää äänikloonauspetokset reaaliajassa, mutta kysymys kuuluu, milloin aiot aloittaa? Työntekijäsi saattavat ennemmin tai myöhemmin tehdä virheen ja huijata sinua. Älä odota sitä ikävää hetkeä.

Tekoälyn ääni-ilmaisimemme voi tunnistaa ääniväärennökset ElevenLabsin ja Murfin kaltaisten alustojen avulla.

Se toimii taustalla suorien puhelujen ja videokokousten aikana, joten puheluagenttisi ei tarvitse tehdä useita tehtäviä samanaikaisesti.

Tämä edellyttää vain nopeaa integrointia REST API -rajapintamme kautta.

Aloita TruthScan nyt ja suojaa yrityksesi deepfake-huijauksilta.