Johdanto: Uusi tekoälyohjattujen hyökkäysten aikakausi

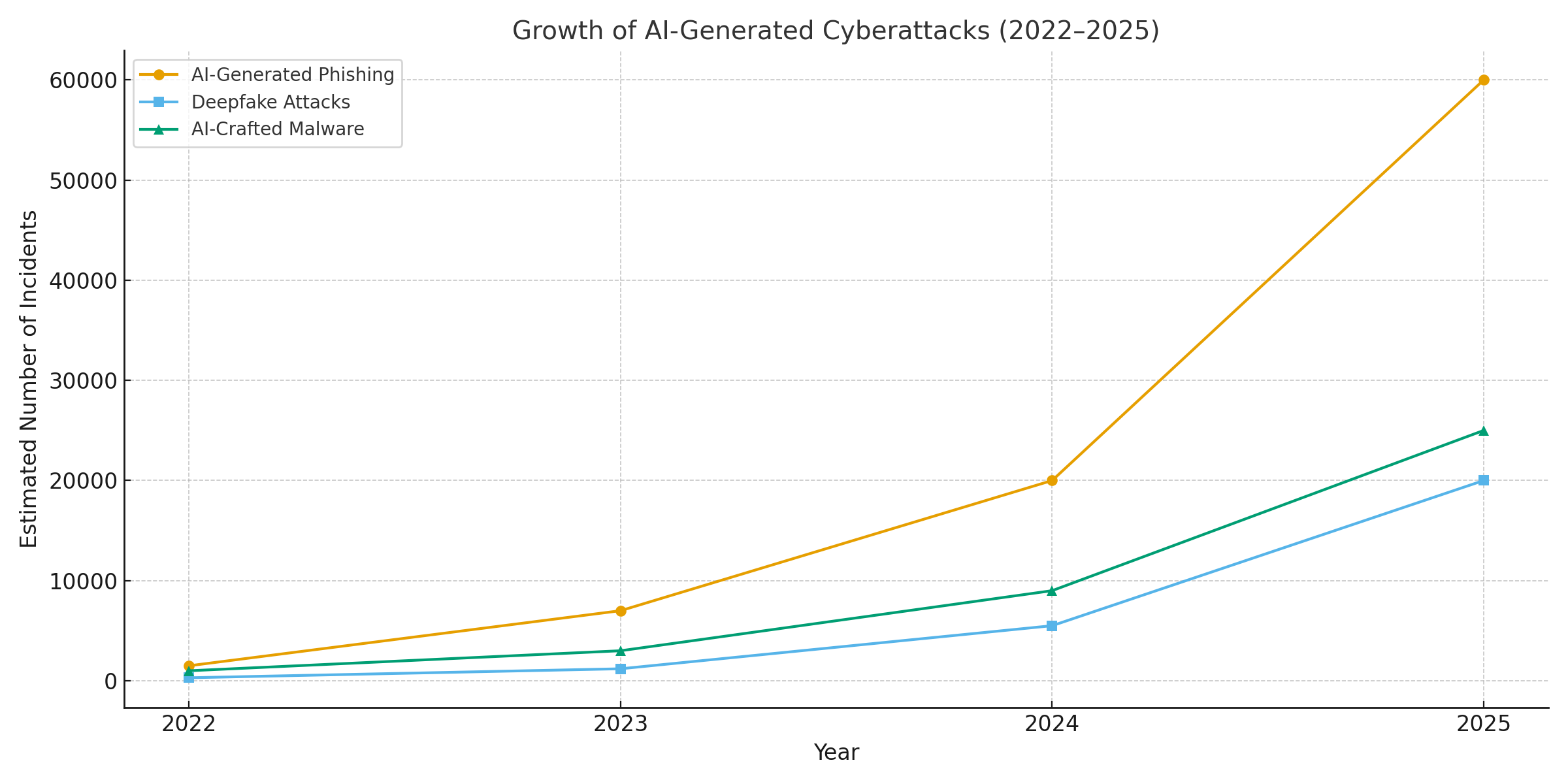

Vuosi 2025 on merkinnyt käännekohtaa kyberturvallisuudessa. Generatiivinen tekoäly on lisännyt kyberhyökkäyksiä, ja uhkaajat voivat käynnistää entistä enemmän hyökkäyksiä. tiheä, realistinen ja skaalautuva kampanjoita kuin koskaan ennen. Itse asiassa viime vuoden aikana arviolta 16% raportoiduista kyberhyökkäyksistä liittyi tekoälytyökaluja hyödyntäviin hyökkääjiin. (esim. kuvien ja kielten generointimallit) sosiaalisen suunnittelun tehostamiseksi.[1]. Erittäin vakuuttavista phishing-sähköposteista deepfake-ääni-/videohuijauksiin - haitalliset toimijat käyttävät tekoälyä aseena kaikilla aloilla. Suurin osa tietoturva-alan ammattilaisista katsoo nyt, että verkkohyökkäysten lisääntyminen johtuu generatiivisesta tekoälystä, joka antaa pahantekijöille nopeampia ja älykkäämpiä tapoja hyödyntää uhreja.[2]. Generatiivinen tekoäly laskee tehokkaasti tietoverkkorikollisuuden taitotasoa ja lisää samalla sen tehoa.

Miksi tämä on niin huolestuttavaa? Tekoäly pystyy tuottamaan välittömästi hiottua, kontekstin huomioon ottavaa sisältöä, joka huijaa jopa koulutettuja käyttäjiä. Se voi jäljitellä ääniä ja kasvoja pelottavan tarkasti ja jopa luoda haitallista koodia, joka muuntuu havaitsemisen välttämiseksi. Tämän seurauksena verkkohyökkäyksiä on entistä vaikeampi havaita ja helpompi toteuttaa. . Maailman talousfoorumi varoittaa, että 72% organisaatiosta on havainnut lisääntyneitä kyberriskejä - erityisesti sosiaalista manipulointia ja petoksia - johtuen generatiivisen tekoälyn kasvavista valmiuksista.[3]. Tämä käy ilmi myös todellisista tapauksista: Vuoden 2024 alussa rikolliset käyttivät tekoälyn luomaa - deepfake-videopuhelu esiintyä yrityksen talousjohtajana ja huijata työntekijää siirtämään - $25,6 miljoonaa huijareille[4]. Ja toisessa tapauksessa pohjoiskorealaiset hakkerit käyttivät - Tekoälyn luomat väärennetyt henkilöllisyystodistukset ohittaa tietoturvatarkastukset puolustuksen phishing-kampanjan yhteydessä[5]. Näissä esimerkeissä korostuvat panokset - generatiivinen tekoäly mahdollistaa huijaukset, joilla ohitetaan sekä inhimillinen että tekninen valvonta.

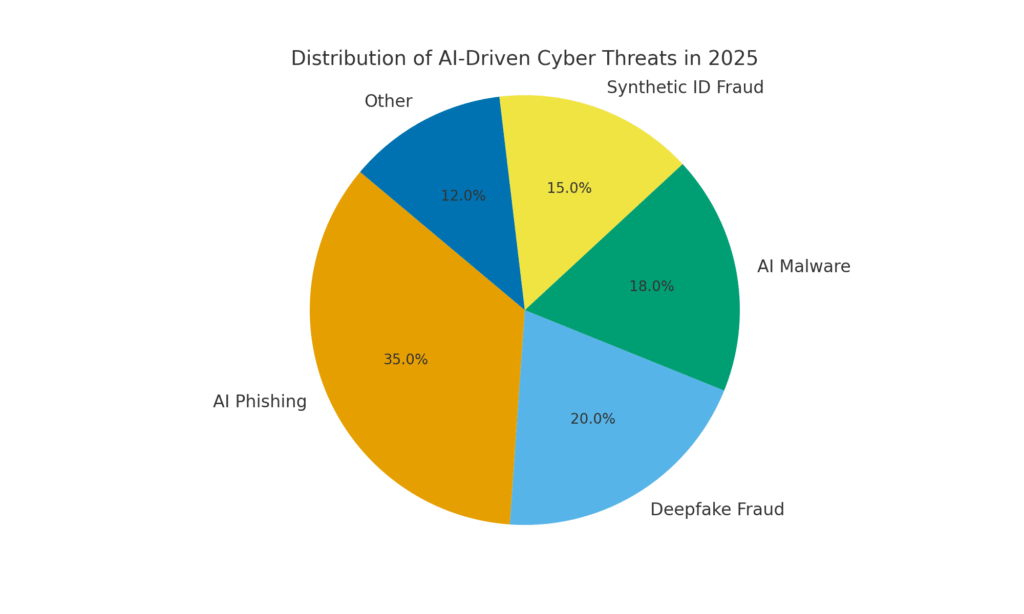

Tekoäly on kuitenkin myös osa ratkaisua. Kehittyneissä tunnistustyökaluissa (kuten TruthScanin työkaluissa) käytetään tekoälyä. vastaan Tekoäly - sisällön analysointi konesukupolven hienovaraisten merkkien löytämiseksi. Tässä whitepaperissa tarkastelemme vuoden 2025 tärkeimpiä tekoälyyn perustuvia kyberuhkia ja sitä, miten organisaatiot voivat lieventää niitä. Osoitteesta Tekoälyn luoma phishing osoitteeseen deepfake toimitusjohtajan petos, Tekoälyn luomat haittaohjelmat, synteettiset identiteetitja muita, tutkimme, miten generatiivinen tekoäly muuttaa hyökkäyksiä. Keskustelemme myös konkreettisista puolustuskeinoista, kuten AI-sisällön havaitseminen, väärennösten rikostekniset tutkimukset ja identiteetin todentamistekniikat, jotka voivat auttaa tietoturvaryhmiä saamaan jälleen yliotteen. Tavoitteena on valaista, miten yritykset, MSSP:t, CISO:t ja petostutkijat voivat integroida tekoälyn havaitsemisvälineet koko kyberturvallisuuspakettiinsa. torjumaan tätä tekoälyllä toimivien uhkien aaltoa.

Älä enää koskaan ole huolissasi tekoälypetoksista. TruthScan Voi auttaa sinua:

- Tunnista AI luotu kuvat, teksti, ääni ja video.

- Vältä merkittävä tekoälyyn perustuva petos.

- Suojaa kaikkein herkkä yrityksen omaisuuserät.

Tekoälyn luoma phishing ja BEC: huijauksia ennennäkemättömässä mittakaavassa

Yksi selkeimmistä generatiivisen tekoälyn vaikutuksista on ollut phishing- ja yrityssähköpostin vaarantaminen (BEC) järjestelmät. Tekoälyn kielimallit pystyvät laatimaan sujuvia, kontekstiin sopivia sähköpostiviestejä sekunneissa, jolloin vältytään kielioppivirheiltä ja kömpelöiltä sanamuodoilta, jotka ennen paljastivat tietojenkalastelijat. Tuloksena on erittäin vakuuttavien huijaussähköpostien ja -tekstien tulva. Huhtikuuhun 2025 mennessä, yli puolet roskapostiviesteistä (51%) oli tekoälyn kirjoittamia., kun kaksi vuotta aiemmin vastaava luku oli lähes nolla.[6]. Vielä hälyttävämpää, tutkijat havaitsivat, että noin 14% BEC-hyökkäyssähköposteista oli tekoälyn luomia. vuoteen 2025 mennessä[7] - Luvun odotetaan nousevan, kun rikolliset ottavat käyttöön ChatGPT:n kaltaisia työkaluja. Joidenkin tutkimusten mukaan yli 80% phishing-sähköposteissa voi nyt olla tekoälyä apuna niiden laatimisessa.[8].

Näiden tekoälyn luomien vieheiden määrä on kasvanut räjähdysmäisesti. Tietoturva-analyysit osoittavat, että tekoälyyn liittyvät phishing-hyökkäykset ovat lisääntyneet huomattavasti. 1,265% lyhyessä ajassa[9]. Yhden jakson aikana phishing-tapahtumailmoitukset kasvoivat hyppäsi 466% yhdellä vuosineljänneksellä, mikä johtuu suurelta osin automaattisista phishing-paketeista ja bottien räätälöidyistä syötteistä.[9][10]. Miksi tällainen piikki? Koska tekoäly antaa hyökkääjien asteikko niiden toimintaa dramaattisesti. Yksittäinen rikollinen voi käyttää tekoäly-chatbotia tuottamaan tuhansia henkilökohtaisia huijaussähköposteja, jotka on suunnattu eri työntekijöille tai asiakkaille, ja kaikki tämä siinä ajassa, joka ennen kului yhden sähköpostiviestin laatimiseen. Tämä massa-automaatio sai FBI:n varoittamaan, että BEC-tappiot (jotka olivat jo $2,7 miljardia vuonna 2022) vain kiihtyvät, kun tekoäly "uhkaa nostaa tappiot vielä korkeammalle".[11][12].

Phishing-sähköpostiviestejä ei ole vain enemmän, vaan ne ovat myös - tehokkaampi. Uhreja huijataan useammin tekoälyn käyttämän kiillotetun kielen ja asiayhteyteen liittyvien yksityiskohtien avulla. Laboratoriotesteissä tekoälyn kirjoittamat phishing-sähköpostit saavuttivat seuraavat tulokset 54% klikkausprosentti - huomattavasti perinteisten phishing-yritysten ~12%:n yläpuolella.[13]. Nämä viestit ovat kuin aidon toimitusjohtajan tyyliin kirjoitettuja tai viittaavat yrityksen todellisiin tapahtumiin, mikä alentaa vastaanottajien varuillaan oloa. Hyökkääjät jopa käyttävät tekoälyä testatakseen erilaisia sanontoja A/B-testien avulla ja toistavat onnistuneimpia koukkuja.[14]. Toisin kuin ihmiset, tekoäly ei tee kirjoitusvirheitä tai väsy - se voi vuodattaa loputtomasti muunnelmia, kunnes yksi pääsee suodattimien ohi ja huijaa jotakuta.

Esimerkkitapaus: Vuoden 2025 puolivälissä Reuters tutkimus paljasti, miten kaakkoisaasialaiset huijarit käyttivät ChatGPT:tä petosviestinnän automatisoimiseen.[15]. He loivat vakuuttavia pankkien sähköpostiviestejä ja asiakaspalvelutekstejä massoittain, mikä lisäsi huomattavasti heidän järjestelmiensä tavoittavuutta. Euroopan poliisi raportoi myös tekoälyohjatuista phishing-paketeista, joita myydään pimeässä verkossa alle $20:lla, minkä ansiosta heikosti koulutetut toimijat voivat käynnistää hienostuneita kampanjoita.[16][17]. BEC:n ja tietojenkalastelun markkinoille pääsyn esteet ovat olennaisesti haihtuneet.

Puolustustoimenpiteet - AI Phishin pysäyttäminen: Organisaatioiden on vahvistettava sähköposti- ja viestintäkanaviaan tämän hyökkäyksen vuoksi. Tässä kohtaa AI-sisällön havaitseminen voi auttaa. Työkalut kuten TruthScanin tekoälytekstintunnistin ja erikoistunut sähköpostiskannerit voi analysoida saapuvia viestejä tekoälyn tuottaman tekstin tilastollisten merkkien löytämiseksi. Esimerkiksi TruthScan Sähköpostihuijaus Detector käyttää luonnollisen kielen analyysiä merkitäkseen sähköpostit, jotka ovat todennäköisesti peräisin tekoälyltä, vaikka ne näyttäisivät laillisilta.[18]. Nämä ilmaisimet tutkivat esimerkiksi täydellisesti hiottua kielioppia, lauseiden monimutkaisuutta ja tyylillisiä malleja, jotka ovat epätavallisia ihmisistä koostuville kirjoittajille. Osoitteessa reaaliaikainen skannaus, epäilyttävät sähköpostiviestit voidaan eristää tai merkitä tarkistettavaksi ennen kuin ne saapuvat käyttäjille. Yritysten tietoturvaryhmät ovat alkaneet ottaa tällaisia tekoälyyn perustuvia suodattimia käyttöön sähköpostiporttien ja viestialustojen yhteydessä. Käytännössä tämä lisää perinteisten roskapostisuodattimien päälle uuden puolustuskerroksen, joka on nimenomaisesti viritetty havaitsemaan tekoälyn kirjoittamaa sisältöä. Vuodesta 2025 alkaen johtavat yritykset integroivat TruthScanin kaltaisia ratkaisuja API:n kautta suojattuihin sähköpostiportteihinsa ja pilvipalveluiden yhteistyökokonaisuuksiinsa ja luovat näin automaattisen tarkistuspisteen Tekoälyn luoma phishing sisältö.

Deepfake Voice & Video Impersonation: Huijari: "Näkeminen pettää" Petos

Kenties visuaalisin tekoälyyn perustuva uhka vuonna 2025 on nouseva deepfake-ääni- ja videohyökkäykset. Tekoälymallien avulla rikolliset voivat kloonata henkilön äänen vain muutaman sekunnin mittaisesta äänitiedostosta tai luoda realistisen videon henkilön kasvoista muutamasta valokuvasta. Näitä syväväärennöksiä käytetään aseena suurten panosten huijauksissa - toimitusjohtajahuijauksista ("väärennetyt toimitusjohtajapuhelut") valevideokonferensseihin ja paljon muuhun. Äskettäin julkaistu raportti paljasti, että 47% organisaatioista on kokenut deepfake-hyökkäyksiä. jonkinlainen[19]. Eikä se ole vain teoreettista: useat ryöstöt vuosina 2023-2025 ovat osoittaneet, että väärennökset voivat voittaa äärimmäisen todentamisen - omat silmämme ja korvamme.

Eräässä surullisenkuuluisassa tapauksessa oli kyse kansainvälisestä pankkisiirrosta, jonka kohteena oli $25 miljoonaa sen jälkeen, kun työntekijää oli huijattu väärennetyllä videokonferenssilla. Hyökkääjät käyttivät tekoälyä syntetisoidakseen yrityksen talousjohtajan hahmon Zoom-puhelussa, hänen äänensä ja maneerinsa mukaan, ja neuvoivat työntekijää siirtämään varoja.[4][20]. Toisessa Australiassa tapahtuneessa tapauksessa paikallishallinto menetetty $2,3 miljoonaa euroa kun huijarit väärensivät sekä kaupungin virkamiesten ääntä että videokuvaa hyväksyäkseen vilpilliset maksut.[21]. Hälyttävää on myös se, että rikolliset käyttävät tekoälyllä kloonattuja ääniä "isovanhempien huijauksissa" - he soittavat vanhuksille ja esiintyvät heidän sukulaisinaan hädässä. . FBI ja FinCEN varoitti vuoden 2024 lopulla petosten lisääntymisestä, joissa käytetään apuna Tekoälyn luoma "deepfake"-media, mukaan lukien väärennetyt asiakaspalvelijat ja synteettiset henkilöllisyydet KYC-tarkistusten ohittamiseksi.[22].

Deepfake-pohjaisten rikosten määrä kasvaa nopeasti. Erään analyysin mukaan vuoden 2024 loppuun mennessä... uusi deepfake-huijaus tapahtui viiden minuutin välein. keskimäärin[23]. Pelkästään vuoden 2025 ensimmäisellä neljänneksellä raportoidut väärennökset kasvoivat 19% verrattuna vuoden 2025 ensimmäiseen neljännekseen. kaikki 2024[24][25]. Syvä väärennösten osuus on nyt arviolta 6,5% kaikista petoshyökkäyksistä, a 2,137% lisäys vuodesta 2022 lähtien[26][27]. Tarvittava teknologia on tullut helposti saataville - usein tarvitaan vain vähän kuin 30 sekuntia ääntä kloonata ääni tai alle tunnin näytemateriaalia mallintaa henkilön kasvot vakuuttavasti.[20]. Lyhyesti sanottuna, ei ole koskaan ollut helpompaa tehdä "väärentää" luotettavan henkilön henkilöllisyys. ja huijaavat uhreja luovuttamaan rahaa tai tietoja.

Puolustustoimenpiteet - Todellisuuden todentaminen: Vastatakseen väärennettyihin uhkiin organisaatiot käyttävät kehittyneitä synteettisen median havaitseminen työkalut. Esimerkiksi, TruthScanin tekoälyn äänentunnistin ja TruthScan Deepfake Detector käyttää tekoälyä äänen ja videon analysointiin manipuloinnin merkkien löytämiseksi. Nämä järjestelmät suorittavat ruutukohtaisen ja aaltomuotoanalyysin havaitakseen keinotekoisen tekoälyn luoman klipin artefaktit, kuten luonnottomat kasvojen liikkeet, huulisynkronointiongelmat tai äänen spektrin epäsäännöllisyydet. Testeissä TruthScanin algoritmit saavuttivat seuraavat tulokset 99%+ tarkkuus tekoälyn tuottamien äänten tunnistamisessa. ja havaitsivat manipuloidut videokuvat reaaliajassa.[28][29]. Itse asiassa Genians Security Centerin tutkijat käyttivät äskettäin TruthScanin kuvantekotekniikkaa analysoidakseen pohjoiskorealaisten hakkereiden käyttämää väärennettyä henkilökorttia - TruthScanin deepfake-kuvailmaisin merkitsi asiakirjan väärennetyksi. 98% luottamus, spear-phishing-yrityksen estäminen[5][30].

Käytännön puolustusta varten yritykset käyttävät näitä havaitsemisominaisuuksia tärkeimpiin sulkupisteisiin. Puhevarmennus lisätään puhelinkeskusten työnkulkuihin - esimerkiksi kun "asiakas" pyytää suurta siirtoa puhelimitse, ääni voidaan ajaa ääniväärennösten tunnistimen läpi, jotta voidaan varmistaa, että kyseessä on todella hän (eikä tekoälyn jäljitelmä). Samoin, videokonferenssialustat voi integroida osallistujien videovirtojen live-syväväärennösskannauksen synteettisten kasvojen havaitsemiseksi. TruthScanin deepfake-tunnistuspaketti tarjoaa esimerkiksi seuraavat ominaisuudet reaaliaikainen videopuheluanalyysi ja kasvojen tunnistus joka voi liittyä Zoomiin tai WebExiin API:n kautta.[31][29]. Tämä tarkoittaa, että jos joku yrittää liittyä kokoukseen käyttämällä tekoälyn luomaa videota toimitusjohtajastasi, järjestelmä voi merkitä "mahdollisen väärennöksen" ennen kuin vahinkoa tapahtuu. Lisäksi tärkeisiin tapahtumiin sisältyy nykyään usein varmennusvaihe (kaistan ulkopuolinen tai monitekijäinen), jossa voidaan hyödyntää sisällön todentamista - esimerkiksi vaatia lyhyt puhuttu vahvistus, jonka aitous tarkistetaan tekoälyn äänentunnistimella. Kerrostamalla näitä työkaluja yritykset luovat turvaverkon: vaikka työntekijät olisivat katso tai kuule jotain uskottavaa, kulissien takana tehtävä tekoälyn rikostutkinta kyseenalaistaa sen todellisuuden. Tekoälyn läpäisemässä uhkamaisemassa, "Älä luota - tarkista" tulee mantraksi kaikessa puhe- tai videoviestinnässä, jossa on kyse rahasta tai arkaluontoisista tiedoista.

Tekoälyn luomia haittaohjelmia ja hämäräkoodia: Evolving Threats in the Code

Tekoälyn vaikutus ei rajoitu pelkästään sosiaaliseen manipulointiin - se muuttaa peliä myös haittaohjelmien ja kiertohyökkäyskoodin kehittämisessä. Vuonna 2025 Googlen Threat Intelligence -ryhmä paljasti, että ensimmäiset tekoälyä käyttävät haittaohjelmakannat osoitteessa suorittaminen niiden käyttäytymisen muuttamiseksi[32][33]. Yksi esimerkki, nimeltä PROMPTFLUX, oli haitallinen skripti, joka itse asiassa kutsui tekoälyn API:ta (Googlen Gemini-mallia) kutsumaan kirjoittaa omaa koodiaan uudelleen lennossa, tuottaa uusia hämäriä variantteja virustorjunnan havaitsemisen välttämiseksi.[34][35]. Tämä "just-in-time" tekoälyn kehitys merkitsee harppausta kohti itsenäisiä, monimorfisia haittaohjelmia. Toinen esimerkki, PROMPTSTEAL, käytti tekoälyn koodausavustajaa tuottamaan yksirivisiä Windows-komentoja tietovarkauksia varten ja ulkoisti osan logiikastaan tekoälymoottorille reaaliaikaisesti.[36][37]. Nämä innovaatiot viittaavat tulevaisuuteen, jossa haittaohjelmat voivat jatkuvasti muuttaa itseään - aivan kuten ihmisen kynätestaaja - päihittääkseen puolustuksen.

Vaikka tekoälyä ei olisikaan käytössä, hyökkääjät käyttävät tekoälyä kehitystyön aikana luodakseen entistä tehokkaampaa haittakoodia. Generatiivinen tekoäly voi tuottaa haittaohjelmia, jotka ovat erittäin hämärä, joka sisältää sekavan logiikan kerroksia, jotka vaikeuttavat käänteistä suunnittelua. Uhkaraporttien mukaan, yli 70% suurista tietomurroista vuonna 2025 liittyi jonkinlaiseen polymorfiseen haittaohjelmaan. joka muuttaa allekirjoitustaan tai käyttäytymistään välttääkseen havaitsemisen[38]. Lisäksi, 76% phishing-kampanjoista käyttävät nyt polymorfisia taktiikoita, kuten dynaamisia URL-osoitteita tai tekoälyllä uudelleenkirjoitettuja hyötykuormia.[38]. Työkalut, kuten pimeän verkon tarjoukset WormGPT ja FraudGPT (ChatGPT:n rajoittamattomat kloonit) mahdollistavat jopa ei-asiantuntijoiden luoda haittaohjelmien droppereita, keyloggereita tai lunnasohjelmakoodia yksinkertaisesti kuvaamalla, mitä he haluavat.[39]. Tuloksena on runsaasti uusia haittaohjelmavaihtoehtoja. Esimerkiksi vuonna 2024 julkaistiin infovaras nimeltä BlackMamba syntyi, että oli täysin tekoälyn luomakäyttäen ChatGPT:tä kirjoittamaan koodinsa segmentteinä - jokainen suoritus tuotti hieman erilaisen binäärin, mikä hämmensi perinteiset allekirjoituspohjaiset virustorjuntaohjelmat.[38]. Tietoturvatutkijat esittelivät myös tekoälyn luomia polymorfisia proof-of-concepts -konsepteja, jotka voivat kiertää monet päätelaitteiden suojaukset.[40].

Tämän lisäksi hyökkääjät hyödyntävät tekoälyä hienosäätääkseen toimintansa toimitus haittaohjelmia. Tekoäly voi älykkäästi käsikirjoittaa phishing-sähköposteja (kuten käsiteltiin), joissa on haittaohjelmalinkkejä. Tekoäly voi myös auttaa hyödyntämiskohteiden kehittämisessä, esimerkiksi uusien haavoittuvuuksien löytämisessä tai shellcoden optimoinnissa. Valtiolliset toimijat ovat tiettävästi käyttäneet kehittyneitä tekoälymalleja avuksi nollapäivähyökkäysten löytämisessä ja kohteisiin räätälöityjen haittaohjelmien kehittämisessä.[41]. Kaikki nämä suuntaukset tarkoittavat, että haittaohjelmat ovat vuonna 2025 entistä salakavalampia ja mukautuvampia. Se on usein "yhdessä luotu" tekoälyn kanssamikä vaikeuttaa sen havaitsemista tavanomaisilla säännöillä.

Puolustustoimenpiteet - tekoäly vs. tekoäly haittaohjelmien torjunnassa: Tekoälyn luomia haittaohjelmia vastaan suojautuminen edellyttää kehittyneen havaitsemisen ja tekoälyllä toimivan analyysin yhdistelmää puolustuspuolella. Monet organisaatiot täydentävät päätelaitteiden suojaus ja EDR (Endpoint Detection & Response) (päätelaitteiden havaitseminen ja vaste) AI/ML-malleilla, jotka etsivät tekoälyn tuottaman koodin käyttäytymismalleja. Esimerkiksi äkilliset koodimuutokset tai epätavalliset API-kutsumallit saattavat viitata PROMPTFLUXin uudistumiseen. Vastaavasti verkonvalvonta voi havaita poikkeamia, kuten haittaohjelmat, jotka ottavat yhteyttä tekoälypalveluihin (mikä ei ole "normaalia" käyttäjän sovelluksille). Toimittajat kouluttavat ML-pohjaisia ilmaisimia. perheet tähän mennessä tunnistetuista tekoälyavusteisista haittaohjelmista, mikä parantaa näiden uusien uhkien tunnistamista.

Yksi kehittymässä oleva ratkaisu on integroitu tekoälyn sisältöskannaus kehittäjien ja rakentajien putkistoissa.. Tämä tarkoittaa tekoälypohjaisten ilmaisimien käyttämistä skriptien, ohjelmistokokoonpanojen tai jopa konfiguraatiomuutosten analysointiin haitallisten tai tekoälyn luomien sisältöjen varalta. Esimerkiksi, TruthScanin reaaliaikainen ilmaisin voidaan ottaa käyttöön muutakin kuin tekstiä - sen multimodaalinen analyysi voi mahdollisesti merkitä epäilyttävän koodin tai konfiguraatiotiedostot tunnistamalla, jos ne on luotu koneellisesti hämärtämismallien avulla.[42][43]. Kehitystiimit ja MSSP:t alkavat skannata infrastruktuuri-ohjelmointikoodin skriptejä, PowerShell-lokeja ja muita artefakteja merkkien löytämiseksi tekoälyn kirjoittamista segmenteistä, jotka voisivat viitata hyökkääjän käteen. Vaikka tämä ala on vasta kehittymässä, se on lupaava: eräässä tapauksessa tietoturvaryhmä käytti tekoälyilmaisinta havaitakseen hämäävän phishingkit-tiedoston, joka "tuntui" tekoälyn luomalta ja joka todellakin oli osa hyökkäystä.[44]. Tiedoston koodi oli liian monimutkaista ja monisanaisia (tekoälyn luomisen tunnusmerkkejä), ja tekoälyn suorittama sisällön skannaus vahvisti, että se ei todennäköisesti ollut ihmisen kirjoittama.[40].

Lisäksi tekoälyuhkiin keskittyvän uhkatiedon jakaminen on ratkaisevan tärkeää. Kun Google GTIG julkaisee yksityiskohtaisia tietoja Prompt-pohjaisista haittaohjelmista tai kun tutkijat raportoivat uusista tekoälyn kiertämistekniikoista, organisaatioiden olisi syötettävä nämä tiedot havaitsemistekniikkaansa. Käyttäytymisanalytiikka - etsimällä toimintoja, kuten prosessin käynnistämä skripti, joka kirjoittaa saman prosessin koodin uudelleen - voidaan havaita tekoälyavusteisten haittaohjelmien poikkeamia. Lyhyesti sanottuna puolustajien on torjuttava tulta tulella: otettava käyttöön Tekoälypohjaiset tietoturvatyökalut jotka voivat sopeutua yhtä nopeasti kuin tekoälyohjatut haittaohjelmat. Tähän sisältyy kaikkea tekoälyllä parannetusta virustorjunnasta aina käyttäjäkäyttäytymisen analytiikkaan, jolla voidaan tunnistaa, milloin tili tai järjestelmä alkaa käyttäytyä "ei aivan inhimillisesti". Ottamalla tekoälyn käyttöön puolustuksessa tietoturvaryhmät voivat torjua tekoälyn hyökkääjille antamat nopeus- ja mittakaavaedut.

Synteettiset henkilöllisyydet ja tekoälyn avulla toteutetut petosjärjestelmät

Siirtyminen haittaohjelmista petosten maailmaan: synteettinen identiteettipetos on kasvanut räjähdysmäisesti generatiivisen tekoälyn avulla. Synteettisessä identiteettipetoksessa luodaan fiktiivisiä henkilöitä yhdistämällä todellisia ja väärennettyjä tietoja (esim. oikea SSN + väärennetty nimi ja asiakirjat). Näitä Frankenstein-henkilöllisyyksiä käytetään sitten pankkitilien avaamiseen, luoton hakemiseen tai KYC-tarkastusten läpäisemiseen, mikä johtaa lopulta maksamattomiin lainoihin tai rahanpesuun. Kyseessä oli jo ennestään yksi nopeimmin kasvavista petostyypeistä, ja tekoäly on nyt lisännyt tulta. Synteettisistä henkilöllisyyspetoksista aiheutuvat tappiot ylittää $35 miljardia euroa vuonna 2023.[45]ja vuoden 2025 alussa joidenkin arvioiden mukaan lähes 25% kaikista pankkipetoksista aiheutuneista tappioista. johtuivat synteettisistä identiteeteistä[46]. Experianin analyytikot havaitsivat, että yli 80% uutta tilipetosta tietyillä markkinoilla on nyt kytketty synteettisiin henkilöllisyystodistuksiin.[19] - Tämä on järkyttävä tilasto, joka osoittaa, miten laajalle tämä huijaus on levinnyt.

Generatiivinen tekoäly vahvistaa synteettisiä petoksia muutamalla tavalla. Ensinnäkin tekoälyn avulla on triviaalia tuottaa keinotekoinen "kasvattaja-asiakirjat" ja digitaaliset jalanjäljet, joita tarvitaan väärennetyn henkilöllisyyden myymiseen. Aiemmin huijari saattoi photoshopata henkilöllisyystodistuksen tai luoda käsin väärennettyjä sähkölaskuja. Nyt on olemassa työkaluja, joilla voidaan luoda aidon näköiset profiilikuvat, henkilöllisyystodistukset, passit, tiliotteet ja jopa sosiaalisen median profiilit. käyttämällä tekoälyn kuvageneraattoreita ja kielimalleja[47][48]. Tekoälyn avulla voidaan esimerkiksi luoda realistinen pääkuva henkilöstä, jota ei ole olemassa (mikä estää helpon käänteisen kuvahaun), ja luoda kuvaan sopiva väärennetty ajokortti. Tekoäly voi myös simuloida identiteetin "elonmerkkejä" - esimerkiksi luoda tiedot synteettisistä vanhemmista, osoitteista tai sosiaalisen median viesteistä. taustatarinan täydentämiseksi[49]. Bostonin Fed totesi, että Gen AI voi jopa tuottaa väärennetty ääni ja video väärennetystä henkilöstä - synteettinen käyttäjä voi esimerkiksi "ilmestyä" selfie-varmennusvideoon, jossa on ainutlaatuiset kasvot ja ääni, kaikki tekoälyn luomia.[50].

Toiseksi tekoäly auttaa huijareita laajentaa niiden toimintaa. Sen sijaan, että ne väärentäisivät yhden tai kaksi henkilöllisyyttä kerrallaan, ne voivat luoda ohjelmallisesti satoja tai tuhansia täydellisiä identiteettipaketteja ja täyttää automaattisesti uusia tilihakemuksia massoittain.[51][52]. Jotkin pimeän verkon palvelut tarjoavat tehokkaasti "Synteettiset identiteetit palveluna", joka käyttää automaatiota todennettujen myyntitilien tuottamiseen. Esimerkiksi COVID-19-pandemia-avustusohjelmien aikana rikolliset käyttivät tekoälyn avulla luotuja identiteettejä käyttäviä botteja hakemaan massoittain lainoja ja etuuksia, jolloin järjestelmä täyttyi väärennetyistä hakijoista. Juniper Researchin ennusteiden mukaan digitaalisten identiteettipetosten (joita nämä taktiikat ruokkivat) maailmanlaajuiset kustannukset ovat seuraavat nousu 153% vuoteen 2030 mennessä verrattuna vuoteen 2025[53].

Puolustustoimenpiteet - Identiteetin todentaminen tekoälymaailmassa: Perinteiset identiteetin todentamismenetelmät ovat vaikeuksissa tekoälyn luomia väärennöksiä vastaan. Sopeutuakseen organisaatiot ottavat käyttöön monikerroksinen henkilöllisyyden ja käyttäytymisen todentaminen tekoälyn tukemana. Keskeinen taso on kehittynyt asiakirjojen ja kuvien rikostekninen tutkiminen. Esimerkiksi, TruthScanin tekoälyn kuvantunnistin ja Väärennetyn asiakirjan ilmaisin tarjoavat mahdollisuuden analysoida ladattuja henkilöllisyystodistuksia, selfieitä tai asiakirjoja synteesin tai peukaloinnin merkkien varalta. Nämä työkalut tutkivat pikselitason artefakteja, valaistuksen epäjohdonmukaisuuksia ja metatietoja määrittääkseen, onko kuva tekoälyn luoma tai manipuloitu. Ne voivat havaita hienovaraisia vihjeitä, kuten GAN-generoiduista kuvista peräisin olevat identtiset taustakuviot tai henkilötunnuksen fontit ja välit, jotka eivät vastaa mitään tunnettua hallituksen mallia. Ottamalla tällaisia tunnistimia käyttöön sisäänkirjautumisen yhteydessä pankit voivat automaattisesti merkitä hakijan ajokortin tai selfien, jos se on todennäköisesti tekoälyn luoma (esimerkiksi TruthScanin järjestelmä olisi merkinnyt väärennetyn sotilastunnuksen, jota käytettiin Kimsuky APT:n phishing-tapauksessa).[5]). TruthScanin lehdistötiedotteen mukaan rahoituslaitokset ovat käyttäneet heidän alustaansa asiakirjojen aitouden validointiin laajamittaisesti ja tunnistaneet väärennökset erittäin tarkasti.[54].

Toinen kerros on käyttäytymisanalytiikka ja ristiintarkistukset. Todellisilla henkilöllisyyksillä on syvyyttä - vuosien historia, julkiset tiedot, sosiaalisen median toiminta jne. Tekoälyn luomissa identiteeteissä, vaikka ne olisivat kuinka hiottuja, ei useinkaan ole näitä syviä juuria. Pankit ja lainanantajat käyttävät tekoälyä hakemustietojen ja julkisten ja omien tietojen ristiinkorrelaatioon: Onko tämän henkilön puhelinnumerosta ja sähköpostista nähtävissä käyttöhistoriaa? Onko laitteen tai IP-osoitteen maantieteellisessä sijainnissa järkeä? Kirjoittaako hän tietoja lomakkeisiin inhimillisellä tavalla vai copy-paste-tyyppisesti (kuten botit tekevät)? Tekoälymallit voidaan kouluttaa erottamaan asiakkaiden aito käyttäytyminen synteettisistä malleista. Yhdysvaltain keskuspankki totesi, että "synteettiset identiteetit ovat pinnallisia, ja tekoäly näkee sen" - Tekoälyyn perustuva todentaminen voi nopeasti etsiä identiteetin digitaalista jalanjälkeä ja hälyttää, jos sitä ei löydy juuri lainkaan.[55]. Käytännössä identiteetin todentamispalvelut käyttävät nykyään tekoälyä, joka tarkistaa, että käyttäjän selfie vastaa aiempia valokuvia (kasvojen vaihtamisen havaitsemiseksi), ja jopa kehottaa käyttäjiä satunnaistetuilla toimilla (kuten tietyillä asennoilla tai lauseilla) elävyyden tarkistusten aikana, mikä vaikeuttaa väärennösten oikeaa vastaamista.[56][57].

Vihdoinkin, jatkuva seuranta tilien käyttäytymisen seuraaminen sisäänoton jälkeen auttaa löytämään synteettiset tilit, jotka ovat jääneet huomaamatta. Koska näitä tilejä ei ole sidottu todelliseen henkilöön, niiden käyttötavat erottuvat usein lopulta selvästi (esim. täydellisesti ajoitetut tapahtumat luoton kartuttamiseksi ja sitten maksimitilin nostaminen). Tekoälypohjainen petosten seuranta (kuten Siftin tai Feedzain alustat) voi tunnistaa poikkeavuudet tilien käytössä ja merkitä mahdolliset synteettiset tilit tarkistettavaksi. Yhteenvetona voidaan todeta, että tekoälyyn perustuvien identiteettipetosten torjunta edellyttää seuraavaa Tekoälyä hyödyntävä identiteetin todentaminen - jossa yhdistyvät asiakirjojen rikostekninen tutkinta, biometriset tarkistukset, tietojen korrelaatio ja käyttäytymisanalyysi. Hyvä uutinen on se, että samoja tekoälyn edistysaskeleita, jotka mahdollistavat petokset, käytetään myös niiden havaitsemiseen. Esimerkiksi TruthScan tarjoaa identiteetin todentamissarja joka yhdistää teksti-, kuva- ja äänianalyysin uusien käyttäjien tarkastamiseen. Näitä työkaluja hyödyntämällä eräs suuri pankki havaitsi synteettisten tilinavausten onnistuneen merkittävästi, vaikka alan keskiarvot olivat nousussa. Asevarustelukilpailu jatkuu, mutta puolustajat oppivat havaitsemaan synteettisen tilin heikot "digitaaliset merkit", vaikka tekoäly yrittäisi kuinka hyvin peittää jälkensä.

Tekoälyn havaitsemisen integroiminen tietoturvapinon kaikkiin osa-alueisiin

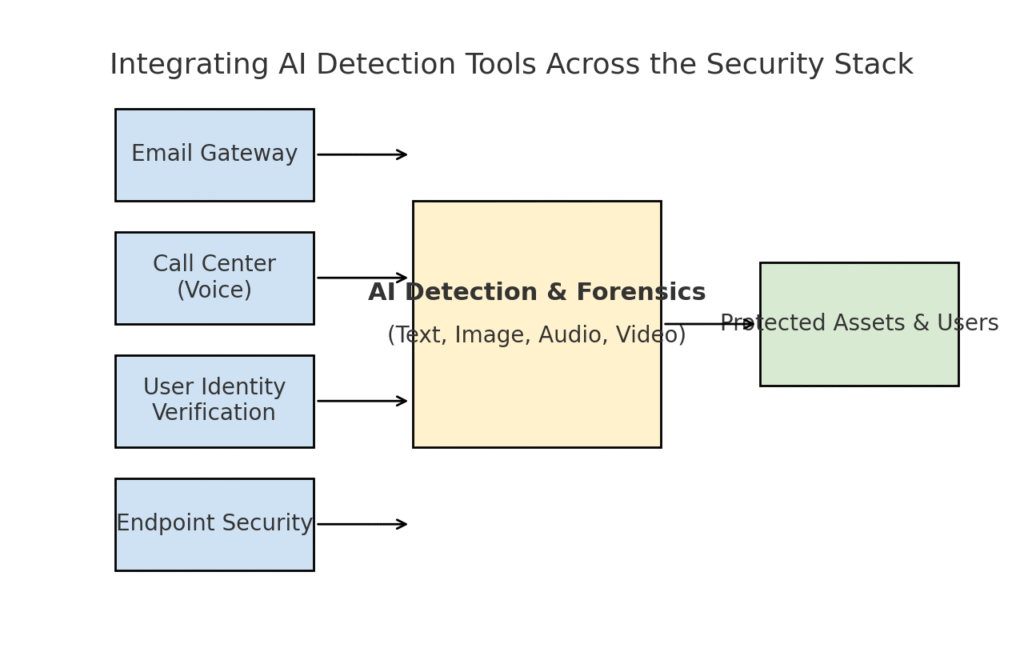

Olemme tutkineet useita eri uhka-alueita - tietojenkalastelua, väärennöksiä, haittaohjelmia ja synteettisiä petoksia - jotka kaikki ovat tekoälyn tukemia. On selvää, että ei yksittäistä työkalua tai kertakorjausta ratkaisee haasteen. Sen sijaan yritykset tarvitsevat kattavan strategian, jolla upottaa tekoälypohjaisen tunnistuksen ja todentamisen jokaiseen kerrokseen. heidän kyberturvapakettinsa. Lähestymistavan on heijastettava hyökkäyspintaa ja katettava sähköposti, verkko, ääni, asiakirjat, identiteetti ja muutkin. Alla oleva kaavio havainnollistaa, miten organisaatiot voivat integroida TruthScanin tekoälyn tunnistustyökalut (ja vastaavat ratkaisut) yrityksen yleisiin tietoturvakerroksiin:

Tekoälyn tunnistustyökalujen integrointi tietoturvapinon useisiin kerroksiin - sähköpostiportista ja puhelinkeskuksista käyttäjien todentamiseen ja päätelaitteiden suojaamiseen. Tekoälyn sisällönhavaitseminen (keskus) analysoi tekstiä, kuvia, ääntä ja videota reaaliajassa ja syöttää ne täytäntöönpanopisteisiin, jotka suojaavat omaisuutta ja käyttäjiä.

Tässä mallissa, multimodaaliset tekoälyilmaisimet toimivat keskusaivoina. joka on yhteydessä erilaisiin turvavalvontatoimenpiteisiin:

- Sähköpostiportit: Saapuneet sähköpostit kulkevat tekoälyn tekstin/huijauksen tunnistimen läpi ennen saapuvien sähköpostien saapumista. Tämä liittyy keskustelun aiheena olleeseen phishing-puolustukseen - esim. TruthScanin sähköpostihuijauksen ilmaisin sähköpostipalveluntarjoajasi API:n kautta, jotta voit automaattisesti karanteeniin eristää epäilyttävät tekoälyn luomat sähköpostit.[18]. Sitä voidaan soveltaa myös viestialustoihin (chat-sovellukset, tekstiviestiportit) sisällön skannaamiseksi phishing- tai huijausmallien varalta.

- Puhelinkeskukset ja äänijärjestelmät: Puhelin- ja VOIP-kanavat on suojattu integroimalla ääniväärennösten tunnistus. Esimerkiksi pankin asiakastukilinja voisi käyttää TruthScanin tekoälyn äänentunnistin analysoida saapuvan soittajan ääntä reaaliaikaisesti ja varoittaa, jos soittajan ääni on synteettinen tai ei vastaa hänen tunnettua profiiliaan.[58][59]. Tämä auttaa estämään vishing-hyökkäysten ja ääni-imitaatiohyökkäysten (kuten toimitusjohtajan väärennettyjen puhelujen) onnistumisen.

- Käyttäjän henkilöllisyyden todentamisprosessit: Kun tili luodaan tai riskialttiita käyttäjätoimia (salasanan nollaus, tilisiirrot), tekoälyyn perustuva henkilöllisyyden todentaminen käynnistyy. Ladattu valokuvatunniste tarkistetaan kuvantunnistustyökalulla (esim. tarkistamalla, onko se tekoälyn luoma vai valokuva valokuvasta), ja selfie- tai videopuhelu tarkistetaan deepfake-ilmaisimella. TruthScanin Deepfake-ilmaisin voidaan käyttää tässä kasvojen todennuksen suorittamiseen - varmistetaan, että kamerassa oleva henkilö on todellinen ja vastaa tunnistetietoja.[60][61]. Käyttäytymissignaaleja (kirjoitustiheys, laitteiden johdonmukaisuus) voidaan myös syöttää tekoälymalleihin bottien tai synteettisten identiteettien tunnistamiseksi.

- Päätepisteet ja verkko: Päätelaitteiden tietoturva-agentit ja välityspalvelimet voivat sisältää tekoälyn sisällönanalyysin tiedostojen ja komentosarjojen osalta. Jos esimerkiksi päätelaitteen EDR havaitsee uuden skriptin tai EXE-tiedoston suoritettavan, se voi lähettää tiedoston tekstisisällön tekoälyilmaisimelle tarkistaakseen, muistuttaako se tunnettuja tekoälyn tuottamia haittaohjelmia tai onko siinä havaittavissa tekoälykoodin hämäriä piirteitä. Vastaavasti DLP-järjestelmät (tietojen häviämisen esto) voivat käyttää tekoälytekstin havaitsemista merkitä arkaluonteisen tekstin, joka on tekoälyn tuottamaa (mikä voisi viitata siihen, että sisäpiiriläinen käyttää tekoälyä tietojen siirtoviestien laatimiseen tai raporttien väärentämiseen). TruthScanin Reaaliaikainen ilmaisin on suunniteltu liitettäväksi tällaisiin työnkulkuihin, ja se tarjoaa reaaliaikaista sisällön analysointia eri alustoilla sekä automaattisia vastausvaihtoehtoja.[42][62] (esimerkiksi tiedoston tai viestin automaattinen estäminen, jos se tunnistetaan tekoälyn tuottamaksi haittaohjelmaksi tai disinformaatioksi).

The keskeinen etu tämän yhdennetyn lähestymistavan tavoitteena on nopeus ja johdonmukaisuus. Tekoälyhyökkäykset etenevät nopeasti - phishing-sähköpostit, väärennetyt äänet ja synteettiset tiedot voivat iskeä moniin kanaviin yhtä aikaa. Kun kaikki nämä kanavat varustetaan tekoälyn tunnistuksella, organisaatio saa reaaliaikaista näkyvyyttä ja syvyyssuuntaisen puolustuksen. Eräs tiimi kuvasi sitä "tekoäly-immuunijärjestelmän" luomiseksi yritykselle: aina kun jotakin viestitään (olipa kyseessä sähköposti, asiakirjan lataus, äänipuhelu jne.), tekoäly-immuunijärjestelmä "haistelee" sen vieraiden (tekoälyn luomien) allekirjoitusten varalta ja neutralisoi sen, jos se havaitaan haitalliseksi.

TruthScanin yrityspaketti on tästä hyvä esimerkki, sillä se tarjoaa yhtenäinen alusta Tekoälyn havaitseminen tekstin, kuvan, äänen ja videon avulla, joka voidaan ottaa käyttöön modulaarisesti tai kokonaisuutena.[63][64]. Monet yritykset aloittavat ottamalla käyttöön yhden tai kaksi ominaisuutta (esimerkiksi tekstintunnistus sähköpostissa ja kuvantunnistus sisäänkirjautumisessa) ja laajentavat sitten muihin, kun näkevät niiden arvon. Tärkeää on, että integrointi on tehty kehittäjäystävälliseksi - TruthScan ja vastaavat palvelut tarjoavat API- ja SDK-palveluja, joiden avulla tietoturvaryhmät voivat liittää havaitsemisen olemassa oleviin järjestelmiin ilman massiivista uudelleensuunnittelua. Olipa kyseessä SIEM, sähköpostiportti, mukautettu pankkisovellus tai CRM-järjestelmä, havaitseminen voi toimia kulissien takana ja syöttää hälytyksiä tai automaattisia toimia. Esimerkiksi eräs suuri sosiaalisen median alusta integroi sisällönmoderoinnin API:t, jotta se voi automaattisesti poistaa väärennetyt videot muutamassa minuutissa niiden lataamisesta.[65][66]ja estää tekoälyn tuottaman väärän tiedon leviämisen.

Johtopäätökset: Pysyminen kehityksen kärjessä

Tekoälyyn perustuvien uhkien nopea leviäminen vuonna 2025 on haastanut organisaatiot uusilla tavoilla. Hyökkääjät ovat löytäneet keinoja hyödyntää ihmisten luottamusta laajamittaisesti - esiintymällä ääninä ja henkilöllisyyksinä, automatisoimalla sosiaalista insinöörityötä, kiertämällä puolustuksia mukautuvan koodin avulla ja luomalla kokonaisia vääriä todellisuuksia. Se on pelottava näkymä puolustajille, mutta ei toivoton. Aivan kuten rikolliset valjastavat tekoälyn, myös me voimme käyttää tekoälyä turvallisuuden hyväksi. Tietotekniikan kehittyminen Tekoälyn sisällön havaitseminen, väärennösten rikostekninen tutkiminen ja synteettisen identiteetin skannerit. antaa meille tehokkaita vastatoimia näitä uusia uhkia vastaan. Käyttämällä näitä välineitä ja integroimalla ne kaikkiin kerroksiin puolustuksen avulla yritykset voivat vähentää huomattavasti tekoälyllä toimivien hyökkäysten läpipääsyriskiä. Varhaiset käyttäjät ovat jo estäneet miljoonien dollareiden petosyritykset nappaamalla väärennökset itse teossa.[26], tai estänyt phishing-katastrofit suodattamalla tekoälyn luomia sähköposteja.

Teknologian lisäksi organisaatioiden tulisi kehittää "luota, mutta tarkista" -kulttuuria. Työntekijöiden tulisi olla tietoisia siitä, että tekoälyn aikakaudella näkeminen (tai kuuleminen) ei aina tarkoita uskomista - terve skeptisyys yhdistettynä todentamistyönkulkuihin voi pysäyttää monet sosiaalisen manipuloinnin juonet. Koulutus ja tietoisuus yhdistettynä TruthScanin kaltaiset automaattiset todentamisvälineet, muodostavat pelottavan puolustuksen. Meidän on tavallaan nostettava tiedon todentamisen ja validoinnin rimaa. Digitaalisia viestejä ja asiakirjoja ei voida enää ottaa todesta, vaan niiden alkuperä on tarkistettava joko koneellisesti tai prosessin avulla.

Odotettavissa on, että hyökkääjät kehittävät tekoälytaktiikoitaan entisestään, mutta myös puolustavan tekoälyn innovaatiot jatkuvat. Kissa ja hiiri -dynamiikka jatkuu. Puolustajien menestys riippuu ketteryys ja tiedustelutietojen jakaminen. Ne, jotka ottavat nopeasti käyttöön uusia uhkatietoja (esim. uusia deepfake-tunnistustekniikoita tai päivitettyjä tekoälymallien allekirjoituksia), pysyvät uusimpia tekoälytyökaluja hyödyntävien hyökkääjien edellä. Teollisuuden, korkeakoulujen ja hallitusten välinen yhteistyö on myös elintärkeää tässä taistelussa, kuten NIST:n tekoälyriskien hallintakehyksen kaltaisten virastojen antamat hälytykset ja kehykset sekä pankkien välinen yhteistyö tekoälypetosten havaitsemiseksi.

Lopuksi todettakoon, että kyberturvallisuusala on tekoälypohjaisen paradigman muutoksen keskellä. Uhkat eivät ole samanlaisia kuin vuosikymmen sitten, mutta vastaamme niihin yhtä lailla ennennäkemättömällä puolustuksella. Edistyksellisen havaintoteknologian ja vankan turvallisuusstrategian yhdistelmällä me voi lieventää generatiivisen tekoälyn riskejä ja jopa kääntää se eduksemme. TruthScanin tekoälyn havaitsemispaketin kaltaiset työkalut antavat meille seuraavat mahdollisuudet palauttaa luottamus nollaluottamuksen maailmassa - varmistaaksemme, että linjan toisessa päässä oleva henkilö on todellinen, että saapuneet asiakirjat ovat aitoja ja että verkossamme suoritettavaa koodia ei ole peukaloinut pahantahtoinen tekoäly. Investoimalla näihin ominaisuuksiin nyt organisaatiot eivät ainoastaan suojaudu nykyisiltä tekoälyä hyödyntäviltä hyökkäyksiltä vaan myös rakentavat vastustuskykyä tulevaisuuden uhkia vastaan. Lopputulos on selvä: Tekoäly saattaa tehostaa verkkohyökkäyksiä, mutta oikealla lähestymistavalla se voi myös tehostaa puolustustamme.

Lähteet: Asiaankuuluvat tiedot ja esimerkit on poimittu 2025 uhkatiedusteluraportista ja asiantuntijoilta, kuten Mayer Brownin Cyber Incident Trends -julkaisusta.[1][67], Fortinetin vuoden 2025 uhkakuvaus[2][19], Barracudan tutkimus tekoälyn sähköpostihyökkäyksistä[6][7], Googlen GTIG:n raportti tekoälyuhkista[34], Bostonin keskuspankin näkemyksiä synteettisistä petoksista[45][50]sekä TruthScanin julkaisemat tapaustutkimukset ja lehdistötiedotteet.[30][26]muun muassa. Nämä havainnollistavat tekoälyyn perustuvien uhkien laajuutta ja tekoälyyn keskittyvien vastatoimien tehokkuutta todellisissa skenaarioissa. Oppimalla tällaisesta älykkyydestä ja ottamalla käyttöön huippuluokan työkaluja voimme navigoida tekoälyyn perustuvien kyberriskien aikakaudella luottavaisin mielin.

[1] [67] 2025 Cyber Incident Trends What Your Business Needs to know | Insights | Mayer Brown

[2] [3] [19] Kyberturvallisuuden huipputilastot: Faktat, tilastot ja tietoturvaloukkaukset 2025: Faktat, tilastot ja tietoturvaloukkaukset 2025

https://www.fortinet.com/resources/cyberglossary/cybersecurity-statistics

[4] [11] [12] [16] [17] [20] [22] [47] [48] [52] Tekoälypohjaiset petokset rahoituspalveluissa: TruthScan

https://truthscan.com/blog/ai-driven-fraud-in-financial-services-recent-trends-and-solutions

[5] [26] [30] [54] TruthScan havaitsi Pohjois-Korean Deepfake-hyökkäyksen puolustusalan virkamiehiä vastaan - Bryan County Magazine

[6] [7] [14] Puolet postilaatikossasi olevasta roskapostista on tekoälyn tuottamaa - sen käyttö kehittyneissä hyökkäyksissä on varhaisemmassa vaiheessa | Barracuda Networks Blogi

https://blog.barracuda.com/2025/06/18/half-spam-inbox-ai-generated

[8] [10] Q2 2025 Digital Trust Index: AI Fraud Data and Insights | Sift

https://sift.com/index-reports-ai-fraud-q2-2025

[9] [13] [24] [25] [38] [39] Tekoälyn kyberturvallisuusuhat 2025: $25.6M Deepfake: $25.6M Deepfake

https://deepstrike.io/blog/ai-cybersecurity-threats-2025

[15] [21] Uusimmat uhkatiedot | TruthScan

[18] [63] [64] TruthScan - Yritysten tekoälyn havaitseminen ja sisällön suojaus

[23] [46] [56] [57] Deepfakes ja talletukset: Generative AI Fraud: How to Fight Generative AI Fraud

https://www.amount.com/blog/deepfakes-and-deposits-how-to-fight-generative-ai-fraud

[27] Deepfake-hyökkäykset ja tekoälyn luoma phishing: 2025 tilastotiedot

https://zerothreat.ai/blog/deepfake-and-ai-phishing-statistics

[28] [58] [59] Tekoälyn äänentunnistin Deepfakes & Voice Cloning | TruthScan

https://truthscan.com/ai-voice-detector

[29] [31] [60] [61] [65] [66] Deepfake Detector - Tunnista väärennetyt ja tekoälyvideot - TruthScan

https://truthscan.com/deepfake-detector

[32] [33] [34] [35] [36] [37] [41] GTIG AI Threat Tracker: Advances in Threat Actor Usage of AI Tools | Google Cloud Blog

https://cloud.google.com/blog/topics/threat-intelligence/threat-actor-usage-of-ai-tools

[40] Hakkerit peittivät haittaohjelmia runsaalla tekoälykoodilla

https://www.bankinfosecurity.com/hackers-obfuscated-malware-verbose-ai-code-a-29541

[42] [43] [62] Reaaliaikainen tekoälyn havaitseminen - TruthScan

https://truthscan.com/real-time-ai-detector

[44] EvilAI-operaattorit käyttävät tekoälyn luomaa koodia ja väärennettyjä sovelluksia kaukana ...

https://www.trendmicro.com/en_us/research/25/i/evilai.html

[45] [49] [50] [51] [55] Tekoälyn sukupolvi lisää synteettisten identiteettipetosten uhkaa - Federal Reserve Bank of Boston

[53] Synteettinen identiteettipetos 2025: AI Detection & Prevention Strategies