Hace sólo unos años, se necesitaba un estudio profesional y mucha habilidad técnica para imitar la voz de alguien.

Ahora, cualquiera con una conexión a Internet y algo de tiempo libre puede crear un clon digital de la voz de cualquier persona en menos de un minuto.

Las herramientas para estos ataques son cada día más baratas y accesibles para todo el mundo. Y como tanta gente comparte su vida en las redes sociales, es muy fácil para un estafador encontrar el audio que necesita.

En este artículo, le mostraremos algunos de los ejemplos reales más conocidos de fraude de audio. También te presentaremos una solución para acabar a tiempo con estas amenazas.

Principales conclusiones

- Los intentos de fraude por imitación de voz han aumentado en más de 2.137% en los últimos años, impulsados por el hecho de que la IA moderna puede generar un clon de voz 85% preciso utilizando tan solo tres segundos de audio de origen.

- Entre los ataques reales más conocidos se encuentra el atraco a la empresa de ingeniería Arup en 2024, en el que los estafadores utilizaron un vídeo y un audio falsos de un director financiero para engañar a un empleado y conseguir que transfiriera $25,6 millones.

- Más allá del robo a empresas, las falsificaciones de voz plantean graves riesgos emocionales a las familias a través de estafas de secuestro y pueden burlar los sistemas de seguridad biométricos tradicionales utilizados por bancos y otras aplicaciones de alta seguridad.

- Las organizaciones se ven obligadas a ir más allá de la mera verificación humana mediante la implantación de protocolos de aprobación multipersonal para grandes transferencias y el despliegue de detectores de voz de IA como TruthScan para analizar las huellas acústicas en tiempo real.

- TruthScan garantiza la seguridad de las interacciones empresariales mediante la identificación de artefactos de voz sintética de plataformas como ElevenLabs y Murf con una precisión superior a 99% en los principales formatos de audio y vídeo.

¿Qué son los ataques Deepfake de voz?

Un deepfake de voz es una falsificación digital de la voz de alguien. El atacante utiliza un software capaz de analizar hasta el más mínimo detalle de cómo habla una persona a partir de una grabación de su voz.

Para clonar la voz, el software intenta detectar patrones en la voz. Principalmente, el software tiene en cuenta aspectos como el tono, la forma de respirar entre frases, etc.

Una vez que aprende estos patrones, el atacante puede hacerle decir cualquier cosa con esa voz.

No vuelva a preocuparse por el fraude de IA. TruthScan puede ayudarle:

- Detectar IA generada imágenes, texto, voz y vídeo.

- Evite grandes fraudes impulsados por la IA.

- Proteja sus sensible activos de la empresa.

Lo peligroso es que las herramientas de creación de deepfakes de voz son fácilmente accesibles. Y la mayoría de ellas no necesitan instalación. Están disponibles en línea en forma de sitios web.

Sólo tienes que echarles unos dólares y empezar a clonar voces. Si indagas un poco más, puede que incluso encuentres herramientas que te permitan clonar voces gratis.

Esta tecnología nueva y de fácil acceso ha provocado un fuerte aumento de los fraudes sonoros.

Los estafadores sólo necesitan un trocito de audio de alguien, que pueden obtener de las redes sociales o de algún otro canal público, para clonarlo.

Luego pueden utilizar la voz clonada para hacerse pasar por una persona en situaciones como llamadas telefónicas en directo, reuniones por vídeo, notas de voz, anuncios, etc.

No se trata de casos hipotéticos de ataques de voz falsa. Estas cosas ya han ocurrido. Más adelante hablaremos de algunos de los ataques de imitación de voz más conocidos.

Riesgos potenciales de los ataques de deepfake de voz

Al oír hablar de voice deepfake, es posible que hayas conjurado imágenes de un vídeo gracioso de un famoso diciendo cosas que nunca ha dicho.

Pero ese uso aparentemente inocuo de la voz clonada puede causar graves daños a las partes implicadas. Hablemos de los riesgos.

Devastación financiera para las empresas

Una falsificación de voz puede arruinar la reputación de una empresa para siempre. También tiene el poder de robarle grandes sumas de dinero en cuestión de minutos.

¿Cómo es posible? Los estafadores pueden clonar la voz del jefe de una empresa y utilizarla para llamar a los empleados y obligarles a hacer cosas que se supone que no deben hacer, como mover dinero a una cuenta.

Éste es sólo un ejemplo. Las posibilidades son infinitas.

Anulación de sistemas de seguridad

Tu voz es un dato biométrico que nadie más debería tener. Porque la utilizas como contraseña para iniciar sesión en muchas de tus aplicaciones, especialmente las bancarias.

Aunque estas aplicaciones pueden llevar incorporado un sistema automatizado de verificación de voz para impedir el acceso no autorizado, un buen clon de voz aún tiene posibilidades de engañarlas.

La carga emocional de las familias

Quizá los objetivos más fáciles para los defraudadores de audio sean las personas mayores de la familia. Padres y abuelos, por ejemplo.

Los estafadores pueden llamar, por ejemplo, a una madre y reproducir el sonido de su hija pidiendo ayuda, diciendo que ha sido secuestrada.

Erosión de la confianza en el lugar de trabajo

Los ataques de deepfake de voz también dañan la confianza en un lugar de trabajo sano.

Los empleados tendrán que volver a comprobar las llamadas de su jefe para asegurarse de que no se trata de un estafador que les ordena hacer cosas arriesgadas con una voz clonada.

Entonces, ¿cuáles son sus opciones si no doble comprobación manual? Todos los riesgos que acabamos de discutir apuntan a la necesidad de una prevención automatizada de ataques deepfake.

Por suerte, ahora disponemos de herramientas de detección de voces de IA falsas, entre las que se encuentra TruthScan.

Evite el fraude y la suplantación de identidad con TruthScan Detector de voz AI.

Ejemplos reales de ataques de imitación de voz

Gracias a la IA, hemos llegado a un punto en el que ya no podemos fiarnos de lo que ven nuestros ojos o escuchan nuestros oídos. La IA es ahora capaz de crear imágenes y vídeos realistas. Lo mismo ocurre con el audio.

Puede que ya hayas oído historias de gente que ha caído en el fraude del audio deepfake. También aparecen en las noticias y en las redes sociales de vez en cuando. Algunas son difíciles de entender.

Vamos a contarte algunos de los ataques de deepfake de voz más conocidos para que te hagas una idea de la astucia con la que se ejecutan.

La reunión virtual de $25 millones que nunca llegó a celebrarse

Este ataque deepfake es probablemente el más denunciado.

En víctima fue una empresa de ingeniería del Reino Unido llamada Arup, pero la estafa se originó en su oficina de Hong Kong.

Era principios de 2024 cuando un trabajador del departamento financiero de la empresa recibió un correo electrónico del director financiero de la empresa en el Reino Unido. En el correo, el director financiero indicaba al trabajador que debía realizar transferencias secretas de dinero a unas cuentas bancarias.

Al principio, el empleado sospechó porque la solicitud le pareció un poco extraña y pensó que podría tratarse de una estafa de phishing.

Pero entonces el empleado fue invitado a una videoconferencia. Cuando el empleado se unió a la llamada, vio lo que parecía exactamente el Director Financiero y varios otros colegas de alto nivel.

Todos parecían y sonaban exactamente como debían. También hablaban entre ellos para que pareciera más real.

Esto disipó por completo todas las dudas del trabajador del departamento financiero, que a continuación envió más de $25,6 millones (~HK$200 millones) a varias cuentas bancarias diferentes de Hong Kong a través de 15 transacciones.

Más tarde se descubrió que todo este montaje era un deepfake. Ninguna persona de la llamada era quien parecía, excepto el empleado de Arup. Los estafadores habían coordinado a la perfección el ataque utilizando clones de audio y vídeo de alta calidad del director financiero y los empleados de alto nivel de la empresa.

El ministro italiano y los iconos de la moda

Ésta también tuvo lugar en 2024. A falso ministro de defensa italiano Guido Crosetto llamó a varias élites italianas y les pidió ayuda financiera inmediata para rescatar a los periodistas secuestrados.

En la llamada, el falso Guido Crosetto afirmaba que se trataba de una operación gubernamental de alto secreto. El autor de la llamada consiguió incluso hablar por teléfono con figuras legendarias de la moda como Giorgio Armani.

Lamentablemente, una persona acabó transfiriendo cerca de un millón de dólares. Probablemente tenían un sentido del deber patriótico de ayudar más fuerte que otros, que los estafadores supieron aprovechar.

El atraco energético de $243.000 en el Reino Unido

Este ocurrido en 2019 y fue probablemente el primer deepfake de esta envergadura del que se tiene noticia.

Un director general de una empresa energética británica pensaba que estaba hablando por teléfono con su jefe de la empresa matriz en Alemania.

El director general recibió la orden de transferir unos 220.000 euros ($243.000) a un proveedor de Hungría. Le dijeron que se trataba de una operación crítica que requería una transferencia inmediata. El CEO cayó en la estafa y transfirió el dinero.

Una llamada aterradora para una madre de Arizona

¿Recuerdas que hablamos de los deepfakes de audio como una amenaza para las familias? El ejemplo de estafa que dimos ocurrió de verdad.

Los estafadores habían clonado la voz de una chica de 15 años a partir de un vídeo suyo en las redes sociales. Después llamaron a su madre y le dijeron que la habían secuestrado y que sus secuestradores pedían un rescate inmediato.

Por suerte, el padre pudo llamar a su verdadera hija, que estaba a salvo en un entrenamiento de esquí durante toda la experiencia. Esquivaron la estafa.

Cómo afectan las falsificaciones de voz a las empresas

El objetivo principal de un ataque de imitación de voz es sobre todo robar dinero.

Pero cuando el objetivo son las empresas, el daño es multidimensional.

Por ejemplo, los deepfakes pueden envenenar el ambiente entre los empleados de una empresa. Tiene el potencial de crear una cultura en la que los empleados siempre están aterrorizados de cometer una metedura de pata.

Tomemos el ejemplo de los centros de llamadas. Estamos viendo informes de ciberdelincuentes que los llaman y se hacen pasar por clientes concretos.

Su truco consiste en hacer que los agentes del centro de llamadas cambien los datos de las cuentas de esos clientes (por ejemplo, la dirección de su domicilio o el número de teléfono) y se apoderen de sus cuentas.

La contratación a distancia y las entrevistas virtuales son otro campo en el que los candidatos pueden utilizar voces falsas para conseguir empleos para los que no están cualificados.

Proteger a las empresas de los ataques de falsificación de voz

Las normas de seguridad tradicionales en las empresas se escribieron en la era anterior a la IA.

Ya es hora de que las empresas se lo replanteen. En primer lugar, deberían empezar por informarse sobre las numerosas nuevas ciberamenazas derivadas del abuso de la IA.

Por ejemplo, pueden organizar sesiones de formación para todo su equipo y mostrarles ejemplos reales de fraude de audio. Pueden empezar con los ejemplos que acabamos de comentar. Esas sesiones de formación también deberían darles consejos de prevención de ataques deepfake para diferentes escenarios.

A continuación, puede seguir adelante y actualizar las políticas empresariales internas. Un cambio importante puede ser dejar de permitir que una sola persona autorice transferencias masivas por sí sola.

Los grandes pagos deberían requerir la aprobación de todo un panel para que al menos uno de ellos pueda darse cuenta a tiempo de que algo va mal.

También debería pensar en integrar un Detector de voz AI para que se ejecute en segundo plano durante las llamadas.

Para eso se crearon las herramientas de IA de TruthScan. Puede detectar, verificar y prevenir ataques de voz falsa utilizando nuestras herramientas de IA. Le diremos cómo.

Cómo asegura TruthScan las interacciones de voz

Entendemos que los empleados no pueden distinguir por sí solos una voz falsa de una voz real en medio de una llamada estresante. Necesitan un asistente dedicado que pueda ocuparse de ese trabajo durante una llamada, mientras su equipo puede centrarse en hacer aquello para lo que fue contratado.

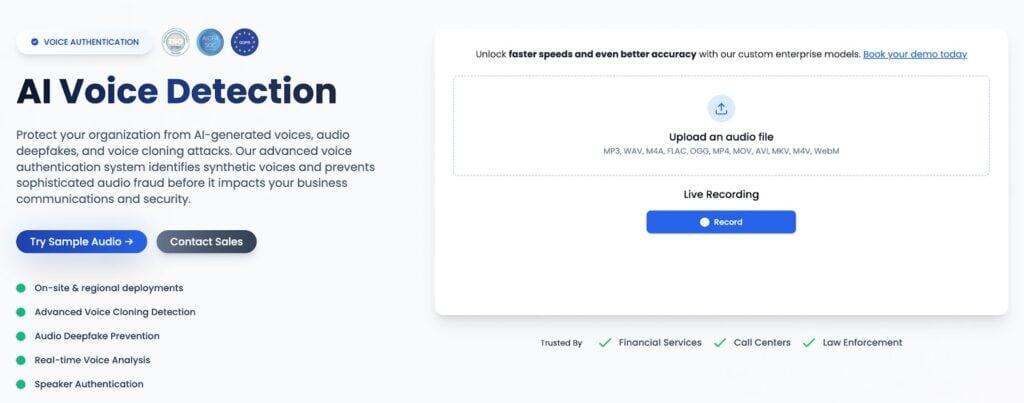

Nuestra Detector de voz AI es una solución específica.

He aquí cómo funciona y de qué es capaz:

- Analiza millones de puntos de datos diferentes en llamadas telefónicas y videoconferencias en directo y ofrece una precisión 99%

- Emite un aviso al instante tras detectar una voz falsa

- Capta patrones espectrales y huellas acústicas en la voz que sólo dejan los modelos sintéticos

- Se integra con su centro de llamadas o servicio de asistencia existentes a través de una sencilla API REST

- Puede escanear los principales formatos de audio y vídeo

Hable con TruthScan sobre la prevención de ataques de voz falsa

Puede detener el fraude por clonación de voz en tiempo real con TruthScan, pero la pregunta es: ¿cuándo va a empezar? Puede que tarde o temprano sus empleados cometan un error garrafal y le estafen. No espere a ese desafortunado momento.

Nuestro detector de voz por IA puede detectar falsificaciones de voz utilizando plataformas como ElevenLabs y Murf.

Funciona en segundo plano durante las llamadas telefónicas en directo y las reuniones por vídeo, para que sus agentes de llamadas no tengan que realizar varias tareas a la vez.

Todo lo que necesita es una rápida integración a través de nuestra API REST.

Empieza con TruthScan ahora y proteja su negocio de las estafas de deepfake.