Una llamada normal de su Director Financiero puede ser el momento en que la confianza se vuelva en su contra. Imagínese que la brecha comienza con;

“¿Puedes enviarme la contraseña de administrador antes de comer?’

Obedeces como si obedecer fuera la única forma de sobrevivir al almuerzo. Suena razonable, ya que es un momento perfectamente ordinario de un día de trabajo.

Pero, este momento rutinario en el trabajo va a ser la escena inicial de un incidente de seguridad. El riesgo llega ahora disfrazado de rutina.

A principios de 2024, exactamente este tipo de engaño llegó con una voz familiar y una cara amistosa cuando un trabajador de las finanzas en Hong Kong cobró $25 millones a alguien con el mismo aspecto que su director financiero real.

Su empresa ya no puede permitirse presumir de buenas intenciones. Es como si estuviéramos sentados en la intersección de la confianza y la responsabilidad legal.

Por lo tanto, es una llamada de atención para alinear sus protocolos de TI con la última legislación de deepfake AI. Porque ahora los hackers hablan con voces que estás acostumbrado a oír todos los días.

Siga leyendo y adéntrese en la nueva era jurídica de la IA para ver cómo las imágenes y los sonidos falsos pueden crear una exposición jurídica real.

Principales conclusiones

- La confianza ya no es segura. La estafa del director financiero de Hong Kong, valorada en $25 millones, demostró que la familiaridad puede fingirse de forma convincente.

- La ley va ahora más deprisa. En el momento en que se despliega la IA, la responsabilidad legal sigue a la empresa. Así que, no importa quién haya pulsado “desplegar”, la ley te señala a ti.

- Los medios sintéticos están tan avanzados que confiar únicamente en los instintos humanos es ahora una apuesta arriesgada. Las empresas necesitan sistemas de detección de IA en tiempo real para escanear todos los correos electrónicos, todas las llamadas de vídeo/voz y los archivos compartidos en busca de indicios de manipulación.

¿Qué es la legislación Deepfake?

La legislación Deepfake ya no es abstracta, o lo que es lo mismo “pertenece sólo en teoría”. Es una necesidad legal innegociable que incluso las empresas bien establecidas se ven presionadas a adoptar.

Pero, ¿qué es exactamente este conjunto de reglas que obligan a tomar decisiones difíciles? Nada confuso, sólo un mapa que necesitas para mantenerte a la cabeza en esta era de la IA.

Como cada píxel contiene una verdad oculta (o una mentir), los gobiernos mundiales se apresuran a impedir que la manipulación de la IA hunda a las empresas. Por ejemplo, la Ley de AI de la UE obliga ahora a las empresas a etiquetar los contenidos de IA o se arriesgan a multas millonarias.

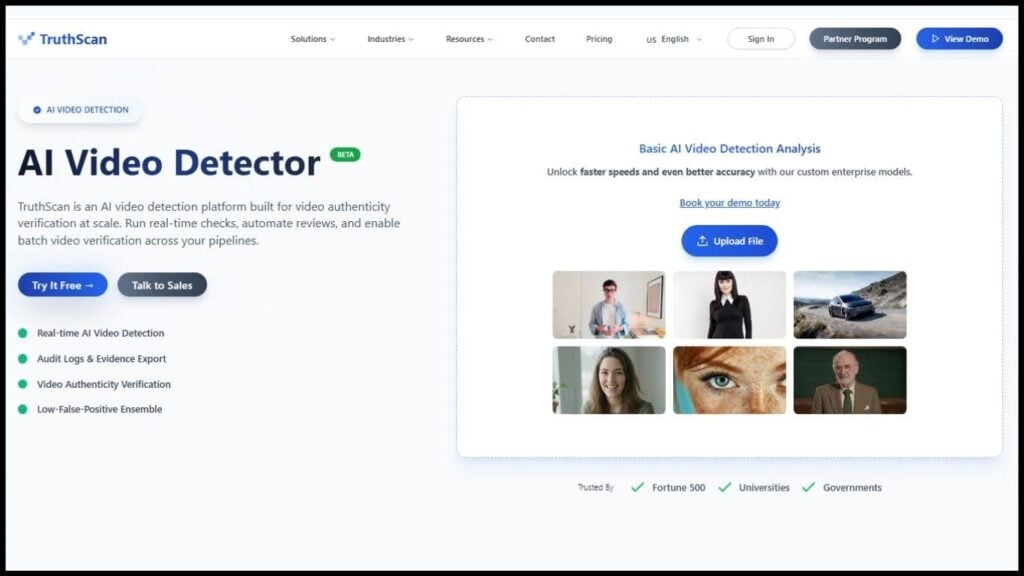

No vuelva a preocuparse por el fraude de IA. TruthScan puede ayudarle:

- Detectar IA generada imágenes, texto, voz y vídeo.

- Evite grandes fraudes impulsados por la IA.

- Proteja sus sensible activos de la empresa.

Porque los humanos necesitan saber cuándo habla una IA y no una persona real.

Cómo afecta Deepfake a las empresas

¿Correos electrónicos de phishing y brechas en la red? ¡Noticia vieja!

La amenaza ahora suena y se parece a su director general (y con la legislación sobre deepfake de IA, las empresas no pueden permitirse ignorarla). Un simple “sí” puede costar millones. Esto demuestra que la confianza es la inversión más salvaje: puede ser tanto tesoro y trampa.

Pero, ¿y si las mentiras enseñan primero las manos? Sí, las mentiras de Deepfake han encontrado su pareja: La detección de IA.

Las organizaciones están desplegando Detectores de IA a través de los canales de comunicación interna porque temen al “Director General” que en realidad nunca ha llamado.

Y, sinceramente, esperar una brecha no es más que una apuesta multimillonaria.

Es más bien una vulnerabilidad, porque los vídeos deepfake de hoy en día han superado nuestra capacidad natural para detectar una falsificación.

La triste realidad es que ya no hay diferencia entre un JEFE y un fantasma de píxeles, a menos que utilices un Detector de vídeo AI creíble que se niega a dejar que una marioneta dirija su nómina.

Riesgos jurídicos para las empresas

“No lo sabía” no es una defensa legal válida en 2026 (gracias al nuevo legislación deepfake).

Si su empresa trata las leyes de IA como “sugerencias”, una demanda es sólo cuestión de tiempo. (Un dato curioso: es sólo una forma de hacer muy, muy ricos a sus abogados).

Ahora, con el fin de proteger a su C-suite de un error de $25 millones y para mantenerse fuera de la sala del tribunal, es esencial convertir “Verificar” en la nueva palabra favorita de su empresa.

Porque, siendo realistas, “Verificar” es el único control interno que protege una marca.

Garantiza que sus activos no se conviertan en el ROI de otra persona rompiendo el círculo del engaño.

‘Verificar’ no es una frase hecha, es una orden.

Atrás quedaron los días en que las promesas vagas y las preguntas amables eran eficaces. Ahora se trata de recibos legales claros y una política de tolerancia cero ante el error.

En Orden ejecutiva de EE.UU. sobre IA, no sólo exige buena voluntad, sino un rastro de papel frío y duro, y la legislación sobre falsificación de IA no hace más que reforzar esa responsabilidad.

Por lo tanto, a la hora de contratar IA y convertirla en una piedra angular de su estrategia, el objetivo debe ser garantizar que sea ética.

Porque cuando su agente autónomo de IA infrinja la ley, los tribunales no culparán al fallo, sino a quien lo haya desplegado, lo que significa que su empresa estará legalmente en un aprieto. Y eso nunca acaba bien.

Nueva era: la legislación reasigna responsabilidades

“El error humano puede ocurrir, y la víctima de un deepfake no debe ser demandada”.”

Esas son las palabras de la nueva ley, como se ha puesto de relieve en las recientes noticias sobre legislación deepfake, que ahora están poniendo el foco en el engaño, no en el engañado.

Supongo que es la infraestructura la que se lleva la peor parte.

Así que, si su empresa sigue indefensa, es hora de que tome las medidas cautelares adecuadas, porque enfrentarse a un juez que no cree en el “oops” será definitivamente duro.

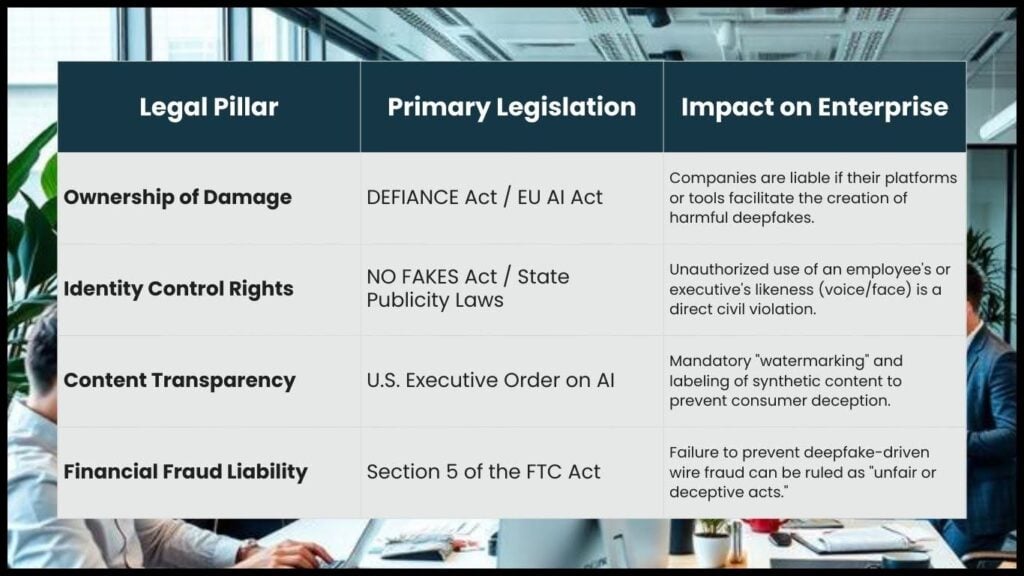

Tres áreas críticas de exposición legal:

Las empresas están ahora expuestas a tres líneas legales clave de defensa.

1- Propiedad del daño

En Ley de desafío y la legislación emergente sobre deepfakes responsabiliza claramente a las empresas de las repercusiones de su tecnología. Si, por ejemplo, su plataforma permite la creación de un deepfake perjudicial, la responsabilidad recaerá sobre usted.

2- Derechos de control de identidad

Muchos Estados de EE.UU. están redefiniendo a quién pertenece la imagen de una persona. No cabe duda de que la identidad es un bien protegido legalmente, pero en esta era de la IA y los medios sintéticos, el uso indebido ya no es una zona gris, es una violación legal directa.

Por tanto, si alguna empresa no respeta los derechos de identidad, la responsabilidad recaerá de lleno sobre ella.

3-Protección jurídica de las palabras y las obras

Si alguien viola los derechos de marca y utiliza material protegido por derechos de autor sin licencia, considere la posibilidad de imponer sanciones civiles donde más duele: en sus beneficios.

Retos y requisitos de conformidad

Hay una delgada línea entre lo que es real y lo que sólo suena real.

El cumplimiento existe para evitar que esa línea desaparezca, especialmente con las noticias sobre legislación falsa que ponen de manifiesto lo rápido que la IA puede saltarse las normas.

Pero, cuando esa línea se difumina, el fraude adopta un rostro amigable. Para mantenerse a la vanguardia, proteger los activos y descubrir mentiras sutiles, la vigilancia debe ser su norma.

Pero, en primer lugar, ¿por qué el cumplimiento nos ve caer? Porque la IA puede hilar mentiras tan suavemente que parecen más reales que la propia verdad.

Desafío 1: Falso “Hola”.”

No nos engañan sólo los sistemas avanzados de IA y el código; nos engañan los modales.

Está bastante claro que las mentiras de la IA vienen vestidas con la sonrisa que uno reconoce, así que los empleados suelen dejar que el reconocimiento prevalezca sobre la razón.

Desde un saludo amistoso en un correo electrónico hasta un memorándum que parece una nota habitual de la jornada laboral, nadie puede culpar al personal de bajar la guardia.

Porque la IA tiene la capacidad de convertir un amistoso “Hola” en un atraco de alta tecnología sin levantar sospechas.

Reto 2: Retraso normativo (viejas leyes, nueva guerra)

La IA evoluciona más rápido que las normas destinadas a controlarla.

Las leyes existentes seguramente verifican las identificaciones e inicios de sesión de forma eficiente, pero ¿patrones persuasivos? Falta de intuición y tracción digital.

Los marcos de cumplimiento e incluso la legislación deepfake no pueden seguir el ritmo de la velocidad del engaño, y esto supone un enorme riesgo para las organizaciones de todo el mundo.

Dado que las empresas son responsables de los riesgos, la ley va por detrás de la evolución de la IA.

Reto 3: Juicio humano sobrecargado

Por muy entrenadas que estén, las personas no pueden mantener la perfección 24/7 en un cerebro de 9 a 5.

No cabe duda de que el personal examina minuciosamente los correos electrónicos, pero si el volumen aumenta, el agotamiento hace que crezcan los pequeños errores.

Por lo tanto, si las empresas siguen confiando en la vigilancia humana, incluso un correo electrónico pasado por alto se convertirá en una puerta de entrada para algo mortal, por ejemplo:

- Ruina de la reputación

- Dolor de cabeza legal

- Responsabilidad masiva

Requisito 1: Protocolo de seguridad por capas

La validación humana y automatizada debe pasar por todo el espectro de salvaguardias.

La validación ordinaria suele incluir simples comprobaciones de formularios y referencias cruzadas básicas, por lo que quedan lagunas que pueden comprometer la seguridad.

Por otro lado, la seguridad avanzada por capas exige inspecciones de varios pasos para cada acción.

Por ejemplo, cuando se realiza una transferencia importante, cada paso desencadena una verificación biométrica, automatizada y humana antes de completarse.

De este modo, nada pasará desapercibido.

Requisito 2: Vigilancia cognitiva

¿Quién dice que sólo los ojos humanos detectan las señales falsas? La mejor forma de detectar rostros sintéticos es dejar que una IA más aguda escanee cada señal.

Aquí es donde TruthScan Detector de IA en tiempo real se erige en el último guardián del cumplimiento frente a cualquier engaño de la IA.

Dado que el verdadero cumplimiento no es episódico, el detector de IA en tiempo real de TruthScan funciona las 24 horas del día, los 7 días de la semana, asegurándose de que el fraude nunca se produzca.

Escanea correos electrónicos, documentos y plataformas de chat para descubrir trucos sintéticos y desenmascarar identidades falsas al instante.

Requisito 3: Observador del comportamiento

Cuestionar debería ser la norma.

Cuando la duda se convierte en un hábito protector, las empresas van dos pasos por delante del engaño.

Por ejemplo, cuando un alto ejecutivo envía una solicitud urgente y fuera de lugar para una transferencia de fondos, un momento de duda puede ahorrar millones.

Buenas prácticas para la preparación de las empresas

La preparación lo es todo, sobre todo con una legislación falsa que hace inevitable la rendición de cuentas.

La mejor defensa es un equipo en alerta constante. En una era de rápida transformación digital y ciberamenazas constantes, solo los vigilantes protegen los activos y neutralizan las amenazas.

La defensa debería ser infranqueable. En 2024, el coste de la complacencia alcanzó máximos históricos. El $4,88 Millones pérdida muestra el coste real de la negligencia digital.

Por lo tanto, estar “preparado” debería significar no tener ningún eslabón débil a la vista, todas las personas formadas y todos los sistemas a prueba de fallos.

1- Auditorías periódicas y evaluaciones de riesgos

Si está sin cartografiar, está sin vigilar.

Las empresas tienen que identificar los riesgos y cerrar todas las brechas antes de que se conviertan en titulares. Los sectores de alto riesgo, como el financiero y el sanitario, exigen auditorías al menos trimestrales, porque el riesgo no descansa.

Esas auditorías ayudarán a identificar todas las vulnerabilidades ocultas.

Dondequiera que sus defensas se queden cortas, cuantifique lo lejos que está de las normas ISO y NIST.

No se limite a auditar, céntrese en el patrón y estudie las tendencias que muestran exactamente dónde es más frágil su sistema.

Corre “Ejercicios de mesa”, donde el liderazgo simula multas reglamentarias y escrutinio público.

2- Desarrollar un plan de respuesta a la crisis

Un plan que no se pone en práctica no es más que papel mojado.

Un verdadero Plan de Respuesta a las Crisis (PRC) es una hoja de ruta que transforma la incertidumbre en movimientos coordinados. Es como una defensa paso a paso contra la interrupción.

Hay que definir quién hace qué y cuándo aparece la primera señal de problemas.

Establezca claramente la estructura del Equipo de Gestión de Crisis (EGC).

Cree plantillas listas para usar para cada escenario de comunicación. Por ejemplo, La respuesta de Airbnb durante la crisis de los viajes COVID-19 convirtió un estancamiento global en una ventaja estratégica.

Utilizando ‘redacciones’ y centros de recursos preestablecidos, se aseguraron de que todos los mensajes fueran oportunos y auténticos. Esto mantuvo la calma de los interesados incluso cuando el mundo cambiaba.

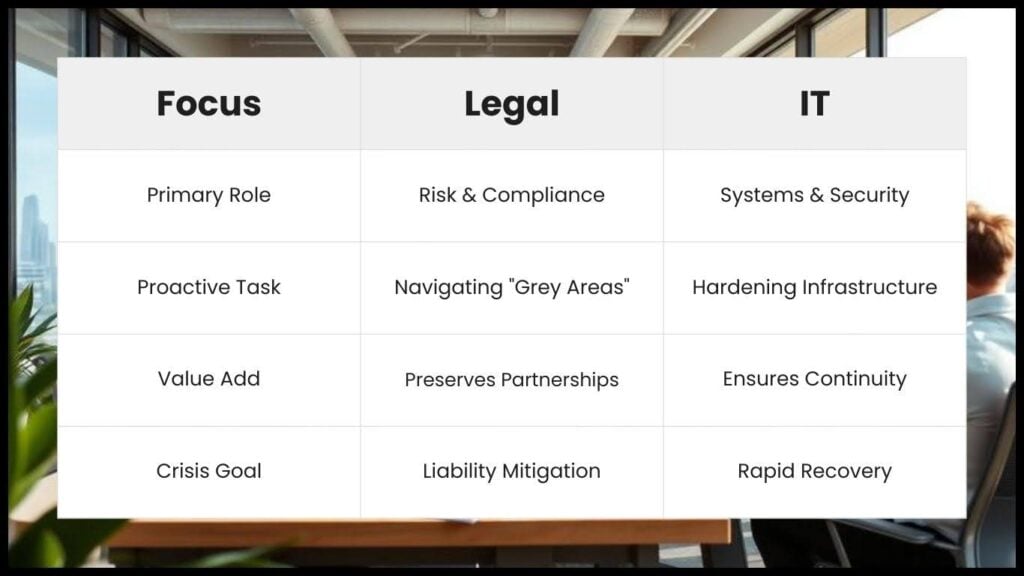

3- Colaboración proactiva con los equipos jurídicos e informáticos

Aislar los departamentos no hace más que perjudicar a su empresa.

Los departamentos jurídico e informático son inseparables. En una crisis, estos dos departamentos deben actuar como uno solo, totalmente alineados para hacer frente a los riesgos señalados por la legislación sobre falsificación.

Legal como cerebro empresarial

Los equipos jurídicos deben participar en todas las decisiones, para que su empresa nunca aprenda por las malas.

Los expertos en Derecho muestran a su dirección dónde cada zona gris legal podría costar relaciones con clientes y socios.

Las TI como columna vertebral

Los informáticos son algo más que “soporte técnico”, son los guardianes de la continuidad operativa. Cuanto más escanean, menos se cuela el fraude.

La colaboración proactiva hace que el cumplimiento y la eficiencia sean aliados, lo que significa que ningún ataque digital interrumpe las operaciones.

Más vale prevenir que curar....

El tiempo confirma el dicho.

El coste de prevenir una crisis es una fracción de lo que cuesta limpiar las secuelas. El precio de la recuperación es siempre mucho más alto y más de lo que cualquier presupuesto puede soportar.

1- Defensa Activa

Las vulnerabilidades deben abordarse antes de que se agraven los daños. Tanto si se trata de la cadena de suministro como de la ciberseguridad o la integridad de los datos, la estrategia más inteligente es reparar antes de que se produzca el fallo.

2- Financiación y asignación de fuerzas

Las organizaciones con visión de futuro dan prioridad a la protección frente a pagar más para solucionar crisis que la preparación podría detener.

Por ejemplo, Maersk, el gigante mundial del transporte marítimo, sufrió un $300 millones de pérdidas en 2017 debido a una única violación del sistema.

Más tarde, la empresa gastó millones en reinstalar miles de máquinas, incluidos 4.000 servidores y 45.000 PC, en sólo diez días para evitar hundir su cadena de suministro en el caos.

Reflexiones finales

La preparación de la empresa es la única forma de ir dos pasos por delante del próximo engaño alimentado por la IA.

A medida que la tecnología deepfake difumina lo que es real y lo que es falso, sólo sobreviven los preparados. Adherirse a la legislación sobre falsificación profunda, como la Ley de Inteligencia Artificial de la UE o la Orden Ejecutiva sobre Inteligencia Artificial de Estados Unidos, no es solo una formalidad, es su defensa contra la manipulación.

Mediante la integración de herramientas de detección de IA en tiempo real, detectores de vídeo, y la formación continua de los empleados, convertirá la cautela en su escudo definitivo contra el engaño.