En los años 90, era el ADN.

En la década de 2000, eran los pings de las torres de telefonía móvil.

Pero en 2026, el nuevo patrón oro de las pruebas es la huella digital.

Piénsalo así...

Cada archivo de vídeo tiene una firma única.

Si la IA altera un solo píxel, la huella dactilar cambia al instante.

Si su prueba de IA no tiene una marca de tiempo de blockchain verificada para bloquear esa huella digital en su lugar, bien podría ser una caricatura a los ojos de un juez moderno.

Esto significa que la era de “ver para creer” ha terminado.

Hemos entrado en la era de la verificación por vídeo con IA, en la que la prueba no se encuentra en lo que se ve, sino en el código digital oculto bajo la superficie.

En este blog, exploraremos por qué las pruebas tradicionales están fallando contra el fraude de vídeo, cómo detectar clips manipulados, por qué la verificación es fundamental para la admisibilidad y por qué un detector de vídeo de IA como TruthScan es ahora esencial para los equipos jurídicos.

Vamos a sumergirnos.

Principales conclusiones

- En 2026, todas las pruebas de vídeo deberán someterse a una verificación de vídeo por IA para ser consideradas fiables.

- El fraude de vídeo incluye pequeñas ediciones, como la manipulación de marcas de tiempo, y no sólo el cambio completo de caras.

- Un detector profesional de deepfakes es la única forma de detectar los artefactos GAN que los humanos pasan por alto.

- Nuevas normas, como la Federal 707, están normalizando la admisión de pruebas de IA en los tribunales.

- El análisis automatizado de pruebas permite a las empresas procesar paquetes masivos de pruebas de forma rápida y precisa.

- TruthScan evita el fraude durante las audiencias en directo detectando máscaras sintéticas en tiempo real.

¿Qué son las pruebas de vídeo en los litigios?

Las pruebas de vídeo son básicamente cualquier clip grabado que se utiliza ante un tribunal para demostrar lo sucedido. Está presente en todas partes, desde casos penales hasta indemnizaciones de seguros.

Sin embargo, en 2026, el aumento del fraude por vídeo ha hecho que “ver para creer” sea una suposición peligrosa. Los profesionales de la justicia necesitan ahora una sólida verificación de vídeo con IA para garantizar la integridad del sistema judicial.

Tipos de pruebas de vídeo que los tribunales utilizan a diario

No vuelva a preocuparse por el fraude de IA. TruthScan puede ayudarle:

- Detectar IA generada imágenes, texto, voz y vídeo.

- Evite grandes fraudes impulsados por la IA.

- Proteja sus sensible activos de la empresa.

- Vigilancia (CCTV): Cámaras de tiendas o semáforos. Es la prueba más habitual en los casos penales.

- Cámaras corporales: Imágenes de agentes de policía, utilizadas sobre todo en casos de derechos civiles o de uso excesivo de la fuerza.

- Dashcams: La prueba a la que acudir en caso de accidente de coche y pelea con el seguro.

- Testimonios grabados: Videodeclaraciones o declaraciones de testigos a distancia que se han convertido en normales desde la pandemia. Ahora son una norma, pero propensas a problemas de detección de fraudes legales.

- Smartphone y redes sociales: Vídeos de transeúntes o mensajes que demuestren el comportamiento o la ubicación de alguien.

- Seguridad de la empresa: Imágenes utilizadas por empresas en casos de fraude o “despido improcedente”.

La IA generativa y la tecnología deepfake han añadido una nueva capa de riesgo. En 2025:

- 1 de cada 20 verificaciones de identidad fueron engañadas por deepfakes de IA

- Según una encuesta de Medius 43% de profesionales habían sido víctimas de un intento de fraude deepfake

Casos reales de fraude con pruebas de vídeo

- Clips de tribunales manipulados

Los clips judiciales manipulados se refieren a cualquier prueba de vídeo o audio presentada en un caso judicial que haya sido alterada, editada o completamente fabricada utilizando tecnología.

Ejemplos:

- Caso deepfake del condado de Alameda (2025): Un caso civil en California fue desestimado después de que el tribunal descubriera que un vídeo de un testigo presentado como prueba había sido creado completamente utilizando IA.

- La defensa del deepfake de Sz Huang contra Tesla (2023): En una demanda por homicidio culposo, los abogados de Tesla afirmaron que las imágenes del accidente podrían ser falsas.

Vídeos de vigilancia alterados

El vídeo de vigilancia es uno de los tipos de pruebas de IA más utilizados en los tribunales. Sin embargo, muchas personas piensan erróneamente que la manipulación se limita a deepfakes completos.

En realidad, el fraude de vídeo suele producirse de formas más pequeñas y menos evidentes que pueden comprometer un caso.

Entre los tipos habituales de manipulación se incluyen:

- Cambios de fecha y hora

- Desmontaje del bastidor

- Cambios de metadatos o GPS

- Sustitución de caras

- Extracción o inserción de objetos

- Imágenes en bucle

- Degradación de la calidad

El vídeo de vigilancia suele proceder de muchos lugares distintos, como tiendas privadas, timbres de viviendas, aparcamientos y cámaras municipales. A diferencia de las grabaciones de las cámaras corporales de la policía, estos sistemas no suelen seguir normas estrictas de cadena de custodia.

Es decir:

- Puede que no quede constancia clara de quién tramitó el expediente.

- Las secuencias pueden copiarse, transferirse o convertirse varias veces.

- Los procedimientos de autenticación pueden ser deficientes o incoherentes.

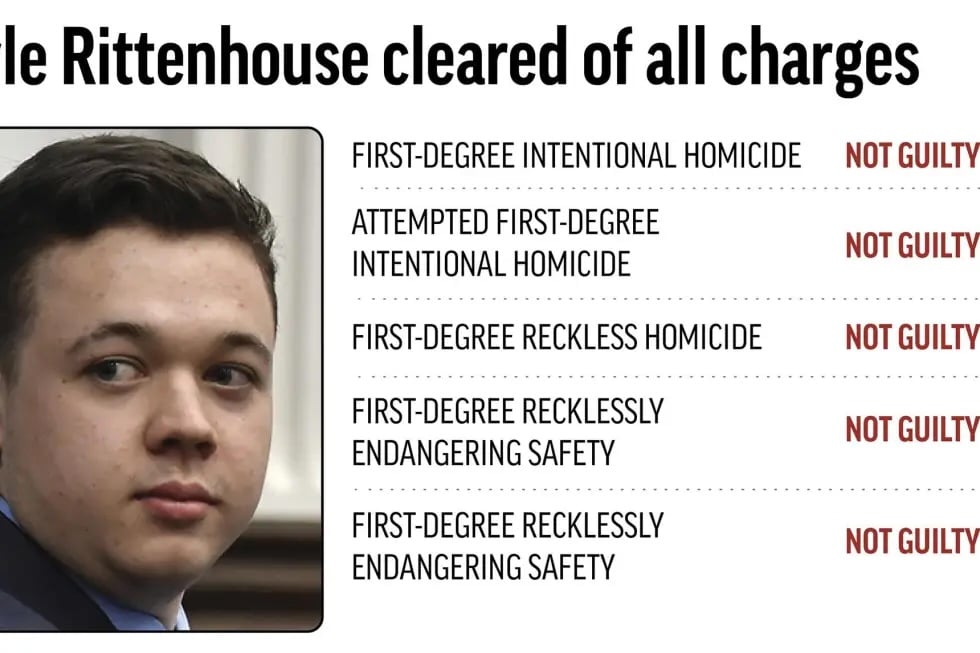

Por ejemplo: La cuestión de la mejora de la IA en Wisconsin contra Rittenhouse

Un ejemplo famoso se produjo en el juicio de Wisconsin contra Rittenhouse. La acusación trató de utilizar la función pellizcar para ampliar de un iPad para mostrar detalles en un vídeo de un dron.

La defensa argumentó que el zoom de Apple utiliza interpolación de IA para adivinar lo que debería estar ahí. El juez dictaminó que, sin un detector de vídeo de IA profesional, las imágenes mejoradas no podían admitirse.

Testimonios en vídeo controvertidos

Un testimonio de vídeo controvertido suele requerir la detección de fraude legal para determinar si una grabación lo es:

- Una deposición o declaración totalmente inventada

- Un testimonio real impugnado como falso

- Una grabación real manipulada

Cada escenario crea una grave carga de autenticación para el tribunal.

Por ejemplo: La custodia de los hijos en el Reino Unido

En un litigio familiar en el Reino Unido citado por la University of Baltimore Law Review, una madre presentó una grabación muy alterada para presentar al padre como violento durante una batalla por la custodia.

El objetivo era restringirle el acceso a sus hijos.

El auge del vídeo generado por IA en asuntos jurídicos

El camino hacia la actual era de los detectores de deepfakes se desarrolló en distintas fases:

- Los primeros años de alerta (2017-2021)

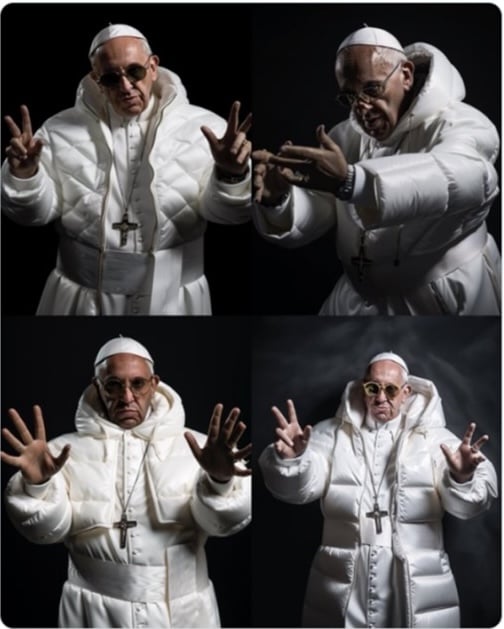

La tecnología Deepfake (impulsada por redes generativas adversariales (GAN)) entró en el ojo público alrededor de 2017.

Los primeros deepfakes solían ser de baja calidad: rostros con distorsiones extrañas, dedos de más, iluminación inadecuada y rasgos borrosos que facilitaban su detección.

- La fase de escalada (2022-2023)

En 2022, la tecnología mejoró. Muchas eran gratuitas y utilizables en un smartphone.

En 2023, empezamos a ver algunos de los primeros desafíos significativos relacionados con deepfake en casos judiciales, como Sz Huang contra Tesla, Estados Unidos contra Reffitt y Estados Unidos contra Doolin, donde los abogados plantearon preguntas sobre si las pruebas de vídeo podrían ser generadas por IA.

Más o menos al mismo tiempo, el Comité Asesor sobre Reglas de Pruebas del Colegio de Abogados de Estados Unidos empezó a estudiar formalmente la cuestión.

- El umbral crítico (2024-2025)

Los contenidos generados por IA no permanecieron académicos mucho tiempo. En 2024, un incidente de la empresa de ingeniería Arup, relacionado con una videollamada falsa generada por IA que autorizaba el uso fraudulento de la inteligencia artificial, se saldó con la muerte de una persona. transferencias bancarias por un total de $25 millones.

El sistema jurídico empezó a responder.

En 2025, Luisiana aprueba la ley HB 178, creando el primer marco estatal de verificación de pruebas de IA.

A nivel federal, el Comité Asesor sobre Reglas de Evidencia de EE.UU. propuso Norma 707, centrada en las pruebas generadas por máquinas.

Situación en 2026

A principios de 2026, la regulación del deepfake y del vídeo con IA se ha acelerado en todo el país:

- 46 Estados han aprobado algún tipo de legislación sobre deepfake.

- Desde 2022, Sólo en 2025 se promulgaron 169 leyes y se presentaron 146 proyectos de ley..

- La Norma Federal 707 está abierta a comentarios públicos hasta el 16 de febrero de 2026.

Mejora de la verificación de vídeo con IA

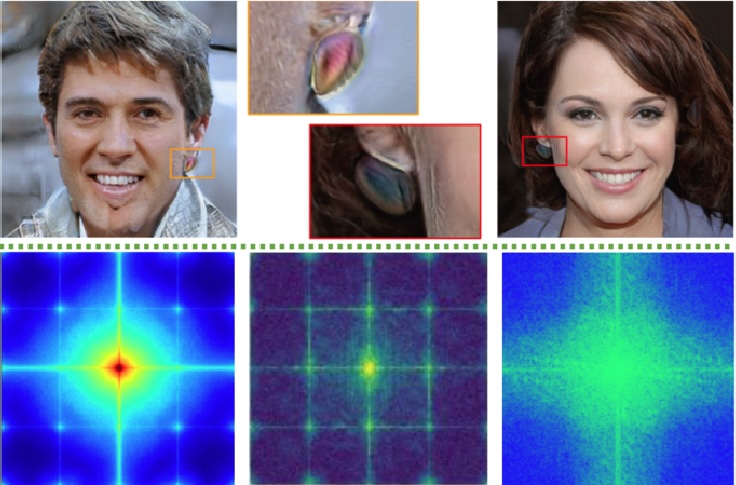

La forma más eficaz de detectar los vídeos generados por IA es utilizar la propia IA.

Esto se debe a que los deepfakes son creados por sistemas de aprendizaje automático que dejan tras de sí sutiles patrones digitales.

Esos patrones son demasiado pequeños o complejos para que los perciba el ojo humano. Pero pueden ser detectados por otros algoritmos.

Un sistema fiable de verificación de vídeo por IA puede analizar varias capas de un vídeo a la vez, entre ellas:

- Análisis del marco comprueba cada fotograma en busca de errores visuales como texturas extrañas, desajustes de iluminación o problemas de mezcla alrededor de las caras.

- Análisis de coherencia temporal observa el movimiento a través de los fotogramas para encontrar saltos poco naturales o movimientos incoherentes.

- Seguimiento de puntos de referencia faciales controla el movimiento de los ojos, el parpadeo y la forma de la cara para detectar cambios no naturales.

- Pruebas de sincronización audiovisual comprueba si los movimientos de los labios coinciden exactamente con las palabras pronunciadas.

- Audio forense analiza la voz en busca de signos de clonación, como patrones de sonido inusuales o tonos robóticos.

- Análisis de metadatos y compresión examinar los datos de archivos ocultos es vital para la detección de fraudes legales, para ver si coinciden con los detalles de la grabación original.

Educar a los equipos jurídicos sobre el fraude por vídeo

Dado que la IA ya puede imitar el comportamiento humano con una precisión aterradora, los bufetes de abogados están utilizando el análisis automatizado de pruebas y una mezcla de tácticas tradicionales para mantenerse a la vanguardia.

| Categoría | Método | Descripción |

| Formas oficiales | Créditos CLE (formación jurídica continua) | Cursos obligatorios u optativos que enseñen a los abogados a autenticar pruebas digitales, comprender los deepfakes y cumplir las normas probatorias. |

| Expertos en inteligencia artificial designados por los tribunales | Establecer especialistas forenses certificados en IA, similares a los expertos en ADN, para evaluar ante los tribunales las pruebas de vídeo controvertidas. | |

| Medios no oficiales | Equipos rojos internos | Contratación de profesionales de la ciberseguridad para comprobar si las pruebas falsas o manipuladas pueden colarse en los sistemas de admisión de la empresa. |

| “Protocolo ”Vibe Check | Formar al personal para que detecte las señales de advertencia habituales de las deepfakes, como el parpadeo antinatural, los rasgos distorsionados o los problemas de sincronización labial, antes de solicitar una revisión forense. |

Herramientas y tecnología para la validación de pruebas

En 2026, hemos dejado atrás la simple inspección ocular.

Dado que la IA es ahora capaz de engañar incluso a los investigadores más avezados, los equipos jurídicos utilizan un conjunto específico de herramientas para verificar que lo que están viendo es la verdad absoluta.

La tecnología detrás de la validación de pruebas

- Detectores de Deepfake: Se trata de programas de software especializados que buscan artefactos GAN. Se trata de patrones o ruidos matemáticos microscópicos dejados por los modelos de IA que generan rostros sintéticos. Mientras que un humano ve una cara, el detector ve una firma digital que no corresponde.

- TruthScan es un detector de falsificaciones que escanea los vídeos fotograma a fotograma en busca de señales de IA, como parpadeos inusuales, formas faciales extrañas o errores de píxeles en los que se añade una cara falsa.

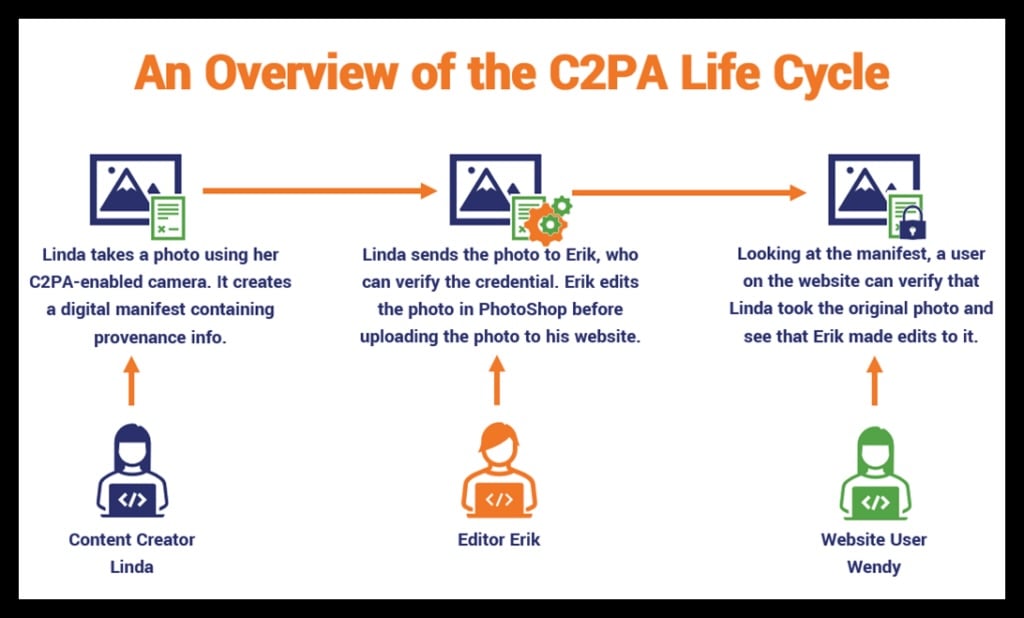

- Marcas de tiempo Blockchain: Para demostrar que un vídeo no se ha tocado desde el momento en que se grabó, muchas agencias utilizan ahora la norma C2PA. Cuando se graba un vídeo en un dispositivo conforme, se crea una huella digital única (hash) que se almacena en una cadena de bloques.

- TruthScan puede comprobar si esta huella coincide con el vídeo, mostrando si el archivo fue editado o se rompió la cadena de custodia.

- Herramientas forenses de metadatos: Cada archivo digital tiene un certificado de nacimiento conocido como datos Exif. Estas herramientas comprueban si un archivo se ha vuelto a guardar en un software de edición de IA o si se han falseado los datos de localización (GPS). Si un vídeo dice proceder de una cámara de una tienda pero los metadatos muestran que fue exportado desde un editor de vídeo, tienes un problema.

- Amped Software y TruthScan examinan los datos ocultos de los archivos (Exif, encabezados) para ver si el vídeo ha sido editado o procesado con IA.

Tendencias en las pruebas de vídeo con IA

Estas son las tres tendencias de 2026.

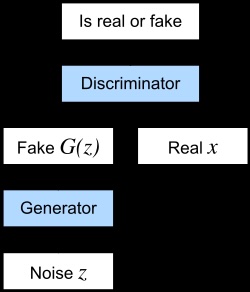

- Generative Adversarial Forensics: IA contra IA

La forma más avanzada de atrapar un deepfake en 2026 es utilizar la misma tecnología que lo creó. Es lo que se conoce como Generative Adversarial Forensics.

- Una IA (el generador) intenta crear una falsificación, mientras que otra IA (el discriminador) intenta descubrirla. En los tribunales, herramientas como TruthScan pueden ser el discriminador definitivo.

- Por ejemplo: Un demandante presenta un vídeo de un director general haciendo un contrato verbal. TruthScan escanea el vídeo utilizando sus propios modelos adversariales para detectar artefactos GAN. Si el software marca una probabilidad sintética 98%, es probable que la prueba sea una falsificación para engañar a los ojos humanos.

- Análisis de sincronización de audio y vídeo (la regla de los 0,01 ms)

Los humanos suelen detectar un retraso si el audio de un vídeo se desvía entre 40 y 80 milisegundos. Sin embargo, los deepfakes de 2026 suelen ser casi perfectos.

- Las modernas herramientas forenses de IA buscan ahora un retardo de 0,01 milisegundos entre el sonido fonético de una palabra y el movimiento mecánico de los labios.

- Por ejemplo: En un caso de acoso de 2026, un acusado alegó que se había falsificado un vídeo. El análisis forense automatizado de las pruebas mostró que las formas de los labios de la “M” y la “B” estaban 0,02 ms desincronizadas con el audio. Este error microscópico demuestra que la voz fue clonada y superpuesta sobre un vídeo diferente, lo que condujo a la desestimación del caso.

- Cheapfakes vs. Deepfakes

Mientras que los deepfakes utilizan IA de alta gama, los cheapfakes son la forma más común de fraude en vídeo.

- Un Deepfake crea una realidad que nunca ocurrió (como un intercambio de caras). Un Cheapfake toma imágenes reales y cambia el contexto o la intención utilizando herramientas sencillas.

- Ejemplo (La ralentización): Se puede crear un vídeo de un político que parezca borracho o impedido simplemente ralentizando la grabación 20% y ajustando el tono del audio.

- Ejemplo (El recontexto): Las imágenes de una protesta en otro país en 2022 se publican en 2026 como prueba en directo de unos disturbios locales. Los equipos jurídicos utilizan ahora el análisis de metadatos de TruthScan para demostrar la fecha de nacimiento real del vídeo.

Cómo protege TruthScan las pruebas de vídeo legales

TruthScan garantiza que cada fotograma que presente ante un tribunal sea auténtico, verificado y legalmente defendible.

La plataforma agiliza la verificación de vídeo con IA gracias a las siguientes ventajas:

Registros de auditoría automatizados y documentación de la cadena de custodia

- Fiabilidad ante los tribunales: Genera informes en PDF y JSON que documentan cada paso de la verificación con puntuaciones de confianza y marcas de tiempo precisas.

- Cumplimiento de la normativa: Descanse tranquilo sabiendo que sus datos permanecen seguros y cumplen estrictas normas mundiales como SOC 2, ISO 27001 y GDPR.

- Control flexible de datos: Mantenga las pruebas confidenciales dentro de la jurisdicción requerida con opciones de implantación local o VPC diseñadas para sectores altamente regulados.

Procesamiento por lotes e integración de API para flujos de trabajo jurídicos

- Ahorro masivo de tiempo: Procese miles de archivos de paquetes de descubrimiento o conjuntos de vigilancia simultáneamente utilizando importaciones de almacenamiento masivo (S3/GCS).

- E-Discovery sin fisuras: Agilice sus operaciones integrando la verificación directamente en su software actual mediante webhooks y API.

- Elimine los errores manuales: Automatice la primera pasada del filtrado de pruebas para que su equipo pueda centrarse en la estrategia en lugar de en la tediosa comprobación archivo por archivo.

Verificación en tiempo real para deposiciones y audiencias a distancia

- Detener la suplantación de identidad: Utilice puntos finales de transmisión en directo para detectar si un deponente está utilizando filtros deepfake o clones de voz durante una audiencia a distancia.

- Mantener la integridad de los tribunales: Señale las anomalías visuales o sonoras en tiempo real, evitando que se introduzcan testimonios fraudulentos en el acta.

- Tranquilidad: Proporcione a sus clientes y al tribunal una capa adicional de seguridad que garantice que la persona que aparece en la pantalla es exactamente quien dice ser.

Más información sobre la seguridad de las pruebas de vídeo con IA

Proteja a su empresa de los riesgos de los medios manipulados. La tecnología de detección de falsificaciones de TruthScan y el detector de vídeo de IA ofrecen la solución definitiva para el descubrimiento electrónico y la verificación legal.

¿Listo para ver TruthScan en acción?

- Visite truthscan.com para conseguir 20.000 créditos gratis.

- Para consultas sobre empresas, integración de API u opciones de implantación personalizadas, póngase en contacto con su equipo en Truthscan.com/contacto.