Sus agentes de asistencia están formados para ser las personas más serviciales de su empresa.

Son la primera línea de la reputación de su marca y trabajan duro para que cada interacción termine con una sonrisa.

Pero, ¿conoces la ironía más peligrosa de 2026?

Esta misma utilidad les convierte en su mayor lastre de seguridad.

Sus agentes se centran en la satisfacción del cliente.

No siempre notan un ligero tono robótico en la voz del interlocutor o un pequeño borrón alrededor de la mandíbula de un cliente durante una videollamada.

De este modo, el fraude contra el cliente se convierte en el momento perfecto para atacar.

Si su servicio de asistencia no está respaldado por un sistema automatizado de detección de fraudes, es posible que ya esté expuesto.

En este blog, vamos a cubrir qué es la suplantación de identidad deepfake, las técnicas utilizadas por los atacantes para eludir sus defensas, los indicadores tempranos que pueden alertar a su equipo, y cómo aprovechar un detector de IA en tiempo real para proteger su negocio.

Entremos en materia.

Principales conclusiones

- Los agentes de soporte están entrenados para ser serviciales, lo que los convierte en los principales objetivos de los sorteos de detección de suplantación de identidad de IA.

- Los estafadores modernos utilizan un detector de IA en tiempo real para identificar clones de voz que se sincronizan en menos de 50 milisegundos.

- La detección automática del fraude debe abarcar ahora las grabaciones de pantalla manipuladas, los recibos falsos y las identificaciones generadas por IA.

- La prevención eficaz de deepfakes requiere escanear audio, vídeo e imágenes simultáneamente.

- La integración de un detector de deepfakes en los flujos de trabajo de e-discovery y soporte reduce las pérdidas económicas por BEC (Business Email Compromise) hasta en 80%.

¿Qué son las suplantaciones de identidad Deepfake?

La palabra “deepfake” viene de aprendizaje profundo (un tipo de IA) y falso.

Suplantación significa hacerse pasar por otra persona, normalmente para ganar confianza, robar dinero o acceder a información privada.

Las suplantaciones de identidad ocurren cuando la IA copia la cara, la voz o el comportamiento de una persona real para crear contenidos falsos diseñados para engañar a otros.

No vuelva a preocuparse por el fraude de IA. TruthScan puede ayudarle:

- Detectar IA generada imágenes, texto, voz y vídeo.

- Evite grandes fraudes impulsados por la IA.

- Proteja sus sensible activos de la empresa.

Los deepfakes ya no se limitan a simples intercambios de caras. En 2026, veremos deepfakes de comportamiento capaces de copiar:

- Patrones de habla

- Tono y pausas

- Microexpresiones faciales

- Incluso los matices de personalidad

Esto hace que sea mucho más difícil detectar la manipulación a simple vista.

Ejemplo real: Suplantación del CEO de WPP (mayo de 2024)

Los ciberdelincuentes utilizaron una foto pública del CEO de WPP, Mark Read, para crear una cuenta falsa de WhatsApp.

Atrajeron a un ejecutivo a una reunión de Microsoft Teams, utilizando un detector de IA en tiempo real que desafiaba el clon de voz para autorizar una transferencia bancaria fraudulenta.

Afortunadamente, un empleado alertado sospechó y denunció el incidente, evitando pérdidas económicas.

Por qué es vulnerable el servicio de atención al cliente

El riesgo de fraude a los clientes empezó a aumentar en 2023-24, cuando se generalizó el uso de herramientas de IA generativa.

Pero en 2025-26, la amenaza alcanzó escala industrial.

Lo que antes requería conocimientos técnicos ahora puede hacerse con herramientas sencillas y unos minutos de audio.

Los equipos de atención al cliente no se volvieron descuidados de repente. Quedaron expuestos.

Los agentes de asistencia están formados para ayudar a las personas, no para interrogarlas, por eso la prevención de deepfake es tan difícil de gestionar manualmente. Los atacantes confían en el instinto del agente y se mueven con rapidez.

La mayoría de los centros de contacto siguen verificando la identidad mediante preguntas sencillasnúmeros de cuenta, fechas de nacimiento, los cuatro últimos dígitos del DNI. El problema es que esa información ya no es privada.

Las filtraciones de datos y las redes sociales facilitan eludir los controles tradicionales, por lo que la detección de suplantación de identidad mediante IA es una capa de defensa obligatoria.

También está la presión del volumen. Muchos agentes gestionan entre 80 y 120 interacciones al día. Cuando las llamadas son consecutivas, no hay tiempo para analizar los sutiles cambios de voz.

Aquí es donde la detección automática del fraude se convierte en un salvavidas. Sin un detector de IA en tiempo real trabajando en segundo plano, los agentes se ven obligados a responder a la urgencia y la emoción.

Técnicas utilizadas por los suplantadores de identidad Deepfake

- Clonación de voz en llamadas

En 2026, herramientas como ElevenLabs, Speechify y Murf podrán crear clones convincentes a partir de menos de 10 segundos de audio.

Y lo que es aún más preocupante, la conversión de voz en tiempo real puede transformar la voz de una persona que llama en la de otra en menos de 50 milisegundos.

A la víctima le suena vivo, natural y familiar.

Ya casi nunca hay una pista robótica obvia. Sin un software de protección contra el fraude, los agentes no detectarán los artefactos sutiles, como los tonos metálicos o los patrones de respiración antinaturales, que indican fraude por parte del cliente.

Ejemplo:

- Mago (finales de 2024): Los atacantes clonaron la voz del consejero delegado Assaf Rappaport para solicitar credenciales. Aunque este intento fracasó debido a la falta de coincidencia de tono, puso de manifiesto la urgente necesidad de detectar la suplantación de identidad mediante IA en las comunicaciones corporativas.

- LastPass (principios de 2024): Un empleado fue blanco de un deepfake de voz de CEO entrenado en vídeos de YouTube. Este incidente demostró que las personas de alto perfil corren un riesgo constante, por lo que es necesario automatizar la detección de fraudes para salvaguardar los canales de asistencia internos.

- Vídeos de agentes con la cara cambiada

Los deepfakes de intercambio de caras utilizan modelos avanzados de IA para sustituir la cara de una persona por otra en un vídeo en directo.

En 2026, herramientas como DeepFaceLive y Deep-Live-Cam podrán funcionar en tiempo real con menos de 50 milisegundos de retraso.

Los estafadores pueden transmitir este vídeo alterado a través de plataformas como Zoom, Microsoft Teams o Google Meet utilizando herramientas de cámara virtual como OBS Studio. Para la persona que recibe la llamada, todo parece normal.

Por ejemplo:

KnowBe4 Caso del empleado falso (julio de 2024): Un agente estatal norcoreano utilizó tecnología de intercambio de rostros por IA para pasar entrevistas de vídeo en directo con una identidad estadounidense robada. Fue capturado solo después de que la seguridad interna detectara una actividad inusual del dispositivo.

- Grabaciones de pantalla manipuladas

Los atacantes utilizan cada vez más la IA para fabricar o alterar grabaciones de pantalla, haciendo que parezca que se ha producido una acción de reembolso, transacción o ticket de soporte.

Estas grabaciones falsas pueden manipular a los agentes de soporte, anular disputas o escalar devoluciones de cargo.

Ahora, la IA puede modificar las marcas de tiempo, los saldos de las cuentas y los elementos dinámicos de la interfaz de usuario de forma tan convincente que una inspección casual no lo detectará.

Los estafadores pueden incluso inyectar vídeos pregrabados o manipulados en las llamadas de asistencia en directo mediante complementos de cámara virtual.

Primeros indicadores de amenazas de Deepfake

Los deepfakes modernos son convincentes. La prevención eficaz de los deepfakes implica buscar estos “indicios”:

Audio-Level Tells:

- Las voces clonadas suenan planas y carecen de cambios de tono naturales.

- El habla de la IA a menudo omite la respiración normal y los sonidos de relleno.

- La voz puede no coincidir con el ruido de fondo.

- La conversión de voz en tiempo real puede provocar pequeños retrasos (200-400 ms) en las preguntas repentinas.

- Las voces de las grabaciones de oratoria pueden sonar demasiado formales para una conversación informal.

Relatos a nivel de vídeo:

- El pelo, las orejas y los bordes de la mandíbula pueden parecer ligeramente borrosos.

- El parpadeo se produce a intervalos muy regulares.

- Es posible que la mirada no siga a la cámara con naturalidad.

- La iluminación de la cara puede no coincidir con la de la habitación.

- Las microexpresiones faltan o son muy suaves.

- Las excusas de mala conexión pueden ocultar artefactos de vídeo causados por la compresión.

Comportamiento/Interacción:

- Los operadores de Deepfake evitan solicitudes de verificación inesperadas.

- Es posible que primero se pongan en contacto contigo a través de aplicaciones informales antes de utilizar los canales oficiales.

- La urgencia y el secretismo juntos son una señal de alarma.

- Se resisten a las comprobaciones fuera de banda, como llamar a un número conocido.

Aprovechamiento de las herramientas de detección de IA

TruthScan es una potente plataforma diseñada para la detección automática del fraude, en la que confían más de 250 millones de usuarios.

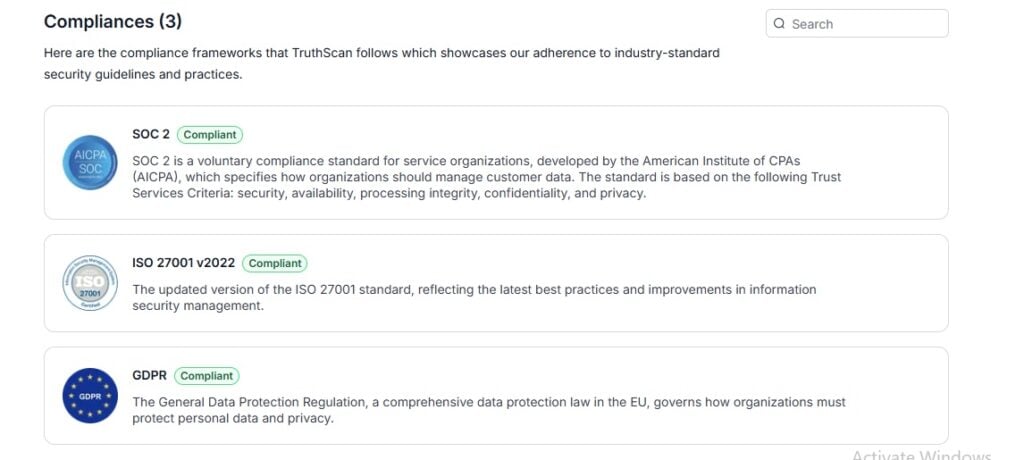

Cuenta con todas las certificaciones ISO 27001, SOC 2 y GDPR, y funciona a la perfección con herramientas como Salesforce, Microsoft 365, Google Workspace, SAP y Zoom.

- Detector de Deepfake

Este detector de deepfakes identifica vídeos generados por IA, intercambios de caras y medios manipulados en los principales formatos (MP4, AVI, MOV, MKV, WebM) hasta 4K.

Funciona así:

- Rastrea los movimientos faciales, los patrones de parpadeo y las microexpresiones.

- Detecta incoherencias a nivel de píxel, desajustes de iluminación y artefactos de fotograma a fotograma.

- Detecta modelos de generación basados en GAN como AnimateDiff, D-ID, HeyGen, Runway Gen-4, Stable Video Diffusion, etc.

Sube un vídeo real conocido y un deepfake (HeyGen/D-ID) a la página de TruthScan Detector de Deepfake.

- Detector de imágenes AI

El detector de imágenes TruthScan AI banderas Imágenes generadas o manipuladas por IA de plataformas como Midjourney, DALL-E, Stable Diffusion, Canva AI, Grok Imagine, StyleGAN y ThisPersonDoesNotExist.

Funciona así:

- Marca cambios de fondo, eliminación de objetos y ediciones de iluminación.

- Genera puntuaciones de confianza y perspectivas a nivel de píxel sin almacenar archivos.

Cargue imágenes reales frente a imágenes generadas por IA en TruthScan's Detector de imágenes AI para comparar las puntuaciones de confianza.

Asegurar eficazmente los canales de asistencia

En 2026, los equipos de atención al cliente estarán bajo la amenaza constante del fraude impulsado por la IA.

Los atacantes pueden falsificar voces, intercambiar caras en vídeo en directo o enviar archivos manipulados, lo que hace casi imposible que los agentes humanos distingan lo que es real de lo que no lo es.

Por eso es esencial asegurar los canales de apoyo.

- Detector de IA en tiempo real

El Detector de IA en tiempo real está diseñado para detectar contenidos generados por IA antes de que lleguen a sus agentes o clientes.

A diferencia de las herramientas basadas en archivos que analizan las cargas, esta plataforma supervisa las interacciones en directo a través del correo electrónico, el chat, el teléfono y los canales de vídeo.

Cómo ayuda a su equipo:

- Detecta en tiempo real los intentos de suplantación de identidad.

- Marque los mensajes o llamadas generados por IA que intentan engañar a los agentes para que den acceso o procesen solicitudes.

- Funciona con Salesforce, Teams, Gmail y Zoom, entre otros, para proporcionar detección automática de fraudes sin ralentizar las operaciones.

- Gestiona millones de interacciones en todos los canales sin ralentizar las operaciones.

- Las certificaciones SOC 2, ISO 27001 y GDPR significan que cada acción es auditable y está preparada para los tribunales.

Políticas y formación para equipos

- Procedimientos normalizados de trabajo

| Nombre de la política | Política |

| Verificación multifactor | Exija MFA para restablecer cuentas, transacciones de alto valor y cambios de seguridad. |

| Verificación de canales | Redirige todas las solicitudes de canales informales (WhatsApp, Telegram, correo electrónico personal) a los sistemas de asistencia oficiales. |

| Registro de contactos | Los agentes deben registrar los contactos inusuales, incluyendo el canal, la hora y la naturaleza de la solicitud. |

| Sistema Safe Word | Utilice frases de verificación prerregistradas para las cuentas de gran valor. |

| Verificación fuera de banda | Cualquier escalada interna o solicitud ejecutiva debe verificarse mediante devolución de llamada a los números oficiales del directorio. |

| Sin aprobación en solitario | Nunca autorice transacciones o cambios de seguridad basándose únicamente en videollamadas o correos electrónicos. |

| Confirmación de voz | Exigir confirmación de voz para todas las transferencias de fondos que superen un umbral definido. |

| Verificación de medios | Escanee todas las fotos, vídeos y grabaciones de pantalla a través de los detectores TruthScan antes de la revisión humana. |

| Comprobación de metadatos | Utilice un detector de imágenes AI para marcar EXIF o marcas de tiempo incoherentes. |

| Revisión secundaria | Las solicitudes de gran cuantía deben someterse a una revisión secundaria antes de ser tramitadas. |

- Formación del personal en materia de fraude

Los empleados necesitan experimentar deepfakes realistas. Las investigaciones demuestran que los índices de detección pasan de 34% a 74% tras una docena de simulaciones en directo con un detector de vídeo de IA.

Señales de alarma:

- La urgencia unida al secretismo

- Solicitudes fuera de los cauces normales

- Resistencia a la devolución de llamada o a la verificación secundaria

- Eludir los procesos estándar

- Presión emocional (miedo, culpa, autoridad)

- Revisiones rutinarias de seguridad

En 2026, incluso los mejores PNT requerirán auditorías periódicas mediante protocolos automatizados de detección del fraude:

| Nombre de la política | Política |

| Evaluación trimestral de las amenazas | Compruebe si existen nuevas herramientas de deepfake, valide los umbrales de detección y revise los incidentes cercanos al fallo. |

| Auditoría de seguridad de canales | Examine cada canal de soporte en busca de puntos débiles; los atacantes buscan el camino de menor resistencia. |

| Validación de la herramienta de detección | Ejecute periódicamente falsificaciones conocidas a través de TruthScan para garantizar que la precisión de la detección sigue el ritmo de la evolución de los métodos de IA. |

| Simulacros de respuesta a incidentes | Realice ejercicios de simulación de suplantación de identidad para comprobar las notificaciones, los bloqueos y la velocidad de respuesta. |

| Cheques de proveedores y terceros | Verifique que las comunicaciones externas de socios o clientes siguen las mismas normas de autenticación fuerte que los canales internos. |

Cómo TruthScan refuerza la seguridad del servicio de atención al cliente

TruthScan está diseñado para detener el fraude de IA en todos los niveles de atención al cliente. Explica por qué algo es sospechoso, para que los equipos puedan actuar con confianza.

| Herramienta | Objetivo y ventajas |

| Detector de voz AI | Detecta voces clonadas en llamadas y grabaciones, protegiendo las conversaciones en directo de la suplantación de identidad. |

| Detector de Deepfake | Analiza vídeos e imágenes para detectar intercambios de caras, personas sintéticas y medios manipulados. |

| Detector de imágenes AI | Señala las fotos de perfil generadas por la IA, las identificaciones falsas y las capturas de pantalla manipuladas antes de que se tome ninguna decisión. |

| Detector de IA en tiempo real | Supervisa continuamente el chat en directo, el correo electrónico y el vídeo con alertas automáticas de detección de fraudes en menos de un segundo. |

| Detector de recibos falsos | Detecta recibos generados por IA o documentos de prueba utilizados en reclamaciones fraudulentas. |

| Detector de fraudes por correo electrónico | Detecta los intentos de phishing y los ataques BEC generados por inteligencia artificial antes de que lleguen a la bandeja de entrada. |

Cómo encaja en una pila de seguridad de atención al cliente:

- Medios de entrada (fotos, vídeos, grabaciones) → Deepfake Detector + AI Image Detector antes de la revisión humana.

- Llamadas de asistencia en directo → Detector de voz AI que analiza grabaciones de llamadas o transmisiones en directo.

- Sesiones de vídeo de apoyo → Detector de Deepfake en tiempo real o después de la llamada

- Canales de correo electrónico y chat → Detector de IA en tiempo real para una supervisión continua.

- Presentación de documentos (identificaciones, recibos, capturas de pantalla) → Detector de recibos falsos + Detector de imágenes AI.

Hable con TruthScan sobre la protección Deepfake en Soporte

No espere a que sea demasiado tarde. TruthScan ayuda a su equipo a detectar contenidos de IA antes de que lleguen a sus agentes.

Elige cómo empezar:

- Pruébelo usted mismo: Pruebe todas las herramientas de detección de TruthScan con 20.000 créditos gratuitos. No se requiere ningún pago. → Inicie su prueba gratuita en TruthScan.

- Demostración para empresas: Deje que nuestro equipo le muestre una implementación a medida para Salesforce, Microsoft 365, Zoom y Google Workspace. → Reserve una demostración en TruthScan.

Asegure hoy mismo sus canales de asistencia, porque ver ya no es creer; verificar sí.