Πώς η τεχνολογία deepfake αφαιρεί δισεκατομμύρια από τις παγκόσμιες επιχειρήσεις - και γιατί κάθε στέλεχος είναι πλέον στόχος

Οι αριθμοί δεν λένε ψέματα

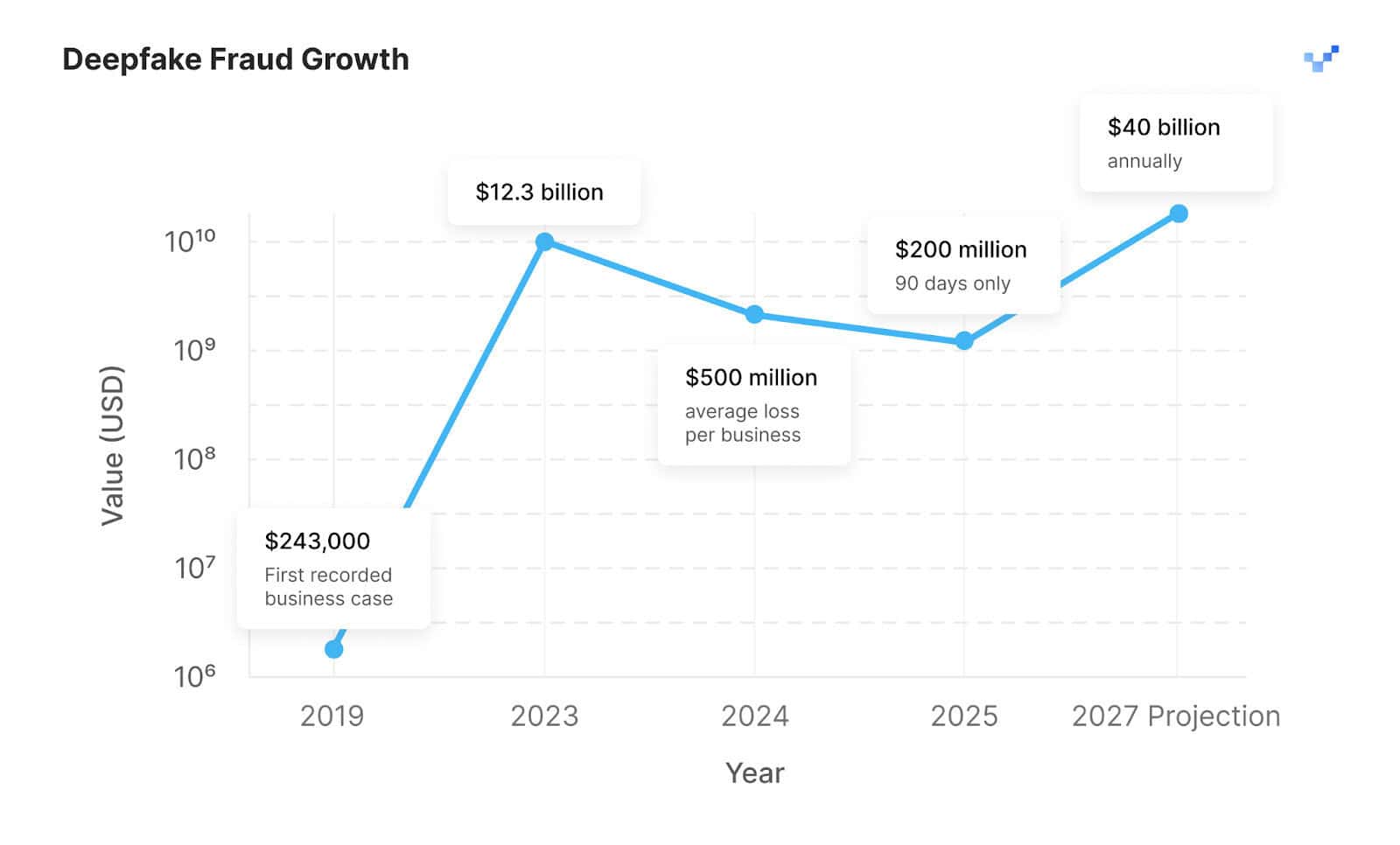

Η απάτη με τη βοήθεια του Deepfake προκάλεσε απώλειες άνω των $200 εκατομμυρίων ευρώ μόνο το πρώτο τρίμηνο του 2025, σύμφωνα με την τελευταία έκθεση περιστατικών της Resemble AI. Αλλά αυτό είναι η κορυφή του παγόβουνου- οι ειδικοί σε θέματα ασφάλειας προειδοποιούν ότι θα μπορούσε να φτάσει $40 δισεκατομμύρια σε ετήσιες απώλειες στις Ηνωμένες Πολιτείες μέχρι το 2027.

Τα μαθηματικά της ψηφιακής εξαπάτησης είναι απογοητευτικά:

Αυτό αντιπροσωπεύει ένα σύνθετος ετήσιος ρυθμός αύξησης του 32%-γρηγορότερα από τις περισσότερες καμπύλες υιοθέτησης τεχνολογιών, και σίγουρα ταχύτερα από την ικανότητά μας να αμυνθούμε απέναντί τους.

Μην ανησυχείτε ποτέ ξανά για την απάτη με τεχνητή νοημοσύνη. TruthScan Μπορεί να σας βοηθήσει:

- Ανίχνευση AI που παράγεται εικόνες, κείμενο, φωνή και βίντεο.

- Αποφύγετε το σημαντική απάτη με βάση την τεχνητή νοημοσύνη.

- Προστατέψτε τα πιο ευαίσθητο περιουσιακά στοιχεία της επιχείρησης.

Η κλίμακα της τρωτότητας

Πρόσφατη έρευνα της Deloitte αποκαλύπτει ότι 25,9% των στελεχών έχουν ήδη βιώσει περιστατικά deepfake με στόχο τα οικονομικά τους δεδομένα τους τελευταίους 12 μήνες. Πιο ανησυχητικό: 50% αναμένουν αύξηση των επιθέσεων κατά το επόμενο έτος.

Ο περιφερειακός αντίκτυπος δείχνει μια σκληρή ιστορία:

- Βόρεια Αμερική: 1,740% αύξηση των περιπτώσεων απάτης deepfake το 2023

- Μέση επιχειρηματική ζημία: $500,000 ανά περιστατικό

- Επιπτώσεις σε μεγάλες επιχειρήσεις: Μέχρι $680,000 ανά επίθεση

Γιατί η έκρηξη τώρα;

Η δημιουργία Deepfake ήταν παλαιότερα απομονωμένη σε μακρινές γωνιές του παγκόσμιου ιστού, όπου οι εγκληματίες του κυβερνοχώρου αντάλλασσαν κρυπτογραφικά νομίσματα με κωδικούς πρόσβασης. Τώρα, τα εργαλεία τεχνητής νοημοσύνης είναι ευρέως διαθέσιμα για χρήση από οποιονδήποτε, και τα chatbots γενικού σκοπού μπορούν να χρησιμοποιηθούν για την τυχαία εξαπάτηση των υφιστάμενων συστημάτων. Οι ικανότητές τους ξεπερνούν κατά πολύ την ικανότητα του κοινού να τις αναγνωρίζει. Όπως εξηγεί ο ειδικός σε θέματα κυβερνοασφάλειας David Fairman από την Netskope: "Η δημόσια προσβασιμότητα αυτών των υπηρεσιών έχει μειώσει το εμπόδιο εισόδου για τους εγκληματίες του κυβερνοχώρου - δεν χρειάζεται πλέον να έχουν ειδικές τεχνολογικές δεξιότητες".

Τα εγκληματικά οικονομικά:

- Κόστος δημιουργίας: Τόσο χαμηλά όσο $20 για το βασικό λογισμικό deepfake

- Ποσοστό επιτυχίας: Χρειάζεται να δουλέψει μόνο μία φορά για τεράστια απόδοση

- Ποσοστό ανίχνευσης: 68% των ανθρώπων δεν μπορούν να διακρίνουν το πραγματικό από το ψεύτικο βίντεο

- Κλωνοποίηση φωνής: Απαιτεί μόλις 3-5 δευτερόλεπτα δείγματος ήχου για ακρίβεια 85%

Πρόσφατες επιθέσεις Deepfake

Ηνωμένο Βασίλειο Auto Insurance Deepfake Surge (2024) Οι ασφαλιστές του Ηνωμένου Βασιλείου, συμπεριλαμβανομένων των Allianz και Zurich, ανέφεραν αύξηση 300% των δόλιων απαιτήσεων που περιλαμβάνουν φωτογραφίες και βίντεο που έχουν τροποποιηθεί με τεχνητή νοημοσύνη από το 2021 έως το 2023, με την τάση να επιταχύνεται το 2024. Μια συγκεκριμένη περίπτωση αφορούσε απατεώνες που χειραγωγούσαν αποδεικτικά στοιχεία CCTV για να αλλάξουν την ημερομηνία, την ώρα και τον αριθμό κυκλοφορίας του οχήματος προς υποστήριξη μιας υποτιθέμενης απαίτησης για ατύχημα Kennedys Law LLPΑγάπη χρήματα. Σύμφωνα με την Ένωση Βρετανικών Ασφαλιστών, η μέση απατηλή απαίτηση άξιζε 15.000 λίρες το 2023, με τα εγκλήματα αυτά να προσθέτουν περίπου 50 λίρες ετησίως στα ασφάλιστρα αυτοκινήτου και κατοικίας του μέσου ασφαλισμένου.

Προσπάθεια μίμησης του CEO της Ferrari (2024) Τον Ιούλιο του 2024, η ιταλική αυτοκινητοβιομηχανία Ferrari υπέστη μια επίθεση όπου απατεώνες προσπάθησαν να εξαπατήσουν οικονομικά στελέχη χρησιμοποιώντας μια ψηφιακή μίμηση του διευθύνοντος συμβούλου Benedetto Vigna. Οι απατεώνες επικοινώνησαν πρώτα με ανώτερα στελέχη στο WhatsApp ρωτώντας για "τη μεγάλη εξαγορά που σχεδιάζουμε", και στη συνέχεια κλιμακώθηκαν σε βαθιές ψεύτικες φωνητικές κλήσεις που αναπαρήγαγαν τη χαρακτηριστική νοτιοϊταλική προφορά του Vigna (άρθρο εδώ).

Απάτη στις υπηρεσίες της ομοσπονδιακής κυβέρνησης (2024) Έρευνα του ομίλου GB Group εκτιμά ότι περίπου 8,6 εκατομμύρια άνθρωποι στο Ηνωμένο Βασίλειο έχουν χρησιμοποιήσει πλαστές ή δόλιες ταυτότητες για να έχουν πρόσβαση σε κυβερνητικές υπηρεσίες. Οι αναγνωριστικές ταυτότητες με τεχνητή νοημοσύνη (deepfake IDs) χρησιμοποιούνται όλο και περισσότερο για διάφορες απάτες, συμπεριλαμβανομένης της πρόσβασης σε κυβερνητικές υπηρεσίες με τη χρήση πλαστών διαπιστευτηρίων ταυτότητας.ID.me ανέφερε μια απότομη αύξηση των φορέων επίθεσης από το 2023 έως το 2024, με τις επιθέσεις deepfake ανταλλαγής προσώπων να αυξάνονται κατά 300%, τις επιθέσεις έγχυσης εικόνας και βίντεο να αυξάνονται κατά 783% και τις επιθέσεις με εικονικές κάμερες να εκτοξεύονται κατά 2,665%

Ο φόρος εμπιστοσύνης

Πέρα από τις άμεσες οικονομικές απώλειες, οι απομιμήσεις επιβάλλουν αυτό που οι οικονομολόγοι θα μπορούσαν να ονομάσουν "φόρο εμπιστοσύνης" στο παγκόσμιο εμπόριο. Όταν το 32% των εταιρικών ηγετών δεν έχουν καμία εμπιστοσύνη ότι οι υπάλληλοί τους μπορούν να αναγνωρίσουν τις απόπειρες απάτης deepfake, το κόστος υπερβαίνει κατά πολύ τα μεμονωμένα περιστατικά.

Οι οργανισμοί αναγκάζονται πλέον να επενδύσουν σε:

- Ενισχυμένα πρωτόκολλα επαλήθευσης

- Προγράμματα κατάρτισης εργαζομένων

- Προηγμένες τεχνολογίες ανίχνευσης

- Δυνατότητες διαχείρισης κρίσεων

- Νομική και κανονιστική συμμόρφωση

Ωστόσο, παρά την αυξανόμενη αυτή απειλή, μόνο 29% των επιχειρήσεων έχουν λάβει μέτρα για την προστασία τους, με 46% χωρίς κανένα σχέδιο μετριασμού των επιπτώσεων.

Η επιτάχυνση μπροστά

Το FinCEN (Financial Crimes Enforcement Network) έχει παρατηρήσει "αύξηση των αναφορών ύποπτης δραστηριότητας από χρηματοπιστωτικά ιδρύματα που περιγράφουν την ύποπτη χρήση των deepfake media σε συστήματα απάτης" από το 2023 έως το 2024.

Αυτό το πρόβλημα των $25 δισεκατομμυρίων δεν αφορά μόνο τα χρήματα - αφορά τη θεμελιώδη διάβρωση της εμπιστοσύνης στις ψηφιακές επικοινωνίες που τροφοδοτούν τις σύγχρονες επιχειρήσεις. Κάθε βιντεοκλήση, κάθε ηχητικό μήνυμα, κάθε ψηφιακή αλληλεπίδραση εμπεριέχει πλέον το ερώτημα: "Πώς ξέρω ότι αυτό είναι αληθινό;"

Τα στελέχη που θα επιλύσουν πρώτα αυτή την κρίση εμπιστοσύνης θα έχουν αποφασιστικό πλεονέκτημα. Όσοι δεν το κάνουν, μπορεί να βρεθούν να πρωταγωνιστούν στη δική τους μελέτη περίπτωσης απάτης.

Αναφορές:

Μοιάζουν με AI Q1 2025 Έκθεση συμβάντος Deepfake - $200 εκατ. ευρώ το πρώτο τρίμηνο του 2025 ζημίες

Deloitte Center for Financial Services (Μάιος 2024) - $40 δισεκατομμύρια προβλέψεις έως το 2027, 25,9% των στελεχών βίωσαν περιστατικά, 50% αναμένουν αυξήσεις

Variety (18 Απριλίου 2025) - "Η απάτη με τη βοήθεια του Deepfake έχει ήδη προκαλέσει $200 εκατομμύρια σε οικονομικές απώλειες το 2025"

Eftsure US (2025) - "Στατιστικά στοιχεία Deepfake (2025): $500,000 μέσες απώλειες επιχειρήσεων, $680,000 απώλειες μεγάλων επιχειρήσεων

CNBC (28 Μαΐου 2024) - Απόσπασμα του David Fairman από το Netskope

Entrust 2025 Έκθεση για την απάτη ταυτότητας - 3,000% αύξηση των deepfakes από το 2022-2023

Ειδοποίηση FinCEN FIN-2024-Alert004 - Αύξηση των αναφορών ύποπτης δραστηριότητας

Διάφορες μελέτες που αναφέρονται στο Eftsure - 32% των ηγετών δεν έχουν καμία εμπιστοσύνη στην αναγνώριση εργαζομένων, 68% δεν μπορούν να διακρίνουν το πραγματικό από το ψεύτικο βίντεο, 3-5 δευτερόλεπτα απαιτούνται για την κλωνοποίηση φωνής