Η ασφαλιστική απάτη εισέρχεται σε μια νέα εποχή που τροφοδοτείται από την τεχνητή νοημοσύνη. Τόσο τα εξελιγμένα κυκλώματα απάτης όσο και οι μοναχικοί απατεώνες εκμεταλλεύονται εργαλεία δημιουργικής τεχνητής νοημοσύνης για να παράγουν ψεύτικες αξιώσεις, συνθετικές ταυτότητες, βαθιά παραποιημένα αποδεικτικά στοιχεία και εξαιρετικά πειστικές απάτες πλαστοπροσωπίας. Αυτό το ενημερωτικό έγγραφο εξετάζει τις τελευταίες τάσεις του 2025 στην ασφαλιστική απάτη με βάση την τεχνητή νοημοσύνη - από τις απαιτήσεις και τα έγγραφα που δημιουργούνται με τεχνητή νοημοσύνη έως τις απάτες με βαθιά πλαστή φωνή - και περιγράφει τον τρόπο με τον οποίο οι ασφαλιστές μπορούν να ανταποκριθούν. Παρουσιάζουμε πρόσφατα δεδομένα, πραγματικές περιπτώσεις και στρατηγικές ιδέες για ασφαλιστές, ερευνητές απάτης, ομάδες κυβερνοασφάλειας, διαχειριστές αποζημιώσεων και C-suite ηγέτες που πρέπει να κατανοήσουν αυτό το ταχέως εξελισσόμενο τοπίο απειλών.

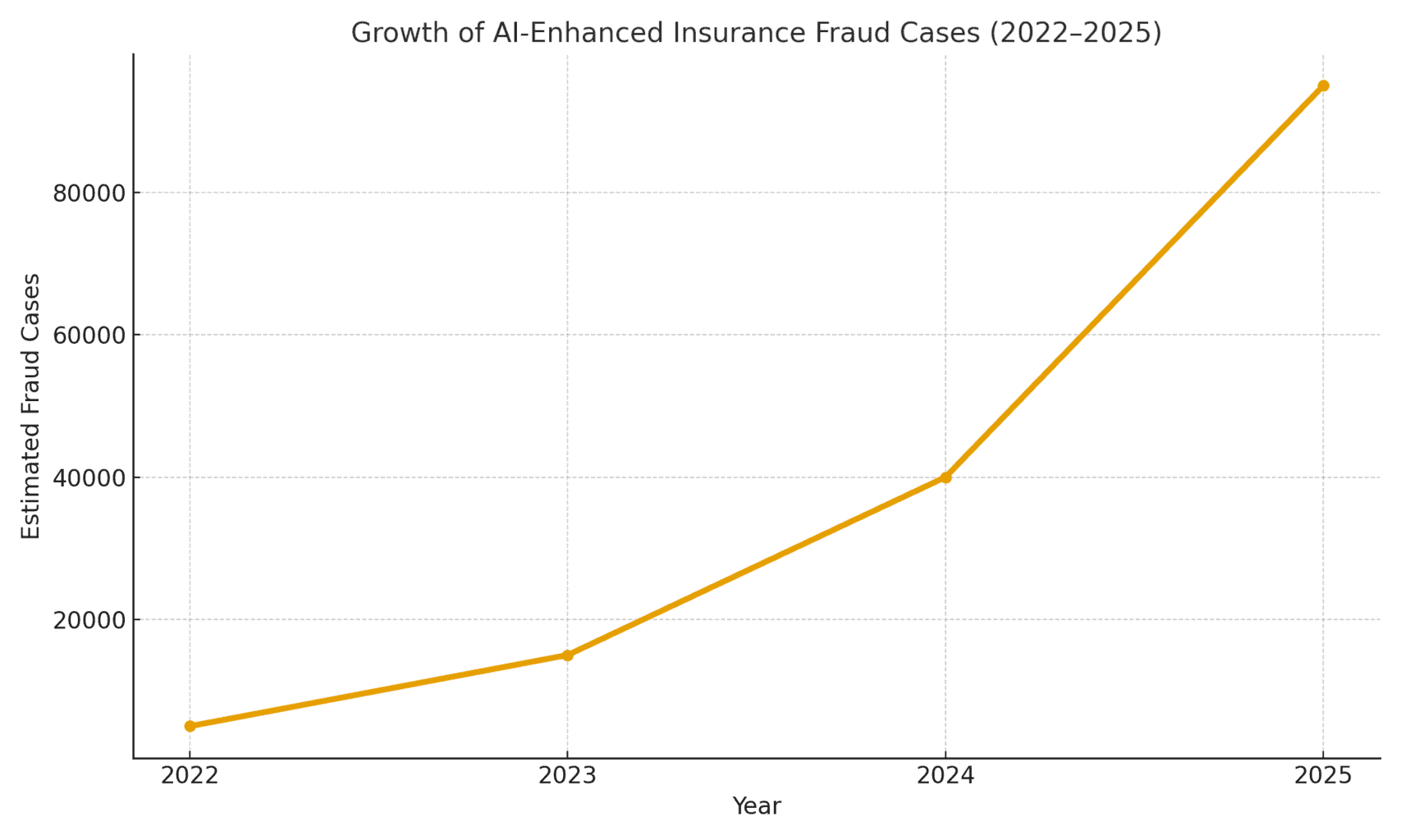

Η κλίμακα της απειλής: Η απάτη που ενεργοποιείται από την τεχνητή νοημοσύνη αυξάνεται ραγδαία. Μια έκθεση εγκληματολογικής λογιστικής του 2025 διαπίστωσε ότι Οι απάτες με βάση την τεχνητή νοημοσύνη αντιπροσωπεύουν πλέον πάνω από το ήμισυ όλων των ψηφιακών οικονομικών απάτων[1]. Στην ασφάλιση συγκεκριμένα, η εταιρεία φωνητικής ασφάλειας Pindrop παρατήρησε μια 475% αύξηση των επιθέσεων συνθετικής φωνητικής απάτης σε ασφαλιστικές εταιρείες το 2024, συμβάλλοντας στην αύξηση κατά 19% σε ετήσια βάση των συνολικών προσπαθειών ασφαλιστικής απάτης[2]. Οι ασφαλιστές αντιμετωπίζουν περίπου 20 φορές μεγαλύτερη έκθεση σε απάτη από τις τράπεζες, εν μέρει λόγω της μεγάλης εξάρτησης από έγγραφα, εικόνες και φωνητικές επαληθεύσεις στις αξιώσεις[3]. Το παρακάτω σχήμα 1 απεικονίζει την εκρηκτική αύξηση των περιστατικών ασφαλιστικής απάτης που ενισχύονται από την ΤΝ από το 2022 έως το 2025, καθώς πολλαπλές εκθέσεις του κλάδου έχουν δείξει τριπλάσια ή τετραπλάσια ποσοστιαία αύξηση από έτος σε έτος στην ανιχνευόμενη συμμετοχή της ΤΝ σε απάτες.

Σχήμα 1: Ραγδαία αύξηση των περιπτώσεων ασφαλιστικής απάτης με τεχνητή νοημοσύνη (αναπροσαρμοσμένη αύξηση 2022-2025). Τα δεδομένα του κλάδου υποδεικνύουν εκθετική αύξηση του περιεχομένου με τεχνητή νοημοσύνη που εντοπίζεται σε απατηλές αξιώσεις, ιδίως από το 2023 και μετά.[4][2]

Ισχυρισμοί που παράγονται από τεχνητή νοημοσύνη και ψεύτικα αποδεικτικά στοιχεία

Μία από τις πιο διαδεδομένες τάσεις είναι η χρήση της δημιουργικής τεχνητής νοημοσύνης για την κατασκευή εξ ολοκλήρου κατασκευασμένες ασφαλιστικές αξιώσεις. Με προηγμένες γεννήτριες κειμένου τεχνητής νοημοσύνης, οι απατεώνες μπορούν να γράψουν ρεαλιστικές περιγραφές περιστατικών, ιατρικές εκθέσεις ή δηλώσεις στην αστυνομία με το πάτημα ενός κουμπιού. Αυτές οι γραπτές αφηγήσεις της τεχνητής νοημοσύνης συχνά διαβάζονται ως γυαλισμένες και αληθοφανείς, καθιστώντας δυσκολότερο για τους ρυθμιστές να εντοπίσουν τις ασυνέπειες. Για παράδειγμα, οι απατεώνες έχουν χρησιμοποιήσει το ChatGPT για να συντάσσουν λεπτομερείς περιγραφές ατυχημάτων ή αναφορές τραυματισμών που ακούγονται επαγγελματικές και πειστικές - μια εργασία που κάποτε απαιτούσε σημαντική προσπάθεια και συγγραφική ικανότητα.

Το πιο ανησυχητικό είναι ότι οι εγκληματίες συνδυάζουν τώρα αυτές τις ψεύτικες αφηγήσεις με Τεχνητή νοημοσύνη που δημιουργεί αποδεικτικά στοιχεία. Τα μοντέλα παραγωγής εικόνων (όπως το Midjourney ή το DALL-E) και τα εργαλεία επεξεργασίας μπορούν να παράγουν φωτορεαλιστικές φωτογραφίες ζημιών και τραυματισμών. Σύμφωνα με αναφορές του κλάδου, ορισμένοι οδηγοί έχουν αρχίσει να υποβολή εικόνων που δημιουργούνται με τεχνητή νοημοσύνη για την υπερβολή των ζημιών του οχήματος σε αξιώσεις αυτοκινήτων[5]. Η δημιουργική τεχνητή νοημοσύνη μπορεί να δημιουργήσει μια φωτογραφία ενός κατεστραμμένου αυτοκινήτου ή ενός πλημμυρισμένου σπιτιού που δεν υπήρξε ποτέ στην πραγματικότητα. Αυτές οι εικόνες είναι συχνά πιο ρεαλιστικές από ό,τι μπορούσαν να επιτύχουν οι παλαιότερες τεχνικές του Photoshop[6], γεγονός που καθιστά δύσκολη την ανίχνευσή τους με γυμνό μάτι. Τον Απρίλιο του 2025, η Zurich Insurance σημείωσε αύξηση των απαιτήσεων με παραποιημένα τιμολόγια, κατασκευασμένες εκτιμήσεις επισκευής και ψηφιακά αλλοιωμένες φωτογραφίες, συμπεριλαμβανομένων των περιπτώσεων όπου οι αριθμοί κυκλοφορίας οχημάτων εισήχθησαν με τεχνητή νοημοσύνη σε εικόνες διασωθέντων αυτοκινήτων[7][8]. Τέτοια πλαστά αποδεικτικά στοιχεία, όταν συνδυάζονται με ένα καλά σχεδιασμένο έντυπο απαίτησης γραμμένο από τεχνητή νοημοσύνη, μπορούν να ξεφύγουν από τις χειροκίνητες αναθεωρήσεις.

Μια εντυπωσιακή περίπτωση στο Ηνωμένο Βασίλειο αφορούσε απατεώνες που έπαιρναν ένα φωτογραφία στα μέσα κοινωνικής δικτύωσης του φορτηγού ενός εμπόρου και χρήση της τεχνητής νοημοσύνης για την προσθήκη ενός ραγισμένου προφυλακτήρα, και στη συνέχεια την υπέβαλε μαζί με ένα πλαστό τιμολόγιο επισκευής για 1.000 λίρες ως μέρος μιας ψευδούς απαίτησης για ατύχημα.[9]. Η απάτη αποκαλύφθηκε μόνο όταν οι ερευνητές παρατήρησαν την ίδιο φωτογραφία του φορτηγού (πριν από τη ζημιά) στη σελίδα του ιδιοκτήτη στο Facebook[10]. Αυτό απεικονίζει ένα ευρύτερο φαινόμενο: οι ασφαλιστές αναφέρουν μια 300% άλμα στις επεξεργασίες εικόνας "ρηχά ψεύτικα" (απλοί ψηφιακοί χειρισμοί για την προσθήκη ζημιών ή την αλλοίωση λεπτομερειών) σε μόλις ένα έτος (2021-2022 έναντι 2022-2023)[4]. Η Allianz UK προειδοποίησε το 2024 ότι οι ψηφιακές παραμορφώσεις φωτογραφιών και τα πλαστά έγγραφα είχαν "όλα τα σημάδια του να γίνουν η τελευταία μεγάλη απάτη που χτύπησε τον κλάδο".[4]. Ο επικεφαλής της Zurich για την απάτη των απαιτήσεων παρατήρησε επίσης ότι αυτό που παλαιότερα απαιτούσε τη σκηνοθεσία μιας φυσικής σύγκρουσης αυτοκινήτου μπορεί τώρα να γίνει εξ ολοκλήρου πίσω από έναν υπολογιστή - οι απατεώνες μπορούν "να δημιουργήσουν μια απατηλή απαίτηση πίσω από το πληκτρολόγιό τους και να αποσπάσουν σημαντικά ποσά" με ψεύτικες φωτογραφίες και αναφορές ολικής απώλειας[11][12]. Η μετατόπιση αυτή όχι μόνο αυξάνει τον όγκο των πλαστών απαιτήσεων αλλά και μειώνει το εμπόδιο εισόδου για τους επίδοξους απατεώνες.

Μην ανησυχείτε ποτέ ξανά για την απάτη με τεχνητή νοημοσύνη. TruthScan Μπορεί να σας βοηθήσει:

- Ανίχνευση AI που παράγεται εικόνες, κείμενο, φωνή και βίντεο.

- Αποφύγετε το σημαντική απάτη με βάση την τεχνητή νοημοσύνη.

- Προστατέψτε τα πιο ευαίσθητο περιουσιακά στοιχεία της επιχείρησης.

Πέρα από τα αυτοκίνητα, αποζημιώσεις περιουσίας και ατυχημάτων βλέπουν πληθωρισμό των ζημιών με τη βοήθεια της τεχνητής νοημοσύνης. Υπάρχουν αναφορές για ψεύτικες φωτογραφίες για ταξιδιωτική ασφάλιση (π.χ. "ζημιές" αποσκευών ή σκηνοθετημένες σκηνές κλοπής) και αποδείξεις που δημιουργούνται από τεχνητή νοημοσύνη για ακριβά αντικείμενα που δεν αγοράστηκαν ποτέ. Απαιτήσεις ζωής και υγείας δεν έχουν ανοσία - οι απατεώνες έχουν δημιουργήσει ψεύτικες ιατρικούς λογαριασμούς και πιστοποιητικά θανάτου χρησιμοποιώντας πλαστογράφους εγγράφων ΤΝ. Στην πραγματικότητα, η Ζυρίχη παρατήρησε ότι η τεχνολογία deepfake χρησιμοποιείται για τη δημιουργία εντελώς πλασματικές αξιολογήσεις μηχανικών και ιατρικές εκθέσεις σε πακέτα απαιτήσεων[11]. Αυτά τα έγγραφα που δημιουργούνται με τεχνητή νοημοσύνη, συχνά με ρεαλιστικά λογότυπα και υπογραφές, μπορούν να είναι δυσδιάκριτα από τα γνήσια έγγραφα. Μια αναδυόμενη ανησυχία για τους ασφαλιστές ζωής είναι απάτη στις νεκρολογίες και τα πιστοποιητικά θανάτου: οι εγκληματίες μπορούν να χρησιμοποιήσουν την ΤΝ για να παράγουν ψεύτικες νεκρολογίες ή επιστολές γιατρών για να υποστηρίξουν τον ισχυρισμό θανάτου κάποιου που στην πραγματικότητα είναι ακόμα ζωντανός (ή που δεν υπήρξε ποτέ, όπως θα συζητηθεί στη συνέχεια).

Συνθετικοί ασφαλισμένοι και ταυτότητες

Ίσως η πιο ύπουλη εξέλιξη είναι απάτη με συνθετική ταυτότητα στην ασφάλιση. Η απάτη με συνθετική ταυτότητα περιλαμβάνει τη δημιουργία ενός πλασματικού προσώπου ή οντότητας συνδυάζοντας πραγματικά δεδομένα (κλεμμένους αριθμούς κοινωνικής ασφάλισης, διευθύνσεις κ.λπ.) με κατασκευασμένα στοιχεία (ψεύτικα ονόματα, πλαστά έγγραφα ταυτότητας). Η πρόοδος της τεχνητής νοημοσύνης έχει καταστήσει ασήμαντα εύκολη τη δημιουργία ρεαλιστικά προσωπικά προφίλ - συμπεριλαμβανομένων φωτογραφιών και ταυτότητας - για άτομα που δεν υπάρχουν[13][14]. Οι απατεώνες μπορούν πλέον να δημιουργήσουν αλγοριθμικά έναν εντελώς ψεύτικο πελάτη, να αγοράσουν ένα συμβόλαιο στο όνομά του και αργότερα να διεκδικήσουν αξιώσεις ή παροχές συμβολαίου για αυτή την ψεύτικη ταυτότητα.

Στον τομέα των ασφαλίσεων ζωής, τα συστήματα συνθετικής ταυτότητας έχουν εκτοξεύθηκε στα ύψη. Η έρευνα του κλάδου το 2025 εκτιμά ότι το κόστος της απάτης με συνθετικές ταυτότητες πάνω από $30 δισεκατομμύρια ετησίως, αντιπροσωπεύοντας έως και 80-85% όλων των περιπτώσεων απάτης ταυτότητας σε όλες τις χρηματοπιστωτικές υπηρεσίες[15][16]. Οι ασφαλιστές ζωής έχουν πληγεί ιδιαίτερα σκληρά: οι απατεώνες είναι γνωστό ότι εξασφαλίζουν ασφαλιστήρια συμβόλαια ζωής για ένα πλασματικό πρόσωπο και στη συνέχεια "σκοτώνουν" το πρόσωπο αυτό στα χαρτιά για να εισπράξουν το επίδομα θανάτου[17]. Για παράδειγμα, ένας απατεώνας μπορεί να δημιουργήσει έναν συνθετικό πελάτη "John Doe", να πληρώσει ασφάλιστρα για ένα έτος και στη συνέχεια να υποβάλει αίτηση με ψεύτικο πιστοποιητικό θανάτου και νεκρολογία για τον πρόωρο θάνατο του John Doe. Επειδή η ταυτότητα κατασκευάστηκε προσεκτικά (πιστωτικό ιστορικό, δημόσια αρχεία κ.λπ.), η αίτηση θανάτου μπορεί να φανεί νόμιμη - μέχρι να μην βρεθεί πραγματικό πτώμα ή πραγματικοί συγγενείς. Μέχρι να αποκαλυφθεί η απάτη, οι δράστες έχουν φύγει προ πολλού με την πληρωμή.

Τα συνθετικά συστήματα ταυτότητας μαστίζουν επίσης ασφάλιση υγείας και ασφάλιση αυτοκινήτου. Τα εγκληματικά κυκλώματα δημιουργούν ταυτότητες "Φρανκενστάιν" με χρησιμοποιώντας αριθμούς κοινωνικής ασφάλισης παιδιών ή ηλικιωμένων (οι οποίοι δεν έχουν πιστωτικό ιστορικό) σε συνδυασμό με ονόματα και άδειες οδήγησης που παράγονται από τεχνητή νοημοσύνη[15]. Στη συνέχεια αγοράζουν συμβόλαια υγείας ή συμβόλαια αυτοκινήτου για αυτά τα ψεύτικα άτομα και λίγο αργότερα υποβάλλουν μεγάλες απαιτήσεις. Μια παραλλαγή είναι οι κοινοπραξίες που δημιουργούν ψεύτικες επιχειρήσεις (εταιρείες-βιτρίνες) - για παράδειγμα, μια εικονική εταιρεία μεταφοράς φορτηγών - και την αγορά εμπορικής ασφάλισης γι' αυτήν, μόνο και μόνο για να διεκδικήσει αργότερα αποζημιώσεις για σκηνοθετημένα ατυχήματα ή εικονικούς τραυματισμούς εργαζομένων[18][19]. Επειδή η επιχείρηση υπάρχει μόνο στα χαρτιά (με εγγραφές επιχειρήσεων και φορολογικούς κωδικούς που δημιουργούνται από την Τεχνητή Νοημοσύνη), αυτό "συνθετική απάτη με βάση την οντότητα συχνά δεν αποκαλύπτεται παρά μόνο μετά την καταβολή των αποζημιώσεων[18][20].

Γιατί οι συνθετικές ταυτότητες είναι τόσο αποτελεσματικές; Πρώτον, συχνά περνούν από αυτοματοποιημένους ελέγχους επαλήθευσης ταυτότητας. Τα πιστωτικά γραφεία και τα συστήματα KYC μπορούν να βρουν δεν υπάρχουν κόκκινες σημαίες επειδή η ταυτότητα περιλαμβάνει κάποια πραγματικά, έγκυρα δεδομένα (π.χ. ένα πραγματικό SSN με καθαρό μητρώο)[21]. Εν τω μεταξύ, οι φωτογραφίες προφίλ και οι σαρώσεις ταυτότητας που δημιουργούνται από την τεχνητή νοημοσύνη μπορούν να φαίνονται απολύτως αυθεντικές - η σημερινή τεχνητή νοημοσύνη μπορεί να παράγει ένα ανθρώπινο πρόσωπο που ακόμη και η προηγμένη αναγνώριση προσώπου μπορεί να δεχτεί ως πραγματικό. Το αποτέλεσμα: τα περισσότερα αυτοματοποιημένα συστήματα αναγνωρίζουν αυτά τα προφίλ ως νόμιμα και η απάτη συλλαμβάνεται (αν συλλαμβάνεται) μόνο μετά από μεγάλες απώλειες[22].

Επιπτώσεις στον πραγματικό κόσμο: Η RGA αναφέρει ότι η απάτη με συνθετικές ταυτότητες στις ασφαλίσεις ζωής κοστίζει πλέον στον κλάδο περίπου $30B ετησίως και έχει αυξηθεί σχεδόν 400% από το 2020[15][16]. Η Ομοσπονδιακή Επιτροπή Εμπορίου των ΗΠΑ εκτιμά ότι οι συνθετικές ταυτότητες αποτελούν τη συντριπτική πλειονότητα των περιστατικών απάτης ταυτότητας[16]. Αυτές οι απώλειες πλήττουν τελικά τα πορτοφόλια των έντιμων ασφαλισμένων - κάθε οικογένεια πληρώνει περίπου \$700 επιπλέον ασφάλιστρα κάθε χρόνο λόγω του ευρύτερου φορτίου απάτης για τους ασφαλιστές.[15]. Οι ασφαλιστές ανταποκρίνονται ενισχύοντας την επαλήθευση κατά την εγγραφή και τις απαιτήσεις: εφαρμόζοντας ελέγχους βάσεων δεδομένων για τη σύνδεση της ταυτότητας, την παρακολούθηση για πολλαπλά συμβόλαια στην ίδια διεύθυνση, ακόμη και τη διεξαγωγή δοκιμών "ζωντάνιας" (έλεγχοι βίντεο με selfie για να διασφαλιστεί ότι ο αιτών είναι πραγματικό πρόσωπο και όχι απλώς μια εικόνα AI).[23][24]. Αλλά όπως θα δούμε, οι απατεώνες αντιδρούν με τεχνητή νοημοσύνη στο επόμενο πεδίο: τις ψεύτικες φωνές και τα βίντεο.

Deepfake φωνές και ισχυρισμοί βίντεο

Τεχνητή νοημοσύνη deepfakes ήχου και βίντεο προσθέτουν μια νέα ανησυχητική διάσταση στην ασφαλιστική απάτη. Το 2023 και το 2024, υπήρξαν αρκετά περιστατικά εγκληματιών που χρησιμοποίησαν κλωνοποίηση φωνής να υποδυθούν άτομα μέσω τηλεφώνου - μια τακτική που αρχικά παρατηρήθηκε σε τραπεζικές ληστείες (όπως το διαβόητο τηλεφώνημα του CEO του deepfake που έκλεψε $35 εκατομμύρια το 2020), αλλά τώρα εξαπλώνεται και στις ασφάλειες. Οι απατεώνες κλωνοποιούν τις φωνές των ασφαλισμένων, των γιατρών ή των ρυθμιστών απαιτήσεων και τις χρησιμοποιούν σε απάτες κοινωνικής μηχανικής. Η ανάλυση της Pindrop για το 2024 προειδοποίησε ότι "οι απάτες με βάση την τεχνητή νοημοσύνη, η τεχνολογία συνθετικής φωνής και οι απάτες με βάση την τεχνητή νοημοσύνη αναδιαμορφώνουν το τοπίο της απάτης", με φωνητική απάτη κλιμάκωση με πρωτοφανή ρυθμό[25]. Διαπίστωσαν ότι τα τηλεφωνικά κέντρα ασφάλισης βομβαρδίζονταν από κακούς παράγοντες του εξωτερικού που χρησιμοποιούσαν φωνητικά deepfakes: για παράδειγμα, οι κλήσεις θα έρχονταν παρέχοντας το κλεμμένο SSN και τα προσωπικά δεδομένα ενός πραγματικού ασφαλισμένου, και αν ένας πράκτορας απαντούσε, ο η κλωνοποιημένη φωνή του καλούντος θα μπορούσε να ξεγελάσει τον πράκτορα μέσω του ελέγχου ταυτότητας βάσει γνώσης και να ζητήσει δόλια εκταμίευση[26]. Στην περίπτωση ενός ασφαλιστή της Δυτικής Ακτής, οι επιτιθέμενοι χρησιμοποίησαν επανειλημμένα αυτή τη μέθοδο για να προσπαθήσουν να καταλάβουν λογαριασμούς και να ανακατευθύνουν πληρωμές, εκμεταλλευόμενοι το γεγονός ότι η επαλήθευση της ταυτότητας του τηλεφωνικού κέντρου βασιζόταν σε φωνητικές και προσωπικές πληροφορίες που μπορούν να παραποιηθούν[26].

Η μίμηση φωνής έχει επίσης χρησιμοποιηθεί στην πλευρά των καταναλωτών: Οι απατεώνες έχουν καλέσει θύματα ατυχημάτων ή δικαιούχους ενώ προσποιούμενοι τους ασφαλιστικούς αντιπροσώπους, χρησιμοποιώντας φωνές τεχνητής νοημοσύνης για να ακούγονται επίσημες, προκειμένου να αποσπάσουν ευαίσθητες πληροφορίες ή ακόμη και πληρωμές. Αντίθετα, ένας απατεώνας μπορεί να υποδυθεί έναν πελάτη σε μια τηλεφωνική γραμμή για αποζημιώσεις για να υποβολή αίτησης μέσω τηλεφώνου με χρήση βαθιάς ψεύτικης φωνής που ταιριάζει με το φύλο/την ηλικία του πελάτη, παρακάμπτοντας έτσι τους φωνητικούς βιομετρικούς ελέγχους. Οι πρόσφατες στατιστικές για την απάτη είναι απογοητευτικές: οι ειδικοί του κλάδου προβλέπουν ένα 162% αύξηση των επιθέσεων απάτης deepfake κατά ασφαλιστών το επόμενο έτος[27], και η Pindrop κατέγραψε ένα 475% Αύξηση των επιθέσεων συνθετικής φωνής το 2024 όπως αναφέρθηκε προηγουμένως[2]. Αυτές οι επιθέσεις ξεπερνούν γρήγορα τους πιο παραδοσιακούς φορείς απάτης στον κυβερνοχώρο.

Πέρα από τα τηλεφωνήματα, deepfakes με βάση το βίντεο αναδύονται κατά τη διαδικασία διεκδίκησης. Πολλοί ασφαλιστές υιοθέτησαν εικονικές επιθεωρήσεις απαιτήσεων και τηλεδιασκέψεις (που επιταχύνθηκαν από την πανδημία), για να επαληθεύουν τις απώλειες ή να παίρνουν συνεντεύξεις από απόσταση από τους αιτούντες. Τώρα, οι απατεώνες αξιοποιώντας avatars τεχνητής νοημοσύνης και deepfake βίντεο για να ξεγελάσουν αυτές τις επαληθεύσεις. Υπήρξαν αναφορές για αιτούντες που χρησιμοποίησαν Άβαταρ που δημιουργούνται με τεχνητή νοημοσύνη σε ζωντανές βιντεοκλήσεις με τους ρυθμιστές, προκειμένου να μεταμφιεστούν σε κάποιον άλλον ή να αποκρύψουν σημάδια ασυνέπειας[28]. Για παράδειγμα, ένα κύκλωμα απάτης μπορεί να χρησιμοποιήσει ένα deepfake "ζωντανό" βίντεο ενός υποτιθέμενου αιτούντος που δείχνει τη ζημιά του μέσω smartphone, ενώ στην πραγματικότητα το πρόσωπο στην κάμερα είναι ένα σύνθετο προϊόν τεχνητής νοημοσύνης ή ένας μισθωμένος ηθοποιός με φίλτρα που αλλοιώνουν το πρόσωπο. Ένα υποθετικό αλλά πιθανό σενάριο είναι η χρήση ενός deepfake ενός αποθανών άτομο: Σε μια απάτη με προσόδους ή ασφάλειες ζωής, ένα μέλος της οικογένειας θα μπορούσε να χρησιμοποιήσει ένα ψεύτικο βίντεο του πρόσφατα αποθανόντος κατά τη διάρκεια μιας κλήσης ρουτίνας για την απόδειξη ζωής για να συνεχίσει να λαμβάνει πληρωμές.[29]. Παρόλο που δεν έχει δημοσιοποιηθεί ακόμη καμία περίπτωση τέτοιας φύσης, οι ασφαλιστές προετοιμάζονται γι' αυτό. Οι ρυθμιστικές αρχές λαμβάνουν επίσης υπόψη - στις ΗΠΑ και την Ευρώπη διεξάγονται συζητήσεις σχετικά με την ταξινόμηση των deepfakes στην κλοπή ταυτότητας και την επικαιροποίηση των κατευθυντήριων γραμμών για την επαλήθευση των αποδείξεων στις ασφάλειες[30].

Η ανίχνευση βίντεο και ήχου deepfake είναι πολύ δύσκολη χωρίς τεχνικά εργαλεία. Οι ανθρώπινοι ρυθμιστές δεν είναι εκπαιδευμένοι να διακρίνουν τα λεπτά προβλήματα συγχρονισμού χειλιών ή τις ακουστικές παραξενιές. Ωστόσο, υπήρξαν κόκκινες σημαίες σε ορισμένες περιπτώσεις: για παράδειγμα, αφύσικο ανοιγοκλείσιμο των ματιών ή δυσλειτουργίες του προσώπου σε βίντεο ή τεχνουργήματα ήχου στο παρασκήνιο σε μια κλήση που έδωσαν την πληροφορία στους ερευνητές. Συνολικά όμως, η ασφαλιστική απάτη deepfake βρίσκεται ακόμη σε πρώιμο στάδιο, και η ποινική δίωξη παραμένει σπάνια - από το 2023, οι νομικοί ορισμοί ήταν ασαφείς και η απόδειξη ότι ένα βίντεο δημιουργήθηκε με τεχνητή νοημοσύνη ήταν δύσκολη χωρίς ανάλυση από εμπειρογνώμονες[31]. Αυτό δίνει στους απατεώνες μια αίσθηση ατιμωρησίας. Η κούρσα των εξοπλισμών συνεχίζεται: οι ασφαλιστές στρέφονται τώρα σε εγκληματολογική Τεχνητή Νοημοσύνη για την καταπολέμηση της Τεχνητής Νοημοσύνης, χρησιμοποιώντας αλγορίθμους ανίχνευσης ψεύτικων βίντεο για την εξέταση ύποπτων βίντεο καρέ-καρέ για ενδείξεις χειραγώγησης[24]. Οι πωλητές βιομετρικών φωνής κυκλοφορούν ανιχνευτές φωνής που αναλύουν φασματικά μοτίβα και φωνητικό ρυθμό για την αυθεντικότητα.[32]. Θα συζητήσουμε αυτές τις αμυντικές τεχνολογίες σε επόμενη ενότητα.

Απάτες phishing και πλαστοπροσωπίας με ενισχυμένη τεχνητή νοημοσύνη

Δεν περνούν όλες οι απάτες με χρήση ΤΝ από το τμήμα απαιτήσεων- ορισμένοι στόχοι είναι πελάτες και εργαζόμενοι μέσω κοινωνικής μηχανικής. Μηνύματα ηλεκτρονικού ταχυδρομείου και κείμενα ηλεκτρονικού "ψαρέματος" που έχουν δημιουργηθεί από την Τεχνητή Νοημοσύνη έχουν καταστεί σημαντική απειλή στον ασφαλιστικό τομέα. Σε αυτά τα συστήματα, οι απατεώνες χρησιμοποιούν AI chatbots και μεταφραστικά εργαλεία για να δημιουργήσουν εξαιρετικά πειστικές επικοινωνίες απάτης. Για παράδειγμα, οι εγκληματίες μπορούν να υποδυθούν το εμπορικό σήμα και το στυλ γραφής μιας ασφαλιστικής εταιρείας για να στείλουν μαζικά μηνύματα ηλεκτρονικού "ψαρέματος" σε ασφαλισμένους, λέγοντάς τους ότι "απαιτείται επείγουσα δράση για να αποφευχθεί η ακύρωση του συμβολαίου" και κατευθύνοντάς τους σε έναν ψεύτικο ιστότοπο. Σε αντίθεση με τα αδέξια μηνύματα ηλεκτρονικού ταχυδρομείου απάτης του παρελθόντος, Η τεχνητή νοημοσύνη εξασφαλίζει άψογη γραμματική και ακόμη και εξατομίκευση, καθιστώντας τους πολύ πιο πιστευτούς. Έχουμε δει την Τεχνητή Νοημοσύνη να χρησιμοποιείται για την ανίχνευση λεπτομερειών στα μέσα κοινωνικής δικτύωσης που ενσωματώνονται σε μηνύματα spear-phishing, όπως η αναφορά σε μια πρόσφατη αγορά αυτοκινήτου σε μια ψεύτικη ειδοποίηση ασφάλισης αυτοκινήτου.

Ένα άλλο διάνυσμα είναι Μίμηση πρακτόρων ή στελεχών με τη βοήθεια ΤΝ. Υπήρξαν περιπτώσεις όπου απατεώνες μιμήθηκαν τη φωνή ενός ιδιοκτήτη ασφαλιστικού πρακτορείου και άφησαν μηνύματα στον τηλεφωνητή των πελατών ζητώντας ενημερώσεις για τραπεζικές πληροφορίες - ουσιαστικά μια φωνητική επίθεση phishing. Παρομοίως, η εσωτερική απάτη μπορεί να προέρχεται από την απομίμηση AI: το οικονομικό τμήμα ενός ασφαλιστή παραλίγο να πέσει θύμα όταν οι απατεώνες έστειλαν ένα ηχητικό μήνυμα deepfake δήθεν από τον Διευθύνοντα Σύμβουλο έγκριση μεταφοράς κεφαλαίων (μια παραλλαγή της "απάτης CEO" που καλύπτεται πλέον από ορισμένα ασφαλιστήρια συμβόλαια ηλεκτρονικού εγκλήματος).[33]). Αυτού του είδους οι απάτες πλαστοπροσωπίας με τεχνητή νοημοσύνη αυξήθηκαν κατά 17% το 2023 σύμφωνα με την Liberty Specialty Markets[33], και αναμένεται να συνεχίσουν να αυξάνονται.

Οι καταναλωτές έχουν επίσης στοχοποιηθεί με συνθετικές απάτες στα μέσα μαζικής ενημέρωσης συνδέεται με την ασφάλιση. Ο Συνασπισμός κατά της Ασφαλιστικής Απάτης σημειώνει περιπτώσεις απατεώνων που παριστάνουν τους ασφαλιστικούς διαμεσολαβητές, επικοινωνούν με θύματα ατυχημάτων ισχυριζόμενοι ότι χειρίζονται την απαίτησή τους και στη συνέχεια που απαιτούν άμεση πληρωμή ή ευαίσθητα δεδομένα[23]. Οι ανυποψίαστοι πελάτες, που ανακουφίζονται που ακούνε από έναν υποτιθέμενο εκπρόσωπο, μπορεί να συμμορφωθούν, ειδικά αν ο καλούντας γνώριζε λεπτομέρειες για το ατύχημά τους (τις οποίες η ΤΝ θα μπορούσε να συλλέξει από hacking ή δημόσιες πηγές). Η ευαισθητοποίηση του κοινού σχετικά με αυτές τις τακτικές είναι χαμηλή- ως εκ τούτου, οι ειδικοί στην πρόληψη της απάτης παροτρύνουν τους ασφαλιστές να εκπαίδευση των ασφαλισμένων σχετικά με την επαλήθευση της ταυτότητας των καλούντων και των ηλεκτρονικών μηνυμάτων[23][34]. Ακριβώς όπως οι τράπεζες προειδοποιούν τους πελάτες τους για το phishing, οι ασφαλιστές το 2025 αρχίζουν να περιλαμβάνουν προειδοποιήσεις για απάτη deepfake στην επικοινωνία τους.

Ένα κοινό στοιχείο σε αυτά τα συστήματα με ενισχυμένη τεχνητή νοημοσύνη είναι η χρήση άμεσα διαθέσιμων πακέτων "απάτης ως υπηρεσία".[35]. Στο σκοτεινό διαδίκτυο, οι εγκληματίες μπορούν να αγοράσουν ή να εγγραφούν σε εργαλεία που παρέχουν προκατασκευασμένες φωνές deepfake, πρότυπα ψεύτικων εγγράφων, γεννήτριες ηλεκτρονικού ταχυδρομείου phishing και πολλά άλλα. Αυτός ο εκδημοκρατισμός των εργαλείων τεχνητής νοημοσύνης σημαίνει ακόμη και οι απατεώνες με χαμηλή εξειδίκευση μπορούν να εξαπολύσουν εξελιγμένες επιθέσεις απάτης[35]. Για τις ασφαλιστικές εταιρείες, αυτό μεταφράζεται σε έναν κατακλυσμό πιο πειστικών προσπαθειών απάτης που προέρχονται από όλες τις πλευρές - αξιώσεις, εξυπηρέτηση πελατών, ηλεκτρονικό ταχυδρομείο, ακόμη και μέσα κοινωνικής δικτύωσης. Υπογραμμίζει την ανάγκη για μια πολυδιάστατη στρατηγική άμυνας, που συνδυάζει την τεχνολογία, την ανθρώπινη επαγρύπνηση και τη διακλαδική συνεργασία.

Ανίχνευση και άμυνα: AI-Powered Response: Μια απάντηση με τεχνητή νοημοσύνη

Η καταπολέμηση της απάτης με τεχνητή νοημοσύνη απαιτεί Άμυνα με βάση την τεχνητή νοημοσύνη. Οι ασφαλιστές στρέφονται όλο και περισσότερο σε προηγμένες τεχνολογίες ανίχνευσης και ανανεωμένες διαδικασίες για να αντιμετωπίσουν την επίθεση. Στην ουσία, οι ασφαλιστές πρέπει να ενσωματώσουν σημεία ελέγχου αυθεντικοποίησης περιεχομένου σε ολόκληρο τον κύκλο ζωής των ασφαλίσεων - από την ανάληψη ασφαλιστικών συμβάσεων έως τις απαιτήσεις και τις αλληλεπιδράσεις με τους πελάτες - για να εντοπίσουν τις πλαστογραφίες της ΤΝ. Το Σχήμα 2 παρέχει μια ανάλυση των βασικών τύπων απάτης που επιτρέπει η ΤΝ και της επικράτησής τους, και οι ακόλουθες ενότητες περιγράφουν λεπτομερώς τον τρόπο ανίχνευσης και αποτροπής του καθενός.

Σχήμα 2: Τύποι ασφαλιστικής απάτης με τεχνητή νοημοσύνη το 2025 (εκτιμώμενο μερίδιο ανά σύστημα). Οι ψεύτικες εικόνες (παραποιημένες φωτογραφίες ζημιών) και οι συνθετικές ταυτότητες συγκαταλέγονται στις μεγαλύτερες κατηγορίες, ακολουθούμενες από τα πλαστά έγγραφα (π.χ. αποδείξεις, πιστοποιητικά) με τεχνητή νοημοσύνη και τις απάτες deepfake ήχου/βίντεο.

1. Εργαλεία ανίχνευσης περιεχομένου AI: Οι νέες υπηρεσίες ανίχνευσης τεχνητής νοημοσύνης μπορούν να αναλύουν κείμενο, εικόνες, ήχο και βίντεο για να προσδιορίσουν αν έχουν παραχθεί από μηχανήματα ή αν έχουν υποστεί χειραγώγηση. Για παράδειγμα, οι ασφαλιστές μπορούν να αξιοποιήσουν λύσεις όπως Ανιχνευτές κειμένου και εικόνας AI της TruthScan τα οποία χρησιμοποιούν 99%+ ακριβή AI για να επισημάνουν έγγραφα γραμμένα με AI ή παραποιημένες φωτογραφίες[36]. Μια ασφαλιστική εταιρεία θα μπορούσε να ενσωματώσει αυτούς τους ανιχνευτές στο σύστημά της για τις αξιώσεις: όταν υποβάλλεται μια αξίωση και τα αποδεικτικά στοιχεία της, η περιγραφή του κειμένου μπορεί να σαρώνεται αυτόματα για γλωσσικά μοτίβα που δημιουργούνται από τεχνητή νοημοσύνη, και κάθε ανεβασμένη εικόνα μπορεί να σαρώνεται για σημάδια CGI ή επεξεργασίας. Τα εργαλεία επιχειρηματικού επιπέδου μπορούν αναγνώριση κειμένου που δημιουργείται από τεχνητή νοημοσύνη σε έγγραφα, μηνύματα ηλεκτρονικού ταχυδρομείου και επικοινωνίες με ακρίβεια 99%[36], και ομοίως ανίχνευση εικόνων που έχουν παραχθεί ή παραποιηθεί από τεχνητή νοημοσύνη για να διασφαλιστεί η αυθεντικότητα του οπτικού περιεχομένου[36]. Αυτό σημαίνει ότι μια ψεύτικη αφήγηση ατυχήματος που παράγεται από το ChatGPT ή μια φωτογραφία ζημιάς που έχει πλαστογραφηθεί κατά τη διάρκεια του ταξιδιού θα επισημανθεί για χειροκίνητη εξέταση πριν από την επεξεργασία της απαίτησης. Οι ασφαλιστές το 2025 υιοθετούν όλο και περισσότερο μια τέτοια αυθεντικοποίηση περιεχομένου AI - στην πραγματικότητα, 83% των επαγγελματιών που ασχολούνται με την καταπολέμηση της απάτης σχεδιάζουν να ενσωματώσουν τη γεννητική ανίχνευση ΤΝ έως το 2025, σύμφωνα με έρευνα του ACFE, από μόλις 18% που το χρησιμοποιούν σήμερα[37][38].

2. Επαλήθευση ταυτότητας & βιομετρικοί έλεγχοι: Για την αντιμετώπιση των συνθετικών ταυτοτήτων, οι ασφαλιστές ενισχύουν τα πρωτόκολλα KYC με τεχνητή νοημοσύνη. Οι υπηρεσίες επικύρωσης ταυτότητας μπορούν να διασταυρώνουν τα δεδομένα των αιτούντων με πολλαπλές βάσεις δεδομένων και να χρησιμοποιούν αναγνώριση προσώπου με δοκιμές ζωντάνιας. Για παράδειγμα, η απαίτηση μιας σύντομης βιντεοσκοπημένης selfie κατά την είσοδο (και η χρήση αντιστοίχισης προσώπου με την παρεχόμενη ταυτότητα) μπορεί να ανατρέψει πολλές συνθετικές ταυτότητες. Ακόμα πιο υψηλής τεχνολογίας, εταιρείες όπως η TruthScan προσφέρουν εγκληματολογικά στοιχεία εικόνας που μπορούν να spot φωτογραφίες προφίλ που δημιουργούνται από τεχνητή νοημοσύνη, avatars και συνθετικές εικόνες προσωπικοτήτων - ο ανιχνευτής εικόνας AI είναι εκπαιδεύονται για να αναγνωρίζουν πρόσωπα που δημιουργούνται από γεννήτριες όπως η StyleGAN ή η ThisPersonDoesNotExist[39]. Με την ανάπτυξη τέτοιων εργαλείων, ένας ασφαλιστής μπορεί να ανιχνεύσει αν η selfie ενός αιτούντος ασφάλισης ζωής δεν είναι πραγματικός άνθρωπος. Από την πλευρά της φωνής, φωνητικός βιομετρικός έλεγχος ταυτότητας για κλήσεις εξυπηρέτησης πελατών μπορεί να βοηθήσει- οι σύγχρονοι ανιχνευτές φωνητικής AI είναι σε θέση να αναγνώριση συνθετικών φωνών και προσπαθειών κλωνοποίησης φωνής σε πραγματικό χρόνο[40]. Για παράδειγμα, το TruthScan Ανίχνευση φωνής AI σύστημα χρησιμοποιεί ακουστική ανάλυση για να να αναγνωρίζουν φωνές που δημιουργούνται από τεχνητή νοημοσύνη και ηχητικές απομιμήσεις πριν ξεγελάσουν το προσωπικό του τηλεφωνικού κέντρου[40]. Αυτές οι λύσεις λειτουργούν σαν τείχος προστασίας - εάν κάποιος καλεί προσποιούμενος τον John Doe και το φωνητικό του αποτύπωμα δεν ταιριάζει με την αυθεντική φωνή του John Doe (ή ταιριάζει με γνωστά χαρακτηριστικά deepfake), η κλήση μπορεί να επισημανθεί ή να απαιτηθεί περαιτέρω απόδειξη ταυτότητας. Ο έλεγχος ταυτότητας πολλαπλών παραγόντων (επιβεβαίωση μέσω email/SMS, κωδικοί πρόσβασης μίας χρήσης κ.λπ.) προσθέτει πρόσθετα εμπόδια που πρέπει να ξεπεράσουν οι πλαστογράφοι.

3. Deepfake Video & Image Forensics: Όσον αφορά τα αποδεικτικά στοιχεία βίντεο, οι ασφαλιστές αρχίζουν να εφαρμόζουν εξειδικευμένη εγκληματολογική ανάλυση. Το προηγμένο λογισμικό μπορεί να αναλύσει τα μεταδεδομένα του βίντεο, τη συνοχή των καρέ και τα επίπεδα σφάλματος για τον εντοπισμό βαθιών απομιμήσεων. Ορισμένα εργαλεία εξετάζουν αντανακλάσεις, σκιές και φυσιολογικές ενδείξεις (όπως ο παλμός στο λαιμό ενός ατόμου σε βίντεο) για να διασφαλίσουν ότι ένα βίντεο είναι γνήσιο. Εγκληματολογία μεταδεδομένων είναι επίσης πολύτιμη: η εξέταση των μεταδεδομένων των αρχείων και των αποτυπωμάτων δημιουργίας σε εικόνες ή PDF μπορεί να αποκαλύψει αν κάτι έχει πιθανότατα παραχθεί από ένα εργαλείο τεχνητής νοημοσύνης.[41]. Οι ασφαλιστές θα πρέπει να απαιτούν πρωτότυπα αρχεία φωτογραφιών (τα οποία περιέχουν μεταδεδομένα) και όχι μόνο στιγμιότυπα οθόνης ή εκτυπωμένα αντίγραφα, για παράδειγμα. Η ομάδα απάτης της Zurich σημείωσε επιτυχία στη σύλληψη πλαστών εικόνων αυτοκινήτων με την παρατήρηση ανωμαλιών στα μεταδεδομένα της εικόνας και την ανάλυση επιπέδου σφάλματος[41]. Ανιχνευτές απάτης ηλεκτρονικού ταχυδρομείου μπορεί επίσης να σαρώσει τις εισερχόμενες επικοινωνίες για ενδείξεις περιεχομένου phishing γραμμένου από τεχνητή νοημοσύνη ή γνωστές κακόβουλες υπογραφές[42]. Πολλές ασφαλιστικές εταιρείες εκτελούν τώρα προσομοιώσεις phishing και παραδείγματα απάτης που έχουν σχεδιαστεί με τεχνητή νοημοσύνη στην εκπαίδευση των εργαζομένων για την αύξηση της ευαισθητοποίησης.

4. Αλλαγές διαδικασιών και ανθρώπινη κατάρτιση: Η τεχνολογία από μόνη της δεν είναι μια ασημένια σφαίρα. Βελτιώσεις διαδικασιών γίνονται, όπως συχνότεροι τυχαίοι επιτόπιοι έλεγχοι για απαιτήσεις υψηλής αξίας ή η απαίτηση φυσικής τεκμηρίωσης σε ορισμένες περιπτώσεις. Ορισμένοι ασφαλιστές έχουν καθυστερήσει την πλήρως αυτοματοποιημένη επεξεργασία των απαιτήσεων, επαναφέροντας την ανθρώπινη εξέταση για τις απαιτήσεις που έχουν υψηλή βαθμολογία σε ένα μοντέλο κινδύνου απάτης με τεχνητή νοημοσύνη. Από την πλευρά των ανθρώπων, η εκπαίδευση είναι ζωτικής σημασίας. Οι ερευνητές απάτης και οι διορθωτές εκπαιδεύονται να αναγνωρίζουν τις κόκκινες σημαίες της ΤΝ: π.χ. πολλαπλές αξιώσεις με πανομοιότυπη διατύπωση ("στυλ" ChatGPT), εικόνες χωρίς πραγματική τυχαιότητα (π.χ. επαναλαμβανόμενα μοτίβα σε κάτι που θα έπρεπε να είναι οργανική ζημιά) ή φωνές που ακούγονται σχεδόν αλλά έχουν ρομποτικό ρυθμό. Οι ασφαλιστές εκπαιδεύουν επίσης τους πελάτες: στέλνουν προειδοποιήσεις για απάτη σχετικά με τα συστήματα deepfake και συμβουλεύουν πώς να επαληθεύουν την ταυτότητα ενός ασφαλιστικού αντιπροσώπου (για παράδειγμα, παρέχοντας έναν γνωστό αριθμό κλήσης).

5. Συνεργατικές προσπάθειες: Η συνεργασία σε ολόκληρη τη βιομηχανία αυξάνεται. Στο Ηνωμένο Βασίλειο, το Γραφείο Ασφαλιστικής Απάτης και η Ένωση Βρετανικών Ασφαλιστών έχουν συγκροτήσει ομάδες εργασίας για την απάτη με τεχνητή νοημοσύνη και η κυβερνητική Χάρτης ασφαλιστικής απάτης (2024) προωθεί την ανταλλαγή δεδομένων και τις κοινές πρωτοβουλίες[43]. Σε παγκόσμιο επίπεδο, οι ασφαλιστικές εταιρείες συνεργάζονται με εταιρείες κυβερνοασφάλειας και νεοφυείς επιχειρήσεις τεχνητής νοημοσύνης. Ειδικότερα, εμφανίζονται νέα ασφαλιστικά προϊόντα: Liberty Mutual ξεκίνησε ένα ασφάλιση ηλεκτρονικού εγκλήματος για τις ΜΜΕ που καλύπτει ειδικά τις απάτες deepfake και την απάτη των διευθύνοντων συμβούλων[44][33], τονίζοντας ότι ο κίνδυνος αυτός είναι πολύ υπαρκτός. Αυτό σημαίνει επίσης ότι οι ασφαλιστές μπορεί να βρεθούν τόσο θύματα όσο και λύτες της απάτης ΤΝ - πληρώνοντας για μια απάτη deepfake, αν δεν εντοπιστεί, αλλά και προσφέροντας κάλυψη για άλλους που υφίστανται τέτοιες επιθέσεις.

Η ενσωμάτωση της τεχνολογίας ανίχνευσης στις ροές εργασίας μπορεί να απεικονιστεί ως μια άμυνα πολλαπλών σημείων στον κύκλο ζωής των απαιτήσεων. Όπως φαίνεται στο Σχήμα 3, οι ασφαλιστές μπορούν να εισάγουν βήματα επαλήθευσης ΤΝ στο εφαρμογή πολιτικής (για τον έλεγχο συνθετικών ταυτοτήτων μέσω ελέγχων εγγράφων ταυτότητας και selfie), στο υποβολή αίτησης (για την αυτόματη ανάλυση μεταφορτωμένων εγγράφων, φωτογραφιών ή ήχου για τη δημιουργία τεχνητής νοημοσύνης), κατά τη διάρκεια της επανεξέταση/διερεύνηση αξιώσεων (για να εκτελέσει εγκληματολογική ανάλυση deepfake σε ύποπτα αποδεικτικά στοιχεία και να επαληθεύσει τυχόν φωνητικές αλληλεπιδράσεις), και ακριβώς πριν από το πληρωμή (μια τελική επαλήθευση ταυτότητας για να διασφαλιστεί ότι ο δικαιούχος είναι νόμιμος). Με τον έγκαιρο εντοπισμό της απάτης - ιδανικά κατά την εγγραφή ή την πρώτη ειδοποίηση ζημίας - οι ασφαλιστές εξοικονομούν έξοδα έρευνας και αποφεύγουν τις άδικες πληρωμές.

Σχήμα 3: Ενσωμάτωση των σημείων ανίχνευσης της ΤΝ στον κύκλο ζωής της ασφάλισης. Κατά την εγγραφή στο συμβόλαιο, η επικύρωση ταυτότητας με βάση την ΤΝ ελέγχει για συνθετικές ή πλαστές ταυτότητες. Κατά την υποβολή μιας απαίτησης, αυτοματοποιημένοι ανιχνευτές σαρώνουν το κείμενο, τα έγγραφα και τις εικόνες της απαίτησης για περιεχόμενο παραγόμενο από ΤΝ. Κατά τον έλεγχο των απαιτήσεων, εξειδικευμένα εργαλεία ανάλυσης deepfake και φωνής επαληθεύουν τυχόν αποδεικτικά στοιχεία ήχου/βίντεο. Πριν από την πληρωμή, η βιομετρική επαλήθευση ταυτότητας επιβεβαιώνει την ταυτότητα του δικαιούχου. Αυτή η πολυεπίπεδη προσέγγιση συμβάλλει στην αναχαίτιση της απάτης σε πολλαπλά στάδια.

Οι ασφαλιστές δεν χρειάζεται να δημιουργήσουν όλες αυτές τις δυνατότητες στο εσωτερικό τους - πολλοί στρέφονται σε επιχειρηματικές λύσεις όπως οι Σουίτα ανίχνευσης AI της TruthScan, η οποία προσφέρει μια σειρά εργαλείων που μπορούν να ενσωματωθούν μέσω API στα συστήματα των ασφαλιστών. Για παράδειγμα, Υπηρεσία ανίχνευσης εικόνας & Deepfake AI της TruthScan μπορεί να χρησιμοποιηθεί για την επαλήθευση της γνησιότητας εικόνων και βίντεο με ακρίβεια άνω των 99%[45]. Το Ανιχνευτής κειμένου AI επισημαίνει κείμενο γραμμένο με τεχνητή νοημοσύνη σε ισχυρισμούς ή μηνύματα ηλεκτρονικού ταχυδρομείου[36], ενώ η Ανιχνευτής φωνής AI παρέχει ανίχνευση κλωνοποίησης φωνής και επαλήθευση ομιλητή για να σταματήσει τους απατεώνες τηλεφώνων[40]. Υπάρχουν ακόμη και εξειδικευμένα εργαλεία όπως ένα Ανιχνευτής πλαστών αποδείξεων να αναλύει άμεσα τιμολόγια/αποδείξεις για ενδείξεις παραποίησης ή γραμματοσειρές/διατάξεις που έχουν δημιουργηθεί με τεχνητή νοημοσύνη[46] - εξαιρετικά χρήσιμη, δεδομένης της επικράτησης πλαστών λογαριασμών επισκευής σε αξιώσεις. Χρησιμοποιώντας έναν συνδυασμό αυτών των εργαλείων, ένας ασφαλιστής μπορεί να βελτιώσει δραστικά το ποσοστό ανίχνευσης απάτης. Ένας ασφαλιστής του Fortune 500 ανέφερε ότι έπιασε 97% των προσπαθειών deepfake το 2024 με τη χρήση μιας πολυεπίπεδης προσέγγισης διαλογής με τεχνητή νοημοσύνη (κείμενο, εικόνα, φωνή) και αποφεύγοντας έτσι εκτιμώμενες απώλειες ύψους \$20M[47][48].

Συμπέρασμα

Η τεχνητή νοημοσύνη μεταμορφώνει το πεδίο μάχης της ασφαλιστικής απάτης σε παγκόσμια κλίμακα. Οι απατεώνες καινοτομούν με τη γενεσιουργό ΤΝ για να δημιουργήσουν ψεύδη που είναι πιο πειστικά από ποτέ - από εντελώς κατασκευασμένα άτομα και ατυχήματα μέχρι μιμήσεις που μπορούν να εξαπατήσουν ακόμη και έμπειρους επαγγελματίες. Τα δεδομένα από το 2024-2025 δείχνουν μια ανησυχητική αύξηση αυτών των συστημάτων που τροφοδοτούνται από την ΤΝ, αλλά υπογραμμίζουν επίσης ότι οι ασφαλιστές που επενδύουν στην ανίχνευση και την πρόληψη μπορούν να παραμείνουν ένα βήμα μπροστά. Συνδυάζοντας τεχνολογία ανίχνευσης AI αιχμής - όπως η εγκληματολογία εικόνων, ο έλεγχος ταυτότητας φωνής και η ανάλυση κειμένου - με επικαιροποιημένες ροές εργασίας και εκπαίδευση, ο κλάδος μπορεί να μετριάσει τους κινδύνους χωρίς να θυσιάσει την αποτελεσματικότητα που προσφέρουν οι ψηφιακές διαδικασίες.

Στον πυρήνα του, πρόκειται για έναν τεχνολογικό αγώνα εξοπλισμών[49]. Όπως σημείωσε ένας εμπειρογνώμονας για την πρόληψη της απάτης, "Σε αυτή τη νέα πραγματικότητα, η επαγρύπνηση είναι το ασφάλιστρο που πρέπει να καταβληθεί"[50]. Οι ασφαλιστικές εταιρείες πρέπει να καλλιεργήσουν μια κουλτούρα επαγρύπνησης και να αξιοποιήσουν τα καλύτερα διαθέσιμα εργαλεία για να διατηρήσουν την εμπιστοσύνη στη διαδικασία αποζημιώσεων. Αυτό σημαίνει ότι πρέπει να επαληθεύουν την αλήθεια των εγγράφων, των φωνών και των εικόνων με την ίδια αυστηρότητα που χρησιμοποιούν οι ασφαλιστές για την αξιολόγηση του κινδύνου. Σημαίνει επίσης συνεργασία σε ολόκληρο τον κλάδο για την ανταλλαγή πληροφοριών σχετικά με τις αναδυόμενες τακτικές απάτης με τεχνητή νοημοσύνη και την από κοινού ανάπτυξη προτύπων (για παράδειγμα, τυποποιημένες απαιτήσεις μεταδεδομένων για τα υποβαλλόμενα μέσα ενημέρωσης ή μαύρες λίστες του κλάδου με γνωστές ψεύτικες ταυτότητες).

Το 2025 είναι ένα σημείο καμπής: οι ασφαλιστές που προληπτική προσαρμογή στην απάτη με βάση την Τεχνητή Νοημοσύνη θα προστατεύσουν τους πελάτες και τους ισολογισμούς τους, ενώ όσοι αργούν να ανταποκριθούν μπορεί να βρεθούν στόχοι απάτης που θα προκαλέσει πρωτοσέλιδα. Τα ενθαρρυντικά νέα είναι ότι η τεχνολογία για την καταπολέμηση της υπάρχει και ωριμάζει γρήγορα - η ίδια τεχνητή νοημοσύνη που ενισχύει τους απατεώνες μπορεί να ενισχύσει τους ασφαλιστές. Με την εφαρμογή λύσεων όπως η πολυτροπική σουίτα ανίχνευσης ΤΝ της TruthScan για απαιτήσεις και επαλήθευση ταυτότητας, οι ασφαλιστές μπορούν να μειώσουν δραματικά το ποσοστό επιτυχίας των προσπαθειών απάτης που δημιουργούνται από ΤΝ[51][52]. Με τον τρόπο αυτό, όχι μόνο αποτρέπουν τις απώλειες, αλλά στέλνουν επίσης ένα σαφές μήνυμα στους επίδοξους απατεώνες: όσο έξυπνα και αν είναι τα εργαλεία, η απάτη θα αποκαλυφθεί.

Συνοψίζοντας, η ασφαλιστική απάτη με βάση την τεχνητή νοημοσύνη είναι μια τρομερή πρόκληση, η οποία όμως μπορεί να αντιμετωπιστεί με μια εξίσου έξυπνη άμυνα. Με επαγρύπνηση, διαλειτουργική στρατηγική και τους σωστούς τεχνολογικούς εταίρους, η ασφαλιστική βιομηχανία μπορεί να συνεχίσει να διατηρεί τη θεμελιώδη υπόσχεση που βρίσκεται στην καρδιά της επιχείρησής της - να πληρώνει μόνο νόμιμες απαιτήσεις και να το κάνει γρήγορα και με ασφάλεια σε έναν ολοένα και πιο ψηφιακό κόσμο.

Αναφορές:

- Ένωση Βρετανικών Ασφαλιστών - Στατιστικά στοιχεία για την απάτη 2023[53][54]

- Allianz & Zurich για το κύμα απαιτήσεων AI-"shallowfake" - The Guardian, 2024[4][11]

- Facia.ai - "Ασφαλιστική απάτη: ΑΣ: Πώς η Τεχνητή Νοημοσύνη ξαναγράφει τους κανόνες," Οκτώβριος 2025[55][56]

- Συνασπισμός κατά της ασφαλιστικής απάτης - Συνθετική απάτη στις ασφάλειες (Quantexa), Δεκέμβριος 2024[21][17]

- RGA - "Το νέο σύνορο της καταπολέμησης της απάτης: συνθετικές ταυτότητες". Ιούνιος 2025[15][16]

- Pindrop - Έκθεση για τη φωνητική απάτη, μέσω FierceHealthcare, Ιούνιος 2025[2][3]

- Γυρνώντας τους αριθμούς - "Κορυφαία συστήματα οικονομικής απάτης 2025," Οκτώβριος 2025[1][57]

- TruthScan - Πλατφόρμα ανίχνευσης AI (επισκόπηση υπηρεσιών), 2025[51][52]

- TruthScan - Σελίδα προϊόντος AI Image Detector, 2025[45][39]

- TruthScan - Σελίδα προϊόντος AI Voice Detector, 2025[40]

- TruthScan - Σελίδα προϊόντος Fake Receipt Detector, 2025[46]

- Liberty Specialty Markets - Δελτίο Τύπου της Deepfake/Cyber Fraud Insurance, Μάρτιος 2025[33]

- Facia.ai - Blog: Απάτη: Αγώνας εξοπλισμών για την πρόληψη της ασφαλιστικής απάτης, 2025[24][32]

- Insurance Business UK - "Εικόνες που δημιουργούνται με τεχνητή νοημοσύνη και χρησιμοποιούνται για απάτες με αυτοκίνητα". Απρ 2025[7][58]

- The Guardian - "Οι ψεύτικες φωτογραφίες ζημιών αυτοκινήτων προκαλούν συναγερμό στους ασφαλιστές," Μάιος 2024[9][12]

[1] [35] [57] 2025 Σχέδια οικονομικής απάτης: Απειλές και κόκκινες σημαίες

https://www.turningnumbers.com/blog/top-financial-fraud-schemes-of-2025

[2] [3] [25] [26] Η ασφαλιστική απάτη αυξήθηκε κατά 19% από φωνητικές επιθέσεις το 2024

https://www.fiercehealthcare.com/payers/insurance-fraud-increased-19-synthetic-voice-attacks-2024

[4] [9] [10] [11] [12] Απατεώνες επεξεργάζονται φωτογραφίες οχημάτων για να προσθέσουν ψεύτικες ζημιές σε βρετανική ασφαλιστική απάτη | Ασφαλιστική βιομηχανία | The Guardian

[5] [6] [7] [8] [43] [53] [54] [58] Οι εικόνες που δημιουργούνται με τεχνητή νοημοσύνη χρησιμοποιούνται πλέον για απάτες στην ασφάλιση αυτοκινήτων - έκθεση | Insurance Business UK

[13] [14] [15] [16] Το νέο σύνορο της καταπολέμησης της απάτης: Συνθετικές ταυτότητες και μια κούρσα εξοπλισμών με τεχνητή νοημοσύνη | RGA

[17] [18] [19] [20] [21] [22] JIFA: Συνθετική απάτη: InsuranceFraud.org

https://insurancefraud.org/publications/jifa-synthetic-fraud/

[23] [24] [28] [29] [30] [31] [32] [34] [41] [49] [50] [55] [56] Ασφαλιστική απάτη Deepfake: Πώς η Τεχνητή Νοημοσύνη ξαναγράφει τους κανόνες των ασφαλιστικών απαιτήσεων

https://facia.ai/blog/deepfake-insurance-fraud-how-ai-is-rewriting-the-rules-of-insurance-claims/

[27] [48] Η σιωπηλή απειλή: Γιατί η ασφαλιστική απάτη μεταφέρεται στην τηλεφωνική γραμμή

https://www.modulate.ai/blog/the-silent-threat-why-insurance-fraud-is-moving-to-the-phone-line

[33] [44] Η ασφάλιση ηλεκτρονικού εγκλήματος για ΜΜΕ στοχεύει στην απάτη CEO, τα deepfakes - LSM | Insurance Business UK

[36] [42] [51] TruthScan - Επιχειρησιακή ανίχνευση AI & ασφάλεια περιεχομένου

[37] Μελέτη: 8 στους 10 μαχητές απάτης αναμένουν να αναπτύξουν γεννητική τεχνητή νοημοσύνη μέχρι το 2025

[38] Πληροφορίες από την έκθεση συγκριτικής αξιολόγησης της τεχνολογίας καταπολέμησης της απάτης 2024

[39] [45] Ανιχνευτής εικόνας AI | Εντοπίστε ψεύτικες και χειραγωγημένες φωτογραφίες - TruthScan

https://truthscan.com/ai-image-detector

[40] [52] Ανιχνευτής φωνής AI για Deepfakes & κλωνοποίηση φωνής | TruthScan

https://truthscan.com/ai-voice-detector

[46] TruthScan Fake Receipt Detector | Επαλήθευση γνησιότητας παραλαβής

https://truthscan.com/fake-receipt-detector

[47] Fortune 500 Ασφαλιστής ανιχνεύει 97% των Deepfakes και σταματάει τις συνθετικές ...