Εισαγωγή

Η τεχνητή νοημοσύνη μεταμορφώνει το τοπίο της οικονομικής απάτης με πρωτοφανή τρόπο. Στις αρχές του 2024, απατεώνες χρησιμοποίησαν τεχνητή νοημοσύνη που δημιουργούσε βαθιά ψεύδη για να υποδυθούν στελέχη σε μια βιντεοκλήση, εξαπατώντας έναν υπάλληλο του Χονγκ Κονγκ να μεταφέρει $25 εκατομμύρια στους απατεώνες[1][2]. Περιστατικά όπως αυτό καταδεικνύουν πώς η δημιουργική τεχνητή νοημοσύνη δίνει τη δυνατότητα στους εγκληματίες να κατασκευάζουν εξαιρετικά πειστικές απάτες που στοχεύουν τις τράπεζες και τους πελάτες τους. Οι ρυθμιστικές αρχές κρούουν τον κώδωνα του κινδύνου: το FinCEN του Υπουργείου Οικονομικών των ΗΠΑ εξέδωσε προειδοποίηση στα τέλη του 2024, προειδοποιώντας για την αύξηση της απάτης με τη χρήση μέσων ενημέρωσης που δημιουργούνται με τεχνητή νοημοσύνη, συμπεριλαμβανομένων πλαστών εγγράφων ταυτότητας για την παράκαμψη των τραπεζικών επαληθεύσεων.[3][4]. Αυτό το έγγραφο εξετάζει τις τελευταίες Τάσεις απάτης AI στις χρηματοπιστωτικές υπηρεσίες και εξετάζει πώς τα ιδρύματα μπορούν να ενισχύσουν τις άμυνές τους. Διερευνούμε πώς οι απατεώνες χρησιμοποιούν ως όπλο τη γεννητική τεχνητή νοημοσύνη -από τις βαθιές πλαστοπροσωπίες έως τις συνθετικές ταυτότητες- και περιγράφουμε την τεχνολογία και τις στρατηγικές (συμπεριλαμβανομένων προηγμένων εργαλείων ανίχνευσης όπως τα TruthScan) που μπορούν να χρησιμοποιήσουν οι ομάδες απάτης και τα στελέχη για την αντιμετώπιση αυτής της εξελισσόμενης απειλής.

Βασικές τάσεις απάτης AI στις χρηματοπιστωτικές υπηρεσίες

Η τεχνητή νοημοσύνη και η μηχανική μάθηση αξιοποιούνται από τους κακοποιούς για τη διενέργεια απάτης σε μεγαλύτερη κλίμακα και πολυπλοκότητα. Αξιοσημείωτο Τακτικές απάτης με βάση την τεχνητή νοημοσύνη που επηρεάζουν τις τράπεζες, τις fintechs και τις ασφαλιστικές εταιρείες περιλαμβάνουν:

- Deepfake απάτες μίμησης: Οι εγκληματίες χρησιμοποιούν Βίντεο και ήχος που παράγονται με τεχνητή νοημοσύνη να υποδύονται έμπιστα άτομα (διευθύνοντες σύμβουλοι, πελάτες κ.λπ.) σε πραγματικό χρόνο. Για παράδειγμα, ζωντανές ψεύτικες φωνές έχουν χρησιμοποιηθεί σε επιθέσεις vishing (voice phishing) για την έγκριση δόλιων εμβασμάτων και βίντεο με τεχνητή νοημοσύνη έχουν ξεγελάσει υπαλλήλους ώστε να εγκρίνουν ψεύτικες συναλλαγές.[1][5]. Αυτά τα συνθετικά μέσα δυσκολεύουν την εξακρίβωση του αν πραγματικά μιλάτε με το άτομο που νομίζετε ότι είστε, επιτρέποντας έτσι ληστείες υψηλής αξίας όπως η παραπάνω υπόθεση $25M deepfake. Τα deepfakes γίνονται προσιτή και εύκολη στην παραγωγή, απαιτώντας μόλις 20-30 δευτερόλεπτα ήχου για την κλωνοποίηση μιας φωνής ή λιγότερο από μία ώρα για τη δημιουργία ενός φαινομενικά αυθεντικού βίντεο.[6].

- AI-Enhanced Phishing & BEC: Η δημιουργική τεχνητή νοημοσύνη ενισχύει τα συστήματα κοινωνικής μηχανικής, όπως τα ηλεκτρονικά μηνύματα phishing και τα συμβιβασμός επιχειρηματικού ηλεκτρονικού ταχυδρομείου (BEC). Τα AI chatbots μπορούν να συντάσσουν εξαιρετικά εξατομικευμένα μηνύματα ηλεκτρονικού ταχυδρομείου απάτης σε τέλεια επιχειρηματική γλώσσα, μιμούμενα το στυλ γραφής ενός CEO ή δημιουργώντας πειστικά ψεύτικα τιμολόγια προμηθευτών σε κλίμακα. Στην πραγματικότητα, υπόγεια εργαλεία όπως τα FraudGPT και WormGPT (μη φιλτραρισμένες εκδόσεις του ChatGPT) έχουν εμφανιστεί για να βοηθήσουν τους εγκληματίες του κυβερνοχώρου να αυτοματοποιήσουν τη δημιουργία phishing και κακόβουλου λογισμικού.[7][8]. Αυτό σημαίνει ότι ένας επίδοξος απατεώνας με ελάχιστες δεξιότητες μπορεί να δημιουργήσει καλογυαλισμένες εκστρατείες phishing ή κακόβουλο κώδικα με ευκολία. Με την τεχνητή νοημοσύνη, ένας μόνο εγκληματίας μπορεί να εκτοξεύσει χιλιάδες εξατομικευμένα μηνύματα ηλεκτρονικού ταχυδρομείου ή μηνύματα κειμένου, αυξάνοντας σημαντικά την εμβέλεια των παραδοσιακών προσπαθειών απάτης. Το Κέντρο Διαδικτυακού Εγκλήματος του FBI έχει ήδη παρατηρήσει πάνω από $2,7 δισ. που χάθηκαν από απάτες BEC το 2022, και η γενεσιουργός τεχνητή νοημοσύνη απειλεί να αυξήσει αυτές τις απώλειες ακόμη περισσότερο τα επόμενα χρόνια[9][10].

- Συνθετικές ταυτότητες & απάτη εγγράφων: Η γεννητική τεχνητή νοημοσύνη τροφοδοτεί μια έκρηξη στην απάτη με συνθετικές ταυτότητες, ένα από τα ταχύτερα αναπτυσσόμενα είδη οικονομικού εγκλήματος[11][12]. Οι απατεώνες συνδυάζουν πραγματικά και ψεύτικα προσωπικά δεδομένα για να δημιουργήσουν ταυτότητες "Φρανκενστάιν", και στη συνέχεια χρησιμοποιούν την τεχνητή νοημοσύνη για να να προσκομίσει ρεαλιστικά δικαιολογητικά - από πλαστά διαβατήρια και τραπεζικές καταστάσεις μέχρι αποκόμματα μισθοδοσίας[7]. AI γεννήτριες εικόνων και εργαλεία επεξεργασίας μπορούν να πλαστογραφήσουν αυθεντικές ταυτότητες και φωτογραφίες που περνούν την επιθεώρηση. Ακόμη και οι έλεγχοι ζωντάνιας ή οι επαληθεύσεις selfie μπορούν δυνητικά να νικηθούν από εικόνες ή βίντεο που έχουν παραποιηθεί από την Τεχνητή Νοημοσύνη. Αυτοματοποιώντας τη δημιουργία χιλιάδων ψεύτικων προσωπικοτήτων (η καθεμία με εικόνες προφίλ που δημιουργούνται από την ΤΝ, κοινωνικά μέσα κ.λπ.), οι εγκληματίες μπορούν να ανοίγουν μαζικά τραπεζικούς λογαριασμούς ή να υποβάλλουν αιτήσεις για δάνεια και να ξεπλένουν χρήματα ή να μην εξυπηρετούν πιστώσεις. Οι απώλειες από την απάτη με συνθετικές ταυτότητες εκτιμήθηκαν σε περίπου $35 δισεκατομμύρια το 2023[13], και η γεννητική τεχνητή νοημοσύνη επιταχύνει αυτή την τάση, καθιστώντας τις πλαστές ταυτότητες φθηνότερες και πιο δύσκολο να εντοπιστούν.

- Αυτοματοποιημένη απάτη και φοροδιαφυγή: Πέρα από τη δημιουργία ψεύτικου περιεχομένου, η τεχνητή νοημοσύνη βοηθά επίσης τους απατεώνες να μεγιστοποιήσουν την επιτυχία των σχεδίων τους. Τα προηγμένα bots μπορούν να δοκιμάσουν γρήγορα τα κλεμμένα στοιχεία πιστωτικής κάρτας σε ιστότοπους ηλεκτρονικού εμπορίου, χρησιμοποιώντας ML για να αποφύγουν τα ερεθίσματα ανίχνευσης. Η τεχνητή νοημοσύνη μπορεί να βοηθήσει τους εγκληματίες να εντοπίσουν τους πιο αδύναμους κρίκους στην ασφάλεια ενός οργανισμού ή ακόμη και να συνθέσουν φωνητικές απαντήσεις για να νικήσουν την επαλήθευση ταυτότητας μέσω τηλεφώνου. Μια μικρή βιομηχανία στο σκοτεινό διαδίκτυο πωλεί τώρα εργαλεία AI "απάτης ως υπηρεσία" για μόλις $20[14]. Αυτός ο εκδημοκρατισμός των δυνατοτήτων ΤΝ σημαίνει ότι ακόμη και οι εγκληματίες χαμηλού επιπέδου μπορούν να εξαπολύσουν εξαιρετικά εξελιγμένες επιθέσεις απάτης. Η κούρσα των εξοπλισμών επεκτείνεται και στην αποφυγή της ανίχνευσης - οι απατεώνες χρησιμοποιούν την ΤΝ για να ανιχνεύουν τα τραπεζικά συστήματα καταπολέμησης της απάτης και να βελτιώνουν την προσέγγισή τους μέχρι να βρουν μια μέθοδο που να περνάει από τα φίλτρα.[15]. Εν ολίγοις, η Τεχνητή Νοημοσύνη επιτρέπει τη διενέργεια απάτης σε κλίμακα και αποτελεσματικότητα που δεν έχει ξαναγίνει, προκαλώντας τις συμβατικές άμυνες.

Αυτές οι τακτικές με δυνατότητα ΤΝ είναι ήδη πολλαπλασιάζονται με ανησυχητικό ρυθμό. Παραδοσιακά συστήματα απάτης, όπως η πλαστογράφηση επιταγών ή το phishing, υπάρχουν εδώ και χρόνια, αλλά η τεχνητή νοημοσύνη αυξάνει τον όγκο και τον ρεαλισμό τους. Τα δεδομένα λένε μια ξεκάθαρη ιστορία: Η απάτη με τεχνητή νοημοσύνη είναι Ώθηση.

Μην ανησυχείτε ποτέ ξανά για την απάτη με τεχνητή νοημοσύνη. TruthScan Μπορεί να σας βοηθήσει:

- Ανίχνευση AI που παράγεται εικόνες, κείμενο, φωνή και βίντεο.

- Αποφύγετε το σημαντική απάτη με βάση την τεχνητή νοημοσύνη.

- Προστατέψτε τα πιο ευαίσθητο περιουσιακά στοιχεία της επιχείρησης.

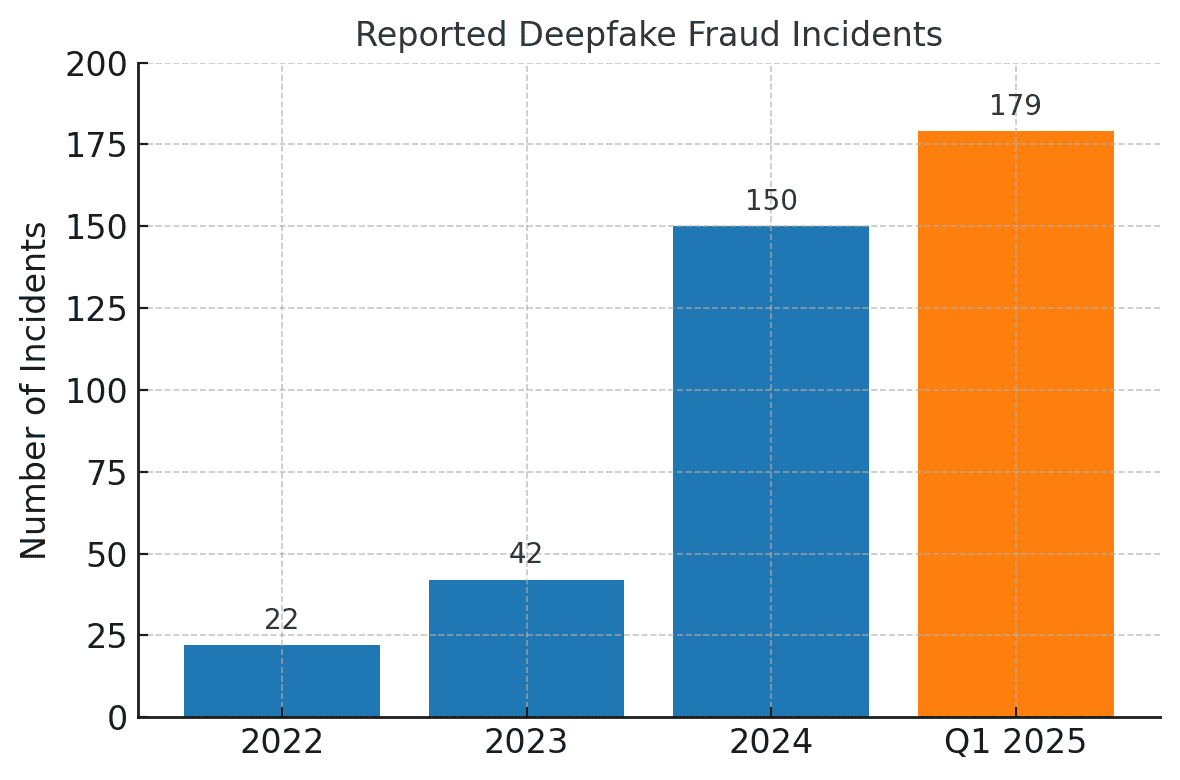

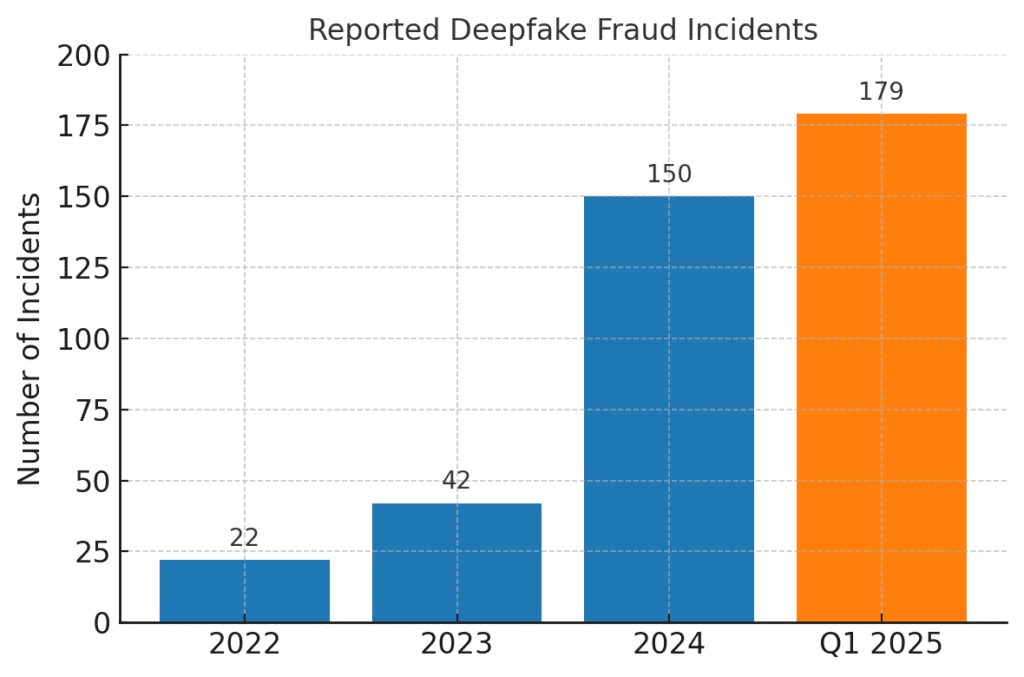

Τα περιστατικά απάτης που σχετίζονται με το Deepfake έχουν αυξηθεί κατακόρυφα. Το 2022, καταγράφηκαν μόνο 22 περιπτώσεις απάτης deepfake, αλλά το 2023 υπήρχαν 42 και μέχρι το 2024 τα περιστατικά εκτοξεύτηκαν σε 150. Μόνο το πρώτο τρίμηνο του 2025, 179 περιστατικά απάτης deepfake αναφέρθηκαν - ξεπερνώντας το σύνολο για όλο το 2024[16][17].

Πρόσφατες αναλύσεις του κλάδου απηχούν αυτές τις τάσεις. Μια έκθεση σημείωσε μια 700% αύξηση των περιστατικών deepfake στοχεύοντας σε επιχειρήσεις fintech το 2023[18]. Ακόμα πιο εντυπωσιακό, η Βόρεια Αμερική είδε ένα 1,740% αύξηση των περιπτώσεων απάτης deepfake μεταξύ 2022 και 2023[19]. Οι οικονομικοί εγκληματίες υιοθετούν γρήγορα αυτά τα εργαλεία επειδή λειτουργούν - πολλές τράπεζες και τα θύματα δεν είναι ακόμη προετοιμασμένα να ανιχνεύσουν την εξαπάτηση που δημιουργείται από τεχνητή νοημοσύνη.

Επιπτώσεις και προκλήσεις για τα χρηματοπιστωτικά ιδρύματα

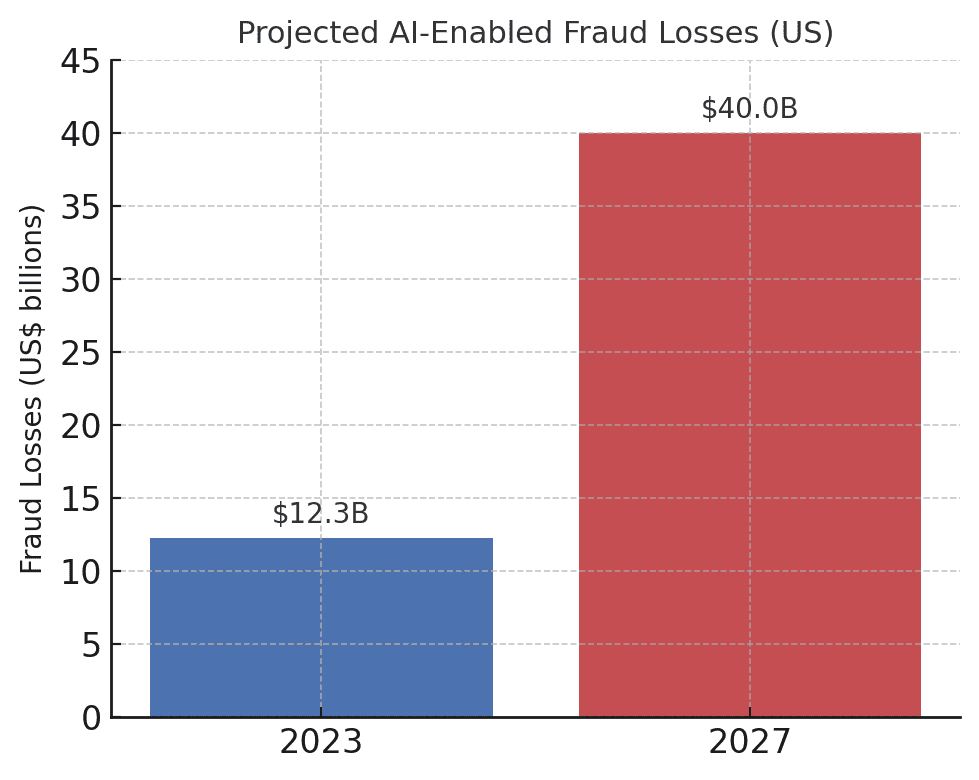

Η άνοδος της απάτης με βάση την τεχνητή νοημοσύνη θέτει σημαντικές επιπτώσεις στα χρηματοπιστωτικά ιδρύματα, τους πελάτες τους και το ευρύτερο χρηματοπιστωτικό σύστημα. Ο πιο άμεσος αντίκτυπος είναι η νομισματική απώλεια. Οι προβλέψεις του κλάδου προβλέπουν ότι μέχρι το 2027, οι απώλειες από απάτες που επιτρέπονται από τη γεννητική τεχνητή νοημοσύνη θα μπορούσαν να φθάσουν το $40 δισεκατομμύριο στις ΗΠΑ, από $12,3 δισ. το 2023[20]. Αυτή η υπερτριπλάσια αύξηση (a 32% CAGR) αντικατοπτρίζει πόσο γρήγορα αυξάνεται ο κίνδυνος απάτης σε όρους δολαρίου.

Οι προβλεπόμενες απώλειες από την απάτη με τεχνητή νοημοσύνη αυξάνονται δραματικά. Η Deloitte εκτιμά ότι οι απώλειες της χρηματοπιστωτικής απάτης στις ΗΠΑ που συνδέονται με τη γενεσιουργό ΤΝ θα αυξηθούν από $12,3 δισ. το 2023 σε $40 δισ. το 2027[20].

Πέρα από τις ακατέργαστες απώλειες, υπάρχουν απώλειες φήμης και έξοδα καταπιστεύματος. Οι καταναλωτές περιμένουν από τις τράπεζές τους να τους προστατεύσουν - αλλά οι απάτες που χρησιμοποιούν την τεχνητή νοημοσύνη υπονομεύουν την εμπιστοσύνη στα ψηφιακά κανάλια. Για παράδειγμα, εάν ένας πελάτης πέσει θύμα μιας πειστικής απάτης deepfake (όπως μια ψεύτικη βιντεοκλήση τραπεζίτη), μπορεί να κατηγορήσει την τράπεζα για ανεπαρκή ασφάλεια. Εμπιστοσύνη του κοινού στην επαλήθευση φωνής, στα μηνύματα ηλεκτρονικού ταχυδρομείου, ακόμη και στις τηλεδιασκέψεις, μπορεί να διαβρωθεί εάν "αυτό που βλέπετε/ακούτε" δεν μπορεί πλέον να θεωρηθεί πραγματικό.[21]. Σύμφωνα με έρευνες, 85% των οικονομικών επαγγελματιών στις ΗΠΑ/ΗΒ θεωρούν τις απάτες deepfake ως "υπαρξιακή" απειλή για την ασφάλεια του οργανισμού τους.[22]. Περισσότερες από τις μισές εταιρείες σε αυτές τις αγορές αναφέρουν ότι έχουν στοχοποιηθεί από μια απάτη που τροφοδοτείται από deepfake, και ανησυχητικά 43% από αυτούς που αποτέλεσαν στόχο παραδέχθηκαν ότι η επίθεση πέτυχε στην εξαπάτησή τους[23]. Κάθε επιτυχημένο περιστατικό όχι μόνο προκαλεί οικονομική ζημία αλλά και κλονίζει την εμπιστοσύνη των πελατών στο ίδρυμα.

Οι χρηματοπιστωτικές επιχειρήσεις παλεύουν επίσης με λειτουργικές προκλήσεις και προκλήσεις συμμόρφωσης από την απάτη της τεχνητής νοημοσύνης. Οι ομάδες καταπολέμησης της απάτης αντιμετωπίζουν αύξηση των συναγερμών και των περιστατικών, γεγονός που επιβαρύνει τους πόρους διερεύνησης. Τα υπάρχοντα μοντέλα ανίχνευσης απάτης (πολλά από τα οποία βασίζονται σε κανόνες ή παλαιότερες τεχνικές μηχανικής μάθησης) ενδέχεται να δυσκολεύονται να αναγνωρίσουν περιεχόμενο που έχει συνθέσει η τεχνητή νοημοσύνη και μοιάζει νόμιμο. Στην πραγματικότητα, τα σύγχρονα συστήματα ανίχνευσης βαθιάς απομίμησης που αναπτύχθηκαν σε εργαστήρια βλέπουν την ακρίβειά τους να μειώνεται κατά σχεδόν 50% όταν έρχονται αντιμέτωπα με deepfakes του πραγματικού κόσμου στη φύση[24]. Το ανθρώπινο προσωπικό δεν τα πηγαίνει πολύ καλύτερα - οι μελέτες διαπιστώνουν ότι οι άνθρωποι μπορούν να εντοπίσουν μόνο υψηλής ποιότητας βίντεο deepfake γύρω στο 55%-60% του χρόνου, μόλις και μετά βίας καλύτερη από την τύχη[25]. Αυτό δείχνει ότι χωρίς νέα εργαλεία, οι τράπεζες θα χάσουν ένα μεγάλο μέρος των προσπαθειών απάτης με τεχνητή νοημοσύνη.

Υπάρχει επίσης ένα ρυθμιστική διάσταση. Οι ρυθμιστικές αρχές και η επιβολή του νόμου έχουν πλήρη επίγνωση των κινδύνων (όπως αποδεικνύεται από την προειδοποίηση της FinCEN) και αναμένουν από τα χρηματοπιστωτικά ιδρύματα να προσαρμοστούν. Οι τράπεζες ενδέχεται να αντιμετωπίσουν αυστηρότερες κατευθυντήριες γραμμές σχετικά με την επαλήθευση των πελατών και την αναφορά απάτης στην εποχή της τεχνητής νοημοσύνης. Για παράδειγμα, εάν ο υπάλληλος μιας τράπεζας εξαπατηθεί από ένα deepfake για να εγκρίνει μια μεταφορά $10 εκατομμυρίων, οι ρυθμιστικές αρχές ενδέχεται να εξετάσουν εξονυχιστικά τους ελέγχους και τις διαδικασίες δέουσας επιμέλειας της τράπεζας. Το Νόμος περί τραπεζικού απορρήτου περιλαμβάνει πλέον ρητά την αναφορά ύποπτων για εγκλήματα στον κυβερνοχώρο και δραστηριότητες που σχετίζονται με deepfake[26][4], πράγμα που σημαίνει ότι οι τράπεζες πρέπει να εκπαιδεύσουν το προσωπικό να αναγνωρίζει και να αναφέρει τους δείκτες απάτης που δημιουργούνται με τεχνητή νοημοσύνη στις αναφορές ύποπτης δραστηριότητας (SAR). Η αποτυχία να συμβαδίσει με τις τεχνικές απάτης που ενισχύονται από την ΤΝ θα μπορούσε να οδηγήσει σε παραβιάσεις της συμμόρφωσης ή σε νομική ευθύνη, εάν οι πελάτες ή οι αντισυμβαλλόμενοι ισχυριστούν ότι η τράπεζα δεν έκανε αρκετά για να αποτρέψει τις προβλέψιμες απάτες που βασίζονται στην ΤΝ.

Ίσως η μεγαλύτερη πρόκληση είναι η ασύμμετρη φύση αυτής της νέας απειλής. Η δημιουργική τεχνητή νοημοσύνη μειώνει σημαντικά το κόστος και το εμπόδιο δεξιοτήτων για τους επιτιθέμενους, ενώ αυξάνει εκθετικά τον όγκο και τον ρεαλισμό των επιθέσεων. Μια και μόνο ιογενής φήμη deepfake ή μια πειστική κλήση κλώνου φωνής μπορεί να νικήσει επενδύσεις εκατομμυρίων δολαρίων σε έλεγχο ταυτότητας. Εν τω μεταξύ, οι υπερασπιστές πρέπει να επαληθεύουν την αυθεντικότητα κάθε συναλλαγής και αλληλεπίδρασης, ένα πολύ πιο δύσκολο έργο. Πρόκειται πραγματικά για μια κούρσα εξοπλισμών: Η τεχνητή νοημοσύνη δίνει στους απατεώνες μια αυτοενημερωμένη εργαλειοθήκη για να παρακάμπτουν την ασφάλεια, απαιτώντας από τις τράπεζες να ενημερώνουν συνεχώς και τις άμυνές τους[15][27]. Πολλά χρηματοπιστωτικά ιδρύματα παραδέχονται ότι δεν είναι επαρκώς προετοιμασμένα - πάνω από 80% των εταιρειών δεν διαθέτουν επίσημο σχέδιο αντιμετώπισης επιθέσεων deepfake, και περισσότεροι από τους μισούς δεν έχουν παράσχει καμία εκπαίδευση στους υπαλλήλους σχετικά με τους κινδύνους deepfake[28][29]. Αυτό το κενό ετοιμότητας σημαίνει ότι οι οργανισμοί είναι επί του παρόντος ευάλωτοι, αλλά αναδεικνύει επίσης τα σημεία όπου απαιτείται δράση.

Μια αξιοσημείωτη και απογοητευτική μέτρηση προέρχεται από μια πρόσφατη έκθεση του κλάδου: 42,5% των προσπαθειών απάτης στον χρηματοπιστωτικό τομέα περιλαμβάνουν πλέον κάποια μορφή ΤΝ[30]. Με άλλα λόγια, σχεδόν οι μισές από τις επιθέσεις απάτης που αντιμετωπίζουν οι τράπεζες έχουν μια συνιστώσα τεχνητής νοημοσύνης - είτε πρόκειται για ένα έγγραφο που δημιουργείται από τεχνητή νοημοσύνη, είτε για συνθετική φωνή, είτε για μήνυμα phishing που δημιουργείται από μηχανήματα. Αυτό το στατιστικό στοιχείο υπογραμμίζει ότι η τεχνητή νοημοσύνη δεν είναι μια υποθετική μελλοντική απειλή- είναι ήδη εδώ, αναγκάζοντας τα χρηματοπιστωτικά ιδρύματα να προσαρμοστούν ή να αντιμετωπίσουν αυξανόμενες απώλειες.

Υπεράσπιση κατά της απάτης με τεχνητή νοημοσύνη: Απάτης: Στρατηγικές και Λύσεις

Η αντιμετώπιση της απάτης με βάση την τεχνητή νοημοσύνη απαιτεί εξέλιξη στις στρατηγικές πρόληψης της απάτης. Οι παραδοσιακές προσεγγίσεις (όπως η χειροκίνητη επαλήθευση ή οι στατικές μηχανές κανόνων) δεν μπορούν να αντιμετωπίσουν τις μεταβαλλόμενες απάτες της τεχνητής νοημοσύνης. Αντ' αυτού, οι τράπεζες πρέπει να υιοθετήσουν τεχνολογία, κατάρτιση και ομαδική εργασία για να αντιστρέψει την κατάσταση. Παρακάτω, περιγράφουμε βασικές στρατηγικές και αναδυόμενες λύσεις:

- Αξιοποίηση της ΤΝ για την καταπολέμηση της ΤΝ (Εργαλεία προηγμένης ανίχνευσης): Τα χρηματοπιστωτικά ιδρύματα στρέφονται όλο και περισσότερο σε Λύσεις ανίχνευσης με τεχνητή νοημοσύνη για τον εντοπισμό περιεχομένου και ανωμαλιών που δημιουργούνται από τεχνητή νοημοσύνη. Στην ουσία, πρέπει να καταπολεμήσετε τη φωτιά με τη φωτιά. Τα νέα επιχειρησιακά εργαλεία, όπως τα TruthScan προσφέρει πολυτροπική ανίχνευση AI σε κείμενο, εικόνες, φωνή και βίντεο για να βοηθήσει στην αυθεντικοποίηση του περιεχομένου σε πραγματικό χρόνο.[31]. Για παράδειγμα, οι τράπεζες μπορούν να αναπτύξουν ανιχνευτές κειμένου τεχνητής νοημοσύνης για να σαρώνουν τις εισερχόμενες επικοινωνίες (μηνύματα ηλεκτρονικού ταχυδρομείου, μηνύματα συνομιλίας) για σημάδια γλώσσας που παράγεται από τεχνητή νοημοσύνη και μπορεί να υποδεικνύει ένα ηλεκτρονικό μήνυμα ηλεκτρονικού ψαρέματος ή μια ψεύτικη έρευνα πελάτη. Το σύστημα ανίχνευσης κειμένου AI της TruthScan μπορεί να εντοπίσει περιεχόμενο γραμμένο με AI από μοντέλα όπως το GPT-4 με 99%+ ακρίβεια, εντοπίζοντας ακόμη και ποιες προτάσεις είναι πιθανότατα δημιουργημένες από Τεχνητή Νοημοσύνη[32][33]. Παρομοίως, τα εργαλεία εγκληματολογίας εικόνων AI μπορούν να επαληθεύσουν έγγραφα και εικόνες. Ανιχνευτής εικόνας AI μπορεί να επισημάνει εάν μια υποβληθείσα άδεια οδήγησης ή ένας λογαριασμός κοινής ωφέλειας έχει δημιουργηθεί ψηφιακά ή έχει παραποιηθεί, συγκρίνοντας την με γνωστά μοτίβα εικόνων που δημιουργούνται από τεχνητή νοημοσύνη[34]. Για τις απειλές ήχου, οι τράπεζες αρχίζουν να χρησιμοποιούν ανιχνευτές φωνής deepfake - λύσεις που αναλύουν τον ήχο κλήσεων για τα ακουστικά αποτυπώματα συνθετικής ομιλίας. Ο ανιχνευτής φωνής AI της TruthScan, για παράδειγμα, ακούει για αποκαλυπτικά σημάδια κλωνοποίησης φωνής και μπορεί να επαληθεύστε τη γνησιότητα του ομιλητή για την αποφυγή απατηλών κλήσεων[35]. Ενσωματώνοντας αυτούς τους ανιχνευτές μέσω API στις ροές εργασίας τους, τα χρηματοπιστωτικά ιδρύματα μπορούν να ελέγχουν αυτόματα για περιεχόμενο ΤΝ στο παρασκήνιο των συναλλαγών και των αλληλεπιδράσεων. Αυτό παρέχει ένα πρόσθετο επίπεδο άμυνας που λειτουργεί σε ταχύτητα μηχανής, συλλαμβάνοντας αυτό που μπορεί να διαφύγει από τα ανθρώπινα μάτια/αυτιά.

- Εφαρμογή επαλήθευσης πολλαπλών παραγόντων και εκτός ζώνης: Καθώς η Τεχνητή Νοημοσύνη δυσκολεύει την εμπιστοσύνη στις φωνές ή τις εικόνες, οι τράπεζες θα πρέπει να βασίζονται περισσότερο σε μεθόδους επαλήθευσης που η Τεχνητή Νοημοσύνη δεν μπορεί εύκολα να παραποιήσει. Αυτό περιλαμβάνει τον έλεγχο ταυτότητας πολλαπλών παραγόντων (MFA) με τη χρήση ασφαλών καναλιών. Για παράδειγμα, εάν ένα αίτημα μεταφοράς χρημάτων έρχεται μέσω ηλεκτρονικού ταχυδρομείου ή βιντεοκλήσης, απαιτήστε έναν δεύτερο παράγοντα, όπως έναν κωδικό πρόσβασης μιας χρήσης που αποστέλλεται στη γνωστή κινητή συσκευή του αιτούντος ή μια επανάκληση σε έναν αξιόπιστο αριθμό τηλεφώνου που υπάρχει στο αρχείο. Ορισμένες τράπεζες προσθέτουν ελέγχους "ζωντάνιας" για συναλλαγές υψηλού κινδύνου - για παράδειγμα, ζητώντας από τον πελάτη να βγάλει μια ζωντανή selfie με μια συγκεκριμένη χειρονομία ή λέξη, την οποία είναι πιο δύσκολο να αναπαράγει ένα βίντεο deepfake. Οι βιομετρικοί ελεγκτές γνησιότητας μπορούν να ενισχυθούν με μέτρα κατά της πλαστογράφησης (π.χ. σάρωση για τρισδιάστατο βάθος προσώπου ή παρακολούθηση των λεπτών κινήσεων των ματιών που συχνά αποτυγχάνουν να μιμηθούν τα ψεύτικα βίντεο.[27]). Το κλειδί είναι η αποφυγή ενιαίων σημείων αποτυχίας. Ακόμα και αν ένα AI deepfake μπορεί να ξεγελάσει ένα κανάλι (π.χ. φωνητική επαλήθευση), ένας συντονισμένος έλεγχος εκτός ζώνης ή βιομετρική δοκιμή μπορεί να παρέχει την απαραίτητη πρόκληση για την αποκάλυψη της απάτης. Αρχές μηδενικής εμπιστοσύνης θα πρέπει να εφαρμόζεται: αντιμετωπίστε κάθε μη ζητηθείσα ή απροσδόκητη εντολή (ακόμη και από "γνωστό" στέλεχος ή πελάτη) ως ύποπτη μέχρι να επαληθευτεί μέσω ανεξάρτητου καναλιού.

- Εκπαίδευση των εργαζομένων και ευαισθητοποίηση σε θέματα απάτης: Η τεχνολογία από μόνη της δεν είναι μια ασημένια σφαίρα - ειδικά από τη στιγμή που οι απατεώνες θα στοχεύσουν στον πιο αδύναμο κρίκο, ο οποίος συχνά είναι η ανθρώπινη εμπιστοσύνη. Τα χρηματοπιστωτικά ιδρύματα θα πρέπει να επενδύουν σε τακτική εκπαίδευση των ομάδων πρόληψης απάτης και του προσωπικού πρώτης γραμμής σχετικά με τις απάτες που βασίζονται στην ΤΝ. Οι εργαζόμενοι πρέπει να μάθουν να αναγνωρίζουν τις κόκκινες σημαίες των deepfakes και της κοινωνικής μηχανικής. Αυτό μπορεί να περιλαμβάνει εκπαίδευση σχετικά με τις λεπτές ανωμαλίες (π.χ. προβλήματα συγχρονισμού χειλιών σε μια βιντεοκλήση ή ήχο που περιέχει αφύσικο τονισμό ή πολύ λίγο θόρυβο φόντου - πιθανά σημάδια συνθετικής φωνής). Ενθαρρύνετε μια κουλτούρα επαλήθευση: Οι υπάλληλοι θα πρέπει να αισθάνονται εξουσιοδοτημένοι να διακόπτουν μια ύποπτη συναλλαγή ή αίτημα και να το επαληθεύουν ανεξάρτητα, ακόμη και αν φαίνεται να προέρχεται από τον Διευθύνοντα Σύμβουλο. Η περίπτωση της Προσπάθεια παραποίησης φωνής του CEO της Ferrari είναι διδακτική - ένα στέλεχος αποκάλυψε το τέχνασμα μόνο με μια προσωπική ερώτηση στην οποία ο απατεώνας δεν μπορούσε να απαντήσει[36]. Οι ασκήσεις προσομοίωσης phishing/deepfake μπορεί επίσης να είναι χρήσιμες. Ακριβώς όπως οι εταιρείες εκτελούν προσομοιώσεις phishing για να εκπαιδεύσουν το προσωπικό, μπορούν να προσομοιώσουν ένα deepfake φωνητικό μήνυμα ή μια ψεύτικη συνάντηση βίντεο και να δουν αν οι εργαζόμενοι το εντοπίζουν. Αυτό δημιουργεί μυϊκή μνήμη για να αντιστέκονται στις πραγματικές επιθέσεις. Δεδομένου ότι περισσότερες από 50% των εταιρειών δεν διαθέτουν πρωτόκολλα αντίδρασης σε βαθιά απομίμηση και ελάχιστη εκπαίδευση[29], η καθιέρωση τέτοιων προγραμμάτων είναι ένας χαμηλός καρπός για τη βελτίωση της ανθεκτικότητας.

- Ανάλυση απάτης και ανίχνευση ανωμαλιών: Οι τράπεζες θα πρέπει να συνεχίσουν να χρησιμοποιούν την τεχνητή νοημοσύνη στην αμυντική πλευρά, ενισχύοντας την ανάλυση της απάτης. Τα σύγχρονα συστήματα ανίχνευσης απάτης χρησιμοποιούν μοντέλα μηχανικής μάθησης που αναλύουν τις συναλλαγές σε πραγματικό χρόνο και επισημαίνουν ανωμαλίες ή μοτίβα υψηλού κινδύνου. Αυτά τα μοντέλα πρέπει να επικαιροποιούνται ώστε να περιλαμβάνουν σήματα ενδεικτικά της απάτης που καθοδηγείται από την τεχνητή νοημοσύνη. Για παράδειγμα, ένα μοντέλο ML μπορεί να εκπαιδευτεί για να ανιχνεύει μεταδεδομένα ή μοτίβα συμπεριφοράς που σχετίζονται με εξαγορές λογαριασμών που οδηγούνται από bot (π.χ. απίστευτα γρήγοροι χρόνοι συμπλήρωσης φορμών ή απόλυτα συνεπή μοτίβα πληκτρολόγησης που υποδηλώνουν ένα αυτοματοποιημένο σενάριο). Τα γλωσσικά μοντέλα μπορούν να χρησιμοποιηθούν για την ανάλυση του περιεχομένου των μηνυμάτων και να επισημάνουν εάν ένα μήνυμα ηλεκτρονικού ταχυδρομείου από έναν προμηθευτή ήχοι που παράγονται από τεχνητή νοημοσύνη ή υπερβολικά τυποποιημένα (σε συνδυασμό με την ανίχνευση κειμένου τεχνητής νοημοσύνης που αναφέρθηκε προηγουμένως). Τράπεζες όπως η JPMorgan έχουν αρχίσει να χρησιμοποιούν μεγάλα γλωσσικά μοντέλα στις εσωτερικές τους επικοινωνίες για να εντοπίζουν φράσεις ή συμφραζόμενα που θα μπορούσαν να υποδηλώνουν μια προσπάθεια κοινωνικής μηχανικής.[37]. Δίκτυα πληρωμών, όπως η Mastercard, σαρώνουν τεράστια σύνολα δεδομένων (δισεκατομμύρια συναλλαγές) με τεχνητή νοημοσύνη για να εντοπίσουν δόλιες συναλλαγές που οι παραδοσιακοί κανόνες θα έχαναν.[38]. Το συμπέρασμα είναι ότι αμυντική Τεχνητή Νοημοσύνη πρέπει να είναι εξίσου καινοτόμος με την επιθετική τεχνητή νοημοσύνη. Οι επιχειρήσεις θα πρέπει να εξετάσουν το ενδεχόμενο ανάπτυξης ή αγοράς μοντέλων ΤΝ ειδικά για την ανίχνευση περιεχομένου deepfake, συνθετικών ταυτοτήτων και γεννητικών μοτίβων επίθεσης. Το σημαντικότερο είναι ότι αυτά τα μοντέλα θα πρέπει να επανεκπαιδεύονται συνεχώς στα πιο πρόσφατα παραδείγματα απάτης ΤΝ (μια πρακτική που ονομάζεται διαδικτυακή μάθηση ή ομοσπονδιακή μάθηση), ώστε να συμβαδίζουν με τις ταχέως εξελισσόμενες τακτικές των εγκληματιών.[39][40].

- Συνεργασία και ανταλλαγή πληροφοριών: Η καταπολέμηση της απάτης με χρήση τεχνητής νοημοσύνης θα απαιτήσει συνεργασία τόσο εντός όσο και μεταξύ των ιδρυμάτων. Οι απομονωμένες προσπάθειες είναι λιγότερο αποτελεσματικές απέναντι σε μια απειλή που ξεπερνά τα οργανωτικά όρια. Ομάδες πρόληψης της απάτης, ομάδες κυβερνοασφάλειας και ΤΠ πρέπει να συνεργάζονται χέρι-χέρι - για παράδειγμα, οι ομάδες ασφαλείας μπορούν να αναπτύξουν την ανίχνευση ψεύτικων στοιχείων σε εργαλεία τηλεδιάσκεψης, ενώ οι ομάδες απάτης ενσωματώνουν σαρώσεις περιεχομένου στην παρακολούθηση συναλλαγών. Σε ευρύτερο επίπεδο, οι τράπεζες θα πρέπει να συμμετέχουν σε ομάδες του κλάδου, όπως το Κέντρο Ανταλλαγής και Ανάλυσης Πληροφοριών Χρηματοοικονομικών Υπηρεσιών (FS-ISAC), για να ανταλλάσσουν πληροφορίες σχετικά με νέα συστήματα απάτης με τεχνητή νοημοσύνη.[41]. Εάν μια τράπεζα ανακαλύψει έναν νέο φορέα επίθεσης deepfake, η ανταλλαγή αυτής της γνώσης μπορεί να βοηθήσει τους άλλους να καλύψουν το κενό πριν χτυπηθούν. Κοινές ασκήσεις ή προσομοιώσεις "κόκκινων ομάδων" με σενάρια που αφορούν την ΤΝ (π.χ. απάτη στελέχους με deepfake ή παράκαμψη επαλήθευσης ταυτότητας που δημιουργείται από ΤΝ) μπορούν να διεξαχθούν μέσω κοινοπραξιών του κλάδου ή με κανονιστική υποστήριξη. Οι ίδιες οι ρυθμιστικές αρχές εστιάζουν στους κινδύνους ΤΝ, οπότε η προληπτική συνεργασία μαζί τους είναι συνετή. Συμβάλλοντας σε πρότυπα και κατευθυντήριες γραμμές για τη χρήση της ΤΝ, οι τράπεζες μπορούν να συμβάλουν στη διαμόρφωση ενός ασφαλέστερου οικοσυστήματος. Τελικά, δεδομένου ότι η απειλή για μια τράπεζα είναι απειλή για όλες τις τράπεζες σε αυτόν τον χώρο[42], μια προσέγγιση συλλογικής άμυνας θα ενισχύσει την ικανότητα όλων να εντοπίζουν και να αποτρέπουν την απάτη με τεχνητή νοημοσύνη.

- Μέτρα εκπαίδευσης πελατών και εμπιστοσύνης: Τέλος, τα χρηματοπιστωτικά ιδρύματα δεν πρέπει να παραβλέπουν το ρόλο της ευαισθητοποίησης των πελατών. Με τις απάτες deepfakes και AI που στοχεύουν στο ευρύ κοινό (για παράδειγμα, ψεύτικες φωνές σε απάτες με παππούδες ή ψεύτικες συνομιλίες "τεχνικής υποστήριξης" που δημιουργούνται από AI), οι τράπεζες μπορούν να βοηθήσουν στην εκπαίδευση των πελατών σχετικά με αυτούς τους κινδύνους. Πολλές τράπεζες αποστέλλουν ήδη ειδοποιήσεις σχετικά με το phishing- μπορούν να τις επεκτείνουν ώστε να αναφέρουν την κλωνοποίηση φωνής AI και τα βίντεο deepfake, παρέχοντας συμβουλές για τον τρόπο επαλήθευσης των αιτημάτων. Ορισμένοι προοδευτικοί οργανισμοί αποστέλλουν ειδοποιήσεις push ή προειδοποιήσεις στις εφαρμογές τους εάν κυκλοφορεί μια γνωστή απάτη (π.χ. "Προσοχή: οι απατεώνες μπορεί να χρησιμοποιήσουν φωνητικούς κλώνους μελών της οικογένειας ζητώντας χρήματα").[43]. Αν και δεν αποτρέπει άμεσα τις επιθέσεις, η εκπαίδευση μπορεί να μειώσει το ποσοστό επιτυχίας και να ενισχύσει ότι η τράπεζα είναι εταίρος στην ασφάλεια. Επιπλέον, οι τράπεζες που επενδύουν στην πρόληψη της απάτης αιχμής θα πρέπει να το τονίζουν αυτό στους πελάτες ως διαφοροποιητής - για παράδειγμα, η ενημέρωση των πελατών ότι όλες οι βιντεοκλήσεις ή τα έγγραφα που υποβάλλονται σαρώνονται από την τεχνητή νοημοσύνη για τη γνησιότητά τους (χωρίς να αποκαλύπτονται ευαίσθητες μέθοδοι) μπορεί να καθησυχάσει τους πελάτες ότι η τράπεζα χρησιμοποιεί κάθε διαθέσιμο εργαλείο για την προστασία τους. Η διατήρηση της ψηφιακής εμπιστοσύνης θα είναι ζωτικής σημασίας για τις τράπεζες προκειμένου να αξιοποιήσουν πλήρως τα οφέλη της ΤΝ στις υπηρεσίες, οπότε η διαφάνεια και οι διασφαλίσεις με επίκεντρο τον πελάτη αποτελούν μέρος μιας ολιστικής άμυνας.

Ρόλος των υπηρεσιών ανίχνευσης περιεχομένου AI

Ακρογωνιαίος λίθος της εργαλειοθήκης για την καταπολέμηση της απάτης στην εποχή της τεχνητής νοημοσύνης είναι η χρήση Υπηρεσίες ανίχνευσης περιεχομένου AI. Αυτές οι υπηρεσίες ειδικεύονται στον εντοπισμό των "δακτυλικών αποτυπωμάτων" του περιεχομένου που παράγεται με τεχνητή νοημοσύνη και μπορεί να ξεφύγει από τους ανθρώπινους κριτές. Η TruthScan είναι ένας τέτοιος πάροχος που προσφέρει ένα επιχειρηματικού επιπέδου AI Detection Suite που καλύπτουν πολλαπλούς τύπους περιεχομένου. Τα χρηματοπιστωτικά ιδρύματα μπορούν να ενσωματώσουν αυτά τα εργαλεία για να ελέγχουν αυτόματα για δείκτες πλαστογραφίας και απάτης:

- Επαλήθευση εγγράφων και εικόνων: Η πλατφόρμα της TruthScan επιτρέπει στις τράπεζες να δοκιμή οικονομικών εγγράφων για απάτες που δημιουργούνται από τεχνητή νοημοσύνη σε πραγματικό χρόνο[44]. Αυτό σημαίνει ότι όταν ανοίγει ένας νέος λογαριασμός ή όταν φτάνει μια αίτηση δανείου με ταυτότητα με φωτογραφία και απόκομμα μισθού, το σύστημα μπορεί να αναλύσει αμέσως αυτές τις εικόνες για ενδείξεις συνθετικής παραγωγής ή παραποίησης. Με ακρίβεια στόχου πάνω από 99%[45], ο AI Image Detector μπορεί να εντοπίσει πλαστές εικόνες ταυτότητας ή παραποιημένα PDF που ένας άνθρωπος μπορεί να εγκρίνει με την ονομαστική τους αξία. Αυτό το είδος επαλήθευση γνησιότητας εγγράφων είναι ζωτικής σημασίας για τη διακοπή της απάτης συνθετικής ταυτότητας πριν καν ανοίξουν λογαριασμοί.

- Παρακολούθηση συναλλαγών σε πραγματικό χρόνο: Με την ανάπτυξη ενσωματώσεων API, η TruthScan μπορεί να συνδεθεί με την επεξεργασία συναλλαγών των τραπεζών και να επισημάνει ανωμαλίες σε σε πραγματικό χρόνο. Εάν μια εντολή έρθει μέσω email που φαίνεται ύποπτη, ο Email Scam Detector μπορεί να αναλύσει το περιεχόμενο του μηνύματος και να εντοπίσει εάν πιθανότατα γράφτηκε από ένα μοντέλο τεχνητής νοημοσύνης που προσπαθεί να ξεγελάσει έναν προμηθευτή ή ένα στέλεχος.[46]. Ομοίως, η Ανιχνευτής AI σε πραγματικό χρόνο μπορεί να παρακολουθεί τις ζωντανές επικοινωνίες (όπως συνομιλίες ή πλατφόρμες συνεργασίας) για να παρέχει άμεσες ειδοποιήσεις εάν, ας πούμε, εντοπιστεί μια ψεύτικη τροφοδοσία βίντεο κατά τη διάρκεια μιας συνάντησης με υψηλό ρίσκο.[47][48]. Η συνεχής παρακολούθηση με άμεσες ειδοποιήσεις και αυτοματοποιημένες αντιδράσεις συμβάλλει στη συρρίκνωση του παραθύρου στο οποίο η απάτη μπορεί να συμβεί απαρατήρητη.

- Άμυνα φωνής και βίντεο Deepfake: Για τα τηλεφωνικά κέντρα και τους διαχειριστές σχέσεων, η ενσωμάτωση του TruthScan Ανιχνευτής φωνής AI προσθέτει ένα επιπλέον επίπεδο ασφάλειας. Εάν ένας απατεώνας καλέσει υποδυόμενος έναν πελάτη χρησιμοποιώντας έναν κλώνο φωνής, το σύστημα μπορεί να αναλύσει τον ήχο της κλήσης και να επισημάνει εάν περιέχει στοιχεία που έχουν συντεθεί με τεχνητή νοημοσύνη (όπως ελλείπουσες φυσικές μικροπαύσεις ή τεχνουργήματα στα ηχητικά κύματα).[35]. Στο μέτωπο του βίντεο, το Ανιχνευτής Deepfake εφαρμόζει αλγορίθμους υπολογιστικής όρασης σε καρέ βίντεο για να εντοπίζει ασυνέπειες -όπως αφύσικες κινήσεις του προσώπου, περίεργο φωτισμό ή λάθος συγχρονισμό χειλιών- που αποκαλύπτουν ένα ψεύτικο βίντεο.[49][50]. Με την επαλήθευση της ακεραιότητας των φωνών και των προσώπων σε βασικές αλληλεπιδράσεις, οι τράπεζες μπορούν να αποτρέψουν τους απατεώνες που προσπαθούν να εξαπατήσουν τους υπαλλήλους τους. Αυτά τα εργαλεία λειτουργούν σαν ένας υψηλής τεχνολογίας ανιχνευτής ψεύδους για ψηφιακό περιεχόμενο, που λειτουργεί αόρατα στο παρασκήνιο.

Αξίζει να σημειωθεί ότι η ανάπτυξη μιας τέτοιας τεχνολογίας ανίχνευσης δεν είναι μια "plug-and-play" θεραπεία- θα πρέπει να βαθμονομηθεί και να προσαρμοστεί στις ροές εργασίας του ιδρύματος. Πρέπει να γίνεται διαχείριση των ψευδώς θετικών αποτελεσμάτων (για παράδειγμα, ένας ανιχνευτής κειμένου τεχνητής νοημοσύνης μπορεί να χαρακτηρίσει τις νόμιμες επικοινωνίες που βασίζονται σε πρότυπα ως ύποπτες μέχρι να μάθει τη διαφορά). Ωστόσο, όταν ενσωματώνονται σωστά, αυτά τα εργαλεία βελτιώνουν αισθητά την ικανότητα ενός οργανισμού να εντοπίζετε το δόλιο περιεχόμενο πριν προκαλέσει ζημιά. Παράγουν επίσης διαδρομές ελέγχου και αναλυτικές αναφορές που είναι χρήσιμες για τη συμμόρφωση και τη συνεχή βελτίωση των μοντέλων απάτης.

Η αποτελεσματικότητα των εργαλείων ανίχνευσης Τεχνητής Νοημοσύνης εξαρτάται από συνεχείς ενημερώσεις. Ακριβώς όπως το λογισμικό προστασίας από ιούς απαιτεί νέες υπογραφές για νέους ιούς, οι ανιχνευτές τεχνητής νοημοσύνης χρειάζονται επανεκπαίδευση στις πιο πρόσφατες τεχνικές deepfake και μοντέλα τεχνητής νοημοσύνης. Προμηθευτές όπως η TruthScan ενημερώνουν τους αλγορίθμους τους για να χειρίζονται τα νέα παραγωγικά μοντέλα και τις τακτικές αποφυγής, διατηρώντας υψηλή ακρίβεια ακόμη και καθώς η ΤΝ εξελίσσεται.[51]. Αυτό αποφορτίζει τις εσωτερικές ομάδες και διασφαλίζει ότι οι τράπεζες δεν θα πολεμούν τον πόλεμο του χθες, ενώ οι εγκληματίες θα προχωρούν σε νέα κόλπα τεχνητής νοημοσύνης.

Συμπέρασμα

Ο κλάδος των χρηματοπιστωτικών υπηρεσιών βρίσκεται σε ένα σταυροδρόμι στον αγώνα κατά της απάτης. Από τη μία πλευρά, οι εγκληματίες αγκαλιάζουν ταχύτατα τη δημιουργική τεχνητή νοημοσύνη για να εξαπολύσουν απάτες που είναι πιο πειστικές και διαδεδομένες από ποτέ. Από την άλλη, οι τράπεζες και οι μαχητές της απάτης έχουν στη διάθεσή τους ένα διευρυνόμενο οπλοστάσιο άμυνας με βάση την ΤΝ. Τα ιδρύματα που θα ευδοκιμήσουν είναι εκείνα που αναγνωρίζουν το νέο τοπίο απειλών και ανταποκρίνονται με την ίδια εφευρετικότητα. Αυτό σημαίνει επένδυση σε προηγμένες δυνατότητες ανίχνευσης, ενσωμάτωση πολυεπίπεδων διαδικασιών επαλήθευσης, εκπαίδευση τόσο του προσωπικού όσο και των πελατών και προώθηση μιας κουλτούρας επαγρύπνησης και προσαρμογής.

Η απάτη με τεχνητή νοημοσύνη είναι ένας στόχος που κινείται γρήγορα - η απάτη deepfake που ξεγέλασε μια εταιρεία σήμερα μπορεί να αντιμετωπιστεί με νέες τεχνικές ανίχνευσης αύριο, μόνο και μόνο για να αλλάξουν οι απατεώνες τις μεθόδους τους την επόμενη εβδομάδα. Έτσι, μια στρατηγική πρόληψης της απάτης με "βιομηχανικό πρότυπο" το 2025 είναι αυτή που δίνει έμφαση στην ευελιξία και τη συνεχή βελτίωση. Οι χρηματοπιστωτικοί οργανισμοί θα πρέπει να αντιμετωπίζουν τα συστήματα άμυνας της απάτης τους ως ζωντανές, μαθησιακές οντότητες που εξελίσσονται παράλληλα με τις εγκληματικές τακτικές. Η αξιοποίηση συνεργασιών με παρόχους τεχνολογίας είναι μια έξυπνη συντόμευση για τη δημιουργία αυτών των δυνατοτήτων. Για παράδειγμα, η συνεργασία με εξειδικευμένες εταιρείες όπως η TruthScan (η οποία προσφέρει λύσεις προσαρμοσμένες για τον τραπεζικό και χρηματοπιστωτικό τομέα) μπορεί να επιταχύνει την ικανότητα ενός ιδρύματος να πρόληψη της απάτης με χρήση τεχνητής νοημοσύνης, διατηρώντας παράλληλα τη συμμόρφωση με τις κανονιστικές διατάξεις και την εμπιστοσύνη των πελατών[52].

Σε τελική ανάλυση, η προστασία από την απάτη με βάση την τεχνητή νοημοσύνη δεν αφορά μόνο την τεχνολογία - αφορά τη διατήρηση των θεμελιωδών εμπιστοσύνη που στηρίζει τη χρηματοδότηση. Οι πελάτες χρειάζονται εμπιστοσύνη ότι η τράπεζά τους μπορεί να ξεχωρίσει μια πραγματική συναλλαγή από μια ψεύτικη, έναν πραγματικό πελάτη από έναν απατεώνα της ΤΝ. Με την ανάπτυξη πρωτοποριακών εργαλείων ανίχνευσης ΤΝ, την ενίσχυση των πρωτοκόλλων επαλήθευσης και τη διατήρηση του προβάδισματός τους στις αναδυόμενες απειλές, οι επιχειρήσεις χρηματοπιστωτικών υπηρεσιών μπορούν να διατηρήσουν αυτή την εμπιστοσύνη. Ο δρόμος μπροστά μας θα περιλαμβάνει αναμφίβολα περισσότερες απόπειρες καινοτομίας απάτης από τους αντιπάλους, αλλά με την ετοιμότητα και τις σωστές επενδύσεις, οι τράπεζες μπορούν να διασφαλίσουν ότι Η τεχνητή νοημοσύνη γίνεται περισσότερο πλεονέκτημα παρά απειλή στον τομέα της πρόληψης της απάτης. Πρόκειται για έναν εφικτό στόχο: οι ίδιες τεχνολογίες τεχνητής νοημοσύνης που απειλούν να προκαλέσουν αναστάτωση μπορούν να αξιοποιηθούν για τη διασφάλιση της ακεραιότητας του χρηματοπιστωτικού μας συστήματος. Τώρα είναι η ώρα για τις ομάδες πρόληψης της απάτης και τα στελέχη C-level να δράσουν αποφασιστικά, υιοθέτηση προηγμένων λύσεων και στρατηγικών για να ξεγελάσουν τους απατεώνες και να διασφαλίσουμε το μέλλον της ψηφιακής χρηματοδότησης.

Πηγές: Πρόσφατες κλαδικές εκθέσεις, κανονιστικές ειδοποιήσεις και τεχνολογικά λευκά έγγραφα έχουν αναφερθεί παντού (Deloitte[20][18], Παγκόσμιο Οικονομικό Φόρουμ[19][24], Υπουργείο Οικονομικών των ΗΠΑ FinCEN[3][4], Ομοσπονδιακή Τράπεζα των ΗΠΑ[13], Keepnet Labs[16][30], μεταξύ άλλων) για την παροχή δεδομένων και παραδειγμάτων. Όλα τα δεδομένα και τα παραδείγματα παρατίθενται στη γραμμή για να μπορούν οι αναγνώστες να διερευνήσουν περαιτέρω.

[1] [9] [10] [14] [15] [18] [20] [37] [38] [42] [43] Deepfake banking και κίνδυνος απάτης με τεχνητή νοημοσύνη | Deloitte Insights

[2] [5] [6] [19] [21] [24] [25] [27] [36] [39] [40] [41] Η ανίχνευση της επικίνδυνης τεχνητής νοημοσύνης είναι απαραίτητη στην εποχή της βαθιάς απομίμησης | Παγκόσμιο Οικονομικό Φόρουμ

[3] [4] [26] Το FinCEN εκδίδει προειδοποίηση για τα συστήματα απάτης που περιλαμβάνουν Deepfake Media με στόχο τα χρηματοπιστωτικά ιδρύματα | FinCEN.gov

[7] [8] FraudGPT και GenAI: Πώς θα χρησιμοποιήσουν οι απατεώνες την AI στη συνέχεια; | Alloy

[11] Συνθετική απάτη ταυτότητας: Federal Reserve Bank of Boston

[12] [13] Η γεννητική τεχνητή νοημοσύνη αυξάνει τις απειλές απάτης συνθετικής ταυτότητας

[16] [17] [22] [23] [28] [29] [30] Deepfake Statistics & Trends 2025 | Βασικά δεδομένα και πληροφορίες - Keepnet

[31] [34] [35] [46] [47] [48] TruthScan - Επιχειρησιακή ανίχνευση AI & ασφάλεια περιεχομένου

[32] [33] [51] Ανιχνευτής AI: Ανίχνευση κειμένου AI Enterprise-Grade - TruthScan

[44] [45] [52] Banking AI Fraud Detection | Λύσεις CRO | TruthScan

[49] [50] Deepfake Detector - Αναγνώριση ψεύτικων βίντεο και βίντεο AI - TruthScan