Εισαγωγή: Μια νέα εποχή επιθέσεων με γνώμονα την Τεχνητή Νοημοσύνη

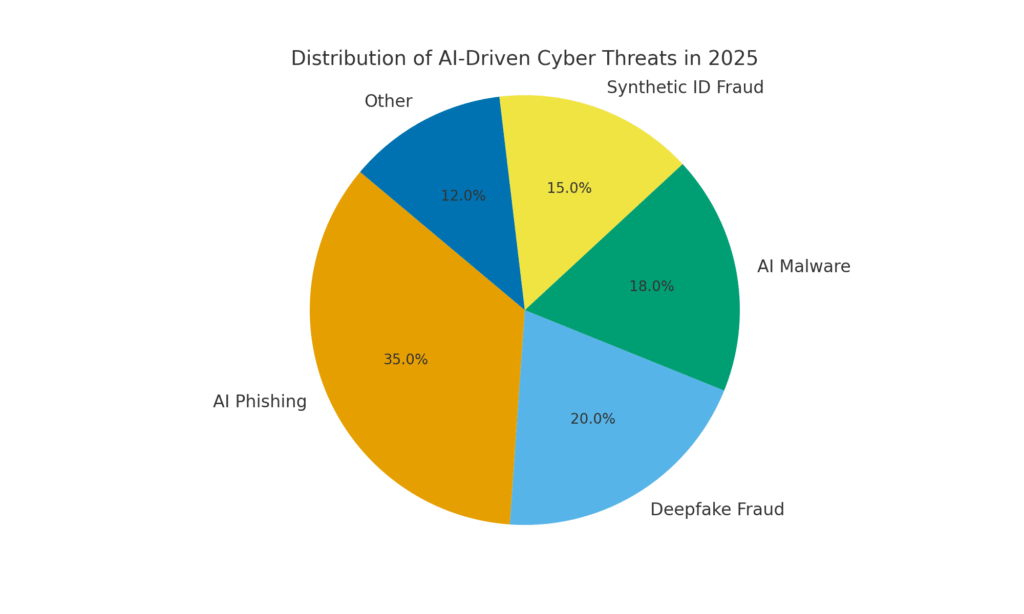

Το έτος 2025 σηματοδότησε ένα σημείο καμπής στην κυβερνοασφάλεια. Η γεννητική τεχνητή νοημοσύνη έχει υπερφορτώσει τις κυβερνοεπιθέσεις, επιτρέποντας στους φορείς απειλών να εξαπολύουν περισσότερες συχνές, ρεαλιστικές και κλιμακούμενες καμπάνιες από ποτέ άλλοτε. Στην πραγματικότητα, κατά τη διάρκεια του περασμένου έτους εκτιμάται ότι 16% των αναφερθέντων περιστατικών στον κυβερνοχώρο αφορούσαν επιτιθέμενους που αξιοποιούσαν εργαλεία τεχνητής νοημοσύνης (π.χ. μοντέλα δημιουργίας εικόνων και γλωσσών) για την ενίσχυση της κοινωνικής μηχανικής[1]. Από εξαιρετικά πειστικά ηλεκτρονικά μηνύματα phishing μέχρι απάτες με ψεύτικο ήχο/βίντεο, οι κακόβουλοι φορείς χρησιμοποιούν ως όπλο την Τεχνητή Νοημοσύνη σε όλους τους τομείς. Η πλειονότητα των επαγγελματιών ασφαλείας αποδίδει πλέον την αύξηση των κυβερνοεπιθέσεων στη γενεσιουργό τεχνητή νοημοσύνη, το οποίο παρέχει στους κακοποιούς ταχύτερους και εξυπνότερους τρόπους εκμετάλλευσης των θυμάτων[2]. Η δημιουργική τεχνητή νοημοσύνη μειώνει αποτελεσματικά τον πήχη των δεξιοτήτων για το έγκλημα στον κυβερνοχώρο, αυξάνοντας παράλληλα την ισχύ του.

Γιατί αυτό είναι τόσο ανησυχητικό; Η τεχνητή νοημοσύνη μπορεί να παράγει άμεσα γυαλισμένο περιεχόμενο με επίγνωση του πλαισίου που ξεγελά ακόμη και εκπαιδευμένους χρήστες. Μπορεί να υποδυθεί φωνές και πρόσωπα με τρομακτική ακρίβεια και να δημιουργήσει ακόμη και κακόβουλο κώδικα που μεταμορφώνεται για να αποφύγει την ανίχνευση. Ως αποτέλεσμα, οι επιθέσεις στον κυβερνοχώρο έχουν γίνει πιο δύσκολο να εντοπιστούν και πιο εύκολο να εκτελεστούν. Το Παγκόσμιο Οικονομικό Φόρουμ προειδοποιεί ότι 72% των οργανισμών έχουν δει αυξημένους κινδύνους στον κυβερνοχώρο - ιδίως κοινωνική μηχανική και απάτη - λόγω των αυξανόμενων δυνατοτήτων της γενεσιουργού τεχνητής νοημοσύνης[3]. Τα περιστατικά του πραγματικού κόσμου το επιβεβαιώνουν αυτό: Στις αρχές του 2024, οι εγκληματίες χρησιμοποίησαν μια τεχνητή νοημοσύνη... deepfake κλήση βίντεο να υποδυθεί τον οικονομικό διευθυντή μιας εταιρείας και να εξαπατήσει έναν υπάλληλο για να μεταφέρει $25,6 εκατομμύρια στους απατεώνες[4]. Και σε μια άλλη περίπτωση, οι χάκερς της Βόρειας Κορέας χρησιμοποίησαν Πλαστά έγγραφα ταυτότητας που παράγονται με τεχνητή νοημοσύνη για να παρακάμψετε τους ελέγχους ασφαλείας σε μια αμυντική εκστρατεία phishing[5]. Αυτά τα παραδείγματα αναδεικνύουν το διακύβευμα - η γεννητική τεχνητή νοημοσύνη ενισχύει τις απάτες που παρακάμπτουν τόσο τους ανθρώπινους όσο και τους τεχνικούς ελέγχους.

Ωστόσο, η τεχνητή νοημοσύνη αποτελεί επίσης μέρος της λύσης. Τα προηγμένα εργαλεία ανίχνευσης (όπως αυτά της TruthScan) χρησιμοποιούν AI κατά Τεχνητή νοημοσύνη - ανάλυση περιεχομένου για τις λεπτές υπογραφές της μηχανικής παραγωγής. Σε αυτό το whitepaper, θα εξετάσουμε τις κορυφαίες κυβερνοαπειλές του 2025 που βασίζονται στην ΤΝ και πώς οι οργανισμοί μπορούν να τις μετριάσουν. Από το Phishing που δημιουργείται από τεχνητή νοημοσύνη στο απάτη του CEO deepfake, AI-crafted malware, συνθετικές ταυτότητες, και πολλά άλλα, θα εξερευνήσουμε πώς η γεννητική τεχνητή νοημοσύνη αναδιαμορφώνει τις επιθέσεις. Θα συζητήσουμε επίσης συγκεκριμένα αμυντικά μέτρα, όπως Ανίχνευση περιεχομένου AI, deepfake forensics και τεχνολογίες επαλήθευσης ταυτότητας που μπορούν να βοηθήσουν τις ομάδες ασφαλείας να ανακτήσουν το πάνω χέρι. Στόχος είναι να φωτιστεί ο τρόπος με τον οποίο οι επιχειρήσεις, οι MSSPs, οι CISOs και οι ερευνητές απάτης μπορούν να να ενσωματώσουν εργαλεία ανίχνευσης ΤΝ σε όλη τη στοίβα κυβερνοασφάλειας για να αντιμετωπίσει αυτό το κύμα απειλών με τεχνητή νοημοσύνη.

Μην ανησυχείτε ποτέ ξανά για την απάτη με τεχνητή νοημοσύνη. TruthScan Μπορεί να σας βοηθήσει:

- Ανίχνευση AI που παράγεται εικόνες, κείμενο, φωνή και βίντεο.

- Αποφύγετε το σημαντική απάτη με βάση την τεχνητή νοημοσύνη.

- Προστατέψτε τα πιο ευαίσθητο περιουσιακά στοιχεία της επιχείρησης.

AI-Generated Phishing & BEC: Απάτες σε πρωτοφανή κλίμακα

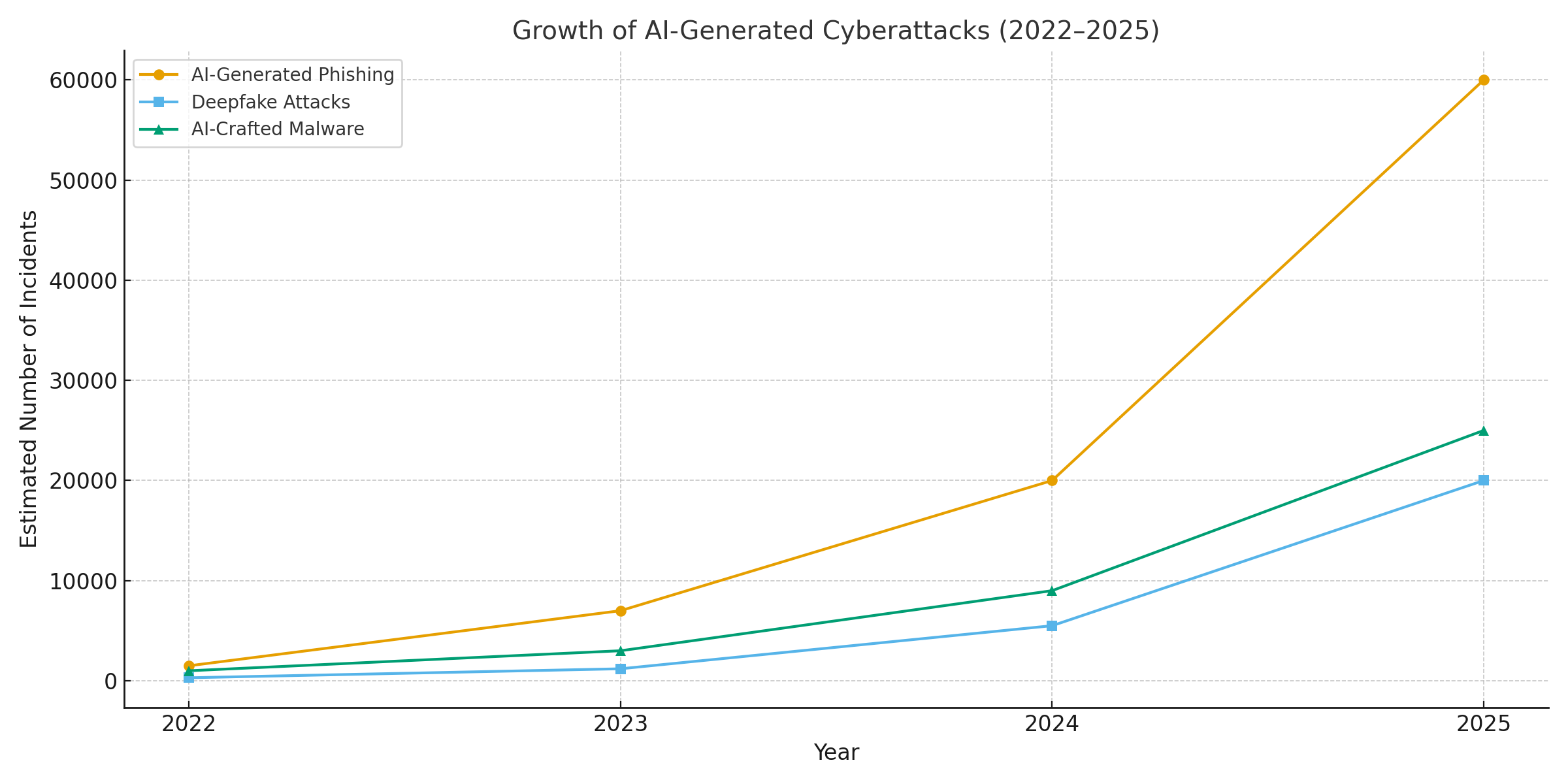

Μία από τις πιο σαφείς επιπτώσεις της δημιουργικής τεχνητής νοημοσύνης ήταν στο phishing και στα συμβιβασμός επιχειρηματικού ηλεκτρονικού ταχυδρομείου (BEC) συστήματα. Τα γλωσσικά μοντέλα τεχνητής νοημοσύνης μπορούν να συντάσσουν εύγλωττα, προσαρμοσμένα στα συμφραζόμενα μηνύματα ηλεκτρονικού ταχυδρομείου σε δευτερόλεπτα - εξαλείφοντας τα αποκαλυπτικά γραμματικά λάθη και τις αδέξιες διατυπώσεις που κάποτε πρόδιδαν το phishing. Το αποτέλεσμα είναι μια πλημμύρα εξαιρετικά πειστικών μηνυμάτων ηλεκτρονικού ταχυδρομείου και κειμένων απάτης. Μέχρι τον Απρίλιο του 2025, πάνω από τα μισά μηνύματα spam (51%) γράφτηκαν από τεχνητή νοημοσύνη, από σχεδόν μηδενικό δύο χρόνια πριν[6]. Ακόμη πιο ανησυχητικό, οι ερευνητές διαπίστωσαν ότι περίπου 14% των emails επιθέσεων BEC δημιουργήθηκαν με τεχνητή νοημοσύνη έως το 2025[7] - ένας αριθμός που αναμένεται να αυξηθεί καθώς οι εγκληματίες υιοθετούν εργαλεία όπως το ChatGPT. Ορισμένες μελέτες εκτιμούν πάνω από 80% των ηλεκτρονικών μηνυμάτων ηλεκτρονικού "ψαρέματος" μπορεί τώρα να έχουν τη βοήθεια της τεχνητής νοημοσύνης στη σύνταξή τους[8].

Ο όγκος αυτών των δολωμάτων που δημιουργούνται από τεχνητή νοημοσύνη έχει εκραγεί. Οι αναλύσεις ασφαλείας δείχνουν ότι οι επιθέσεις phishing που συνδέονται με τη γεννητική τεχνητή νοημοσύνη αυξήθηκαν κατά 1,265% σε σύντομο χρονικό διάστημα[9]. Σε μια περίοδο, οι αναφορές περιστατικών phishing αυξήθηκαν 466% σε ένα μόνο τρίμηνο, κυρίως λόγω των αυτοματοποιημένων κιτ phishing και των bots που διοχετεύουν προσαρμοσμένα δολώματα[9][10]. Γιατί τέτοια αύξηση; Επειδή η τεχνητή νοημοσύνη επιτρέπει στους επιτιθέμενους κλίμακα τις δραστηριότητές τους δραματικά. Ένας μόνο εγκληματίας μπορεί να χρησιμοποιήσει ένα AI chatbot για να δημιουργήσει χιλιάδες εξατομικευμένων μηνυμάτων ηλεκτρονικού ταχυδρομείου απάτης που απευθύνονται σε διαφορετικούς υπαλλήλους ή πελάτες, και όλα αυτά στον χρόνο που χρειαζόταν για να δημιουργηθεί ένα. Αυτή η μαζική αυτοματοποίηση οδήγησε το FBI να προειδοποιήσει ότι οι απώλειες BEC (οι οποίες ήταν ήδη $2,7 δισεκατομμύρια το 2022) θα επιταχυνθούν μόνο καθώς η τεχνητή νοημοσύνη "απειλεί να ωθήσει αυτές τις απώλειες ακόμη υψηλότερα"[11][12].

Όχι μόνο υπάρχουν περισσότερα ηλεκτρονικά μηνύματα ηλεκτρονικού "ψαρέματος", αλλά και αποτελεσματικότερο. Τα θύματα εξαπατώνται σε υψηλότερα ποσοστά από την εκλεπτυσμένη γλώσσα και τις λεπτομέρειες του περιβάλλοντος που μπορεί να ενσωματώσει η τεχνητή νοημοσύνη. Σε εργαστηριακές δοκιμές, τα ηλεκτρονικά μηνύματα phishing που γράφτηκαν με τεχνητή νοημοσύνη πέτυχαν 54% ρυθμός κλικ-μετάβασης - πολύ πάνω από το ~12% για τις παραδοσιακές απόπειρες phishing[13]. Αυτά τα μηνύματα διαβάζονται σαν γνήσιο στυλ του CEO ή αναφέρονται σε πραγματικά γεγονότα της εταιρείας, μειώνοντας την επιφυλακή των παραληπτών. Οι επιτιθέμενοι χρησιμοποιούν ακόμη και τεχνητή νοημοσύνη για να δοκιμάζουν διαφορετικές διατυπώσεις A/B και να επαναλαμβάνουν τα πιο επιτυχημένα αγκίστρια.[14]. Και σε αντίθεση με τους ανθρώπους, η τεχνητή νοημοσύνη δεν κάνει τυπογραφικά λάθη ούτε κουράζεται - μπορεί να εκτοξεύει ατελείωτες παραλλαγές μέχρι να περάσει μία από τα φίλτρα και να ξεγελάσει κάποιον.

Χαρακτηριστικό παράδειγμα: Στα μέσα του 2025, ένα Reuters η έρευνα αποκάλυψε πώς οι απατεώνες της Νοτιοανατολικής Ασίας χρησιμοποίησαν το ChatGPT για να αυτοματοποιήσουν τις επικοινωνίες απάτης[15]. Δημιούργησαν μαζικά πειστικά τραπεζικά μηνύματα ηλεκτρονικού ταχυδρομείου και κείμενα εξυπηρέτησης πελατών, αυξάνοντας κατά πολύ την εμβέλεια των σχεδίων τους. Η ευρωπαϊκή αστυνομία ανέφερε παρομοίως ότι κιτ phishing με βάση την τεχνητή νοημοσύνη πωλούνται στον σκοτεινό ιστό για λιγότερο από $20, επιτρέποντας σε φορείς με χαμηλή εξειδίκευση να ξεκινήσουν εξελιγμένες εκστρατείες[16][17]. Το εμπόδιο εισόδου για το BEC και το phishing έχει ουσιαστικά εξατμιστεί.

Αμυντικά μέτρα - Σταματώντας το AI Phish: Δεδομένης της επίθεσης, οι οργανισμοί πρέπει να οχυρώσουν τα κανάλια ηλεκτρονικού ταχυδρομείου και μηνυμάτων τους. Εδώ είναι που Ανίχνευση περιεχομένου AI μπορεί να βοηθήσει. Εργαλεία όπως Ανιχνευτής κειμένου AI της TruthScan και εξειδικευμένα σαρωτές ηλεκτρονικού ταχυδρομείου μπορεί να αναλύσει τα εισερχόμενα μηνύματα για τους στατιστικούς δείκτες κειμένου που έχει παραχθεί από τεχνητή νοημοσύνη. Για παράδειγμα, η Ανιχνευτής απάτης ηλεκτρονικού ταχυδρομείου TruthScan χρησιμοποιεί ανάλυση φυσικής γλώσσας για να επισημάνει τα μηνύματα ηλεκτρονικού ταχυδρομείου που πιθανότατα προέρχονται από τεχνητή νοημοσύνη, ακόμη και αν φαίνονται νόμιμα[18]. Αυτοί οι ανιχνευτές εξετάζουν πράγματα όπως η τέλεια γυαλισμένη γραμματική, η πολυπλοκότητα των προτάσεων και τα στιλομετρικά μοτίβα που είναι ασυνήθιστα για τους ανθρώπινους συγγραφείς. Με το σάρωση σε πραγματικό χρόνο, τα ύποπτα μηνύματα ηλεκτρονικού ταχυδρομείου μπορούν να τεθούν σε καραντίνα ή να επισημανθούν για επανεξέταση πριν φτάσουν στους χρήστες. Οι ομάδες ασφαλείας των επιχειρήσεων αρχίζουν να αναπτύσσουν τέτοια φίλτρα με βάση την τεχνητή νοημοσύνη στις πύλες ηλεκτρονικού ταχυδρομείου και στις πλατφόρμες ανταλλαγής μηνυμάτων. Στην πράξη, αυτό προσθέτει ένα νέο επίπεδο άμυνας πάνω από τα παραδοσιακά φίλτρα spam - το οποίο είναι ρητά ρυθμισμένο ώστε να συλλαμβάνει περιεχόμενο που έχει γραφτεί με τεχνητή νοημοσύνη. Από το 2025, οι κορυφαίες επιχειρήσεις ενσωματώνουν λύσεις όπως η TruthScan μέσω API στις ασφαλείς πύλες ηλεκτρονικού ταχυδρομείου και στις σουίτες συνεργασίας στο cloud, δημιουργώντας ένα αυτοματοποιημένο σημείο ελέγχου για Phishing που δημιουργείται από τεχνητή νοημοσύνη περιεχόμενο.

Deepfake Voice & Video Impersonation: Η απάτη "Βλέποντας εξαπατά"

Ίσως η πιο ενστικτώδης απειλή με γνώμονα την Τεχνητή Νοημοσύνη το 2025 είναι η άνοδος των deepfake επιθέσεις φωνής και βίντεο. Χρησιμοποιώντας μοντέλα Τεχνητής Νοημοσύνης, οι εγκληματίες μπορούν να κλωνοποιήσουν τη φωνή ενός ατόμου από μερικά δευτερόλεπτα ήχου ή να δημιουργήσουν ένα ρεαλιστικό βίντεο του προσώπου κάποιου από μια χούφτα φωτογραφίες. Αυτές οι βαθιές απομιμήσεις χρησιμοποιούνται ως όπλο για απάτες πλαστοπροσωπίας υψηλού κινδύνου - από απάτες με CEO ("ψεύτικες κλήσεις CEO") μέχρι ψεύτικες βιντεοδιασκέψεις και όχι μόνο. Μια πρόσφατη έκθεση του κλάδου αποκάλυψε 47% των οργανισμών έχουν βιώσει επιθέσεις deepfake κάποιου είδους[19]. Και δεν είναι μόνο θεωρητικό: πολλαπλές ληστείες το 2023-2025 έχουν αποδείξει ότι τα deepfakes μπορούν να νικήσουν τον απόλυτο έλεγχο ταυτότητας - τα ίδια μας τα μάτια και τα αυτιά.

Μια διαβόητη υπόθεση αφορούσε ένα διεθνές τραπεζικό έμβασμα ύψους $25 εκατομμύρια αφού ένας υπάλληλος εξαπατήθηκε από μια ψεύτικη τηλεδιάσκεψη. Οι επιτιθέμενοι χρησιμοποίησαν τεχνητή νοημοσύνη για να συνθέσουν το ομοίωμα της οικονομικής διευθύντριας της εταιρείας σε μια κλήση Zoom, με τη φωνή και τους τρόπους της, δίνοντας εντολή στον υπάλληλο να εμβάσει χρήματα[4][20]. Σε ένα άλλο περιστατικό στην Αυστραλία, μια τοπική κυβέρνηση έχασε $2,3 εκατομμύρια όταν οι απατεώνες παραποίησαν τόσο τη φωνή όσο και το βίντεο δημοτικών υπαλλήλων για να εγκρίνουν δόλιες πληρωμές[21]. Και το ανησυχητικό είναι ότι οι εγκληματίες χρησιμοποιούν φωνές που έχουν κλωνοποιηθεί με τεχνητή νοημοσύνη σε "απάτες με παππούδες" - καλούν ηλικιωμένους και υποδύονται τους συγγενείς τους που βρίσκονται σε κίνδυνο. Το FBI και FinCEN εξέδωσε προειδοποιήσεις στα τέλη του 2024 σχετικά με μια έξαρση της απάτης που χρησιμοποιεί Μέσα ενημέρωσης "deepfake" που δημιουργούνται από τεχνητή νοημοσύνη, συμπεριλαμβανομένων ψεύτικων πρακτόρων εξυπηρέτησης πελατών και συνθετικών ταυτοτήτων για την παράκαμψη των επαληθεύσεων KYC[22].

Η συχνότητα των εγκλημάτων που βασίζονται σε deepfake αυξάνεται με ταχείς ρυθμούς. Μέχρι το τέλος του 2024, μια ανάλυση έδειξε ότι μια νέα απάτη deepfake εμφανιζόταν κάθε πέντε λεπτά κατά μέσο όρο[23]. Μόνο το 1ο τρίμηνο του 2025, τα αναφερόμενα περιστατικά deepfake αυξήθηκαν κατά 19% σε σύγκριση με όλα του 2024[24][25]. Deepfakes τώρα αντιπροσωπεύουν ένα εκτιμώμενο 6,5% όλων των επιθέσεων απάτης, a 2,137% αύξηση από το 2022[26][27]. Η απαιτούμενη τεχνολογία έχει γίνει εύκολα προσβάσιμη - συχνά απαιτεί μόλις 30 δευτερόλεπτα ήχου για να κλωνοποιήσετε μια φωνή, ή κάτω από μια ώρα δειγματοληπτικού υλικού για να μοντελοποιήσετε πειστικά το πρόσωπο ενός ατόμου.[20]. Εν ολίγοις, ποτέ δεν ήταν ευκολότερο να "ψεύτικη" ταυτότητα ενός έμπιστου προσώπου και εξαπατούν τα θύματα για να τους παραδώσουν χρήματα ή πληροφορίες.

Αμυντικά μέτρα - Επικύρωση της πραγματικότητας: Για την αντιμετώπιση των απειλών deepfake, οι οργανισμοί στρέφονται σε προηγμένες ανίχνευση συνθετικών μέσων εργαλεία. Για παράδειγμα, Ανιχνευτής φωνής AI της TruthScan και Ανιχνευτής Deepfake TruthScan χρησιμοποιούν τεχνητή νοημοσύνη για την ανάλυση ήχου και βίντεο για ενδείξεις χειραγώγησης. Αυτά τα συστήματα εκτελούν ανάλυση καρέ-καρέ και κυματομορφής για να εντοπίσουν τεχνουργήματα όπως αφύσικες κινήσεις του προσώπου, προβλήματα συγχρονισμού των χειλιών ή φασματικές ανωμαλίες του ήχου που προδίδουν ένα κλιπ που έχει δημιουργηθεί με τεχνητή νοημοσύνη. Σε δοκιμές, οι αλγόριθμοι της TruthScan πέτυχαν 99%+ ακρίβεια στον εντοπισμό φωνών που παράγονται από τεχνητή νοημοσύνη και ανίχνευσε πειραγμένα καρέ βίντεο σε πραγματικό χρόνο[28][29]. Στην πραγματικότητα, οι ερευνητές του Κέντρου Ασφαλείας Genians χρησιμοποίησαν πρόσφατα την εγκληματολογία εικόνας του TruthScan για να αναλύσουν μια πλαστή ταυτότητα που χρησιμοποιήθηκε από χάκερς της Βόρειας Κορέας - ο ανιχνευτής εικόνας deepfake του TruthScan χαρακτήρισε το έγγραφο ως μη αυθεντικό με 98% εμπιστοσύνη, αποτρέποντας την απόπειρα spear-phishing[5][30].

Για την πρακτική άμυνα, οι επιχειρήσεις αναπτύσσουν αυτές τις δυνατότητες ανίχνευσης σε βασικά σημεία ασφυξίας. Φωνητική επαλήθευση προστίθεται στις ροές εργασίας του τηλεφωνικού κέντρου - π.χ. όταν ένας "πελάτης" ζητάει μια μεγάλη μεταφορά μέσω τηλεφώνου, ο ήχος μπορεί να περάσει από έναν ανιχνευτή φωνητικής απομίμησης για να διασφαλιστεί ότι πρόκειται πραγματικά για τον ίδιο (και όχι για μιμητή τεχνητής νοημοσύνης). Ομοίως, πλατφόρμες τηλεδιάσκεψης μπορεί να ενσωματώσει ζωντανή σάρωση deepfake των ροών βίντεο των συμμετεχόντων, για να εντοπίσει τυχόν συνθετικά πρόσωπα. Η σουίτα ανίχνευσης ψεύτικων εικόνων της TruthScan, για παράδειγμα, προσφέρει ανάλυση βιντεοκλήσεων σε πραγματικό χρόνο και έλεγχος ταυτότητας προσώπου που μπορούν να συνδεθούν στο Zoom ή στο WebEx μέσω API[31][29]. Αυτό σημαίνει ότι αν κάποιος προσπαθήσει να συμμετάσχει σε μια συνάντηση χρησιμοποιώντας ένα βίντεο που δημιούργησε η Τεχνητή Νοημοσύνη του Διευθύνοντος Συμβούλου σας, το σύστημα μπορεί να επισημάνει την "πιθανή βαθιά πλαστογράφηση" πριν γίνει οποιαδήποτε ζημιά. Επιπλέον, οι σημαντικές συναλλαγές περιλαμβάνουν πλέον συχνά ένα βήμα επαλήθευσης (εκτός ζώνης ή πολλαπλών παραγόντων) που μπορεί να αξιοποιήσει την αυθεντικοποίηση περιεχομένου - π.χ. απαιτώντας μια σύντομη προφορική επιβεβαίωση που στη συνέχεια ελέγχεται από έναν ανιχνευτή φωνής AI για αυθεντικότητα. Με τη διαστρωμάτωση αυτών των εργαλείων, οι εταιρείες δημιουργούν ένα δίχτυ ασφαλείας: ακόμη και αν οι εργαζόμενοι βλέπε ή ακούστε κάτι αληθοφανές, μια εγκληματολογική εξέταση της ΤΝ θα αμφισβητήσει την πραγματικότητά της. Σε ένα τοπίο απειλών που διαπερνάται από την Τεχνητή Νοημοσύνη, "Μην εμπιστεύεστε - επαληθεύστε" γίνεται το μάντρα για κάθε φωνητική ή βιντεοσκοπημένη επικοινωνία που αφορά χρήματα ή ευαίσθητη πρόσβαση.

AI-Crafted Malware & Obfuscated Code: Κώδικας: Εξελισσόμενες απειλές στον κώδικα

Η επιρροή της Τεχνητής Νοημοσύνης δεν περιορίζεται στην κοινωνική μηχανική - αλλάζει επίσης το παιχνίδι στην ανάπτυξη κακόβουλου λογισμικού και στον κώδικα επιθέσεων διαφυγής. Το 2025, η Threat Intelligence Group της Google αποκάλυψε το τα πρώτα στελέχη κακόβουλου λογισμικού που χρησιμοποιούν τεχνητή νοημοσύνη κατά τη διάρκεια του εκτέλεση για να αλλάξει η συμπεριφορά τους[32][33]. Ένα παράδειγμα, που ονομάστηκε PROMPTFLUX, ήταν ένα κακόβουλο σενάριο που στην πραγματικότητα καλούσε ένα API AI (το μοντέλο Gemini της Google) για να να ξαναγράφει τον δικό του κώδικα εν κινήσει, παράγοντας νέες παραλλαγές με συγκεκαλυμμένες παραλλαγές για να αποφύγει την ανίχνευση από ιούς προστασίας από ιούς[34][35]. Αυτή η "just-in-time" εξέλιξη της ΤΝ σηματοδοτεί ένα άλμα προς το αυτόνομο, πολυμορφικό κακόβουλο λογισμικό. Ένα άλλο δείγμα, PROMPTSTEAL, χρησιμοποίησε έναν βοηθό κωδικοποίησης ΤΝ για τη δημιουργία εντολών μιας γραμμής για τα Windows για την κλοπή δεδομένων, αναθέτοντας ουσιαστικά τμήματα της λογικής του σε μια μηχανή ΤΝ σε πραγματικό χρόνο[36][37]. Αυτές οι καινοτομίες δείχνουν ένα μέλλον όπου το κακόβουλο λογισμικό θα μπορεί να μεταμορφώνεται συνεχώς - όπως ένας ανθρώπινος δοκιμαστής διείσδυσης - για να νικήσει τις άμυνες.

Ακόμα και χωρίς τεχνητή νοημοσύνη εν κινήσει, οι επιτιθέμενοι χρησιμοποιούν την τεχνητή νοημοσύνη κατά τη διάρκεια της ανάπτυξης για να δημιουργήσουν πιο ισχυρό κακόβουλο κώδικα. Η δημιουργική ΤΝ μπορεί να παράγει κακόβουλο λογισμικό που είναι ιδιαίτερα συγκεχυμένη, που περιέχουν στρώματα μπερδεμένης λογικής που εμποδίζουν την αντίστροφη μηχανική. Σύμφωνα με αναφορές πληροφοριών για απειλές, πάνω από 70% των μεγάλων παραβιάσεων το 2025 αφορούσαν κάποια μορφή πολυμορφικού κακόβουλου λογισμικού που αλλάζει την υπογραφή ή τη συμπεριφορά του για να αποφύγει την ανίχνευση[38]. Επιπλέον, 76% των εκστρατειών phishing χρησιμοποιούν πλέον πολυμορφικές τακτικές, όπως δυναμικές διευθύνσεις URL ή AI-rewritten payloads[38]. Εργαλεία όπως οι προσφορές dark-web WormGPT και FraudGPT (απεριόριστοι κλώνοι του ChatGPT) επιτρέπουν ακόμη και σε μη ειδικούς να παράγουν droppers κακόβουλου λογισμικού, keyloggers ή κώδικα ransomware περιγράφοντας απλά τι θέλουν.[39]. Το αποτέλεσμα είναι μια πληθώρα νέων παραλλαγών κακόβουλου λογισμικού. Για παράδειγμα, το 2024 ένας κλέφτης πληροφοριών με την ονομασία BlackMamba προέκυψε ότι ήταν εξ ολοκλήρου τεχνητή νοημοσύνη, χρησιμοποιώντας το ChatGPT για να γράφει τον κώδικά του σε τμήματα - κάθε εκτέλεση παρήγαγε ένα ελαφρώς διαφορετικό δυαδικό αρχείο, μπερδεύοντας τα παραδοσιακά antivirus που βασίζονται σε υπογραφές[38]. Οι ερευνητές ασφαλείας κατέδειξαν επίσης πολυμορφικές αποδείξεις που δημιουργούνται με τεχνητή νοημοσύνη και θα μπορούσαν να παρακάμψουν πολλές προστασίες τελικών σημείων[40].

Επιπλέον, οι επιτιθέμενοι αξιοποιούν την Τεχνητή Νοημοσύνη για να βελτιώσουν τις παράδοση του κακόβουλου λογισμικού. Η ΤΝ μπορεί να συντάσσει έξυπνα σενάρια ηλεκτρονικών μηνυμάτων ηλεκτρονικού "ψαρέματος" (όπως αναφέρθηκε) που φέρουν συνδέσμους κακόβουλου λογισμικού. Μπορεί επίσης να βοηθήσει στην ανάπτυξη exploits - π.χ. χρησιμοποιώντας AI για την εύρεση νέων ευπαθειών ή τη βελτιστοποίηση shellcode. Οι εθνικοί κρατικοί φορείς φέρονται να έχουν χρησιμοποιήσει προηγμένα μοντέλα ΤΝ για να βοηθήσουν στην ανακάλυψη exploits μηδενικής ημέρας και στην ανάπτυξη προσαρμοσμένου κακόβουλου λογισμικού για στόχους.[41]. Όλες αυτές οι τάσεις σημαίνουν ότι το κακόβουλο λογισμικό το 2025 θα είναι πιο αθόρυβο και πιο προσαρμοστικό. Είναι συχνά "συν-δημιουργείται" με την ΤΝ, γεγονός που καθιστά δυσκολότερο τον εντοπισμό του με τη χρήση συμβατικών κανόνων.

Αμυντικά μέτρα - Τεχνητή νοημοσύνη εναντίον τεχνητής νοημοσύνης στην άμυνα κακόβουλου λογισμικού: Η άμυνα κατά του κακόβουλου λογισμικού που έχει δημιουργηθεί με τεχνητή νοημοσύνη απαιτεί έναν συνδυασμό προηγμένης ανίχνευσης και ανάλυσης με τεχνητή νοημοσύνη στην αμυντική πλευρά. Πολλοί οργανισμοί ενισχύουν τις προστασία τελικών σημείων και EDR (Endpoint Detection & Response) με μοντέλα AI/ML που αναζητούν τα μοτίβα συμπεριφοράς του κώδικα που παράγεται από AI. Για παράδειγμα, ξαφνικοί μετασχηματισμοί κώδικα εντός του υπολογιστή ή ασυνήθιστα μοτίβα κλήσεων API μπορεί να υποδεικνύουν κάτι σαν το PROMPTFLUX που αναγεννιέται. Ομοίως, η παρακολούθηση δικτύου μπορεί να εντοπίσει ανωμαλίες όπως κακόβουλο λογισμικό που φτάνει σε υπηρεσίες ΤΝ (κάτι που δεν είναι "φυσιολογικό" για εφαρμογές χρηστών). Οι πωλητές εκπαιδεύουν ανιχνευτές που βασίζονται σε ML στο οικογένειες των κακόβουλων λογισμικών που έχουν εντοπιστεί μέχρι στιγμής, βελτιώνοντας την αναγνώριση αυτών των νέων απειλών.

Μια αναδυόμενη λύση είναι ολοκληρωμένη σάρωση περιεχομένου AI σε αγωγούς ανάπτυξης και κατασκευής. Αυτό σημαίνει τη χρήση ανιχνευτών με βάση την τεχνητή νοημοσύνη για την ανάλυση σεναρίων, δημιουργιών λογισμικού ή ακόμη και αλλαγών ρυθμίσεων για κακόβουλο ή τεχνητής νοημοσύνης περιεχόμενο. Για παράδειγμα, Ανιχνευτής πραγματικού χρόνου της TruthScan μπορεί να αναπτυχθεί πέραν του κειμένου - η πολυτροπική του ανάλυση μπορεί ενδεχομένως να επισημάνει ύποπτο κώδικα ή αρχεία ρυθμίσεων αναγνωρίζοντας αν δημιουργήθηκαν από μηχανήματα με μοτίβα συσκοτίσεων.[42][43]. Οι ομάδες ανάπτυξης και οι MSSPs αρχίζουν να σαρώνουν τα σενάρια infrastructure-as-code, τα αρχεία καταγραφής PowerShell και άλλα αντικείμενα για ενδείξεις τμημάτων γραμμένων με τεχνητή νοημοσύνη που θα μπορούσαν να υποδηλώνουν το χέρι ενός επιτιθέμενου. Αν και πρόκειται για έναν εκκολαπτόμενο τομέα, δείχνει πολλά υποσχόμενο: σε μια περίπτωση, μια ομάδα ασφαλείας χρησιμοποίησε έναν ανιχνευτή AI για να εντοπίσει ένα συγκεκαλυμμένο αρχείο phishing kit που "έμοιαζε" να έχει δημιουργηθεί από AI και ήταν πράγματι μέρος μιας επίθεσης[44]. Ο κώδικας του αρχείου ήταν υπερβολικά πολύπλοκος και πολυλογάς (χαρακτηριστικά γνωρίσματα της δημιουργίας AI) και μια σάρωση του περιεχομένου με AI επιβεβαίωσε την υψηλή πιθανότητα να μην είναι ανθρώπινης γραφής.[40].

Τέλος, η ανταλλαγή πληροφοριών σχετικά με απειλές με επίκεντρο τις απειλές ΤΝ είναι ζωτικής σημασίας. Όταν η Google GTIG δημοσιεύει λεπτομέρειες για κακόβουλο λογισμικό που βασίζεται σε Prompt ή όταν οι ερευνητές αναφέρουν νέες τεχνικές αποφυγής της τεχνητής νοημοσύνης, οι οργανισμοί θα πρέπει να τις τροφοδοτούν στη μηχανική ανίχνευσής τους. Ανάλυση συμπεριφοράς - αναζητώντας ενέργειες, όπως μια διεργασία που γεννά ένα σενάριο που ξαναγράφει τον κώδικα της ίδιας διεργασίας - μπορεί να εντοπίσει ανωμαλίες που εμφανίζει το κακόβουλο λογισμικό που υποστηρίζεται από τεχνητή νοημοσύνη. Εν ολίγοις, οι αμυντικοί πρέπει να αντιμετωπίσουν τη φωτιά με φωτιά: να αναπτύξουν Εργαλεία ασφαλείας με βάση την τεχνητή νοημοσύνη που μπορούν να προσαρμοστούν τόσο γρήγορα όσο και το κακόβουλο λογισμικό με βάση την Τεχνητή Νοημοσύνη. Αυτό περιλαμβάνει τα πάντα, από ενισχυμένα με τεχνητή νοημοσύνη antivirus μέχρι αναλύσεις της συμπεριφοράς των χρηστών που μπορούν να εντοπίσουν πότε ένας λογαριασμός ή ένα σύστημα αρχίζει να συμπεριφέρεται "όχι αρκετά ανθρώπινα". Με την υιοθέτηση της AI για την άμυνα, οι ομάδες ασφαλείας μπορούν να αντιμετωπίσουν τα πλεονεκτήματα ταχύτητας και κλίμακας που παρέχει η AI στους επιτιθέμενους.

Συνθετικές ταυτότητες και συστήματα απάτης που τροφοδοτούνται από την τεχνητή νοημοσύνη

Από το κακόβουλο λογισμικό στον κόσμο της απάτης: απάτη με συνθετική ταυτότητα έχει εκραγεί με τη βοήθεια της δημιουργικής τεχνητής νοημοσύνης. Η συνθετική απάτη ταυτότητας περιλαμβάνει τη δημιουργία πλασματικών προσωπικοτήτων με το συνδυασμό πραγματικών και πλαστών δεδομένων (π.χ. πραγματικό SSN + ψεύτικο όνομα και έγγραφα). Αυτές οι ταυτότητες "Φρανκενστάιν" χρησιμοποιούνται στη συνέχεια για να ανοίξουν τραπεζικούς λογαριασμούς, να υποβάλουν αίτηση για πίστωση ή να περάσουν τους ελέγχους KYC - με τελικό αποτέλεσμα να καταλήγουν σε απλήρωτα δάνεια ή ξέπλυμα χρήματος. Ήταν ήδη ένας από τους ταχύτερα αναπτυσσόμενους τύπους απάτης, και η τεχνητή νοημοσύνη έχει τώρα ρίξει λάδι στη φωτιά. Απώλειες από απάτη με συνθετική ταυτότητα ξεπέρασε τα $35 δισεκατομμύρια το 2023[45], και μέχρι τις αρχές του 2025 ορισμένες εκτιμήσεις έδειχναν σχεδόν 25% όλων των απωλειών τραπεζικής απάτης οφείλονταν σε συνθετικές ταυτότητες[46]. Οι αναλυτές της Experian διαπίστωσαν ότι πάνω από 80% απάτες σε νέους λογαριασμούς σε ορισμένες αγορές συνδέεται πλέον με συνθετικές ταυτότητες[19] - ένα συγκλονιστικό στατιστικό στοιχείο που υπογραμμίζει πόσο διαδεδομένη είναι αυτή η απάτη.

Η δημιουργική τεχνητή νοημοσύνη ενισχύει τη συνθετική απάτη με διάφορους τρόπους. Πρώτον, η τεχνητή νοημοσύνη καθιστά τετριμμένη την παραγωγή των "έγγραφα αναπαραγωγής" και τα ψηφιακά αποτυπώματα που απαιτούνται για την πώληση ψεύτικης ταυτότητας. Στο παρελθόν, ένας απατεώνας μπορούσε να φτιάξει με Photoshop μια ταυτότητα ή να δημιουργήσει χειροκίνητα πλαστούς λογαριασμούς κοινής ωφέλειας. Τώρα, υπάρχουν εργαλεία για τη δημιουργία αυθεντικές φωτογραφίες προφίλ, ταυτότητες, διαβατήρια, τραπεζικές δηλώσεις, ακόμη και προφίλ στα μέσα κοινωνικής δικτύωσης χρησιμοποιώντας γεννήτριες εικόνων τεχνητής νοημοσύνης και γλωσσικά μοντέλα[47][48]. Για παράδειγμα, μπορεί κανείς να χρησιμοποιήσει μια τεχνητή νοημοσύνη για να δημιουργήσει μια ρεαλιστική φωτογραφία κεφαλής ενός ατόμου που δεν υπάρχει (αποτρέποντας την εύκολη αναζήτηση αντίστροφης εικόνας) και να δημιουργήσει μια αντίστοιχη ψεύτικη άδεια οδήγησης με αυτή τη φωτογραφία. Η τεχνητή νοημοσύνη μπορεί επίσης να προσομοιώσει τα "σημεία ζωής" μιας ταυτότητας - π.χ. δημιουργώντας αρχεία συνθετικών γονέων, διευθύνσεων ή αναρτήσεων στα μέσα κοινωνικής δικτύωσης για να δώσει σάρκα και οστά σε μια ιστορική αναδρομή[49]. Η Fed της Βοστώνης σημείωσε ότι η Gen AI μπορεί ακόμη και να παράγει deepfake ήχου και βίντεο ενός ψεύτικου ατόμου - για παράδειγμα, ένας συνθετικός χρήστης θα μπορούσε να "εμφανιστεί" σε ένα βίντεο επαλήθευσης selfie, με μοναδικό πρόσωπο και φωνή, όλα δημιουργημένα από τεχνητή νοημοσύνη.[50].

Δεύτερον, η τεχνητή νοημοσύνη βοηθά τους απατεώνες αύξηση της κλίμακας τις δραστηριότητές τους. Αντί να πλαστογραφούν μία ή δύο ταυτότητες κάθε φορά, μπορούν να δημιουργήσουν με προγραμματισμό εκατοντάδες ή χιλιάδες πλήρη πακέτα ταυτότητας και να συμπληρώσουν μαζικά τις αιτήσεις νέων λογαριασμών.[51][52]. Ορισμένες υπηρεσίες σκοτεινού ιστού προσφέρουν αποτελεσματικά "Συνθετικές ταυτότητες ως υπηρεσία", χρησιμοποιώντας αυτοματισμούς για να βγάζει επαληθευμένους λογαριασμούς προς πώληση. Κατά τη διάρκεια των προγραμμάτων ανακούφισης από την πανδημία COVID-19, για παράδειγμα, οι εγκληματίες χρησιμοποίησαν bots με ταυτότητες που δημιουργήθηκαν με τεχνητή νοημοσύνη για να υποβάλουν μαζικά αιτήσεις για δάνεια και παροχές, κατακλύζοντας το σύστημα με ψεύτικους αιτούντες. Όπως προβλέπει η Juniper Research, το παγκόσμιο κόστος της ψηφιακής απάτης ταυτότητας (που τροφοδοτείται από αυτές τις τακτικές) θα αύξηση 153% έως το 2030 σε σύγκριση με το 2025[53].

Αμυντικά μέτρα - Επαλήθευση της ταυτότητας σε έναν κόσμο τεχνητής νοημοσύνης: Οι παραδοσιακές μέθοδοι απόδειξης της ταυτότητας δυσκολεύονται να αντιμετωπίσουν τα ψεύτικα προϊόντα που δημιουργούνται με τεχνητή νοημοσύνη. Για να προσαρμοστούν, οι οργανισμοί υιοθετούν πολυεπίπεδη επαλήθευση ταυτότητας και συμπεριφοράς ενισχυμένη από την τεχνητή νοημοσύνη. Ένα βασικό επίπεδο είναι το προηγμένο εγκληματολογία εγγράφων και εικόνων. Για παράδειγμα, Ανιχνευτής εικόνας AI της TruthScan και Ανιχνευτής πλαστών εγγράφων παρέχουν τη δυνατότητα ανάλυσης των αναρτημένων ταυτοτήτων, selfies ή εγγράφων για σημάδια σύνθεσης ή παραποίησης. Αυτά τα εργαλεία εξετάζουν τεχνουργήματα σε επίπεδο εικονοστοιχείου, ασυνέπειες φωτισμού και μεταδεδομένα για να καθορίσουν αν μια εικόνα έχει δημιουργηθεί ή χειραγωγηθεί από τεχνητή νοημοσύνη. Μπορούν να εντοπίσουν ανεπαίσθητες ενδείξεις - όπως πανομοιότυπα μοτίβα φόντου από φωτογραφίες που έχουν παραχθεί με GAN ή γραμματοσειρές και διαστήματα σε μια ταυτότητα που δεν ταιριάζουν με κανένα γνωστό κυβερνητικό πρότυπο. Με την ανάπτυξη τέτοιων ανιχνευτών κατά την εγγραφή, οι τράπεζες μπορούν να επισημάνουν αυτόματα την άδεια οδήγησης ή τη selfie ενός αιτούντος αν είναι πιθανό να έχει δημιουργηθεί από τεχνητή νοημοσύνη (για παράδειγμα, το σύστημα TruthScan θα είχε επισημάνει την πλαστή στρατιωτική ταυτότητα που χρησιμοποιήθηκε στην υπόθεση phishing της Kimsuky APT).[5]). Σύμφωνα με ένα δελτίο τύπου της TruthScan, η πλατφόρμα τους έχει χρησιμοποιηθεί από χρηματοπιστωτικά ιδρύματα για την επικύρωση της γνησιότητας εγγράφων σε κλίμακα, εντοπίζοντας βαθιές απομιμήσεις με εξαιρετικά υψηλή ακρίβεια[54].

Ένα άλλο στρώμα είναι ανάλυση συμπεριφοράς και ελέγχους διασταυρώσεων. Οι πραγματικές ταυτότητες έχουν βάθος - πολυετές ιστορικό, δημόσια αρχεία, δραστηριότητα στα μέσα κοινωνικής δικτύωσης κ.λπ. Οι ταυτότητες που δημιουργούνται με τεχνητή νοημοσύνη, όσο γυαλισμένες και αν είναι, συχνά δεν έχουν αυτές τις βαθιές ρίζες. Οι τράπεζες και οι δανειστές χρησιμοποιούν πλέον την ΤΝ για τη διασταύρωση των δεδομένων των αιτήσεων με δημόσια και ιδιόκτητα δεδομένα: Ο αριθμός τηλεφώνου και το email αυτού του ατόμου δείχνουν ιστορικό χρήσης; Βγάζει νόημα η γεωγραφική θέση της συσκευής ή της IP; Πληκτρολογεί δεδομένα σε φόρμες με ανθρώπινο τρόπο ή με copy-paste (όπως κάνουν τα bots); Τα μοντέλα τεχνητής νοημοσύνης μπορούν να εκπαιδευτούν ώστε να διακρίνουν τη γνήσια συμπεριφορά των πελατών από τα συνθετικά πρότυπα. Η Ομοσπονδιακή Τράπεζα των ΗΠΑ σημείωσε ότι "Οι συνθετικές ταυτότητες είναι ρηχές και η τεχνητή νοημοσύνη μπορεί να το δει αυτό" - Η επαλήθευση με βάση την τεχνητή νοημοσύνη μπορεί να αναζητήσει γρήγορα το ψηφιακό αποτύπωμα μιας ταυτότητας και να σημάνει συναγερμό εάν δεν βρεθεί κανένα ή ελάχιστο από αυτά.[55]. Στην πράξη, οι υπηρεσίες επαλήθευσης ταυτότητας χρησιμοποιούν πλέον τεχνητή νοημοσύνη που ελέγχει αν η selfie ενός χρήστη ταιριάζει με προηγούμενες φωτογραφίες (για να ανιχνεύσει ανταλλαγές προσώπων) και ακόμη και προτρέπει τους χρήστες με τυχαίες ενέργειες (όπως συγκεκριμένες πόζες ή φράσεις) κατά τη διάρκεια των ελέγχων ζωντάνιας, καθιστώντας δυσκολότερη τη σωστή ανταπόκριση των deepfakes.[56][57].

Τέλος, συνεχής παρακολούθηση της συμπεριφοράς του λογαριασμού μετά την εγγραφή βοηθάει στον εντοπισμό συνθετικών λογαριασμών που ξεγλίστρησαν. Δεδομένου ότι αυτοί οι λογαριασμοί δεν συνδέονται με μια πραγματική προσωπικότητα, τα μοτίβα χρήσης τους συχνά τελικά ξεχωρίζουν (π.χ. πραγματοποίηση απόλυτα συγχρονισμένων συναλλαγών για τη δημιουργία πίστωσης και στη συνέχεια εξάντληση του μέγιστου ποσού). Η παρακολούθηση της απάτης με βάση την τεχνητή νοημοσύνη (όπως οι πλατφόρμες της Sift ή της Feedzai) μπορεί να εντοπίσει ανωμαλίες στον τρόπο χρήσης των λογαριασμών, επισημαίνοντας πιθανά συνθετικά για επανεξέταση. Συνοπτικά, η καταπολέμηση της απάτης ταυτότητας με τεχνητή νοημοσύνη απαιτεί Απόδειξη ταυτότητας με χρήση τεχνητής νοημοσύνης - που συνδυάζει εγκληματολογία εγγράφων, βιομετρικούς ελέγχους, συσχέτιση δεδομένων και ανάλυση συμπεριφοράς. Τα καλά νέα είναι ότι οι ίδιες εξελίξεις της τεχνητής νοημοσύνης που επιτρέπουν την απάτη χρησιμοποιούνται επίσης για τον εντοπισμό της. Η TruthScan, για παράδειγμα, προσφέρει ένα σουίτα επαλήθευσης ταυτότητας που ενσωματώνει ανάλυση κειμένου, εικόνας και φωνής για την εξέταση νέων χρηστών. Αξιοποιώντας αυτά τα εργαλεία, μια μεγάλη τράπεζα σημείωσε σημαντική μείωση των επιτυχημένων συνθετικών ανοιγμάτων λογαριασμών, ακόμη και όταν οι μέσοι όροι του κλάδου αυξάνονταν. Η κούρσα των εξοπλισμών συνεχίζεται, αλλά οι υπερασπιστές μαθαίνουν να εντοπίζουν τις αμυδρές "ψηφιακές μαρτυρίες" ενός συνθετικού λογαριασμού, ανεξάρτητα από το πόσο καλά η τεχνητή νοημοσύνη προσπαθεί να καλύψει τα ίχνη της.

Ενσωμάτωση της ανίχνευσης AI σε όλη τη στοίβα ασφαλείας

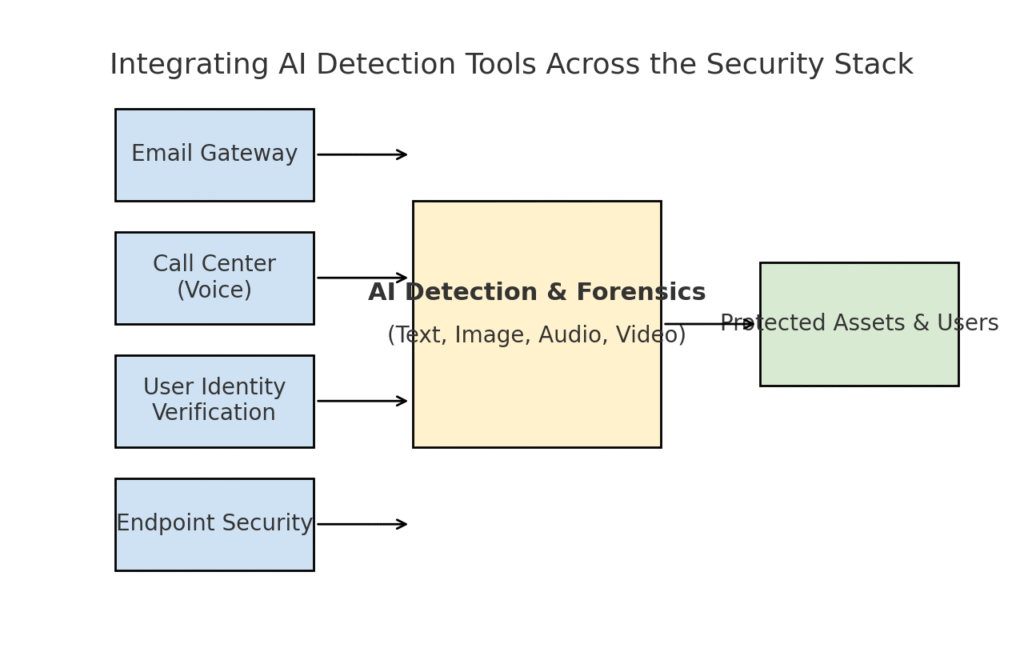

Έχουμε διερευνήσει διάφορους ξεχωριστούς τομείς απειλών - phishing, deepfakes, κακόβουλο λογισμικό, συνθετική απάτη - όλοι ενισχυμένοι από την τεχνητή νοημοσύνη. Είναι σαφές ότι δεν υπάρχει ένα μόνο εργαλείο ή μια εφάπαξ λύση θα λύσει την πρόκληση. Αντίθετα, οι επιχειρήσεις χρειάζονται μια ολοκληρωμένη στρατηγική για ενσωμάτωση ανίχνευσης και επαλήθευσης με τεχνητή νοημοσύνη σε κάθε επίπεδο της στοίβας κυβερνοασφάλειας. Η προσέγγιση πρέπει να αντικατοπτρίζει την επιφάνεια επίθεσης, καλύπτοντας το ηλεκτρονικό ταχυδρομείο, το διαδίκτυο, τη φωνή, τα έγγραφα, την ταυτότητα και όχι μόνο. Το παρακάτω διάγραμμα απεικονίζει πώς οι οργανισμοί μπορούν να ενσωματώσουν τα εργαλεία ανίχνευσης AI της TruthScan (και παρόμοιες λύσεις) σε κοινά επίπεδα ασφάλειας της επιχείρησης:

Ενσωμάτωση εργαλείων ανίχνευσης ΤΝ σε πολλαπλά επίπεδα της στοίβας ασφαλείας - από πύλες ηλεκτρονικού ταχυδρομείου και τηλεφωνικά κέντρα έως την επαλήθευση χρηστών και την προστασία τελικών σημείων. Η ανίχνευση περιεχομένου AI (κέντρο) αναλύει κείμενο, εικόνες, ήχο και βίντεο σε πραγματικό χρόνο, τροφοδοτώντας τα σημεία επιβολής που προστατεύουν περιουσιακά στοιχεία και χρήστες.

Σε αυτό το μοντέλο, οι πολυτροπικοί ανιχνευτές ΤΝ λειτουργούν ως κεντρικός εγκέφαλος που διασυνδέεται με διάφορους ελέγχους ασφαλείας:

- Πύλες ηλεκτρονικού ταχυδρομείου: Τα εισερχόμενα μηνύματα ηλεκτρονικού ταχυδρομείου περνούν από έναν ανιχνευτή κειμένου/απάτης τεχνητής νοημοσύνης πριν φτάσουν στα εισερχόμενα μηνύματα. Αυτό συνδέεται με την άμυνα phishing που συζητήσαμε - π.χ. χρησιμοποιώντας Ανιχνευτής απάτης ηλεκτρονικού ταχυδρομείου της TruthScan μέσω API στον πάροχο ηλεκτρονικού ταχυδρομείου σας για την αυτόματη καραντίνα ύποπτων μηνυμάτων ηλεκτρονικού ταχυδρομείου που δημιουργούνται από Τεχνητή Νοημοσύνη[18]. Μπορεί επίσης να εφαρμοστεί σε πλατφόρμες ανταλλαγής μηνυμάτων (εφαρμογές συνομιλίας, πύλες SMS) για τη σάρωση περιεχομένου για μοτίβα phishing ή απάτης.

- Τηλεφωνικά κέντρα και φωνητικά συστήματα: Τα τηλεφωνικά κανάλια και τα κανάλια VOIP εξασφαλίζονται με την ενσωμάτωση της ανίχνευσης φωνητικής πλαστογράφησης. Για παράδειγμα, η γραμμή υποστήριξης πελατών μιας τράπεζας θα μπορούσε να χρησιμοποιήσει Ανιχνευτής φωνής AI της TruthScan να αναλύει τον ήχο εισερχόμενων κλήσεων σε πραγματικό χρόνο και να ειδοποιεί εάν το φωνητικό αποτύπωμα ενός καλούντος είναι συνθετικό ή δεν ταιριάζει με το γνωστό προφίλ του.[58][59]. Αυτό συμβάλλει στην αποτροπή της επιτυχίας των επιθέσεων vishing και φωνητικής μίμησης (όπως οι ψεύτικες κλήσεις CEO).

- Διαδικασίες επαλήθευσης ταυτότητας χρήστη: Κατά τη δημιουργία λογαριασμού ή τις ενέργειες υψηλού κινδύνου του χρήστη (επαναφορά κωδικού πρόσβασης, εμβάσματα), η επαλήθευση ταυτότητας με βάση την τεχνητή νοημοσύνη ενεργοποιείται. Μια αναγνωριστική φωτογραφία που έχει μεταφορτωθεί ελέγχεται από ένα εργαλείο εγκληματολογίας εικόνας (π.χ. ελέγχοντας αν είναι προϊόν τεχνητής νοημοσύνης ή φωτογραφία μιας φωτογραφίας) και μια selfie ή μια βιντεοκλήση ελέγχεται από έναν ανιχνευτή βαθιάς απομίμησης. Το TruthScan Ανιχνευτής Deepfake μπορεί να χρησιμοποιηθεί εδώ για την εκτέλεση ελέγχου ταυτότητας προσώπου - διασφαλίζοντας ότι το πρόσωπο στην κάμερα είναι πραγματικό και ταιριάζει με την ταυτότητα[60][61]. Σήματα συμπεριφοράς (συχνότητα πληκτρολόγησης, συνέπεια συσκευής) μπορούν επίσης να τροφοδοτηθούν σε μοντέλα τεχνητής νοημοσύνης για τον εντοπισμό bots ή συνθετικών ταυτοτήτων.

- Τελικά σημεία και δίκτυο: Οι πράκτορες ασφαλείας τελικών σημείων και οι διακομιστές μεσολάβησης μπορούν να ενσωματώσουν ανάλυση περιεχομένου AI για αρχεία και δέσμες ενεργειών. Για παράδειγμα, εάν ένα EDR τελικού σημείου δει ένα νέο script ή EXE να εκτελείται, θα μπορούσε να στείλει το περιεχόμενο κειμένου του αρχείου σε έναν ανιχνευτή ΤΝ για να ελέγξει εάν μοιάζει με γνωστό κακόβουλο λογισμικό που παράγεται από ΤΝ ή παρουσιάζει χαρακτηριστικά συγκεκαλυμμένου κώδικα ΤΝ. Ομοίως, τα συστήματα DLP (πρόληψη απώλειας δεδομένων) θα μπορούσαν να χρησιμοποιήσουν την ανίχνευση κειμένου AI για να επισημάνουν το ευαίσθητο κείμενο που έχει παραχθεί με AI (το οποίο θα μπορούσε να υποδεικνύει ότι ένας εσωτερικός χρήστης χρησιμοποιεί AI για τη σύνταξη μηνυμάτων διαρροής δεδομένων ή την παραποίηση αναφορών). Το TruthScan Ανιχνευτής πραγματικού χρόνου έχει σχεδιαστεί για να συνδέεται σε τέτοιες ροές εργασίας, προσφέροντας ζωντανή ανάλυση περιεχομένου σε όλες τις πλατφόρμες με αυτοματοποιημένες επιλογές απόκρισης.[42][62] (για παράδειγμα, αυτόματο μπλοκάρισμα ενός αρχείου ή μηνύματος, αν αυτό αναγνωριστεί ως κακόβουλο λογισμικό ή παραπληροφόρηση που δημιουργήθηκε από τεχνητή νοημοσύνη).

Το βασικό πλεονέκτημα αυτής της ολοκληρωμένης προσέγγισης είναι ταχύτητα και συνέπεια. Οι επιθέσεις τεχνητής νοημοσύνης κινούνται γρήγορα - τα ηλεκτρονικά μηνύματα phishing, οι ψεύτικες φωνές και τα συνθετικά δεδομένα μπορούν να χτυπήσουν πολλά κανάλια ταυτόχρονα. Με την ενορχήστρωση όλων αυτών των καναλιών με ανίχνευση AI, ένας οργανισμός αποκτά ορατότητα σε πραγματικό χρόνο και άμυνα σε βάθος. Μια ομάδα το περιέγραψε ως τη δημιουργία ενός "ανοσοποιητικού συστήματος AI" για την επιχείρησή της: κάθε φορά που επικοινωνείται κάτι (είτε πρόκειται για ένα email, ένα upload εγγράφου, μια φωνητική κλήση κ.λπ.), το ανοσοποιητικό σύστημα AI το "μυρίζει" για ξένες (παραγόμενες από την AI) υπογραφές και το εξουδετερώνει αν βρεθεί κακόβουλο.

Η επιχειρησιακή σουίτα της TruthScan αποτελεί παράδειγμα αυτού, καθώς προσφέρει ένα ενοποιημένη πλατφόρμα που καλύπτει την ανίχνευση κειμένου, εικόνας, ήχου και βίντεο Τεχνητής Νοημοσύνης, η οποία μπορεί να αναπτυχθεί αρθρωτά ή στο σύνολό της.[63][64]. Πολλές εταιρείες ξεκινούν με την ανάπτυξη μίας ή δύο δυνατοτήτων (π.χ. ανίχνευση κειμένου στο ηλεκτρονικό ταχυδρομείο και ανίχνευση εικόνας στο onboarding) και στη συνέχεια επεκτείνονται και σε άλλες μόλις διαπιστώσουν την αξία τους. Σημαντικό είναι ότι η ενσωμάτωση γίνεται φιλική προς τους προγραμματιστές - Το TruthScan και παρόμοιες υπηρεσίες παρέχουν API και SDK, έτσι ώστε οι ομάδες ασφαλείας να μπορούν να συνδέσουν την ανίχνευση σε υπάρχοντα συστήματα χωρίς μαζική επανασχεδίαση. Είτε πρόκειται για ένα SIEM, μια πύλη ηλεκτρονικού ταχυδρομείου, μια προσαρμοσμένη τραπεζική εφαρμογή ή ένα σύστημα CRM, η ανίχνευση μπορεί να εκτελείται παρασκηνιακά και να τροφοδοτεί ειδοποιήσεις ή αυτοματοποιημένες ενέργειες. Για παράδειγμα, μια μεγάλη πλατφόρμα μέσων κοινωνικής δικτύωσης ενσωμάτωσε APIs μετριοπάθειας περιεχομένου για την αυτόματη κατάργηση βίντεο με ψεύτικα στοιχεία μέσα σε λίγα λεπτά από τη μεταφόρτωση.[65][66], αποτρέποντας την εξάπλωση της παραπληροφόρησης που δημιουργείται από την ΤΝ.

Συμπέρασμα: Μένουμε μπροστά από την καμπύλη

Η ταχεία εξάπλωση των απειλών με βάση την Τεχνητή Νοημοσύνη το 2025 έθεσε νέες προκλήσεις για τους οργανισμούς. Οι επιτιθέμενοι έχουν βρει μέσα για να εκμεταλλευτούν την ανθρώπινη εμπιστοσύνη σε κλίμακα - υποδυόμενοι φωνές και ταυτότητες, αυτοματοποιώντας την κοινωνική μηχανική, αποφεύγοντας τις άμυνες μέσω προσαρμοστικού κώδικα και κατασκευάζοντας ολόκληρες ψεύτικες πραγματικότητες. Πρόκειται για μια τρομακτική προοπτική για τους αμυντικούς, αλλά όχι απελπιστική. Ακριβώς όπως οι εγκληματίες αξιοποιούν την ΤΝ, έτσι και εμείς μπορούμε να επιστρατεύσουμε την ΤΝ στο πλευρό της ασφάλειας. Η εμφάνιση των Ανίχνευση περιεχομένου τεχνητής νοημοσύνης, εγκληματολογική ανάλυση ψεύτικου περιεχομένου και σαρωτές συνθετικής ταυτότητας μας δίνει ισχυρές απαντήσεις σε αυτές τις νέες απειλές. Με την ανάπτυξη αυτών των εργαλείων και την ενσωμάτωσή τους σε όλα τα επίπεδα της άμυνας, οι επιχειρήσεις μπορούν να μειώσουν δραματικά τον κίνδυνο επιθέσεων με τεχνητή νοημοσύνη. Οι πρώτοι χρήστες έχουν ήδη αποτρέψει απόπειρες απάτης πολλών εκατομμυρίων δολαρίων, συλλαμβάνοντας τα deepfakes εν τη γενέσει τους.[26], ή απέτρεψε τις καταστροφές phishing φιλτράροντας τα μηνύματα ηλεκτρονικού ταχυδρομείου που έχουν δημιουργηθεί με τεχνητή νοημοσύνη.

Πέρα από την τεχνολογία, οι οργανισμοί θα πρέπει να καλλιεργήσουν μια κουλτούρα "εμπιστοσύνης αλλά επαλήθευσης". Οι εργαζόμενοι θα πρέπει να γνωρίζουν ότι στην εποχή της τεχνητής νοημοσύνης, το να βλέπεις (ή να ακούς) δεν σημαίνει πάντα ότι πιστεύεις - ένας υγιής σκεπτικισμός σε συνδυασμό με ροές εργασίας επαλήθευσης μπορεί να σταματήσει πολλά τεχνάσματα κοινωνικής μηχανικής. Η εκπαίδευση και η ευαισθητοποίηση, σε συνδυασμό με αυτοματοποιημένα εργαλεία επαλήθευσης όπως το TruthScan, σχηματίζουν μια τρομερή άμυνα. Κατά μία έννοια, πρέπει να ανεβάσουμε τον πήχη της αυθεντικοποίησης και της επικύρωσης των πληροφοριών. Οι ψηφιακές επικοινωνίες και τα έγγραφα δεν μπορούν πλέον να λαμβάνονται για την ονομαστική τους αξία- η προέλευσή τους πρέπει να ελέγχεται, είτε από μηχανή είτε από διαδικασία.

Καθώς προχωράμε μπροστά, αναμένουμε ότι οι επιτιθέμενοι θα βελτιώσουν περαιτέρω τις τακτικές τους με τεχνητή νοημοσύνη - αλλά αναμένουμε επίσης συνεχή καινοτομία στην αμυντική τεχνητή νοημοσύνη. Η δυναμική της γάτας και του ποντικιού θα συνεχιστεί. Η επιτυχία των αμυντικών θα εξαρτηθεί από ευελιξία και ανταλλαγή πληροφοριών. Όσοι ενσωματώνουν γρήγορα νέες πληροφορίες για απειλές (π.χ. νέες τεχνικές ανίχνευσης deepfake ή ενημερωμένες υπογραφές μοντέλων AI) θα παραμείνουν μπροστά από τους επιτιθέμενους που χρησιμοποιούν τα πιο πρόσφατα εργαλεία AI. Οι συνεργασίες μεταξύ βιομηχανίας, ακαδημαϊκής κοινότητας και κυβέρνησης θα είναι επίσης ζωτικής σημασίας σε αυτόν τον αγώνα, όπως φαίνεται από τις προειδοποιήσεις και τα πλαίσια που προκύπτουν από οργανισμούς όπως το Πλαίσιο Διαχείρισης Κινδύνου Τεχνητής Νοημοσύνης του NIST και τις διατραπεζικές συνεργασίες για την ανίχνευση απάτης Τεχνητής Νοημοσύνης.

Κλείνοντας, ο κλάδος της ασφάλειας στον κυβερνοχώρο βρίσκεται εν μέσω μιας αλλαγής παραδείγματος με γνώμονα την τεχνητή νοημοσύνη. Οι απειλές δεν μοιάζουν με εκείνες που υπήρχαν πριν από μια δεκαετία, αλλά τις αντιμετωπίζουμε με εξίσου πρωτοφανείς άμυνες. Με έναν συνδυασμό προηγμένης τεχνολογίας ανίχνευσης και στιβαρής στρατηγικής ασφάλειας, θα μπορεί να να μετριάσουμε τους κινδύνους της γενεσιουργού τεχνητής νοημοσύνης και ακόμη και να την μετατρέψουμε σε πλεονέκτημά μας. Εργαλεία όπως η σουίτα ανίχνευσης ΤΝ της TruthScan μας επιτρέπουν να αποκατάσταση της εμπιστοσύνης σε έναν κόσμο μηδενικής εμπιστοσύνης - για να διασφαλίσουμε ότι το άτομο στην άλλη άκρη της γραμμής είναι πραγματικό, ότι το έγγραφο στα εισερχόμενά μας είναι αυθεντικό και ότι ο κώδικας που εκτελείται στο δίκτυό μας δεν έχει αλλοιωθεί από κακόβουλη τεχνητή νοημοσύνη. Επενδύοντας τώρα σε αυτές τις δυνατότητες, οι οργανισμοί όχι μόνο θα προστατευτούν από τις σημερινές επιθέσεις με τη βοήθεια της ΤΝ, αλλά και θα αποκτήσουν ανθεκτικότητα απέναντι στις εξελισσόμενες απειλές του αύριο. Το συμπέρασμα είναι σαφές: Η τεχνητή νοημοσύνη μπορεί να ενισχύει τις επιθέσεις στον κυβερνοχώρο, αλλά με τη σωστή προσέγγιση μπορεί επίσης να ενισχύσει τις άμυνές μας.

Πηγές: Τα σχετικά δεδομένα και παραδείγματα αντλήθηκαν από 2025 εκθέσεις πληροφοριών για απειλές και εμπειρογνώμονες, συμπεριλαμβανομένης της έκθεσης Cyber Incident Trends της Mayer Brown.[1][67], Η συγκέντρωση απειλών της Fortinet για το 2025[2][19], Έρευνα της Barracuda σχετικά με τις επιθέσεις ηλεκτρονικού ταχυδρομείου με τεχνητή νοημοσύνη[6][7], Έκθεση της Google GTIG για τις απειλές της Τεχνητής Νοημοσύνης[34], Boston Federal Reserve insights on synthetic fraud[45][50], καθώς και τις δημοσιευμένες μελέτες περιπτώσεων και τα δελτία τύπου της TruthScan[30][26], μεταξύ άλλων. Αυτά καταδεικνύουν το εύρος των απειλών με βάση την ΤΝ και την αποτελεσματικότητα των αντιμέτρων που επικεντρώνονται στην ΤΝ σε σενάρια του πραγματικού κόσμου. Μαθαίνοντας από την εν λόγω νοημοσύνη και αναπτύσσοντας εργαλεία αιχμής, μπορούμε να περιηγηθούμε στην εποχή των κινδύνων στον κυβερνοχώρο που ενισχύονται από την Τεχνητή Νοημοσύνη με αυτοπεποίθηση.

[1] [67] 2025 Cyber Incident Trends What Your Business Needs to Know | Insights | Mayer Brown

[2] [3] [19] Κορυφαία στατιστικά στοιχεία για την ασφάλεια στον κυβερνοχώρο: για το 2025

https://www.fortinet.com/resources/cyberglossary/cybersecurity-statistics

[4] [11] [12] [16] [17] [20] [22] [47] [48] [52] Απάτη με βάση την τεχνητή νοημοσύνη στις χρηματοπιστωτικές υπηρεσίες: TruthScan

https://truthscan.com/blog/ai-driven-fraud-in-financial-services-recent-trends-and-solutions

[5] [26] [30] [54] Η TruthScan ανιχνεύει βορειοκορεατική επίθεση Deepfake σε αξιωματούχους της Άμυνας - Bryan County Magazine

[6] [7] [14] Το μισό spam στα εισερχόμενά σας παράγεται από τεχνητή νοημοσύνη - η χρήση της σε προηγμένες επιθέσεις βρίσκεται σε πρώιμο στάδιο | Barracuda Networks Blog

https://blog.barracuda.com/2025/06/18/half-spam-inbox-ai-generated

[8] [10] Δείκτης ψηφιακής εμπιστοσύνης 2ου τριμήνου 2025: Δεδομένα και πληροφορίες για την απάτη AI | Sift

https://sift.com/index-reports-ai-fraud-q2-2025

[9] [13] [24] [25] [38] [39] Απειλές κυβερνοασφάλειας AI 2025: $25.6M Deepfake

https://deepstrike.io/blog/ai-cybersecurity-threats-2025

[15] [21] Τελευταίες πληροφορίες απειλών | TruthScan

[18] [63] [64] TruthScan - Επιχειρησιακή ανίχνευση AI & ασφάλεια περιεχομένου

[23] [46] [56] [57] Deepfakes και καταθέσεις: Πώς να καταπολεμήσετε την απάτη της Γενετικής Τεχνητής Νοημοσύνης

https://www.amount.com/blog/deepfakes-and-deposits-how-to-fight-generative-ai-fraud

[27] Επιθέσεις Deepfake & AI-Generated Phishing: Στατιστικά στοιχεία για το 2025

https://zerothreat.ai/blog/deepfake-and-ai-phishing-statistics

[28] [58] [59] Ανιχνευτής φωνής AI για Deepfakes & κλωνοποίηση φωνής | TruthScan

https://truthscan.com/ai-voice-detector

[29] [31] [60] [61] [65] [66] Deepfake Detector - Αναγνώριση ψεύτικων βίντεο και βίντεο AI - TruthScan

https://truthscan.com/deepfake-detector

[32] [33] [34] [35] [36] [37] [41] GTIG AI Threat Tracker: | Google Cloud Blog

https://cloud.google.com/blog/topics/threat-intelligence/threat-actor-usage-of-ai-tools

[40] Hackers Obfuscated κακόβουλο λογισμικό με φλύαρο κώδικα AI

https://www.bankinfosecurity.com/hackers-obfuscated-malware-verbose-ai-code-a-29541

[42] [43] [62] Ανίχνευση AI σε πραγματικό χρόνο - TruthScan

https://truthscan.com/real-time-ai-detector

[44] EvilAI Operators Use AI-Generated Code and Fake Apps for Far ...

https://www.trendmicro.com/en_us/research/25/i/evilai.html

[45] [49] [50] [51] [55] Η γενιά της τεχνητής νοημοσύνης αυξάνει την απειλή της απάτης με συνθετικές ταυτότητες - Federal Reserve Bank of Boston

[53] Συνθετική απάτη ταυτότητας 2025: AI Detection & Prevention Strategies