Μόλις πριν από λίγα χρόνια, χρειαζόταν ένα επαγγελματικό στούντιο και πολλές τεχνικές δεξιότητες για να μιμηθείς τη φωνή κάποιου.

Τώρα, οποιοσδήποτε με σύνδεση στο διαδίκτυο και λίγο ελεύθερο χρόνο μπορεί να δημιουργήσει έναν ψηφιακό κλώνο της φωνής οποιουδήποτε σε λιγότερο από ένα λεπτό.

Τα εργαλεία για αυτές τις επιθέσεις γίνονται φθηνότερα και πιο προσιτά σε όλους κάθε μέρα. Και επειδή τόσοι πολλοί άνθρωποι μοιράζονται τη ζωή τους στα μέσα κοινωνικής δικτύωσης, είναι πολύ εύκολο για έναν απατεώνα να βρει τον ήχο που χρειάζεται.

Σε αυτό το άρθρο, θα σας παρουσιάσουμε μερικά από τα διαβόητα παραδείγματα απάτης στον πραγματικό κόσμο. Θα σας παρουσιάσουμε επίσης μια λύση για να θέσετε εγκαίρως τέρμα σε αυτές τις απειλές.

Βασικά συμπεράσματα

- Οι απόπειρες απάτης με φωνητική απομίμηση έχουν αυξηθεί κατά 2.137% τα τελευταία χρόνια, γεγονός που οφείλεται στο ότι η σύγχρονη τεχνητή νοημοσύνη μπορεί να δημιουργήσει έναν ακριβή κλώνο φωνής 85% χρησιμοποιώντας μόλις τρία δευτερόλεπτα αρχικού ήχου.

- Στις διαβόητες επιθέσεις στον πραγματικό κόσμο περιλαμβάνεται η ληστεία της εταιρείας μηχανικών Arup το 2024, όπου οι απατεώνες χρησιμοποίησαν βίντεο και ήχο deepfake ενός οικονομικού διευθυντή για να ξεγελάσουν έναν υπάλληλο και να του μεταφέρουν $25,6 εκατομμύρια ευρώ.

- Πέρα από την εταιρική κλοπή, οι φωνητικές απομιμήσεις εγκυμονούν σοβαρούς συναισθηματικούς κινδύνους για τις οικογένειες μέσω απαγωγών και μπορούν να παρακάμψουν τα παραδοσιακά βιομετρικά συστήματα ασφαλείας που χρησιμοποιούνται από τράπεζες και άλλες εφαρμογές υψηλής ασφάλειας.

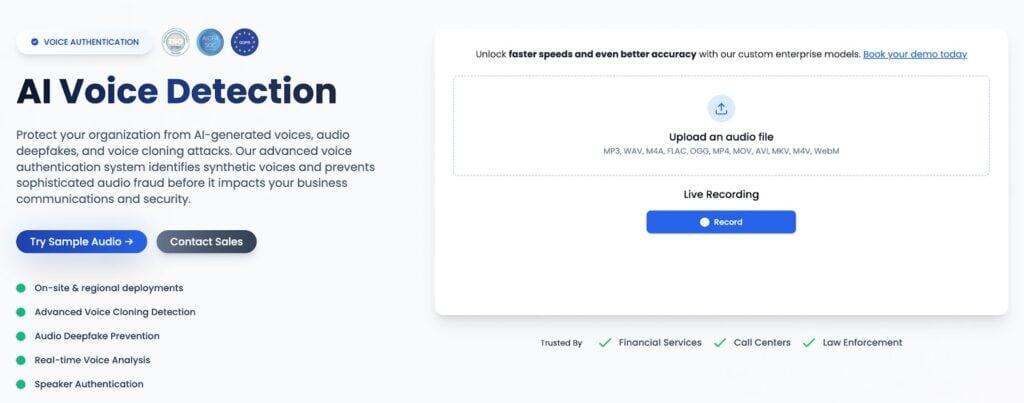

- Οι οργανισμοί αναγκάζονται να ξεπεράσουν την ανθρώπινη επαλήθευση μόνο με την εφαρμογή πρωτοκόλλων έγκρισης πολλών ατόμων για μεγάλες μεταφορές και την ανάπτυξη ανιχνευτών φωνής AI όπως το TruthScan για την ανάλυση ακουστικών αποτυπωμάτων σε πραγματικό χρόνο.

- Το TruthScan διασφαλίζει τις αλληλεπιδράσεις των επιχειρήσεων αναγνωρίζοντας συνθετικά αντικείμενα ομιλίας από πλατφόρμες όπως η ElevenLabs και η Murf με ακρίβεια άνω των 99% σε όλες τις κύριες μορφές ήχου και βίντεο.

Τι είναι οι επιθέσεις Voice Deepfake;

Το deepfake φωνής είναι μια ψηφιακή πλαστογράφηση της φωνής κάποιου. Ο επιτιθέμενος χρησιμοποιεί λογισμικό που μπορεί να αναλύσει κάθε μικρή λεπτομέρεια για το πώς μιλάει κάποιος από μια ηχογράφηση της φωνής του.

Για να κλωνοποιήσει τη φωνή, το λογισμικό προσπαθεί να παρατηρήσει μοτίβα στη φωνή. Κυρίως, το λογισμικό λαμβάνει υπόψη του πράγματα όπως το ύψος της φωνής, τον τόνο, τον τρόπο με τον οποίο κάποιος αναπνέει ανάμεσα στις προτάσεις κ.λπ.

Μόλις μάθει αυτά τα μοτίβα, ο επιτιθέμενος μπορεί να το κάνει να πει οτιδήποτε με αυτή τη φωνή.

Μην ανησυχείτε ποτέ ξανά για την απάτη με τεχνητή νοημοσύνη. TruthScan Μπορεί να σας βοηθήσει:

- Ανίχνευση AI που παράγεται εικόνες, κείμενο, φωνή και βίντεο.

- Αποφύγετε το σημαντική απάτη με βάση την τεχνητή νοημοσύνη.

- Προστατέψτε τα πιο ευαίσθητο περιουσιακά στοιχεία της επιχείρησης.

Αυτό που είναι επικίνδυνο είναι ότι τα εργαλεία δημιουργίας φωνητικών απομιμήσεων είναι εύκολα προσβάσιμα. Και τα περισσότερα από αυτά δεν χρειάζονται καμία εγκατάσταση. Είναι διαθέσιμα στο διαδίκτυο με τη μορφή ιστότοπων.

Απλά πρέπει να τους δώσετε μερικά δολάρια και να αρχίσετε να κλωνοποιείτε φωνές. Αν ψάξετε λίγο περισσότερο, ίσως βρείτε ακόμη και εργαλεία που σας επιτρέπουν να κλωνοποιήσετε φωνές δωρεάν.

Αυτή η νέα και εύκολα διαθέσιμη τεχνολογία έχει οδηγήσει σε κατακόρυφη αύξηση της απάτης στον τομέα του ήχου.

Οι απατεώνες χρειάζονται μόνο ένα μικρό κομμάτι ήχου από κάποιον, το οποίο μπορούν να αντλήσουν από τα μέσα κοινωνικής δικτύωσης ή κάποιο άλλο δημόσιο κανάλι, για να τον κλωνοποιήσουν.

Στη συνέχεια, μπορούν να χρησιμοποιήσουν την κλωνοποιημένη φωνή για να υποδυθούν ένα άτομο σε καταστάσεις όπως ζωντανές τηλεφωνικές κλήσεις, συναντήσεις μέσω βίντεο, φωνητικές σημειώσεις, ανακοινώσεις κ.λπ.

Αυτές δεν είναι απλώς υποθετικές περιπτώσεις χρήσης των επιθέσεων deepfake φωνής. Αυτά τα πράγματα έχουν ήδη συμβεί. Θα καλύψουμε μερικές από τις διαβόητες επιθέσεις deepfake φωνής αργότερα.

Πιθανοί κίνδυνοι των επιθέσεων Deepfake Voice

Όταν ακούσατε για το voice deepfake, μπορεί να σας ήρθαν στο μυαλό εικόνες ενός αστείου βίντεο με έναν διάσημο να λέει πράγματα που δεν έχει πει ποτέ.

Αλλά αυτή η φαινομενικά αθώα χρήση της κλωνοποιημένης φωνής μπορεί να προκαλέσει σοβαρή ζημία στα εμπλεκόμενα μέρη. Ας μιλήσουμε για τους κινδύνους.

Οικονομική καταστροφή για τις επιχειρήσεις

Μια ψεύτικη φωνή μπορεί να καταστρέψει τη φήμη μιας εταιρείας για πάντα. Έχει επίσης τη δύναμη να της στερήσει μεγάλα χρηματικά ποσά μέσα σε λίγα λεπτά.

Πώς γίνεται αυτό, θα ρωτήσετε; Οι απατεώνες μπορούν να κλωνοποιήσουν τη φωνή του αφεντικού μιας εταιρείας και να τη χρησιμοποιήσουν για να καλέσουν τους υπαλλήλους και να τους αναγκάσουν να κάνουν πράγματα που δεν πρέπει να γίνουν, όπως η μεταφορά χρημάτων σε έναν λογαριασμό.

Αυτό είναι μόνο ένα παράδειγμα. Οι δυνατότητες είναι ατελείωτες.

Παράκαμψη συστημάτων ασφαλείας

Η φωνή σας είναι ένα βιομετρικό στοιχείο που κανείς άλλος δεν πρέπει να έχει. Αυτό συμβαίνει επειδή τη χρησιμοποιείτε ως κωδικό πρόσβασης για να συνδεθείτε σε πολλές από τις εφαρμογές σας, ιδίως στις τραπεζικές.

Παρόλο που αυτές οι εφαρμογές μπορεί να διαθέτουν ένα ενσωματωμένο αυτοματοποιημένο σύστημα επαλήθευσης φωνής για την αποτροπή μη εξουσιοδοτημένης πρόσβασης, ένας καλός κλώνος φωνής εξακολουθεί να έχει την ευκαιρία να τους ξεγελάσει.

Η συναισθηματική επιβάρυνση των οικογενειών

Ίσως οι ευκολότεροι στόχοι για τους απατεώνες ήχου είναι οι ηλικιωμένοι της οικογένειας. Οι γονείς και οι παππούδες, για παράδειγμα.

Οι απατεώνες μπορεί να καλέσουν, ας πούμε, μια μητέρα και να παίξουν τον ήχο της κόρης της που φωνάζει για βοήθεια, λέγοντας ότι την έχουν απαγάγει.

Καταστροφή της εμπιστοσύνης στον εργασιακό χώρο

Οι φωνητικές επιθέσεις deepfake πλήττουν επίσης την εμπιστοσύνη σε έναν υγιή εργασιακό χώρο.

Οι εργαζόμενοι θα πρέπει να διπλοελέγχουν τις τηλεφωνικές κλήσεις από τον προϊστάμενό τους για να βεβαιωθούν ότι δεν πρόκειται για κάποιον απατεώνα που τους διατάζει να κάνουν επικίνδυνα πράγματα με κλωνοποιημένη φωνή.

Τότε ποιες είναι οι επιλογές σας, αν όχι ο διπλός έλεγχος με το χέρι; Όλοι οι κίνδυνοι που μόλις συζητήσαμε υποδεικνύουν την ανάγκη για αυτοματοποιημένη πρόληψη επιθέσεων deepfake.

Ευτυχώς, διαθέτουμε τώρα εργαλεία ανίχνευσης φωνής με τεχνητή νοημοσύνη, το TruthScan είναι ένα από αυτά.

Αποτρέψτε την απάτη και την πλαστοπροσωπία με το TruthScan Ανιχνευτής φωνής AI.

Παραδείγματα πραγματικού κόσμου για επιθέσεις Deepfake φωνής

Χάρη στην Τεχνητή Νοημοσύνη, έχουμε φτάσει σε ένα σημείο όπου δεν μπορούμε να εμπιστευόμαστε εύκολα αυτό που βλέπουν τα μάτια μας ή ακούνε τα αυτιά μας. Η τεχνητή νοημοσύνη είναι πλέον σε θέση να δημιουργεί ρεαλιστικές εικόνες και βίντεο. Το ίδιο ισχύει και για τον ήχο.

Ίσως έχετε ήδη ακούσει ιστορίες ανθρώπων που έχουν πέσει θύμα απάτης με deepfake audio. Εμφανίζεται συνεχώς στις ειδήσεις και στα μέσα κοινωνικής δικτύωσης κατά καιρούς. Κάποιες από αυτές είναι δύσκολο να τις κατανοήσετε.

Ας σας μιλήσουμε για μερικές από τις πιο διαβόητες επιθέσεις deepfake φωνής, ώστε να πάρετε μια καλή ιδέα για το πόσο έξυπνα εκτελούνται.

Η εικονική συνάντηση $25 εκατομμυρίων που στην πραγματικότητα δεν έγινε ποτέ

Αυτή η επίθεση deepfake είναι ίσως η πιο αναφερόμενη.

Το θύμα ήταν μια βρετανική εταιρεία μηχανικών που ονομάζεται Arup, αλλά η απάτη ξεκίνησε από το γραφείο της στο Χονγκ Κονγκ.

Ήταν αρχές του 2024 όταν ένας εργαζόμενος στο οικονομικό τμήμα της εταιρείας έλαβε ένα μήνυμα ηλεκτρονικού ταχυδρομείου από τον οικονομικό διευθυντή της εταιρείας στο Ηνωμένο Βασίλειο. Στο μήνυμα ηλεκτρονικού ταχυδρομείου, ο εργαζόμενος καθοδηγούνταν από τον οικονομικό διευθυντή να κάνει μυστικές μεταφορές χρημάτων σε κάποιους τραπεζικούς λογαριασμούς.

Στην αρχή, ο υπάλληλος ήταν αρκετά καχύποπτος, επειδή το αίτημα του φάνηκε λίγο περίεργο και σκέφτηκε ότι μπορεί να επρόκειτο για απάτη phishing.

Στη συνέχεια, όμως, ο υπάλληλος προσκλήθηκε σε μια τηλεδιάσκεψη. Όταν ο εργαζόμενος μπήκε στην κλήση, είδε κάτι που έμοιαζε ακριβώς με τον οικονομικό διευθυντή και αρκετούς άλλους ανώτερους συναδέλφους.

Όλοι έμοιαζαν και ακούγονταν ακριβώς όπως έπρεπε. Μιλούσαν επίσης μεταξύ τους για να φαίνεται πιο αληθινό.

Αυτό εξαφάνισε εντελώς όλες τις αμφιβολίες του εργαζομένου του οικονομικού τμήματος, ο οποίος στη συνέχεια έστειλε πάνω από $25,6 εκατομμύρια (~HK$200 εκατομμύρια) σε διάφορους τραπεζικούς λογαριασμούς στο Χονγκ Κονγκ μέσω 15 συναλλαγών.

Αργότερα διαπιστώθηκε ότι όλη αυτή η εγκατάσταση ήταν ένα deepfake. Κανένα άτομο στην κλήση δεν ήταν αυτό που φαινόταν, εκτός από τον υπάλληλο της Arup. Οι απατεώνες είχαν συντονίσει τέλεια την επίθεση χρησιμοποιώντας υψηλής ποιότητας κλώνους ήχου και βίντεο του οικονομικού διευθυντή και των ανώτερων υπαλλήλων της εταιρείας.

Ο Ιταλός υπουργός και τα είδωλα της μόδας

Αυτό έλαβε χώρα επίσης το 2024. A ψεύτικος Ιταλός υπουργός Άμυνας Guido Crosetto κάλεσε διάφορες ιταλικές ελίτ και ζήτησε την άμεση οικονομική βοήθειά τους για τη διάσωση των απαχθέντων δημοσιογράφων.

Στο τηλεφώνημα, ο ψεύτικος Guido Crosetto ισχυρίστηκε ότι επρόκειτο για μια άκρως απόρρητη κυβερνητική επιχείρηση. Ο καλούντας κατάφερε ακόμη και να μιλήσει στο τηλέφωνο με θρυλικές προσωπικότητες της μόδας, όπως ο Giorgio Armani.

Δυστυχώς, ένα άτομο κατέληξε να μεταφέρει περίπου ένα εκατομμύριο δολάρια. Πιθανότατα είχε ισχυρότερο αίσθημα πατριωτικού καθήκοντος να βοηθήσει από άλλους, το οποίο οι απατεώνες κατάφεραν να εκμεταλλευτούν.

Η ενεργειακή ληστεία $243,000 στο Ηνωμένο Βασίλειο

Αυτό το συνέβη το 2019 και ήταν πιθανότατα το πρώτο deepfake της κλίμακας του.

Ένας διευθύνων σύμβουλος μιας βρετανικής ενεργειακής εταιρείας νόμιζε ότι μιλούσε στο τηλέφωνο με το αφεντικό του από τη μητρική εταιρεία στη Γερμανία.

Ο διευθύνων σύμβουλος διατάχθηκε να μεταφέρει περίπου 220.000 ευρώ ($243.000) σε έναν προμηθευτή στην Ουγγαρία. Του είπαν ότι επρόκειτο για μια κρίσιμη συμφωνία που χρειαζόταν άμεση μεταφορά. Ο Διευθύνων Σύμβουλος έπεσε στην απάτη και μετέφερε τα χρήματα.

Ένα τρομακτικό τηλεφώνημα για μια μητέρα στην Αριζόνα

Θυμάστε που μιλήσαμε για τα audio deepfakes που αποτελούν απειλή για τις οικογένειες; Το παράδειγμα της απάτης που δώσαμε συνέβη στην πραγματικότητα.

Οι απατεώνες είχαν κλωνοποιήσει τη φωνή ενός 15χρονου κοριτσιού από ένα βίντεό της στα μέσα κοινωνικής δικτύωσης. Στη συνέχεια τηλεφώνησαν στη μητέρα της και ισχυρίστηκαν με τη φωνή της κόρης ότι την είχαν απαγάγει και οι απαγωγείς της ζητούσαν άμεσα λύτρα.

Ευτυχώς, ο πατέρας μπόρεσε να καλέσει την πραγματική κόρη τους, η οποία ήταν ασφαλής σε μια προπόνηση σκι κατά τη διάρκεια της όλης δοκιμασίας. Απέφυγαν την απάτη.

Πώς επηρεάζουν οι επιχειρήσεις τα Deepfakes φωνής

Ο κύριος στόχος μιας επίθεσης deepfake φωνής είναι κυρίως η κλοπή χρημάτων.

Όταν όμως ο στόχος είναι επιχειρήσεις, η ζημιά είναι πολυδιάστατη.

Για παράδειγμα, τα deepfakes μπορούν να δηλητηριάσουν την ατμόσφαιρα μεταξύ των εργαζομένων μιας εταιρείας. Έχει τη δυνατότητα να δημιουργήσει μια κουλτούρα όπου οι εργαζόμενοι είναι πάντα τρομοκρατημένοι από το ενδεχόμενο να κάνουν μια γκάφα.

Πάρτε το παράδειγμα των τηλεφωνικών κέντρων. Βλέπουμε αναφορές για εγκληματίες του κυβερνοχώρου που τα καλούν και προσποιούνται ότι είναι συγκεκριμένοι πελάτες.

Το τέχνασμά τους είναι να κάνουν τους υπαλλήλους του τηλεφωνικού κέντρου να αλλάξουν τα στοιχεία των λογαριασμών αυτών των πελατών (π.χ. διευθύνσεις κατοικίας, αριθμούς τηλεφώνου) και να αναλάβουν τους λογαριασμούς τους.

Οι απομακρυσμένες προσλήψεις και οι εικονικές συνεντεύξεις είναι ένας άλλος τομέας όπου οι υποψήφιοι μπορούν να χρησιμοποιήσουν τις ψεύτικες φωνές για να πάρουν θέσεις εργασίας για τις οποίες δεν έχουν τα προσόντα.

Προστασία επιχειρήσεων από επιθέσεις Voice Deepfake

Οι παραδοσιακοί κανόνες ασφαλείας στις επιχειρήσεις γράφτηκαν στην προ-AI εποχή.

Είναι καιρός οι επιχειρήσεις να τις επανεξετάσουν. Θα πρέπει πρώτα να ξεκινήσουν με την εκπαίδευσή τους σχετικά με τις πολλές νέες απειλές στον κυβερνοχώρο που έχουν προέλθει από την κατάχρηση της τεχνητής νοημοσύνης.

Για παράδειγμα, μπορούν να οργανώσουν εκπαιδευτικές συνεδρίες για ολόκληρη την ομάδα τους και να τους δείξουν πραγματικά παραδείγματα απάτης με ήχο. Μπορείτε να ξεκινήσετε με τα παραδείγματα που μόλις συζητήσαμε παραπάνω. Αυτές οι εκπαιδευτικές συνεδρίες θα πρέπει επίσης να τους δώσουν συμβουλές πρόληψης επιθέσεων deepfake για διάφορα σενάρια.

Στη συνέχεια, μπορείτε να προχωρήσετε στην επικαιροποίηση των εσωτερικών επιχειρηματικών πολιτικών. Μια σημαντική αλλαγή μπορεί να είναι να σταματήσετε να επιτρέπετε σε ένα μόνο άτομο να εγκρίνει μαζικές μεταφορές χρημάτων μόνο του.

Οι μεγάλες πληρωμές θα πρέπει να απαιτούν την έγκριση μιας ολόκληρης επιτροπής, ώστε τουλάχιστον ένας από αυτούς να μπορεί να αντιληφθεί εγκαίρως ότι κάτι δεν πάει καλά.

Θα πρέπει επίσης να σκεφτείτε την ενσωμάτωση ενός αυτοματοποιημένου Ανιχνευτής φωνής AI να εκτελείται στο παρασκήνιο κατά τη διάρκεια των κλήσεων.

Γι' αυτό φτιάχτηκαν τα εργαλεία τεχνητής νοημοσύνης TruthScan. Μπορείτε να εντοπίζετε, να επαληθεύετε και να αποτρέπετε τις επιθέσεις deepfake φωνής χρησιμοποιώντας τα εργαλεία τεχνητής νοημοσύνης μας. Ας σας πούμε πώς.

Πώς η TruthScan διασφαλίζει τις φωνητικές αλληλεπιδράσεις

Καταλαβαίνουμε ότι οι εργαζόμενοι δεν μπορούν να ξεχωρίσουν μόνοι τους μια βαθιά ψεύτικη φωνή από μια πραγματική φωνή στη μέση μιας αγχωτικής κλήσης. Χρειάζονται έναν εξειδικευμένο βοηθό που θα μπορούσε να ασχοληθεί με αυτή τη δουλειά κατά τη διάρκεια μιας κλήσης, ενώ η ομάδα σας μπορεί να επικεντρωθεί σε αυτό για το οποίο προσλήφθηκε.

Το μας Ανιχνευτής φωνής AI είναι μια ειδική λύση.

Δείτε πώς λειτουργεί και τι μπορεί να κάνει:

- Αναλύει εκατομμύρια διαφορετικά σημεία δεδομένων σε ζωντανές τηλεφωνικές κλήσεις και συνεδριάσεις βίντεο και παρέχει ακρίβεια 99%.

- Εκδίδει προειδοποίηση αμέσως μετά τον εντοπισμό ψεύτικης φωνής

- Πιάνει φασματικά μοτίβα και ακουστικά αποτυπώματα στη φωνή που αφήνουν πίσω τους μόνο τα συνθετικά μοντέλα

- Ενσωματώνεται με το υπάρχον τηλεφωνικό κέντρο ή γραφείο βοήθειας μέσω ενός απλού REST API

- Μπορεί να σαρώσει όλες τις κύριες μορφές ήχου και βίντεο

Μιλήστε στην TruthScan για την πρόληψη επιθέσεων Deepfake Voice

Μπορείτε να σταματήσετε την απάτη κλωνοποίησης φωνής σε πραγματικό χρόνο με το TruthScan, αλλά το ερώτημα είναι, πότε θα ξεκινήσετε; Οι υπάλληλοί σας μπορεί αργά ή γρήγορα να κάνουν μια γκάφα και να σας εξαπατήσουν. Μην περιμένετε αυτή την ατυχή στιγμή.

Ο ανιχνευτής φωνής τεχνητής νοημοσύνης μας μπορεί να επισημάνει τις φωνητικές απομιμήσεις χρησιμοποιώντας πλατφόρμες όπως η ElevenLabs και η Murf.

Λειτουργεί στο παρασκήνιο κατά τη διάρκεια ζωντανών τηλεφωνικών κλήσεων και βιντεοσυνεδριάσεων, ώστε οι τηλεφωνικοί σας πράκτορες να μην χρειάζεται να κάνουν πολλές εργασίες.

Το μόνο που χρειάζεται είναι μια γρήγορη ενσωμάτωση μέσω του REST API μας.

Ξεκινήστε με TruthScan τώρα και προστατεύστε την επιχείρησή σας από απάτες deepfake.