Στη δεκαετία του '90, ήταν το DNA.

Στη δεκαετία του 2000, ήταν οι κεραίες κινητής τηλεφωνίας.

Αλλά το 2026, το νέο χρυσό πρότυπο αποδεικτικών στοιχείων είναι το ψηφιακό δακτυλικό αποτύπωμα.

Σκεφτείτε το ως εξής...

Κάθε αρχείο βίντεο έχει μια μοναδική υπογραφή.

Αν έστω και ένα εικονοστοιχείο τροποποιηθεί από την τεχνητή νοημοσύνη, το δακτυλικό αποτύπωμα αλλάζει αμέσως.

Εάν τα αποδεικτικά στοιχεία της ΤΝ σας δεν έχουν μια επαληθευμένη χρονοσφραγίδα blockchain για να κλειδώσουν αυτό το δακτυλικό αποτύπωμα στη θέση του, θα μπορούσε κάλλιστα να είναι μια γελοιογραφία στα μάτια ενός σύγχρονου δικαστή.

Αυτό λοιπόν σημαίνει ότι η εποχή του “βλέποντας πιστεύεις” έχει τελειώσει.

Έχουμε εισέλθει στην εποχή της επαλήθευσης βίντεο με τεχνητή νοημοσύνη, όπου η απόδειξη δεν βρίσκεται σε αυτό που βλέπετε, αλλά στον ψηφιακό κώδικα που κρύβεται κάτω από την επιφάνεια.

Σε αυτό το ιστολόγιο, θα διερευνήσουμε γιατί τα παραδοσιακά αποδεικτικά στοιχεία αποτυγχάνουν έναντι της απάτης με βίντεο, πώς να εντοπίζετε τα παραποιημένα κλιπ, γιατί η επαλήθευση είναι κρίσιμη για το παραδεκτό και γιατί ένας ανιχνευτής βίντεο με τεχνητή νοημοσύνη όπως το TruthScan είναι πλέον απαραίτητος για τις νομικές ομάδες.

Ας βουτήξουμε.

Βασικά συμπεράσματα

- Το 2026, όλα τα αποδεικτικά στοιχεία βίντεο θα πρέπει να υποβάλλονται σε επαλήθευση βίντεο ΤΝ για να θεωρούνται αξιόπιστα.

- Η απάτη με βίντεο περιλαμβάνει μικρές επεξεργασίες όπως η χειραγώγηση χρονοσήμανσης, όχι μόνο πλήρεις ανταλλαγές προσώπων.

- Ένας επαγγελματικός ανιχνευτής deepfake είναι ο μόνος τρόπος για να εντοπίσετε τα τεχνουργήματα GAN που διαφεύγουν από τους ανθρώπους.

- Νέοι κανόνες, όπως ο ομοσπονδιακός κανόνας 707, τυποποιούν τον τρόπο με τον οποίο τα αποδεικτικά στοιχεία ΤΝ γίνονται δεκτά στο δικαστήριο.

- Η αυτοματοποιημένη ανάλυση αποδεικτικών στοιχείων επιτρέπει στις επιχειρήσεις να επεξεργάζονται μαζικά πακέτα αποκαλύψεων γρήγορα και με ακρίβεια.

- Το TruthScan αποτρέπει την απάτη κατά τη διάρκεια ζωντανών ακροάσεων, ανιχνεύοντας συνθετικές μάσκες σε πραγματικό χρόνο.

Τι είναι τα αποδεικτικά βίντεο σε νομικές διαφορές;

Βιντεοαποδεικτικό στοιχείο είναι ουσιαστικά κάθε καταγεγραμμένο απόσπασμα που χρησιμοποιείται στο δικαστήριο για να αποδείξει τι συνέβη. Από ποινικές υποθέσεις έως ασφαλιστικούς διακανονισμούς, υπάρχουν παντού.

Ωστόσο, το 2026, η άνοδος της απάτης με βίντεο έχει καταστήσει το “βλέποντας πιστεύεις” μια επικίνδυνη υπόθεση. Οι επαγγελματίες του νομικού κλάδου χρειάζονται πλέον ισχυρή επαλήθευση βίντεο AI για να διασφαλίσουν την ακεραιότητα του συστήματος απονομής δικαιοσύνης.

Τύποι βίντεο αποδείξεων που χρησιμοποιούν καθημερινά τα δικαστήρια

Μην ανησυχείτε ποτέ ξανά για την απάτη με τεχνητή νοημοσύνη. TruthScan Μπορεί να σας βοηθήσει:

- Ανίχνευση AI που παράγεται εικόνες, κείμενο, φωνή και βίντεο.

- Αποφύγετε το σημαντική απάτη με βάση την τεχνητή νοημοσύνη.

- Προστατέψτε τα πιο ευαίσθητο περιουσιακά στοιχεία της επιχείρησης.

- Επιτήρηση (CCTV): Κάμερες από καταστήματα ή φανάρια. Αυτή είναι η πιο συνηθισμένη απόδειξη σε ποινικές υποθέσεις.

- Κάμερες σώματος: Πλάνα από αστυνομικούς, που χρησιμοποιούνται κυρίως σε υποθέσεις πολιτικών δικαιωμάτων ή υπερβολικής βίας.

- Dashcams: Τα αποδεικτικά στοιχεία για αυτοκινητιστικά ατυχήματα και ασφαλιστικές διαμάχες.

- Καταγεγραμμένες μαρτυρίες: Βιντεοσκοπημένες καταθέσεις ή εξ αποστάσεως καταθέσεις μαρτύρων που έχουν γίνει συνήθεις μετά την πανδημία. Πλέον αποτελούν πρότυπο, αλλά επιρρεπείς σε προκλήσεις ανίχνευσης νομικής απάτης.

- Smartphone & Social Media: Βίντεο από παρευρισκόμενους ή αναρτήσεις που αποδεικνύουν τη συμπεριφορά ή την τοποθεσία κάποιου.

- Ασφάλεια της εταιρείας: Πλάνα που χρησιμοποιούνται από εταιρείες για υποθέσεις απάτης ή “άδικης απόλυσης”.

Η γενετική τεχνητή νοημοσύνη και η τεχνολογία deepfake έχουν προσθέσει ένα νέο επίπεδο κινδύνου. Το 2025:

- 1 στις 20 επαληθεύσεις ταυτότητας ξεγελάστηκαν από AI deepfakes

- Μια έρευνα της Medius ανέφερε ότι 43% των επαγγελματιών είχαν πέσει θύματα απόπειρας απάτης deepfake

Πραγματικές περιπτώσεις απάτης με βιντεοσκοπημένα αποδεικτικά στοιχεία

- Χειραγωγημένα αποσπάσματα δικαστηρίου

Τα χειραγωγημένα αποσπάσματα δικαστικής αίθουσας αναφέρονται σε οποιοδήποτε βίντεο ή ηχητικό αποδεικτικό στοιχείο που υποβάλλεται σε μια νομική υπόθεση, το οποίο έχει τροποποιηθεί, μονταριστεί ή κατασκευαστεί εντελώς με τη χρήση τεχνολογίας.

Παραδείγματα:

- Υπόθεση Deepfake της κομητείας Alameda (2025): Μια αστική υπόθεση στην Καλιφόρνια απορρίφθηκε αφού το δικαστήριο ανακάλυψε ότι ένα βίντεο μάρτυρα που υποβλήθηκε ως αποδεικτικό στοιχείο είχε δημιουργηθεί εξ ολοκλήρου με τη χρήση τεχνητής νοημοσύνης.

- Η υπεράσπιση του Sz Huang εναντίον του Tesla deepfake (2023): Σε μια αγωγή αδικαιολόγητου θανάτου, οι δικηγόροι της Tesla ισχυρίστηκαν ότι τα βασικά πλάνα από τη σύγκρουση μπορεί να είναι ψεύτικα.

Τροποποιημένα βίντεο παρακολούθησης

Το βίντεο παρακολούθησης είναι ένας από τους πιο συνηθισμένους τύπους αποδεικτικών στοιχείων ΤΝ που χρησιμοποιούνται στο δικαστήριο. Ωστόσο, πολλοί άνθρωποι πιστεύουν λανθασμένα ότι η χειραγώγηση αφορά μόνο τα πλήρη deepfakes.

Στην πραγματικότητα, η απάτη με βίντεο συμβαίνει συχνά με μικρότερους, λιγότερο προφανείς τρόπους που μπορούν να θέσουν σε κίνδυνο μια υπόθεση.

Οι συνήθεις τύποι χειραγώγησης περιλαμβάνουν:

- Αλλαγές χρονοσφραγίδας

- Αφαίρεση πλαισίου

- Αλλαγές μεταδεδομένων ή GPS

- Αντικατάσταση προσώπου

- Αφαίρεση ή εισαγωγή αντικειμένου

- Looping footage

- Υποβάθμιση της ποιότητας

Το βίντεο παρακολούθησης προέρχεται συχνά από πολλά διαφορετικά μέρη, όπως ιδιωτικά καταστήματα, κουδούνια σπιτιών, χώρους στάθμευσης και κάμερες της πόλης. Σε αντίθεση με το υλικό από τις κάμερες της αστυνομίας, αυτά τα συστήματα συνήθως δεν ακολουθούν αυστηρούς κανόνες αλυσίδας φύλαξης.

Αυτό σημαίνει:

- Ενδέχεται να μην υπάρχει σαφές αρχείο σχετικά με το ποιος χειρίστηκε τον φάκελο.

- Το υλικό μπορεί να αντιγραφεί, να μεταφερθεί ή να μετατραπεί πολλές φορές.

- Οι διαδικασίες πιστοποίησης μπορεί να είναι αδύναμες ή ασυνεπείς.

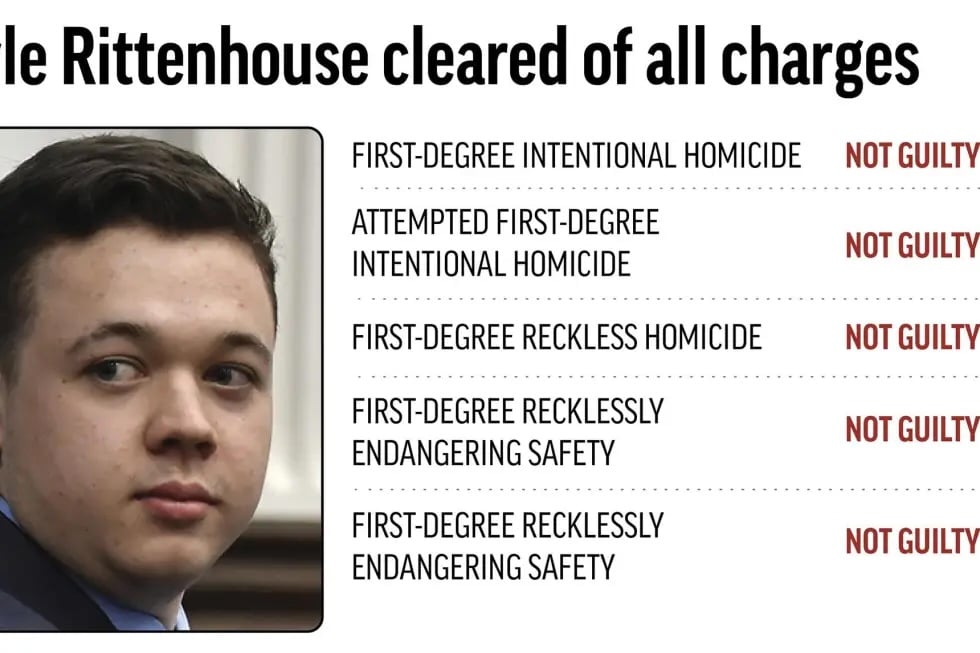

Παράδειγμα: Το ζήτημα της ενίσχυσης της AI στην υπόθεση Wisconsin v. Rittenhouse

Ένα διάσημο παράδειγμα προέρχεται από τη δίκη Wisconsin v. Rittenhouse. Η εισαγγελία προσπάθησε να χρησιμοποιήσει τη λειτουργία pinch-to-zoom ενός iPad για να δείξει λεπτομέρειες σε ένα βίντεο με drone.

Η υπεράσπιση υποστήριξε ότι το ζουμ της Apple χρησιμοποιεί τεχνητή παρεμβολή για να μαντέψει τι θα έπρεπε να υπάρχει. Ο δικαστής έκρινε ότι χωρίς έναν επαγγελματικό ανιχνευτή βίντεο τεχνητής νοημοσύνης, το ενισχυμένο υλικό δεν μπορούσε να γίνει δεκτό.

Αμφισβητούμενες μαρτυρίες βίντεο

Μια αμφισβητούμενη μαρτυρία βίντεο απαιτεί συνήθως την ανίχνευση νομικής απάτης για να προσδιοριστεί αν μια καταγραφή είναι:

- Πλήρως κατασκευασμένη κατάθεση ή δήλωση

- Μια πραγματική μαρτυρία που αμφισβητείται ως ψεύτικη

- Μια χειραγωγημένη πραγματική ηχογράφηση

Κάθε σενάριο δημιουργεί σοβαρό βάρος επικύρωσης για το δικαστήριο.

Παράδειγμα: Η υπόθεση της επιμέλειας των παιδιών στο Ηνωμένο Βασίλειο

Σε μια οικογενειακή δικαστική διαμάχη στο Ηνωμένο Βασίλειο, την οποία επικαλείται το University of Baltimore Law Review, μια μητέρα υπέβαλε μια πολύ τροποποιημένη ηχογράφηση για να παρουσιάσει τον πατέρα ως βίαιο κατά τη διάρκεια μιας μάχης για την επιμέλεια.

Ο στόχος ήταν να περιοριστεί η πρόσβασή του στα παιδιά του.

Η άνοδος των βίντεο που παράγονται από τεχνητή νοημοσύνη σε νομικές υποθέσεις

Το ταξίδι προς την τρέχουσα εποχή των ανιχνευτών deepfake εξελίχθηκε σε διακριτές φάσεις:

- Τα έτη έγκαιρης προειδοποίησης (2017-2021)

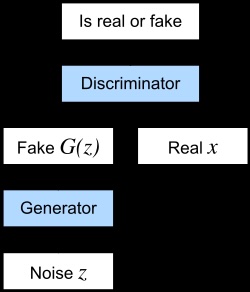

Η τεχνολογία Deepfake (η οποία βασίζεται σε δημιουργικά αντίπαλα δίκτυα (GAN)) ήρθε στο φως της δημοσιότητας γύρω στο 2017.

Οι πρώτες απομιμήσεις ήταν συχνά χαμηλής ποιότητας: πρόσωπα με περίεργες παραμορφώσεις, επιπλέον δάχτυλα, ακατάλληλο φωτισμό και θολά χαρακτηριστικά που τις έκαναν εύκολα εντοπίσιμες.

- Η φάση κλιμάκωσης (2022-2023)

Μέχρι το 2022, η τεχνολογία βελτιώθηκε. Πολλές από αυτές ήταν δωρεάν και μπορούσαν να χρησιμοποιηθούν σε ένα smartphone.

Το 2023, αρχίσαμε να βλέπουμε μερικές από τις πρώτες σημαντικές προκλήσεις που σχετίζονται με το deepfake σε δικαστικές υποθέσεις, συμπεριλαμβανομένων των Sz Huang v. Tesla, United States v. Reffitt και United States v. Doolin, όπου οι δικηγόροι έθεσαν ερωτήματα σχετικά με το κατά πόσον τα αποδεικτικά στοιχεία βίντεο μπορεί να είναι τεχνητής νοημοσύνης.

Περίπου την ίδια εποχή, η Συμβουλευτική Επιτροπή για τους Κανόνες Αποδείξεων του Αμερικανικού Δικηγορικού Συλλόγου άρχισε επίσημα να μελετά το θέμα.

- Το κρίσιμο κατώφλι (2024-2025)

Το περιεχόμενο που δημιουργήθηκε με τεχνητή νοημοσύνη δεν παρέμεινε ακαδημαϊκό για πολύ. Το 2024, ένα περιστατικό σε μια εταιρεία μηχανικών Arup, που αφορούσε μια ψεύτικη βιντεοκλήση που δημιουργούσε η τεχνητή νοημοσύνη και επέτρεπε δόλια τραπεζικά εμβάσματα συνολικού ύψους $25 εκατομμυρίων.

Το νομικό σύστημα άρχισε να ανταποκρίνεται.

Το 2025, Η Λουιζιάνα πέρασε το HB 178, δημιουργώντας το πρώτο πλαίσιο επαλήθευσης αποδεικτικών στοιχείων ΤΝ σε κρατικό επίπεδο.

Σε ομοσπονδιακό επίπεδο, η συμβουλευτική επιτροπή των ΗΠΑ για τους κανόνες απόδειξης πρότεινε Κανόνας 707, επικεντρώθηκε σε αποδεικτικά στοιχεία που παράγονται από μηχανές.

Πού βρίσκονται τα πράγματα το 2026

Από τις αρχές του 2026, η ρύθμιση των deepfake και AI-video έχει επιταχυνθεί σε εθνικό επίπεδο:

- 46 κράτη έχουν περάσει κάποια μορφή νομοθεσίας για το deepfake.

- Από το 2022, 169 νόμοι έχουν θεσπιστεί και 146 νομοσχέδια έχουν εισαχθεί μόνο το 2025..

- Ο ομοσπονδιακός κανόνας 707 είναι ανοικτός για δημόσια σχόλια έως τις 16 Φεβρουαρίου 2026.

Ενίσχυση της επαλήθευσης βίντεο με AI

Ο πιο αποτελεσματικός τρόπος για τον εντοπισμό βίντεο που έχει δημιουργηθεί με τεχνητή νοημοσύνη είναι να χρησιμοποιηθεί η ίδια η τεχνητή νοημοσύνη.

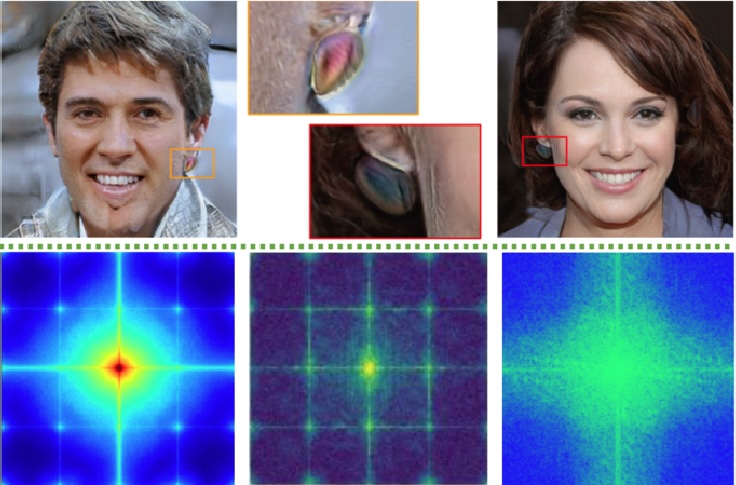

Αυτό οφείλεται στο γεγονός ότι τα deepfakes δημιουργούνται από συστήματα μηχανικής μάθησης που αφήνουν πίσω τους λεπτά ψηφιακά μοτίβα.

Αυτά τα μοτίβα είναι πολύ μικρά ή πολύπλοκα για να τα παρατηρήσει το ανθρώπινο μάτι. Μπορούν όμως να εντοπιστούν από άλλους αλγορίθμους.

Ένα αξιόπιστο σύστημα επαλήθευσης βίντεο με τεχνητή νοημοσύνη μπορεί να αναλύσει πολλαπλά επίπεδα ενός βίντεο ταυτόχρονα, όπως:

- Ανάλυση σε επίπεδο πλαισίου ελέγχει κάθε καρέ για οπτικά σφάλματα όπως παράξενες υφές, αναντιστοιχίες φωτισμού ή προβλήματα ανάμειξης γύρω από πρόσωπα.

- Ανάλυση χρονικής συνοχής εξετάζει την κίνηση σε όλα τα καρέ για να βρει αφύσικα άλματα ή ασυνεπείς κινήσεις.

- Παρακολούθηση ορόσημου προσώπου παρακολουθεί την κίνηση των ματιών, το ανοιγόκλεισμα των ματιών και το σχήμα του προσώπου για να ανιχνεύει αφύσικες αλλαγές.

- Δοκιμή οπτικοακουστικού συγχρονισμού ελέγχει αν οι κινήσεις των χειλιών ταιριάζουν ακριβώς με τις προφορικές λέξεις.

- Ιατροδικαστική ήχου αναλύει τη φωνή για ενδείξεις κλωνοποίησης, όπως ασυνήθιστα μοτίβα ήχου ή ρομποτικούς τόνους.

- Ανάλυση μεταδεδομένων και συμπίεσης η εξέταση των δεδομένων του κρυμμένου αρχείου είναι ζωτικής σημασίας για την ανίχνευση νομικής απάτης, ώστε να διαπιστωθεί αν ταιριάζουν με τα στοιχεία της αρχικής εγγραφής.

Εκπαίδευση των νομικών ομάδων για την απάτη με βίντεο

Δεδομένου ότι η τεχνητή νοημοσύνη μπορεί πλέον να μιμηθεί την ανθρώπινη συμπεριφορά με τρομακτική ακρίβεια, οι δικηγορικές εταιρείες χρησιμοποιούν αυτοματοποιημένη ανάλυση αποδεικτικών στοιχείων και ένα μείγμα παραδοσιακών τακτικών για να παραμείνουν μπροστά.

| Κατηγορία | Μέθοδος | Περιγραφή |

| Επίσημοι τρόποι | Μονάδες CLE (Συνεχιζόμενη Νομική Εκπαίδευση) | Υποχρεωτικά ή κατ' επιλογήν μαθήματα που διδάσκουν στους δικηγόρους πώς να πιστοποιούν την αυθεντικότητα των ψηφιακών αποδεικτικών στοιχείων, να κατανοούν τα "deepfakes" και να πληρούν τα αποδεικτικά πρότυπα. |

| Δικαστικά διορισμένοι εμπειρογνώμονες Τεχνητής Νοημοσύνης | Καθιέρωση πιστοποιημένων εμπειρογνωμόνων ιατροδικαστών ΤΝ, παρόμοιων με τους εμπειρογνώμονες DNA, για την αξιολόγηση αμφισβητούμενων αποδεικτικών στοιχείων βίντεο στο δικαστήριο. | |

| Μη επίσημοι τρόποι | Εσωτερική κόκκινη ομάδα | Πρόσληψη επαγγελματιών κυβερνοασφάλειας για να ελέγξουν κατά πόσον πλαστά ή παραποιημένα αποδεικτικά στοιχεία μπορούν να περάσουν από τα συστήματα εισαγωγής της επιχείρησης. |

| “Πρωτόκολλο ”Vibe Check" | Εκπαίδευση του προσωπικού να εντοπίζει κοινά προειδοποιητικά σημάδια όπως αφύσικο ανοιγοκλείσιμο των ματιών, παραμορφωμένα χαρακτηριστικά ή προβλήματα συγχρονισμού των χειλιών πριν από την κλιμάκωση για εγκληματολογική εξέταση. |

Εργαλεία και τεχνολογία για την επικύρωση αποδεικτικών στοιχείων

Το 2026, έχουμε ξεπεράσει την απλή επιθεώρηση με τα μάτια.

Επειδή η τεχνητή νοημοσύνη είναι πλέον ικανή να ξεγελάσει ακόμη και τους πιο έμπειρους ερευνητές, οι νομικές ομάδες χρησιμοποιούν ένα συγκεκριμένο σύνολο εργαλείων για να επαληθεύσουν ότι αυτό που βλέπουν είναι η απόλυτη αλήθεια.

Η τεχνολογία πίσω από την επικύρωση αποδεικτικών στοιχείων

- Ανιχνευτές Deepfake: Πρόκειται για εξειδικευμένα προγράμματα λογισμικού που σαρώνουν για αντικείμενα GAN. Πρόκειται για μικροσκοπικά, μαθηματικά μοτίβα ή θόρυβο που αφήνουν πίσω τους τα μοντέλα τεχνητής νοημοσύνης που παράγουν συνθετικά πρόσωπα. Ενώ ο άνθρωπος βλέπει ένα πρόσωπο, ο ανιχνευτής βλέπει μια ψηφιακή υπογραφή που δεν ανήκει.

- TruthScan είναι ένας βαθύς ανιχνευτής ψεύτικων εικόνων που σαρώνει βίντεο καρέ-καρέ για σημάδια ΤΝ, όπως ασυνήθιστο ανοιγοκλείσιμο των ματιών, περίεργα σχήματα προσώπου ή σφάλματα εικονοστοιχείων όπου προστίθεται ένα ψεύτικο πρόσωπο.

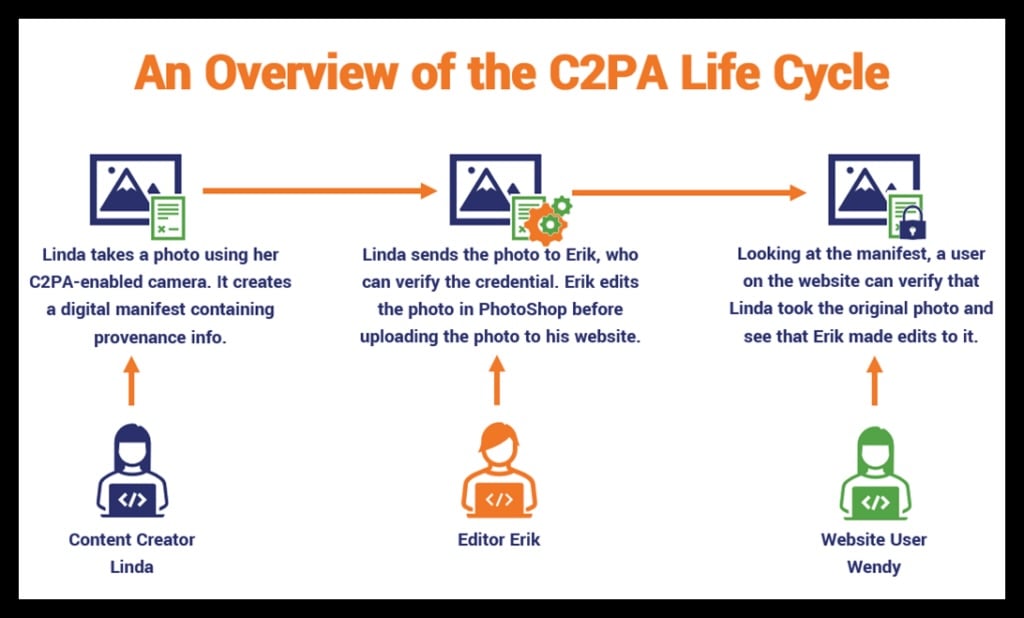

- Χρονοσφραγίδες Blockchain: Για να αποδειχθεί ότι ένα βίντεο δεν έχει πειραχτεί από τη στιγμή που καταγράφηκε, πολλές υπηρεσίες χρησιμοποιούν πλέον το πρότυπο C2PA. Όταν ένα βίντεο καταγράφεται σε μια συμβατή συσκευή, δημιουργείται ένα μοναδικό ψηφιακό δακτυλικό αποτύπωμα (hash) και αποθηκεύεται σε μια αλυσίδα μπλοκ (blockchain).

- Το TruthScan μπορεί να ελέγξει αν αυτό το αποτύπωμα ταιριάζει με το βίντεο, δείχνοντας αν το αρχείο έχει υποστεί επεξεργασία ή αν έχει παραβιαστεί η αλυσίδα φύλαξης.

- Εργαλεία εγκληματολογικής ανάλυσης μεταδεδομένων: Κάθε ψηφιακό αρχείο έχει ένα πιστοποιητικό γέννησης γνωστό ως δεδομένα Exif. Αυτά τα εργαλεία ελέγχουν αν ένα αρχείο αποθηκεύτηκε εκ νέου σε λογισμικό επεξεργασίας AI ή αν τα δεδομένα θέσης (GPS) έχουν παραποιηθεί. Εάν ένα βίντεο ισχυρίζεται ότι προέρχεται από κάμερα καταστήματος, αλλά τα μεταδεδομένα δείχνουν ότι εξήχθη από πρόγραμμα επεξεργασίας βίντεο, έχετε πρόβλημα.

- Το Amped Software και το TruthScan εξετάζουν τα κρυφά δεδομένα αρχείων (Exif, επικεφαλίδες) για να διαπιστώσουν αν το βίντεο έχει υποστεί επεξεργασία ή επεξεργασία με τεχνητή νοημοσύνη.

Τάσεις στην Τεχνητή Νοημοσύνη για την απόδειξη βίντεο

Ακολουθούν οι τρεις τάσεις του 2026.

- Γενετική αντιφατική εγκληματολογία: ΤΝ εναντίον ΤΝ

Ο πιο εξελιγμένος τρόπος για να πιάσετε ένα deepfake το 2026 είναι να χρησιμοποιήσετε την ίδια τεχνολογία που το δημιούργησε. Αυτό είναι γνωστό ως Generative Adversarial Forensics.

- Μια τεχνητή νοημοσύνη (η γεννήτρια) προσπαθεί να δημιουργήσει ένα ψεύτικο, ενώ μια άλλη τεχνητή νοημοσύνη (ο διαχωριστής) προσπαθεί να το πιάσει. Στη δικαστική αίθουσα, εργαλεία όπως το TruthScan μπορούν να αποτελέσουν τον απόλυτο διαχωριστή.

- Παράδειγμα: Ο ενάγων υποβάλλει βίντεο με έναν διευθύνοντα σύμβουλο να συνάπτει προφορική σύμβαση. Το TruthScan σαρώνει το βίντεο χρησιμοποιώντας τα δικά του αντιφατικά μοντέλα για να ανιχνεύσει τεχνουργήματα GAN. Εάν το λογισμικό επισημάνει μια συνθετική πιθανότητα 98%, το αποδεικτικό στοιχείο είναι πιθανότατα μια πλαστογράφηση για να ξεγελάσει τα ανθρώπινα μάτια.

- Ανάλυση συγχρονισμού ήχου-βίντεο (Ο κανόνας των 0,01ms)

Οι άνθρωποι μπορούν συνήθως να εντοπίσουν μια καθυστέρηση αν ο ήχος ενός βίντεο απέχει περίπου 40-80 χιλιοστά του δευτερολέπτου. Ωστόσο, οι απομιμήσεις του 2026 είναι συχνά σχεδόν τέλειες.

- Τα σύγχρονα εγκληματολογικά εργαλεία τεχνητής νοημοσύνης αναζητούν πλέον μια καθυστέρηση 0,01 χιλιοστών του δευτερολέπτου μεταξύ του φωνητικού ήχου μιας λέξης και της μηχανικής κίνησης των χειλιών.

- Παράδειγμα: Σε μια υπόθεση παρενόχλησης του 2026, ένας εναγόμενος ισχυρίστηκε ότι ένα βίντεο ήταν πλαστό. Η αυτοματοποιημένη εγκληματολογική ανάλυση των αποδεικτικών στοιχείων έδειξε ότι τα σχήματα των χειλιών “M” και “B” ήταν 0,02ms εκτός συγχρονισμού με τον ήχο. Αυτό το μικροσκοπικό σφάλμα αποδεικνύει ότι η φωνή ήταν κλωνοποιημένη και τοποθετημένη πάνω σε ένα διαφορετικό βίντεο, οδηγώντας σε απόρριψη της αγωγής.

- Cheapfakes vs. Deepfakes

Ενώ τα deepfakes χρησιμοποιούν υψηλής τεχνολογίας τεχνητή νοημοσύνη, τα cheapfakes είναι η πιο κοινή μορφή απάτης βίντεο.

- Ένα Deepfake δημιουργεί μια πραγματικότητα που δεν συνέβη ποτέ (όπως μια ανταλλαγή προσώπων). Ένα Cheapfake παίρνει πραγματικό υλικό και αλλάζει το πλαίσιο ή την πρόθεση χρησιμοποιώντας απλά εργαλεία.

- Παράδειγμα (Η επιβράδυνση): Ένα βίντεο ενός πολιτικού που εμφανίζεται μεθυσμένος ή με προβλήματα υγείας μπορεί να δημιουργηθεί απλά επιβραδύνοντας το υλικό κατά 20% και ρυθμίζοντας το βήμα του ήχου.

- Παράδειγμα (Το νέο πλαίσιο): Πλάνα από μια διαμαρτυρία του 2022 σε άλλη χώρα δημοσιεύονται το 2026 ως ζωντανή απόδειξη μιας τοπικής εξέγερσης. Οι νομικές ομάδες χρησιμοποιούν τώρα την ανάλυση μεταδεδομένων της TruthScan για να αποδείξουν την πραγματική ημερομηνία γέννησης του βίντεο.

Πώς το TruthScan προστατεύει τα νομικά αποδεικτικά στοιχεία βίντεο

Το TruthScan διασφαλίζει ότι κάθε καρέ που παρουσιάζετε στο δικαστήριο είναι αυθεντικό, επαληθευμένο και νομικά υπερασπίσιμο.

Η πλατφόρμα βελτιώνει την επαλήθευση βίντεο AI μέσω των ακόλουθων πλεονεκτημάτων:

Αυτοματοποιημένα αρχεία καταγραφής ελέγχου & τεκμηρίωση αλυσίδας φύλαξης

- Αξιοπιστία έτοιμη για το δικαστήριο: Δημιουργεί αναφορές PDF και JSON που τεκμηριώνουν κάθε βήμα επαλήθευσης με ακριβείς βαθμολογίες εμπιστοσύνης και χρονοσφραγίδες.

- Κορυφαία συμμόρφωση: Μπορείτε να είστε ήσυχοι γνωρίζοντας ότι τα δεδομένα σας παραμένουν ασφαλή και πληρούν αυστηρά παγκόσμια πρότυπα όπως τα SOC 2, ISO 27001 και GDPR.

- Ευέλικτος έλεγχος δεδομένων: Διατηρήστε τα ευαίσθητα στοιχεία εντός της απαιτούμενης δικαιοδοσίας σας με τις επιλογές εγκατάστασης on-premise ή VPC που έχουν σχεδιαστεί για κλάδους με αυστηρά ρυθμισμένες προδιαγραφές.

Επεξεργασία παρτίδων & ενσωμάτωση API για νομικές ροές εργασίας

- Μαζική εξοικονόμηση χρόνου: Επεξεργασία χιλιάδων αρχείων από πακέτα ανακάλυψης ή σύνολα επιτήρησης ταυτόχρονα με τη χρήση μαζικών εισαγωγών αποθήκευσης (S3/GCS).

- Απρόσκοπτη ηλεκτρονική ανακάλυψη: Βελτιστοποιήστε τις λειτουργίες σας ενσωματώνοντας την επαλήθευση απευθείας στο υπάρχον λογισμικό σας μέσω webhooks και API.

- Εξάλειψη των χειροκίνητων σφαλμάτων: Αυτοματοποιήστε το πρώτο πέρασμα του ελέγχου των αποδεικτικών στοιχείων, ώστε η ομάδα σας να μπορεί να επικεντρωθεί στη στρατηγική αντί για τον κουραστικό έλεγχο αρχείου προς αρχείο.

Επαλήθευση σε πραγματικό χρόνο για καταθέσεις και απομακρυσμένες ακροάσεις

- Σταματήστε τη μίμηση: Χρήση τελικών σημείων ζωντανής ροής για να ανιχνεύσετε εάν ένας καταθέτης χρησιμοποιεί φίλτρα deepfake ή κλώνους φωνής κατά τη διάρκεια μιας απομακρυσμένης ακρόασης.

- Διατήρηση της ακεραιότητας του δικαστηρίου: Σημειώστε οπτικές ή ακουστικές ανωμαλίες σε πραγματικό χρόνο, αποτρέποντας την καταγραφή δόλιων μαρτυριών.

- Ειρήνη του μυαλού: Παρέχετε στους πελάτες σας και στο δικαστήριο ένα επιπλέον επίπεδο ασφάλειας που εγγυάται ότι το πρόσωπο που εμφανίζεται στην οθόνη είναι ακριβώς αυτό που ισχυρίζεται ότι είναι.

Μάθετε περισσότερα σχετικά με τη διασφάλιση των αποδείξεων βίντεο AI

Προστατέψτε την επιχείρησή σας από τους κινδύνους των χειραγωγημένων μέσων ενημέρωσης. Ο ανιχνευτής deepfake της TruthScan και η τεχνολογία AI video detector παρέχουν την απόλυτη λύση για την ηλεκτρονική ανακάλυψη και τη νομική επαλήθευση.

Είστε έτοιμοι να δείτε το TruthScan σε δράση;

- Επισκεφθείτε το truthscan.com για να πάρετε δωρεάν 20.000 μονάδες.

- Για ερωτήσεις σχετικά με επιχειρήσεις, ενσωμάτωση API ή προσαρμοσμένες επιλογές ανάπτυξης, επικοινωνήστε με την ομάδα τους στη διεύθυνση Truthscan.com/contact.