In den 90er Jahren war es die DNA.

In den 2000er Jahren waren es die Pings der Mobilfunkmasten.

Aber im Jahr 2026 ist der neue Goldstandard der Beweisführung der digitale Fingerabdruck.

Sehen Sie es mal so...

Jede Videodatei hat eine eindeutige Signatur.

Wenn auch nur ein einziges Pixel von der KI verändert wird, ändert sich der Fingerabdruck sofort.

Wenn Ihr KI-Beweis nicht mit einem verifizierten Blockchain-Zeitstempel versehen ist, um den Fingerabdruck zu fixieren, könnte er in den Augen eines modernen Richters genauso gut eine Karikatur sein.

Dies bedeutet, dass die Ära des “Sehen und Glauben” vorbei ist.

Wir sind in die Ära der KI-Videoverifikation eingetreten, in der der Beweis nicht in dem liegt, was man sieht, sondern in dem digitalen Code, der unter der Oberfläche verborgen ist.

In diesem Blog gehen wir der Frage nach, warum herkömmliche Beweismittel bei der Bekämpfung von Videobetrug versagen, wie man manipulierte Clips erkennt, warum die Verifizierung für die Zulässigkeit entscheidend ist und warum ein KI-Videodetektor wie TruthScan für Rechtsteams heute unverzichtbar ist.

Lassen Sie uns eintauchen.

Wichtigste Erkenntnisse

- Im Jahr 2026 müssen alle Videobeweise einer KI-Videoüberprüfung unterzogen werden, um als zuverlässig zu gelten.

- Zum Videobetrug gehören auch kleine Bearbeitungen wie die Manipulation von Zeitstempeln, nicht nur vollständige Gesichtsvertauschungen.

- Ein professioneller Deepfake-Detektor ist die einzige Möglichkeit, GAN-Artefakte zu erkennen, die Menschen übersehen.

- Neue Regeln wie Federal Rule 707 standardisieren die Zulassung von AI-Beweisen vor Gericht.

- Die automatisierte Analyse von Beweismitteln ermöglicht es den Unternehmen, umfangreiche Datenpakete schnell und präzise zu bearbeiten.

- TruthScan verhindert Betrug bei Live-Anhörungen, indem es synthetische Masken in Echtzeit erkennt.

Was sind Videobeweise in Rechtsstreitigkeiten?

Videobeweise sind im Grunde genommen alle aufgezeichneten Clips, die vor Gericht verwendet werden, um zu beweisen, was passiert ist. Ob in Strafsachen oder bei der Regulierung von Versicherungsangelegenheiten - es gibt sie überall.

Im Jahr 2026 ist die Annahme “Sehen ist Glauben” aufgrund der Zunahme von Videobetrug jedoch gefährlich geworden. Juristen benötigen jetzt eine robuste KI-Videoüberprüfung, um die Integrität des Justizsystems zu gewährleisten.

Arten von Videobeweisen, die von Gerichten tagtäglich verwendet werden

Machen Sie sich nie wieder Sorgen über KI-Betrug. TruthScan Kann Ihnen helfen:

- Erkennen Sie AI-generierte Bilder, Text, Sprache und Video.

- Vermeiden Sie KI-gesteuerter Betrug in großem Umfang.

- Schützen Sie Ihre wichtigsten empfindlich Unternehmensvermögen.

- Überwachung (CCTV): Kameras von Geschäften oder Verkehrsampeln. Dies ist der häufigste Beweis in Strafsachen.

- Körperkameras: Filmmaterial von Polizeibeamten, das meist in Fällen von Bürgerrechten oder übermäßiger Gewaltanwendung verwendet wird.

- Dashcams: Der beste Beweis für Autounfälle und Versicherungsstreitigkeiten.

- Aufgezeichnete Zeugenaussagen: Videovernehmungen oder Zeugenaussagen aus der Ferne, die seit der Pandemie normal geworden sind. Sie sind inzwischen Standard, aber anfällig für rechtliche Probleme bei der Aufdeckung von Betrug.

- Smartphone und soziale Medien: Videos von Unbeteiligten oder Beiträge, die das Verhalten oder den Standort einer Person belegen.

- Sicherheit des Unternehmens: Filmmaterial, das von Unternehmen in Fällen von Betrug oder “unrechtmäßiger Entlassung” verwendet wird.

Generative KI und Deepfake-Technologie haben eine neue Risikoebene geschaffen. Im Jahr 2025:

- 1 von 20 Identitätsüberprüfungen wurden durch KI-Deepfakes getäuscht

- Eine Medius-Umfrage ergab, dass 43% der Berufstätigen waren Opfer eines Betrugsversuchs mit Deepfakes geworden

Reale Fälle von Videobeweis-Betrug

- Manipulierte Clips im Gerichtssaal

Manipulierte Gerichtsausschnitte sind Video- oder Audiobeweise, die in einem Gerichtsverfahren vorgelegt werden und die mit Hilfe von Technologie verändert, bearbeitet oder vollständig fabriziert wurden.

Beispiele:

- Alameda county deepfake Fall (2025): Ein kalifornischer Zivilprozess wurde abgewiesen, nachdem das Gericht festgestellt hatte, dass ein als Beweismittel vorgelegtes Zeugenvideo vollständig mit Hilfe von KI erstellt worden war.

- Die Verteidigung von Sz Huang und Tesla gegen Fälschungen (2023): In einer Klage wegen widerrechtlicher Tötung haben die Anwälte von Tesla behauptet, dass wichtige Aufnahmen des Unfalls eine Fälschung sein könnten.

Veränderte Überwachungsvideos

Überwachungsvideos sind eine der häufigsten Arten von KI-Beweisen, die vor Gericht verwendet werden. Viele Menschen denken jedoch fälschlicherweise, dass Manipulationen nur bei vollständigen Fälschungen vorkommen.

In Wirklichkeit geschieht Videobetrug oft auf kleinere, weniger offensichtliche Weise, die einen Fall gefährden kann.

Zu den üblichen Arten der Manipulation gehören:

- Änderungen des Zeitstempels

- Entfernung des Rahmens

- Metadaten oder GPS-Änderungen

- Gesicht ersetzen

- Entfernen oder Einführen von Objekten

- Filmmaterial in Schleife

- Verschlechterung der Qualität

Überwachungsvideos stammen oft von vielen verschiedenen Orten, z. B. von privaten Geschäften, Haustürklingeln, Parkplätzen und städtischen Kameras. Anders als die Aufnahmen von Polizeikameras unterliegen diese Systeme in der Regel nicht den strengen Regeln der Beweiskette.

Das bedeutet:

- Möglicherweise gibt es keine eindeutigen Aufzeichnungen darüber, wer die Akte bearbeitet hat.

- Das Filmmaterial kann mehrfach kopiert, übertragen oder konvertiert werden.

- Die Authentifizierungsverfahren können schwach oder uneinheitlich sein.

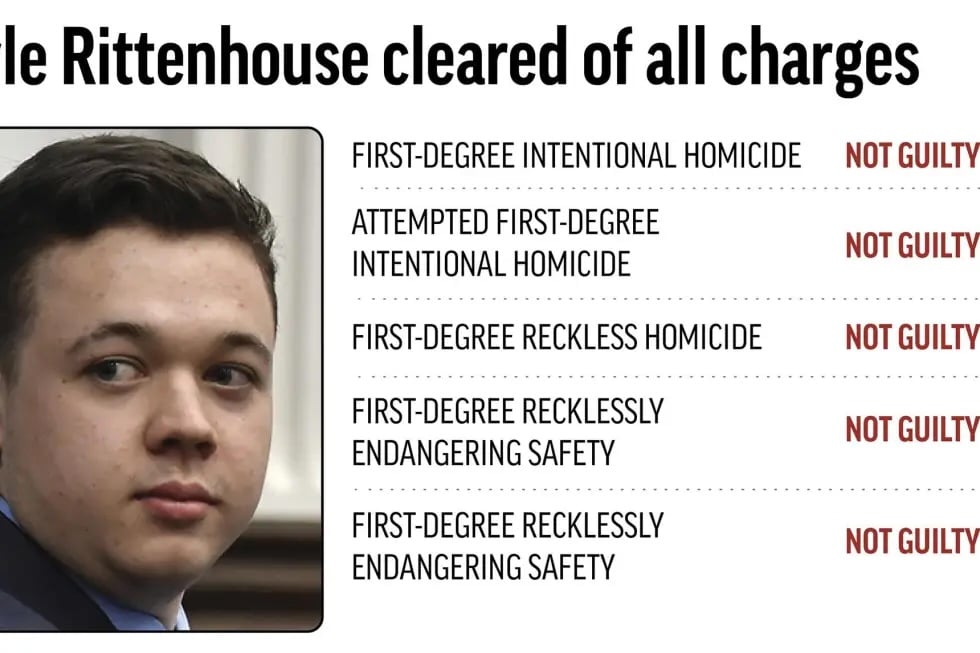

Beispiel: Der Fall Wisconsin vs. Rittenhouse AI Enhancement

Ein berühmtes Beispiel stammt aus dem Prozess Wisconsin gegen Rittenhouse. Die Staatsanwaltschaft versuchte, die Pinch-to-Zoom-Funktion eines iPads zu nutzen, um Details in einem Drohnenvideo zu zeigen.

Die Verteidigung argumentierte, dass Apples Zoom eine KI-Interpolation verwendet, um zu erraten, was dort zu sehen sein sollte. Der Richter entschied, dass das erweiterte Filmmaterial ohne einen professionellen KI-Videodetektor nicht zugelassen werden kann.

Umstrittene Video-Zeugnisse

Eine strittige Videoaussage erfordert in der Regel eine juristische Betrugserkennung, um festzustellen, ob es sich um eine Aufnahme handelt:

- Eine vollständig gefälschte Aussage oder Erklärung

- Ein echtes Zeugnis als Fälschung angefochten

- Eine manipulierte Realaufnahme

Jedes dieser Szenarien ist für das Gericht mit einem erheblichen Authentifizierungsaufwand verbunden.

Beispiel: Das britische Sorgerecht für Kinder

In einem von der University of Baltimore Law Review zitierten Streitfall vor einem britischen Familiengericht legte eine Mutter eine stark veränderte Aufnahme vor, um den Vater während eines Sorgerechtsstreits als gewalttätig darzustellen.

Ziel war es, seinen Zugang zu seinen Kindern zu beschränken.

Der Aufstieg von KI-generierten Videos in Rechtsangelegenheiten

Die Entwicklung hin zur heutigen Ära der Deepfake-Detektoren vollzog sich in verschiedenen Phasen:

- Die Frühwarnjahre (2017-2021)

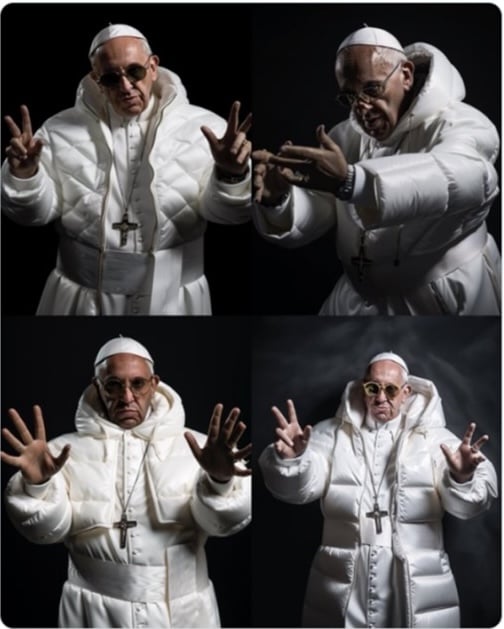

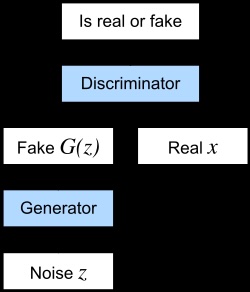

Die Deepfake-Technologie (angetrieben durch generative adversarische Netzwerke (GANs)) trat 2017 an die Öffentlichkeit.

Frühe Fälschungen waren oft von minderer Qualität: Gesichter mit seltsamen Verzerrungen, zusätzlichen Fingern, falscher Beleuchtung und unscharfen Gesichtszügen, so dass sie leicht zu erkennen waren.

- Die Eskalationsphase (2022-2023)

Bis 2022 verbesserte sich die Technologie. Viele waren kostenlos und auf einem Smartphone nutzbar.

Im Jahr 2023 kam es zu ersten bedeutenden Anfechtungen von Deepfakes in Gerichtsverfahren, darunter Sz Huang v. Tesla, United States v. Reffitt und United States v. Doolin, in denen Anwälte die Frage aufwarfen, ob Videobeweise möglicherweise durch KI generiert wurden.

Etwa zur gleichen Zeit begann das Advisory Committee on Evidence Rules der American Bar Association offiziell mit der Untersuchung dieser Frage.

- Die kritische Schwelle (2024-2025)

KI-generierte Inhalte blieben nicht lange akademisch. Im Jahr 2024 ereignete sich ein Vorfall im Ingenieurbüro Arup, bei dem ein KI-generierter gefälschter Videoanruf, der betrügerische Überweisungen in Höhe von $25 Millionen.

Das Rechtssystem begann zu reagieren.

Im Jahr 2025, Louisiana verabschiedete HB 178, und schuf damit den ersten Rahmen für die Überprüfung von KI-Nachweisen auf staatlicher Ebene.

Auf Bundesebene hat das U.S. Advisory Committee on Evidence Rules vorgeschlagen Regel 707, die sich auf maschinell erzeugte Beweise konzentriert.

Der Stand der Dinge im Jahr 2026

Ab Anfang 2026 hat sich die Regulierung von Deepfake und KI-Videos landesweit beschleunigt:

- 46 Staaten haben irgendeine Form von Deepfake-Gesetzgebung verabschiedet.

- Seit 2022, 169 Gesetze wurden erlassen und 146 Gesetzesentwürfe wurden allein im Jahr 2025 eingebracht..

- Federal Rule 707 ist für öffentliche Kommentare geöffnet bis zum 16. Februar 2026.

Verbesserte Videoüberprüfung mit KI

Der effektivste Weg, KI-generierte Videos zu erkennen, ist die Verwendung von KI selbst.

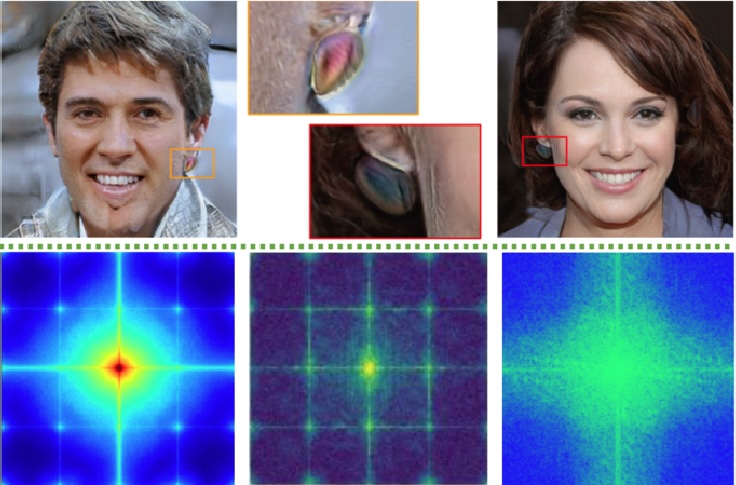

Dies liegt daran, dass Deepfakes von maschinellen Lernsystemen erstellt werden, die subtile digitale Muster hinterlassen.

Diese Muster sind zu klein oder zu komplex, als dass das menschliche Auge sie erkennen könnte. Aber sie können von anderen Algorithmen erkannt werden.

Ein zuverlässiges KI-Videoverifikationssystem kann mehrere Ebenen eines Videos gleichzeitig analysieren, darunter auch die folgenden:

- Analyse auf Rahmenebene prüft jedes Bild auf visuelle Fehler wie seltsame Texturen, unpassende Beleuchtung oder Überblendungsprobleme bei Gesichtern.

- Zeitliche Kohärenzanalyse untersucht die Bewegung über Frames hinweg, um unnatürliche Sprünge oder inkonsistente Bewegungen zu finden.

- Verfolgung von Gesichtsmerkmalen überwacht Augenbewegungen, Blinzeln und Gesichtsform, um unnatürliche Veränderungen zu erkennen.

- Prüfung der audiovisuellen Synchronisation prüft, ob die Lippenbewegungen genau mit den gesprochenen Worten übereinstimmen.

- Audio-Forensik analysiert die Stimme auf Anzeichen des Klonens, wie ungewöhnliche Klangmuster oder roboterhafte Töne.

- Analyse von Metadaten und Komprimierung Die Prüfung versteckter Dateidaten ist für die Aufdeckung von Rechtsbetrug unerlässlich, um festzustellen, ob sie mit den ursprünglichen Aufzeichnungsdaten übereinstimmen.

Aufklärung von Rechtsteams über Videobetrug

Da KI inzwischen menschliches Verhalten mit erschreckender Genauigkeit nachahmen kann, nutzen Anwaltskanzleien automatisierte Beweisanalysen und eine Mischung aus traditionellen Taktiken, um die Nase vorn zu haben.

| Kategorie | Methode | Beschreibung |

| Offizielle Wege | CLE (kontinuierliche juristische Ausbildung) Credits | Pflicht- oder Wahlfächer, in denen Juristen lernen, wie sie digitale Beweise authentifizieren, Deepfakes verstehen und Beweisstandards einhalten können. |

| Gerichtlich bestellte AI-Sachverständige | Einrichtung von zertifizierten KI-Forensikern, ähnlich wie DNA-Experten, die strittige Videobeweise vor Gericht auswerten. | |

| Nicht-offizielle Wege | Internes Red-Teaming | Beauftragung von Cybersicherheitsexperten mit der Prüfung, ob gefälschte oder manipulierte Beweise durch die Aufnahmesysteme des Unternehmens gelangen können. |

| “Vibe Check”-Protokoll | Schulung des Personals, um häufige Deepfake-Warnzeichen wie unnatürliches Blinzeln, verzerrte Gesichtszüge oder Lippensynchronitätsprobleme zu erkennen, bevor eine forensische Überprüfung eingeleitet wird. |

Werkzeuge und Technologie für die Validierung von Beweisen

Im Jahr 2026 haben wir die einfache Sichtprüfung hinter uns gelassen.

Da KI heute in der Lage ist, selbst die erfahrensten Ermittler zu täuschen, verwenden Rechtsteams eine Reihe spezieller Tools, um zu überprüfen, ob das, was sie sehen, die absolute Wahrheit ist.

Die Technologie hinter der Evidenzvalidierung

- Deepfake-Detektoren: Dies sind spezielle Softwareprogramme, die nach GAN-Artefakten suchen. Dabei handelt es sich um mikroskopisch kleine, mathematische Muster oder Rauschen, die von den KI-Modellen hinterlassen werden, die synthetische Gesichter erzeugen. Während ein Mensch ein Gesicht sieht, sieht der Detektor eine digitale Signatur, die nicht dazugehört.

- TruthScan ist ein Deepfake-Detektor, der Videos Bild für Bild auf KI-Zeichen wie ungewöhnliches Blinzeln, seltsame Gesichtsformen oder Pixelfehler, bei denen ein falsches Gesicht hinzugefügt wurde, überprüft.

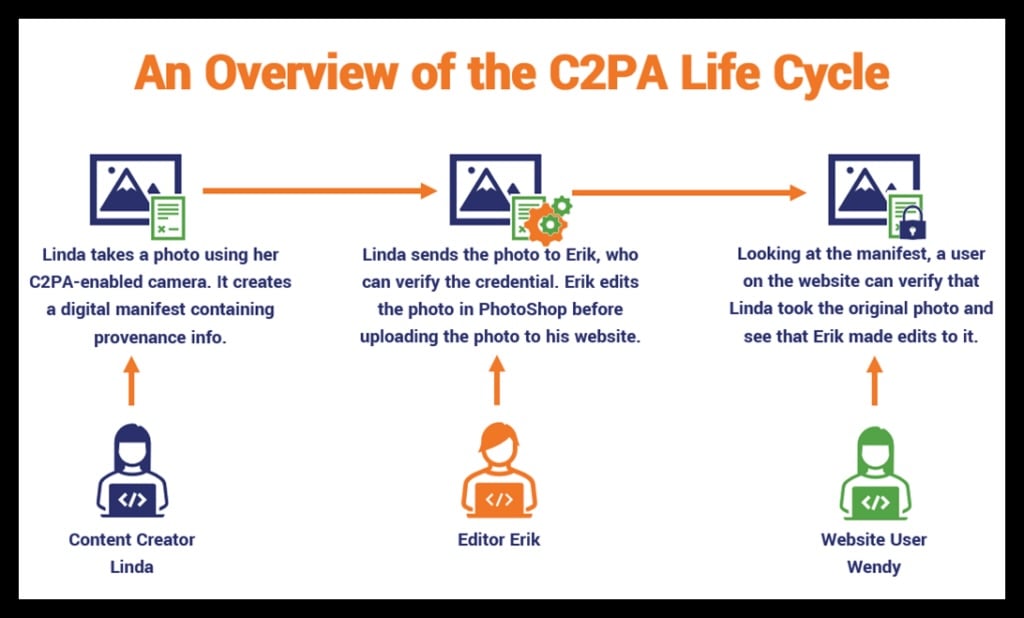

- Blockchain-Zeitstempel: Um nachzuweisen, dass ein Video seit der Aufzeichnung nicht mehr verändert wurde, verwenden viele Behörden inzwischen den C2PA-Standard. Wenn ein Video mit einem konformen Gerät aufgezeichnet wird, wird ein eindeutiger digitaler Fingerabdruck (Hash) erstellt und in einer Blockchain gespeichert.

- TruthScan kann prüfen, ob dieser Fingerabdruck mit dem Video übereinstimmt, und so feststellen, ob die Datei bearbeitet oder die Überwachungskette unterbrochen wurde.

- Forensische Metadaten-Tools: Jede digitale Datei hat eine Geburtsurkunde, die so genannten Exif-Daten. Diese Tools prüfen, ob eine Datei in einer AI-Bearbeitungssoftware neu gespeichert wurde oder ob die Standortdaten (GPS) gefälscht wurden. Wenn ein Video behauptet, von einer Speicherkamera zu stammen, aber die Metadaten zeigen, dass es aus einem Videoeditor exportiert wurde, haben Sie ein Problem.

- Amped Software und TruthScan untersuchen verborgene Dateidaten (Exif, Kopfzeilen), um festzustellen, ob das Video bearbeitet oder mit künstlicher Intelligenz ausgestattet wurde.

Trends im AI-Videobeweis

Das sind die drei Trends für 2026.

- Generative kontradiktorische Forensik: KI vs. KI

Die fortschrittlichste Methode, einen Deepfake im Jahr 2026 zu erkennen, ist die Verwendung derselben Technologie, die ihn erzeugt hat. Dies ist als Generative Adversarial Forensics bekannt.

- Eine KI (der Generator) versucht, eine Fälschung zu erstellen, während eine andere KI (der Diskriminator) versucht, sie zu erkennen. Im Gerichtssaal können Tools wie TruthScan der ultimative Unterscheidungsfaktor sein.

- Beispiel: Ein Kläger reicht ein Video ein, in dem ein Geschäftsführer einen mündlichen Vertrag abschließt. TruthScan scannt das Video mit seinen eigenen gegnerischen Modellen, um GAN-Artefakte zu erkennen. Wenn die Software eine synthetische 98%-Wahrscheinlichkeit anzeigt, handelt es sich wahrscheinlich um eine Fälschung, um menschliche Augen zu täuschen.

- Audio-Video-Synchronisationsanalyse (Die 0,01ms-Regel)

Menschen können in der Regel eine Verzögerung erkennen, wenn der Ton eines Videos um etwa 40-80 Millisekunden abweicht. Deepfakes aus dem Jahr 2026 sind jedoch oft nahezu perfekt.

- Moderne forensische KI-Tools suchen heute nach einer Verzögerung von 0,01 Millisekunden zwischen dem phonetischen Klang eines Wortes und der mechanischen Bewegung der Lippen.

- Beispiel: In einem Fall von Belästigung aus dem Jahr 2026 behauptete ein Angeklagter, ein Video sei gefälscht. Die automatisierte forensische Beweisanalyse ergab, dass die Lippenformen “M” und “B” um 0,02 ms von der Synchronisation mit dem Ton abwichen. Dieser mikroskopische Fehler beweist, dass die Stimme geklont und über ein anderes Video gelegt wurde, was zu einer Klageabweisung führte.

- Cheapfakes vs. Deepfakes

Während bei Deepfakes hochentwickelte KI zum Einsatz kommt, sind Cheapfakes die häufigste Form des Videobetrugs.

- Ein Deepfake schafft eine Realität, die nie stattgefunden hat (wie ein Gesichtstausch). Ein Cheapfake nimmt echtes Filmmaterial und verändert den Kontext oder die Absicht mit einfachen Mitteln.

- Beispiel (Der Slow-Down): Ein Video, in dem ein Politiker betrunken oder beeinträchtigt erscheint, kann einfach durch Verlangsamung des Filmmaterials um 20% und Anpassung der Tonhöhe erstellt werden.

- Beispiel (The Re-Context): Filmmaterial von einer Demonstration im Jahr 2022 in einem anderen Land wird im Jahr 2026 als Live-Beweis für einen lokalen Aufstand veröffentlicht. Rechtsteams nutzen nun die Metadatenanalyse von TruthScan, um das tatsächliche Geburtsdatum des Videos nachzuweisen.

Wie TruthScan legale Videobeweise schützt

TruthScan stellt sicher, dass jedes Bild, das Sie vor Gericht präsentieren, authentisch, verifiziert und rechtlich vertretbar ist.

Die Plattform optimiert die KI-Videoüberprüfung durch die folgenden Vorteile:

Automatisierte Prüfprotokolle und Dokumentation der Lieferkette (Chain-of-Custody)

- Gerichtstaugliche Verlässlichkeit: Generiert PDF- und JSON-Berichte, die jeden Überprüfungsschritt mit genauen Vertrauenswerten und Zeitstempeln dokumentieren.

- Top-Tier Compliance: Sie können sich beruhigt zurücklehnen, denn Ihre Daten sind sicher und erfüllen strenge globale Standards wie SOC 2, ISO 27001 und GDPR.

- Flexible Datenkontrolle: Bewahren Sie vertrauliche Beweise innerhalb Ihres Zuständigkeitsbereichs auf - mit Bereitstellungsoptionen vor Ort oder im VPC, die für stark regulierte Branchen entwickelt wurden.

Stapelverarbeitung und API-Integration für juristische Arbeitsabläufe

- Massive Zeitersparnis: Verarbeiten Sie Tausende von Dateien aus Erkennungspaketen oder Überwachungssets gleichzeitig mit Massenspeicherimporten (S3/GCS).

- Nahtlose E-Discovery: Optimieren Sie Ihre Abläufe, indem Sie die Verifizierung über Webhooks und APIs direkt in Ihre bestehende Software integrieren.

- Eliminieren Sie manuelle Fehler: Automatisieren Sie den ersten Durchgang der Beweismittelprüfung, damit sich Ihr Team auf die Strategie konzentrieren kann, anstatt mühsam Datei für Datei zu prüfen.

Echtzeitüberprüfung für Zeugenaussagen und Fernvernehmungen

- Nachahmung stoppen: Verwenden Sie Live-Streaming-Endpunkte, um zu erkennen, ob ein Zeuge während einer Fernanhörung Deepfake-Filter oder Stimmenklone verwendet.

- Wahrung der Integrität des Gerichts: Markieren Sie visuelle oder akustische Anomalien in Echtzeit, um zu verhindern, dass betrügerische Aussagen in das Protokoll aufgenommen werden.

- Seelenfrieden: Bieten Sie Ihren Kunden und dem Gericht eine zusätzliche Sicherheitsebene, die garantiert, dass die Person auf dem Bildschirm genau die ist, die sie vorgibt zu sein.

Erfahren Sie mehr über die Sicherung von AI-Videobeweisen

Schützen Sie Ihr Unternehmen vor den Risiken von manipulierten Medien. Der Deepfake-Detektor und die KI-Videodetektor-Technologie von TruthScan bieten die ultimative Lösung für E-Discovery und rechtliche Überprüfung.

Möchten Sie TruthScan in Aktion sehen?

- Besuchen Sie truthscan.de um kostenlos 20.000 Credits zu erhalten.

- Für Anfragen von Unternehmen, API-Integration oder kundenspezifische Bereitstellungsoptionen wenden Sie sich bitte an das Team unter Truthscan.com/kontakt.