Noch vor ein paar Jahren brauchte man ein professionelles Studio und viel technisches Geschick, um die Stimme eines Menschen zu imitieren.

Jetzt kann jeder, der einen Internetanschluss und etwas Zeit hat, in weniger als einer Minute einen digitalen Klon der Stimme einer beliebigen Person erstellen.

Die Werkzeuge für diese Angriffe werden immer billiger und sind jeden Tag für jedermann zugänglich. Und da so viele Menschen ihr Leben in den sozialen Medien teilen, ist es für Betrüger sehr einfach, das benötigte Material zu finden.

In diesem Artikel stellen wir Ihnen einige der berüchtigten Beispiele für Audio-Betrug vor, die in der Praxis vorkommen. Außerdem stellen wir Ihnen eine Lösung vor, mit der Sie diesen Bedrohungen rechtzeitig ein Ende setzen können.

Wichtigste Erkenntnisse

- Die Zahl der Betrugsversuche mit gefälschten Stimmen ist in den letzten Jahren um mehr als 2.137% gestiegen, was darauf zurückzuführen ist, dass moderne künstliche Intelligenz in der Lage ist, einen 85% genauen Stimmenklon mit nur drei Sekunden Tonmaterial zu erstellen.

- Zu den berüchtigten realen Angriffen gehört der Raubüberfall auf das Ingenieurbüro Arup aus dem Jahr 2024, bei dem Betrüger mit gefälschten Video- und Audioaufnahmen eines Finanzvorstands einen Angestellten dazu brachten, $25,6 Millionen zu überweisen.

- Neben dem Diebstahl in Unternehmen stellen Stimmfälschungen durch Entführungsbetrug ein ernsthaftes emotionales Risiko für Familien dar und können herkömmliche biometrische Sicherheitssysteme umgehen, die von Banken und anderen Hochsicherheitsanwendungen verwendet werden.

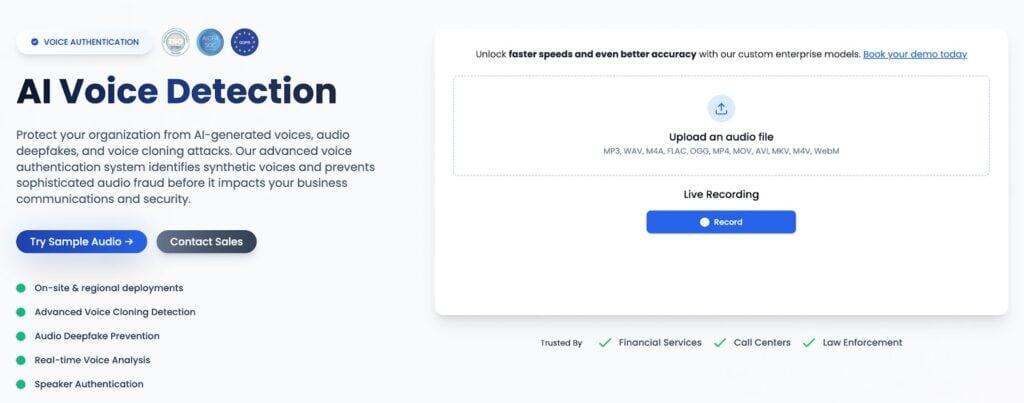

- Unternehmen sind gezwungen, die menschliche Verifizierung hinter sich zu lassen, indem sie Genehmigungsprotokolle für große Übertragungen mit mehreren Personen einführen und KI-Stimmdetektoren wie TruthScan einsetzen, um akustische Fingerabdrücke in Echtzeit zu analysieren.

- TruthScan sichert Unternehmensinteraktionen, indem es synthetische Sprachartefakte von Plattformen wie ElevenLabs und Murf mit einer Genauigkeit von über 99% in allen wichtigen Audio- und Videoformaten identifiziert.

Was sind Deepfake-Angriffe auf die Stimme?

Ein Voice Deepfake ist eine digitale Fälschung der Stimme einer Person. Der Angreifer verwendet eine Software, die jedes kleine Detail der Sprechweise einer Person anhand einer Aufnahme ihrer Stimme analysieren kann.

Um die Stimme zu klonen, versucht die Software, Muster in der Stimme zu erkennen. Hauptsächlich werden Dinge wie die Tonhöhe, der Tonfall, die Art und Weise, wie jemand zwischen den Sätzen atmet, usw. von der Software in Betracht gezogen.

Sobald es diese Muster gelernt hat, kann der Angreifer es dazu bringen, alles mit dieser Stimme zu sagen.

Machen Sie sich nie wieder Sorgen über KI-Betrug. TruthScan Kann Ihnen helfen:

- Erkennen Sie AI-generierte Bilder, Text, Sprache und Video.

- Vermeiden Sie KI-gesteuerter Betrug in großem Umfang.

- Schützen Sie Ihre wichtigsten empfindlich Unternehmensvermögen.

Das Gefährliche daran ist, dass die Tools zur Erstellung von Sprachfälschungen leicht zugänglich sind. Und die meisten von ihnen müssen nicht installiert werden. Sie sind online in Form von Websites verfügbar.

Sie müssen nur ein paar Dollar in die Hand nehmen und mit dem Klonen von Stimmen beginnen. Wenn Sie ein wenig mehr suchen, finden Sie vielleicht sogar Tools, mit denen Sie Stimmen kostenlos klonen können.

Diese neue und leicht verfügbare Technologie hat zu einem steilen Anstieg des Audio-Betrugs geführt.

Betrüger brauchen nur ein winziges Stückchen Audio von jemandem, das sie aus sozialen Medien oder einem anderen öffentlichen Kanal beziehen können, um ihn zu klonen.

Dann können sie die geklonte Stimme verwenden, um sich in Situationen wie Live-Telefonaten, Videokonferenzen, Sprachnotizen, Ankündigungen usw. als eine Person auszugeben.

Dies sind nicht nur hypothetische Anwendungsfälle von Deepfake-Angriffen auf die Stimme. Diese Dinge sind bereits geschehen. Wir werden später auf einige der berüchtigten Deepfake-Angriffe auf die Stimme eingehen.

Potenzielle Risiken von Deepfake-Angriffen auf die Stimme

Wenn Sie von Voice Deepfake hören, denken Sie vielleicht an ein lustiges Video, in dem ein Prominenter Dinge sagt, die er nie gesagt hat.

Aber diese scheinbar harmlose Verwendung geklonter Stimmen kann den Beteiligten ernsthaften Schaden zufügen. Lassen Sie uns über die Risiken sprechen.

Finanzielle Verheerungen für Unternehmen

Ein Stimmentäuschungsversuch kann den Ruf eines Unternehmens für immer ruinieren. Er hat auch die Macht, es innerhalb von Minuten um große Geldsummen zu bringen.

Wie kommt das, werden Sie sich fragen? Betrüger können die Stimme des Chefs eines Unternehmens klonen und sie benutzen, um Mitarbeiter anzurufen und sie dazu zu bringen, Dinge zu tun, die nicht getan werden sollten, wie etwa Geld auf ein Konto zu überweisen.

Dies ist nur ein Beispiel. Die Möglichkeiten sind endlos.

Umgehung von Sicherheitssystemen

Ihre Stimme ist ein biometrisches Merkmal, das niemand sonst haben sollte. Das liegt daran, dass Sie sie als Passwort verwenden, um sich bei vielen Ihrer Apps anzumelden, vor allem bei den Banking-Apps.

Diese Apps verfügen zwar über ein eingebautes automatisches Sprachverifizierungssystem, um unbefugten Zugriff zu verhindern, aber ein guter Stimmenklon hat immer noch eine Chance, sie zu täuschen.

Der emotionale Tribut für Familien

Die vielleicht einfachste Zielscheibe für Audiobetrüger sind ältere Menschen in der Familie. Eltern und Großeltern, zum Beispiel.

Betrüger rufen z. B. eine Mutter an und spielen den Ton ihrer um Hilfe schreienden Tochter ab, die angeblich entführt wurde.

Schwindendes Vertrauen am Arbeitsplatz

Voice-Defake-Angriffe schaden auch dem Vertrauen in einen gesunden Arbeitsplatz.

Die Mitarbeiter müssen die Anrufe ihres Vorgesetzten überprüfen, um sicherzugehen, dass es sich nicht um einen Betrüger handelt, der sie mit einer geklonten Stimme zu riskanten Handlungen auffordert.

Welche Möglichkeiten haben Sie also, wenn Sie nicht manuell nachprüfen wollen? Alle Risiken, die wir gerade besprochen haben, weisen auf die Notwendigkeit einer automatisierten Deepfake-Angriffsprävention hin.

Zum Glück gibt es jetzt Tools zur Erkennung von gefälschten KI-Stimmen, darunter auch TruthScan.

Verhindern Sie Betrug und Nachahmung mit TruthScan's AI Sprachdetektor.

Reale Beispiele für Deepfake-Angriffe auf die Stimme

Dank der künstlichen Intelligenz sind wir heute an einem Punkt angelangt, an dem wir nicht mehr ohne Weiteres darauf vertrauen können, was unsere Augen sehen oder unsere Ohren hören. Die KI ist jetzt in der Lage, realistische Bilder und Videos zu erstellen. Das Gleiche gilt für Audio.

Vielleicht haben Sie schon von Menschen gehört, die auf den Deepfake-Audio-Betrug hereingefallen sind. Auch in den Nachrichten und sozialen Medien tauchen immer wieder solche Fälle auf. Einige davon sind schwer zu begreifen.

Wir stellen Ihnen einige der berüchtigtsten Stimmentäuschungsangriffe vor, damit Sie sich ein Bild davon machen können, wie raffiniert diese ausgeführt werden.

Das virtuelle $25-Millionen-Meeting, das nie stattgefunden hat

Dieser Deepfake-Angriff ist wahrscheinlich der am häufigsten gemeldete.

Die Opfer war ein britisches Ingenieurbüro namens Arup, aber der Betrug hatte seinen Ursprung in ihrem Büro in Hongkong.

Es war Anfang 2024, als ein Mitarbeiter der Finanzabteilung des Unternehmens eine E-Mail vom Finanzchef des Unternehmens aus dem Vereinigten Königreich erhielt. In der E-Mail wurde der Mitarbeiter vom CFO angewiesen, geheime Geldüberweisungen auf einige Bankkonten vorzunehmen.

Zunächst war der Angestellte ziemlich misstrauisch, denn die Anfrage kam ihm etwas seltsam vor, und er dachte, es könnte sich um einen Phishing-Betrug handeln.

Doch dann wurde der Mitarbeiter zu einer Videokonferenz eingeladen. Als der Mitarbeiter an der Telefonkonferenz teilnahm, sah er etwas, das genau wie der CFO und mehrere andere leitende Kollegen aussah.

Alle sahen so aus und hörten sich so an, wie sie sollten. Sie sprachen auch miteinander, um es realer wirken zu lassen.

Damit waren alle Zweifel des Mitarbeiters der Finanzabteilung ausgeräumt, der daraufhin in 15 Transaktionen über $25,6 Millionen (~HK$200 Millionen) auf verschiedene Bankkonten in Hongkong überwies.

Später stellte sich heraus, dass die ganze Sache ein Täuschungsmanöver war. Keine Person in dem Anruf war die, die sie zu sein schien, mit Ausnahme des Arup-Mitarbeiters. Die Betrüger hatten den Angriff perfekt koordiniert und hochwertige Audio- und Videoklone des Finanzvorstands und der leitenden Angestellten des Unternehmens verwendet.

Der italienische Minister und die Mode-Ikonen

Diese fand ebenfalls im Jahr 2024 statt. A den falschen italienischen Verteidigungsminister Guido Crosetto rief mehrere italienische Spitzenpolitiker an und bat sie um sofortige finanzielle Unterstützung bei der Rettung der entführten Journalisten.

In dem Anruf behauptete der falsche Guido Crosetto, es handele sich um eine streng geheime Regierungsaktion. Der Anrufer schaffte es sogar, mit legendären Modegrößen wie Giorgio Armani zu telefonieren.

Traurigerweise hat eine Person am Ende etwa eine Million Dollar überwiesen. Sie hatte wahrscheinlich ein stärkeres Gefühl der patriotischen Pflicht zu helfen als andere, was die Betrüger erfolgreich ausnutzten.

Der $243.000 UK Energie-Raub

Diese geschehen im Jahr 2019 und war wahrscheinlich der erste jemals gemeldete Deepfake dieses Ausmaßes.

Der Vorstandsvorsitzende eines britischen Energieunternehmens dachte, er telefoniere mit seinem Chef von der Muttergesellschaft in Deutschland.

Der Geschäftsführer wurde angewiesen, rund 220.000 € ($243.000 €) an einen Lieferanten in Ungarn zu überweisen. Ihm wurde gesagt, es handele sich um ein wichtiges Geschäft, das sofort überwiesen werden müsse. Der Geschäftsführer fiel auf den Betrug herein und überwies das Geld.

Ein erschreckender Anruf für eine Mutter in Arizona

Erinnern Sie sich daran, dass wir darüber gesprochen haben, dass Audio-Deepfakes eine Bedrohung für Familien darstellen? Das Beispiel für den Betrug, das wir genannt haben, ist tatsächlich passiert.

Betrüger hatten die Stimme eines 15-jährigen Mädchens aus einem Video von ihr in den sozialen Medien geklont. Dann riefen sie ihre Mutter an und behaupteten in der Stimme der Tochter, sie sei entführt worden und ihre Entführer würden sofort Lösegeld fordern.

Glücklicherweise konnte der Vater seine leibliche Tochter anrufen, die sich während der ganzen Tortur in Sicherheit bei einer Ski-Übung befand. Sie sind dem Betrug entkommen.

Wie sich Voice Deepfakes auf Unternehmen auswirken

Das Hauptziel eines Deepfake-Angriffs auf die Stimme ist meist, Geld zu stehlen.

Aber wenn das Ziel Unternehmen sind, ist der Schaden multidimensional.

Deepfakes können zum Beispiel die Atmosphäre zwischen den Mitarbeitern eines Unternehmens vergiften. Es besteht die Gefahr, dass eine Kultur entsteht, in der die Mitarbeiter ständig Angst haben, einen Fehler zu machen.

Nehmen Sie das Beispiel der Callcenter. Es gibt Berichte über Cyberkriminelle, die dort anrufen und sich als bestimmte Kunden ausgeben.

Ihr Trick besteht darin, die Callcenter-Agenten dazu zu bringen, die Kontodaten dieser Kunden zu ändern (z. B. Wohnadressen, Telefonnummern) und deren Konten zu übernehmen.

Ferneinstellungen und virtuelle Vorstellungsgespräche sind ein weiterer Bereich, in dem gefälschte Stimmen von Bewerbern genutzt werden können, um Stellen zu erhalten, für die sie nicht qualifiziert sind.

Schutz von Unternehmen vor Deepfake-Angriffen auf die Stimme

Die traditionellen Sicherheitsregeln in Unternehmen stammen aus der Zeit vor der künstlichen Intelligenz.

Es ist höchste Zeit, dass Unternehmen sie neu überdenken. Sie sollten zunächst damit beginnen, sich über die vielen neuen Cyberbedrohungen zu informieren, die sich aus dem Missbrauch von KI ergeben haben.

Sie können zum Beispiel Schulungen für ihr gesamtes Team organisieren und ihnen reale Beispiele für Audio-Betrug zeigen. Sie können mit den Beispielen beginnen, die wir gerade oben besprochen haben. In diesen Schulungen sollten sie auch Tipps zur Vermeidung von Deepfake-Angriffen für verschiedene Szenarien erhalten.

Dann können Sie die internen Unternehmensrichtlinien aktualisieren. Eine wichtige Änderung kann darin bestehen, dass Sie einer einzelnen Person nicht mehr gestatten, im Alleingang umfangreiche Überweisungen zu genehmigen.

Große Zahlungen sollten von einem gesamten Gremium genehmigt werden müssen, damit wenigstens einer von ihnen rechtzeitig merkt, dass etwas nicht stimmt.

Sie sollten auch über die Integration eines automatisierten AI Sprachdetektor die während eines Anrufs im Hintergrund läuft.

Dafür wurden die KI-Tools von TruthScan entwickelt. Mit unseren KI-Tools können Sie Deepfake-Angriffe auf Stimmen erkennen, verifizieren und verhindern. Wir sagen Ihnen wie.

Wie TruthScan Sprachinteraktionen absichert

Wir wissen, dass die Mitarbeiter nicht in der Lage sind, während eines stressigen Telefongesprächs eine falsche Stimme von einer echten Stimme zu unterscheiden. Sie brauchen einen engagierten Assistenten, der sich während eines Anrufs um diese Aufgabe kümmert, während sich Ihr Team auf seine eigentlichen Aufgaben konzentrieren kann.

Unser AI Sprachdetektor ist eine spezielle Lösung.

Hier erfahren Sie, wie es funktioniert und was es kann:

- Analysiert Millionen verschiedener Datenpunkte in Live-Telefonaten und Videokonferenzen und liefert 99% Genauigkeit

- Gibt sofort eine Warnung aus, wenn eine gefälschte Stimme erkannt wird

- Erfasst spektrale Muster und akustische Fingerabdrücke in der Stimme, die nur von synthetischen Modellen hinterlassen werden

- Integration in Ihr bestehendes Call Center oder Ihren Helpdesk über eine einfache REST API

- Kann alle gängigen Audio- und Videoformate scannen

Sprechen Sie mit TruthScan über die Verhinderung von Voice Deepfake Angriffen

Mit TruthScan können Sie den Voice-Cloning-Betrug in Echtzeit stoppen, aber die Frage ist, wann Sie damit anfangen? Ihre Mitarbeiter könnten früher oder später einen Fehler machen und Sie betrogen werden. Warten Sie nicht auf diesen unglücklichen Moment.

Unser KI-Stimmdetektor kann mit Hilfe von Plattformen wie ElevenLabs und Murf Stimmfälschungen erkennen.

Es arbeitet bei Live-Telefonaten und Videokonferenzen im Hintergrund, so dass Ihre Call Agents kein Multitasking betreiben müssen.

Dazu ist lediglich eine schnelle Integration über unsere REST-API erforderlich.

Starten Sie mit TruthScan jetzt und schützen Sie Ihr Unternehmen vor Deepfake-Betrug.