Ihre Support-Mitarbeiter sind so geschult, dass sie die hilfreichsten Mitarbeiter in Ihrem Unternehmen sind.

Sie stehen an vorderster Front für den Ruf Ihrer Marke und arbeiten hart daran, dass jede Interaktion mit einem Lächeln endet.

Aber kennst du die gefährlichste Ironie des Jahres 2026?

Gerade diese Hilfsbereitschaft macht sie zu Ihrem größten Sicherheitsrisiko.

Ihre Mitarbeiter sind auf Kundenzufriedenheit ausgerichtet.

Sie bemerken nicht immer einen leicht roboterhaften Ton in der Stimme eines Anrufers oder einen winzigen Fleck um die Kieferpartie eines Kunden während eines Videoanrufs.

Dies bietet Kundenbetrügern ein perfektes Zeitfenster, um zuzuschlagen.

Wenn Ihr Support Desk nicht durch eine automatische Betrugserkennung unterstützt wird, sind Sie möglicherweise bereits gefährdet.

In diesem Blog erfahren Sie, was Deepfake-Impersonation ist, welche Techniken Angreifer verwenden, um Ihre Abwehr zu umgehen, welche Frühindikatoren Ihr Team warnen können und wie Sie einen Echtzeit-KI-Detektor zum Schutz Ihres Unternehmens einsetzen können.

Lasst uns eintauchen.

Wichtigste Erkenntnisse

- Support-Agenten sind darauf trainiert, hilfsbereit zu sein, was sie zu den primären Zielen für die Umgehung der KI-Imitationserkennung macht.

- Moderne Betrüger verwenden einen Echtzeit-KI-Detektor, um Sprachklone zu erkennen, die sich in weniger als 50 Millisekunden synchronisieren.

- Die automatisierte Betrugserkennung muss nun auch manipulierte Bildschirmaufnahmen, gefälschte Quittungen und KI-generierte IDs umfassen.

- Eine wirksame Deepfake-Prävention erfordert das gleichzeitige Scannen von Audio, Video und Bildern.

- Die Integration eines Deepfake-Detektors in E-Discovery- und Support-Workflows reduziert finanzielle Verluste durch BEC (Business Email Compromise) um bis zu 80%.

Was sind Deepfake-Imitationen?

Das Wort “Deepfake” kommt von Deep Learning (eine Art von AI) und Fälschung.

Unter Impersonation versteht man die Vorgabe, jemand anderes zu sein, in der Regel um Vertrauen zu gewinnen, Geld zu stehlen oder Zugang zu privaten Informationen zu erhalten.

Deepfake-Imitationen entstehen, wenn KI das Gesicht, die Stimme oder das Verhalten einer echten Person kopiert, um gefälschte Inhalte zu erstellen, mit denen andere getäuscht werden sollen.

Machen Sie sich nie wieder Sorgen über KI-Betrug. TruthScan Kann Ihnen helfen:

- Erkennen Sie AI-generierte Bilder, Text, Sprache und Video.

- Vermeiden Sie KI-gesteuerter Betrug in großem Umfang.

- Schützen Sie Ihre wichtigsten empfindlich Unternehmensvermögen.

Deepfakes beschränken sich nicht mehr auf den einfachen Austausch von Gesichtern. Im Jahr 2026 werden wir Verhaltensdeepfakes sehen, die kopieren können:

- Sprachmuster

- Tonfall und Pausen

- Mikro-Ausdrücke im Gesicht

- Auch Persönlichkeitsnuancen

Das macht es viel schwieriger, Manipulationen mit bloßem Auge zu erkennen.

Beispiel aus der Praxis: WPP-CEO-Nachahmung (Mai 2024)

Die Cyberkriminellen nutzten ein öffentlich zugängliches Foto von WPP-CEO Mark Read, um ein gefälschtes WhatsApp-Konto zu erstellen.

Sie lockten eine Führungskraft in ein Microsoft-Teams-Meeting und nutzten einen KI-Detektor in Echtzeit, um eine betrügerische Überweisung zu autorisieren.

Glücklicherweise wurde ein aufmerksamer Mitarbeiter misstrauisch und meldete den Vorfall, so dass ein finanzieller Schaden verhindert werden konnte.

Warum der Kundensupport anfällig ist

Das Risiko von Kundenbetrug begann 2023-24 zu steigen, als generative KI-Tools weithin verfügbar wurden.

Doch bis 2025-26 erreichte die Bedrohung ein industrielles Ausmaß.

Was früher technische Fertigkeiten erforderte, kann heute mit einfachen Werkzeugen und ein paar Minuten Audiozeit erledigt werden.

Die Kundenserviceteams sind nicht plötzlich unvorsichtig geworden. Sie wurden bloßgestellt.

Support-Mitarbeiter sind darauf geschult, Menschen zu helfen, nicht sie in Frage zu stellen, Deshalb ist die Deepfake-Prävention auch so schwer manuell zu bewerkstelligen. Angreifer verlassen sich auf den Instinkt des Agenten, zu vertrauen und schnell zu handeln.

Die meisten Contact Center überprüfen die Identität immer noch anhand einfacher FragenKontonummern, Geburtsdaten, die letzten vier Ziffern eines Personalausweises. Das Problem ist, dass diese Informationen nicht mehr privat sind.

Datenschutzverletzungen und soziale Medien machen es leicht, herkömmliche Kontrollen zu umgehen, so dass die Erkennung von KI-Identitäten eine wichtige Verteidigungsschicht darstellt.

Hinzu kommt der Druck der Menge. Viele Agenten bearbeiten 80 bis 120 Interaktionen pro Tag. Wenn mehrere Anrufe hintereinander eingehen, bleibt keine Zeit für die Analyse feiner Stimmveränderungen.

An dieser Stelle wird die automatische Betrugserkennung zum Lebensretter. Ohne einen Echtzeit-KI-Detektor, der im Hintergrund arbeitet, sind die Mitarbeiter gezwungen, auf Dringlichkeit und Emotionen zu reagieren.

Von Deepfake-Imitatoren verwendete Techniken

- Klonen von Stimmen bei Anrufen

Im Jahr 2026 können Tools wie ElevenLabs, Speechify und Murf aus weniger als 10 Sekunden Audio überzeugende Klone erstellen.

Noch bedenklicher ist, dass die Sprachumwandlung in Echtzeit die Stimme eines Anrufers in weniger als 50 Millisekunden in die einer anderen Person verwandeln kann.

Für das Opfer klingt es lebendig, natürlich und vertraut.

Es gibt nur noch selten einen offensichtlichen Hinweis auf einen Roboter. Ohne Software zum Schutz vor Betrug erkennen die Mitarbeiter nicht die subtilen Artefakte wie metallische Untertöne oder unnatürliche Atemmuster, die auf Kundenbetrug hindeuten.

Beispiel:

- Wiz (Ende 2024): Die Angreifer klonten die Stimme von CEO Assaf Rappaport, um Anmeldedaten zu erlangen. Dieser Versuch scheiterte zwar aufgrund einer Fehlanpassung des Tons, machte aber deutlich, wie dringend notwendig die Erkennung von KI-Imitaten in der Unternehmenskommunikation ist.

- LastPass (Anfang 2024): Ein Mitarbeiter wurde von einer gefälschten CEO-Stimme angegriffen, die auf YouTube-Videos trainiert wurde. Dieser Vorfall bewies, dass hochrangige Personen einem ständigen Risiko ausgesetzt sind und eine automatische Betrugserkennung zum Schutz der internen Support-Kanäle erforderlich ist.

- Videos mit vertauschten Gesichtern von Agenten

Face-Swap-Deepfakes verwenden fortschrittliche KI-Modelle, um das Gesicht einer Person durch ein anderes in einem Live-Video zu ersetzen.

Bis 2026 können Werkzeuge wie DeepFaceLive und Deep-Live-Cam in Echtzeit mit weniger als 50 Millisekunden Verzögerung arbeiten.

Betrüger können dieses manipulierte Video über Plattformen wie Zoom, Microsoft Teams oder Google Meet mit virtuellen Kameratools wie OBS Studio streamen. Für den Gesprächsteilnehmer sieht alles normal aus.

Beispiel:

KnowBe4 Fall eines falschen Mitarbeiters (Juli 2024): Ein nordkoreanischer staatlicher Akteur nutzte eine KI-Gesichtstausch-Technologie, um mit einer gestohlenen US-Identität Live-Video-Interviews zu führen. Er wurde erst gefasst, nachdem die interne Sicherheit ungewöhnliche Geräteaktivitäten gemeldet hatte.

- Manipulierte Bildschirmaufnahmen

Angreifer setzen zunehmend KI ein, um Bildschirmaufzeichnungen zu fälschen oder zu verändern und so den Anschein zu erwecken, dass eine Erstattung, eine Transaktion oder eine Support-Ticket-Aktion stattgefunden hat.

Mit diesen gefälschten Aufnahmen können Support-Mitarbeiter manipuliert, Streitfälle außer Kraft gesetzt oder Rückbuchungen eskaliert werden.

Die künstliche Intelligenz kann jetzt Zeitstempel, Kontostände und dynamische Elemente der Benutzeroberfläche so überzeugend verändern, dass es bei einem zufälligen Blick nicht auffällt.

Betrüger können über virtuelle Kamera-Plugins sogar vorab aufgezeichnete oder manipulierte Videos in Live-Support-Anrufe einfügen.

Frühindikatoren für Deepfake-Bedrohungen

Moderne Deepfakes sind überzeugend. Eine wirksame Deepfake-Prävention besteht darin, auf diese “Tells” zu achten:

Audio-Level Tells:

- Geklonte Stimmen klingen flach und weisen keine natürlichen Tonhöhenänderungen auf.

- Bei der AI-Sprache fehlen oft normale Atem- und Füllgeräusche.

- Die Stimme passt möglicherweise nicht zu den Hintergrundgeräuschen.

- Die Echtzeit-Sprachumwandlung kann bei plötzlichen Fragen kleine Verzögerungen (200-400 ms) verursachen.

- Stimmen aus Aufnahmen von öffentlichen Reden können für ein lockeres Gespräch zu förmlich klingen.

Video-Level Tells:

- Haare, Ohren und Kieferränder können leicht verschwommen aussehen.

- Das Blinken erfolgt in sehr regelmäßigen Abständen.

- Der Blick folgt der Kamera möglicherweise nicht auf natürliche Weise.

- Die Beleuchtung des Gesichts passt möglicherweise nicht zum Raum.

- Mikroausdrücke fehlen oder sind sehr weich.

- Schlechte Verbindungsausreden können durch Kompression verursachte Videoartefakte verbergen.

Verhaltens-/Interaktionsebene erzählt:

- Deepfake-Betreiber vermeiden unerwartete Verifizierungsanfragen.

- Es kann sein, dass sie Sie zunächst über informelle Apps kontaktieren, bevor sie offizielle Kanäle nutzen.

- Dringlichkeit und Geheimniskrämerei zusammen sind ein Warnzeichen.

- Sie widerstehen "Out-of-Band"-Kontrollen, z. B. durch Anrufen einer bekannten Nummer.

Nutzung von KI-Erkennungstools

TruthScan ist eine leistungsstarke Plattform für die automatische Betrugserkennung, der über 250 Millionen Nutzer vertrauen.

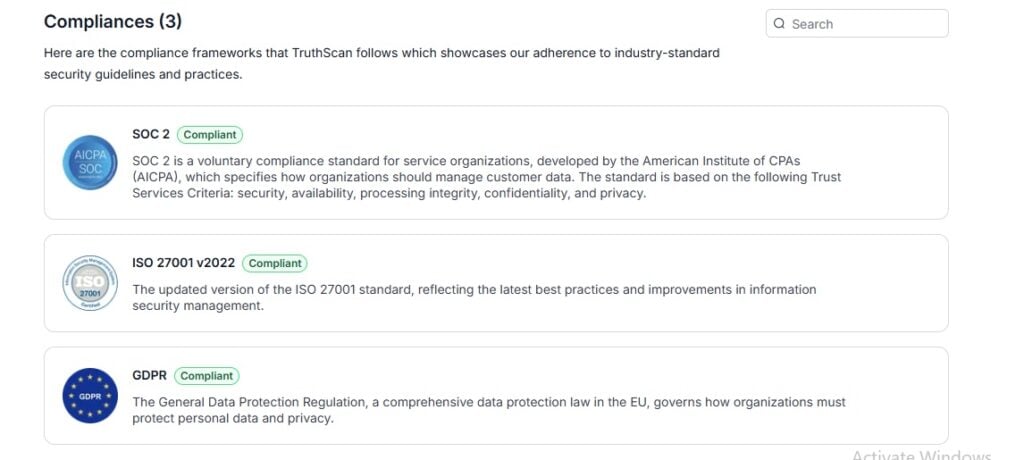

Sie ist vollständig nach ISO 27001, SOC 2 zertifiziert und GDPR-konform und arbeitet nahtlos mit Tools wie Salesforce, Microsoft 365, Google Workspace, SAP und Zoom zusammen.

- Deepfake-Detektor

Dieser Deepfake-Detektor identifiziert KI-generierte Videos, Gesichtsvertauschungen und manipulierte Medien in allen gängigen Formaten (MP4, AVI, MOV, MKV, WebM) bis zu 4K.

Und so funktioniert es:

- Verfolgt Gesichtsbewegungen, Blinzelmuster und Mikroexpressionen.

- Erkennt Inkonsistenzen auf Pixelebene, Beleuchtungsfehler und Frame-to-Frame-Artefakte.

- Erkennt GAN-basierte Generierungsmodelle wie AnimateDiff, D-ID, HeyGen, Runway Gen-4, Stable Video Diffusion und andere.

Laden Sie ein bekanntes echtes Video und ein Deepfake (HeyGen/D-ID) auf TruthScan's Deepfake-Detektor.

- AI-Bild-Detektor

Der TruthScan AI-Bilddetektor Flaggen KI-generierte oder manipulierte Bilder von Plattformen wie Midjourney, DALL-E, Stable Diffusion, Canva AI, Grok Imagine, StyleGAN und ThisPersonDoesNotExist.

Und so funktioniert es:

- Kennzeichnet den Austausch von Hintergründen, das Entfernen von Objekten und Beleuchtungsbearbeitungen.

- Erzeugt Konfidenzwerte und Erkenntnisse auf Pixelebene, ohne Dateien zu speichern.

Laden Sie reale und KI-generierte Bilder auf TruthScan's AI-Bild-Detektor um Konfidenzwerte zu vergleichen.

Effektive Sicherung der Supportkanäle

Im Jahr 2026 sind Kundenserviceteams einer ständigen Bedrohung durch KI-gesteuerten Betrug ausgesetzt.

Angreifer können Stimmen fälschen, Gesichter in Live-Videos austauschen oder manipulierte Dateien übermitteln, so dass es für menschliche Agenten fast unmöglich ist, zu erkennen, was echt ist und was nicht.

Deshalb ist die Sicherung von Unterstützungskanälen so wichtig.

- AI-Detektor in Echtzeit

Der Echtzeit-KI-Detektor wurde entwickelt, um KI-generierte Inhalte abzufangen, bevor sie Ihre Agenten oder Kunden erreichen.

Im Gegensatz zu dateibasierten Tools, die Uploads analysieren, überwacht diese Plattform Live-Interaktionen über E-Mail-, Chat-, Telefon- und Videokanäle.

Wie es Ihrem Team hilft:

- Erkennt KI-Identifizierungsversuche in Echtzeit.

- Kennzeichnen Sie KI-generierte Nachrichten oder Anrufe, die versuchen, Agenten dazu zu bringen, Zugang zu gewähren oder Anfragen zu bearbeiten.

- Arbeitet mit Salesforce, Teams, Gmail, Zoom und anderen Systemen zusammen, um eine automatische Betrugserkennung zu ermöglichen, ohne den Betrieb zu verlangsamen.

- Verarbeitet Millionen von Interaktionen über alle Kanäle hinweg, ohne den Betrieb zu verlangsamen.

- SOC 2-, ISO 27001- und GDPR-Zertifizierungen bedeuten, dass jede Aktion auditierbar und gerichtsfest ist.

Richtlinien und Schulungen für Teams

- Standardarbeitsanweisungen

| Politik Name | Politik |

| Multi-Faktor-Verifizierung | Erfordern Sie MFA für das Zurücksetzen von Konten, für Transaktionen mit hohem Wert und für Sicherheitsänderungen. |

| Kanal-Verifizierung | Leiten Sie alle Anfragen aus informellen Kanälen (WhatsApp, Telegram, persönliche E-Mails) an offizielle Support-Systeme weiter. |

| Kontaktaufzeichnung | Die Agenten müssen ungewöhnliche Kontakte unter Angabe von Kanal, Zeit und Art der Anfrage protokollieren. |

| Safe Word System | Verwenden Sie vorregistrierte Verifizierungsphrasen für hochwertige Konten. |

| Out-of-Band-Verifizierung | Interne Eskalationen oder Anfragen von Führungskräften müssen durch Rückrufe bei offiziellen Telefonnummern überprüft werden. |

| Keine Solo-Zulassung | Genehmigen Sie niemals Transaktionen oder Sicherheitsänderungen allein aufgrund von Videoanrufen oder E-Mails. |

| Sprachbestätigung | Verlangt eine Sprachbestätigung für alle Geldüberweisungen, die einen bestimmten Schwellenwert überschreiten. |

| Überprüfung der Medien | Scannen Sie alle Fotos, Videos und Bildschirmaufzeichnungen durch TruthScan-Detektoren, bevor sie von Menschen überprüft werden. |

| Metadaten-Prüfungen | Verwenden Sie einen AI-Bilddetektor, um inkonsistente EXIF- oder Zeitstempel zu erkennen. |

| Sekundäre Überprüfung | Eingereichte Anträge mit hohem Wert müssen vor der Bearbeitung einer zweiten Prüfung unterzogen werden. |

- Schulung des Personals zum Thema Betrug

Die Mitarbeiter müssen realistische Fälschungen erleben. Untersuchungen zeigen, dass die Erkennungsraten nach etwa einem Dutzend Live-Simulationen mit einem KI-Videodetektor von 34% auf 74% steigen.

Rote Fahnen, auf die man achten sollte:

- Dringlichkeit gepaart mit Geheimhaltung

- Ersuchen außerhalb der normalen Kanäle

- Widerstand gegen Rückrufe oder Zweitprüfungen

- Umgehung von Standardprozessen

- Emotionaler Druck (Angst, Schuldgefühle, Autorität)

- Routinemäßige Sicherheitsüberprüfungen

Im Jahr 2026 müssen selbst die besten SOPs regelmäßig durch automatisierte Betrugserkennungsprotokolle überprüft werden:

| Politik Name | Politik |

| Vierteljährliche Bewertung der Bedrohungslage | Prüfen Sie auf neue Deepfake-Tools, validieren Sie Erkennungsschwellen und überprüfen Sie Beinahe-Vorfälle. |

| Audit der Kanalsicherheit | Testen Sie jeden Unterstützungskanal auf Schwachstellen; Angreifer suchen sich den Weg des geringsten Widerstands. |

| Validierung von Erkennungsinstrumenten | Lassen Sie bekannte Fälschungen regelmäßig durch TruthScan laufen, um sicherzustellen, dass die Erkennungsgenauigkeit mit den sich weiterentwickelnden KI-Methoden Schritt hält. |

| Übungen zur Reaktion auf Zwischenfälle | Durchführung von Tabletop-Übungen, bei denen Deepfake-Imitationen simuliert werden, um Benachrichtigungen, Abriegelungen und Reaktionsgeschwindigkeit zu testen. |

| Schecks von Lieferanten und Dritten | Vergewissern Sie sich, dass für die externe Kommunikation mit Partnern oder Kunden die gleichen strengen Authentifizierungsstandards gelten wie für interne Kanäle. |

Wie TruthScan die Sicherheit des Kundensupports stärkt

TruthScan wurde entwickelt, um KI-Betrug auf jeder Ebene des Kundensupports zu verhindern. Es erklärt, warum etwas verdächtig ist, sodass die Teams sicher handeln können.

| Werkzeug | Zweck und Nutzen |

| AI Sprachdetektor | Spürt geklonte Stimmen in Anrufen und Aufnahmen auf und schützt so Live-Gespräche vor Nachahmung. |

| Deepfake-Detektor | Analysiert Videos und Bilder, um Gesichtsvertauschungen, synthetische Personen und manipulierte Medien zu erkennen. |

| AI-Bild-Detektor | Kennzeichnet KI-generierte Profilbilder, gefälschte IDs und manipulierte Screenshots, bevor eine Entscheidung getroffen wird. |

| AI-Echtzeit-Detektor | Kontinuierliche Überwachung von Live-Chat, E-Mail und Video mit automatischen Betrugserkennungswarnungen im Sekundentakt. |

| Detektor für gefälschte Quittungen | Erkennt KI-generierte Quittungen oder Nachweise, die in betrügerischen Anträgen verwendet werden. |

| E-Mail-Betrugsdetektor | Fängt KI-generierte Phishing-Versuche und BEC-Angriffe ab, bevor sie den Posteingang erreichen. |

Wie es in den Sicherheitsbereich des Kundensupports passt:

- Eingehende Medien (Fotos, Videos, Aufnahmen) → Deepfake-Detektor + KI-Bilddetektor vor menschlicher Überprüfung

- Live-Support-Anrufe → KI-Sprachdetektor zur Analyse von Anrufaufzeichnungen oder Live-Streams

- Video-Support-Sitzungen → Deepfake-Detektor in Echtzeit oder nach einem Anruf

- E-Mail- und Chat-Kanäle → Real-Time AI Detector für kontinuierliche Überwachung

- Einreichung von Dokumenten (IDs, Quittungen, Screenshots) → Detektor für gefälschte Quittungen + AI-Bild-Detektor

Sprechen Sie mit TruthScan über Deepfake Protection im Support

Warten Sie nicht, bis es zu spät ist. TruthScan hilft Ihrem Team, KI-Inhalte zu erkennen, bevor sie Ihre Agenten erreichen.

Wählen Sie, wie Sie beginnen möchten:

- Testen Sie sich selbst: Testen Sie alle TruthScan-Erkennungswerkzeuge mit 20.000 kostenlosen Credits. Keine Zahlung erforderlich. → Starten Sie Ihren kostenlosen Test unter TruthScan.

- Unternehmens-Demo: Lassen Sie sich von unserem Team eine maßgeschneiderte Bereitstellung für Salesforce, Microsoft 365, Zoom und Google Workspace zeigen. → Buchen Sie eine Demo unter TruthScan.

Sichern Sie sich noch heute Ihre Support-Kanäle, denn Sehen ist nicht mehr gleich Glauben, sondern Überprüfen schon.