For bare nogle få år siden skulle man have et professionelt studie og en masse tekniske færdigheder for at efterligne en persons stemme.

Nu kan alle med en internetforbindelse og lidt fritid skabe en digital klon af en persons stemme på mindre end et minut.

Værktøjerne til disse angreb bliver billigere og mere tilgængelige hver eneste dag for alle. Og fordi så mange mennesker deler deres liv på de sociale medier, er det meget nemt for en svindler at finde den lyd, de har brug for.

I denne artikel gennemgår vi nogle af de mest berygtede eksempler på lydsvindel i den virkelige verden. Vi præsenterer dig også for en løsning, der kan sætte en stopper for disse trusler i tide.

Det vigtigste at tage med

- Forsøg på deepfake af stemmer er steget med over 2.137% i de seneste år, drevet af det faktum, at moderne AI kan generere en 85% nøjagtig stemmeklon ved hjælp af så lidt som tre sekunders kildelyd.

- Berygtede angreb i den virkelige verden omfatter kuppet mod ingeniørfirmaet Arup i 2024, hvor svindlere brugte deepfake-video og -lyd af en økonomidirektør til at narre en medarbejder til at overføre $25,6 millioner.

- Ud over virksomhedstyveri udgør voice deepfakes alvorlige følelsesmæssige risici for familier gennem kidnapningssvindel og kan omgå traditionelle biometriske sikkerhedssystemer, der bruges af banker og andre højsikkerhedsapps.

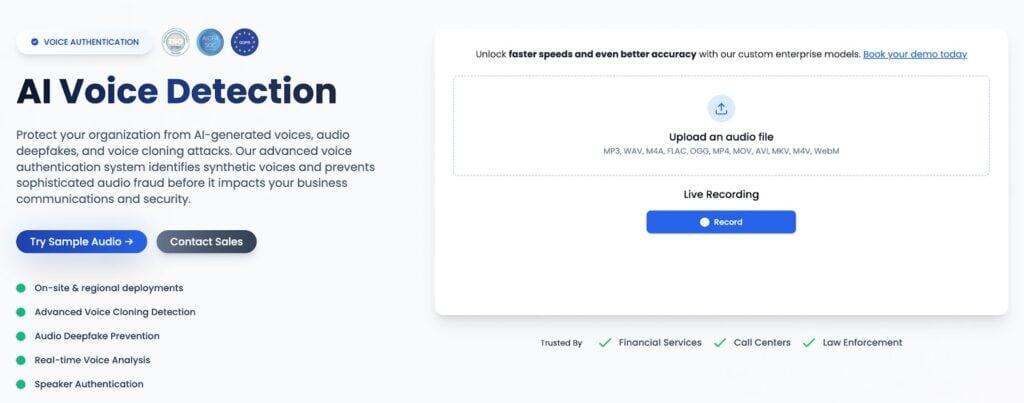

- Organisationer er tvunget til at gå videre end menneskelig verifikation alene ved at implementere godkendelsesprotokoller med flere personer til store overførsler og anvende AI-stemmedetektorer som TruthScan til at analysere akustiske fingeraftryk i realtid.

- TruthScan sikrer virksomhedsinteraktioner ved at identificere syntetiske taleartefakter fra platforme som ElevenLabs og Murf med over 99% nøjagtighed på tværs af alle større lyd- og videoformater.

Hvad er Voice Deepfake-angreb?

En voice deepfake er en digital forfalskning af en persons stemme. Angriberen bruger software, der kan analysere hver eneste lille detalje om, hvordan en person taler, ud fra en optagelse af deres stemme.

For at klone stemmen forsøger softwaren at lægge mærke til mønstre i stemmen. Hovedsageligt tager softwaren hensyn til ting som tonehøjde, tonefald, den måde, en person trækker vejret på mellem sætninger osv.

Når den har lært disse mønstre, kan angriberen få den til at sige hvad som helst med den stemme.

Du skal aldrig bekymre dig om AI-svindel igen. TruthScan Kan hjælpe dig:

- Opdag AI-generering billeder, tekst, stemme og video.

- Undgå at stor AI-drevet svindel.

- Beskyt dine mest følsom virksomhedsaktiver.

Det farlige er, at værktøjer til at skabe voice deepfake er let tilgængelige. Og de fleste af dem kræver ingen installation. De er tilgængelige online i form af hjemmesider.

Du skal bare smide et par dollars efter dem og begynde at klone stemmer. Hvis du graver lidt mere, kan du måske endda finde værktøjer, der giver dig mulighed for at klone stemmer gratis.

Denne nye og lettilgængelige teknologi har ført til en kraftig stigning i lydsvindel.

Svindlere behøver kun en lille smule lyd af en person, som de kan hente fra sociale medier eller en anden offentlig kanal, for at klone den.

Derefter kan de bruge den klonede stemme til at udgive sig for at være en person i situationer som live telefonopkald, videomøder, stemmenotater, meddelelser osv.

Det er ikke bare hypotetiske anvendelser af voice deepfake-angreb. Disse ting er allerede sket. Vi dækker nogle af de berygtede voice deepfake-angreb senere.

Potentielle risici ved Voice Deepfake-angreb

Når du hører om voice deepfake, tænker du måske på en sjov video af en berømthed, der siger ting, som vedkommende aldrig har sagt.

Men den tilsyneladende uskyldige brug af klonet stemme kan forårsage alvorlig skade på de involverede parter. Lad os tale om risiciene.

Økonomisk ødelæggelse for virksomheder

En voice deepfake kan ødelægge en virksomheds omdømme for altid. Den kan også stjæle store pengesummer på få minutter.

Hvordan kan det være, spørger du måske? Svindlere kan klone en virksomhedsleders stemme og bruge den til at ringe til medarbejdere og få dem til at gøre ting, der ikke skal gøres, som at flytte penge til en konto.

Dette er blot ét eksempel. Mulighederne er uendelige.

Omgåelse af sikkerhedssystemer

Din stemme er et biometrisk kendetegn, som ingen andre bør have. Det skyldes, at du bruger den som adgangskode til at logge ind på mange af dine apps, især bank-apps.

Selv om disse apps kan have et indbygget automatisk stemmebekræftelsessystem for at forhindre uautoriseret adgang, har en god stemmeklon stadig en chance for at narre dem.

Den følelsesmæssige belastning af familier

De nemmeste mål for lydsvindlere er måske ældre mennesker i familien. Forældre og bedsteforældre, for eksempel.

Svindlere kan f.eks. ringe til en mor og afspille lyden af hendes datter, der råber om hjælp, og sige, at hun er blevet kidnappet.

Underminering af tillid på arbejdspladsen

Voice deepfake-angreb skader også tilliden til en sund arbejdsplads.

Medarbejderne bliver nødt til at dobbelttjekke telefonopkald fra deres leder for at sikre sig, at det ikke er en svindler, der beordrer dem til at gøre risikable ting med en klonet stemme.

Så hvad er dine muligheder, hvis ikke du dobbelttjekker manuelt? Alle de risici, vi lige har diskuteret, peger på behovet for en automatiseret forebyggelse af deepfake-angreb.

Heldigvis har vi nu værktøjer til at detektere deepfake AI-stemmer, og TruthScan er et af dem.

Forebyg svindel og efterligning med TruthScans AI stemme-detektor.

Eksempler fra den virkelige verden på Voice Deepfake-angreb

Takket være AI er vi nu nået til et punkt, hvor vi ikke uden videre kan stole på, hvad vores øjne ser eller ører hører. AI er nu i stand til at skabe realistiske billeder og videoer. Det samme gælder for lyd.

Du har måske allerede hørt historier om folk, der er faldet for deepfake audio-svindel. Det dukker også op i nyhederne og på de sociale medier fra tid til anden. Nogle af dem er svære at forstå.

Lad os fortælle dig om nogle af de mest berygtede voice deepfake-angreb, så du kan få en god idé om, hvor smart de er udført.

Det virtuelle møde til $25 millioner, der aldrig fandt sted

Dette deepfake-angreb er nok det mest rapporterede.

Den Offeret var et britisk ingeniørfirma ved navn Arup., men svindelnummeret opstod på kontoret i Hongkong.

Det var i begyndelsen af 2024, da en medarbejder i virksomhedens økonomiafdeling fik en e-mail fra virksomhedens økonomidirektør i Storbritannien. I mailen blev medarbejderen instrueret af CFO'en i at foretage hemmelige pengeoverførsler til nogle bankkonti.

Først var medarbejderen faktisk ret mistænksom, fordi anmodningen føltes lidt mærkelig, og de troede, at det kunne være et phishing-svindel.

Men så blev medarbejderen inviteret til et videokonferenceopkald. Da medarbejderen deltog i opkaldet, så han noget, der lignede økonomidirektøren og flere andre højtstående kolleger.

Alle så ud og lød præcis, som de skulle. De talte også med hinanden for at få det til at virke mere virkeligt.

Det fjernede fuldstændig tvivlen hos medarbejderen i finansafdelingen, som derefter sendte over $25,6 millioner (~HK$200 millioner) til flere forskellige bankkonti i Hongkong via 15 transaktioner.

Det viste sig senere, at hele dette setup var en deepfake. Ingen personer i opkaldet var, hvem de så ud til at være, bortset fra Arup-medarbejderen. Svindlerne havde koordineret angrebet perfekt ved hjælp af lyd- og videokloner af høj kvalitet af virksomhedens økonomidirektør og ledende medarbejdere.

Den italienske minister og modeikonerne

Denne fandt også sted i 2024. A falsk italiensk forsvarsminister Guido Crosetto ringede til flere italienske eliter og bad dem om øjeblikkelig økonomisk hjælp til at redde de kidnappede journalister.

I opkaldet hævdede den falske Guido Crosetto, at der var tale om en tophemmelig regeringsoperation. Det lykkedes endda opkalderen at komme i telefon med legendariske modefigurer som Giorgio Armani.

Desværre endte en person med at overføre omkring en million dollars. De havde nok en stærkere følelse af patriotisk pligt til at hjælpe end andre, hvilket det lykkedes svindlerne at udnytte.

Energikuppet på $243.000 i Storbritannien

Denne skete i 2019 og var sandsynligvis den første rapporterede deepfake i den størrelsesorden.

En direktør for et britisk energifirma troede, at han talte i telefon med sin chef fra moderselskabet i Tyskland.

Den administrerende direktør blev beordret til at overføre ca. 220.000 euro ($243.000) til en leverandør i Ungarn. Han fik at vide, at det var en kritisk aftale, som skulle overføres med det samme. Den administrerende direktør faldt for svindelnummeret og overførte pengene.

Et skræmmende opkald til en mor i Arizona

Kan du huske, at vi talte om, at lyd-deepfakes var en trussel for familier? Det eksempel på svindel, vi gav, skete faktisk.

Svindlere havde klonet en 15-årig piges stemme fra en video af hende på de sociale medier. Derefter ringede de til hendes mor og påstod med datterens stemme, at hun var blevet kidnappet, og at hendes kidnappere krævede løsepenge med det samme.

Heldigvis var faren i stand til at ringe til deres rigtige datter, som var i sikkerhed ved en skitræning under hele episoden. De undgik svindelnummeret.

Sådan påvirker Voice Deepfakes virksomheder

Hovedformålet med et deepfake-angreb er for det meste at stjæle penge.

Men når målet er virksomheder, er skaden flerdimensionel.

For eksempel kan deepfakes forgifte atmosfæren mellem medarbejderne i en virksomhed. Det har potentiale til at skabe en kultur, hvor medarbejderne altid er bange for at begå en fejl.

Tag eksemplet med callcentre. Vi ser rapporter om cyberkriminelle, der ringer til dem og udgiver sig for at være specifikke kunder.

Deres trick er at få callcenter-agenterne til at ændre disse kunders kontooplysninger (f.eks. hjemmeadresser, telefonnumre) og overtage deres konti.

Fjernansættelse og virtuelle interviews er et andet område, hvor falske stemmer kan bruges af kandidater til at få jobs, de ikke er kvalificerede til.

Beskyttelse af virksomheder mod Voice Deepfake-angreb

De traditionelle sikkerhedsregler i virksomheder blev skrevet i tiden før AI.

Det er på høje tid, at virksomhederne genovervejer dem. De bør først begynde med at uddanne sig om de mange nye cybertrusler, der er opstået som følge af misbrug af kunstig intelligens.

De kan f.eks. arrangere træningssessioner for hele deres team og vise dem virkelige eksempler på lydsvindel. Du kan starte med de eksempler, vi lige har diskuteret ovenfor. Disse træningssessioner bør også give dem tips til forebyggelse af deepfake-angreb i forskellige scenarier.

Så kan du gå i gang med at opdatere de interne forretningspolitikker. En vigtig ændring kan være at stoppe med at tillade en enkelt person at godkende massive bankoverførsler helt alene.

Store betalinger bør kræve godkendelse af et helt panel, så mindst én af dem i tide kan opdage, at der er noget galt.

Du bør også overveje at integrere en automatiseret AI stemme-detektor til at køre i baggrunden under opkald.

Det er det, TruthScans AI-værktøjer er skabt til. Du kan opdage, verificere og forhindre voice deepfake-angreb ved hjælp af vores AI-værktøjer. Lad os fortælle dig hvordan.

Sådan sikrer TruthScan stemmeinteraktioner

Vi forstår, at medarbejderne ikke på egen hånd kan skelne en falsk stemme fra en rigtig stemme midt i et stressende opkald. De har brug for en dedikeret assistent, der kan tage sig af det job under et opkald, mens dit team kan fokusere på at gøre det, de er ansat til.

Vores AI stemme-detektor er en dedikeret løsning.

Her er, hvordan den fungerer, og hvad den er i stand til:

- Analyserer millioner af forskellige datapunkter i live telefonopkald og videomøder og leverer 99% nøjagtighed

- Udsender en advarsel med det samme efter at have opdaget en falsk stemme

- Fanger spektrale mønstre og akustiske fingeraftryk i stemmen, som kun efterlades af syntetiske modeller

- Integreres med dit eksisterende callcenter eller helpdesk via en simpel REST API

- Kan scanne alle større lyd- og videoformater

Tal med TruthScan om forebyggelse af Voice Deepfake-angreb

Du kan stoppe svindel med stemmekloning i realtid med TruthScan, men spørgsmålet er, hvornår du skal begynde? Dine medarbejdere kan før eller siden begå en fejl og få dig snydt. Vent ikke på det uheldige øjeblik.

Vores AI-stemmedetektor kan markere stemme-deepfakes ved hjælp af platforme som ElevenLabs og Murf.

Den arbejder i baggrunden under live telefonopkald og videomøder, så dine call-agenter ikke behøver at multitaske.

Alt, hvad der skal til, er en hurtig integration via vores REST API.

Kom i gang med TruthScan nu og beskyt din virksomhed mod deepfake-svindel.