I 90'erne var det DNA.

I 2000'erne var det pings fra mobilmaster.

Men i 2026 er den nye guldstandard for bevismateriale det digitale fingeraftryk.

Tænk på det på denne måde...

Hver videofil har en unik signatur.

Hvis blot en enkelt pixel ændres af AI, ændres fingeraftrykket øjeblikkeligt.

Hvis dit AI-bevis ikke har et verificeret blockchain-tidsstempel til at låse fingeraftrykket på plads, kan det lige så godt være en tegneserie i en moderne dommers øjne.

Så det betyder, at æraen med “at se er at tro” er forbi.

Vi er gået ind i en æra med AI-videoverifikation, hvor beviset ikke findes i det, du ser, men i den digitale kode, der er skjult under overfladen.

I denne blog vil vi undersøge, hvorfor traditionelle beviser ikke kan bruges mod videosvindel, hvordan man spotter manipulerede klip, hvorfor verifikation er afgørende for antagelighed, og hvorfor en AI-videodetektor som TruthScan nu er afgørende for juridiske teams.

Lad os dykke ned i det.

Det vigtigste at tage med

- I 2026 skal alt videobevis gennemgå AI-videoverifikation for at blive betragtet som pålideligt.

- Videosvindel omfatter små redigeringer som f.eks. manipulation af tidsstempler, ikke bare komplette ansigtsudskiftninger.

- En professionel deepfake-detektor er den eneste måde at fange GAN-artefakter på, som mennesker overser.

- Nye regler som Federal Rule 707 standardiserer, hvordan AI-bevismateriale tillades i retten.

- Automatiseret bevisanalyse gør det muligt for firmaer at behandle store pakker med bevismateriale hurtigt og præcist.

- TruthScan forhindrer svindel under livehøringer ved at opdage syntetiske masker i realtid.

Hvad er videobeviser i juridiske tvister?

Videobevis er dybest set ethvert optaget klip, der bruges i retten til at bevise, hvad der skete. Det findes overalt, lige fra straffesager til forsikringsopgør.

Men i 2026 har stigningen i videosvindel gjort “at se er at tro” til en farlig antagelse. Jurister har nu brug for robust AI-videoverifikation for at sikre retssystemets integritet.

Typer af videobeviser, som domstolene bruger hver dag

Du skal aldrig bekymre dig om AI-svindel igen. TruthScan Kan hjælpe dig:

- Opdag AI-generering billeder, tekst, stemme og video.

- Undgå at stor AI-drevet svindel.

- Beskyt dine mest følsom virksomhedsaktiver.

- Overvågning (CCTV): Kameraer fra butikker eller trafiklys. Det er det mest almindelige bevis i straffesager.

- Body Cams: Optagelser fra politibetjente, som mest bruges i sager om borgerrettigheder eller overdreven magtanvendelse.

- Dashcams: Det bedste bevismateriale til bilulykker og forsikringssager.

- Optagede vidnesbyrd: Videoafhøringer eller vidneudsagn på afstand, som er blevet normale siden pandemien. Det er nu en standard, men det kan give udfordringer med at opdage juridisk svindel.

- Smartphone og sociale medier: Videoer fra tilskuere eller indlæg, der beviser en persons adfærd eller placering.

- Virksomhedens sikkerhed: Optagelser, der bruges af virksomheder i sager om bedrageri eller “uretmæssig fyring”.

Generativ AI og deepfake-teknologi har tilføjet et nyt lag af risiko. I 2025:

- 1 ud af 20 identitetsbekræftelser blev snydt af AI-deepfakes

- En Medius-undersøgelse viste, at 43% af fagfolk var blevet ofre for et forsøg på deepfake-svindel

Tilfælde af svindel med videobeviser i den virkelige verden

- Manipulerede klip fra retssalen

Manipulerede klip fra retssalen henviser til video- eller lydbeviser, der er fremlagt i en retssag, og som er blevet ændret, redigeret eller helt fabrikeret ved hjælp af teknologi.

Eksempler:

- Alameda county deepfake case (2025): En civil sag i Californien blev afvist, da retten opdagede, at en vidnevideo, der blev fremlagt som bevismateriale, var blevet skabt udelukkende ved hjælp af kunstig intelligens.

- Sz Huang v. Tesla deepfake-forsvaret (2023): I en retssag om uretmæssig død hævdede Teslas advokater, at de vigtigste optagelser fra ulykken kunne være en deepfake.

Ændrede overvågningsvideoer

Overvågningsvideo er en af de mest almindelige typer AI-beviser, der bruges i retten. Men mange mennesker tænker fejlagtigt på manipulation som kun fuldstændige deepfakes.

I virkeligheden sker videosvindel ofte på mindre, mindre åbenlyse måder, som kan kompromittere en sag.

Almindelige typer af manipulation omfatter:

- Ændringer i tidsstempler

- Fjernelse af ramme

- Metadata eller GPS-ændringer

- Udskiftning af ansigt

- Fjernelse eller indsættelse af objekt

- Optagelser i loop

- Forringelse af kvaliteten

Overvågningsvideo kommer ofte fra mange forskellige steder, f.eks. private butikker, dørklokker i hjemmet, parkeringspladser og bykameraer. I modsætning til optagelser fra politiets kropskameraer følger disse systemer normalt ikke strenge regler for opbevaringskæden.

Det vil sige:

- Der er måske ingen klar oversigt over, hvem der har håndteret sagen.

- Optagelserne kan kopieres, overføres eller konverteres flere gange.

- Autentificeringsprocedurer kan være svage eller inkonsekvente.

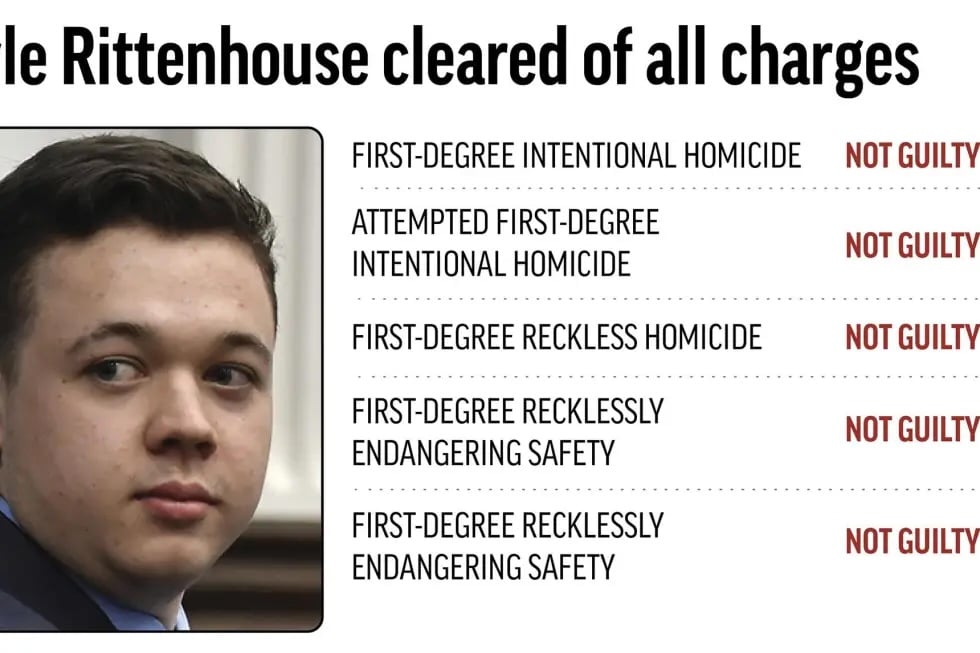

Et eksempel: Spørgsmålet om Wisconsin v. Rittenhouse AI-forbedring

Et berømt eksempel kom fra retssagen Wisconsin mod Rittenhouse. Anklageren forsøgte at bruge en iPads pinch-to-zoom-funktion til at vise detaljer i en dronevideo.

Forsvaret hævdede, at Apples zoom bruger AI-interpolation til at gætte, hvad der burde være der. Dommeren afgjorde, at uden en professionel AI-videodetektor kunne de forbedrede optagelser ikke tillades.

Omstridte video-vidnesbyrd

Et omstridt videovidnesbyrd kræver normalt juridisk svindelopsporing for at afgøre, om en optagelse er det:

- En fuldstændig fabrikeret vidneforklaring eller erklæring

- Et ægte vidnesbyrd udfordret som falsk

- En manipuleret ægte optagelse

Hvert scenarie skaber en alvorlig autentificeringsbyrde for retten.

Et eksempel: Den britiske sag om forældremyndighed

I en britisk familiedomstolstvist, som University of Baltimore Law Review citerer, indsendte en mor en stærkt ændret optagelse for at fremstille faderen som voldelig under en kamp om forældremyndigheden.

Målet var at begrænse hans adgang til sine børn.

Fremgang for AI-genereret video i juridiske sager

Rejsen mod den nuværende æra med deepfake-detektorer foregik i forskellige faser:

- De tidlige advarselsår (2017-2021)

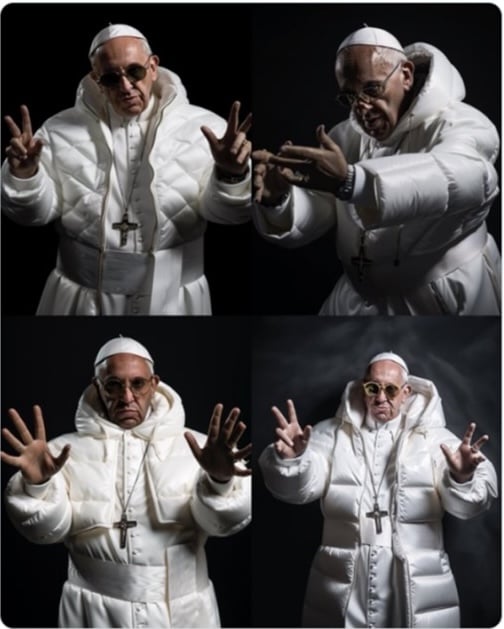

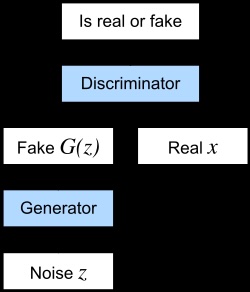

Deepfake-teknologi (drevet af generative adversarial networks (GANs)) kom i offentlighedens søgelys omkring 2017.

De første deepfakes var ofte af lav kvalitet: ansigter med underlige forvrængninger, ekstra fingre, forkert belysning og slørede træk, der gjorde dem nemme at få øje på.

- Eskalationsfasen (2022-2023)

I 2022 var teknologien blevet bedre. Mange var gratis og kunne bruges på en smartphone.

I 2023 begyndte vi at se nogle af de første betydelige deepfake-relaterede udfordringer i retssager, herunder Sz Huang v. Tesla, United States v. Reffitt og United States v. Doolin, hvor advokaterne rejste spørgsmål om, hvorvidt videobeviser kunne være AI-genererede.

Omtrent samtidig begyndte American Bar Association's Advisory Committee on Evidence Rules formelt at studere spørgsmålet.

- Den kritiske tærskel (2024-2025)

AI-genereret indhold forblev ikke akademisk længe. I 2024 skete der en hændelse i ingeniørfirmaet Arup, som involverede et AI-genereret spoof-videoopkald, der autoriserede svigagtige bankoverførsler på i alt $25 millioner.

Det juridiske system begyndte at reagere.

I 2025, Louisiana vedtog HB 178, og skabte den første ramme for verifikation af AI-evidens på statsniveau.

På føderalt niveau foreslog U.S. Advisory Committee on Evidence Rules Regel 707, der fokuserer på maskingenereret bevismateriale.

Hvor står tingene i 2026?

Fra begyndelsen af 2026 er reguleringen af deepfake og AI-video accelereret på landsplan:

- 46 stater har vedtaget en eller anden form for deepfake-lovgivning.

- Siden 2022, 169 love er blevet vedtaget, og 146 lovforslag blev fremsat alene i 2025..

- Federal Rule 707 er åben for offentlige kommentarer til og med 16. februar 2026.

Forbedring af videoverifikation med AI

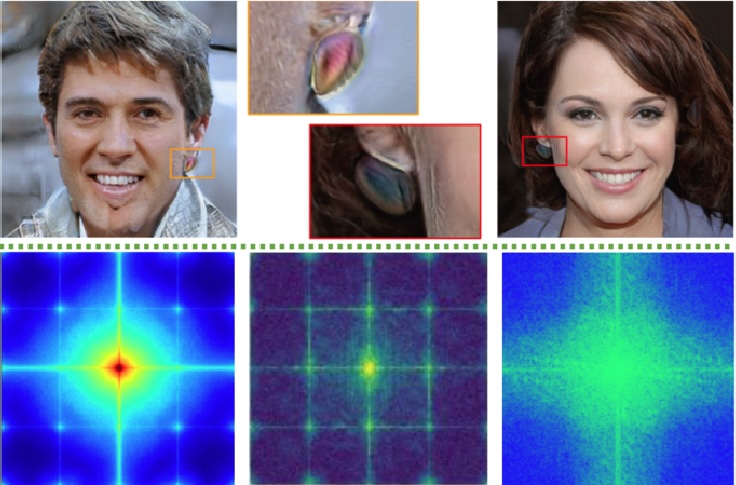

Den mest effektive måde at opdage AI-genereret video på er at bruge AI selv.

Det skyldes, at deepfakes skabes af maskinlæringssystemer, der efterlader subtile digitale mønstre.

Disse mønstre er for små eller komplekse til, at det menneskelige øje kan se dem. Men de kan opdages af andre algoritmer.

Et pålideligt AI-videoverifikationssystem kan analysere flere lag af en video på én gang, herunder:

- Analyse på rammeniveau tjekker hver frame for visuelle fejl som mærkelige teksturer, forkert belysning eller blandingsproblemer omkring ansigter.

- Analyse af tidsmæssig sammenhæng ser på bevægelser på tværs af billeder for at finde unaturlige spring eller inkonsekvente bevægelser.

- Sporing af landemærker i ansigtet overvåger øjenbevægelser, blink og ansigtsform for at opdage unaturlige ændringer.

- Test af audiovisuel synkronisering kontrollerer, om læbebevægelserne passer nøjagtigt til de talte ord.

- Retsmedicinske undersøgelser af lyd analyserer stemmen for tegn på kloning, f.eks. usædvanlige lydmønstre eller robotagtige toner.

- Analyse af metadata og komprimering Undersøgelser af skjulte fildata er afgørende for afsløring af juridisk svindel for at se, om de matcher de oprindelige optagelsesdetaljer.

Uddannelse af juridiske teams i videosvindel

Da AI nu kan efterligne menneskelig adfærd med skræmmende nøjagtighed, bruger advokatfirmaer automatiseret bevisanalyse og en blanding af traditionelle taktikker for at være på forkant.

| Kategori | Metode | Beskrivelse |

| Officielle måder | CLE-kreditter (løbende juridisk uddannelse) | Obligatoriske eller valgfrie kurser, der lærer advokater at autentificere digitale beviser, forstå deepfakes og opfylde bevisstandarder. |

| Retsudpegede AI-eksperter | Etablering af certificerede AI-retsmedicinske specialister, svarende til DNA-eksperter, til at evaluere omstridte videobeviser i retten. | |

| Ikke-officielle måder | Internt rødt team | Ansættelse af cybersikkerhedsfolk til at teste, om falske eller manipulerede beviser kan slippe igennem firmaets modtagelsessystemer. |

| “Vibe Check”-protokollen | Træne personalet i at spotte almindelige deepfake-advarselssignaler som unaturlige blink, forvrængede træk eller problemer med læbesynkronisering, før de eskalerer til retsmedicinsk gennemgang. |

Værktøjer og teknologi til validering af evidens

I 2026 har vi bevæget os ud over simpel inspektion med øjnene.

Fordi AI nu er i stand til at narre selv de mest erfarne efterforskere, bruger juridiske teams et specifikt sæt værktøjer til at verificere, at det, de ser, er den absolutte sandhed.

Teknologien bag validering af evidens

- Deepfake-detektorer: Det er specialiserede softwareprogrammer, der scanner for GAN-artefakter. Det er mikroskopiske, matematiske mønstre eller støj, som er efterladt af de AI-modeller, der genererer syntetiske ansigter. Mens et menneske ser et ansigt, ser detektoren en digital signatur, der ikke hører til.

- TruthScan er en deepfake-detektor, der scanner videoer billede for billede for AI-tegn som usædvanlige blink, mærkelige ansigtsformer eller pixelfejl, hvor der er tilføjet et falsk ansigt.

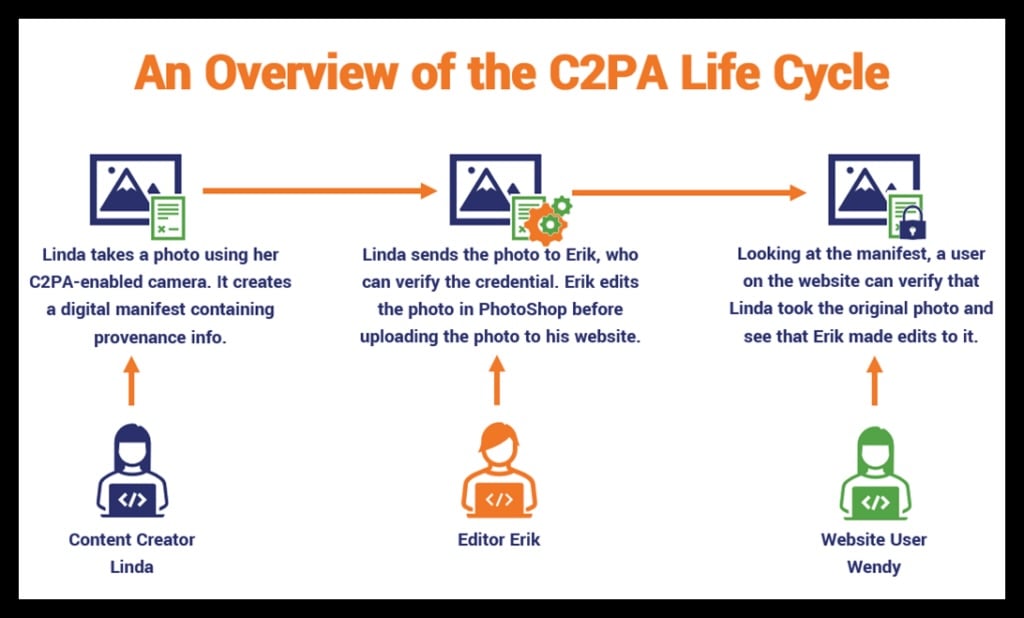

- Blockchain-tidsstempler: For at bevise, at en video ikke er blevet rørt siden det øjeblik, den blev optaget, bruger mange agenturer nu C2PA-standarden. Når en video optages på en kompatibel enhed, oprettes der et unikt digitalt fingeraftryk (hash), som gemmes på en blockchain.

- TruthScan kan tjekke, om dette fingeraftryk matcher videoen og vise, om filen er blevet redigeret, eller om sporbarhedskæden er blevet brudt.

- Retsmedicinske værktøjer til metadata: Alle digitale filer har en fødselsattest, der kaldes Exif-data. Disse værktøjer kontrollerer, om en fil er blevet gemt igen i en AI-redigeringssoftware, eller om lokaliseringsdataene (GPS) er blevet forfalsket. Hvis en video hævder at være fra et butikskamera, men metadataene viser, at den blev eksporteret fra et videoredigeringsprogram, har du et problem.

- Amped Software og TruthScan undersøger skjulte fildata (Exif, headers) for at se, om videoen er redigeret eller AI-bearbejdet.

Tendenser inden for AI-videobeviser

Her er de tre trends i 2026.

- Generativ kontradiktorisk kriminalteknik: AI vs. AI

Den mest avancerede måde at fange en deepfake på i 2026 er at bruge den samme teknologi, som skabte den. Dette er kendt som Generative Adversarial Forensics.

- En AI (generatoren) forsøger at skabe en forfalskning, mens en anden AI (diskriminatoren) forsøger at fange den. I retssalen kan værktøjer som TruthScan være den ultimative diskriminator.

- Et eksempel: En sagsøger indsender en video af en CEO, der indgår en mundtlig kontrakt. TruthScan scanner videoen ved hjælp af sine egne kontradiktoriske modeller for at opdage GAN-artefakter. Hvis softwaren markerer en 98%-syntetisk sandsynlighed, er beviset sandsynligvis en forfalskning for at narre menneskelige øjne.

- Analyse af lyd- og videosynkronisering (0,01 ms-reglen)

Mennesker kan normalt se en forsinkelse, hvis lyden i en video er ca. 40-80 millisekunder forkert. Men deepfakes fra 2026 er ofte næsten perfekte.

- Moderne AI-retsmedicinske værktøjer leder nu efter en forsinkelse på 0,01 millisekunder mellem den fonetiske lyd af et ord og den mekaniske bevægelse af læberne.

- Et eksempel: I en chikanesag fra 2026 hævdede en tiltalt, at en video var forfalsket. En automatiseret retsmedicinsk bevisanalyse viste, at læbeformerne “M” og “B” var 0,02 ms ude af sync med lyden. Denne mikroskopiske fejl beviser, at stemmen var klonet og lagt over en anden video, hvilket førte til en afvisning.

- Cheapfakes vs. Deepfakes

Mens deepfakes bruger avanceret AI, er cheapfakes den mest almindelige form for videosvindel.

- En Deepfake skaber en virkelighed, der aldrig er sket (som et face-swap). En Cheapfake tager rigtige optagelser og ændrer konteksten eller hensigten ved hjælp af enkle værktøjer.

- Eksempel (den langsomme nedtrapning): En video af en politiker, der virker beruset eller påvirket, kan skabes ved at sænke hastigheden på optagelserne med 20% og justere lydniveauet.

- Eksempel (den nye kontekst): Optagelser fra en protest i 2022 i et andet land bliver lagt ud i 2026 som direkte bevis på et lokalt oprør. Juridiske teams bruger nu TruthScans metadataanalyse til at bevise videoens faktiske fødselsdato.

Sådan beskytter TruthScan juridisk videobeviser

TruthScan sikrer, at hvert eneste billede, du præsenterer i retten, er autentisk, verificeret og juridisk forsvarligt.

Platformen strømliner AI-videoverifikation gennem følgende fordele:

Automatiserede revisionslogs og dokumentation af opbevaringskæden

- Retssikker pålidelighed: Genererer PDF- og JSON-rapporter, der dokumenterer hvert verifikationstrin med præcise tillidsscorer og tidsstempler.

- Overensstemmelse i topklasse: Du kan være sikker på, at dine data forbliver sikre og opfylder strenge globale standarder som SOC 2, ISO 27001 og GDPR.

- Fleksibel datakontrol: Hold følsomme beviser inden for din nødvendige jurisdiktion med lokale eller VPC-implementeringsmuligheder designet til stærkt regulerede industrier.

Batchbehandling og API-integration til juridiske workflows

- Massive tidsbesparelser: Behandl tusindvis af filer fra opdagelsespakker eller overvågningssæt på samme tid ved hjælp af import af masselagring (S3/GCS).

- Sømløs E-Discovery: Strømlin din drift ved at integrere verifikation direkte i din eksisterende software via webhooks og API'er.

- Eliminer manuelle fejl: Automatiser den første del af bevisscreeningen, så dit team kan fokusere på strategi i stedet for kedelig kontrol af fil for fil.

Verifikation i realtid til vidneudsagn og fjernhøringer

- Stop efterligning: Brug live streaming endpoints til at opdage, om en vidne bruger deepfake-filtre eller stemmekloner under en fjernhøring.

- Oprethold rettens integritet: Marker visuelle eller lydmæssige afvigelser i realtid, så falske vidnesbyrd ikke kommer med i protokollen.

- Fred i sindet: Giv dine klienter og retten et ekstra lag af sikkerhed, der garanterer, at personen på skærmen er præcis den, han eller hun giver sig ud for at være.

Få mere at vide om sikring af AI-videobeviser

Beskyt dit firma mod risikoen ved manipulerede medier. TruthScans deepfake-detektor og AI-videodetektorteknologi giver den ultimative løsning til e-discovery og juridisk verifikation.

Er du klar til at se TruthScan i aktion?

- Besøg truthscan.com for at få 20.000 credits gratis.

- For virksomhedsforespørgsler, API-integration eller tilpassede implementeringsmuligheder kan du kontakte deres team på Truthscan.com/contact.