Introduktion

Kunstig intelligens er i færd med at ændre landskabet for økonomisk svindel på hidtil usete måder. I begyndelsen af 2024 brugte svindlere AI-genererede deepfakes til at udgive sig for at være ledere i et videoopkald - og narrede en medarbejder i Hongkong til at overføre $25 millioner til svindlerne[1][2]. Hændelser som denne viser, hvordan generativ AI gør det muligt for kriminelle at lave meget overbevisende svindel, der er rettet mod banker og deres kunder. Tilsynsmyndighederne slår alarm: Det amerikanske finansministeriums FinCEN udsendte i slutningen af 2024 en advarsel om stigende svindel ved hjælp af AI-genererede "deepfake"-medier, herunder falske identitetsdokumenter til at omgå bankverificeringer.[3][4]. Dette whitepaper undersøger de seneste Tendenser til AI-svindel i finansielle tjenester og diskuterer, hvordan institutioner kan styrke deres forsvar. Vi undersøger, hvordan svindlere bruger generativ AI som våben - fra deepfake-imitationer til syntetiske identiteter - og skitserer teknologi og strategier (herunder avancerede detektionsværktøjer som f.eks. TruthScan), som bedrageriteams og ledere kan bruge til at imødegå denne nye trussel.

Vigtige tendenser inden for AI-svindel i finanssektoren

AI og maskinlæring bliver udnyttet af dårlige aktører til at udføre bedrageri i større skala og mere sofistikeret. Bemærkelsesværdigt AI-drevne svindeltaktikker der påvirker banker, fintechs og forsikringsselskaber, omfatter:

- Deepfake-svindel med efterligning: Kriminelle bruger AI-genereret video og lyd til at udgive sig for at være betroede personer (direktører, kunder osv.) i realtid. For eksempel er livagtige deepfake-stemmer blevet brugt i vishing-angreb (voice phishing) til at godkende falske bankoverførsler, og AI-skabte videoer har narret medarbejdere til at godkende falske transaktioner.[1][5]. Disse syntetiske medier gør det svært at vide, om du virkelig taler med den person, du tror, du er, hvilket muliggør værdifulde røverier som $25M deepfake-sagen ovenfor. Deepfakes er ved at blive overkommelig og nem at producereder kræver så lidt som 20-30 sekunders lyd for at klone en stemme eller under en time for at generere en tilsyneladende autentisk video.[6].

- AI-forbedret phishing og BEC: Generativ AI sætter turbo på social engineering-metoder som phishing-mails og Kompromittering af forretningsmail (BEC). AI-chatbots kan udarbejde meget personlige svindelmails i perfekt forretningssprog, efterligne en CEO's skrivestil eller skabe overbevisende falske leverandørfakturaer i stor skala. Faktisk kan undergrundsværktøjer som SvindelGPT og OrmGPT (ufiltrerede versioner af ChatGPT) er dukket op for at hjælpe cyberkriminelle med at automatisere phishing og malware-oprettelse[7][8]. Det betyder, at en potentiel svindler med minimale færdigheder let kan generere polerede phishing-kampagner eller ondsindet kode. Med AI kan en enkelt kriminel udsende tusindvis af skræddersyede svindelmails eller sms'er, hvilket i høj grad øger rækkevidden af traditionelle svindelforsøg. FBI's Internet Crime Center har allerede observeret over $2,7 milliarder kroner tabt til BEC-svindel i 2022, og generativ AI truer med at skubbe disse tab endnu højere op i de kommende år[9][10].

- Syntetiske identiteter og dokumentsvindel: Generativ AI giver næring til et boom i syntetisk identitetssvindelen af de hurtigst voksende former for økonomisk kriminalitet[11][12]. Svindlere kombinerer ægte og falske personlige data for at skabe "Frankenstein"-identiteter og bruger derefter AI til at producere realistisk dokumentation - fra falske pas og kontoudtog til lønsedler[7]. AI-billedgeneratorer og -redigeringsværktøjer kan smede ID'er og fotos, der ser autentiske ud der passerer en tilfældig inspektion. Selv livskontrol eller selfie-verifikation kan potentielt overvindes af AI-manipulerede billeder eller videoer. Ved at automatisere oprettelsen af tusindvis af falske personer (hver med AI-genererede profilbilleder, sociale medier osv.) kan kriminelle åbne bankkonti eller ansøge om lån i massevis og hvidvaske penge eller misligholde kredit. Tab som følge af syntetisk identitetssvindel blev anslået til ca. $35 milliarder i 2023[13]og generativ AI fremskynder kun denne tendens ved at gøre falske identiteter billigere og sværere at opdage.

- Automatiseret svindel og unddragelse: Ud over at skabe falsk indhold hjælper AI også svindlere maksimere succesen af deres planer. Avancerede bots kan hurtigt teste stjålne kreditkortoplysninger på e-handelssider ved hjælp af ML for at undgå at blive opdaget. AI kan hjælpe kriminelle med at identificere de svageste led i en organisations sikkerhed eller endda syntetisere stemmesvar for at overvinde telefonbaseret identitetsbekræftelse. En lille industri på det mørke web sælger nu AI-værktøjer til "svindel som en service" for så lidt som $20[14]. Denne demokratisering af AI-kapaciteter betyder, at selv kriminelle på lavt niveau kan iværksætte meget sofistikerede svindelangreb. Våbenkapløbet strækker sig til at undgå at blive opdaget - svindlere bruger AI til at undersøge bankernes antisvindelsystemer og forfine deres tilgang, indtil de finder en metode, der slipper igennem filtrene.[15]. Kort sagt gør AI det muligt at begå bedrageri. i en skala og med en effektivitet, der ikke er set førog udfordrer det konventionelle forsvar.

Disse AI-aktiverede taktikker er allerede spredes med en alarmerende hastighed. Traditionelle svindelmetoder som checkforfalskning eller phishing har eksisteret i årevis, men AI øger deres omfang og realisme. Dataene fortæller en klar historie: AI-svindel er stigende.

Du skal aldrig bekymre dig om AI-svindel igen. TruthScan Kan hjælpe dig:

- Opdag AI-generering billeder, tekst, stemme og video.

- Undgå at stor AI-drevet svindel.

- Beskyt dine mest følsom virksomhedsaktiver.

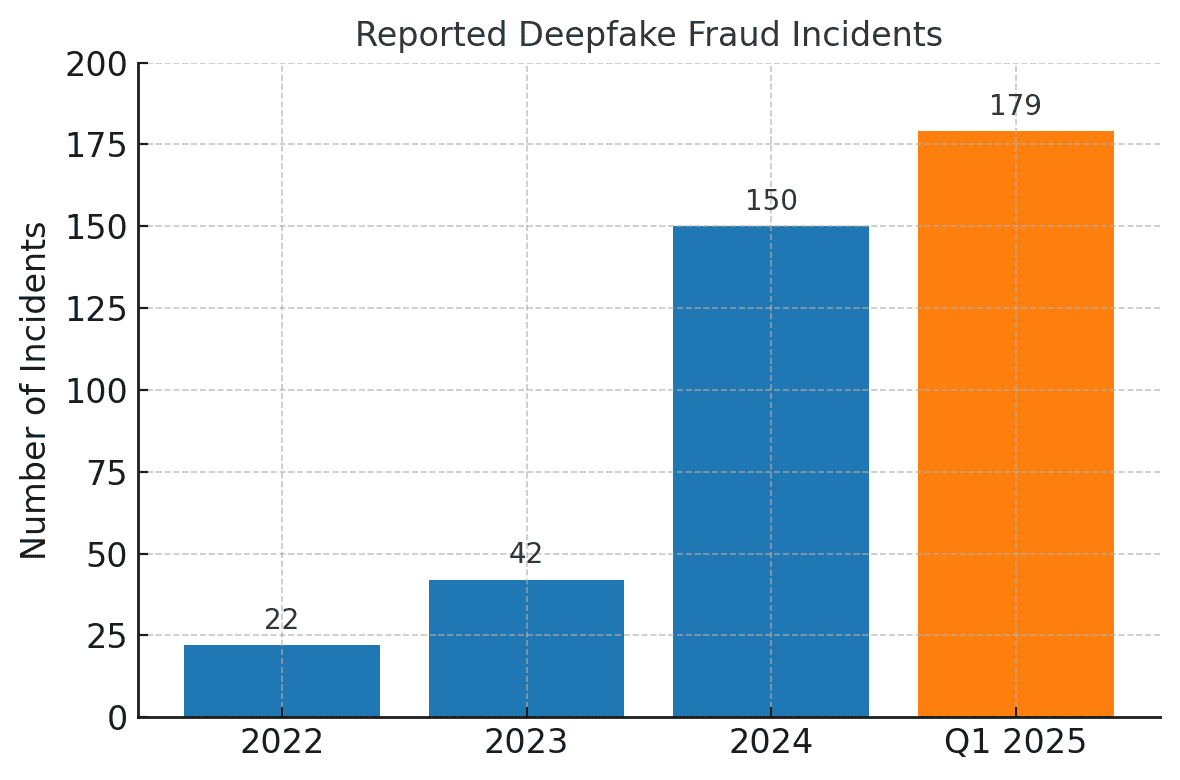

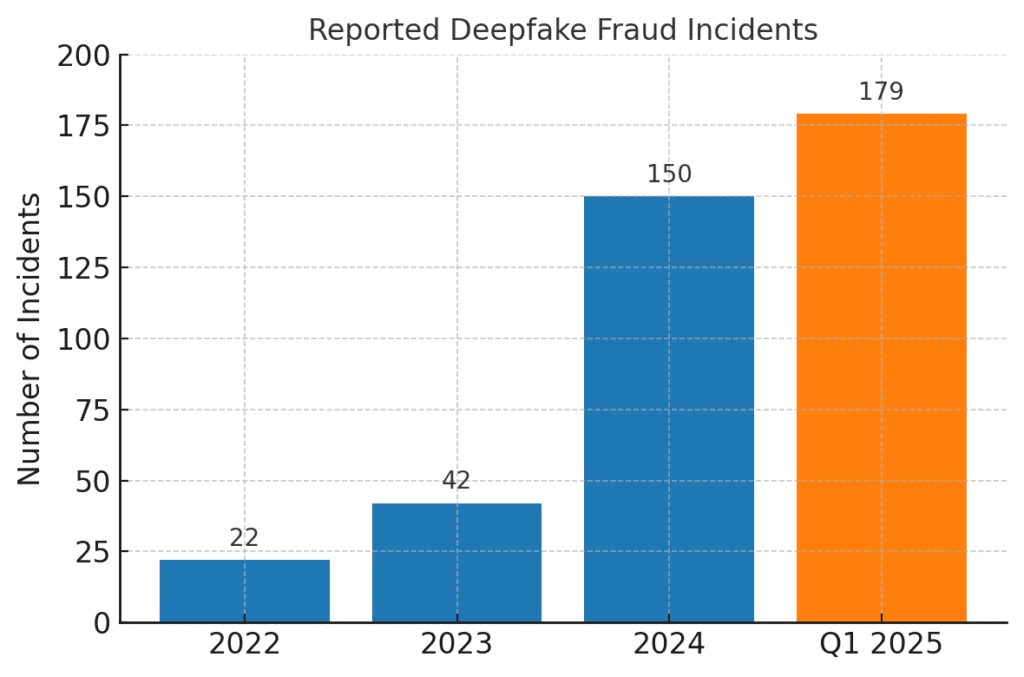

Deepfake-relaterede svindelhændelser er skudt i vejret. I 2022 blev der kun registreret 22 tilfælde af deepfake-svindel, men i 2023 var der 42, og i 2024 eksploderede antallet af hændelser til 150. Bare i det første kvartal af 2025, 179 tilfælde af deepfake-svindel blev rapporteret - hvilket overstiger det samlede antal for hele 2024[16][17].

Nylige brancheanalyser afspejler disse tendenser. En rapport bemærkede en 700% stigning i deepfake-hændelser rettet mod fintech-virksomheder i 2023[18]. Endnu mere forbløffende er det, at Nordamerika oplevede en 1,740% stigning i sager om deepfake-svindel mellem 2022 og 2023[19]. Finansielle kriminelle tager hurtigt disse værktøjer til sig, fordi de virker - mange banker og ofre er endnu ikke forberedt på at opdage AI-genereret bedrag.

Konsekvenser og udfordringer for finansielle institutioner

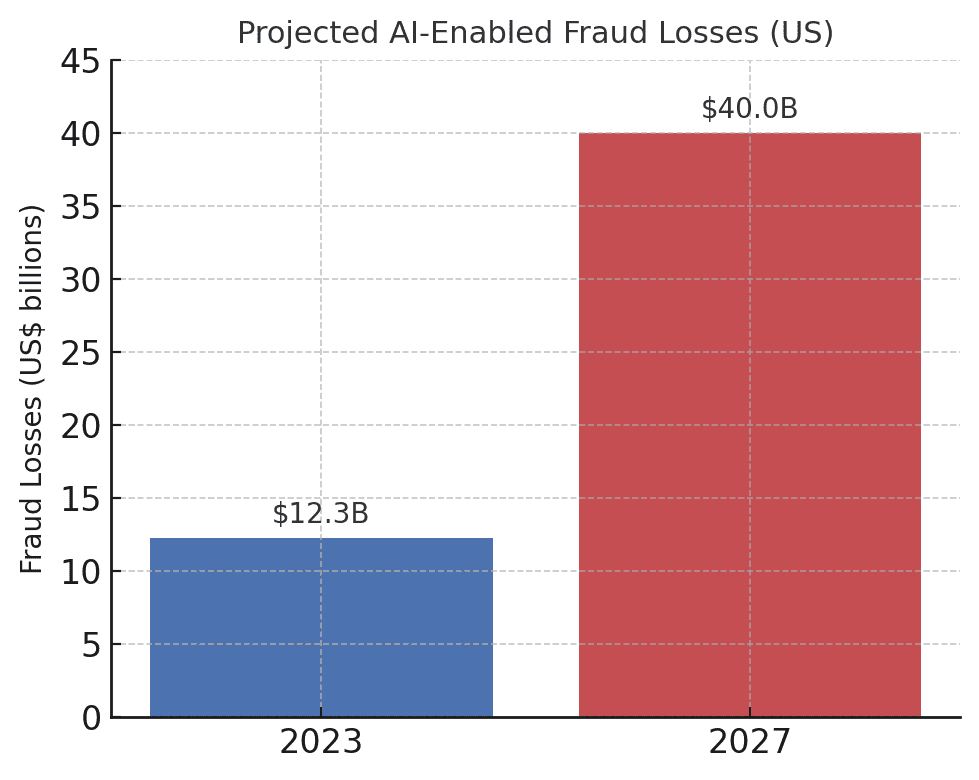

Fremkomsten af AI-drevet svindel udgør væsentlige påvirkninger på finansielle institutioner, deres kunder og det bredere finansielle system. Den mest umiddelbare konsekvens er økonomiske tab. Prognoser fra branchen forudsiger, at i 2027, Tab ved svindel muliggjort af generativ AI kan nå $40 milliarder i USA, op fra $12,3 milliarder i 2023[20]. Denne mere end tredobbelte stigning (en 32% CAGR) afspejler, hvor hurtigt risikoen for svindel vokser i dollar.

De forventede tab fra AI-aktiveret svindel stiger dramatisk. Deloitte anslår, at tab ved økonomisk svindel i USA i forbindelse med generativ AI vil stige fra $12,3 milliarder i 2023 til $40 milliarder i 2027[20].

Ud over rå tab er der omdømme- og Tillidsomkostninger. Forbrugerne forventer, at deres banker beskytter dem - men svindel med kunstig intelligens underminerer tilliden til digitale kanaler. Hvis en kunde f.eks. bliver offer for et overbevisende deepfake-svindelforsøg (som et falsk videoopkald fra en bankmand), kan de bebrejde banken for utilstrækkelig sikkerhed. Offentlighedens tillid i talebekræftelse, e-mails og endda videokonferencer kan udhules, hvis "det, du ser/hører", ikke længere kan antages at være ægte.[21]. Ifølge undersøgelser ser 85% af finansfolk i USA/UK deepfake-svindel som en "eksistentiel" trussel mod deres organisations sikkerhed.[22]. Mere end halvdelen af virksomhederne på disse markeder rapporterer, at de er blevet ramt af et deepfake-drevet svindelnummer, og alarmerende nok 43% af dem, det gik ud over, indrømmede, at angrebet lykkedes ved at narre dem[23]. Hver vellykket hændelse forårsager ikke kun økonomisk skade, men nedbryder også kundernes tillid til institutionen.

Finansielle virksomheder kæmper også med udfordringer med drift og compliance fra AI-svindel. Anti-svindel-teams står over for en stigning i antallet af advarsler og hændelser, hvilket belaster efterforskningsressourcerne. Eksisterende modeller til afsløring af svindel (hvoraf mange bygger på regler eller ældre maskinlæringsteknikker) kan have svært ved at genkende AI-syntetiseret indhold, der ser legitimt ud. Faktisk ser state-of-the-art deepfake-detektionssystemer udviklet i laboratorier deres nøjagtighed falde med næsten 50%, når de konfronteres med deepfakes i den virkelige verden i naturen[24]. Menneskelige medarbejdere klarer sig ikke meget bedre - undersøgelser viser, at mennesker kun kan spotte deepfake-videoer af høj kvalitet omkring 55%-60% af tidenknap bedre end tilfældighederne[25]. Dette indikerer, at uden nye værktøjer vil bankerne gå glip af en stor del af de AI-drevne svindelforsøg.

Der er også en lovgivningsmæssig dimension. Tilsynsmyndigheder og retshåndhævende myndigheder er meget opmærksomme på risiciene (som det fremgår af FinCEN-alarmen), og de forventer, at finansielle institutioner tilpasser sig. Banker kan blive udsat for strengere retningslinjer for kundeverifikation og rapportering af svindel i AI-æraen. Hvis en bankansat f.eks. bliver narret af en deepfake til at godkende en overførsel på $10 millioner, kan tilsynsmyndighederne granske bankens kontrol- og due diligence-processer. De Lov om bankhemmelighed omfatter nu eksplicit rapportering af mistanke om cyberkriminalitet og deepfake-relateret aktivitet[26][4]Det betyder, at banker skal uddanne personale til at genkende og rapportere AI-genererede svindelindikatorer i rapporter om mistænkelig aktivitet (SAR). Hvis man ikke følger med i AI-forstærkede svindelteknikker, kan det føre til overtrædelser af reglerne eller juridisk ansvar, hvis kunder eller modparter hævder, at banken ikke gjorde nok for at forhindre forudsigelige AI-aktiverede svindelnumre.

Den største udfordring er måske Den nye trussels asymmetriske karakter. Generativ AI sænker i høj grad omkostningerne og færdighedsbarrieren for angribere, samtidig med at mængden og realismen af angreb øges eksponentielt. Et enkelt viralt deepfake-rygte eller et overbevisende stemmeopkald kan ødelægge millioner af dollars i autentificeringsinvesteringer. I mellemtiden skal forsvarere verificere ægtheden af hver eneste transaktion og interaktion, hvilket er en meget sværere opgave. Det er i sandhed et våbenkapløb: AI giver svindlere et selvopdaterende værktøjssæt til at omgå sikkerheden, hvilket kræver, at bankerne også konstant opdaterer deres forsvar.[15][27]. Mange finansielle institutioner indrømmer, at de ikke er tilstrækkeligt forberedte. over 80% af virksomhederne mangler en formel beredskabsplan for deepfake-angrebog mere end halvdelen har ikke undervist deres medarbejdere i deepfake-risici.[28][29]. Denne mangel på beredskab betyder, at organisationer i øjeblikket er sårbare, men det viser også, hvor der er behov for handling.

Et bemærkelsesværdigt og tankevækkende tal kommer fra en nylig brancherapport: 42,5% af svindelforsøgene i den finansielle sektor involverer nu en eller anden form for AI[30]. Med andre ord har næsten halvdelen af de svindelangreb, som bankerne udsættes for, en AI-komponent - uanset om det er et AI-genereret dokument, en syntetiseret stemme eller en maskingenereret phishing-besked. Denne statistik understreger, at AI ikke er en hypotetisk fremtidig trussel; den er her allerede og tvinger finansielle institutioner til at tilpasse sig eller stå over for stigende tab.

Forsvar mod AI-aktiveret svindel: Strategier og løsninger

At konfrontere AI-drevet svindel kræver en udvikling af strategier til forebyggelse af svindel. Traditionelle tilgange (som manuel verificering eller statiske regelsæt) kan ikke hamle op med formskiftende AI-svindel. I stedet skal bankerne omfavne Teknologi (som at sørge for, at de har en Sikkert SSL-certifikat), træning og teamwork for at vende udviklingen. Nedenfor skitserer vi de vigtigste strategier og nye løsninger:

- Udnyt AI til at bekæmpe AI (avancerede detektionsværktøjer): Finansielle institutioner henvender sig i stigende grad til AI-drevne detektionsløsninger til at identificere AI-genereret indhold og afvigelser. I bund og grund er du nødt til at bekæmpe ild med ild. Nye virksomhedsværktøjer som f.eks. TruthScan tilbyde multimodal AI-detektion på tværs af tekst, billeder, stemme og video for at hjælpe med at autentificere indhold i realtid[31]. For eksempel kan banker anvende AI-tekstdetektorer til at scanne indgående kommunikation (e-mails, chatbeskeder) for tegn på AI-genereret sprog, der kan indikere en phishing-mail eller en falsk kundehenvendelse. TruthScans AI-tekstdetekteringssystem kan identificere AI-skrevet indhold fra modeller som GPT-4 med 99%+ nøjagtighedog endda finde ud af, hvilke sætninger der sandsynligvis er AI-genererede[32][33]. På samme måde kan AI-billedredskaber verificere dokumenter og billeder; en AI-billeddetektor kan markere, hvis et indsendt kørekort eller en regning er blevet oprettet digitalt eller manipuleret ved at sammenligne det med kendte mønstre af AI-genererede billeder[34]. Til lydtrusler er bankerne begyndt at bruge stemme deepfake-detektorer - løsninger, der analyserer opkaldslyd for de akustiske fingeraftryk af syntetisk tale. TruthScans AI Voice Detector lytter f.eks. efter tydelige tegn på stemmekloning og kan Bekræft talerens ægthed for at forhindre falske opkald[35]. Ved at integrere disse detektorer via API i deres workflows kan finansielle institutioner automatisk screene for AI-indhold i baggrunden af transaktioner og interaktioner. Dette giver et ekstra lag af forsvar, der fungerer ved maskinhastighed og fanger det, som menneskelige øjne/ører måske overser.

- Implementer multifaktor- og out-of-band-verifikation: Da AI gør det sværere at stole på stemmer eller billeder, bør bankerne i højere grad anvende verifikationsmetoder, som AI ikke så let kan forfalske. Dette omfatter multifaktorautentificering (MFA) ved hjælp af sikre kanaler. Hvis en anmodning om bankoverførsel f.eks. kommer via e-mail eller videoopkald, skal man kræve en anden faktor som f.eks. en engangskode, der sendes til anmoderens kendte mobile enhed, eller et tilbagekald på et pålideligt telefonnummer, der er registreret. Nogle banker tilføjer "liveness"-tjek til højrisikotransaktioner - for eksempel ved at bede en kunde om at tage en live-selfie med en bestemt gestus eller et bestemt ord, som er sværere for en deepfake-video at kopiere. Biometriske autentifikatorer kan forbedres med antispoofing-foranstaltninger (f.eks. scanning for 3D-ansigtsdybde eller overvågning af de subtile øjenbevægelser, som deepfakes ofte ikke kan efterligne).[27]). Nøglen er at undgå single points of failure. Selv hvis en AI-deepfake kan narre én kanal (f.eks. stemmekontrol), kan en koordineret out-of-band-kontrol eller biometrisk test give den nødvendige udfordring til at afsløre svindlen. Principper om nul tillid bør anvendes: Behandl enhver uopfordret eller uventet instruks (selv fra en "kendt" leder eller klient) som mistænkelig, indtil den er verificeret gennem en uafhængig kanal.

- Uddannelse af medarbejdere og bevidsthed om svindel: Teknologi alene er ikke nogen mirakelkur - især fordi svindlere går efter det svageste led, som ofte er menneskelig tillid. Finansielle institutioner bør investere i regelmæssig træning af teams til forebyggelse af svindel og frontlinjepersonale i AI-baseret svindel. Medarbejderne skal lære at genkende røde flag for deepfakes og social engineering. Det kan omfatte træning i subtile anomalier (f.eks. problemer med læbesynkronisering i et videoopkald eller lyd, der indeholder unaturlig intonation eller for lidt baggrundsstøj - potentielle tegn på en syntetisk stemme). Tilskynd til en kultur af Verifikation: Medarbejderne skal føle sig bemyndiget til at sætte en mistænkelig transaktion eller anmodning på pause og verificere den uafhængigt, selv om den ser ud til at komme fra CEO'en. Sagen om den Forsøg på spoofing af Ferrari CEO's stemme er lærerig - en leder afslørede kun svindelnummeret ved at stille et personligt spørgsmål, som bedrageren ikke kunne svare på[36]. Simulerede phishing/deepfake-øvelser kan også være nyttige. Ligesom virksomheder kører phishing-simuleringer for at træne personalet, kan de simulere en deepfake voicemail eller et falsk videomøde og se, om medarbejderne opdager det. Det opbygger muskelhukommelse til at modstå rigtige angreb. I betragtning af at Mere end 50% af virksomhederne har ingen deepfake-responsprotokoller og kun lidt træning på plads.[29]Det er en lavthængende frugt at indføre sådanne programmer for at forbedre modstandskraften.

- Svindelanalyse og opdagelse af uregelmæssigheder: Bankerne bør fortsætte med at bruge AI på den defensive side ved at forbedre deres svindelanalyser. Moderne systemer til afsløring af svindel anvender maskinlæringsmodeller, der analyserer transaktioner i realtid og markerer uregelmæssigheder eller højrisikomønstre. Disse modeller skal opdateres for at inkludere signaler, der indikerer AI-drevet svindel. For eksempel kan en ML-model trænes til at opdage metadata eller adfærdsmønstre, der er forbundet med bot-drevne kontoovertagelser (f.eks. umuligt hurtige formularudfyldningstider eller helt ensartede skrivemønstre, der tyder på et automatiseret script). Sprogmodeller kan bruges til at analysere meddelelsesindhold og markere, hvis en e-mail fra en leverandør Lyde, der er AI-genererede eller alt for formelagtige (sammen med den tidligere nævnte AI-tekstdetektering). Banker som JPMorgan er begyndt at bruge store sprogmodeller på deres interne kommunikation for at spotte sætninger eller sammenhænge, der kan indikere et forsøg på social engineering.[37]. Betalingsnetværk som Mastercard scanner store datasæt (milliarder af transaktioner) med kunstig intelligens for at identificere svigagtige transaktioner, som traditionelle regler ville overse.[38]. Det, man kan tage med sig, er, at defensiv AI skal være lige så innovativ som offensiv AI. Virksomheder bør overveje at udvikle eller købe AI-modeller specifikt til at opdage deepfake-indhold, syntetiske identiteter og generative angrebsmønstre. Det er vigtigt, at disse modeller løbende omskoles med de seneste eksempler på AI-svindel (en praksis, der kaldes online-læring eller fødereret læring), så de holder trit med de kriminelles hurtigt udviklende taktikker.[39][40].

- Samarbejde og informationsdeling: Bekæmpelse af AI-aktiveret svindel vil kræve samarbejde både inden for og på tværs af institutioner. En isoleret indsats er mindre effektiv mod en trussel, der overskrider organisatoriske grænser. Teams til forebyggelse af svindel, cybersikkerhedsteams og IT skal arbejde hånd i hånd - f.eks. kan sikkerhedsteams anvende deepfake-detektion i videokonferenceværktøjer, mens svindelteams integrerer indholdsscanninger i transaktionsovervågning. På et bredere plan bør bankerne deltage i branchegrupper som Financial Services Information Sharing and Analysis Center (FS-ISAC) for at udveksle oplysninger om nye AI-svindelplaner.[41]. Hvis en bank opdager en ny deepfake-angrebsvektor, kan deling af denne indsigt hjælpe andre med at lukke hullet, før de bliver ramt. Fælles øvelser eller "red team"-simuleringer med scenarier, der involverer AI (f.eks. et deepfake-svindelforsøg eller AI-genereret ID-verifikation), kan gennemføres gennem industrikonsortier eller med støtte fra myndighederne. Myndighederne fokuserer selv på AI-risici, så det er klogt at samarbejde proaktivt med dem. Ved at bidrage til standarder og retningslinjer for brug af AI kan bankerne være med til at skabe et mere sikkert økosystem. I sidste ende, da En trussel mod én bank er en trussel mod alle. i dette rum[42]En kollektiv forsvarstilgang vil styrke alles evne til at opdage og afskrække AI-forstærket svindel.

- Kundeuddannelse og tillidsforanstaltninger: Endelig bør finansielle institutioner ikke overse den rolle, som kundebevidsthed spiller. Med deepfakes og AI-svindel rettet mod den brede offentlighed (f.eks. falske stemmer i bedsteforældresvindel eller falske "teknisk support"-chats genereret af AI) kan bankerne hjælpe med at uddanne kunderne om disse farer. Mange banker sender allerede advarsler om phishing; de kan udvide disse til at nævne AI-stemmekloning og deepfake-videoer og give tips til, hvordan man verificerer anmodninger. Nogle progressive organisationer sender push-meddelelser eller advarsler i deres apps, hvis et kendt svindelnummer er i omløb (f.eks. "Pas på: Svindlere kan bruge stemmekloner af familiemedlemmer, der beder om penge").[43]. Selv om det ikke direkte forhindrer angreb, kan uddannelse reducere succesraten og forstærke, at banken er en sikkerhedspartner. Desuden bør banker, der investerer i banebrydende forebyggelse af svindel, fremhæve dette over for kunderne som en Differentiator - Hvis man f.eks. fortæller kunderne, at alle videoopkald eller indsendte dokumenter scannes af AI for ægthed (uden at afsløre følsomme metoder), kan det forsikre kunderne om, at banken bruger alle tilgængelige værktøjer til at beskytte dem. Bevarelse af digital tillid vil være afgørende for, at bankerne fuldt ud kan udnytte AI's fordele inden for tjenester, så gennemsigtighed og kundefokuserede sikkerhedsforanstaltninger er en del af et holistisk forsvar.

Rollen for AI-indholdsdetekteringstjenester

En hjørnesten i værktøjssættet til bekæmpelse af svindel i AI-æraen er brugen af Tjenester til detektering af AI-indhold. Disse tjenester specialiserer sig i at spotte "fingeraftryk" af AI-genereret indhold, som kan slippe forbi menneskelige korrekturlæsere. TruthScan er en af disse udbydere, der tilbyder en enterprise-grade AI Detection Suite der spænder over flere indholdstyper. Finansielle institutioner kan integrere disse værktøjer til automatisk at screene for forfalskning og svindelindikatorer:

- Verifikation af dokumenter og billeder: TruthScans platform gør det muligt for banker at Test finansielle dokumenter for AI-genereret svindel i realtid[44]. Det betyder, at når en ny konto åbnes, eller en låneansøgning ankommer med et foto-ID og en lønseddel, kan systemet øjeblikkeligt analysere disse billeder for tegn på syntetisk generering eller manipulation. Med over 99% målnøjagtighed[45]AI Image Detector kan fange falske ID-billeder eller manipulerede PDF'er, som et menneske måske ville godkende efter pålydende. Denne form for Verifikation af dokumenters ægthed er afgørende for at stoppe syntetisk identitetssvindel, før der overhovedet åbnes konti.

- Overvågning af transaktioner i realtid: Ved at implementere API-integrationer kan TruthScan koble sig på bankernes transaktionsbehandling og markere uregelmæssigheder i i realtid. Hvis der kommer en instruktion via e-mail, der virker mistænkelig, kan Email Scam Detector analysere meddelelsens indhold og opdage, om den sandsynligvis er skrevet af en AI-model, der forsøger at forfalske en leverandør eller leder.[46]. På samme måde er AI-detektor i realtid kan overvåge live-kommunikation (som chats eller samarbejdsplatforme) for at give øjeblikkelige advarsler, hvis der f.eks. opdages et bedragerisk deepfake-videofeed under et møde med høj indsats[47][48]. Kontinuerlig overvågning med øjeblikkelige advarsler og automatiserede reaktioner hjælper med at mindske det vindue, hvor svindel kan ske uden at blive opdaget.

- Forsvar mod stemme- og video-deepfake: For callcentre og kundeansvarlige kan indarbejdelsen af TruthScans AI stemme-detektor tilføjer et ekstra lag af sikkerhed. Hvis en svindler ringer ind og udgiver sig for at være en klient ved hjælp af en stemmeklon, kan systemet analysere opkaldslyden og markere, hvis den indeholder AI-syntetiserede elementer (såsom manglende naturlige mikropauser eller artefakter i lydbølgerne).[35]. På videofronten er Deepfake-detektor anvender computersynsalgoritmer på videobilleder for at fange uoverensstemmelser - som unaturlige ansigtsbevægelser, mærkelig belysning eller uoverensstemmende læbesynkronisering - der afslører en forfalskning.[49][50]. Ved at verificere integriteten af stemmer og ansigter i vigtige interaktioner kan banker afværge bedragere, der forsøger at narre deres medarbejdere. Disse værktøjer fungerer som en højteknologisk løgnedetektor for digitalt indhold og arbejder usynligt i baggrunden.

Det er værd at bemærke, at implementering af en sådan detektionsteknologi ikke er en plug-and-play-løsning; den skal kalibreres og afstemmes efter institutionens arbejdsgange. Falske positiver skal håndteres (f.eks. kan en AI-tekstdetektor markere skabelonbaseret legitim kommunikation som mistænkelig, indtil den lærer at kende forskel). Men når de er korrekt integreret, forbedrer disse værktøjer markant en organisations evne til at Spot svigagtigt indhold, før det forårsager skade. De genererer også revisionsspor og analytiske rapporter, der er nyttige for compliance og for løbende at forbedre svindelmodellerne.

Det er afgørende, at effektiviteten af AI-detektionsværktøjer afhænger af konstante opdateringer. Ligesom antivirussoftware kræver nye signaturer til nye vira, skal AI-detektorer omskoles til de nyeste deepfake-teknikker og AI-modeller. Leverandører som TruthScan opdaterer deres algoritmer til at håndtere nye generative modeller og undvigelsestaktikker og opretholder en høj nøjagtighed, selv når AI udvikler sig.[51]. Det aflaster de interne teams og sikrer, at bankerne ikke kæmper gårsdagens krig, mens de kriminelle går videre med nye AI-tricks.

Konklusion

Finanssektoren står ved en skillevej i kampen mod svindel. På den ene side tager kriminelle hurtigt generativ AI til sig for at lancere svindel, der er mere overbevisende og udbredt end nogensinde. På den anden side har banker og svindelbekæmpere et voksende arsenal af AI-drevne forsvarsmekanismer til deres rådighed. De institutioner, der vil trives, er dem, der anerkende det nye trusselsbillede og reagere med samme opfindsomhed. Det betyder, at man skal investere i avancerede detektionsfunktioner, integrere verifikationsprocesser i flere lag, uddanne både medarbejdere og kunder og fremme en kultur med årvågenhed og tilpasning.

AI-aktiveret svindel er et mål, der bevæger sig hurtigt - den deepfake-svindel, der narrede en virksomhed i dag, kan blive imødegået af nye detektionsteknikker i morgen, hvorefter svindlerne ændrer deres metoder i næste uge. Derfor er en "industristandard" strategi for forebyggelse af svindel i 2025 en, der lægger vægt på smidighed og løbende forbedringer. Finansielle organisationer bør behandle deres svindelforsvarssystemer som levende, lærende enheder der udvikler sig i takt med kriminelle taktikker. Udnyttelse af partnerskaber med teknologileverandører er en smart genvej til at opbygge disse muligheder. For eksempel kan samarbejde med specialiserede firmaer som TruthScan (som tilbyder løsninger, der er skræddersyet til bank- og finanssektoren) fremskynde en institutions evne til at forhindre AI-aktiveret svindel og samtidig overholde lovgivningen og bevare kundernes tillid[52].

I sidste ende handler beskyttelse mod AI-drevet svindel ikke kun om teknologi - det handler om at bevare den grundlæggende tillid der understøtter finansverdenen. Kunderne har brug for tillid til, at deres bank kan skelne en ægte transaktion fra en falsk, en ægte kunde fra en AI-bedrager. Ved at anvende avancerede AI-detektionsværktøjer, styrke verifikationsprotokollerne og være på forkant med nye trusler kan finansielle virksomheder opretholde denne tillid. Den kommende tid vil utvivlsomt byde på flere forsøg på svindelinnovationer fra modstandere, men med beredskab og de rette investeringer kan bankerne sikre, at AI bliver mere et aktiv end en trussel inden for forebyggelse af svindel. Det er et opnåeligt mål: De samme AI-teknologier, som truer med at forstyrre, kan udnyttes til at beskytte vores finansielle systems integritet. Nu er det tid til, at teams til forebyggelse af svindel og ledere på C-niveau handler beslutsomt, at tage avancerede løsninger og strategier i brug for at overliste svindlerne og sikre fremtiden for digital finansiering.

Kilder: Der er hele tiden henvist til nyere brancherapporter, lovgivningsmæssige advarsler og teknologiske whitepapers (Deloitte[20][18], World Economic Forum[19][24]USA's finansministerium FinCEN[3][4], Federal Reserve[13], Keepnet Labs[16][30](blandt andre) til at levere data og eksempler. Alle data og eksempler er citeret in-line for at give læserne mulighed for at udforske yderligere.

[1] [9] [10] [14] [15] [18] [20] [37] [38] [42] [43] Deepfake banking og risiko for AI-svindel | Deloitte Insights

[2] [5] [6] [19] [21] [24] [25] [27] [36] [39] [40] [41] Det er vigtigt at opdage farlig AI i deepfake-æraen | World Economic Forum

[3] [4] [26] FinCEN udsender advarsel om svindelordninger, der involverer deepfake-medier rettet mod finansielle institutioner | FinCEN.gov

[7] [8] FraudGPT og GenAI: Hvordan vil svindlere bruge AI næste gang? | Alloy

[11] Syntetisk identitetssvindel: Hvordan AI ændrer spillet - Federal Reserve Bank of Boston

[12] [13] Generativ kunstig intelligens øger truslen om syntetisk identitetssvindel

[16] [17] [22] [23] [28] [29] [30] Deepfake-statistikker og -tendenser 2025 | Nøgledata og -indsigt - Keepnet

[31] [34] [35] [46] [47] [48] TruthScan - AI-detektering og indholdssikkerhed for virksomheder

[32] [33] [51] AI-detektor: AI-tekstdetektering på virksomhedsniveau - TruthScan

[44] [45] [52] AI-svindelopsporing i bankverdenen | CRO-løsninger | TruthScan

[49] [50] Deepfake Detector - Identificer falske og AI-videoer - TruthScan