Introduktion

Generativ AI er ved at revolutionere sundhedsvæsenet - og ikke altid til det bedre. I 2025 er svindel med sundhedsydelser vokset mere digital og sofistikeret, drevet af databrud, automatisering og generativ AI[1]. Kriminelle udnytter AI-værktøjer til at skabe falske patientidentiteter, syntetiske forsikringskrav, AI-genererede medicinske dokumenter, forfalskede recepter og endda deepfaked læge-patient-interaktioner. Disse højteknologiske bedragerier tager svindlen til nye højder og truer forsikringsselskabernes økonomi og patientsikkerheden verden over. Udfordringen er enorm: Svindel i sundhedsvæsenet koster allerede titusindvis af milliarder årligt, og fremkomsten af AI er intensiverer både omfanget og kompleksiteten af svindel[2][3]. Dette whitepaper giver et detaljeret indblik i de seneste AI-drevne svindeltrends i sundhedsvæsenet, cases fra den virkelige verden fra 2025 og strategier - fra AI-indholdsdetektorer til identitetsbekræftelse - til at bekæmpe denne voksende trussel.

Fremkomsten af AI-aktiverede svindelordninger i sundhedssektoren

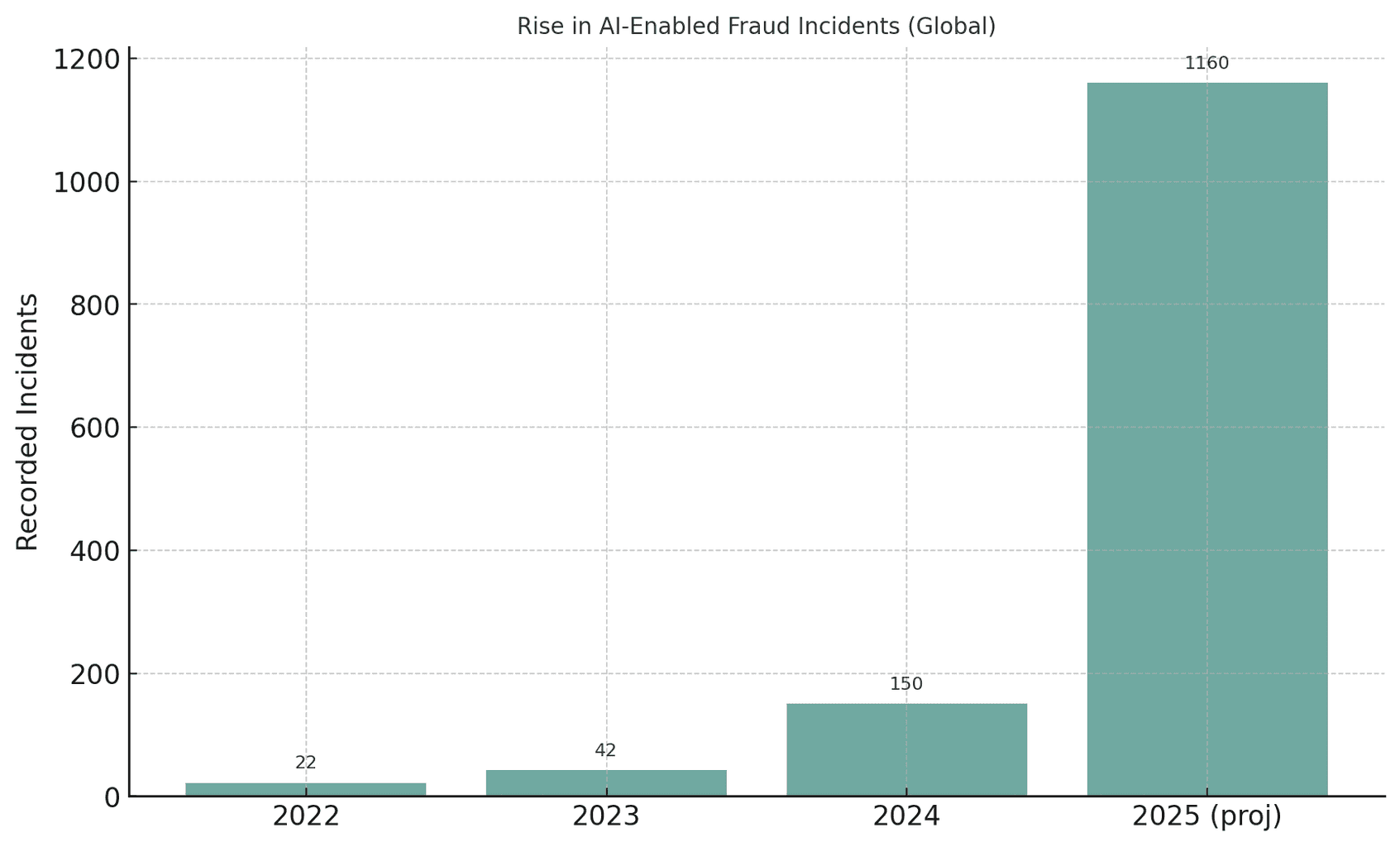

Den globale sundhedssektor oplever en hidtil uset stigning i AI-drevne svindelforsøg. Efterhånden som generativ AI bliver tilgængelig, kan svindlere automatisere det, der tidligere var manuelle svindelnumre, og producere overbevisende falske identiteter, dokumenter og endda stemmer eller videoer i stor skala. For eksempel bemærkede myndighederne, at Forsøg på svindel med deepfake-medier steg med 3.000% i 2023 alene[4][5]. Deepfake-relaterede hændelser blev næsten fordoblet fra 22 i 2022 til 42 i 2023 og eksploderede derefter til 150 hændelser i 2024; forbløffende nok var der i første kvartal af 2025 179 deepfake-svindelsager - hvilket allerede overstiger det samlede antal for 2024.[6][7]. Denne tendens tyder på en Voldsom vækst i AI-drevet svindelog analytikere forudsiger, at generativ AI kan føre til tab af svindel fra $12,3 milliarder i 2023 til $40 milliarder i 2027 (32% CAGR)[8].

Figur: Den eksplosive vækst i AI-aktiverede svindelhændelser i de seneste år. Opdagede tilfælde af deepfake eller AI-assisteret svindel er steget dramatisk fra 2022 til 2025, hvilket illustrerer, hvordan generative AI-værktøjer har forstærket forsøg på svindel.[4][7].

Du skal aldrig bekymre dig om AI-svindel igen. TruthScan Kan hjælpe dig:

- Opdag AI-generering billeder, tekst, stemme og video.

- Undgå at stor AI-drevet svindel.

- Beskyt dine mest følsom virksomhedsaktiver.

Sundhedsvæsenet er særligt sårbart over for denne AI-drevne kriminalitetsbølge. Sektorens enorme, fragmenterede økosystem - der spænder over hospitaler, klinikker, forsikringsselskaber, apoteker og telesundhedsplatforme - tilbyder tusindvis af angrebspunkter[9][10]. Traditionelle svindelnumre (f.eks. falske forsikringskort eller stjålne patient-ID'er) har udviklet sig til systemisk udnyttelse ved hjælp af AI[10][11]. I en amerikansk aktion i 2025 anklagede justitsministeriet 324 tiltalte for svindel til en samlet værdi af $14,6 milliarder kroner i falske krav - den største sag om svindel i sundhedssektoren nogensinde[12][13]. Mange svindelnumre involverede telemedicinske konsultationer og svindel med genetiske tests, og en ny DOJ... Datafusionscenter for svindel i sundhedsvæsenet brugte AI-analyser til proaktivt at opdage mønstre[14][15]. Det er klart, at AI er et tveægget sværd: Det hjælper efterforskere med at fange svindel, men også gør det muligt for kriminelle at begå bedrageri i et hidtil uset omfang og på en hidtil uset sofistikeret måde[11][2].

Almindelige AI-drevne svindelteknikker i sundhedssektoren (2025)

Svindlere i 2025 har en værktøjskasse med AI-aktiverede taktikker til at bedrage sundhedssystemer og forsikringsselskaber. De vigtigste metoder omfatter forfalskning af identiteter og dokumenter, generering af falske medicinske data og efterligning af betroet personale via deepfakes. Nedenfor gennemgår vi de mest udbredte AI-drevne svindelteknikker, og hvordan de bruges mod sundhedsorganisationer:

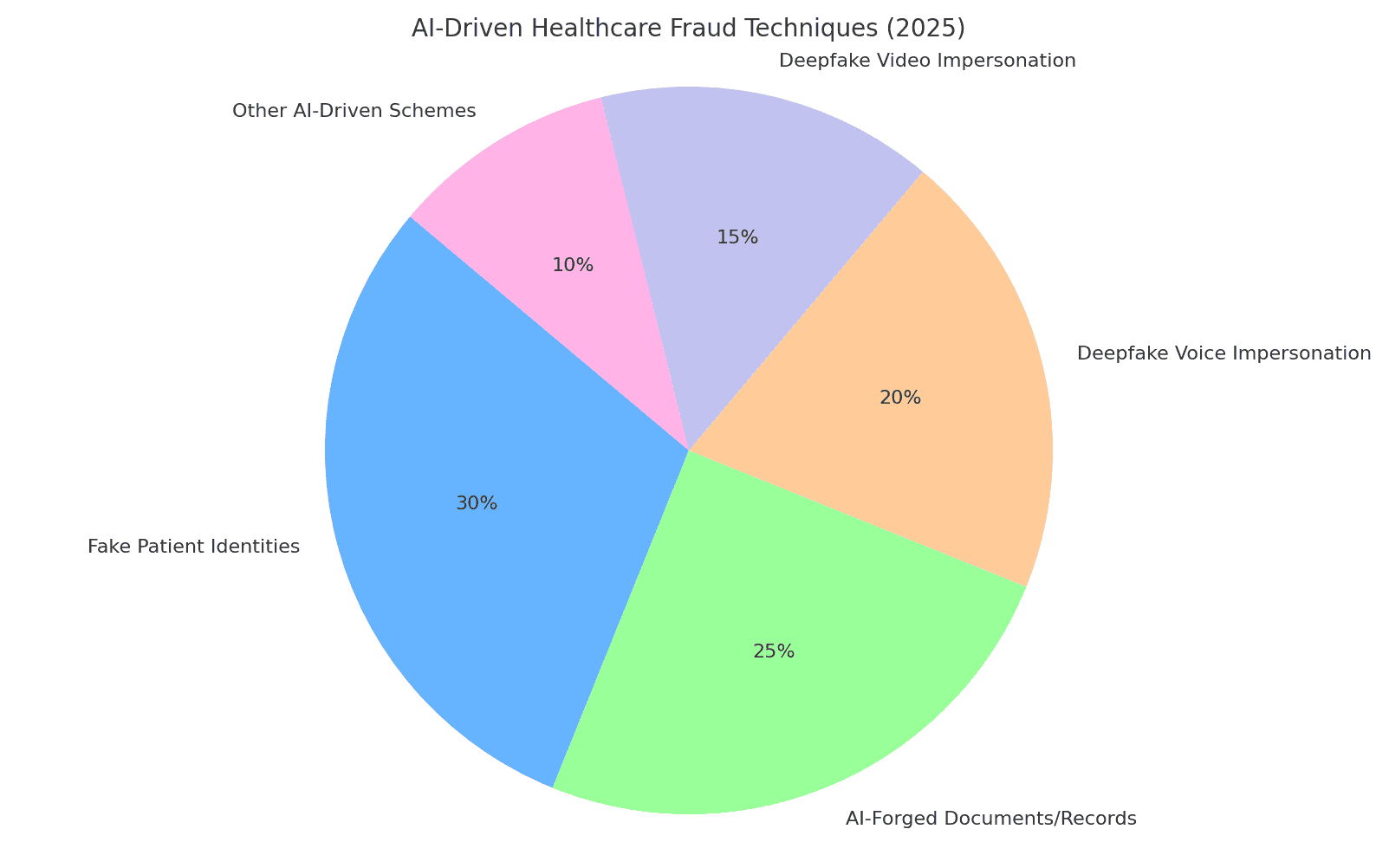

Figur: Opdeling af de vigtigste AI-drevne teknikker til svindel i sundhedssektoren i 2025. Falske patientidentiteter og AI-forfalskede dokumenter (f.eks. lægejournaler, krav) udgør en stor del af bedragerierne, mens deepfake stemme og Video-imitationer er en hurtigt voksende trussel. "Andre AI-drevne ordninger" omfatter AI-udarbejdede phishing-e-mails, bots, der angriber patientportaler, og lignende udnyttelser (anslåede procentsatser baseret på brancherapporter[8][16]).

Syntetiske patientidentiteter

Falske patientidentiteter - ofte skabt ved hjælp af AI - er en grundlæggende svindeltaktik. I stedet for at stjæle en persons identitet kombinerer kriminelle reelle data fra flere personer med opdigtede detaljer for at skabe syntetiske identiteter der går for at være nye patienter[17][18]. Generativ AI fremskynder dette ved at producere realistiske personlige optegnelser. For eksempel kan AI generere plausible ID'er, profiler, selv familiehistorier ("syntetiske forældre") for en falsk patient[19][20]. Disse fantompatienter bruges derefter til at åbne konti, tegne forsikringspolicer eller fakturere for tjenester der aldrig har fundet sted. Under COVID-19-pandemien brugte svindlere syntetiske ID'er til at få adgang til akutte sundhedsydelser; nu bruger de dem til at indgive falske forsikringskrav eller få recepter, vel vidende at en velkonstrueret identitet kan undgå at blive opdaget[21][22]. Ifølge den amerikanske centralbank toppede tabene fra syntetisk identitetssvindel $35 milliarder i 2023 og fortsætter med at stige[23]. Konsekvenserne for sundhedsvæsenet er alvorlige: Svindlere kan bruge et barns stjålne CPR-nummer til at opbygge en falsk patient med perfekt kreditværdighed eller blande stjålne patientdata for at omgå forsikringsselskabets verifikation.[17][24]. Hver syntetisk patient, der introduceres i systemet underminerer dataintegriteten og kan føre til uretmæssige udbetalinger eller endda kliniske fejl, hvis den falske identitet bliver sammenflettet med rigtige lægejournaler.

AI-genererede medicinske dokumenter og forsikringskrav

Generativ AI bruges nu til at skabe medicinske dokumenter, journaler og hele forsikringskrav. Sprogmodeller kan producere autentisk udseende lægeerklæringer, epikriser, laboratorieresultater eller fakturaer fyldt med medicinsk jargon - alt sammen skræddersyet til at understøtte et svigagtigt krav. Faktisk rapporterer brancheobservatører om en 89% stigning i AI-genererede medicinske dokumenter der indsendes, sammenlignet med tidligere år[25][26]. Svindlere udnytter disse falske journaler til at retfærdiggøre dyre procedurer eller medicin, der aldrig blev givet, eller til at oppuste refusionskoder. For eksempel kunne en AI generere en falsk Billeddiagnostisk rapport eller laboratorieresultat for at underbygge et krav om høje omkostninger til kræftmedicin. Forsikringsselskaber og sundhedssystemer står over for en oversvømmelse af sådanne syntetisk papirarbejdeDet gør det sværere at skelne mellem legitime krav og forfalskninger. I Storbritannien bemærker forsikringsselskaberne en hastigt stigende brug af deepfakes og forfalskede dokumenter i erstatningssvindel, ofte i tilsyneladende rutinemæssige krav af lav værdi for at undgå kontrol[27]. Selv kliniske billeder er ikke immune - der er tegn på, at Svindlere bruger generativ AI til at efterligne medicinske billeder som røntgenbilleder eller scanninger[3]. Konsekvenserne går ud over det økonomiske tab: Hvis forfalskede lægejournaler kommer ind i patientjournaler, kan de føre til fejldiagnoser eller forkert behandling. Sådan er det, AI-skrevne sundhedsdokumenter udgør en alvorlig integritets- og sikkerhedsrisiko.

Forfalskede recepter og apotekssvindel

Receptsvindel er trådt ind i den digitale tidsalder med AI. Forfalskede recepter - der traditionelt blev lavet med stjålne receptblokke eller rudimentær redigering - kan nu genereres automatisk med realistiske detaljer og lægesignaturer. AI-billedgeneratorer eller skabeloner gør det trivielt at skabe autentisk udseende e-receptudskrifter eller apotekernes bestillingssedler. Mere snigende er det, at kriminelle bruger Kloning af stemme til at udgive sig for at være læger i samtaler med apotekere. I en rapporteret tendens hackede svindlere sig ind i lægejournaler for at stjæle lægers DEA-registreringsnumre og brugte derefter disse legitimationsoplysninger til at sende elektroniske recepter på kontrollerede stoffer.[28]. Der har været tilfælde af AI-stemmeforfalskninger bruges til at godkende genopfyldninger - en apoteker modtager et opkald, der lyder præcis som en kendt læge, der bekræfter en recept, men det er faktisk en AI-genereret stemme. Resultatet er, at kontrollerede lægemidler (som opioider eller stimulanser) kan fås ulovligt og omdirigeres. Svindel med falske recepter medfører ikke kun økonomiske tab for forsikringsselskaber og apoteker; det er også til fare for patienterne, som kan få forkert medicin i deres journaler. Hvis en svindler f.eks. udgiver sig for at være en patient for at få opioidrecepter, kan En ægte patients journal kan blive opdateret med medicin, de aldrig har taget, hvilket fører til farlige interaktioner eller markerer dem som medicinsøgende.[29]. Denne blanding af cyberkriminalitet og AI-udnyttelse har ført til advarsler fra myndighederne. Sundhedsorganisationer skal nu kontrollere, at alle recepter - især højrisikomedicin - er legitime og virkelig kommer fra den autoriserede udbyderDet er ikke en deepfake eller et databrud.

Deepfake læge-patient-imitationer

Den måske mest opsigtsvækkende udvikling er brugen af deepfakes for at udgive sig for at være sundhedspersonale eller patienter. Inden for telemedicin og kundeservice bruger svindlere AI-genereret video og lyd til at narre folk i den anden ende. For eksempel har kriminelle skabt deepfake-videoer af patienter for telesundhedskonsultationer, der narrer læger til at give "behandling" eller henvisninger, som derefter faktureres til forsikringen[30][31]. Omvendt kan en svindler deepfake en læges udseende - ved at bruge en velrenommeret læges ansigt og stemme - i et videoopkald for at overbevise en patient om at betale for en bedragerisk tjeneste eller udlevere personlige oplysninger. Sundheds-it-eksperter advarer om, at Telesundhed er blevet et modent mål: man kan planlægge en virtuel aftale ved hjælp af en falsk patientidentitet og derefter få en AI-avatar til at stå i videoen for at få recepter eller medicinsk rådgivning under falske forudsætninger[31][32]. Ud over telemedicin er deepfakes ved at mætte de sociale medier i form af "Læge"-videoer, der promoverer mirakelkure. I 2024 observerede eksperter, at deepfaked videoer af berømte læger "tog virkelig fart," rettet mod ældre målgrupper med falske sundhedstips og fup-produkter[33][34]. Betroede tv-læger i Storbritannien og Frankrig fik klonet deres portrætter for at reklamere for falske diabeteskure og blodtrykstilskud.[35][36]. Op til halvdelen af seerne kunne ikke se, at disse deepfake-medicinske videoer var falske[37]. Denne erosion af sandheden har håndgribelige omkostninger: Patienter kan følge skadelige råd fra en falsk lægevideo, eller svindlere kan fakturere forsikringsselskaber for konsultationer, der aldrig har fundet sted, undtagen som en deepfake-optagelse. Alt i alt, AI-drevet efterligning underminerer den grundlæggende tillid til interaktioner i sundhedsvæsenet - Hvis man ikke kan stole på, at personen på skærmen eller i telefonen er den, de udgiver sig for at være, er hele systemet i fare.

Virkning og omfang: 2025-svindel i tal

AI-drevet svindel er ikke længere et marginalt problem - det er nu en stor økonomisk belastning og sikkerhedstrussel på tværs af globale sundhedssystemer. Overvej følgende nylige statistikker og sager, der illustrerer Problemets omfang:

- Årlige tab: Svindel i sundhedsvæsenet koster USA anslået $68 milliarder eller mere hvert år[25], cirka 3-10% af alle sundhedsudgifter[38]. På verdensplan kan svindel forbruge omkring 6% af sundhedsudgifterne[39] - et svimlende tal i betragtning af, at sundhedsudgifterne på verdensplan løber op i billioner af dollars. Disse tab betyder i sidste ende højere præmier, øgede hospitalsomkostninger og færre ressourcer til patientbehandling.

- Stigning i svindel i 2023-2025: Fremkomsten af generativ AI har ført til en eksplosion af forsøg på svindel. Deepfake-relaterede svindelhændelser steg tidoblet fra 2022 til 2023[4]. I 2024 steg antallet af rapporterede deepfake-hændelser til 150 (en stigning på 257%).[40]og 2025 er på vej til langt at overgå det (580 hændelser i bare første halvdel af 2025, næsten 4× det samlede antal for 2024).[7]. Svindeleksperter bemærker, at 46% har oplevet syntetisk ID-svindel, 37% stemme-deepfakes og 29% video-deepfakes i deres undersøgelser[8] - hvilket understreger, hvor almindelige disse AI-teknikker er blevet.

- Rekordstore nedtagninger: Håndhævelsesorganer reagerer med større indgreb. I juni 2025 annoncerede det amerikanske justitsministerium Historiens største opklaring af sundhedssvindel, sigtelse af 324 personer og afsløring af $14,6 milliarder kroner i svigagtige krav[1][13]. Ordningerne omfattede svindel med telemedicinsk rådgivning, svindel med genetiske tests og svindel med varigt medicinsk udstyr i stor skala.[13]. Som en del af denne indsats har Medicare suspenderet $4 milliarder i ventende udbetalinger anses for mistænkelig[41]og forhindre disse tab. En hjørnestenssag ("Operation Gold Rush") afslørede en international ring, der brugte stjålne identiteter til at indgive $10,6 milliarder i falske krav for medicinske forsyninger[42] - et bevis på, hvor langt kriminelle vil gå, når de er bevæbnet med brudte data og automatisering.

- Konsekvenser for forsikringsselskaberne: Forsikringsselskaber over hele verden ser en Stigning i AI-relateret svindel. I Storbritannien rapporterer forsikringsselskaber, at deepfakes i stigende grad bruges i erstatningssager (ofte "low touch"-skadesager for at undgå at blive opdaget).[27]. Et førende genforsikringsselskab advarer om, at forfalskede lægejournaler og falske helbredstilstande underminerer tegningen af forsikringer og kan øge tabene på livs- og sundhedsforsikringer.[43]. En Deloitte-analyse fra 2024 anslår, at det vil ske i 2027, generativ AI-aktiveret svindel kan stå for $40 milliarder i årlige tab i USA. (op fra $12,3 milliarder i 2023)[8]. Denne udvikling indebærer et betydeligt slag mod forsikringsselskabernes bundlinjer, hvis der ikke træffes robuste modforanstaltninger.

- Patientofre: Patienter og offentligheden mister også penge på grund af disse svindelnumre. Især ældre voksne er blevet ramt af AI-stemmesvindel ("barnebarn i nød"-opkald) og deepfake-sundhedssvindel. I 2023 rapporterede amerikanske seniorer om $3,4 milliarder kroner i tab som følge af svindel, en stigning på 11% fra året før[44][45] - Noget af dette er drevet af AI-forbedrede ordninger. Og ud over de økonomiske omkostninger er der en menneskelige omkostninger: svigagtig medicinsk rådgivning og falske behandlinger, der annonceres via AI, kan føre til fysisk skade eller mistet tillid til legitim sundhedsvejledning.

Overordnet set har 2025 gjort det klart, at AI sætter turbo på traditionel sundhedssvindel. Det, der tidligere var mindre, opportunistiske planer, er blevet til industrialiserede operationer, der spænder over kontinenter. Kombinationen af big data (ofte fra sikkerhedsbrud) og AI-generering betyder, at svindelnumre kan implementeres med skræmmende hastighed og troværdighed. De globale tab er på et tocifret milliardbeløb og stigendeog alle interessenter - fra hospitaler og forsikringsselskaber til patienter - er i fare. I næste afsnit diskuteres det, hvordan branchen kan slå igen ved hjælp af lige så avancerede teknologier og strategier.

Forsvar mod AI-drevet svindel: Strategier og løsninger

At konfrontere AI-aktiveret svindel i sundhedsvæsenet kræver et arsenal af lige så avancerede forsvar. Ledere i sundhedssektoren, cybersikkerhedsteams, compliance-ansvarlige og forsikringsselskaber skal koordinere for at indarbejde foranstaltninger til bekæmpelse af svindel på alle sårbare steder - fra patientens onboarding til udbetaling af erstatninger. Her er de vigtigste strategier og tekniske løsninger til at imødegå AI-drevet svindel:

- Værktøjer til registrering af AI-indhold: Ligesom kriminelle bruger AI til at fabrikere indhold, kan organisationer bruge AI til at opdage det. Avanceret AI-skrevne indholdsdetektorer (som f.eks. TruthScans suite) analyserer tekst, billeder, lyd og video for at identificere tydelige tegn på AI-generering. For eksempel anvender TruthScans platform maskinlæring til at spotte de statistiske mønstre og sproglige særheder, der indikerer AI-genereret tekst med over 99% nøjagtighed[46][47]. Disse værktøjer kan integreres i skadebehandlingssystemer eller elektroniske patientjournaler for automatisk at markere mistænkelige dokumenter - f.eks. en medicinsk rapport, der sandsynligvis er skrevet af ChatGPT - til manuel gennemgang. På samme måde kan AI-billedteknik opdage manipulerede medicinske scanninger eller falske ID'er, og deepfake-detektionsalgoritmer kan analysere videoer for tegn på syntese (artefakter i pixels, mærkelig timing af ansigtsbevægelser osv.)[48][49]. Ved at anvende multimodale AI-detektorer kan sundhedsorganisationer frasorterer en stor del af det AI-forfalskede indhold i realtid før det forårsager skade.

- Verifikation af journaler og dokumenter: Sundhedsudbydere henvender sig til specialiserede løsninger for at verificere ægtheden af optegnelser og skadedokumenter. Dette omfatter hashing og digital signering af legitime optegnelser samt brug af databaser med kendte, gode dokumentskabeloner til at sammenligne med indsendte dokumenter. AI-drevne verifikationstjenester (f.eks. TruthScans Autentificering af medicinske dokumenter løsning) kan øjeblikkeligt analysere et dokuments indhold og metadata for at afgøre, om det er maskingenereret eller ændret.[50][51]. De ser på uoverensstemmelser, som et menneske måske ville overse - såsom subtile formateringsanomalier eller metadata, der indikerer, at et billede er AI-produceret. Realtidsovervågning af patientjournaler og forsikringskrav for uregelmæssigheder er også vigtigt[52]. Ved løbende at scanne nye indtastninger (laboratoriesvar, lægenotater, vedhæftede filer) kan disse systemer fange falske optegnelser. før de fører til svigagtige udbetalinger eller kliniske fejl. Nogle forsikringsselskaber har implementeret regler, hvor enhver dokumentation for krav, der identificeres som AI-genereret, automatisk inddrages til efterforskning af svindel. Målet er at sikre, at alle journaler eller krav, der kommer ind i workflowet, er troværdige og uændrede.

- Identitetssikring og -validering: Det er afgørende at styrke identitetsbekræftelsen i en tid med syntetiske ID'er. Sundhedsenheder bør håndhæve streng identitetskontrol af nye patienter, udbydere og leverandører. Dette kan involvere multifaktorautentificering, biometriske kontroller (som ansigtsgenkendelse eller fingeraftryk ved registrering) og brug af identitetsbekræftelsestjenester, der udnytter AI til at opdage falske ID'er eller uoverensstemmende personlige data. For eksempel kan ansigtsgenkendelse kombineres med livstest for at forhindre, at et AI-genereret ansigt udgiver sig for at være en rigtig patient via et foto. I den anden ende kan algoritmer krydsverificere en patients oplysninger (adresse, telefon, e-mail, tilstedeværelse på sociale medier) for at få øje på "tynde" identiteter, der mangler en normal historie - et kendt kendetegn for syntetiske ID'er.[53]. Finansielle institutioner har brugt sådanne AI-drevne baggrundstjek med stor effekt[54]og sundhedsvæsenet kan gøre det samme: F.eks. markere en ny Medicare-ansøger, hvis vedkommende ikke har noget digitalt fodaftryk fra før i år. Validering af udbyderidentiteter er lige så vigtig - at sikre, at lægen på en telehealth-video har licens og faktisk er den, de påstår, måske ved at udstede digitale certifikater eller vandmærkede videofeeds, der er svære for deepfakes at efterligne. På apoteker bør personalet dobbelttjekke usædvanlige receptanmodninger via direkte tilbagekald til udbydere og bruge kodesætninger eller verifikationsspørgsmål til at besejre potentielle AI-stemmebedragere.

- Integreret afsløring af svindel i workflows: For virkelig at beskytte systemet kan afsløring af svindel ikke være et selvstændigt skridt - det skal være vævet ind i alle arbejdsgange i en sundhedsorganisation.

I praksis betyder det, at hospitaler og forsikringsselskaber bruger API-integrationer til at tilkalde tjenester til afsløring af svindel på kritiske tidspunkter. Når en udbyder f.eks. indsender et krav med vedhæftede dokumenter, kan en AI-tjeneste automatisk evaluere disse vedhæftede filer for ægthed på få sekunder. Hvis der indledes en telehealth-aftale, kan platformen køre passiv stemmeanalyse i baggrunden for at sikre, at den, der ringer op, ikke bruger en syntetisk stemme. Kontinuerlig overvågning er også nøglen: Moderne svindelplatforme tilbyder dashboards, der sporer svindelsignaler på tværs af organisationen (mislykkede valideringer, hyppig markering af en bestemt kliniks krav osv.) for at identificere mønstre, såsom en organiseret svindelring, der opererer på tværs af flere krav. Ved at behandle svindel i sundhedssektoren mere som cybertrusler - med 24/7 overvågning, detektering af anomalier og hurtig reaktion på hændelser - organisationer kan fange problemer, før de udvikler sig til en spiral[55].

- AI til svindelanalyse og mønstergenkendelse: Mængden af sundhedsdata er så stor, at kunstig intelligens er uundværlig til at finde svindelmønstre, som mennesker overser. Maskinlæringsmodeller kan trænes på historiske svindelsager for at opdage nye (f.eks. ved at gruppere krav, der har lignende usædvanlige ICD-koder, eller identificere, når en læges fakturering afviger meget fra kollegernes). Forsikringsselskaber bruger allerede prædiktive analyser til at score krav for risiko for svindel i realtid. Nye teknikker som grafneurale netværk kan kortlægge relationer mellem patienter, udbydere, diagnoser og krav for at spotte usandsynlige forbindelser (som f.eks. det samme enheds serienummer, der bruges i krav fra forskellige stater). TruthScans pakke til forsikringssvindel omfatter f.eks. Genkendelse af skadesmønstre og prædiktiv modellering for at fange organiserede svindelringe og atypiske mønstre, før tabene akkumuleres[56][57]. DOJ Fusion Center 2025 var et eksempel på denne tilgang, hvor man samlede data på tværs af Medicare og private forsikringsselskaber for proaktivt at finde klynger af mistænkelig aktivitet.[58]. Sundhedsorganisationer bør ligeledes Del data og AI-modeller i konsortier for at udvide de svindelsignaler, de hver især kan opdage. Jo flere data (inden for privatlivets grænser), der fodrer disse modeller, jo bedre bliver de til at skelne mellem normal og svigagtig adfærd.

- Uddannelse af personale og proceskontrol: Teknologi er afgørende, men menneskelig bevidsthed er stadig et stærkt forsvar. Sundhedspersonale og administratorer bør uddannes i AI-aktiverede svindeltaktikker - for eksempel at vide, at en perfekt skrevet e-mail fra en CEO kan være AI-forfattet phishingeller at de skulle verificere videoopkalds identitet hvis noget virker "forkert" (mærkelige øjenbevægelser eller lydforsinkelse kan tyde på en deepfake). Regelmæssige øvelser og tips (i stil med træning i phishing) kan implementeres i forbindelse med nye trusler som deepfake-telefonsvindel. Simple proceskontroller tilføjer lag af sikkerhed: at kræve tilbagekald eller sekundær verifikation for store eller usædvanlige betalingsanmodninger, at bruge kendte, sikre kommunikationskanaler til følsomme oplysninger og at opretholde en beredskabsplan specifikt for mistanke om AI-medieret svindel. Det er vigtigt, at organisationer dyrker en kultur, hvor medarbejderne føler sig bemyndiget til at sætte spørgsmålstegn ved uregelmæssighederselv hvis det er en "læge" på video, der beder om en mærkelig anmodning. Mange deepfake-svindelforsøg lykkes ved at udnytte tillid og autoritet; en årvågen arbejdsstyrke, der kender til disse tricks, kan stoppe hændelser tidligt. Som en ekspert bemærkede, kan det at konfrontere deepfakes blive lige så rutinemæssigt som at spotte phishing-e-mails - en standarddel af cybersikkerhedshygiejnen.[32][59].

- Udnyttelse af specialiserede tjenester: På grund af den hurtige udvikling af AI-trusler samarbejder mange sundhedsorganisationer med specialiserede udbydere af svindelforebyggelse. Tjenester som TruthScan til sundhedssektoren tilbyder end-to-end-løsninger, der er skræddersyet til medicinsk brug, herunder: realtidsovervågning af integriteten af elektroniske patientjournaler (EMR), Verifikation af patientdokumenter mod AI-manipulation, deepfake-detektion til telesundhed og compliancerapportering (f.eks. revisionsspor, der beviser rettidig omhu i svindelopdagelse for tilsynsmyndigheder)[60][51]. Sådanne platforme giver ofte API-integration passer problemfrit ind i eksisterende systemer og er bygget til at opfylde sundhedsregulativer (HIPAA, GDPR)[61][62]. Ved at bruge værktøjer i virksomhedsklassen kan selv mindre klinikker eller regionale forsikringsselskaber få adgang til avancerede AI-detekteringsfunktioner uden at udvikle dem internt. Derudover bør forsikringsselskaber og udbydere holde øje med opdateringer af regler og branchestandarder - for eksempel nye love mod deepfake-svindel (nogle jurisdiktioner forbyder nu eksplicit medicinske deepfakes, og USA udvider vedtægterne for identitetstyveri til at dække AI-imitation[63]). Ved at tilpasse sig sådanne standarder og anvende de nyeste værktøjer vil man ikke kun reducere tab ved svindel, men også demonstrere en stærk sikkerhedsposition over for partnere, revisorer og patienter.

Konklusion og fremtidsudsigter

År 2025 har vist, at den Ånden er ude af flasken - generativ AI og automatisering er nu flettet sammen med svindel i sundhedsvæsenet. Fremover vil svindlerne sandsynligvis fortsætte med at innovere: Vi vil måske se AI-modeller, der lærer at efterligne specifikke lægers skrivestil, eller deepfakes, der reagerer i realtid på udfordrende spørgsmål. Kampen vil være et løbende våbenkapløb. Men sundhedssektoren reagerer med samme styrke og investerer i AI-drevne forsvar og strammere sikkerhedsworkflows. Ved at kombinere avanceret detektionsteknologi, strenge verifikationsprocesser, datadeling på tværs af brancher og medarbejdernes årvågenhedkan sundhedsorganisationer i høj grad afbøde den AI-faciliterede svindeltrussel.

Det er ikke kun et IT-problem - det er et spørgsmål om ledelse og tillid. Bestyrelser og ledere i sundhedssektoren skal anerkende AI-svindel som en strategisk risiko for økonomien og patienternes tillid, hvilket kræver regelmæssig opmærksomhed og ressourcer. Compliance-teams bør opdatere risikovurderinger for svindel, så de omfatter AI-aspekter, og forsikringsselskaberne bør måske genoverveje deres forsikringsantagelser, når de ved, at en vis procentdel af kravene kan være AI-assisteret svindel. På den anden side vil etisk udnyttelse af AI i sundhedsvæsenet (til klinisk beslutningsstøtte, faktureringseffektivitet osv.) fortsat give store fordele - så længe der er stærke sikkerhedsforanstaltninger på plads for at forhindre misbrug.

For at opsummere, Generativ AI har ændret svindelspillet i sundhedsvæsenet, men med bevidsthed og avancerede modforanstaltninger behøver det ikke at overvælde systemet. De organisationer, der får succes, er dem, der holder sig orienteret om nye trusler, tilpasser sig hurtigt med AI-drevne forsvar og fremmer en kultur med "verificering og tillid" i stedet for "tillid som standard". På den måde kan sundhedsvæsenet sikkert udnytte AI's positive sider og samtidig neutralisere misbrug og beskytte både bundlinjen og patienternes velbefindende i den digitale tidsalder.

Kilder: Nylige brancherapporter og sager som nævnt ovenfor, herunder Pymnts (juli 2025)[2][3], Swiss Re Institute (juni 2025)[27], Federal Reserve Bank of Boston (april 2025)[19], BMJ (2024)[37]og TruthScan løsningsbeskrivelser (2025)[51][64]blandt andre. Alle data og citater afspejler de senest tilgængelige i 2024-2025, hvilket illustrerer den aktuelle tilstand af AI-drevet svindel i sundhedsvæsenet og reaktionerne på at bekæmpe det.

[1] [2] [3] [9] [10] [11] [12] [13] [14] [15] [41] [42] [55] [58] Justitsministeriet anerkender AI-værktøjer i historisk opgør med sundhedssvindel

[4] [5] [6] [7] [16] [40] [44] [45] Deepfake-statistikker og -tendenser 2025 | Nøgledata og -indsigt - Keepnet

https://keepnetlabs.com/blog/deepfake-statistics-and-trends

[8] Deepfakes og erkendelsens krise | UNESCO

https://www.unesco.org/en/articles/deepfakes-and-crisis-knowing

[17] [18] [19] [20] [21] [22] [23] [24] [53] [54] Gen AI øger truslen om syntetisk identitetssvindel - Federal Reserve Bank of Boston

[25] [26] [56] [57] [62] [64] Opdagelse af AI-svindel inden for sundheds- og livsforsikring | TruthScan

https://truthscan.com/solutions/health-life-commercial-insurance-fraud-detection-solution

[27] [43] Hvordan deepfakes, disinformation og AI forstærker forsikringssvindel | Swiss Re

[28] DEA advarer mod elektronisk receptsvindel - Pharmacy Practice News

[29] [39] Cybersikkerhed og svindel i sundhedsvæsenet: Et dybt dyk ned i nutidens største risici og forsvar | CrossClassify

https://www.crossclassify.com/resources/articles/healthcare-cybersecurity-and-fraud/

[30] [31] [32] [59] Den voksende trussel fra deepfake-svindel med telemedicin, Mike Ruggio

https://insights.taylorduma.com/post/102jkzn/the-evolving-threat-of-deepfake-telemedicine-scams

[33] [34] Eksperter advarer om svindlere, der bruger 'deepfakes' af berømte læger på sociale medier

[35] [36] [37] Betroede tv-læger "deepfaked" for at promovere sundhedssvindel på sociale medier - BMJ Group

https://bmjgroup.com/trusted-tv-doctors-deepfaked-to-promote-health-scams-on-social-media/

[38] [PDF] nuværende forskningstilstand Ajit Appari og M. Eric Johnson

http://mba.tuck.dartmouth.edu/digital/Research/ResearchProjects/AJIJIEM.pdf

[46] [47] [48] [49] TruthScan - AI-detektering og indholdssikkerhed for virksomheder

[50] [51] [52] [60] [61] AI-opdagelse af svindel med lægejournaler | CRO-løsninger til sundhedssektoren | TruthScan

https://truthscan.com/solutions/healthcare-cro-fraud-detection

[63] Hvor farlige er deepfakes og andre AI-drevne svindelnumre?