En omfattende guide til at forstå, opdage og forhindre AI-stemmesvindel i virksomheden

Stemmeopkaldet til $25 millioner, der aldrig fandt sted

I februar 2024 modtog en økonomimedarbejder i en multinational virksomhed i Hong Kong et videoopkald fra sin økonomidirektør.

Stemmen i den anden ende var umiskendelig; hvert tonefald, hver pause og selv den lille accent blev genkendt med det samme.

Han bad hende indtrængende om at behandle 15 bankoverførsler på i alt $25 millioner for at afslutte et fortroligt opkøb.

Du skal aldrig bekymre dig om AI-svindel igen. TruthScan Kan hjælpe dig:

- Opdag AI-generering billeder, tekst, stemme og video.

- Undgå at stor AI-drevet svindel.

- Beskyt dine mest følsom virksomhedsaktiver.

CFO'en foretog aldrig det opkald. Det var fuldstændig AI-genereret.

Dette var ikke et enkeltstående tilfælde. Finansielle institutioner oplever en kraftig stigning i deepfake-svindel.

I løbet af de sidste tre år er antallet af sager steget med 2.137%, og AI driver nu 42,5% af alle forsøg på svindel i sektoren.

Selv med stigningen i AI-stemmesvindel indrømmer mere end halvdelen af virksomhedslederne, at deres medarbejdere ikke er blevet uddannet til at spotte eller reagere på deepfake-angreb; næsten 80% af virksomhederne har ingen formelle protokoller på plads til at håndtere disse hændelser.

Hvordan AI-stemmekloning fungerer, og hvorfor det er en trussel

Moderne AI-stemmesyntese har brug for overraskende lidt data. Bare et par sekunders lyd kan klone en stemme med op til 85% nøjagtighed.

Processen består af tre hovedtrin:

- Indsamling af data: Svindlere indsamler stemmeprøver fra offentlige kilder som f.eks. konferenceopkald, podcast-interviews, klip fra sociale medier eller endda LinkedIn-videoindlæg.

- Modeluddannelse: AI analyserer stemmeegenskaber som tonehøjde, tonefald, accent, tempo og vejrtrækningsmønstre.

- Generation: Systemet skaber syntetisk tale, der er overbevisende nok til at narre selv nære kolleger.

Problemet med tilgængelighed

Det, der gør denne trussel endnu farligere, er dens demokratisering. Svindlere har ikke længere brug for ressourcer på Hollywood-niveau.

Alt, hvad der kræves, er en tilgængelig software til at klone en stemme fra et kort klip på de sociale medier; open source-værktøjer og skybaserede AI-tjenester har gjort stemmekloning tilgængelig for alle med grundlæggende tekniske færdigheder.

Hvorfor ledere er topmål for svindel

Ledere står over for en farlig blanding af risikofaktorer.

Deres offentlige eksponering gennem sociale medier gør det nemt at finde stemmeprøver, og deres autoritet får ofte medarbejderne til at handle hurtigt på presserende anmodninger.

I gennemsnit har en ud af fire ledere en begrænset forståelse af deepfake-teknologi.

Aktuelle statistikker tegner et bekymrende billede

I en 2024 Deloitte-undersøgelse25,9% af lederne sagde, at deres organisationer havde været udsat for mindst én deepfake-hændelse rettet mod finans- eller regnskabsdata i det forgangne år, og halvdelen af alle respondenter mente, at sådanne angreb ville vokse i løbet af de næste 12 måneder.

Mest bekymrende: Kun 52% af organisationerne føler sig sikre på, at de kan spotte en deepfake af deres CEO.

Sådan spotter du AI Voice-svindel

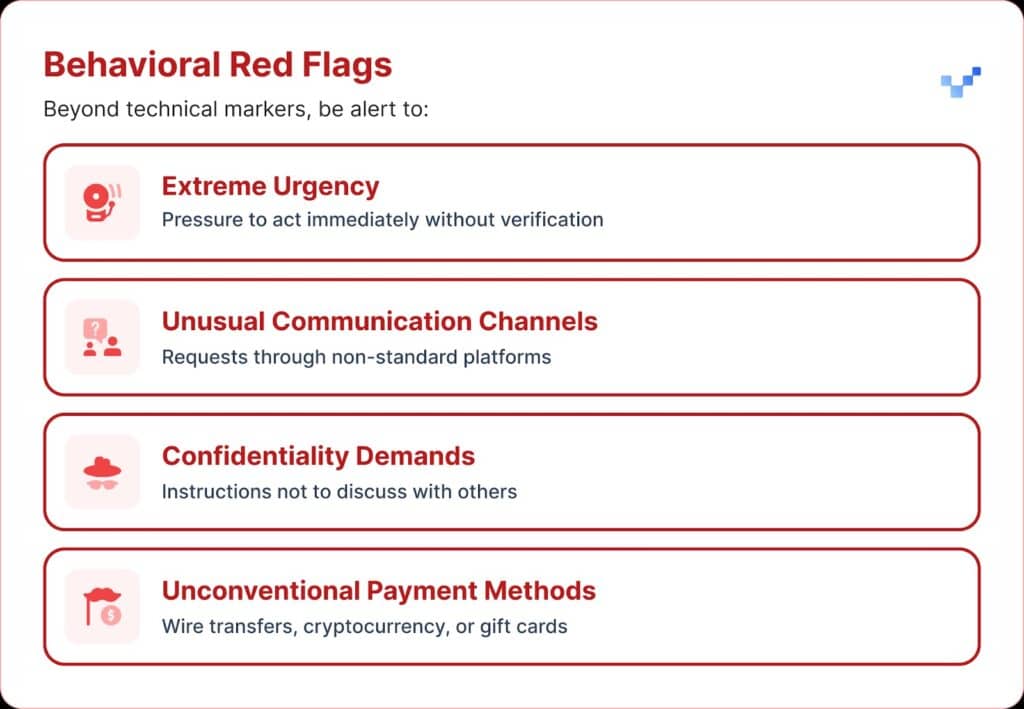

Når du modtager en mistænkelig stemmemeddelelse, er der et par advarselstegn, du skal være opmærksom på.

Svindel med AI-stemmer lyder ofte monotont eller fladt. Du vil måske også bemærke et usædvanligt tempo med mærkelige pauser eller en unaturlig rytme.

Lyden kan også indeholde svag elektronisk summen eller ekko, især under længere opkald.

Og i mange tilfælde gentager stemmen begrænsede sætninger, som virker indstuderede.

Økonomiske konsekvenser og hvad det virkelig koster

De fleste organisationer mistede i gennemsnit omkring $450.000, men i finanssektoren steg tabene til over $603.000.

Og i de mest alvorlige tilfælde rapporterede 1 ud af 10 organisationer om tab på mere end $1 million.

Denne tendens er vokset hurtigt. Tidligere forskning fra 2022 viste, at den gennemsnitlige økonomiske byrde ved identitetssvindel var omkring $230.000, næsten halvdelen af det nuværende tal.

Forventede fremtidige tab

Ifølge Deloittes Center for Financial Services kan tabet af penge på grund af AI-svindel i USA stige fra $12,3 milliarder i 2023 til $40 milliarder i 2027. Det er en vækst på omkring 32% hvert år.

Regional sårbarhed

Nordamerika oplevede en stigning på 1740% i deepfake-svindel.

Denne betydelige regionale stigning tyder på, at Nordamerika kan være et primært mål for deepfake-svindlere, sandsynligvis på grund af landets store digitale økonomi og udbredte brug af onlinetjenester.

Strategiske tilgange til beskyttelse af ledere

1. Implementer verifikationsprotokoller

En måde at styrke forsvaret på er ved at bruge et "safe word"-system, hvor man på forhånd har aftalt autentificeringsfraser, som deles med nøglepersoner.

En svindler, der bruger AI-stemmekloning, kender ikke de rigtige svar på spørgsmål om personlig bekræftelse.

En anden sikkerhedsforanstaltning er verifikation via flere kanaler.

Enhver usædvanlig økonomisk anmodning skal bekræftes via en separat kommunikationskanal, og man må aldrig kun forlade sig på den oprindelige kontaktmetode.

Virksomheder bør også opstille klare regler for eskalering med ventetider og godkendelsestrin for store finansielle transaktioner, uanset hvem der anmoder om dem.

2. Vær opmærksom på digital eksponering

Et andet lag af beskyttelse består i at begrænse, hvor meget lyd og video fra ledelsen, der er tilgængelig online. Jo flere eksempler svindlerne kan indsamle, jo mere overbevisende bliver deres kloner.

Det hjælper også at opstille klare retningslinjer for ledere på de sociale medier, især omkring udstationering af videoer med ren lyd.

Og når det gælder konferencer, bør organisationer være opmærksomme på indspillede foredrag eller interviews, der giver lange strækninger med stemmeprøver.

3. Implementer tekniske løsninger

Det er her, avanceret AI-detektionsteknologi bliver afgørende.

Organisationer har brug for stemmegodkendelse i virksomhedsklasse og deepfake-detektion kapaciteter, der giver:

- Analyse i realtid: Opdag syntetiske stemmer under live-kommunikation

- Historisk verifikation: Analyser indspillede opkald og beskeder for ægthed

- Integrationskapacitet: Fungerer problemfrit med eksisterende kommunikationsplatforme

- Høj nøjagtighed: Minimér falske positiver, mens du fanger sofistikerede forfalskninger

4. Omfattende træningsprogrammer

Lederteams har brug for målrettet træning i AI-stemmetrusler og verifikationsprocedurer.

Lige så vigtigt er det at øge medarbejdernes bevidsthed.

Alle, uanset rolle, bør være udstyret til at spotte potentielle deepfakes og forhindre cybertrusler i at komme ind i organisationen.

Regelmæssige simulationsøvelser kan styrke dette beredskab ved at bruge falske forsøg på stemmesvindel til at teste og forfine reaktionsprocedurer.

Avancerede AI-løsninger til stemmedetektering

Traditionelle forsvar blev bygget til netværksbaserede trusler, ikke til AI-drevne menneskelige efterligninger.

Hovedårsagerne til, at standard cybersikkerhedsværktøjer ikke kan håndtere stemmebaseret social engineering:

- Ingen malware-signatur: Stemmeopkald udløser ikke traditionelle sikkerhedssystemer

- Menneskelig tillidsfaktor: Folk stoler naturligt på det, de hører, især velkendte stemmer.

- Huller i detektionsteknologien: På trods af stigningen i AI-drevne svindelforsøg, herunder deepfakes, har kun 22% af de finansielle institutioner implementeret AI-baserede værktøjer til forebyggelse af svindel.

Behovet for specialiseret stemmedetektion

Moderne stemmesvindel kræver moderne afsløringsmuligheder.

Enterprise-klasse AI-systemer til registrering af stemmer kan:

- Analyser vokale biomarkører: Opdag subtile uoverensstemmelser i syntetisk tale

- Behandling i realtid: Giv øjeblikkelige advarsler under mistænkelige opkald

- Kontinuerlig læring: Tilpasning til nye stemmesyntese-teknikker

- Klar til integration: Arbejd med eksisterende kommunikationsinfrastruktur

Organisationer, der vil beskytte sig mod stemmesvindel, er nødt til at investere i specialbygget AI-detektionsteknologi, der kan matche de sofistikerede trusler, de står over for.

Stemmesvindel er her nu, og det eskalerer

I første kvartal af 2025 forårsagede deepfake-svindel og identitetstyveri over $200 millioner i tab.

Voice phishing med AI-kloner steg til 442%, og mere end 400 virksomheder om dagen bliver ramt af deepfake CEO- eller CFO-svindel.

Mens 56% af virksomhederne siger, at de føler sig meget sikre på at opdage deepfakes, er det kun 6%, der rent faktisk har undgået at lide økonomiske tab på grund af dem.

Det vigtige er ikke, om din organisation bliver ramt, men om du er klar til det.

Stemmesvindel ændrer cybersikkerhedens ansigt. Traditionelle forsvar kan ikke følge med AI-drevne efterligninger.

For at være beskyttet har organisationer brug for bedre detektionsværktøjer, stærke træningsprogrammer og klare verifikationsprocedurer.

Teknologien til at slå igen er her allerede. Det virkelige spørgsmål er, om du vil bruge den før eller efter dit første tilfælde af stemmesvindel.