V 90. letech to byla DNA.

V roce 2000 to byly signály z mobilních věží.

V roce 2026 však bude novým zlatým standardem důkazů digitální otisk prstu.

Přemýšlejte o tom takto...

Každý soubor videa má jedinečný podpis.

Pokud umělá inteligence změní byť jen jediný pixel, otisk se okamžitě změní.

Pokud váš důkaz o umělé inteligenci nemá ověřené časové razítko blockchainu, které by tento otisk uzamklo, může být v očích moderního soudce stejně dobře karikaturou.

Znamená to tedy, že éra “vidět znamená věřit” skončila.

Vstoupili jsme do éry ověřování videí pomocí umělé inteligence, kdy důkazem není to, co vidíte, ale digitální kód skrytý pod povrchem.

V tomto blogu se budeme zabývat tím, proč tradiční důkazy selhávají v boji proti podvodům s videem, jak odhalit zmanipulované klipy, proč je ověření rozhodující pro přípustnost a proč je nyní pro právní týmy nezbytný detektor videa s umělou inteligencí, jako je TruthScan.

Pojďme se do toho ponořit.

Klíčové poznatky

- V roce 2026 musí být všechny videozáznamy ověřeny umělou inteligencí, aby byly považovány za spolehlivé.

- Podvody s videem zahrnují i drobné úpravy, jako je manipulace s časovými razítky, nejen úplné výměny obličejů.

- Jediný způsob, jak zachytit artefakty GAN, které člověk přehlédne, je profesionální detektor hlubokých podvrhů.

- Nová pravidla, jako je federální pravidlo 707, standardizují způsob přijímání důkazů o umělé inteligenci u soudu.

- Automatizovaná analýza důkazů umožňuje firmám rychle a přesně zpracovávat rozsáhlé balíky důkazů.

- Systém TruthScan zabraňuje podvodům během živých slyšení tím, že v reálném čase odhaluje syntetické masky.

Co je to videodůkaz v právních sporech?

Videodůkaz je v podstatě jakýkoli záznam, který se používá u soudu k prokázání toho, co se stalo. Jsou všudypřítomné, od trestních případů až po pojistné události.

V roce 2026 se však díky nárůstu podvodů s videem stává “vidět znamená věřit” nebezpečným předpokladem. Právní profesionálové nyní vyžadují robustní ověřování videí pomocí umělé inteligence, aby zajistili integritu justičního systému.

Typy videodůkazů, které soudy používají každý den

Už nikdy se nemusíte obávat podvodů s umělou inteligencí. TruthScan Může vám pomoci:

- Detekce generované umělou inteligencí obrázky, text, hlas a video.

- Vyhněte se velké podvody řízené umělou inteligencí.

- Chraňte své nejzajímavější citlivé majetek podniku.

- Dozor (CCTV): Kamery z obchodů nebo semaforů. Jedná se o nejčastější důkaz v trestních věcech.

- Tělesné kamery: Záběry policistů, které se většinou používají v případech týkajících se občanských práv nebo nepřiměřené síly.

- Přístrojové kamery: Důkazní materiál pro dopravní nehody a boje s pojišťovnami.

- Zaznamenaná svědectví: Videozáznamy nebo výpovědi svědků na dálku, které se po pandemii staly běžnou záležitostí. Nyní standard, ale náchylný k problémům s odhalováním právních podvodů.

- Smartphone a sociální média: Videa od náhodných svědků nebo příspěvky, které dokazují něčí chování nebo polohu.

- Bezpečnost společnosti: Záběry používané společnostmi pro případy podvodů nebo “neoprávněného propuštění”.

Generativní umělá inteligence a technologie deepfake přidaly novou úroveň rizika. V roce 2025:

- Každé 20. ověření identity bylo oklamáno falešnou umělou inteligencí.

- Průzkum společnosti Medius uvádí, že 43% profesionálů se stalo obětí pokusu o deepfake podvod.

Skutečné případy podvodů s videodůkazy

- Zmanipulované klipy ze soudní síně

Zmanipulované záznamy ze soudní síně označují jakýkoli obrazový nebo zvukový důkaz předložený v soudním řízení, který byl pozměněn, upraven nebo zcela zfalšován pomocí technologie.

Příklady:

- Případ deepfake v okrese Alameda (2025): Kalifornský občanskoprávní případ byl zamítnut poté, co soud zjistil, že video svědka předložené jako důkaz bylo kompletně vytvořeno pomocí umělé inteligence.

- Obhajoba v případu Sz Huang vs. Tesla (2023): Právníci společnosti Tesla vžalobě za neúmyslné usmrcení tvrdili, že klíčové záběry znehody mohou být falešné.

Pozměněná sledovací videa

Jedním z nejčastějších typů důkazů umělou inteligencí používaných u soudu je kamerový záznam. Mnoho lidí však mylně považuje za manipulaci pouze úplné deepfakes.

Ve skutečnosti se podvody s videem často dějí menšími, méně nápadnými způsoby, které mohou případ ohrozit.

Mezi běžné typy manipulace patří:

- Změny časových razítek

- Odstranění rámu

- Změny metadat nebo GPS

- Výměna obličeje

- Odstranění nebo vložení předmětu

- Záběry ve smyčce

- Zhoršení kvality

Bezpečnostní videa často pocházejí z mnoha různých míst, například ze soukromých obchodů, domovních zvonků, parkovišť a městských kamer. Na rozdíl od záznamů z policejních kamer se tyto systémy obvykle neřídí přísnými pravidly řetězce uchovávání.

To znamená:

- Nemusí existovat jasný záznam o tom, kdo se spisem nakládal.

- Záběry lze kopírovat, přenášet nebo převádět vícekrát.

- Ověřovací postupy mohou být slabé nebo nekonzistentní.

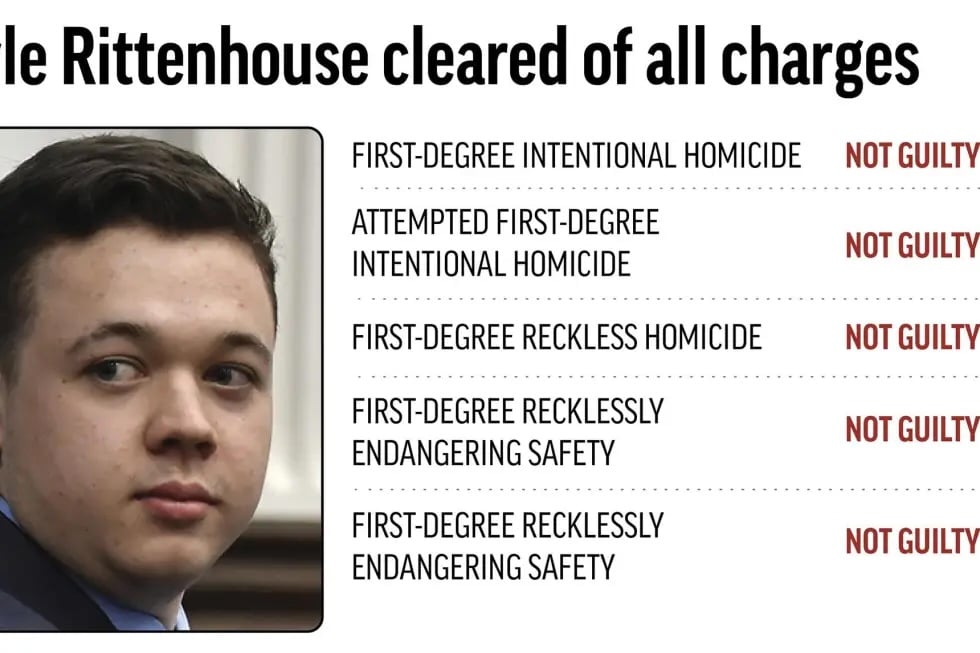

Příklad: Problém zvýšení umělé inteligence v případu Wisconsin v. Rittenhouse

Známý příklad pochází z procesu Wisconsin versus Rittenhouse. Obžaloba se snažila použít funkci přiblížení pomocí iPadu k zobrazení detailů na videu z dronu.

Obhajoba tvrdila, že zvětšení od společnosti Apple používá interpolaci umělou inteligencí, aby odhadlo, co by tam mělo být. Soudce rozhodl, že bez profesionálního detektoru videa s umělou inteligencí nelze rozšířené záběry připustit.

Sporná svědectví na videu

Sporné video svědectví obvykle vyžaduje právní detekci podvodu, aby bylo možné určit, zda se jedná o nahrávku:

- Zcela smyšlená výpověď nebo prohlášení

- Skutečné svědectví zpochybněné jako falešné

- Zmanipulovaná skutečná nahrávka

Každý z těchto scénářů představuje pro soud závažnou ověřovací zátěž.

Příklad: Případ péče o dítě ve Spojeném království

V rodinném soudním sporu ve Velké Británii, který cituje University of Baltimore Law Review, matka předložila značně pozměněnou nahrávku, která měla otce během bitvy o opatrovnictví vykreslit jako násilníka.

Cílem bylo omezit jeho přístup k dětem.

Vzestup videa generovaného umělou inteligencí v právních záležitostech

Cesta k současné éře deepfake detektorů probíhala v různých fázích:

- Roky včasného varování (2017-2021)

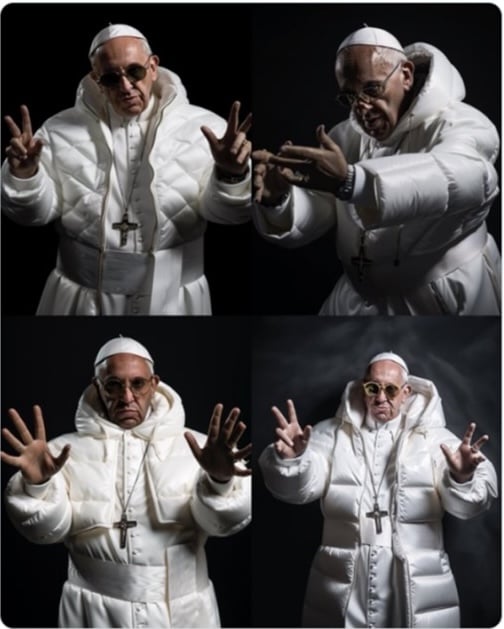

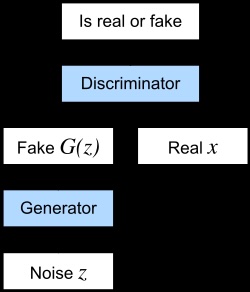

Technologie Deepfake (založená na generativních adversariálních sítích (GAN)) vstoupila na veřejnost kolem roku 2017.

První deepfakes byly často nekvalitní: obličeje s podivnými deformacemi, prsty navíc, špatným osvětlením a rozmazanými rysy, díky nimž je bylo snadné rozpoznat.

- Fáze eskalace (2022-2023)

Do roku 2022 se technologie zlepšila. Mnohé z nich byly zdarma a použitelné na chytrém telefonu.

V roce 2023 jsme se začali setkávat s prvními významnými výzvami souvisejícími s deepfake v soudních případech, včetně případů Sz Huang v. Tesla, Spojené státy v. Reffitt a Spojené státy v. Doolin, kde právní zástupci vznesli otázky, zda videodůkazy mohou být vytvořeny umělou inteligencí.

Přibližně ve stejné době začal Poradní výbor pro pravidla dokazování Americké advokátní komory tuto otázku oficiálně zkoumat.

- Kritický práh (2024-2025)

Obsah generovaný umělou inteligencí nezůstal akademický dlouho. V roce 2024 došlo v inženýrské firmě Arup k incidentu, který zahrnoval falešný videohovor generovaný umělou inteligencí, který autorizoval podvodné bankovní převody v celkové výši $25 mil..

Právní systém začal reagovat.

V roce 2025, Louisiana schválila HB 178, čímž byl vytvořen první rámec pro ověřování důkazů o umělé inteligenci na státní úrovni.

Na federální úrovni navrhl Poradní výbor USA pro pravidla dokazování Pravidlo 707, zaměřené na strojově generované důkazy.

Jaký je stav věcí v roce 2026

Od začátku roku 2026 se regulace deepfake a AI-videí zrychlila na celostátní úrovni:

- 46 států přijaly nějakou formu deepfake legislativy.

- Od roku 2022, V roce 2025 bylo přijato 169 zákonů a předloženo 146 návrhů zákonů..

- Federální pravidlo 707 je otevřeno pro veřejné připomínky do 16. února 2026.

Zlepšení ověřování videa pomocí umělé inteligence

Nejúčinnějším způsobem, jak odhalit video vytvořené umělou inteligencí, je použít samotnou umělou inteligenci.

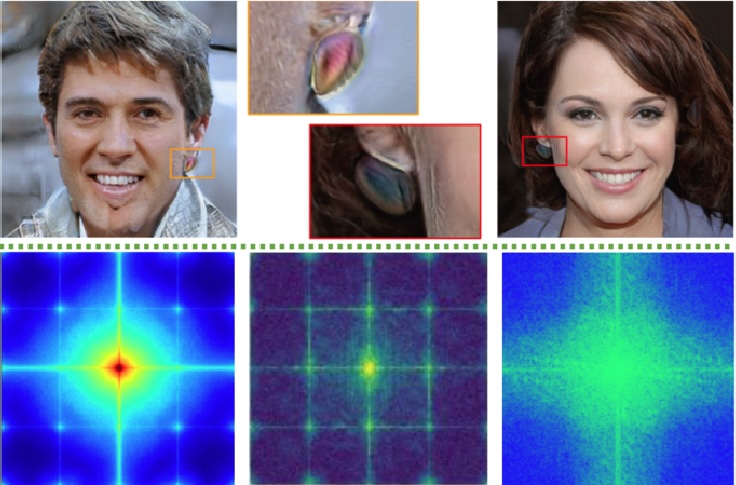

Je to proto, že deepfakes jsou vytvářeny systémy strojového učení, které za sebou zanechávají jemné digitální vzory.

Tyto vzory jsou příliš malé nebo složité na to, aby si jich lidské oko všimlo. Mohou je však odhalit jiné algoritmy.

Spolehlivý systém ověřování videa s umělou inteligencí dokáže analyzovat více vrstev videa najednou, včetně:

- Analýza na úrovni rámce kontroluje každý snímek na vizuální chyby, jako jsou podivné textury, nesoulad osvětlení nebo problémy s prolínáním obličejů.

- Analýza časové koherence zkoumá pohyb napříč snímky a hledá nepřirozené skoky nebo nekonzistentní pohyby.

- Sledování orientačních bodů obličeje sleduje pohyby očí, mrkání a tvar obličeje, aby odhalil nepřirozené změny.

- Testování audiovizuální synchronizace kontroluje, zda pohyby rtů přesně odpovídají mluveným slovům.

- Forenzní audio analyzuje hlas a hledá známky klonování, jako jsou neobvyklé zvukové vzory nebo robotické tóny.

- Analýza metadat a komprese zkoumá údaje skrytého souboru, které jsou důležité pro odhalování právních podvodů, aby zjistil, zda se shodují s původními údaji záznamu.

Vzdělávání právních týmů v oblasti podvodů s videem

Vzhledem k tomu, že umělá inteligence dnes dokáže napodobit lidské chování s děsivou přesností, využívají advokátní kanceláře automatizovanou analýzu důkazů a kombinaci tradičních taktik, aby si udržely náskok.

| Kategorie | Metoda | Popis |

| Oficiální způsoby | Kredity CLE (průběžné právní vzdělávání) | Povinné nebo volitelné kurzy, v nichž se právníci učí, jak ověřovat pravost digitálních důkazů, porozumět falešným důkazům a dodržovat důkazní standardy. |

| Soudem jmenovaní odborníci na umělou inteligenci | zřízení certifikovaných forenzních specialistů na umělou inteligenci, kteří by podobně jako znalci DNA vyhodnocovali sporné videodůkazy u soudu. | |

| Neoficiální způsoby | Interní červený tým | najímání odborníků na kybernetickou bezpečnost, kteří testují, zda přes firemní systémy příjmu neproklouznou falešné nebo zmanipulované důkazy. |

| “Protokol ”Vibe Check" | Školení zaměstnanců, aby rozpoznali běžné varovné příznaky deepfake, jako je nepřirozené mrkání, zkreslené rysy nebo problémy se synchronizací rtů, než je předají k forenznímu přezkoumání. |

Nástroje a technologie pro ověřování důkazů

V roce 2026 jsme se posunuli od prosté kontroly z očí do očí.

Vzhledem k tomu, že umělá inteligence je nyní schopna oklamat i ty nejzkušenější vyšetřovatele, používají právní týmy specifickou sadu nástrojů k ověření, že to, co vidí, je naprostá pravda.

Technologie pro ověřování důkazů

- Detektory hlubokých falzifikátů: Jedná se o specializované softwarové programy, které vyhledávají artefakty GAN. Jedná se o mikroskopické matematické vzory nebo šum, které po sobě zanechávají modely umělé inteligence generující syntetické obličeje. Zatímco člověk vidí tvář, detektor vidí digitální podpis, který tam nepatří.

- TruthScan je hloubkový detektor falešných tváří, který skenuje videa snímek po snímku a hledá známky umělé inteligence, jako je neobvyklé mrkání, zvláštní tvary obličeje nebo chyby v pixelech, kde je přidána falešná tvář.

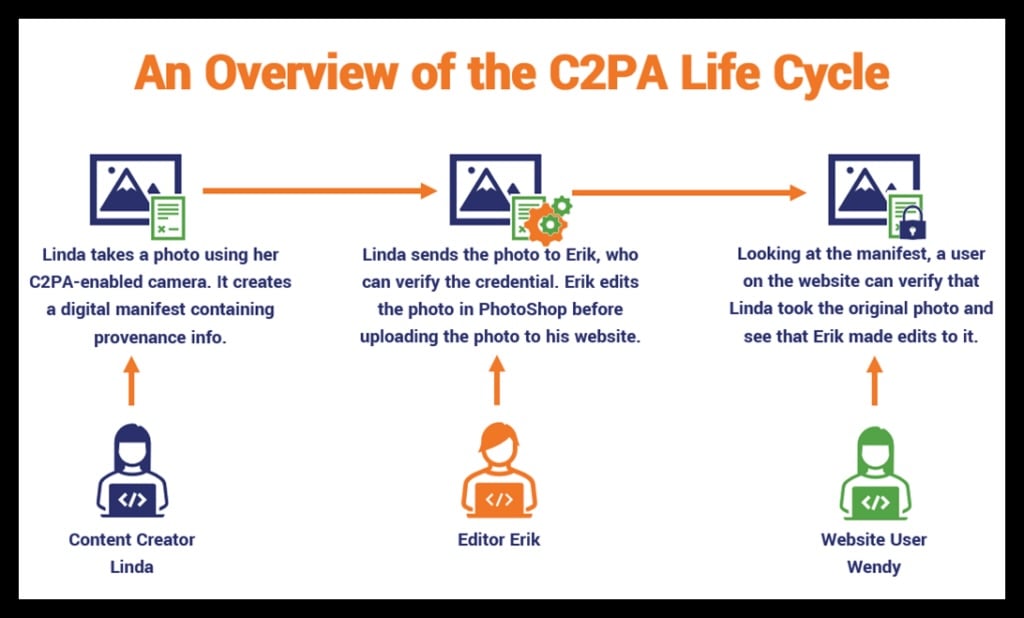

- Časové značky blockchainu: K prokázání toho, že s videozáznamem nebylo od okamžiku jeho nahrání nijak manipulováno, nyní mnoho agentur používá standard C2PA. Když je video nahráno na kompatibilní zařízení, vytvoří se jedinečný digitální otisk (hash), který se uloží do blockchainu.

- Program TruthScan může zkontrolovat, zda se tento otisk shoduje s videem, a zjistit, zda byl soubor upraven nebo zda byl porušen řetězec ochrany.

- Nástroje pro forenzní analýzu metadat: Každý digitální soubor má rodný list známý jako data Exif. Tyto nástroje zjišťují, zda byl soubor znovu uložen v softwaru pro úpravu umělé inteligence nebo zda nedošlo k podvržení údajů o poloze (GPS). Pokud video tvrdí, že pochází z kamery v obchodě, ale podle metadat bylo exportováno z editoru videa, máte problém.

- Software Amped a TruthScan zkoumají skrytá data souborů (Exif, hlavičky) a zjišťují, zda bylo video upraveno nebo zpracováno umělou inteligencí.

Trendy ve videodůkazech s umělou inteligencí

Zde jsou tři trendy roku 2026.

- Generativní adversariální forenzní analýza: Umělá inteligence vs. umělá inteligence

Nejpokročilejší způsob, jak zachytit deepfake v roce 2026, je použít stejnou technologii, která ho vytvořila. Jedná se o takzvanou generativní adversariální forenzní analýzu.

- Jedna umělá inteligence (generátor) se snaží vytvořit podvrh, zatímco druhá umělá inteligence (diskriminátor) se ho snaží zachytit. V soudní síni mohou být nástroje jako TruthScan dokonalým diskriminátorem.

- Příklad: Žalobce předkládá videozáznam generálního ředitele, který uzavírá ústní smlouvu. TruthScan prohledá video pomocí vlastních adverzních modelů a odhalí artefakty GAN. Pokud software označí syntetický 98% pravděpodobnost, že důkaz je pravděpodobně podvrh, který má oklamat lidské oči.

- Analýza synchronizace zvuku a videa (pravidlo 0,01 ms)

Lidé obvykle rozpoznají zpoždění, pokud se zvuk videa liší o 40-80 milisekund. Deepfakes z roku 2026 jsou však často téměř dokonalé.

- Moderní forenzní nástroje umělé inteligence nyní hledají 0,01 milisekundy zpoždění mezi fonetickým zvukem slova a mechanickým pohybem rtů.

- Příklad: V případu obtěžování z roku 2026 žalovaný tvrdil, že video bylo zfalšováno. Forenzní automatizovaná analýza důkazů ukázala, že tvary rtů “M” a “B” jsou o 0,02 ms mimo synchronizaci se zvukem. Tato mikroskopická chyba prokázala, že hlas byl naklonován a navrstven na jiné video, což vedlo k zamítnutí žaloby.

- Cheapfakes vs. Deepfakes

Zatímco hloubkové podvrhy využívají špičkovou umělou inteligenci, levné podvrhy jsou nejběžnější formou podvodů s videem.

- Deepfake vytváří realitu, která se nikdy nestala (například výměna obličeje). Cheapfake využívá skutečné záběry a pomocí jednoduchých nástrojů mění kontext nebo záměr.

- Příklad (Zpomalení): Video s politikem, který vypadá opilý nebo postižený, lze vytvořit jednoduše zpomalením záznamu o 20% a úpravou výšky zvuku.

- Příklad (opětovný kontext): V roce 2026 jsou zveřejněny záběry z protestu v jiné zemi v roce 2022 jako přímý důkaz místních nepokojů. Právní týmy nyní používají analýzu metadat společnosti TruthScan k prokázání skutečného data narození videa.

Jak TruthScan chrání právní videodůkazy

Služba TruthScan zajišťuje, že každý snímek, který předložíte u soudu, je autentický, ověřený a právně obhajitelný.

Platforma zefektivňuje ověřování videí s umělou inteligencí díky následujícím výhodám:

Automatizované protokoly o auditu a dokumentace zpracovatelského řetězce

- Spolehlivost připravená na soud: Generuje zprávy PDF a JSON, které dokumentují každý krok ověření s přesným hodnocením důvěryhodnosti a časovými značkami.

- Dodržování předpisů na nejvyšší úrovni: Buďte v klidu, protože vaše data zůstanou v bezpečí a splňují přísné globální standardy, jako jsou SOC 2, ISO 27001 a GDPR.

- Flexibilní kontrola dat: Uchovávejte citlivé důkazy v rámci požadované jurisdikce díky možnostem nasazení on-premise nebo VPC navrženým pro vysoce regulovaná odvětví.

Dávkové zpracování a integrace API pro právní pracovní postupy

- Obrovská úspora času: Zpracovávejte tisíce souborů z balíčků pro zjišťování nebo sad pro sledování současně pomocí hromadných importů z úložišť (S3/GCS).

- Bezproblémové elektronické vyhledávání: Zjednodušte své operace integrací ověřování přímo do stávajícího softwaru prostřednictvím webových háčků a rozhraní API.

- Eliminace ručních chyb: Automatizujte první průchod kontroly důkazů, aby se váš tým mohl soustředit na strategii namísto zdlouhavé kontroly jednotlivých souborů.

Ověřování v reálném čase pro výpovědi a slyšení na dálku

- Zastavení napodobování: Pomocí koncových bodů živého přenosu můžete zjistit, zda účastník řízení během vzdáleného slyšení používá deepfake filtry nebo hlasové klony.

- Zachování integrity soudu: Označte vizuální nebo zvukové anomálie v reálném čase, a zabraňte tak podvodným svědectvím, aby se dostala do záznamu.

- Klid v duši: Poskytněte svým klientům a soudu další úroveň zabezpečení, která zaručí, že osoba na obrazovce je přesně ta, za kterou se vydává.

Další informace o zabezpečení videodůkazů s umělou inteligencí

Chraňte svou firmu před riziky zmanipulovaných médií. Detektor hlubokých falzifikátů a technologie detektoru videa s umělou inteligencí společnosti TruthScan představují dokonalé řešení pro e-discovery a právní ověřování.

Jste připraveni vidět TruthScan v akci?

- Navštivte truthscan.com získat zdarma 20 000 kreditů.

- V případě dotazů pro podniky, integrace rozhraní API nebo možností vlastního nasazení se obraťte na jejich tým na adrese. Truthscan.com/kontakt.