Ještě před několika lety jste potřebovali profesionální studio a spoustu technických dovedností, abyste mohli napodobit něčí hlas.

Kdokoli s připojením k internetu a trochou volného času může nyní vytvořit digitální klon hlasu kohokoli za méně než minutu.

Nástroje pro tyto útoky jsou každým dnem levnější a dostupnější pro každého. A protože tolik lidí sdílí svůj život na sociálních sítích, je pro podvodníka velmi snadné najít zvukový záznam, který potřebuje.

V tomto článku vás seznámíme s některými notoricky známými příklady podvodů se zvukem. Představíme vám také řešení, které těmto hrozbám včas učiní přítrž.

Klíčové poznatky

- Počet pokusů o podvody s hlasem se v posledních letech zvýšil o více než 2 137%, k čemuž přispěla i skutečnost, že moderní umělá inteligence dokáže vygenerovat 85% přesný klon hlasu s použitím pouhých tří sekund zdrojového zvuku.

- Mezi známé reálné útoky patří loupež v roce 2024 ve strojírenské firmě Arup, kdy podvodníci použili falešné video a zvuk finančního ředitele, aby zaměstnance přiměli k převodu $25,6 milionu.

- Kromě krádeží v podnicích představují falešné hlasové záznamy vážné emocionální riziko pro rodiny prostřednictvím podvodů s únosy a mohou obejít tradiční biometrické bezpečnostní systémy používané bankami a dalšími aplikacemi s vysokou úrovní zabezpečení.

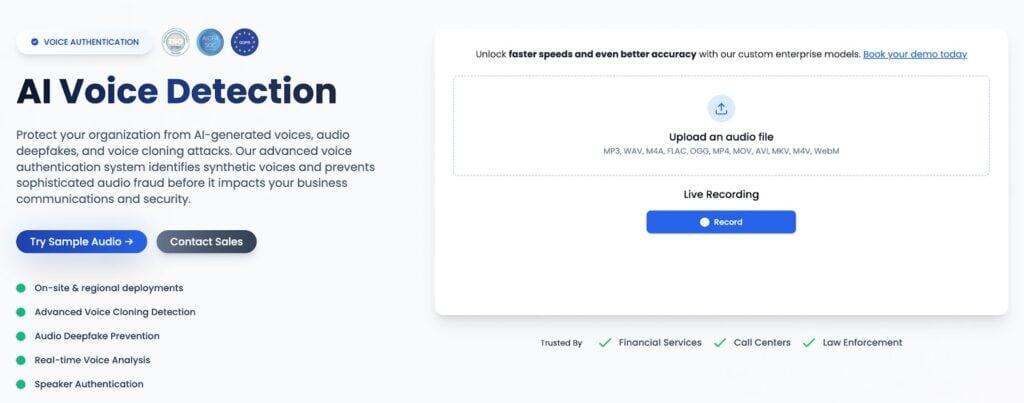

- Organizace jsou nuceny překonat ověřování pouze lidmi tím, že zavádějí vícečlenné schvalovací protokoly pro velké přenosy a nasazují hlasové detektory s umělou inteligencí, jako je TruthScan, které analyzují akustické otisky v reálném čase.

- TruthScan zabezpečuje podnikové interakce identifikací artefaktů syntetické řeči z platforem, jako jsou ElevenLabs a Murf, s přesností více než 99% ve všech hlavních formátech zvuku a videa.

Co jsou hlasové útoky Deepfake?

Hlasový deepfake je digitální padělek cizího hlasu. Útočník používá software, který dokáže z nahrávky hlasu analyzovat každý detail toho, jak někdo mluví.

Při klonování hlasu se software snaží rozpoznat vzory v hlase. Software bere v úvahu hlavně takové věci, jako je výška hlasu, tón, způsob dýchání mezi větami atd.

Jakmile se útočník naučí tyto vzory, může jej přimět, aby tímto hlasem řekl cokoli.

Už nikdy se nemusíte obávat podvodů s umělou inteligencí. TruthScan Může vám pomoci:

- Detekce generované umělou inteligencí obrázky, text, hlas a video.

- Vyhněte se velké podvody řízené umělou inteligencí.

- Chraňte své nejzajímavější citlivé majetek podniku.

Nebezpečné je, že nástroje pro vytváření hlasových deepfake jsou snadno dostupné. A většina z nich nepotřebuje žádnou instalaci. Jsou k dispozici online ve formě webových stránek.

Stačí jim přihodit pár dolarů a začít klonovat hlasy. Pokud budete pátrat trochu víc, můžete dokonce najít nástroje, které vám umožní klonovat hlasy zdarma.

Tato nová a snadno dostupná technologie vedla k prudkému nárůstu podvodů se zvukem.

Podvodníkům stačí jen malý kousek zvukového záznamu, který mohou získat ze sociálních médií nebo jiného veřejného kanálu, a naklonovat si ho.

Klonovaný hlas pak mohou používat k vydávání se za osobu v situacích, jako jsou živé telefonní hovory, videokonference, hlasové poznámky, oznámení atd.

Nejedná se pouze o hypotetické případy použití hlasových deepfake útoků. Tyto věci se již staly. Některými notoricky známými útoky typu voice deepfake se budeme zabývat později.

Potenciální rizika hlasových deepfake útoků

Když jste slyšeli o hlasovém deepfake, možná jste si představili vtipné video, na kterém nějaká celebrita říká věci, které nikdy neřekla.

Zdánlivě neškodné použití klonovaného hlasu však může zúčastněným stranám způsobit vážné škody. Promluvme si o rizicích.

Finanční devastace podniků

Hlasový deepfake může navždy zničit pověst společnosti. Může ji také během několika minut připravit o velké částky peněz.

Ptáte se, jak to? Podvodníci mohou naklonovat hlas šéfa společnosti a pomocí něj volat zaměstnancům a nutit je dělat věci, které se dělat nemají, například převádět peníze na účet.

Toto je jen jeden příklad. Možnosti jsou nekonečné.

Obcházení bezpečnostních systémů

Váš hlas je biometrický údaj, který by nikdo jiný neměl mít. Používáte ho totiž jako heslo pro přihlášení do mnoha aplikací, zejména bankovních.

I když tyto aplikace mohou mít zabudovaný automatický systém ověřování hlasu, který zabraňuje neoprávněnému přístupu, dobrý hlasový klon má stále šanci je oklamat.

Emocionální zátěž pro rodiny

Snad nejsnadnějším cílem pro podvodníky se zvukovými záznamy jsou starší lidé v rodině. Například rodiče a prarodiče.

Podvodníci mohou zavolat například matce a přehrát zvuk její dcery volající o pomoc s tím, že byla unesena.

Narušování důvěry na pracovišti

Důvěru na zdravém pracovišti poškozují také hlasové deepfake útoky.

Zaměstnanci budou muset dvakrát zkontrolovat telefonáty od svého nadřízeného, aby se ujistili, že nejde o podvodníka, který jim klonovaným hlasem přikazuje dělat riskantní věci.

Jaké jsou tedy vaše možnosti, když ne dvojitá ruční kontrola? Všechna rizika, která jsme právě probrali, ukazují na potřebu automatické prevence deepfake útoků.

Naštěstí máme nyní k dispozici nástroje pro detekci falešných hlasů s umělou inteligencí, mezi něž patří i TruthScan.

Zabraňte podvodům a vydávání se za někoho jiného pomocí systému TruthScan. Detektor hlasu AI.

Reálné příklady útoků na hlasové podvrhy

Díky umělé inteligenci jsme se dostali do bodu, kdy už nemůžeme věřit tomu, co naše oči vidí nebo uši slyší. Umělá inteligence je nyní schopna vytvářet realistické obrázky a videa. Totéž platí pro zvuk.

Možná jste již slyšeli příběhy o lidech, kteří naletěli podvodníkům s falešnými zvukovými nahrávkami. Čas od času se objeví i ve zprávách a na sociálních sítích. Nad některými z nich je těžké se zamyslet.

Povíme vám o některých nejznámějších útocích typu deepfake, abyste si mohli udělat dobrou představu o tom, jak chytře jsou prováděny.

Virtuální schůzka za $25 milionů, která se ve skutečnosti nikdy nekonala

Tento deepfake útok je pravděpodobně nejčastěji hlášeným útokem.

Na stránkách obětí byla britská inženýrská firma Arup., ale podvod vznikl v její hongkongské pobočce.

Byl začátek roku 2024, když pracovník finančního oddělení společnosti dostal e-mail od finančního ředitele společnosti ve Velké Británii. V e-mailu bylo pracovníkovi finančním ředitelem nařízeno, aby provedl tajné převody peněz na některé bankovní účty.

Zaměstnanec byl zpočátku podezřívavý, protože mu žádost připadala poněkud zvláštní a myslel si, že by mohlo jít o phishingový podvod.

Pak byl ale zaměstnanec pozván na videokonferenci. Když se zaměstnanec připojil k hovoru, uviděl něco, co vypadalo přesně jako finanční ředitel a několik dalších vedoucích kolegů.

Všichni vypadali a zněli přesně tak, jak měli. Také spolu mluvili, aby to vypadalo opravdověji.

To zcela vyvrátilo veškeré pochybnosti pracovníka finančního oddělení, který poté prostřednictvím 15 transakcí odeslal více než 1TP725,6 milionu USD (~1TP7200 milionů Kč) na několik různých hongkongských bankovních účtů.

Později bylo zjištěno, že celá tato sestava byla deepfake. Žádná osoba v hovoru nebyla tím, za koho se vydávala, s výjimkou zaměstnance společnosti Arup. Podvodníci útok dokonale koordinovali pomocí vysoce kvalitních zvukových a obrazových klonů finančního ředitele a vedoucích zaměstnanců společnosti.

Italský ministr a módní ikony

I ten se odehrál v roce 2024. A falešný italský ministr obrany Guido Crosetto zavolal několika italským elitám a požádal je o okamžitou finanční pomoc při záchraně unesených novinářů.

Falešný Guido Crosetto v hovoru tvrdil, že se jedná o přísně tajnou vládní operaci. Volajícímu se dokonce podařilo spojit s legendárními osobnostmi módního průmyslu, jako je Giorgio Armani.

Bohužel jedna osoba nakonec převedla asi milion dolarů. Pravděpodobně měli silnější pocit vlastenecké povinnosti pomoci než ostatní, čehož podvodníci úspěšně využili.

$243,000 UK Energy Heist

Tento se stalo v roce 2019 a pravděpodobně se jednalo o vůbec první hlášený deepfake takového rozsahu.

Generální ředitel britské energetické společnosti si myslel, že telefonuje se svým šéfem z mateřské společnosti v Německu.

Generálnímu řediteli bylo nařízeno převést dodavateli v Maďarsku přibližně 220 000 EUR ($243 000). Bylo mu řečeno, že se jedná o kritický obchod, který vyžaduje okamžitý převod. Generální ředitel naletěl podvodníkovi a peníze převedl.

Děsivé volání pro matku v Arizoně

Vzpomínáte si, jak jsme mluvili o tom, že zvukové deepfakes představují hrozbu pro rodiny? Příklad podvodu, který jsme uvedli, se skutečně stal.

Podvodníci naklonovali hlas patnáctileté dívky z jejího videa na sociálních sítích. Poté zavolali její matce a hlasem dcery tvrdili, že byla unesena a únosci za ni okamžitě požadují výkupné.

Naštěstí se otci podařilo zavolat jejich skutečné dceři, která byla během celé události v bezpečí na lyžařském tréninku. Podvodu se vyhnuli.

Jak hlasové podvrhy ovlivňují podniky

Hlavním cílem hlasového útoku deepfake je většinou krádež peněz.

Pokud jsou však cílem podniky, je škoda vícerozměrná.

Například deepfakes mohou otrávit atmosféru mezi zaměstnanci společnosti. Může vytvořit kulturu, v níž se zaměstnanci vždy bojí, že udělají chybu.

Vezměme si příklad call center. Setkáváme se se zprávami o kyberzločincích, kteří do nich volají a vydávají se za konkrétní zákazníky.

Jejich trik spočívá v tom, že přimějí pracovníky call centra, aby změnili údaje o účtu těchto zákazníků (např. adresy bydliště, telefonní čísla) a převzali jejich účty.

Nábor na dálku a virtuální pohovory jsou další oblastí, kde mohou uchazeči využít falešných hlasů k získání pracovních míst, pro která nemají kvalifikaci.

Ochrana firem před hlasovými útoky Deepfake

Tradiční bezpečnostní pravidla ve firmách byla vytvořena v době před nástupem umělé inteligence.

Je nejvyšší čas, aby je podniky přehodnotily. Nejprve by měly začít s osvětou o mnoha nových kybernetických hrozbách, které vznikly zneužitím umělé inteligence.

Mohou například uspořádat školení pro celý svůj tým a ukázat jim skutečné příklady podvodů se zvukem. Můžete začít příklady, které jsme právě probrali výše. Na těchto školeních by jim také měli poskytnout tipy na prevenci deepfake útoků pro různé scénáře.

Pak můžete přistoupit k aktualizaci interních obchodních zásad. Jednou z důležitých změn může být to, že přestanete umožňovat jediné osobě, aby sama schvalovala masivní bankovní převody.

Velké platby by měly vyžadovat schválení celé komise, aby si alespoň jeden z nich mohl včas všimnout, že něco není v pořádku.

Měli byste také přemýšlet o integraci automatizovaného Detektor hlasu AI běžet na pozadí během hovorů.

K tomu byly nástroje TruthScan AI stvořeny. Pomocí našich nástrojů umělé inteligence můžete odhalovat, ověřovat a předcházet útokům typu deepfake. Řekneme vám, jak na to.

Jak TruthScan zabezpečuje hlasové interakce

Chápeme, že zaměstnanci uprostřed stresujícího hovoru nedokážou sami rozeznat hluboký falešný hlas od skutečného. Potřebují specializovaného asistenta, který by se během hovoru mohl věnovat této práci, zatímco váš tým se může soustředit na to, kvůli čemu byl najat.

Naše Detektor hlasu AI je specializované řešení.

Zde se dozvíte, jak funguje a co umí:

- Analyzuje miliony různých datových bodů v živých telefonních hovorech a videokonferencích a poskytuje přesnost 99%.

- Po zjištění falešného hlasu okamžitě vydá varování.

- zachycuje spektrální vzorce a akustické otisky hlasu, které zanechávají pouze syntetické modely.

- Integruje se s vaším stávajícím call centrem nebo oddělením pomoci prostřednictvím jednoduchého rozhraní REST API.

- Dokáže skenovat všechny hlavní formáty zvuku a videa

Promluvte si s TruthScanem o prevenci hlasových deepfake útoků

S nástrojem TruthScan můžete zastavit podvody s klonováním hlasu v reálném čase, ale otázkou je, kdy s tím začnete. Vaši zaměstnanci mohou dříve či později udělat chybu a nechat vás podvést. Nečekejte na tento nešťastný okamžik.

Náš detektor hlasu s umělou inteligencí dokáže označit hlasové podvrhy pomocí platforem, jako jsou ElevenLabs a Murf.

Pracuje na pozadí během živých telefonních hovorů a videokonferencí, takže vaši telefonní operátoři se nemusí věnovat více úlohám.

Stačí jen rychlá integrace prostřednictvím našeho rozhraní REST API.

Začněte s TruthScan a ochránit svou firmu před podvody typu deepfake.