Pojistné podvody vstupují do nové éry poháněné umělou inteligencí. Sofistikované podvodné skupiny i osamělí podvodníci využívají generativní nástroje umělé inteligence k vytváření falešných pojistných událostí, syntetických identit, hluboce falešných důkazů a velmi přesvědčivých podvodů s vydáváním se za někoho jiného. Tato bílá kniha zkoumá nejnovější 2025 trendů v oblasti pojistných podvodů založených na umělé inteligenci - od nároků a dokumentů generovaných umělou inteligencí až po podvody s hluboce falešnými hlasy - a nastiňuje, jak na ně mohou pojistitelé reagovat. Předkládáme nejnovější data, reálné případy a strategické postřehy pro upisovatele, vyšetřovatele podvodů, týmy kybernetické bezpečnosti, manažery pojistných událostí a vedoucí pracovníky v oblasti C-suite, kteří potřebují porozumět tomuto rychle se vyvíjejícímu prostředí hrozeb.

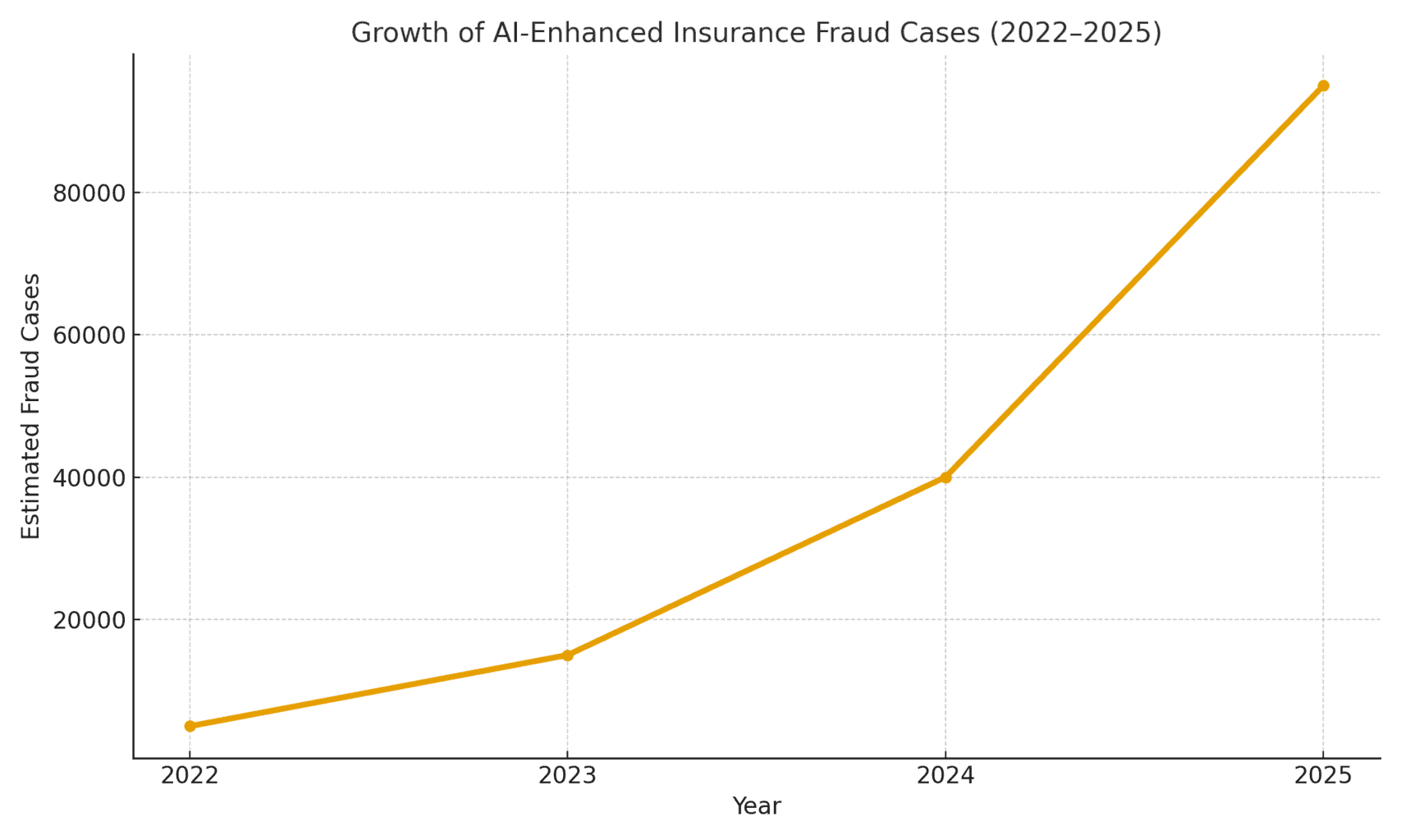

Rozsah hrozby: Podvody umožněné umělou inteligencí prudce rostou. Zpráva forenzního účetnictví z roku 2025 zjistila, že Podvody řízené umělou inteligencí nyní představují více než polovinu všech digitálních finančních podvodů.[1]. Konkrétně v oblasti pojištění zaznamenala společnost Pindrop, která se zabývá hlasovým zabezpečením. 475% nárůst syntetických hlasových podvodů v pojišťovnách v roce 2024, což přispělo k meziročnímu nárůstu celkového počtu pokusů o pojistné podvody o 19%.[2]. Pojišťovny čelí zhruba 20krát vyšší riziko podvodů než u bank, zčásti kvůli velkému spoléhání se na dokumenty, obrázky a hlasové ověření v nárocích.[3]. Obrázek 1 níže ilustruje explozivní nárůst případů pojistných podvodů s využitím umělé inteligence v letech 2022 až 2025, neboť podle řady zpráv z odvětví dochází meziročně k troj- nebo čtyřcifernému procentuálnímu nárůstu zjištěného zapojení umělé inteligence do podvodů.

Obrázek 1: Rychlý nárůst případů pojistných podvodů s využitím umělé inteligence (indexovaný růst 2022-2025). Údaje z odvětví naznačují exponenciální nárůst obsahu generovaného umělou inteligencí, který se vyskytuje v podvodných pojistných událostech, zejména od roku 2023.[4][2]

Tvrzení generovaná umělou inteligencí a falešné důkazy

Jedním z nejrozšířenějších trendů je využití generativní umělé inteligence k vytváření zcela vymyšlené pojistné události. Díky pokročilým generátorům textu s umělou inteligencí mohou podvodníci napsat realistický popis události, lékařskou zprávu nebo policejní výpověď pouhým kliknutím. Tato vyprávění napsaná umělou inteligencí se často čtou jako uhlazená a věrohodná, takže je pro likvidátory těžší odhalit nesrovnalosti. Podvodníci například využívají ChatGPT k vypracování podrobných popisů nehod nebo zpráv o zranění, které znějí profesionálně a přesvědčivě - což je úkol, který kdysi vyžadoval značné úsilí a dovednost psaní.

Ještě více znepokojující je, že zločinci nyní spojují tato falešná vyprávění s Podpůrné důkazy vytvořené umělou inteligencí. Modely pro generování obrázků (např. Midjourney nebo DALL-E) a nástroje pro úpravy mohou vytvářet fotorealistické fotografie poškození a zranění. Podle zpráv z oboru začali někteří řidiči předkládání snímků generovaných umělou inteligencí k přehánění poškození vozidla při pojistných událostech.[5]. Generativní umělá inteligence dokáže vytvořit fotografii havarovaného auta nebo zatopeného domu, který ve skutečnosti nikdy neexistoval. Tyto snímky jsou často realističtější než to, čeho bylo možné dosáhnout staršími technikami Photoshopu.[6], takže je obtížné je odhalit pouhým okem. V dubnu 2025 zaznamenala pojišťovna Zurich nárůst pojistných událostí s. zfalšované faktury, zfalšované odhady oprav a digitálně upravené fotografie.včetně případů, kdy registrační značky vozidel byly vloženy umělou inteligencí na snímky zachráněných automobilů.[7][8]. Takové falešné důkazy mohou v kombinaci s dobře vytvořeným formulářem žádosti napsaným umělou inteligencí proklouznout přes manuální kontrolu.

Ve Velké Británii se stal zarážející případ, kdy podvodníci převzali fotografie dodávky obchodníka na sociálních sítích a použití umělé inteligence k přidání prasklého nárazníku.a poté ji předložil spolu s falešnou fakturou za opravu na 1 000 liber jako součást falešné žádosti o odškodnění za havárii.[9]. Podvod byl odhalen, až když si vyšetřovatelé všimli, že totéž fotografie dodávky (před poškozením) na stránce majitele na Facebooku[10]. To ilustruje širší jev: pojistitelé hlásí 300% skok v úpravách obrázků "shallowfake" (jednoduchá digitální manipulace za účelem přidání poškození nebo změny detailů) za pouhý jeden rok (2021-2022 vs. 2022-2023).[4]. Allianz UK v roce 2024 varovala, že zkreslování digitálních fotografií a falešné doklady "mají všechny předpoklady stát se posledním velkým podvodem, který zasáhl odvětví".[4]. Vedoucí oddělení škodních podvodů společnosti Zurich rovněž poznamenal, že to, co dříve vyžadovalo zinscenování fyzické autonehody, lze nyní provést výhradně za počítačem. - podvodníci mohou "zpoza klávesnice vytvořit podvodnou žádost a získat značné částky" pomocí falešných fotografií a zpráv o totální škodě.[11][12]. Tento posun nejen zvyšuje objem falešných žádostí, ale také snižuje vstupní bariéru pro potenciální podvodníky.

Už nikdy se nemusíte obávat podvodů s umělou inteligencí. TruthScan Může vám pomoci:

- Detekce generované umělou inteligencí obrázky, text, hlas a video.

- Vyhněte se velké podvody řízené umělou inteligencí.

- Chraňte své nejzajímavější citlivé majetek podniku.

Kromě aut, majetkové a úrazové nároky zaznamenávají inflaci ztrát za pomoci umělé inteligence. Objevují se zprávy o falešných fotografiích pro cestovní pojištění (např. "poškození" zavazadel nebo zinscenované scény krádeže) a účtenky generované umělou inteligencí za drahé předměty, které nikdy nebyly zakoupeny. Životní a zdravotní pojistné události nejsou imunní - podvodníci vytvořili falešné lékařské účty a úmrtní listy pomocí padělatelů dokumentů s umělou inteligencí. Ve skutečnosti Curych zaznamenal, že technologie deepfake byla použita k vytvoření zcela fiktivní posudky inženýrů a lékařské zprávy. v balíčcích pro reklamace[11]. Tyto dokumenty generované umělou inteligencí, často doplněné realistickými logy a podpisy, mohou být k nerozeznání od pravých dokumentů. Nově vznikajícím problémem pro životní pojišťovny je podvody s nekrology a úmrtními listy: zločinci mohou pomocí umělé inteligence vytvořit falešné nekrology nebo dopisy od lékařů, aby podpořili tvrzení o úmrtí někoho, kdo je ve skutečnosti stále naživu (nebo kdo vůbec nikdy neexistoval, jak bude uvedeno dále).

Syntetické pojistníky a identity

Snad nejzáludnějším vývojem je podvody se syntetickou identitou v pojištění. Podvody se syntetickou identitou spočívají ve vytvoření fiktivní osoby nebo subjektu kombinací skutečných údajů (ukradená čísla sociálního pojištění, adresy atd.) s vymyšlenými údaji (falešná jména, falešné doklady totožnosti). Pokroky v oblasti umělé inteligence umožnily triviálně snadno generovat realistické osobní profily - včetně fotografií a průkazů totožnosti - pro neexistující osoby.[13][14]. Podvodníci nyní mohou algoritmicky vytvořit zcela falešného zákazníka, zakoupit pojistku na jeho jméno a později pro tuto falešnou identitu zinscenovat pojistné události nebo pojistné plnění.

V odvětví životního pojištění se systémy syntetické identity prudce vzrostl. Průmyslový výzkum v roce 2025 odhaduje náklady na podvody se syntetickou identitou. více než $30 miliard ročně, což představuje až 80-85% všech případů podvodů s identitou napříč finančními službami[15][16]. Životní pojišťovny byly zasaženy obzvláště tvrdě: podvodníci jsou známí tím, že zajistit životní pojistku pro fiktivní osobu a pak ji "papírově" zabít, aby si vybrali pojistné plnění pro případ smrti.[17]. Podvodník si například může vytvořit falešného klienta "John Doe", rok platit pojistné a poté podat žádost o pojistné plnění s falešným úmrtním listem a nekrologem o předčasném úmrtí Johna Doe. Protože identita byla pečlivě vytvořena (úvěrová historie, veřejné záznamy atd.), může se žádost o úmrtí jevit jako legitimní - dokud se nenajde skutečné tělo nebo skuteční příbuzní. Než je podvod odhalen, jsou pachatelé dávno pryč i s výplatou.

Syntetická identita je také problémem zdravotní pojištění a pojištění vozidel. Zločinecké kruhy vytvářejí "frankensteinovské" identity tím, že použití čísel sociálního pojištění dětí nebo starších osob (které nemají žádnou úvěrovou historii) v kombinaci se jmény a řidičskými průkazy vygenerovanými umělou inteligencí.[15]. Poté kupují zdravotní pojistky nebo pojistky na auta pro tyto falešné osoby a krátce poté podávají velké žádosti o odškodnění.. Jednou z variant je zřizování syndikátů falešné podniky (fiktivní společnosti) - například fingovaná dopravní společnost - a zakoupení komerčního pojištění pro ni, aby později uplatnila nárok na fingované nehody nebo fingovaná zranění zaměstnanců.[18][19]. Vzhledem k tomu, že podnik existuje pouze na papíře (s obchodními registracemi a daňovými identifikačními čísly generovanými umělou inteligencí). "syntetické podvody založené na subjektech se často objeví až po vyplacení pojistného plnění.[18][20].

Proč jsou syntetické identity tak účinné? Za prvé, často projdou automatickým ověřováním totožnosti. Úvěrové úřady a systémy KYC mohou zjistit. žádné červené vlajky protože identita obsahuje některé skutečné, platné údaje (např. skutečný SSN s čistým záznamem).[21]. Mezitím mohou profilové fotografie a průkazové skeny generované umělou inteligencí vypadat zcela autenticky - dnešní umělá inteligence dokáže vytvořit lidský obličej, který by i pokročilé rozpoznávání obličeje mohlo považovat za skutečný. Výsledek: většina automatických systémů tyto profily rozpozná jako legitimní. a podvod je odhalen (pokud vůbec) až po velkých ztrátách.[22].

Dopad v reálném světě: RGA uvádí, že podvody se syntetickou identitou v životním pojištění nyní stojí odvětví asi $30B ročně. a od roku 2020 vzrostl o téměř 400%[15][16]. Federální obchodní komise USA odhaduje, že naprostou většinu případů podvodů s identitou tvoří syntetické průkazy totožnosti.[16]. Tyto ztráty v konečném důsledku zasáhnou peněženky poctivých pojistníků - každá rodina zaplatí ročně na pojistném odhadem \$700 navíc kvůli většímu zatížení pojišťoven podvody.[15]. Pojišťovny na to reagují posílením ověřování při přijímání a vyřizování pojistných událostí: zavádějí kontroly databází pro propojení identity, sledují, zda na stejné adrese není uzavřeno více pojistných smluv, a dokonce provádějí testy "živosti" (kontroly selfie videí, aby se ujistily, že žadatel o pojistné plnění je skutečná osoba, a ne jen obraz umělé inteligence).[23][24]. Jak ale uvidíme, podvodníci se snaží čelit umělé inteligenci i v další oblasti: falešných hlasech a videích.

Deepfake hlasy a tvrzení o videu

Vytvořené umělou inteligencí audio a video deepfakes dodávají pojistným podvodům nový znepokojivý rozměr. V letech 2023 a 2024 došlo k několika případům, kdy zločinci použili klonování hlasu vydávat se za jednotlivce po telefonu - taktika, která se původně používala při bankovních loupežích (například nechvalně proslulý telefonát s falešným generálním ředitelem, který v roce 2020 ukradl $35 milionů), ale nyní se rozšiřuje i do pojišťovnictví. Podvodníci klonují hlasy pojistníků, lékařů nebo likvidátorů pojistných událostí a používají je při podvodech sociálního inženýrství. Analýza společnosti Pindrop z roku 2024 varovala, že "deepfakes, syntetické hlasové technologie a podvody řízené umělou inteligencí mění podobu podvodného prostředí.", s hlasovým podvodem nebývale rychle se rozšiřuje.[25]. Zjistili, že call centra pojišťoven byla bombardována zahraničními podvodníky, kteří používali hlasové falešné nahrávky: například volali a uváděli ukradené SSN a osobní údaje skutečného pojistníka, a pokud agent odpověděl, tak hlas volajícího naklonovaný umělou inteligencí by mohl oklamat agenta prostřednictvím ověřování založeného na znalostech. a požádat o podvodné vyplacení.[26]. V případě jedné pojišťovny na západním pobřeží USA se útočníci opakovaně pokoušeli touto metodou převzít účty a přesměrovat výplaty, přičemž využívali skutečnosti, že ověření totožnosti v call centru se opíralo o hlas a osobní údaje, které lze podvrhnout.[26].

Vydávání se za hlas se používá i na straně spotřebitelů: Podvodníci volali obětem nehod nebo příjemcům dávek, zatímco předstírání, že jsou zástupci pojišťovny, které používají hlasy umělé inteligence, aby zněly oficiálně, s cílem vylákat citlivé informace nebo dokonce platby. Podvodník se naopak může vydávat za zákazníka na infolince pro vyřizování pojistných událostí, aby podat reklamaci po telefonu pomocí falešného hlasu, který odpovídá pohlaví/věku zákazníka., čímž se obejdou hlasové biometrické kontroly. Nedávné statistiky podvodů jsou střízlivé: odborníci z oboru předpokládají, že se 162% nárůst podvodných útoků proti pojišťovnám typu deepfake v nadcházejícím roce[27]a Pindrop zaznamenal 475% nárůst syntetických hlasových útoků v roce 2024 jak již bylo zmíněno dříve[2]. Tyto útoky rychle překonávají tradiční vektory kybernetických podvodů.

Kromě telefonních hovorů, deepfakes založené na videu se objevují v procesu reklamace. Mnoho pojistitelů zavedlo virtuální prohlídky pojistných událostí a videokonference (urychlené pandemií), aby mohli na dálku ověřovat škody nebo vyslýchat žadatele o pojistné plnění. Nyní se podvodníci využití avatarů umělé inteligence a falešných videí k oklamání těchto ověření.. Objevily se zprávy o žadatelích, kteří používají Avataři generovaní umělou inteligencí v živých videohovorech s upravovateli, aby se vydávali za někoho jiného nebo aby zakryli známky nedůslednosti.[28]. Podvodná skupina může například použít deepfake. "živé" video údajného žadatele, který ukazuje své poškození prostřednictvím chytrého telefonu., i když ve skutečnosti je osoba na kameře složená z umělé inteligence nebo najatého herce s filtry měnícími obličej. Jedním ze spekulativních, ale pravděpodobných scénářů je použití deepfake zemřelý osoba: V případě podvodu s anuitami nebo životním pojištěním by mohl rodinný příslušník během rutinního hovoru o prokázání dožití použít falešné video nedávno zesnulého, aby mohl nadále dostávat výplaty.[29]. Ačkoli zatím nebyl zveřejněn žádný takový případ, pojišťovny se na něj připravují. Regulační orgány také berou na vědomí - v USA a v Evropě probíhají diskuse o zařazení falešných dokladů do kategorie krádeže identity a o aktualizaci pokynů pro ověřování důkazů v pojišťovnictví.[30].

Detekce deepfake videí a zvuků je bez technických nástrojů velmi náročná. Lidé nejsou vycvičeni k tomu, aby rozpoznali jemné problémy se synchronizací rtů nebo akustické zvláštnosti. V některých případech se však objevily varovné signály: například nepřirozené mrkání nebo záškuby obličeje na videu nebo zvukové artefakty na pozadí hovoru, které vyšetřovatele upozornily. Celkově však, deepfake pojistný podvod je stále v počáteční fázi, a stíhání zůstává vzácné - od roku 2023 byly právní definice nejasné a prokázat, že video bylo vytvořeno umělou inteligencí, bylo bez odborné analýzy obtížné.[31]. To dává podvodníkům pocit beztrestnosti. Závody ve zbrojení pokračují: pojišťovny se nyní obracejí na forenzní umělá inteligence v boji proti umělé inteligenci, nasazení algoritmů pro hloubkovou detekci falzifikátů, které zkoumají podezřelá videa snímek po snímku a hledají známky manipulace.[24]. Výrobci hlasové biometrie zavádějí detektory falešného hlasu, které analyzují spektrální vzorce a hlasovou kadenci pro zjištění pravosti.[32]. Těmto obranným technologiím se budeme věnovat v další části.

Phishingové a imitující podvody s využitím umělé inteligence

Ne všechny podvody s využitím umělé inteligence procházejí reklamačním oddělením; některé cíle jsou zákazníci a zaměstnanci prostřednictvím sociálního inženýrství. Phishingové e-maily a texty vytvořené umělou inteligencí se staly hlavní hrozbou v oblasti pojištění. V těchto schématech podvodníci využívají chatboty s umělou inteligencí a překladatelské nástroje k vytváření velmi přesvědčivých podvodných sdělení. Zločinci se například mohou vydávat za značku a styl psaní pojišťovny a rozesílat pojistníkům hromadné phishingové e-maily, v nichž jim sdělují, že "je třeba podniknout naléhavé kroky, aby se zabránilo zrušení pojistky", a odkazují je na falešné webové stránky. Na rozdíl od neohrabaných podvodných e-mailů z minulosti, Umělá inteligence zajišťuje bezchybnou gramatiku a dokonce i personalizaci, což je činí mnohem věrohodnějšími. Viděli jsme, jak se umělá inteligence používá k vyhledávání údajů ze sociálních médií, které se vplétají do spear-phishingových zpráv, například odkaz na nedávný nákup auta ve falešném oznámení o pojištění auta.

Dalším vektorem je Vydávání se za agenty nebo vedoucí pracovníky s pomocí umělé inteligence. Byly zaznamenány případy, kdy podvodníci naklonovali hlas majitele pojišťovací agentury a zanechávali zákazníkům hlasové zprávy s žádostí o aktualizaci bankovních údajů - jednalo se tedy o hlasový phishingový útok. Podobně mohou interní podvody pramenit z vydávání se za umělou inteligenci: finanční oddělení jedné pojišťovny se málem stalo obětí, když podvodníci poslali deepfake zvukovou zprávu údajně od generálního ředitele autorizace převodu finančních prostředků (varianta "CEO podvodu", která je nyní kryta některými pojistnými smlouvami pro případ elektronické kriminality).[33]). Podle společnosti Liberty Specialty Markets vzrostl v roce 2023 počet těchto podvodů řízených umělou inteligencí o 17%.[33], a očekává se, že se bude nadále zvyšovat.

Spotřebitelé se také stávají terčem podvodů se syntetickými médii. vázané na pojištění. Koalice proti pojistným podvodům upozorňuje na případy, kdy se podvodníci vydávají za pojišťovací agenty, kontaktují oběti nehod a tvrdí, že vyřizují jejich pojistnou událost, a pak požadování okamžité platby nebo citlivých údajů[23]. Nic netušící zákazníci, kterým se uleví, když se jim ozve údajný zástupce, mohou vyhovět, zejména pokud volající zná podrobnosti o jejich nehodě (které může AI získat z hackerských nebo veřejných zdrojů). Povědomí veřejnosti o těchto taktikách je nízké, proto odborníci na prevenci podvodů vyzývají pojišťovny, aby informovat pojistníky o ověřování totožnosti volajících a e-mailů.[23][34]. Stejně jako banky varují klienty před phishingem, začínají pojišťovny v roce 2025 do své komunikace zahrnovat varování před deepfake podvody.

Jedním ze společných rysů těchto schémat s podporou umělé inteligence je využívání snadno dostupných sad "podvodů jako služby".[35]. Na temném webu si zločinci mohou koupit nebo si předplatit nástroje, které poskytují předem připravené deepfake hlasy, šablony falešných dokumentů, generátory phishingových e-mailů a další. Tato demokratizace nástrojů umělé inteligence znamená, že i podvodníci s nízkou kvalifikací mohou provádět sofistikované podvodné útoky.[35]. Pro pojišťovny to znamená záplavu přesvědčivějších pokusů o podvod, které přicházejí ze všech stran - z oddělení pojistných událostí, zákaznického servisu, e-mailu i sociálních sítí. Zdůrazňuje to potřebu vícestranné obranné strategie, která kombinuje technologie, lidskou ostražitost a mezioborovou spolupráci.

Detekce a obrana: Reakce na základě umělé inteligence

Boj proti podvodům řízeným umělou inteligencí vyžaduje Obrana řízená umělou inteligencí. Pojišťovny se proti tomuto náporu stále častěji obracejí k pokročilým detekčním technologiím a modernizovaným procesům. Pojišťovny musí v podstatě zakotvit kontrolní body ověřování obsahu v celém životním cyklu pojištění - od upisování přes pojistné události až po interakce se zákazníky - aby bylo možné odhalit padělky umělé inteligence. Obrázek 2 uvádí rozdělení klíčových typů podvodů, které AI umožňuje, a jejich výskyt a následující části podrobně popisují, jak každý z nich odhalit a odvrátit.

Obrázek 2: Typy pojistných podvodů s využitím umělé inteligence v roce 2025 (odhadovaný podíl podle schématu). Mezi nejpočetnější kategorie patří falešné snímky (zfalšované fotografie škod) a syntetické identity, následují dokumenty padělané umělou inteligencí (např. účtenky, certifikáty) a podvody s hluboce falešným zvukem/videem.

1. Nástroje pro detekci obsahu AI: Nové služby detekce umělé inteligence dokáží analyzovat text, obrázky, zvuk a video a určit, zda byly vytvořeny strojově nebo zda s nimi bylo manipulováno. Pojišťovny mohou využít například řešení, jako je např. Detektory textu a obrázků s umělou inteligencí společnosti TruthScan které používají přesnou umělou inteligenci 99%+ k označení dokumentů napsaných umělou inteligencí nebo zfalšovaných fotografií.[36]. Pojišťovna by mohla tyto detektory integrovat do svého systému pro řešení pojistných událostí: při odeslání pojistné události a důkazů k ní může být textový popis automaticky skenován na jazykové vzorce generované umělou inteligencí a všechny nahrané obrázky mohou být skenovány na zřetelné známky CGI nebo úprav. Nástroje podnikové úrovně mohou identifikovat text generovaný umělou inteligencí v dokumentech, e-mailech a komunikaci s přesností 99%.[36]a podobně detekovat obrázky vytvořené umělou inteligencí nebo zmanipulované obrázky, aby se zajistila autenticita vizuálního obsahu.[36]. To znamená, že falešný popis nehody vytvořený službou ChatGPT nebo falešná fotografie škody z poloviny cesty budou označeny k ručnímu přezkoumání před zpracováním pojistné události. Pojišťovny v roce 2025 stále častěji zavádějí takové ověřování obsahu pomocí umělé inteligence - ve skutečnosti, 83% odborníků na boj proti podvodům plánuje do roku 2025 integrovat generativní detekci AIpodle průzkumu ACFE, přičemž v současnosti jej používá pouze 18%.[37][38].

2. Ověřování totožnosti a biometrické kontroly: Aby se pojišťovny vypořádaly se syntetickými identitami, vylepšují také protokoly KYC pomocí umělé inteligence. Služby pro ověřování totožnosti mohou křížově ověřovat údaje žadatelů ve více databázích a využívat rozpoznávání obličeje s testy živosti. Například požadavek na krátkou video selfie během onboardingu (a použití porovnání obličeje s poskytnutým průkazem totožnosti) může zmařit mnoho syntetických identit. Ještě špičkovější technologie nabízejí společnosti jako TruthScan, které se zabývají forenzní analýzou obrazu, jež může profilové fotografie, avatary a syntetické obrazy osobností generované umělou inteligencí. - jejich detektor obrazu AI je vycvičené k identifikaci obličejů vytvořených generátory jako StyleGAN nebo ThisPersonDoesNotExist.[39]. Nasazením těchto nástrojů může pojišťovna zjistit, zda selfie žadatele o životní pojištění není skutečný člověk. Na straně hlasu, hlasové biometrické ověřování pro hovory zákaznického servisu; moderní hlasové detektory AI jsou schopny identifikovat syntetické hlasy a pokusy o klonování hlasu. v reálném čase[40]. Například společnost TruthScan Detekce hlasu AI systém využívá akustickou analýzu k rozpoznat hlasy generované umělou inteligencí a zvukové podvrhy dříve, než oklamou pracovníky call centra.[40]. Tato řešení fungují jako firewall - pokud někdo zavolá a vydává se za neznámého a jeho hlasový otisk se neshoduje s autentickým hlasem neznámého (nebo se shoduje se známými charakteristikami deepfake), hovor může být označen nebo může být požadováno další prokázání totožnosti. Vícefaktorové ověřování (potvrzení e-mailem/SMS, jednorázové přístupové kódy atd.) přidává další překážky, které musí podvodníci překonat.

3. Deepfake Video & Image Forensics: Pokud jde o důkazní video, pojišťovny začínají zavádět specializovanou forenzní analýzu. Pokročilý software dokáže analyzovat metadata videa, konzistenci snímků a úroveň chyb, aby odhalil hluboké podvrhy. Některé nástroje zkoumají odrazy, stíny a fyziologické náznaky (například puls v krku osoby na videu), aby se ujistily, že je video pravé. Forenzní analýza metadat je také cenná: zkoumání metadat souborů a otisků generování v obrázcích nebo PDF může odhalit, zda bylo něco pravděpodobně vytvořeno nástrojem umělé inteligence.[41]. Pojišťovny by měly vyžadovat originální soubory fotografií (které obsahují metadata), a ne například jen snímky obrazovky nebo vytištěné kopie. Tým společnosti Zurich zabývající se podvody zaznamenal úspěch při zachycování falešných snímků automobilů díky tomu, že si všímal anomálií v metadatech snímků a analýze úrovně chyb.[41]. Detektory podvodných e-mailů může také skenovat příchozí komunikaci a hledat známky phishingového obsahu napsaného umělou inteligencí nebo známé škodlivé signatury.[42]. Mnoho pojišťoven nyní v rámci školení zaměstnanců provádí simulace phishingu a příklady podvodů vytvořené umělou inteligencí, aby se zvýšila informovanost.

4. Změny procesů a školení lidí: Samotná technologie není stříbrná kulka. Vylepšení procesů jako jsou častější namátkové osobní kontroly u žádostí s vysokou hodnotou nebo vyžadování fyzické dokumentace v určitých případech. Někteří pojistitelé odložili plně automatizované přímé zpracování pojistných událostí a u pojistných událostí, které dosáhly vysokého skóre v modelu rizika podvodu s umělou inteligencí, znovu zavedli lidskou kontrolu. Na straně lidí je klíčové školení. Vyšetřovatelé a likvidátoři podvodů jsou školeni, aby rozpoznali červené vlajky AI: např. vícenásobné pojistné události používající identické znění (ChatGPT "styl"), obrázky postrádající skutečnou náhodnost (např. opakující se vzory v tom, co by mělo být organickým poškozením) nebo hlasy, které znějí téměř správně, ale s robotickou kadencí. Pojišťovny také vzdělávají zákazníky: rozesílají upozornění na podvodné schéma deepfake a radí, jak ověřit totožnost zástupce pojišťovny (například poskytnutím známého čísla zpětného volání).

5. Úsilí o spolupráci: Spolupráce v rámci celého odvětví se rozšiřuje. Ve Spojeném království vytvořily Úřad pro pojistné podvody a Asociace britských pojistitelů pracovní skupiny pro podvody s umělou inteligencí a vládní agentura Charta pojistných podvodů (2024) podporuje sdílení dat a společné iniciativy[43]. Pojišťovny celosvětově spolupracují s firmami zabývajícími se kybernetickou bezpečností a startupy v oblasti umělé inteligence. Pozoruhodné je, že se objevují nové pojistné produkty: Liberty Mutual uvedla na trh pojištění proti elektronické kriminalitě pro malé a střední podniky, které se vztahuje zejména na podvody typu deepfake a podvody na generálních ředitelích.[44][33], čímž zdůraznil, že toto riziko je velmi reálné. To také znamená, že pojistitelé se mohou ocitnout jak v roli obětí, tak v roli řešitelů podvodů s umělou inteligencí - vyplatí pojistné plnění za podvod s deepfake, pokud nebude odhalen, ale také nabídnou pojistné krytí pro ostatní, kteří se stanou obětí takových útoků.

Integraci detekční technologie do pracovních postupů si lze představit jako vícebodovou obranu v životním cyklu reklamace. Jak je znázorněno v Obrázek 3, mohou pojistitelé vložit kroky ověření umělé inteligence na adrese aplikace politiky (pro kontrolu syntetických identit prostřednictvím dokladů totožnosti a kontroly selfie), na adrese podání reklamace (k automatické analýze nahraných dokumentů, fotografií nebo zvuku pro generování umělé inteligence), během... přezkoumání/vyšetření pojistné události (k provedení hloubkové forenzní analýzy podezřelých důkazů a ověření hlasových interakcí) a těsně předtím, než se výplata (závěrečné ověření totožnosti, aby se zajistilo, že příjemce je legitimní). Včasným zachycením podvodu - ideálně při nástupu do zaměstnání nebo při prvním oznámení škody - pojišťovny ušetří náklady na vyšetřování a zabrání neoprávněnému vyplacení.

Obrázek 3: Integrace bodů detekce AI v životním cyklu pojištění. Při uzavírání pojistné smlouvy se na základě umělé inteligence ověřuje, zda se nejedná o syntetickou nebo falešnou identitu. Při podání pojistné události automatické detektory skenují text pojistné události, dokumenty a obrázky a hledají obsah vytvořený umělou inteligencí. Při kontrole pojistných událostí ověřují specializované nástroje pro hloubkovou analýzu falzifikátů a hlasovou analýzu veškeré audio/video důkazy. Před výplatou se biometrickým ověřením identity potvrdí totožnost příjemce. Tento vícevrstvý přístup pomáhá zachytit podvody ve více fázích.

Pojišťovny nemusí všechny tyto funkce budovat přímo ve firmě - mnohé se obracejí na podniková řešení, jako je např. Sada pro detekci umělé inteligence společnosti TruthScan, která nabízí řadu nástrojů, jež lze integrovat do systémů pojistitelů prostřednictvím rozhraní API. Jedná se například o tzv, Služba umělé inteligence TruthScan pro detekci obrázků a hlubokých falzifikátů lze použít k ověření pravosti obrázků a videí s přesností více než 99%.[45]. Jejich Detektor textu AI označuje text napsaný umělou inteligencí v reklamacích nebo e-mailech.[36], zatímco Detektor hlasu AI umožňuje detekci klonování hlasu a ověření mluvčího, aby se zabránilo podvodníkům.[40]. Existují dokonce i nástroje pro výklenek, jako je např. Detektor falešných účtenek okamžitě analyzovat faktury/účtenky, zda neobsahují známky manipulace nebo písma/rozložení generované umělou inteligencí.[46] - mimořádně užitečné vzhledem k tomu, že v reklamacích se často objevují falešné účty za opravy. Nasazením kombinace těchto nástrojů může pojišťovna výrazně zvýšit míru odhalení podvodů. Jeden pojistitel z žebříčku Fortune 500 uvedl, že zachytil 97% pokusů o deepfake v roce 2024 pomocí vrstevnatého přístupu ke screeningu AI (text, obraz, hlas), a tím zabránit odhadovaným ztrátám ve výši \$20M.[47][48].

Závěr

Umělá inteligence mění bojiště pojistných podvodů v celosvětovém měřítku. Podvodníci inovují generativní umělou inteligenci a vytvářejí lži, které jsou přesvědčivější než kdykoli předtím - od zcela vymyšlených osob a nehod až po vydávání se za osoby, které mohou oklamat i zkušené profesionály. Údaje z let 2024-2025 ukazují alarmující nárůst těchto podvodů poháněných umělou inteligencí, ale také zdůrazňují, že pojistitelé, kteří investují do odhalování a prevence, mohou zůstat o krok napřed. Kombinací špičková technologie detekce umělé inteligence - jako je forenzní analýza obrazu, ověřování hlasu a analýza textu - s aktualizovanými pracovními postupy a vzděláváním může odvětví zmírnit rizika, aniž by se vzdalo efektivity, kterou přinášejí digitální procesy.

V jádru jde o technologické závody ve zbrojení.[49]. Jak poznamenal jeden z odborníků na prevenci podvodů, "V této nové realitě je třeba platit za ostražitost."[50]. Pojišťovny musí podporovat kulturu ostražitosti a využívat nejlepší dostupné nástroje k zachování důvěry v proces likvidace pojistných událostí. To znamená ověřovat pravdivost dokumentů, hlasů a obrázků se stejnou přísností, jakou používají upisovatelé k posuzování rizik. Znamená to také spolupracovat napříč odvětvím na sdílení informací o nových taktikách podvodů s umělou inteligencí a společně vyvíjet standardy (například standardní požadavky na metadata pro předložená média nebo průmyslové černé listiny známých falešných identit).

2025 je bodem zlomu: pojišťovny, které proaktivně se přizpůsobit podvodům řízeným umělou inteligencí. ochrání své zákazníky a rozvahu, zatímco ti, kteří reagují pomalu, se mohou stát terčem podvodů, které se dostanou na titulní stránky novin. Povzbudivou zprávou je, že technologie pro boj proti podvodům existuje a rychle se vyvíjí - stejná umělá inteligence, která posiluje podvodníky, může posílit pojišťovny. Zavedením řešení, jako je multimodální sada pro detekci umělé inteligence TruthScan, která slouží k ověřování pohledávek a identity, mohou pojistitelé výrazně snížit úspěšnost pokusů o podvody generovaných umělou inteligencí.[51][52]. Tímto způsobem nejenže zabrání ztrátám, ale také vyšlou jasný signál potenciálním podvodníkům: nezáleží na tom, jak chytré nástroje používají, podvody budou odhaleny.

Pojistné podvody řízené umělou inteligencí představují obrovskou výzvu, které však lze čelit stejně inteligentní obranou. Díky ostražitosti, mezioborové strategii a správným technologickým partnerům může pojišťovnictví i nadále dodržovat základní slib, který je jádrem jeho podnikání - vyplácet pouze oprávněné pojistné události, a to rychle a bezpečně ve stále digitálnějším světě.

Odkazy:

- Asociace britských pojistitelů - Statistiky podvodů v roce 2023[53][54]

- Allianz a Zurich o nárůstu pojistných událostí způsobených umělou inteligencí - The Guardian, 2024[4][11]

- Facia.ai - "Deepfake Insurance Fraud: Jak umělá inteligence přepisuje pravidla," Říjen 2025[55][56]

- Koalice proti pojistným podvodům - Syntetické podvody v pojišťovnictví (Quantexa), prosinec 2024[21][17]

- RGA - "Nová hranice boje proti podvodům: syntetické identity," červen 2025[15][16]

- Pindrop - Zpráva o podvodech s hlasem, přes FierceHealthcare, červen 2025[2][3]

- Obrácení čísel - "Top finanční podvody 2025," Říjen 2025[1][57]

- TruthScan - AI Detection Platform (přehled služeb), 2025[51][52]

- TruthScan - Stránka produktu AI Image Detector, 2025[45][39]

- TruthScan - Stránka produktu AI Voice Detector, 2025[40]

- TruthScan - Stránka produktu Detektor falešných účtenek, 2025[46]

- Liberty Specialty Markets - Tisková zpráva pojišťovny Deepfake/Cyber Fraud Insurance, Březen 2025[33]

- Facia.ai - Blog: Blog: Závody v prevenci pojistných podvodů, 2025[24][32]

- Pojišťovnictví ve Velké Británii - "Obrázky generované umělou inteligencí slouží k podvodům s motorovými vozidly," duben 2025[7][58]

- The Guardian - "Falešné fotografie poškození vozu alarmují pojišťovny," květen 2024[9][12]

[1] [35] [57] 2025 Finanční podvody: Hrozby a varovné signály umělé inteligence

https://www.turningnumbers.com/blog/top-financial-fraud-schemes-of-2025

[2] [3] [25] [26] Pojistné podvody v roce 2024 vzrostly o 19% z hlasových útoků

https://www.fiercehealthcare.com/payers/insurance-fraud-increased-19-synthetic-voice-attacks-2024

[4] [9] [10] [11] [12] Podvodníci upravují fotografie vozidel a přidávají do nich falešné škody v rámci pojistného podvodu ve Spojeném království | Pojišťovnictví | The Guardian

[5] [6] [7] [8] [43] [53] [54] [58] Obrázky generované umělou inteligencí se nyní používají k podvodům v pojištění motorových vozidel - zpráva | Insurance Business UK

[13] [14] [15] [16] Nová hranice boje proti podvodům: syntetické identity a závody v umělé inteligenci | RGA

[17] [18] [19] [20] [21] [22] JIFA: Syntetický podvod: JIFA: Pojišťovny musí myslet více jako banky, protože syntetické podvody jsou již v jejich ekosystému - InsuranceFraud.org

https://insurancefraud.org/publications/jifa-synthetic-fraud/

[23] [24] [28] [29] [30] [31] [32] [34] [41] [49] [50] [55] [56] Pojistný podvod Deepfake: Jak umělá inteligence přepisuje pravidla pojistných událostí?

https://facia.ai/blog/deepfake-insurance-fraud-how-ai-is-rewriting-the-rules-of-insurance-claims/

[27] [48] Tichá hrozba: Proč se pojistné podvody přesouvají na telefonní linku?

https://www.modulate.ai/blog/the-silent-threat-why-insurance-fraud-is-moving-to-the-phone-line

[33] [44] Pojištění proti elektronické kriminalitě pro malé a střední podniky zaměřené na podvody generálních ředitelů a deepfakes - LSM | Insurance Business UK

[36] [42] [51] TruthScan - Podniková detekce umělé inteligence a zabezpečení obsahu

[37] Studie: Studie: 8 z 10 firem bojujících proti podvodům očekává, že do roku 2025 nasadí generativní umělou inteligenci

[38] Poznatky ze srovnávací zprávy o technologiích pro boj proti podvodům pro rok 2024

[39] [45] Detektor obrázků s umělou inteligencí | Spot Fake & Manipulated Photos - TruthScan

https://truthscan.com/ai-image-detector

[40] [52] Detektor hlasu s umělou inteligencí pro hluboké podvrhy a klonování hlasu | TruthScan

https://truthscan.com/ai-voice-detector

[46] Detektor falešných účtenek TruthScan | Ověření pravosti účtenky

https://truthscan.com/fake-receipt-detector

[47] Pojišťovna Fortune 500 odhalila 97% hlubokých podvrhů a zastavila syntetické...