Um guia abrangente para entender, detectar e prevenir fraudes de voz com IA na empresa

A chamada de voz de $25 milhões que nunca aconteceu

Em fevereiro de 2024, uma funcionária do setor financeiro de uma empresa multinacional em Hong Kong recebeu uma chamada de vídeo de seu CFO.

A voz do outro lado era inconfundível; cada inflexão, cada pausa e até mesmo o leve sotaque foram reconhecidos instantaneamente.

Ele solicitou que ela processasse com urgência 15 transferências eletrônicas, totalizando $25 milhões, para finalizar uma aquisição confidencial.

Nunca mais se preocupe com fraudes de IA. TruthScan Pode lhe ajudar:

- Detectar IA gerada imagens, texto, voz e vídeo.

- Evitar grande fraude impulsionada por IA.

- Proteja seus mais sensível ativos da empresa.

O CFO nunca fez essa chamada. Ela foi totalmente gerada por IA.

Esse não foi um caso isolado. As instituições financeiras estão observando um aumento acentuado nas fraudes de deepfake.

Nos últimos três anos, os casos aumentaram em 2.137%, e a IA agora é responsável por 42,5% de todas as tentativas de fraude no setor.

Mesmo com o aumento da fraude de voz por IA, mais da metade dos líderes empresariais admite que seus funcionários não foram treinados para identificar ou responder a ataques de deepfake; quase 80% das empresas não têm protocolos formais para lidar com esses incidentes.

Como funciona a clonagem de voz por IA e por que ela é uma ameaça

A síntese de voz da IA moderna precisa de surpreendentemente poucos dados. Apenas alguns segundos de áudio podem clonar uma voz com precisão de até 85%.

O processo se resume a três etapas principais:

- Coleta de dados: Os golpistas coletam amostras de voz de fontes públicas, como chamadas em conferência, entrevistas em podcast, clipes de mídia social ou até mesmo postagens de vídeo no LinkedIn.

- Treinamento de modelos: A IA analisa características vocais como tom, timbre, sotaque, ritmo e padrões de respiração.

- Geração: O sistema cria uma fala sintética convincente o suficiente para enganar até mesmo colegas próximos.

O problema da acessibilidade

O que torna essa ameaça ainda mais perigosa é sua democratização. Os golpistas não precisam mais de recursos de nível hollywoodiano.

Tudo o que é necessário é um software acessível para clonar uma voz a partir de um clipe curto de mídia social. Muitas ferramentas disponíveis publicamente, inclusive ferramentas de nível de consumidor Texto para fala com IA podem ser usadas indevidamente para gerar áudio sintético convincente.

Por que os executivos são os principais alvos de fraude

Os executivos enfrentam uma combinação perigosa de fatores de risco.

Sua exposição pública por meio das mídias sociais torna as amostras de voz fáceis de encontrar, e sua autoridade geralmente leva os funcionários a agir rapidamente em solicitações urgentes.

Em média, um em cada quatro executivos tem um entendimento limitado da tecnologia deepfake.

As estatísticas atuais mostram um quadro preocupante

Em um Pesquisa da Deloitte de 2024Em uma pesquisa realizada em 2008, 25,9% dos executivos disseram que suas organizações enfrentaram pelo menos um incidente de deepfake direcionado a dados financeiros ou contábeis no ano passado, e metade de todos os entrevistados acreditava que esses ataques cresceriam nos próximos 12 meses.

O mais preocupante: apenas 52% das organizações se sentem confiantes de que poderiam identificar um deepfake de seu CEO.

Como identificar golpes de voz com IA

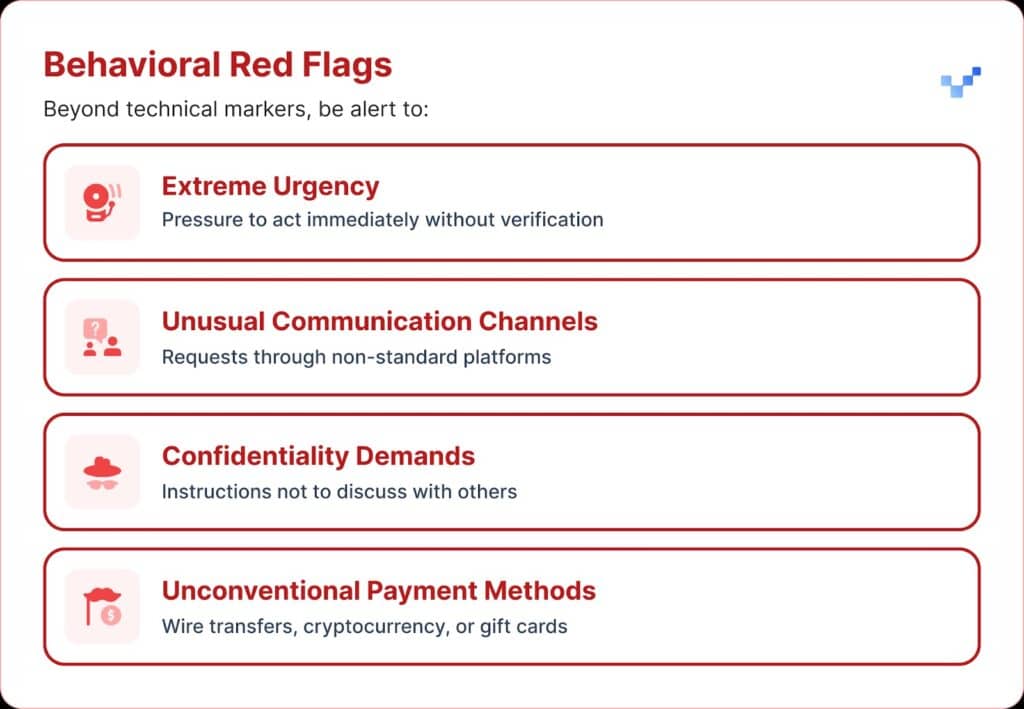

Quando você recebe uma comunicação de voz suspeita, há alguns sinais de alerta a serem observados.

Os golpes de voz de IA geralmente soam monótonos ou sem brilho. Você também pode notar um ritmo incomum, com pausas estranhas ou um ritmo não natural.

O áudio também pode apresentar zumbidos ou ecos eletrônicos fracos, especialmente durante chamadas mais longas.

E, em muitos casos, a voz repete frases limitadas que parecem ter sido escritas ou ensaiadas.

Impacto financeiro e quanto realmente custa

A maioria das organizações perdeu cerca de $450.000 em média, mas no setor de serviços financeiros as perdas subiram para mais de $603.000.

E nos casos mais graves, 1 em cada 10 organizações relatou perdas de mais de $1 milhão.

Essa tendência tem crescido rapidamente. Pesquisas anteriores de 2022 indicavam que o ônus financeiro médio da fraude de identidade era de cerca de $230.000, quase a metade do valor atual.

Perdas futuras projetadas

De acordo com o Centro de Serviços Financeiros da Deloitte, o dinheiro perdido com fraudes de IA nos EUA pode aumentar de $12,3 bilhões em 2023 para $40 bilhões até 2027. Isso representa um crescimento de cerca de 32% por ano.

Vulnerabilidade regional

A América do Norte registrou um aumento de 1740% na fraude deepfake.

Esse aumento regional significativo sugere que a América do Norte pode ser o principal alvo dos fraudadores de deepfake, provavelmente devido à sua grande economia digital e ao uso generalizado de serviços on-line.

Abordagens estratégicas para a proteção de executivos

1. Implementar protocolos de verificação

Uma maneira de fortalecer as defesas é usar um sistema de "palavras seguras", frases de autenticação pré-acordadas compartilhadas com o pessoal-chave.

Um golpista que usa clonagem de voz por IA não saberá as respostas certas para as perguntas de verificação pessoal.

Outra proteção é a verificação multicanal.

Qualquer solicitação financeira incomum deve ser confirmada por meio de um canal de comunicação separado, nunca confiando apenas no método de contato original.

As empresas também devem estabelecer regras claras de escalonamento, com períodos de espera e etapas de aprovação para grandes transações financeiras, independentemente de quem as solicite.

2. Cuidado com a exposição digital

Outra camada de proteção consiste em limitar a quantidade de áudio e vídeo executivo disponível on-line. Quanto mais amostras os golpistas puderem coletar, mais convincentes se tornarão seus clones.

Também é útil definir diretrizes claras de mídia social para os executivos, especialmente em relação à publicação de vídeos com áudio limpo.

E, quando se trata de conferências, as organizações devem estar atentas a palestras ou entrevistas gravadas que forneçam longos trechos de amostras de voz.

3. Implementar soluções técnicas

É nesse ponto que a tecnologia avançada de detecção de IA se torna essencial.

As organizações precisam de autenticação de voz de nível empresarial e detecção de deepfake recursos que fornecem:

- Análise em tempo real: Detectar vozes sintéticas durante comunicações ao vivo

- Verificação histórica: Analisar a autenticidade de chamadas e mensagens gravadas

- Capacidades de integração: Trabalhar perfeitamente com as plataformas de comunicação existentes

- Altos índices de precisão: Minimize os falsos positivos e detecte falsificações sofisticadas

4. Programas de treinamento abrangentes

As equipes de liderança precisam de treinamento direcionado sobre ameaças de voz de IA e procedimentos de verificação.

Igualmente importante é aumentar a conscientização dos funcionários.

Todos, em qualquer função, devem estar preparados para identificar possíveis deepfakes e impedir que ameaças cibernéticas entrem na organização.

Exercícios regulares de simulação podem fortalecer essa prontidão usando tentativas simuladas de fraude por voz para testar e refinar os procedimentos de resposta.

Soluções avançadas de detecção de voz com IA

As defesas tradicionais foram criadas para ameaças baseadas em rede, não para a personificação humana com tecnologia de IA.

Os principais motivos pelos quais as ferramentas padrão de segurança cibernética não conseguem lidar com a engenharia social baseada em voz:

- Sem assinatura de malware: As chamadas de voz não acionam os sistemas de segurança tradicionais

- Fator de confiança humana: As pessoas confiam naturalmente no que ouvem, especialmente em vozes familiares

- Lacunas na tecnologia de detecção: Apesar do aumento das tentativas de fraude orientadas por IA, incluindo deepfakes, apenas 22% das instituições financeiras implementaram ferramentas de prevenção de fraudes baseadas em IA

A necessidade de uma detecção de voz especializada

A fraude de voz moderna exige recursos de detecção modernos.

De nível empresarial Sistemas de detecção de voz com IA pode:

- Analisar biomarcadores vocais: Detectar inconsistências sutis na fala sintética

- Processamento em tempo real: Fornecer alertas imediatos durante chamadas suspeitas

- Aprendizado contínuo: Adaptar-se a novas técnicas de síntese de voz

- Pronto para integração: Trabalhar com a infraestrutura de comunicação existente

As organizações que pretendem se proteger contra a fraude de voz precisam investir em uma tecnologia de detecção de IA desenvolvida especificamente para atender à sofisticação das ameaças que enfrentam.

A fraude de voz já existe e está aumentando

No primeiro trimestre de 2025, a fraude deepfake e o roubo de identidade causaram mais de $200 milhões em perdas.

O phishing de voz com clones de IA aumentou 442%, e mais de 400 empresas por dia estão sendo atingidas por golpes de deepfake de CEO ou CFO.

Embora 56% das empresas digam que se sentem muito confiantes em identificar deepfakes, apenas 6% realmente evitaram sofrer perdas financeiras com elas.

O que importa não é se sua organização será alvo, mas se você está preparado para isso.

A fraude por voz está mudando a face da segurança cibernética. As defesas tradicionais não conseguem acompanhar a falsificação de identidade com tecnologia de IA.

Para se manterem protegidas, as organizações precisam de melhores ferramentas de detecção, programas de treinamento sólidos e procedimentos de verificação claros.

A tecnologia para reagir já está aqui. A verdadeira questão é se você a usará antes ou depois do seu primeiro incidente de fraude de voz.