Introdução

A IA generativa está revolucionando o setor de saúde - e nem sempre para melhor. Em 2025, os esquemas de fraude no setor de saúde cresceram mais digital e sofisticado, impulsionado por violações de dados, automação e IA generativa[1]. Os criminosos estão explorando ferramentas de IA para criar identidades falsas de pacientes, reivindicações sintéticas de seguro, documentos médicos gerados por IA, prescrições forjadas e até mesmo interações médico-paciente falsas. Esses enganos de alta tecnologia elevam a fraude a novos patamares, ameaçando as finanças das seguradoras e a segurança dos pacientes em todo o mundo. O desafio é enorme: a fraude no setor de saúde já custa dezenas de bilhões anualmente, e o aumento da IA está intensificando tanto a escala quanto a complexidade de golpes[2][3]. Este whitepaper fornece uma visão detalhada das últimas tendências de fraude orientada por IA no setor de saúde, casos reais de 2025 e estratégias - desde detectores de conteúdo de IA até verificação de identidade - para combater essa ameaça em evolução.

O surgimento de esquemas de fraude habilitados por IA no setor de saúde

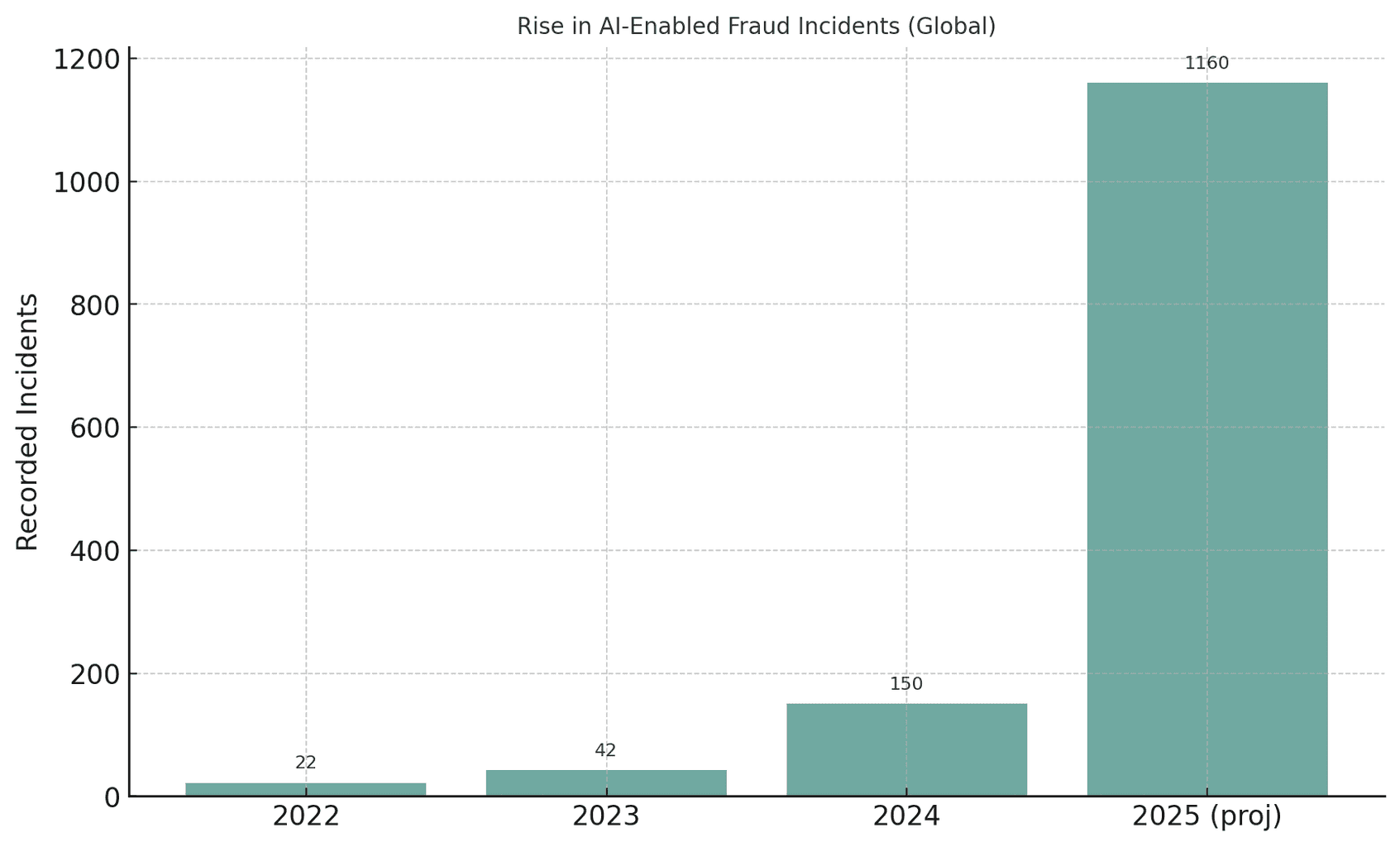

O setor de saúde global está passando por um aumento sem precedentes nas tentativas de fraude com tecnologia de IA. À medida que a IA generativa se torna acessível, os fraudadores podem automatizar o que costumava ser golpes manuais, produzindo identidades, documentos e até vozes ou vídeos falsos convincentes em escala. Por exemplo, as autoridades observaram que tentativas de fraude envolvendo mídia deepfake aumentaram em 3.000% em 2023 sozinho[4][5]. Os incidentes relacionados a deepfake quase dobraram de 22 em 2022 para 42 em 2023, depois explodiram para 150 incidentes em 2024; surpreendentemente, o primeiro trimestre de 2025 registrou 179 casos de fraude deepfake - já excedendo o total de 2024[6][7]. Essa tendência sugere uma crescimento desenfreado de fraudes impulsionadas por IAOs analistas preveem que a IA generativa poderá gerar perdas por fraude de $12,3 bilhões em 2023 para $40 bilhões em 2027 (32% CAGR)[8].

Figura: O crescimento explosivo de incidentes de fraude habilitados por IA nos últimos anos. Os casos detectados de deepfake ou de fraude assistida por IA aumentaram drasticamente de 2022 a 2025, ilustrando como as ferramentas de IA generativas sobrecarregaram as tentativas de fraude[4][7].

Nunca mais se preocupe com fraudes de IA. TruthScan Pode lhe ajudar:

- Detectar IA gerada imagens, texto, voz e vídeo.

- Evitar grande fraude impulsionada por IA.

- Proteja seus mais sensível ativos da empresa.

O setor de saúde é particularmente vulnerável a essa onda de crimes alimentada por IA. O vasto e fragmentado ecossistema do setor - que abrange hospitais, clínicas, seguradoras, farmácias e plataformas de telessaúde - oferece milhares de pontos de ataque[9][10]. Os golpes tradicionais (por exemplo, cartões de seguro falsos ou IDs de pacientes roubados) têm evoluiu para a exploração sistêmica usando IA[10][11]. Em uma ação judicial nos EUA em 2025, o Departamento de Justiça acusou 324 réus em esquemas que totalizavam $14,6 bilhões em alegações falsas - o maior caso de fraude no setor de saúde de todos os tempos[12][13]. Muitos golpes envolviam consultas de telemedicina e fraudes em testes genéticos, e um novo relatório do DOJ Centro de fusão de dados sobre fraudes no setor de saúde usou a análise de IA para detectar padrões de forma proativa[14][15]. Claramente, a IA é uma faca de dois gumes: ela está ajudando os investigadores a capturar fraudes, mas também permitindo que os criminosos cometam fraudes em escala e sofisticação sem precedentes[11][2].

Técnicas comuns de fraude orientadas por IA no setor de saúde (2025)

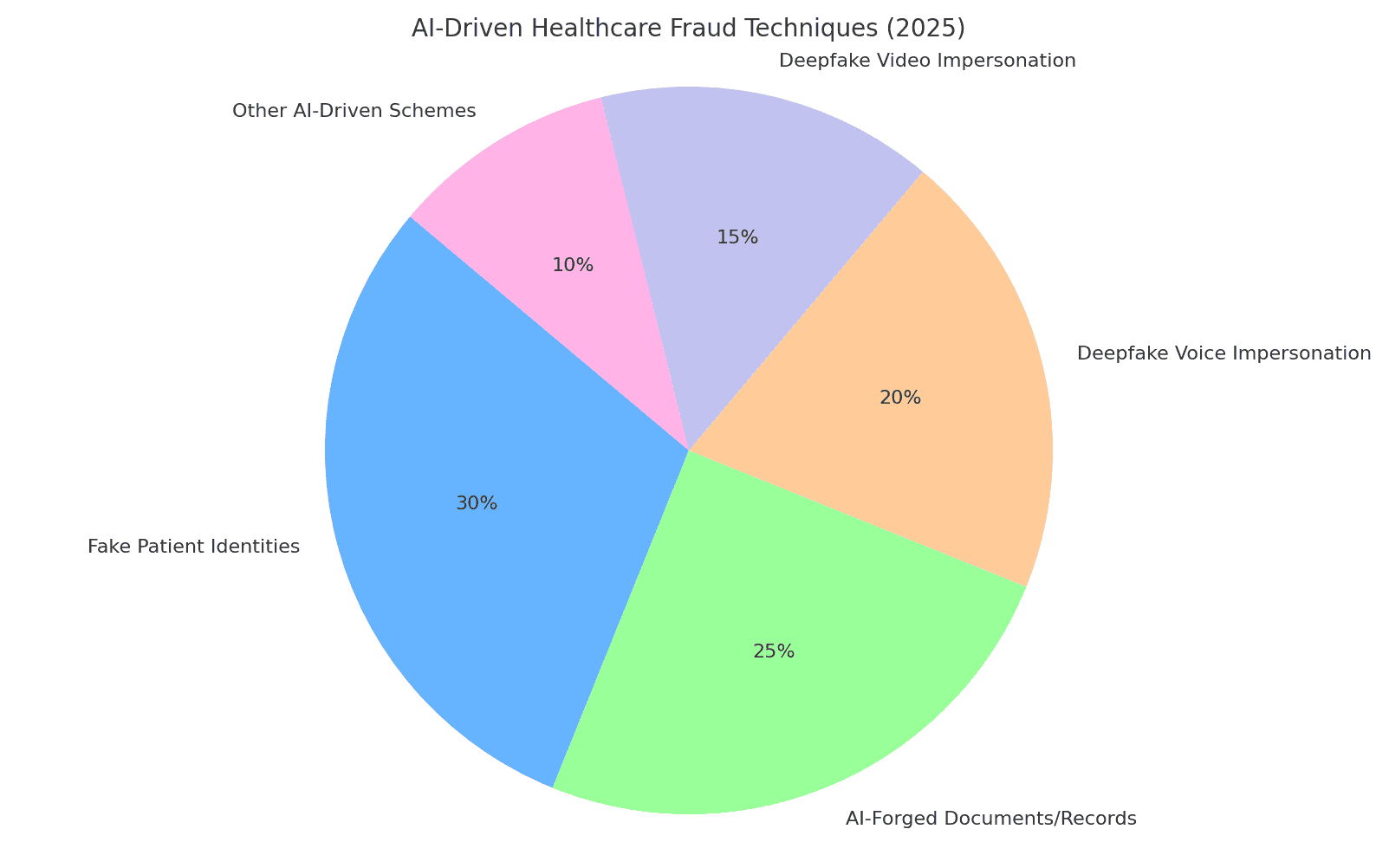

Os fraudadores em 2025 têm uma caixa de ferramentas de táticas habilitadas por IA para fraudar sistemas de saúde e seguradoras. Os principais esquemas incluem a falsificação de identidades e documentos, a geração de dados médicos falsos e a representação de pessoal confiável por meio de deepfakes. Abaixo, detalhamos as técnicas de fraude orientadas por IA mais predominantes e como elas são usadas contra organizações de saúde:

Figura: Detalhamento das principais técnicas de fraude no setor de saúde impulsionadas por IA em 2025. Identidades falsas de pacientes e Documentos forjados por IA (por exemplo, registros médicos, reivindicações) compreendem uma grande parte dos esquemas, enquanto o deepfake voz e imitações em vídeo são uma ameaça que cresce rapidamente. "Outros esquemas orientados por IA" incluem e-mails de phishing criados por IA, bots que atacam portais de pacientes e explorações semelhantes (porcentagens estimadas com base em relatórios do setor[8][16]).

Identidades sintéticas de pacientes

Identidades falsas de pacientes - muitas vezes criados com a ajuda da IA - são uma tática fundamental de fraude. Em vez de roubar a identidade de uma pessoa, os criminosos combinam dados reais de várias pessoas com detalhes fabricados para criar identidades sintéticas que se passam por novos pacientes[17][18]. A IA generativa acelera isso produzindo registros pessoais realistas. Por exemplo, a IA pode gerar registros pessoais plausíveis. IDs, perfis e até mesmo históricos familiares ("pais sintéticos") para um paciente falso[19][20]. Esses pacientes fantasmas são então usados para abrir contas, obter apólices de seguro ou cobrar por serviços que nunca ocorreu. Durante a pandemia da COVID-19, os fraudadores usaram identidades sintéticas para obter benefícios de saúde emergenciais; agora eles as usam para registrar falsas reivindicações de seguro ou obter prescriçõesSabendo que uma identidade bem elaborada pode evitar a detecção[21][22]. De acordo com o U.S. Federal Reserve, as perdas com fraudes de identidade sintética chegaram a $35 bilhões em 2023 e continuam a crescer[23]. O impacto na área da saúde é grave: os golpistas podem usar o número do Seguro Social roubado de uma criança para criar um paciente falso com crédito perfeito, ou misturar dados roubados de pacientes para contornar a verificação da seguradora[17][24]. Cada paciente sintético introduzido no sistema prejudica a integridade dos dados e pode levar a pagamentos indevidos ou até mesmo erros clínicos, se a identidade falsa for entrelaçada com registros médicos reais.

Documentos médicos e solicitações de seguro gerados por IA

A IA generativa agora está sendo usada para forjar documentos médicos, registros e reivindicações completas de seguro. Os modelos de linguagem podem produzir anotações médicas de aparência autêntica, resumos de alta, resultados de laboratório ou declarações de faturamento repletas de jargões médicos - tudo feito sob medida para apoiar uma reivindicação fraudulenta. De fato, observadores do setor relatam um 89% aumento de documentos médicos gerados por IA que está sendo apresentado, em comparação com anos anteriores[25][26]. Os golpistas aproveitam esses registros falsos para justificar procedimentos ou medicamentos caros que nunca foram fornecidos, ou para inflar os códigos de reembolso. Por exemplo, uma IA poderia gerar um registro falso de relatório de diagnóstico por imagem ou resultado de laboratório para comprovar uma reivindicação de alto custo para medicamentos oncológicos. As seguradoras e os sistemas de saúde enfrentam uma enxurrada de reclamações desse tipo. papelada sintéticatornando mais difícil distinguir sinistros legítimos de falsos. No Reino Unido, as seguradoras observam um aumento rápido do uso de deepfakes e documentos adulterados em fraudes de sinistrosA empresa, muitas vezes em reivindicações aparentemente rotineiras e de baixo valor para evitar o escrutínio[27]. Mesmo as imagens clínicas não estão imunes - há evidências de que Fraudadores usam IA generativa para imitar imagens médicas como raios X ou exames[3]. As consequências vão além da perda financeira: se registros médicos falsificados entrarem nos arquivos dos pacientes, eles podem levar a diagnósticos errados ou tratamentos inadequados. Portanto, Documentos de saúde redigidos por IA representam um sério risco à integridade e à segurança.

Prescrições falsas e fraude farmacêutica

A fraude de prescrição entrou na era digital com a IA. Prescrições falsificadas - tradicionalmente feitas com blocos de receitas roubados ou edição rudimentar, agora podem ser geradas automaticamente com detalhes realistas e assinaturas de médicos. Os geradores de imagens ou modelos de IA tornam trivial a criação de impressões de prescrições eletrônicas com aparência autêntica ou formulários de pedidos de farmácia. Mais insidiosamente, os criminosos usam clonagem de voz para se passar por médicos em ligações com farmacêuticos. Em uma tendência relatada, os golpistas invadiram os registros médicos para roubar os números de registro DEA dos médicos e, em seguida, usaram essas credenciais para enviar prescrições eletrônicas de substâncias controladas[28]. Houve casos de Deepfakes de voz com IA usados para autorizar recargas - um farmacêutico recebe uma ligação que soa exatamente como um médico conhecido confirmando uma receita, mas na verdade é uma voz gerada por IA. Como resultado, medicamentos controlados (como opioides ou estimulantes) podem ser obtidos e desviados ilegalmente. A fraude de prescrição forjada não só causa perdas financeiras para as seguradoras e farmácias, mas também coloca em risco os pacientes, que podem receber medicamentos incorretos em seus registros. Por exemplo, se um fraudador se passar por um paciente para obter prescrições de opioides, o o arquivo médico de um paciente real pode ser atualizado com medicamentos que ele nunca tomou, levando a interações perigosas ou sinalizando-o como um usuário de drogas[29]. Essa combinação de crime cibernético e exploração de IA gerou alertas dos órgãos reguladores. As organizações de saúde agora precisam verificar se cada prescrição, especialmente de medicamentos de alto risco, é legítima e realmente provenientes do provedor autorizadoNão se trata de um deepfake ou violação de dados.

Imitações Deepfake de médico e paciente

Talvez o desenvolvimento que mais chame a atenção seja o uso de deepfakes para se passar por profissionais de saúde ou pacientes. Nas configurações de telemedicina e atendimento ao cliente, os golpistas utilizam vídeo e áudio gerados por IA para enganar as pessoas do outro lado. Por exemplo, os criminosos criaram vídeos deepfake de pacientes para consultas de telessaúde, enganando os médicos para que forneçam "tratamento" ou encaminhamentos que depois são cobrados do seguro[30][31]. Por outro lado, um golpista pode falsificar a imagem de um médico - usando o rosto e a voz de um médico de boa reputação - em uma chamada de vídeo para convencer um paciente a pagar por um serviço fraudulento ou divulgar informações pessoais. Os especialistas em TI do setor de saúde alertam que a telessaúde se tornou um alvo fácil: é possível agendar uma consulta virtual usando uma identidade falsa de paciente e, em seguida, fazer com que um avatar de IA apareça no vídeo para obter prescrições ou orientações médicas sob falsos pretextos[31][32]. Além da telemedicina, os deepfakes estão saturando as mídias sociais na forma de Vídeos de "médicos" promovendo curas milagrosas. Em 2024, os especialistas observaram que os vídeos deepfaked de médicos famosos "realmente decolou," visando o público mais velho com dicas de saúde falsas e produtos fraudulentos[33][34]. Médicos confiáveis da TV no Reino Unido e na França tiveram suas imagens clonadas para endossar falsos remédios para diabetes e suplementos para pressão arterial[35][36]. Até a metade dos espectadores não conseguiu perceber que esses vídeos médicos deepfake eram falsos[37]. Essa erosão da verdade tem custos tangíveis: os pacientes podem seguir conselhos prejudiciais de um vídeo falso de um médico, ou os golpistas podem cobrar das seguradoras por consultas que nunca aconteceram, exceto por uma gravação deepfake. Ao todo, A falsificação de identidade orientada por IA prejudica a confiança fundamental nas interações de saúde - Se você não puder confiar que a pessoa na tela ou no telefone é quem ela diz ser, todo o sistema estará em risco.

Impacto e escala: a fraude de 2025 em números

As fraudes baseadas em IA não são mais uma questão marginal, mas sim uma grande ameaça financeira e de segurança nos sistemas de saúde globais. Considere as seguintes estatísticas e casos recentes que ilustram a escala do problema:

- Perdas anuais: Estima-se que a fraude no setor de saúde custe aos EUA $68 bilhões ou mais a cada ano[25]aproximadamente 3-10% de todas as despesas com saúde[38]. Globalmente, a fraude pode consumir cerca de 6% de gastos com saúde[39] - um número surpreendente, considerando que os gastos com saúde em todo o mundo são de trilhões de dólares. Em última análise, essas perdas se traduzem em prêmios mais altos, aumento dos custos hospitalares e redução dos recursos para o atendimento ao paciente.

- Aumento de fraudes em 2023-2025: O advento da IA generativa levou a uma explosão de tentativas de fraude. Os incidentes de fraude relacionados a deepfake aumentaram dez vezes mais de 2022 a 2023[4]. Em 2024, os incidentes de deepfake registrados saltaram para 150 (um aumento de 257%)[40]e 2025 está no caminho certo para superar esse número (580 incidentes apenas na primeira metade de 2025, quase 4 vezes o total de 2024)[7]. Os especialistas em fraudes observam que 46% encontraram fraudes de identificação sintética, 37% deepfakes de voz e 29% deepfakes de vídeo em suas investigações[8] - destacando como essas técnicas de IA se tornaram comuns.

- Takedowns que batem recordes: As agências de fiscalização estão respondendo com repressões maiores. Em junho de 2025, o DOJ dos EUA anunciou a a maior apreensão de fraude no setor de saúde da história, acusando 324 indivíduos e descobrindo $14,6 bilhões em reivindicações fraudulentas[1][13]. Os esquemas incluíam golpes de consultas de telessaúde, fraudes em testes genéticos e fraudes com equipamentos médicos duráveis em grande escala[13]. Como parte desse esforço, o Medicare suspendeu $4 bilhões em pagamentos pendentes consideradas suspeitas[41]e evitar essas perdas. Um caso fundamental ("Operação Gold Rush") revelou uma rede internacional que usava identidades roubadas para registrar $10,6 bilhões em alegações falsas para suprimentos médicos[42] - uma prova de quão longe os criminosos irão quando armados com dados violados e automação.

- Impactos sobre as seguradoras: As seguradoras de todo o mundo estão observando um aumento de fraudes relacionadas à IA. No Reino Unido, as seguradoras relatam que as falsificações profundas são cada vez mais usadas em sinistros (geralmente sinistros de "baixo contato" para evitar a detecção)[27]. Uma importante empresa de resseguros adverte que registros médicos falsificados e condições de saúde profundamente falsas estão prejudicando a subscrição e podem aumentar as perdas com seguros de vida e saúde[43]. Uma análise da Deloitte de 2024 projetou que até 2027, fraudes geradas por IA podem ser responsáveis por $40 bilhões em perdas anuais nos EUA. (acima de $12,3 bilhões em 2023)[8]. Essa trajetória implica um impacto significativo nos resultados das seguradoras se não forem adotadas contramedidas robustas.

- Vítimas de pacientes: Os pacientes e o público também estão perdendo dinheiro com esses golpes. Os adultos mais velhos, em particular, têm sido alvo de golpes de voz de IA (chamadas telefônicas para "netos em perigo") e golpes de saúde deepfake. Em 2023, os idosos dos EUA relataram $3,4 bilhões em perdas por fraude, um aumento de 11% em relação ao ano anterior[44][45] - parte disso impulsionada por esquemas aprimorados por IA. E além do custo monetário, há um custo humanoA IA pode ser usada para criar um ambiente de trabalho mais seguro e seguro: orientações médicas fraudulentas e tratamentos falsos anunciados por meio de IA podem causar danos físicos ou perda de confiança em orientações legítimas de saúde.

Em geral, 2025 deixou claro que A IA está turbinando a fraude tradicional no setor de saúde. O que costumava ser esquemas menores e oportunistas se transformou em operações industrializadas que abrangem continentes. A combinação de big data (geralmente de violações) e geração de IA significa que os golpes podem ser implantados com velocidade e plausibilidade assustadoras. As perdas globais são da ordem de dezenas de bilhões e estão aumentandoA indústria de seguros está em risco, e todas as partes interessadas - de hospitais e seguradoras a pacientes - estão em risco. A próxima seção discute como o setor pode reagir usando tecnologias e estratégias igualmente avançadas.

Defesa contra fraudes orientadas por IA: Estratégias e soluções

O enfrentamento da fraude no setor de saúde habilitada por IA exige um arsenal de defesas igualmente avançadas. Os executivos do setor de saúde, as equipes de segurança cibernética, os diretores de conformidade e as seguradoras devem se coordenar para Incorporar medidas antifraude em todos os pontos vulneráveis - desde a integração do paciente até o pagamento de sinistros. Abaixo estão as principais estratégias e soluções técnicas para combater a fraude orientada por IA:

- Ferramentas de detecção de conteúdo de IA: Assim como os criminosos usam a IA para fabricar conteúdo, as organizações podem usar a IA para detectá-lo. Avançado Detectores de conteúdo escrito por IA (como o conjunto da TruthScan) analisam texto, imagens, áudio e vídeo para identificar sinais reveladores de geração de IA. Por exemplo, a plataforma do TruthScan aplica o aprendizado de máquina para identificar os padrões estatísticos e as peculiaridades linguísticas que indicam texto gerado por IA com mais de Precisão do 99%[46][47]. Essas ferramentas podem ser integradas a sistemas de gerenciamento de reclamações ou registros eletrônicos de saúde para sinalizar automaticamente documentos suspeitos - por exemplo, um relatório médico que provavelmente foi escrito pelo ChatGPT - para revisão manual. Da mesma forma, a análise forense de imagens com IA pode detectar exames médicos manipulados ou identidades falsas, e os algoritmos de detecção de deepfake podem analisar vídeos em busca de sinais de síntese (artefatos em pixels, tempo estranho de movimentos faciais etc.)[48][49]. Ao implantar detectores de IA multimodais, as organizações de saúde podem filtrar uma grande parte do conteúdo forjado por IA em tempo real antes que cause danos.

- Verificação de registros médicos e documentos: Os provedores de serviços de saúde estão recorrendo a soluções especializadas para verificar a autenticidade dos registros e documentos de reclamações. Isso inclui hashing e assinatura digital de registros legítimos, bem como o uso de bancos de dados de modelos de documentos conhecidos como bons para comparar com os envios. Serviços de verificação orientados por IA (por exemplo, o TruthScan's Autenticação de documentos médicos A solução de gerenciamento de conteúdo e metadados (SIP) pode analisar instantaneamente o conteúdo e os metadados de um documento para determinar se ele foi gerado ou alterado por máquina[50][51]. Eles observam inconsistências que podem passar despercebidas por um ser humano, como anomalias sutis de formatação ou metadados que indicam que uma imagem foi produzida por IA. Monitoramento em tempo real de registros de pacientes e solicitações de seguro para detectar anomalias também é essencial[52]. Ao examinar continuamente novas entradas (resultados de laboratório, anotações médicas, anexos de reclamações), esses sistemas podem detectar registros falsos antes de eles levam a pagamentos fraudulentos ou erros clínicos. Algumas seguradoras implementaram regras em que qualquer documentação de sinistro identificada como gerada por IA é automaticamente retirada para investigação de fraude. O objetivo é garantir que todos os registros médicos ou solicitações que entram no fluxo de trabalho são confiáveis e inalterados.

- Comprovação e validação de identidade: O fortalecimento da verificação de identidade é fundamental na era das identificações sintéticas. As entidades do setor de saúde devem aplicar rigorosa comprovação de identidade para novos pacientes, provedores e fornecedores. Isso pode envolver autenticação multifatorial, verificações biométricas (como reconhecimento facial ou impressões digitais no registro) e o uso de serviços de verificação de identidade que aproveitam a IA para detectar IDs falsas ou dados pessoais incompatíveis. Por exemplo, o reconhecimento facial pode ser combinado com testes de vivacidade para evitar que um rosto gerado por IA se passe por um paciente real por meio de uma foto. No back-end, os algoritmos podem fazer a verificação cruzada dos detalhes de um paciente (endereço, telefone, e-mail, presença na mídia social) para identificar identidades "finas" que não têm um histórico normal - uma conhecida revelação de IDs sintéticas[53]. As instituições financeiras têm usado essas verificações de consistência de antecedentes baseadas em IA com grande eficácia[54]A indústria da saúde pode fazer o mesmo: por exemplo, sinalizar um novo solicitante do Medicare se ele não tiver nenhuma pegada digital anterior a este ano. Validação de identidades de provedores é igualmente importante: garantir que o médico em um vídeo de telessaúde seja licenciado e seja realmente quem ele diz ser, talvez emitindo certificados digitais ou feeds de vídeo com marca d'água que sejam difíceis de imitar por deepfakes. Nas farmácias, a equipe deve verificar novamente as solicitações de prescrição incomuns por meio de chamadas diretas para os provedores e usar frases de código ou perguntas de verificação para derrotar possíveis impostores de voz de IA.

- Detecção integrada de fraudes em fluxos de trabalho: Para realmente proteger o sistema, a detecção de fraudes não pode ser uma etapa isolada - ela precisa ser integrado em todos os fluxos de trabalho em uma organização de saúde.

Na prática, isso significa que os hospitais e as seguradoras estão implementando integrações de API para chamar serviços de detecção de fraudes em momentos críticos. Por exemplo, quando um provedor envia um pedido de reembolso com documentos anexados, um serviço de IA pode avaliar automaticamente a autenticidade desses anexos em segundos. Se uma consulta de telessaúde for iniciada, a plataforma poderá executar uma análise de voz passiva em segundo plano para garantir que o autor da chamada não esteja usando uma voz sintetizada. Monitoramento contínuo também é fundamental: as plataformas modernas de fraude oferecem painéis que rastreiam sinais de fraude em toda a organização (validações fracassadas, sinalização frequente de reivindicações de uma determinada clínica etc.) para identificar padrões, como uma rede de fraude organizada operando em várias reivindicações. Ao tratar a fraude no setor de saúde mais como ameaças cibernéticas - com Monitoramento 24 horas por dia, 7 dias por semana, detecção de anomalias e resposta rápida a incidentes - as organizações podem detectar problemas antes que eles se agravem[55].

- IA para análise de fraudes e reconhecimento de padrões: O volume de dados do setor de saúde é tão grande que a IA é indispensável para encontrar padrões de fraude que os humanos não percebem. Os modelos de aprendizado de máquina podem ser treinados em casos de fraudes históricas para detectar novos casos (por exemplo, agrupamento de reivindicações que tenham códigos CID incomuns semelhantes ou identificação de quando o faturamento de um médico se desvia muito dos colegas). As seguradoras já estão usando a análise preditiva para pontuar os sinistros quanto ao risco de fraude em tempo real. Técnicas emergentes, como as redes neurais gráficas, podem mapear as relações entre pacientes, provedores, diagnósticos e reclamações para identificar conexões improváveis (como o mesmo número de série de dispositivo usado em reclamações de diferentes estados). O conjunto de fraudes de seguro do TruthScan, por exemplo, inclui reconhecimento de padrões de reclamações e modelagem preditiva para capturar redes de fraude organizadas e padrões atípicos antes que as perdas se acumulem[56][57]. O Fusion Center do DOJ de 2025 exemplificou essa abordagem - agregando dados do Medicare e de seguradoras privadas para encontrar proativamente grupos de atividades suspeitas[58]. As organizações de saúde também devem compartilhar dados e modelos de IA em consórcios para ampliar os sinais de fraude que cada um pode detectar. Quanto mais dados (dentro dos limites de privacidade) alimentam esses modelos, melhor eles se tornam para discernir o comportamento normal do fraudulento.

- Treinamento da equipe e controles de processo: A tecnologia é fundamental, mas a conscientização humana continua sendo uma defesa poderosa. A equipe de saúde e os administradores devem ser treinados sobre táticas de fraude habilitadas para IA - por exemplo, saber que um e-mail perfeitamente escrito de um CEO pode ser um phishing criado por IAou que eles deveriam verificar a identidade dos autores das chamadas de vídeo se algo parecer "estranho" (movimentos estranhos dos olhos ou atraso no áudio podem indicar um deepfake). Podem ser implementados exercícios e dicas regulares (semelhantes ao treinamento de conscientização sobre phishing) para novas ameaças, como golpes telefônicos de deepfake. Controles de processo simples adicionam camadas de segurança: exigir retornos de chamada ou verificação secundária para solicitações de pagamento grandes ou incomuns, usar canais de comunicação reconhecidamente seguros para informações confidenciais e manter um plano de resposta a incidentes especificamente para suspeita de fraude mediada por IA. É importante ressaltar que as organizações devem cultivar uma cultura em que os funcionários se sentem capacitados para questionar anomaliasMesmo que seja um "médico" em um vídeo fazendo uma solicitação estranha. Muitos golpes de deepfake são bem-sucedidos explorando a confiança e a autoridade; uma força de trabalho vigilante que conheça esses truques pode interromper os incidentes logo no início. Como observou um especialista, confrontar deepfakes pode se tornar tão rotineiro quanto detectar e-mails de phishing - uma parte padrão da higiene da segurança cibernética[32][59].

- Aproveitamento de serviços especializados: Dada a rápida evolução das ameaças de IA, muitas organizações de saúde fazem parcerias com provedores especializados em prevenção de fraudes. Serviços como TruthScan para o setor de saúde oferecem soluções de ponta a ponta adaptadas a casos de uso médico, incluindo: monitoramento em tempo real da integridade de registros médicos eletrônicos (EMR), verificação de documentos do paciente contra manipulação de IA, detecção de deepfake para telessaúde e relatórios de conformidade (por exemplo, trilhas de auditoria que comprovam a devida diligência na detecção de fraudes para reguladores)[60][51]. Essas plataformas geralmente oferecem Integração de API para uma adaptação perfeita aos sistemas existentes e são desenvolvidos para atender às normas de saúde (HIPAA, GDPR)[61][62]. Ao usar ferramentas de nível empresarial, até mesmo clínicas menores ou seguradoras regionais podem ter acesso a recursos avançados de detecção de IA sem desenvolvê-los internamente. Além disso, as seguradoras e os provedores devem ficar atentos às atualizações nas regulamentações e nos padrões do setor - por exemplo, novas leis contra fraudes de deepfake (algumas jurisdições agora proíbem explicitamente as deepfakes médicas, e os EUA estão expandindo os estatutos de roubo de identidade para abranger a imitação de IA).[63]). O alinhamento com esses padrões e a implementação de ferramentas de última geração não só reduzirão as perdas por fraude, mas também demonstrarão uma postura de segurança sólida para parceiros, auditores e pacientes.

Conclusão e perspectivas

O ano de 2025 demonstrou que a o gênio está fora da garrafa - A IA generativa e a automação estão agora entrelaçadas com a fraude na área da saúde. No futuro, os fraudadores provavelmente continuarão a inovar: poderemos ver modelos de IA que aprendem a imitar estilos de escrita de médicos específicos ou deepfakes que reagem em tempo real a perguntas desafiadoras. A batalha será uma corrida armamentista contínua. No entanto, o setor de saúde está respondendo com o mesmo vigor, investindo em defesas com tecnologia de IA e fluxos de trabalho de segurança mais rígidos. Ao combinar tecnologia de detecção de ponta, processos de verificação rigorosos, compartilhamento de dados entre setores e vigilância dos funcionáriosSe a fraude for cometida por uma IA, as organizações de saúde podem mitigar substancialmente a ameaça de fraude facilitada por IA.

Crucialmente, esse não é apenas um problema de TI - é um problema de governança e confiança. As diretorias e os executivos do setor de saúde devem reconhecer a fraude de IA como um risco estratégico para as finanças e a confiança dos pacientes, garantindo atenção e recursos regulares. As equipes de conformidade devem atualizar as avaliações de risco de fraude para incluir aspectos de IA, e as seguradoras podem repensar as suposições de subscrição sabendo que uma determinada porcentagem de sinistros pode ser fraude assistida por IA. Por outro lado, o uso ético da IA na área da saúde (para suporte a decisões clínicas, eficiência de faturamento, etc.) continuará a trazer grandes benefícios, desde que existam fortes salvaguardas para evitar abusos.

Em resumo, a IA generativa mudou o jogo da fraude na área da saúde, mas com conscientização e contramedidas avançadas, ele não precisa sobrecarregar o sistema. As organizações bem-sucedidas serão aquelas que se mantiverem informadas sobre as ameaças emergentes, se adaptarem rapidamente com defesas orientadas por IA e promoverem uma cultura de "verificar e confiar" em vez de "confiar por padrão". Ao fazer isso, a área da saúde pode aproveitar com segurança os aspectos positivos da IA e, ao mesmo tempo, neutralizar seu uso indevido, protegendo os resultados financeiros e o bem-estar dos pacientes na era digital.

Fontes: Relatórios e casos recentes do setor, conforme citado acima, incluindo Pymnts (julho de 2025)[2][3]Instituto Swiss Re (junho de 2025)[27]Banco da Reserva Federal de Boston (abril de 2025)[19], BMJ (2024)[37]e resumos de soluções TruthScan (2025)[51][64]entre outros. Todos os dados e citações refletem o que há de mais recente disponível em 2024-2025, ilustrando o estado atual da fraude impulsionada por IA no setor de saúde e as respostas para combatê-la.

[1] [2] [3] [9] [10] [11] [12] [13] [14] [15] [41] [42] [55] [58] DOJ credita ferramentas de IA na histórica repressão à fraude no setor de saúde

[4] [5] [6] [7] [16] [40] [44] [45] Estatísticas e tendências do Deepfake para 2025 - Principais dados e percepções - Keepnet

https://keepnetlabs.com/blog/deepfake-statistics-and-trends

[8] Deepfakes e a crise do conhecimento | UNESCO

https://www.unesco.org/en/articles/deepfakes-and-crisis-knowing

[17] [18] [19] [20] [21] [22] [23] [24] [53] [54] A geração de IA está aumentando a ameaça de fraude de identidade sintética - Federal Reserve Bank of Boston

[25] [26] [56] [57] [62] [64] Detecção de fraude por IA em seguros de vida e saúde | TruthScan

https://truthscan.com/solutions/health-life-commercial-insurance-fraud-detection-solution

[27] [43] Como deepfakes, desinformação e IA amplificam a fraude de seguros | Swiss Re

[28] DEA alerta sobre fraude na prescrição eletrônica - Pharmacy Practice News

[29] [39] Fraude e segurança cibernética no setor de saúde: Um mergulho profundo nos maiores riscos e defesas da atualidade | CrossClassify

https://www.crossclassify.com/resources/articles/healthcare-cybersecurity-and-fraud/

[30] [31] [32] [59] A ameaça em evolução dos golpes de telemedicina Deepfake, Mike Ruggio

https://insights.taylorduma.com/post/102jkzn/the-evolving-threat-of-deepfake-telemedicine-scams

[33] [34] Especialistas alertam sobre golpistas que usam 'deepfakes' de médicos famosos nas mídias sociais

[35] [36] [37] Médicos confiáveis da TV "deepfaked" para promover golpes de saúde nas mídias sociais - BMJ Group

https://bmjgroup.com/trusted-tv-doctors-deepfaked-to-promote-health-scams-on-social-media/

[38] [PDF] estado atual da pesquisa Ajit Appari e M. Eric Johnson

http://mba.tuck.dartmouth.edu/digital/Research/ResearchProjects/AJIJIEM.pdf

[46] [47] [48] [49] TruthScan - Detecção de IA empresarial e segurança de conteúdo

[50] [51] [52] [60] [61] Detecção de fraude em registros médicos por IA | Soluções CRO para o setor de saúde | TruthScan

https://truthscan.com/solutions/healthcare-cro-fraud-detection

[63] Qual é o perigo das deepfakes e de outras fraudes baseadas em IA?