Há apenas alguns anos, era necessário um estúdio profissional e muita habilidade técnica para imitar a voz de alguém.

Agora, qualquer pessoa com uma conexão à Internet e algum tempo livre pode criar um clone digital da voz de qualquer pessoa em menos de um minuto.

As ferramentas para esses ataques estão se tornando mais baratas e mais acessíveis a cada dia para todos. E como muitas pessoas compartilham suas vidas nas mídias sociais, é muito fácil para um golpista encontrar o áudio de que precisa.

Neste artigo, mostraremos alguns dos exemplos mais notórios de fraude de áudio no mundo real. Também apresentaremos uma solução para pôr um fim oportuno a essas ameaças.

Principais conclusões

- As tentativas de fraude de deepfake de voz aumentaram em mais de 2.137% nos últimos anos, impulsionadas pelo fato de que a IA moderna pode gerar um clone de voz 85% preciso usando apenas três segundos de áudio de origem.

- Os ataques notórios do mundo real incluem o assalto à empresa de engenharia Arup em 2024, em que os golpistas usaram vídeo e áudio deepfake de um CFO para enganar um funcionário e fazê-lo transferir $25,6 milhões.

- Além do roubo corporativo, os deepfakes de voz representam graves riscos emocionais para as famílias por meio de golpes de sequestro e podem contornar os sistemas tradicionais de segurança biométrica usados por bancos e outros aplicativos de alta segurança.

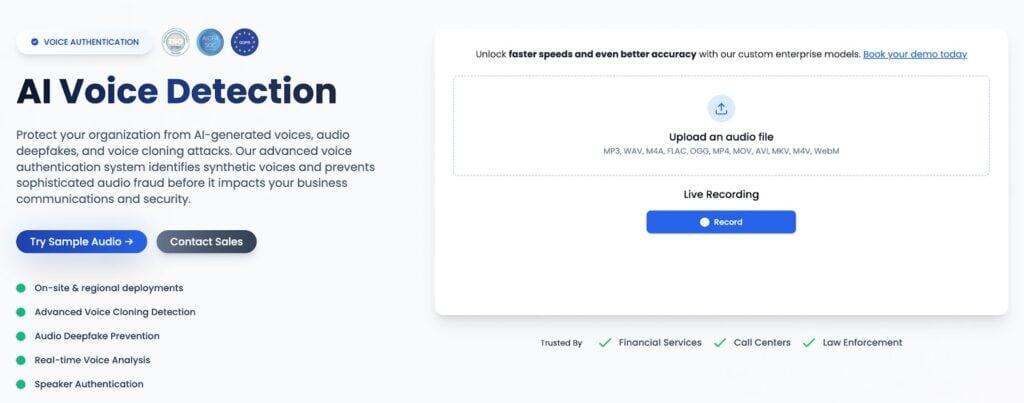

- As organizações são forçadas a ir além da verificação humana, implementando protocolos de aprovação de várias pessoas para grandes transferências e implantando detectores de voz com IA, como o TruthScan, para analisar impressões digitais acústicas em tempo real.

- O TruthScan protege as interações empresariais identificando artefatos de fala sintética de plataformas como ElevenLabs e Murf com precisão superior a 99% em todos os principais formatos de áudio e vídeo.

O que são ataques de voz Deepfake?

Um deepfake de voz é uma falsificação digital da voz de alguém. O invasor usa um software que pode analisar cada pequeno detalhe sobre como alguém fala a partir de uma gravação de sua voz.

Para clonar a voz, o software tenta perceber padrões na voz. O software leva em consideração, principalmente, aspectos como o tom, o timbre, a forma como a pessoa respira entre as frases, etc.

Depois de aprender esses padrões, o invasor pode fazer com que ele diga qualquer coisa com essa voz.

Nunca mais se preocupe com fraudes de IA. TruthScan Pode lhe ajudar:

- Detectar IA gerada imagens, texto, voz e vídeo.

- Evitar grande fraude impulsionada por IA.

- Proteja seus mais sensível ativos da empresa.

O que é perigoso é que as ferramentas de criação de deepfake de voz são facilmente acessíveis. E a maioria delas não precisa de instalação. Elas estão disponíveis on-line na forma de sites.

Você só precisa desembolsar alguns dólares e começar a clonar vozes. Se você pesquisar um pouco mais, poderá até encontrar ferramentas que permitem clonar vozes gratuitamente.

Essa tecnologia nova e facilmente disponível levou a um aumento acentuado nas fraudes de áudio.

Os golpistas só precisam de uma pequena parte do áudio de alguém, que podem obter nas mídias sociais ou em algum outro canal público, para cloná-lo.

Em seguida, eles podem usar a voz clonada para se passar por uma pessoa em situações como chamadas telefônicas ao vivo, reuniões por vídeo, anotações de voz, anúncios etc.

Esses não são apenas casos de uso hipotéticos de ataques de deepfake de voz. Essas coisas já aconteceram. Abordaremos alguns dos notórios ataques de deepfake de voz mais adiante.

Riscos potenciais de ataques de deepfake de voz

Ao ouvir falar em deepfake de voz, você pode ter imaginado um vídeo engraçado de uma celebridade dizendo coisas que ela nunca disse.

Mas esse uso aparentemente inócuo da voz clonada pode causar sérios danos às partes envolvidas. Vamos falar sobre os riscos.

Devastação financeira para as empresas

Um deepfake de voz pode arruinar a reputação de uma empresa para sempre. Ele também tem o poder de roubar grandes somas de dinheiro em minutos.

Como assim, você pode se perguntar? Os golpistas podem clonar a voz do chefe de uma empresa e usá-la para ligar para os funcionários e obrigá-los a fazer coisas que não deveriam ser feitas, como transferir dinheiro para uma conta.

Este é apenas um exemplo. As possibilidades são infinitas.

Contornar sistemas de segurança

Sua voz é uma biometria que ninguém mais deveria ter. Isso porque você a usa como uma senha para fazer login em muitos de seus aplicativos, especialmente os bancários.

Embora esses aplicativos possam ter um sistema integrado de verificação automática de voz para impedir o acesso não autorizado, um bom clone de voz ainda tem a chance de enganá-los.

O ônus emocional para as famílias

Talvez os alvos mais fáceis para os fraudadores de áudio sejam as pessoas idosas da família. Os pais e os avós, por exemplo.

Os golpistas podem ligar, digamos, para uma mãe e reproduzir o som de sua filha pedindo socorro, dizendo que ela foi sequestrada.

Diminuição da confiança no local de trabalho

Os ataques de voz deepfake também prejudicam a confiança em um local de trabalho saudável.

Os funcionários terão que verificar novamente as chamadas telefônicas de seus gerentes para ter certeza de que não se trata de um golpista ordenando que eles façam coisas arriscadas com uma voz clonada.

Então, quais são suas opções, se não a dupla verificação manual? Todos os riscos que acabamos de discutir apontam para a necessidade de uma prevenção automatizada de ataques deepfake.

Felizmente, agora temos ferramentas de detecção de voz com IA deepfake, sendo o TruthScan uma delas.

Evite fraudes e falsificação de identidade com o sistema TruthScan Detector de voz AI.

Exemplos reais de ataques de deepfake de voz

Graças à IA, chegamos a um ponto em que não podemos confiar prontamente no que nossos olhos veem ou nossos ouvidos ouvem. A IA agora é capaz de criar imagens e vídeos realistas. O mesmo vale para o áudio.

Você já deve ter ouvido histórias de pessoas que caíram na fraude do deepfake audio. Elas também aparecem de tempos em tempos nos noticiários e nas mídias sociais. Algumas delas são difíceis de entender.

Vamos falar sobre alguns dos mais notórios ataques de deepfake de voz para que você possa ter uma boa ideia de como eles são executados de forma inteligente.

A reunião virtual de $25 milhões que nunca aconteceu de fato

Esse ataque deepfake é provavelmente o mais relatado.

O A vítima foi uma empresa de engenharia do Reino Unido chamada Arup, mas o golpe teve origem em seu escritório em Hong Kong.

Era início de 2024 quando um funcionário do departamento financeiro da empresa recebeu um e-mail do diretor financeiro da empresa no Reino Unido. No e-mail, o funcionário estava sendo orientado pelo CFO a fazer transferências secretas de dinheiro para algumas contas bancárias.

No início, o funcionário ficou bastante desconfiado porque a solicitação parecia um pouco estranha e ele pensou que poderia ser um golpe de phishing.

Mas então o funcionário foi convidado para uma chamada de videoconferência. Quando o funcionário entrou na chamada, ele viu o que parecia ser exatamente o CFO e vários outros colegas seniores.

Todos pareciam e soavam exatamente como deveriam. Eles também estavam conversando entre si para que tudo parecesse mais real.

Isso eliminou completamente todas as dúvidas do funcionário do departamento financeiro, que então enviou mais de $25,6 milhões (~HK$200 milhões) para várias contas bancárias diferentes de Hong Kong por meio de 15 transações.

Mais tarde, descobriu-se que todo esse esquema era uma farsa. Nenhuma pessoa na chamada era quem parecia ser, exceto o funcionário da Arup. Os golpistas haviam coordenado perfeitamente o ataque usando clones de áudio e vídeo de alta qualidade do diretor financeiro e dos funcionários seniores da empresa.

O ministro italiano e os ícones da moda

Esse também ocorreu em 2024. A falso ministro da defesa italiano Guido Crosetto telefonou para várias elites italianas e solicitou sua ajuda financeira imediata para resgatar os jornalistas que haviam sido sequestrados.

Na ligação, o falso Guido Crosetto afirmou que se tratava de uma operação ultrassecreta do governo. O autor da chamada conseguiu até mesmo falar ao telefone com figuras lendárias da moda, como Giorgio Armani.

Infelizmente, uma pessoa acabou transferindo cerca de um milhão de dólares. Ela provavelmente tinha um senso mais forte de dever patriótico para ajudar do que outras pessoas, o que os golpistas conseguiram explorar.

O roubo de energia de $243.000 no Reino Unido

Isso aconteceu em 2019 e foi provavelmente o primeiro deepfake dessa escala já relatado.

Um CEO de uma empresa de energia do Reino Unido pensou que estava ao telefone com seu chefe da matriz na Alemanha.

O CEO recebeu ordens para transferir cerca de 220.000 euros ($243.000) para um fornecedor na Hungria. Disseram-lhe que se tratava de um negócio crítico que precisava de transferência imediata. O CEO caiu no golpe e transferiu o dinheiro.

Uma ligação aterrorizante para uma mãe no Arizona

Lembra que falamos sobre o fato de os deepfakes de áudio serem uma ameaça para as famílias? O exemplo do golpe que demos aconteceu de fato.

Os golpistas clonaram a voz de uma menina de 15 anos de um vídeo dela nas mídias sociais. Em seguida, ligaram para a mãe dela e alegaram, na voz da filha, que ela havia sido sequestrada e que os sequestradores estavam exigindo um resgate imediato.

Felizmente, o pai conseguiu ligar para a filha verdadeira, que estava em segurança em um treino de esqui durante toda a situação. Eles se esquivaram do golpe.

Como os deepfakes de voz afetam as empresas

O principal objetivo de um ataque de deepfake de voz é principalmente roubar dinheiro.

Mas quando o alvo são as empresas, o dano é multidimensional.

Por exemplo, os deepfakes podem envenenar a atmosfera entre os funcionários de uma empresa. Ele tem o potencial de criar uma cultura em que os funcionários estão sempre com medo de cometer um erro.

Veja o exemplo das centrais de atendimento. Estamos vendo relatos de criminosos cibernéticos ligando para elas e fingindo ser clientes específicos.

Seu truque é fazer com que os agentes do call center alterem os detalhes da conta desses clientes (por exemplo, endereços residenciais, números de telefone) e assumam o controle de suas contas.

A contratação remota e as entrevistas virtuais são outra área em que as vozes falsas podem ser usadas pelos candidatos para conseguir empregos para os quais não estão qualificados.

Protegendo as empresas contra ataques de deepfake de voz

As regras de segurança tradicionais das empresas foram escritas na era pré-AI.

Está mais do que na hora de as empresas reconsiderarem isso. Primeiro, elas devem começar a se informar sobre as muitas novas ameaças cibernéticas decorrentes do abuso da IA.

Por exemplo, eles podem organizar sessões de treinamento para toda a equipe e mostrar-lhes exemplos reais de fraude de áudio. Você pode começar com os exemplos que acabamos de discutir acima. Essas sessões de treinamento também devem dar a eles dicas de prevenção de ataques de deepfake para diferentes cenários.

Em seguida, você pode ir em frente e atualizar as políticas internas da empresa. Uma mudança importante pode ser parar de permitir que uma única pessoa autorize transferências eletrônicas em massa por conta própria.

Grandes pagamentos devem exigir a aprovação de um painel inteiro para que pelo menos um deles possa perceber a tempo que algo está errado.

Você também deve pensar em integrar um Detector de voz AI para ser executado em segundo plano durante as chamadas.

É para isso que as ferramentas de IA do TruthScan foram criadas. Você pode detectar, verificar e evitar ataques de deepfake de voz usando nossas ferramentas de IA. Vamos lhe dizer como.

Como o TruthScan protege as interações de voz

Entendemos que os funcionários não conseguem, sozinhos, distinguir uma voz grave de uma voz real no meio de uma chamada estressante. Eles precisam de um assistente dedicado que possa lidar com esse trabalho durante uma chamada, enquanto sua equipe pode se concentrar em fazer aquilo para o qual foi contratada.

Nosso Detector de voz AI é uma solução dedicada.

Veja a seguir como ele funciona e do que é capaz:

- Analisa milhões de pontos de dados diferentes em chamadas telefônicas e reuniões por vídeo ao vivo e oferece precisão de 99%

- Emite um aviso instantaneamente após detectar uma voz falsa

- Captura padrões espectrais e impressões digitais acústicas na voz que só são deixados para trás por modelos sintéticos

- Integra-se à sua central de atendimento ou help desk existente por meio de uma API REST simples

- Pode digitalizar todos os principais formatos de áudio e vídeo

Fale com o TruthScan sobre a prevenção de ataques de deepfake de voz

Você pode impedir a fraude de clonagem de voz em tempo real com o TruthScan, mas a questão é: quando você vai começar? Seus funcionários podem, mais cedo ou mais tarde, cometer um erro e fazer com que você seja enganado. Não espere por esse momento infeliz.

Nosso detector de voz com IA pode sinalizar deepfakes de voz usando plataformas como ElevenLabs e Murf.

Ele funciona em segundo plano durante chamadas telefônicas ao vivo e reuniões por vídeo, para que seus agentes de chamadas não precisem realizar várias tarefas.

Tudo o que você precisa é de uma rápida integração por meio de nossa API REST.

Comece a usar TruthScan agora e proteja sua empresa contra golpes de deepfake.